Andersons vinkel

Varför språkmodeller blir “förlorade” i samtal

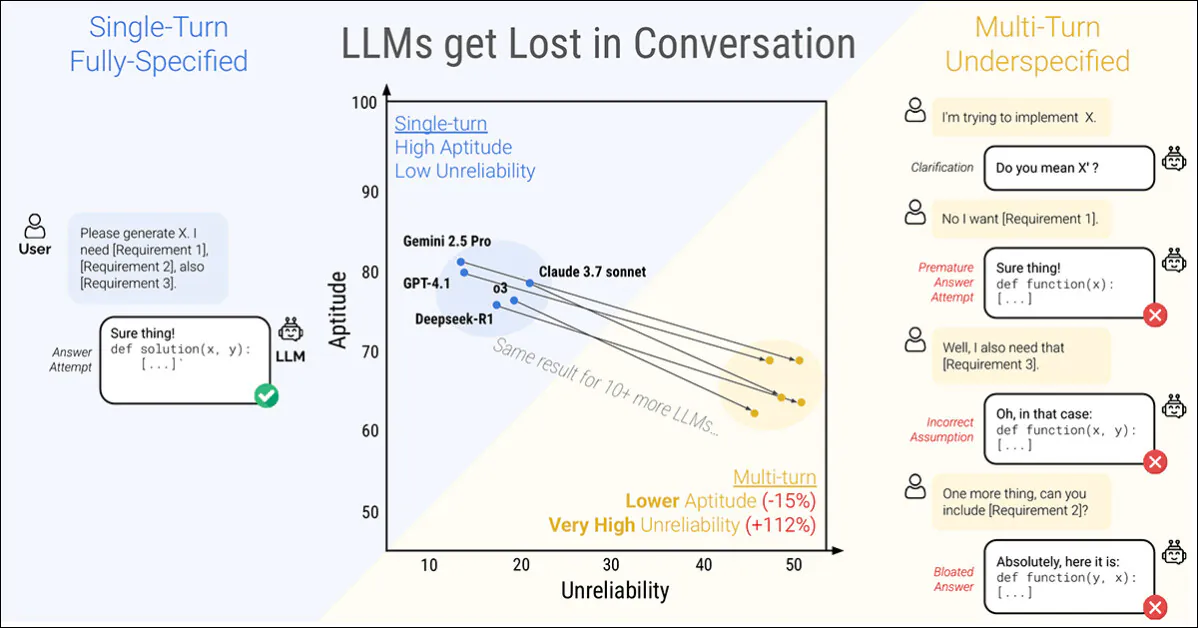

En ny rapport från Microsoft Research och Salesforce visar att även de mest kapabla stora språkmodellerna (LLM) bryter samman när instruktioner ges i etapper snarare än allt på en gång. Författarna fann att prestandan minskar med i genomsnitt 39 procent över sex uppgifter när en prompt delas upp över flera varv:

Ett enskilt varvs samtal (vänster) ger de bästa resultaten, men är onaturligt för slutanvändaren. Ett flervarvs samtal (höger) visar att även de högst rankade och mest presterande LLMerna förlorar den effektiva impulsen i ett samtal. Källa: https://arxiv.org/pdf/2505.06120

Mer anmärkningsvärt är att tillförlitligheten hos svaren tar en nosedive, med prestigefyllda modeller som ChatGPT-4.1 och Gemini 2.5 Pro som svänger mellan nästan perfekta svar och uppenbara misslyckanden, beroende på hur samma uppgift uttrycks; dessutom kan utdatakonsekvensen minska med mer än hälften under processen.

För att undersöka detta beteende introducerar rapporten en metod som kallas sharding*, som delar upp fullt specificerade promptrar i mindre fragment och släpper ut dem en i taget i ett samtal.

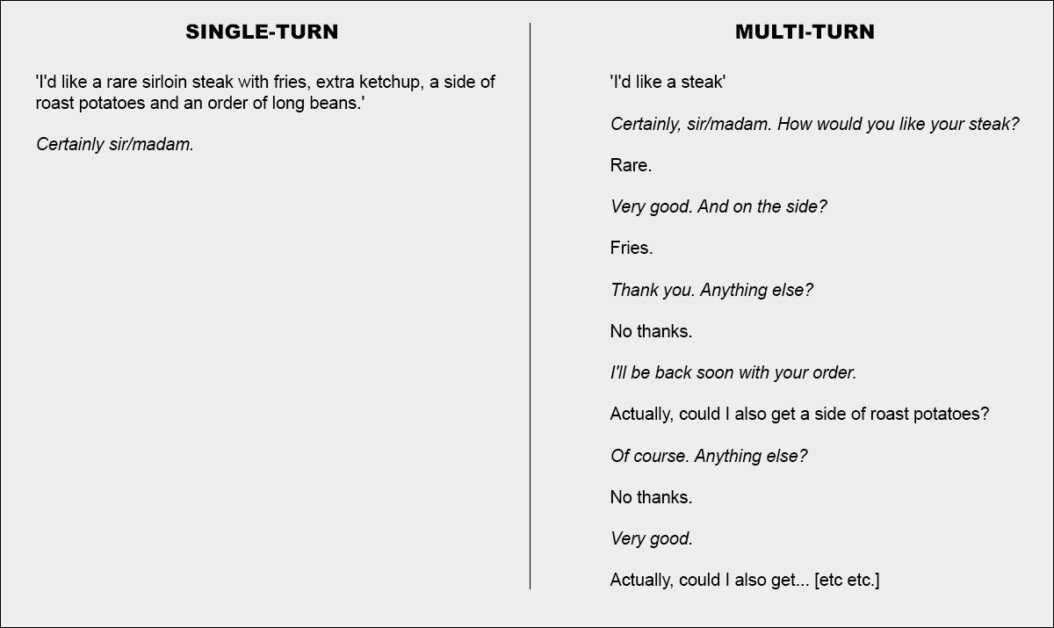

I de mest grundläggande termer är detta ekvivalent med att ge en sammanhållen och omfattande enskild order på en restaurang, och lämna kyparen med ingenting att göra än att erkänna begäran; eller också bestämma sig för att angripa saken samarbetande:

Två extrema versioner av ett restaurangssamtal (inte från den nya rapporten, för illustrativa ändamål endast).

För tydlighet kanske exemplet ovan sätter kunden i ett negativt ljus. Men den grundläggande idén som avbildas i den andra kolumnen är den om en transaktionsbaserad utbyte som förtydligar ett problem innan det angrips – uppenbarligen ett rationellt och rimligt sätt att närma sig en uppgift.

Denna inställning återspeglas i den nya arbets sharded-tillvägagångssätt för LLM-interaktion. Författarna noterar att LLMer ofta genererar överdrivet långa svar och sedan fortsätter att förlita sig på sina egna insikter även efter att dessa insikter har visat sig vara felaktiga eller irrelevanta. Denna tendens, i kombination med andra faktorer, kan orsaka att systemet förlorar spåret helt.

I själva verket noterar forskarna vad många av oss har funnit anekdotiskt – att det bästa sättet att få samtalet tillbaka på rätt spår är att starta ett nytt samtal med LLM:

‘Om ett samtal med en LLM inte ledde till förväntade resultat, kan startandet av ett nytt samtal som upprepar samma information ge betydligt bättre resultat än att fortsätta ett pågående samtal.

‘Detta beror på att nuvarande LLMer kan bli förlorade i samtalet, och våra experiment visar att att fortsätta i ett samtal med modellen är ineffektivt. Dessutom, eftersom LLMer genererar text med slumpmässighet, kan ett nytt samtal leda till förbättrade resultat.’

Författarna erkänner att agenter som Autogen eller LangChain potentiellt kan förbättra resultaten genom att fungera som tolkningslager mellan slutanvändaren och LLM, och endast kommunicera med LLM när de har samlat tillräckligt med sharded-svar för att koagulera till en enda sammanhållen fråga (som slutanvändaren inte kommer att utsättas för).

Men författarna hävdar att ett separat abstraktionslager inte bör vara nödvändigt, eller så bör det byggas direkt in i käll-LLM:

‘Ett argument kan göras för att flervarvsförmåga inte är en nödvändig funktion för LLMer, eftersom det kan avlastas till agentramverket. Med andra ord, behöver vi nativ flervarvsstöd i LLMer när ett agentramverk kan orkestrera interaktioner med användare och utnyttja LLMer endast som enkelvarvsoperatörer?…’

Men efter att ha testat påståendet över hela deras uppsättning exempel, drar de slutsatsen:

‘[Att förlita sig på] ett agentliknande ramverk för att bearbeta information kan vara begränsande, och vi hävdar att LLMer bör stödja flervarvsinteraktion naturligt.’

Denna intressanta nya rapport heter LLMer förlorar sig i flervarvssamtal, och kommer från fyra forskare över MS Research och Salesforce,

Fragmenterade samtal

Den nya metoden delar först upp konventionella enkelvarvsinstruktioner i mindre fragment, utformade för att introduceras vid viktiga ögonblick under en LLM-interaktion, en struktur som återspeglar den utforskande, växelvisa stilen i system som ChatGPT eller Google Gemini.

Varje ursprunglig instruktion är en enda, självinnehållande prompt som levererar hela uppgiften på en gång, som kombinerar en högnivåfråga, stödande kontext och eventuella relevanta villkor. Den sharded-versionen bryter detta i flera mindre delar, med varje fragment som lägger till bara en bit information:

Parade instruktioner som visar (a) en fullständig prompt som levereras i ett enda varv och (b) dess sharded-version som används för att simulera ett underspecificeerat, flervarvssamtal. Semantiskt levererar varje version samma informativa payload.

Det första fragmentet introducerar alltid huvudmålet för uppgiften, medan resten tillhandahåller förtydligande detaljer. Tillsammans levererar de samma innehåll som den ursprungliga prompten, men spridda naturligt över flera varv i samtalet.