Artificiell intelligens

Varför kan generativa videosystem inte skapa kompletta filmer?

Framstegen inom generativ AI-video har fått många som följer utvecklingen att förutsäga att maskinlärning kommer att innebära dödsstöten för filmindustrin som vi känner den – istället kommer enskilda skapare att kunna skapa Hollywood-inspirerade blockbusters hemma, antingen på lokala eller molnbaserade GPU-system.

Är detta möjligt? Även om det är möjligt, är det verkligen nära förestående, som så många tror?

Att individer så småningom kommer att kunna skapa filmer, i den form vi känner dem, med konsekventa karaktärer, berättelsekontinuitet och total fotorealism, är ganska möjligt – och kanske till och med oundvikligt.

Men det finns flera grundläggande skäl till varför detta inte sannolikt kommer att ske med videosystem baserade på Latent Diffusionsmodeller.

Denna sista punkt är viktig eftersom det för närvarande inkluderar varje populär text-till-video (T2) och bild-till-video (I2V) system som finns tillgängligt, inklusive Minimax, Kling, Sora, Imagen, Luma, Amazon Video Generator, Runway ML, Kaiber (och, så långt vi kan avgöra, Adobes kommande videofunktion i Firefly); bland många andra.

Här överväger vi utsikten till sanna auteur fullängds gen-AI-produktioner, skapade av individer, med konsekventa karaktärer, cinematografi och visuella effekter som är åtminstone lika bra som den nuvarande tillståndet i Hollywood.

Låt oss ta en titt på några av de största praktiska hindren för utmaningarna som är inblandade.

1: Du kan inte få en exakt uppföljningsbild

Berättelseinkonsekvens är det största av dessa hinder. Faktum är att inget nu tillgängligt videoskapande system kan skapa en verkligt exakt “uppföljningsbild”.

Detta beror på att denoising diffusionsmodellen i hjärtat av dessa system bygger på slumpmässig brus, och denna kärnprincip är inte mottaglig för att tolka exakt samma innehåll två gånger (dvs. från olika vinklar, eller genom att utveckla den tidigare bilden till en uppföljningsbild som upprätthåller konsekvens med den tidigare bilden).

Där textprompts används, antingen ensamma eller tillsammans med uppladdade “seed”-bilder (multimodalt indata), kommer token från prompten att framkalla semantiskt lämpligt innehåll från den tränade latenta utrymmet i modellen.

Men, ytterligare hämmad av “slumpmässig brus”-faktorn, kommer den aldrig att göra det på samma sätt två gånger.

Detta innebär att identiteterna för personer i videon tenderar att skifta, och föremål och miljöer kommer inte att matcha den initiala bilden.

Detta är varför virala klipp som visar extraordinära visuella effekter och Hollywood-nivåutmatning tenderar att vara antingen enstaka bilder eller en “showcase-montage” av systemets förmågor, där varje bild visar olika karaktärer och miljöer.

Utdrag från en generativ AI-montage av Marco van Hylckama Vlieg – källa: https://www.linkedin.com/posts/marcovhv_thanks-to-generative-ai-we-are-all-filmmakers-activity-7240024800906076160-nEXZ/

Antydningen i dessa samlingar av ad hoc-videogenereringar (som kan vara oärliga i fallet med kommersiella system) är att det underliggande systemet kan skapa sammanhängande och konsekventa berättelser.

Analogin som utnyttjas här är en filmtrailer, som visar bara en eller två minuter av filmen, men ger publiken anledning att tro att hela filmen existerar.

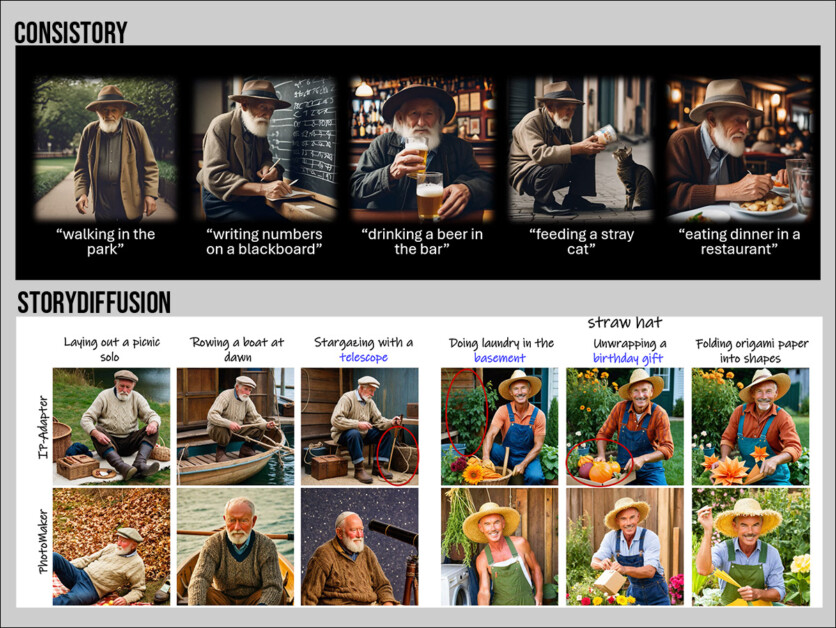

De enda system som för närvarande erbjuder berättelsekonsekvens i en diffusionsmodell är de som producerar stillbilder. Dessa inkluderar NVIDIAs ConsiStory, och diverse projekt i den vetenskapliga litteraturen, som TheaterGen, DreamStory och StoryDiffusion.

Två exempel på ‘statisk’ berättelsekontinuitet, från nyliga modeller:: Källor: https://research.nvidia.com/labs/par/consistory/ och https://arxiv.org/pdf/2405.01434

I teorin kunde man använda en bättre version av sådana system (inget av ovanstående är verkligen konsekvent) för att skapa en serie bild-till-video-bilder, som kunde strängas samman till en sekvens.

Vid den nuvarande tillståndet i konsten producerar denna metod inte trovärdiga uppföljningsbilder; och, i vilket fall som helst, har vi redan avvikit från auteur-drömmen genom att lägga till en nivå av komplexitet.

Vi kan, dessutom, använda Low Rank Adaptation (LoRA) modeller, specifikt tränade på karaktärer, saker eller miljöer, för att upprätthålla bättre konsekvens över bilder.

Men, om en karaktär vill dyka upp i en ny kostym, behöver en helt ny LoRA vanligtvis tränas som inkarnerar karaktären iklädd den fashionen (även om underbegrepp som ‘röd klänning’ kan tränas in i individuella LoRAs, tillsammans med lämpliga bilder, är de inte alltid lätta att arbeta med).

Detta lägger till betydande komplexitet, även till en öppningsscen i en film, där en person klär av sig, sätter på en morgonrock, gäspningar, tittar ut genom sovrumsfönstret och går till badrummet för att borsta tänderna.

En sådan scen, som innehåller ungefär 4-8 bilder, kan filmas på en morgon med konventionella filmproduktionsförfaranden; vid den nuvarande tillståndet i konsten för generativ AI, representerar den potentiellt veckor av arbete, flera tränade LoRAs (eller andra hjälpsystem), och en betydande mängd efterbearbetning

Alternativt kan video-till-video användas, där alldagliga eller CGI-filmer omvandlas genom textprompts till alternativa tolkningar. Runway erbjuder till exempel ett sådant system.

CGI (till vänster) från Blender, tolkad i en textbaserad Runway video-till-video-experiment av Mathieu Visnjevec – Källa: https://www.linkedin.com/feed/update/urn:li:activity:7240525965309726721/

Det finns två problem här: du måste redan skapa den grundläggande filmen, så du gör redan filmen två gånger, även om du använder ett syntetiskt system som UnReals MetaHuman.

Om du skapar CGI-modeller (som i klippet ovan) och använder dem i en video-till-bild-omvandling, kan deras konsekvens över bilder inte lita på.

Detta beror på att video-diffusionsmodeller inte ser den “stora bilden” – snarare skapar de en ny bild baserad på tidigare bild/er, och i vissa fall, överväger de en närliggande framtida bild; men, för att jämföra processen med ett schackspel, kan de inte tänka “tio drag framåt”, och kan inte komma ihåg tio drag bakåt.

För det andra kommer en diffusionsmodell fortfarande att kämpa för att upprätthålla ett konsekvent utseende över bilderna, även om du inkluderar flera LoRAs för karaktär, miljö och ljusstil, av skäl som nämns i början av denna sektion.

2: Du kan inte redigera en bild lätt

Om du visar en karaktär som går nerför en gata med hjälp av traditionella CGI-metoder, och du bestämmer dig för att ändra något aspekt av bilden, kan du justera modellen och rendera den igen.

Om det är en riktig inspelning, återställer du den och spelar in den igen, med lämpliga ändringar.

Men, om du producerar en gen-AI-video-bild som du älskar, men vill ändra en aspekt av den, kan du bara uppnå detta genom smärtsamma efterbearbetningsmetoder som utvecklats under de senaste 30-40 åren: CGI, rotoscoping, modellering och matning – alla arbetskrävande och dyra, tidskrävande procedurer.

Sättet som diffusionsmodeller fungerar på, kommer enkla ändringar av en textprompt (även i en multimodal prompt, där du tillhandahåller en komplett källseed-bild) att ändra flera aspekter av den genererade utmatningen, vilket leder till en lek av “whack-a-mole”.

3: Du kan inte lita på fysikens lagar

Traditionella CGI-metoder erbjuder en mängd algoritmiska fysikbaserade modeller som kan simulera saker som fluiddynamik, gasrörelse, invers kinematik (exakt modellering av mänsklig rörelse), tygdynamik, explosioner och diverse andra verkliga fenomen.

Men, diffusionsbaserade metoder, som vi har sett, har korta minnen, och också en begränsad mängd rörelsepriorer (exempel på sådana handlingar, inkluderade i träningsdata) att dra på.

I en tidigare version av OpenAIs landningssida för det hyllade Sora-generativa systemet, medgav företaget att Sora har begränsningar på detta område (även om denna text har tagits bort sedan dess):

‘[Sora] kan ha svårt att simulera fysiken i en komplex scen, och kan inte förstå specifika instanser av orsak och verkan (till exempel: en kaka kanske inte visar ett märke efter att en karaktär bitit i den).

‘Modellen kan också förväxla spatiala detaljer som ingår i en prompt, som att skilja vänster från höger, eller kämpa med precisa beskrivningar av händelser som utvecklas över tid, som specifika kamerabanor.’

Den praktiska användningen av olika API-baserade generativa videosystem visar liknande begränsningar i att visa precisa fysiska fenomen. Men, vissa vanliga fysiska fenomen, som explosioner, verkar vara bättre representerade i deras träningsdata.

Vissa rörelseprior-inkapslingar, antingen tränade in i den generativa modellen eller matade in från en källvideo, tar en stund att slutföra (som en person som utför en komplex och icke-repetitiv danssekvens i en påkostad kostym) och, än en gång, kommer diffusionsmodellens korta uppmärksamhetsfönster sannolikt att omvandla innehållet (ansikts-ID, kostymdetaljer etc.) innan rörelsen har spelats ut. Men, LoRAs kan mildra detta, till en viss grad.

Laga det i efterbearbetning

Det finns andra brister i ren “enskild användare” AI-videogenerering, som svårigheten att visa snabba rörelser, och det allmänna och mycket mer pressande problemet att uppnå tidsmässig konsekvens i utmatningsvideo.

Dessutom är att skapa specifika ansiktsprestationer nästan uteslutande en fråga om tur i generativ video, liksom lip-sync för dialog.

I båda fallen är användningen av hjälpsystem som LivePortrait och AnimateDiff mycket populär i VFX-gemenskapen, eftersom detta tillåter överföring av åtminstone breda ansiktsuttryck och lip-sync till befintlig genererad utmatning.

Ett exempel på uttrycksoverföring (drivande video i nedre vänstra hörnet) som påförs en målbild med LivePortrait. Videon är från Generative Z TunisiaGenerative. Se den fullständiga versionen i bättre kvalitet på https://www.linkedin.com/posts/genz-tunisia_digitalcreation-liveportrait-aianimation-activity-7240776811737972736-uxiB/?

Ytterligare, en mängd komplexa lösningar, som inkorporerar verktyg som Stable Diffusion GUI ComfyUI och den professionella kompositions- och manipuleringsapplikationen Nuke, samt latenta utrymmesmanipulering, tillåter AI-VFX-utövare att få större kontroll över ansiktsuttryck och disposition.

Även om han beskriver processen för ansiktsanimering i ComfyUI som “pinning”, har VFX-proffs Francisco Contreras utvecklat en sådan procedur, som tillåter påförande av lip-fonem och andra aspekter av ansikts-/huvudavbildning

Stable Diffusion, hjälpt av en Nuke-aktiverad ComfyUI-arbetsflöde, tillåter VFX-proffs Francisco Contreras att få ovanlig kontroll över ansiktsaspekter. För den fullständiga videon, i bättre upplösning, gå till https://www.linkedin.com/feed/update/urn:li:activity:7243056650012495872/

Slutsats

Inget av detta är lovande för utsikten till att en enskild användare kan generera sammanhängande och fotorealistiska blockbusters, med realistisk dialog, lip-sync, prestationer, miljöer och kontinuitet.

Dessutom är de hinder som beskrivs här, åtminstone i förhållande till diffusionsbaserade generativa videomodeller, inte nödvändigtvis lösbara “närsomhelst” nu, trots forumkommentarer och mediabevakning som gör detta påstående. De begränsningar som beskrivs verkar vara intrinsic till arkitekturen.

I AI-syntesforskning, liksom i all vetenskaplig forskning, dazzlar lysande idéer oss periodvis med sin potential, bara för att ytterligare forskning ska avslöja deras grundläggande begränsningar.

I det generativa/syntetiska utrymmet har detta redan hänt med Generativa Adversarial Networks (GANs) och Neurala Strålningsfält (NeRF), båda av vilka visade sig vara mycket svåra att instrumentaliera till presterande kommersiella system, trots år av akademisk forskning mot det målet. Dessa teknologier dyker nu upp oftast som hjälpskomponenter i alternativa arkitekturer.

Liksom filmstudior kan hoppas att utbildning på legitimt licensierade filmkataloger kunde eliminera VFX-artister, lägger AI faktiskt till roller i arbetskraften just nu.

Om diffusionsbaserade videosystem kan förvandlas till berättelsekonsekventa och fotorealistiska filmgeneratorer, eller om hela affären bara är en annan alkemisk strävan, bör bli uppenbart under de kommande 12 månaderna.

Det kan vara att vi behöver en helt ny approach; eller det kan vara att Gaussian Splatting (GSplat), som utvecklades i början av 1990-talet och nyligen tagit fart i bildsyntesutrymmet, representerar en potentiell alternativ till diffusionsbaserad videogenerering.

Eftersom GSplat tog 34 år att komma till före, är det möjligt också att äldre utmanare som NeRF och GANs – och till och med latent diffusionsmodeller – ännu inte har haft sin dag.

* Även om Kaibers AI Storyboard-funktion erbjuder denna typ av funktionalitet, är resultaten jag har sett inte av produktionkvalitet.

Martin Anderson är den tidigare chefen för vetenskapligt innehåll på metaphysic.ai

Först publicerad måndag, 23 september 2024