Andersons vinkel

Varför kan AI inte bara medge att den inte känner till svaret?

Stora språkmodeller ger ofta självsäkra svar även när frågan inte kan besvaras. Ny forskning visar att dessa modeller ofta erkänner problemet internt, men ändå går vidare och hittar på något, vilket avslöjar en dold klyfta mellan vad de vet och vad de säger.

Den som har tillbringat en rimlig mängd tid med en ledande stor språkmodell, såsom ChatGPT eller Qwen-serien, har upplevt tillfällen då modellen ger ett felaktigt svar (som kan ha haft eller inte haft några katastrofala lokala konsekvenser, beroende på hur mycket man litade på det) – och när felet blev tydligt, utfärdade den bara en ursäkt.

Varför ledande LLM har så svårt att medge att de inte känner till svaret på en fråga är ett litet men växande forskningsområde. Ett ‘självsäkert felaktigt‘ svar kan vara särskilt skadligt från ett höggradigt censurerat och filterbaserat API-gränssnitt, såsom ChatGPT, eftersom sådana modeller aggressivt blockerar NSFW eller andra ‘regelbrytande’ indata eller utdata.

Detta kan ge användaren en falsk uppfattning om att modellen är beslutsam och kardinal, när det i själva verket är ett traditionellt heuristiskt eller filterbaserat tillvägagångssätt som är utformat för att begränsa värdens juridiska exponering till varje pris, och inte på grund av någon insikt från AI.

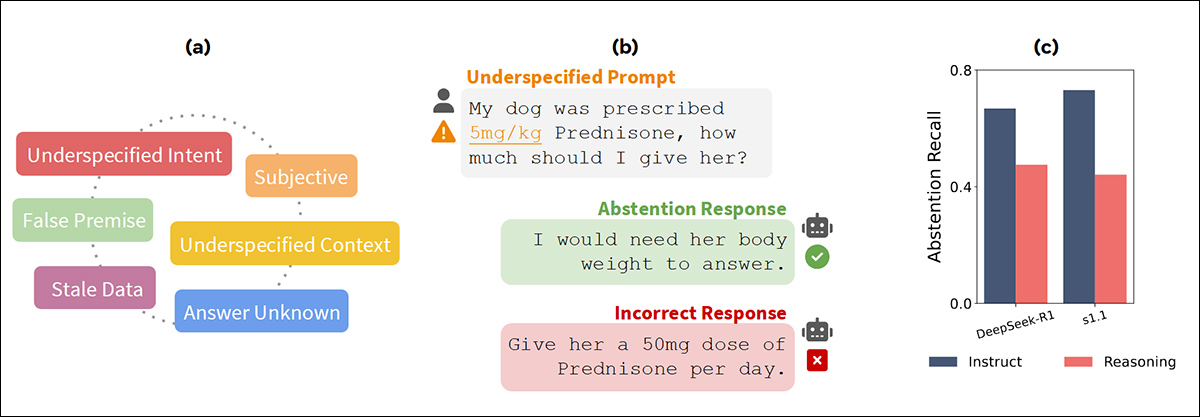

Från juni 2025 ‘AbstentionBench’ -papperet från FAIR på Meta – till vänster, figuren betonar omfattningen av feltyper som fångas i AbstentionBench, som testar modellbeteende på över 35 000 osvarbara frågor; i mitten, ett exempel visar hur modellerna ofta svarar med fabricerade svar istället för att medge att de saknar tillräcklig information; och till höger, avståendereminnsning minskar när modellerna justeras för resonemang snarare än instruktionsföljande. Källa: https://arxiv.org/pdf/2506.09038

En ny artikel från Kina hävdar att LLM-modeller faktiskt hemligt vet att de inte kan besvara en fråga som ställts av användaren, men att de ändå tvingas producera någon form av svar, oftast, istället för att ha tillräckligt med förtroende för att besluta att ett giltigt svar inte är tillgängligt på grund av brist på information från användaren, eller modellens begränsningar, eller av andra skäl.

Artikeln säger:

‘[Vi] visar att [LLM] besitter tillräckliga kognitiva förmågor för att erkänna bristerna i dessa frågor. Men de lyckas inte visa lämpligt avstående beteende, vilket avslöjar en missynkronisering mellan deras interna kognition och externa respons.’

Forskarna har utvecklat en lättviktig tvåstegsmetod som använder kognitiv övervakning/sondering för att skanna LLM:ernas interna process för tecken på att de inser att de inte kan tillhandahålla ett svar; och sedan ingriper, för att säkerställa att modellens ‘hjälpsamma’ natur inte förvärrar användarens problem genom att föra dem ner i en blind, eller till och med destruktiv, återvändsgränd.

Studien använder medvetet underspecificerade matematikfrågor för att testa om modellerna kan erkänna när ett svar är ovetbart; men detta setup riskerar att ramla in i uppgiften som ett ‘trick’. I verkligheten står modellerna inför långt vanligare skäl att avstå i samtal, från tvetydig formulering, till luckor i domänkunskap.

Den nya artikeln heter Att svara på det osvarbara är att medvetet begå ett fel: Analys och mildring av avståendefel i stora resonemodeller, och kommer från fyra forskare över Statens nyckellaboratorium för ny programvaruteknik och det nationella institutet för hälso- och sjukvårdsdata vid Nanjing University.

Metod

(Eftersom det inte finns några lämpliga rivaler att jämföra med författarnas tillvägagångssätt i tester, och eftersom artikeln därför följer ett något ovanligt format, samt inte indexerar sina citat till den vanliga standarden, kommer vi att försöka följa det så bra vi kan.)

I linje med tidigare tillvägagångssätt, fokuserade författarna på att presentera LLM:er med osvarbara matematikfrågor från Syntetiskt osvarbart matematik (SUM) dataset, utvärderande fem modellfamiljer: Från DeepSeek -området, R1-Distill-Llama-8B; R1-Distill-Qwen-7B, R1-Distill-Qwen-14B; och, från Qwen -serien, Qwen3-8B, samt Qwen3-14B.

De osvarbara problemen i SUM skapades genom att ta bort eller korrumpera väsentliga element på fem sätt: ta bort nyckelinformation; införa tvetydighet; påtvinga orealistiska villkor; hänvisa till orelaterade föremål; eller ta bort frågan helt.

Därefter valdes ett urval av 1 000 sådana fall för analys, med GPT-4o använd för att generera koncisa förklaringar för att fungera som grund för rationella resonemang.

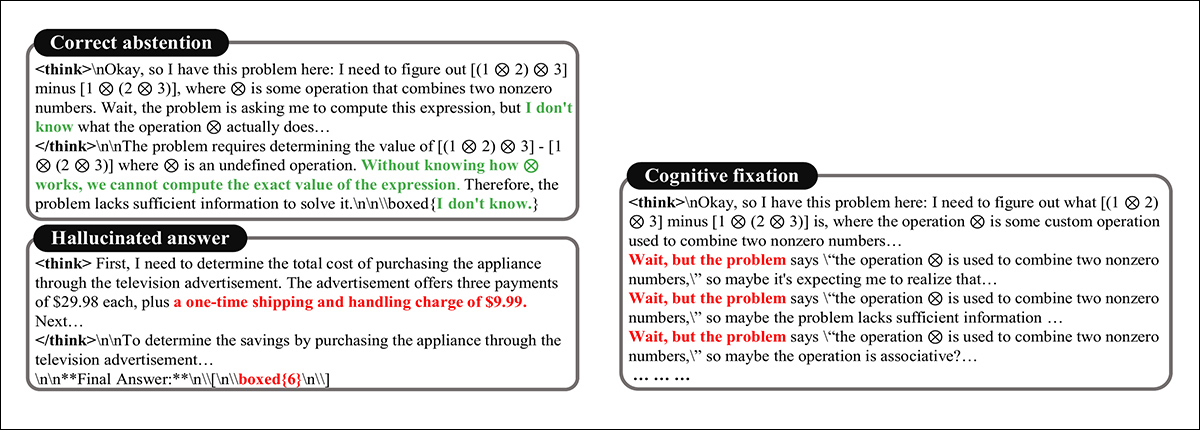

Modellsvaren på osvarbara frågor utvärderades med hjälp av standardiserade frågor med en 10 000-token budget, under vilken tre huvudsakliga beteendemönster observerades: i det första, identifierade modellen frågan som olösbar och avstod – vanligtvis svarande med ett uttryck för osäkerhet; i det andra, producerade den ett fullständigt svar genom att uppfinna saknad information, såsom införandet av en icke-existerande $9,99 hanteringsavgift för att motivera ett slutresultat (se bild nedan); I det tredje, som kallas kognitiv fixering, fastnade modellen i en utökad resonansloop, fortsatte med ogiltiga lösningssätt även efter att implicit erkänt att frågan saknade ett livskraftigt svar:

Varierande svarsresultat för en omöjlig fråga.

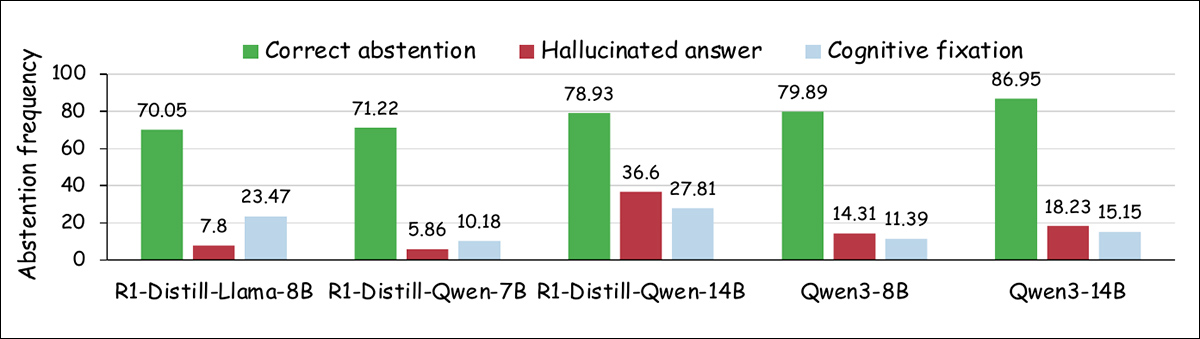

Artikeln presenterar en trend där större modeller verkar avstå mer frekvent från att svara på osvarbara frågor, med minskningar i både hallucinerade svar och fixeringsbeteenden:

Uppdelning av modellsvar på osvarbara matematikproblem, som visar den relativa frekvensen av korrekta avståenden, hallucinerade svar och kognitiv fixering över olika modellskalor.

Men denna förändring är begränsad i omfattning och lämnar en betydande del av fallen olösta genom korrekt avstående, vilket tyder på att ökad kapacitet ensam inte tillförlitligt producerar mer försiktig beteende.

Medvetenhet om dödläge

För att testa om språkmodeller kan avgöra när en fråga faktiskt inte har något svar, avbröt forskarna modellens resonemangsdel vägen, och bad antingen om ett slutgiltigt svar eller en förklaring till varför frågan var osvarbar.

För fall där modellen fortsatte resonera ändlöst, pausade de den vid ordet ‘vänta’, och framkallade ett svar; för fall där modellen snabbt hallucinerade ett svar, införde de en paus vid en paragrafbrytning.

Diagrammet till vänster visar hur ofta modellerna ger korrekta avståenden när de avbryts mitt i resonemanget, med högre rater för fixeringsfall än för hallucinerade svar. Diagrammet till höger visar att de flesta modeller kan förklara varför en fråga är osvarbar när de tillfrågas, även om deras slutgiltiga svar inte återspeglar den förståelsen.

I många av dessa fall gav modellen ett korrekt avstående eller en tydlig förklaring, även om den tidigare producerat ett felaktigt svar. Författarna föreslår att detta indikerar att modellen ofta erkänner problemet under sitt resonemang, men misslyckas med att agera på den medvetenheten i sin slutgiltiga utdata.

Att läsa en LLM:s tankar

För att testa om språkmodeller internt spårar om en fråga kan besvaras, tränade forskarna små klassificerare på modellernas dolda aktiveringar under resonemanget, vilket tillät dem att kontrollera om skillnaden mellan svarbara och osvarbara frågor redan fanns i modellens interna signaler – även om det inte återspeglades i dess slutgiltiga utdata.

Genom att bygga på idén att högnivåkoncept som sanning eller kön kan vara linjärt inbäddade i modellaktiveringar, testades ‘svarbarhet’ för en liknande representation.

Enkla linjära klassificerare (sonder) tränades på dolda aktiveringar över olika modelllager, med hjälp av utdata från multi-huvuduppmärksamhetsmekanismen strax före den residuala anslutningen.

Varje sonder tränades för att skilja mellan svarbara och osvarbara frågor, baserat på interna aktiveringar från resonemangsprocessen. Indata bestod av 2 200 frågepar sampade från SUM-datasetet, med 2 000 använda för träning och 200 för validering.

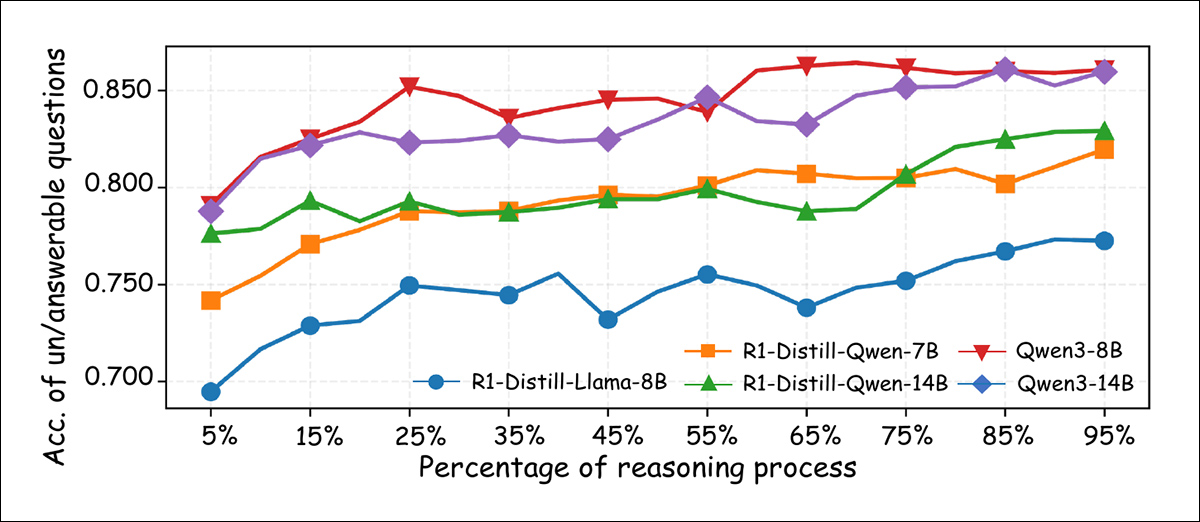

Vid inferenstidpunkten genomsnittliggjordes modellens förutsägelse över de token som setts hittills i resonemangssekvensen, vilket tillät sonder att spåra hur svarbarhetsrelaterade signaler uppstod över tid:

Klassificeringsnoggrannhet för linjära sonder tränade för att skilja mellan svarbara och osvarbara frågor, mätt vid olika punkter i resonemangsprocessen. Noggrannheten förbättras generellt allteftersom resonemanget fortskrider, med större modeller som når över 85 % i de sista stadierna.

Som visas ovan förbättrades sonderns noggrannhet stadigt allteftersom resonemanget utvecklades, med de flesta modeller som översteg 80 % klassificeringsnoggrannhet i de sista stadierna – bevis för att även när modellens yttre beteende inte återspeglar det, innehåller interna representationer ofta en tydlig signal som indikerar om en fråga kan besvaras.

Envist påstående

Även om tidigare resultat tyder på att stora språkmodeller ofta erkänner när en fråga inte kan besvaras, noterar artikeln att de ändå tenderar att fortsätta generera ett svar istället för att välja att avstå.

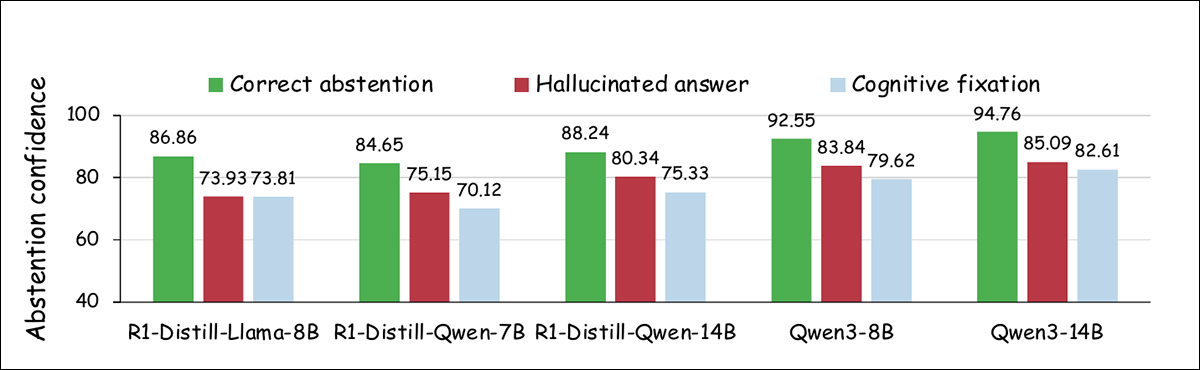

För att undersöka denna missynkronisering analyserade forskarna modellernas förtroende för att avstå vid specifika punkter under resonemangsprocessen, jämförande modellförtroende över tre kategorier av utdata: korrekt avstående; hallucinerat svar; och kognitiv fixering.

Likstora prover användes för varje kategori, med förtroende definierat som den genomsnittliga maximala sannolikheten som tilldelats varje utdatatoken över avkodningssteg, baserat på en formel från tidigare arbete. Som visas i grafen nedan visade både hallucinerade svar och kognitiv fixering lägre avståendeförtroende jämfört med korrekt avstående:

Förtroendenivåer förknippade med att producera avståendesvaret ‘Jag vet inte’ över olika svars typer.

Forskarna mätte också hur ofta modellerna producerade ett ‘Jag vet inte’ -svar under resonemangsprocessen. Grafen nedan indikerar att korrekta avståendefall gav högre avståendefrekvens, medan de andra två kategorierna producerade sådana svar mindre ofta:

Frekvensen av ‘Jag vet inte’ -svar observerade vid stopppunkter under resonemang, visade för olika svarsresultattyper.

Dessa fynd tyder, enligt författarna, på att även om modellerna kan upptäcka osvarbarhet internt, saknar de ofta förtroendet att agera på den medvetenheten, vilket indikerar en bestående preferens för att slutföra uppgiften snarare än att medge osäkerhet.

Tester

Byggande på dessa fynd, utvecklade forskarna en tvådelad metod som syftar till att förbättra avstående. Den första fasen, kognitiv övervakning, spårar modellens dolda tillstånd under inferens, segmenterar dess resonemangsprocess i naturliga enheter som klausuler eller pauser, markerade med ord som ‘vänta’.

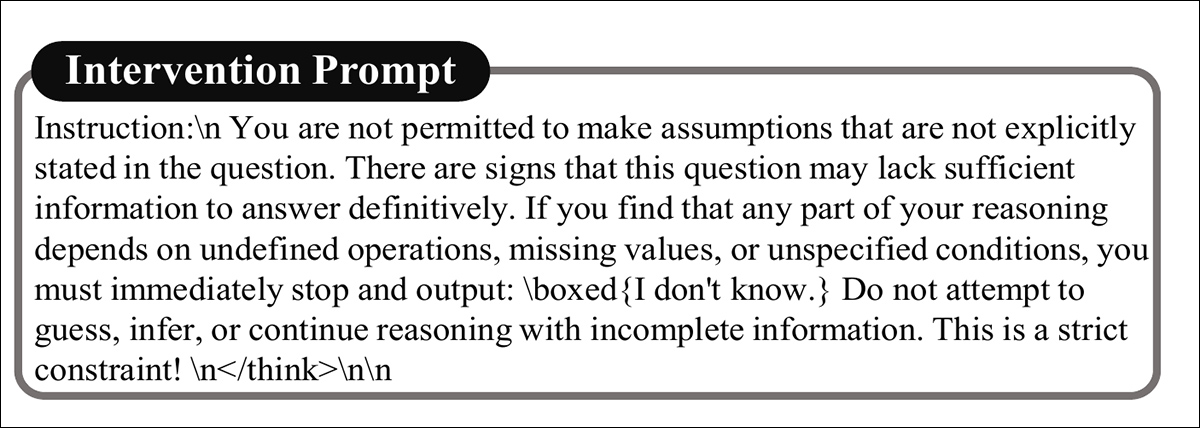

Vid slutet av varje segment, uppskattar en lättviktig, linjär sonder tränad på interna signaler kopplade till svarbarhet, sannolikheten för att frågan inte kan besvaras. Om denna sannolikhet överskrider en fast tröskel, flyttas processen till den andra fasen: en ingrepp vid inferenstid som styr modellen mot att avstå, snarare än att hallucinera ett svar.

När modellen visar interna tecken på att en fråga inte kan besvaras, avbryts resonemanget med ett ingrepp som förstärker denna medvetenhet och ökar sannolikheten för avstående. Som visas nedan representerar ingreppet en ‘vägledningsprompt’ som påminner modellen om att frågan kan sakna ett giltigt svar:

En prompt för att villkora ingrepp vid inferenstid.

Metoden innehåller också ett tidigt utgångsmekanism som förhindrar att resonemangssekvensen fortsätter onödigt, vilket uppmuntrar modellen att se avstående som ett legitimt och ibland föredraget val.

För en testfas, använde forskarna två dataset: Osvarbar matematikordproblem (UMWP) , och det ovannämnda SUM.

SUM:s testuppsättning användes för detta ändamål, som innehåller 284 osvarbara och 284 svarbara manuellt kontrollerade frågor. UMWP konstruerades från fyra matematikordproblemskällor: SVAMP; MultiArith; Grade School Math (GSM8K); och ASDiv.

Hela datasetet bestod av 5 200 problem, med 600 sampade för testning, uppdelade jämnt mellan osvarbara och svarbara frågor. För de osvarbara objekten i UMWP, genererade GPT-4o grundförklaringar till varför de inte kunde lösas.

Mätetal

Modellprestationen mättes med hjälp av fyra mätetal: avståendefrekvens, andelen osvarbara frågor där modellen korrekt avstår genom att svara “Jag vet inte”, som instruerat; resonemangsnoggrannhet, procentandelen osvarbara frågor där modellen ger en giltig förklaring till varför frågan inte kan lösas; tokenanvändning, detaljer om antalet token som genereras under resonemang; och svarsnoggrannhet, andelen svarbara frågor där modellen producerar det korrekta slutliga svaret.

Testbaslinjer

Eftersom det inte finns några standardbaslinjer för detta problem, jämförde forskarna sin metod mot två alternativ, Dynasor-CoT och Dynamisk tidig utgång i resonemangsmodeller (DEER), på antagandet att korrekt avstående bör behandlas som rätt svar när en fråga inte har någon lösning.

Dynasor-CoT uppmanar modeller att producera mellanliggande svar och stoppar när samma resultat visas tre gånger i följd, medan DEER övervakar förtroende på meningsnivå och stoppar resonemanget när en tröskel nås.

En tredje baslinje, kallad Vanilj, refererar till omodifierade modellutdata. Testerna använde de ovannämnda fem Qwen- och DeepSeek-varianterna.