Tankeledare

Vad varje dataforskare bör veta om Graph Transformers och deras påverkan på strukturerad data

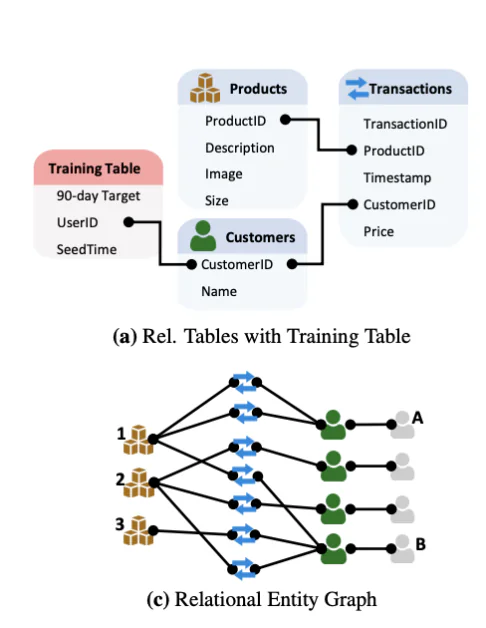

Jag var med och skapade Graph Neural Networks under min tid på Stanford. Jag insåg tidigt att denna teknik var otroligt kraftfull. Varje datapunkt, varje observation, varje bit av kunskap existerar inte i isolering; det är en del av en graf som är kopplad till andra bitar av kunskap. Viktigt är att de flesta värdefulla affärsdata, ofta lagrade som tabeller i databaser och datawarehouse, naturligt kan representeras som en graf. Att utnyttja denna relationella struktur är nyckeln till att bygga precisa och icke-hallucinerande AI-modeller.

Graph neurala nätverk (GNNs) introducerade message-passing-arkitekturer som kunde resonera över grafer som fångar samband mellan bitar av kunskap. Men precis som Transformers förvandlade språkförståelse, är en ny klass av modeller, Graph Transformers, på väg att bringa liknande vinster till grafbaserad data. Dessa modeller kombinerar flexibiliteten i uppmärksamhetsmekanismer med strukturella grafpriorer för att modellera komplexa relationer mer effektivt än deras GNN-föregångare.

Varför grafer behöver mer än message passing

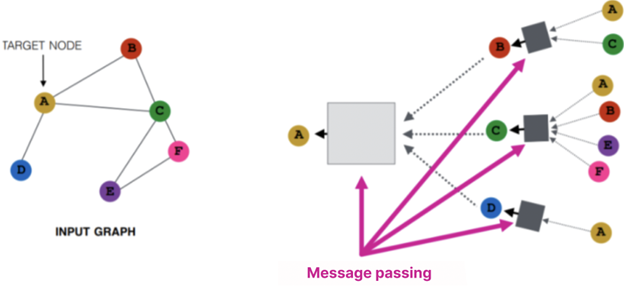

Traditionella graph neurala nätverk (GNNs) förlitar sig på message passing, en process där varje nod uppdaterar sin interna tillstånd genom att aggregera information från sina grannar. Tänk på det som varje nod utbyter sammanfattningar med närliggande noder, och sedan använder dessa sammanfattningar för att förfinansiera sin egen förståelse. Över flera lager tillåter detta information att propagera genom grafen.

Medan det är kraftfullt för att lära sig lokala mönster, har message passing viktiga begränsningar:

- Över-squashing: När information aggregeras över många hopp, kan den bli komprimerad och förlora meningsfull detalj. Detta är särskilt problematiskt i djupa GNNs.

- Begränsad kontext: Standard message passing kan inte lätt fånga långväga beroenden utan många lager, vilket ökar komplexitet och brus.

- Uttrycksfullhet: Många grafstrukturer kan inte differentieras med hjälp av endast lokal grannskapsinformation, vilket begränsar modellens prestanda på uppgifter som kräver fina strukturella distinktioner.

Här kommer Graph Transformers in. Genom att ersätta eller komplettera message passing med uppmärksamhetsmekanismer, tillåter de varje nod att direkt uppmärksamma andra (även avlägsna) baserat på lärd betydelse. Resultatet är rikare representationer, bättre skalbarhet och förmågan att resonera över komplexa strukturer mer flexibelt.

Från GNNs till Graph Transformers

Den ursprungliga Transformer-modellen, som introducerades i den ikoniska artikeln, Attention Is All You Need, var utformad för att modellera relationer mellan token i en sekvens. Dess framgång ligger i självuppmärksamhet, en mekanism som tillåter varje inmatning att överväga varje annan inmatning, viktad av lärd relevans.

Graph Transformers anpassar denna paradigm genom att tillåta noder att uppmärksamma inte bara sina grannar utan också varje nod i grafen, antingen genom fullständigt ansluten uppmärksamhet eller en hybridmetod som balanserar globala och lokala signaler. Utmaningen är att introducera en notion av struktur i en modell som är utformad för ostrukturerade sekvenser.

Graf-specifika positionskodningar

Till skillnad från text, har grafer ingen inneboende ordning, vilket gör positionskodning, som hänvisar till tekniker för att injicera strukturell eller platsbaserad information i en modell, inte trivialt. Graph Transformers tacklar detta med olika metoder:

- Laplacian Eigenvectors: Härledda från grafens Laplacematrix, ger de en spektral inbäddning som fångar den globala strukturen.

- Slumpmässiga promenader: Fånga sannolikheten för att gå från en nod till en annan över flera hopp.

- Strukturella kodningar: Inkluderar distansmått, nodgrader eller kanter.

Dessa positionskodningar, antingen spektrala, sannolikhetsmässiga eller strukturella, ger Graph Transformers ett sätt att förstå var varje nod sitter i den bredare grafen. Denna strukturella medvetenhet är avgörande för att möjliggöra uppmärksamhetsmekanismer för att fungera meningsfullt över oregelbunden, ostrukturerad data, och tillåter slutligen modellen att fånga relationer som skulle vara osynliga för enklare, rent lokala metoder.

Verkliga implementeringar och användningsfall

Att ta Graph Transformers till produktion kräver infrastruktur som kan skalas till verkliga datamängder. Bibliotek som PyTorch Geometric (PyG) gör det möjligt. Byggt på PyTorch, tillhandahåller PyG ett modulärt ramverk för att implementera GNNs och Graph Transformers över ett brett spektrum av tillämpningar, från molekylmodellering till rekommendationssystem. Det stöder mini-batch-träning på både många små grafer och enstaka stora grafer, med multi-GPU och torch.compile-stöd, vilket gör det väl lämpat för forskning och företagsflöden.

Dessa verktyg används redan för att driva en mängd olika verkliga tillämpningar. Inom läkemedelsupptäckt hjälper Graph Transformers till att förutsäga molekylära egenskaper genom att modellera atominteraktioner som grafer. Inom logistik och försörjningskedjeoptimering kan de representera och resonera över dynamiska nätverk av leveranser, lager och rutter. E-handelsföretag använder dem för att förbättra rekommendationer genom att förstå samköps- och bläddringsbeteende som relationella grafer. Och inom cybersäkerhet används grafbaserade modeller för att upptäcka avvikelser genom att analysera åtkomstmönster, nätverkstopologi och händelsesekvenser.

I var och en av dessa miljöer visar sig förmågan att lära sig från komplexa, sammanhängande strukturer, utan att förlita sig enbart på handgjorda funktioner, vara en stor fördel.

Tekniska överväganden

Trots deras potential, kommer Graph Transformers med verkliga ingenjörsavvägningar. Fullständig självuppmärksamhet skalar kvadratiskt med antalet noder, vilket gör minnes- och beräknings-effektivitet till en topprioritet, särskilt för stora eller täta grafer. Många verkliga grafer har också riktade kanter, vilket introducerar asymmetrier som komplicerar hur strukturell information kodas. Och i praktiska distributioner är ingångarna sällan enhetliga: att kombinera grafstrukturerad data med text, tidsserier eller bilder kräver noggranna arkitektval och robust dataförbehandling.

Dessa utmaningar är inte oövervinnliga, men de kräver noggrann systemdesign, särskilt när man övergår från forskningsprototyper till produktklara modeller.

Vad kommer härnäst: LLMs möter grafer

En viktig forskningsriktning är integrationen av stora språkmodeller (LLMs) med grafstrukturer. Dessa hybrid-system använder LLMs för att koda textuell kontext eller extrahera entiteter, och sedan förankra den informationen i en graf för resonemang och beslutsfattande.

Inom biologi har detta drivit verktyg som AlphaFold. Inom företags-AI möjliggör det kundsupportsystem som kombinerar dokumentation och beteendegrafer. Graph Transformers spelar också en växande roll i att möjliggöra AI-agenter att fatta smartare, mer handlingsbara beslut genom att tillåta dem att resonera över strukturerade tillståndsrepresentationer och prioritera interaktioner dynamiskt. Denna fusion hjälper agenter att bättre förstå hierarkiska relationer, spåra beroenden över tid och anpassa sitt beteende i komplexa miljöer.

Fältet är fortfarande under utveckling, men potentialen är betydande.

Slutsats

Graph Transformers är inte bara nästa iteration av GNNs; de representerar en konvergens av uppmärksamhet, struktur och skalbarhet. Oavsett om du arbetar inom finans, life sciences eller rekommendationssystem, är budskapet tydligt: din data utgör en graf, så dina modeller bör också göra det.