Andersons vinkel

Vibe-kodning fungerar sämre när AI:s roll utökas

En ny studie visar att vibe-kodning förbättras när människor ger instruktioner, men försämras när AI gör det, med den bästa hybriduppställningen som håller människor främst, med AI som skiljedomare eller domare.

Ny forskning från USA, som undersöker vad som händer när AI-system tillåts styra vibe-kodning, snarare än att bara utföra mänskliga instruktioner, har funnit att när stora språkmodeller (LLM) tar på sig en större riktning, är resultaten nästan alltid sämre.

Även om forskarna använde OpenAI:s GPT-5 som ramverk för sina mänskliga/AI-samarbetsförsök, bekräftade de senare att både Anthropics Claude Opus 4.5 och Google Gemini 3 Pro var föremål för samma försämringskurva när ansvar växte, och konstaterade att “även begränsad mänsklig inblandning stadigt förbättrar prestanda”:

‘[Människor] tillhandahåller unikt effektiv högnivåvägledning över iterationer, [medan] AI-vägledning ofta leder till prestandakollaps. Dessutom finner vi att en noggrann rollfördelning som håller människor ansvariga för riktning medan utvärdering offentliggörs till AI kan förbättra hybridprestanda.’

För att tillhandahålla ett konsekvent test som kunde utvärderas lika av människor som av AI byggdes ett kontrollerat experimentellt ramverk runt en iterativ koduppgift där en referensbild – som visade en foto av en katt, hund, tiger, fågel, elefant, pingvin, haj, zebra, giraff eller panda – skulle återskapas med hjälp av skalbara vektorgrafik (SVG), och att återskapningen bedömdes mot den fotokälla från vilken den härstammade:

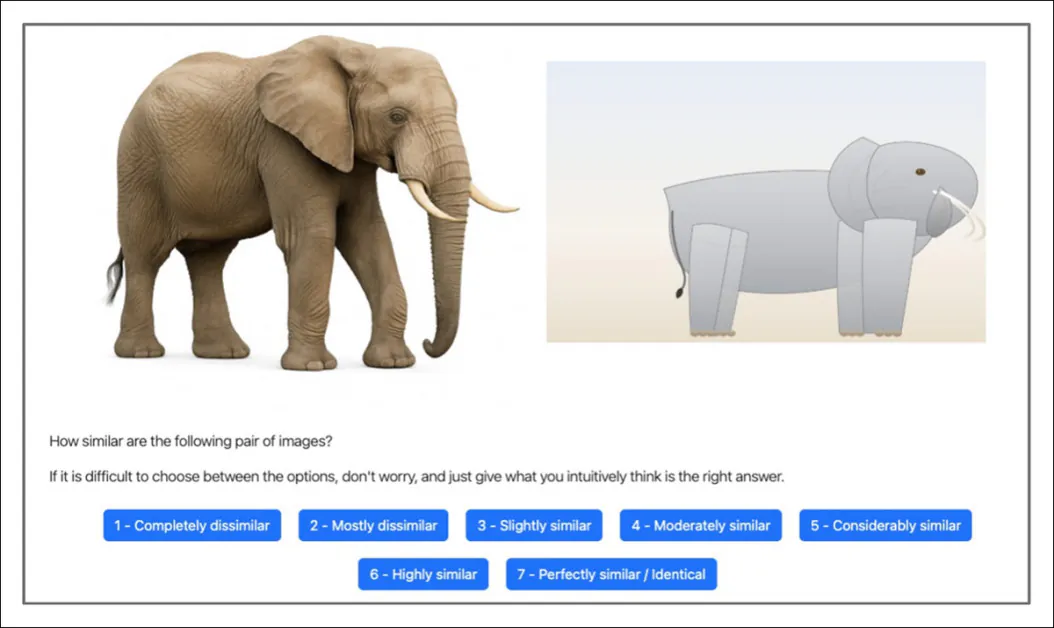

Både mänskliga och AI-deltagare visades en fotografisk referensbild tillsammans med en AI-genererad SVG-rekonstruktion, och bad att bedöma hur lika de två var på en sjupunkts skala. Källa

I varje omgång tillhandahöll en agent högnivå naturliga språkinstruktioner för att vägleda en kodgenerator, och en annan beslutade om att behålla den nya versionen eller återgå till den tidigare – en strukturerad loop som speglar verkliga samarbetsflöden.

Under sexton experiment som involverade 604 deltagare och tusentals API-anrop jämfördes fullständigt mänskligt ledda testomgångar direkt med fullständigt AI-ledda omgångar, under i övrigt identiska förhållanden.

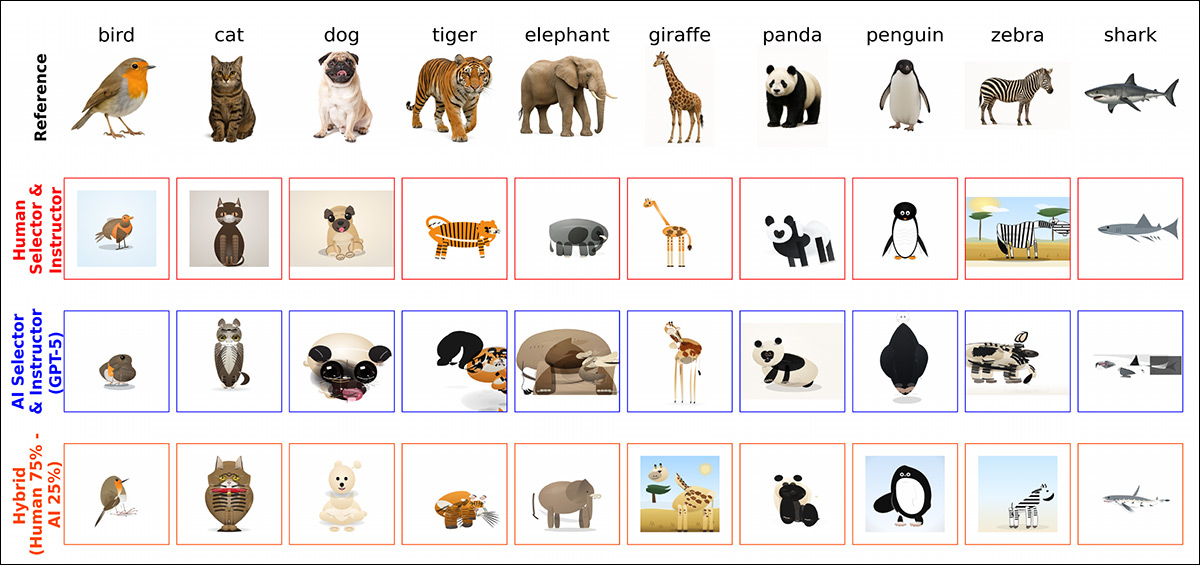

Några av de varierade lösningarna som nåddes av olika kombinationer av mänsklig/AI-samarbetsprocent och typer (tagen från en större illustration i källpapperet, till vilket vi hänvisar läsaren).

Även om människor och AI presterade på liknande nivåer vid baslinjen i testerna, avvek deras banor över tiden: när människor tillhandahöll instruktioner och fattade urvalbeslut, ökade likhetspoängen över iterationer, med stadig kumulativ förbättring; men när AI-system fyllde båda rollerna, visade prestanda ingen konsekvent förbättring, och försämrades ofta över omgångar – även om samma underliggande modell användes för kodgenerering, och AI hade tillgång till samma information som mänskliga deltagare.

Den prolix effekten

Resultaten visade också att mänskliga instruktioner vanligtvis var korta och handlingsinriktade, fokuserade på vad som skulle ändras nästa i den aktuella bilden; tvärtom var AI-instruktioner mycket längre och tungt deskriptiva (en faktor som parametrerats för GPT-5), detaljerande visuella attribut snarare än att prioritera inkrementell korrektion.

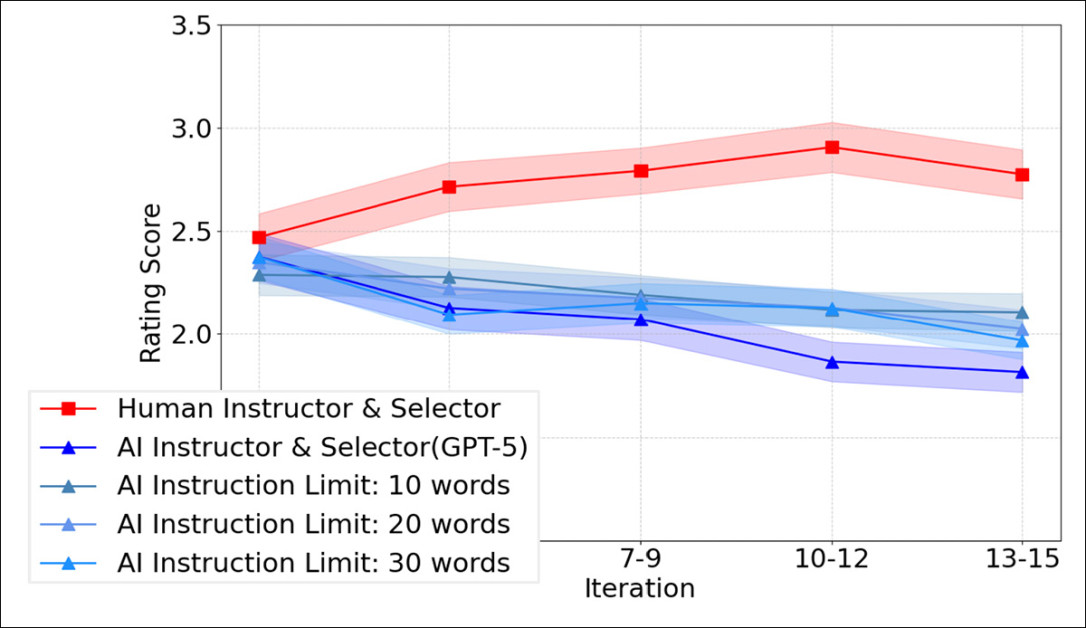

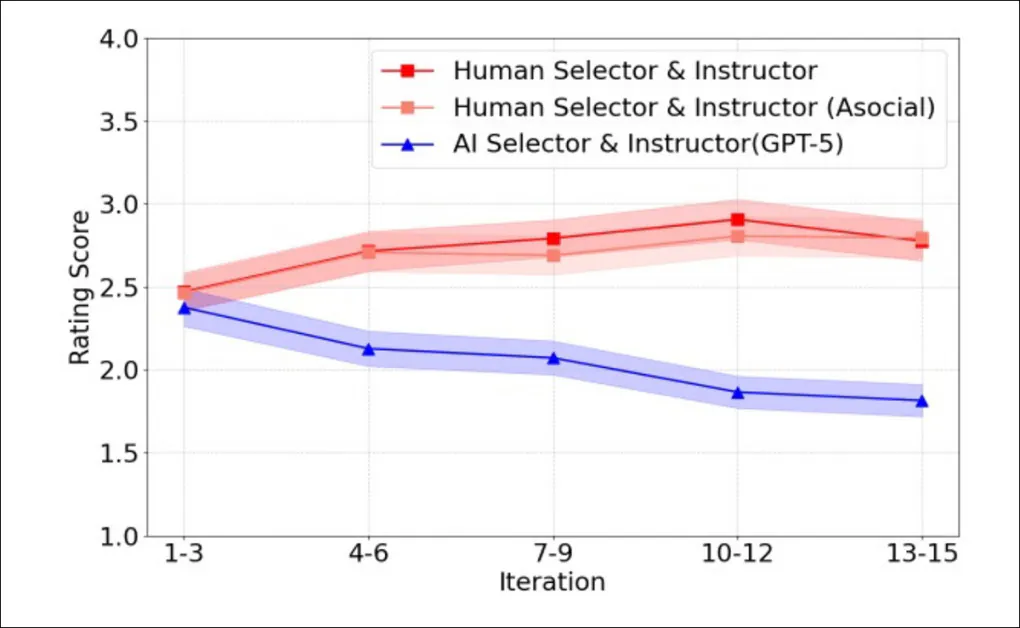

Men, som visas i grafen nedan, förbättrade inte att påtvinga strikta ordgränser för AI-instruktioner mönstret; även när AI-instruktioner begränsades till 10, 20 eller 30 ord, fungerade fortfarande AI-ledda kedjor inte för att förbättra över tiden:

Likhetsbetyg över iterationer för mänskligt ledda omgångar jämfört med fullständigt AI-ledda omgångar begränsade till 10, 20 eller 30-ords instruktioner. Tydligtvis förkortar inte AI-prompt den iterativa prestandaförsämring som observeras när AI dirigerar både instruktion och urval.

Hybridexperimenten gjorde mönstret tydligare, visar att tillägg av även en liten mänsklig inblandning förbättrade resultaten, jämfört med fullständigt AI-ledda setup; men prestanda försämrades vanligtvis när andelen AI-vägledning ökade.

När rollerna separerades kunde utvärdering och urval överlåtas till AI med relativt liten kvalitetsförlust; men att ersätta mänsklig högnivåinstruktion med AI-vägledning ledde till märkbara prestandaförsämringar, vilket tyder på att det som betyder mest inte är vem som genererar koden, utan vem som sätter och upprätthåller riktningen över iterationer.

Författarna slutsats:

‘Över flera experiment förbättrades mänskligt ledd kodning konsekvent över iterationer, medan AI-ledd kodning ofta kollapsade trots tillgång till samma information och liknande exekveringsförmåga.

‘Detta pekar på nyckelstrider för dagens AI-system i att upprätthålla sammanhängande högnivåriktning över upprepade interaktioner, av den typ som krävs för framgångsrik vibe-kodning’

Den nya artikeln har titeln Varför mänsklig vägledning är viktig i samarbetsvibe-kodning, och kommer från sju forskare på Cornell University, Princeton University, Massachusetts Institute of Technology och New York University.

Metod

För experimenten tittade en mänsklig instruktör på en GPT-5-genererad djurreferensbild, tillsammans med den senaste associerade SVG-imitationsförsöket. Den skrev sedan naturliga språkinstruktioner för att vägleda kodgenereringen mot en närmare match.

Således skulle genereringen producera en ny SVG varje omgång, vilket tillhandahöll en iterativ loop för att testa hur effekten av vägledning ackumuleras över tid. Målen var tio GPT-5-genererade djurbilder, som täckte ett spektrum av former och texturer så att förbättringar eller misstag skulle vara lätta att upptäcka:

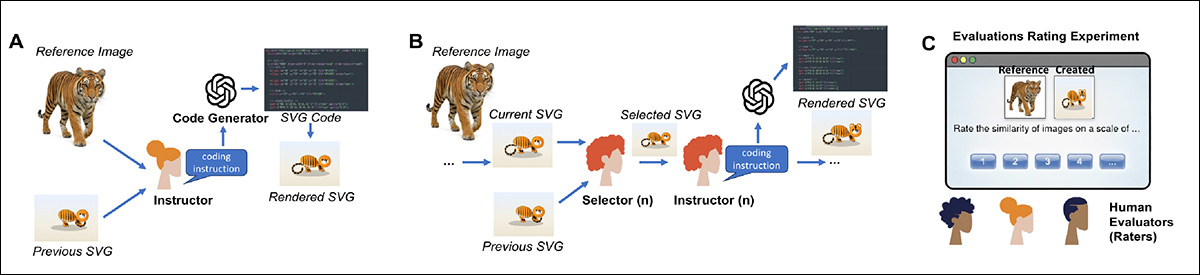

Schema för vibe-kodningsarbetsflödet som användes i studien. I A) tittar en mänsklig instruktör på en fotografisk referensbild tillsammans med den bästa SVG som producerats hittills och skriver naturliga språkinstruktioner för kodgenereringen att följa när den producerar nästa SVG; i B) jämför en mänsklig urvalare den nya SVG med den tidigare och väljer vilken version som bäst matchar referensbilden, innan den valda SVG skickas vidare för nästa omgång av instruktion; och i C) bedömer oberoende mänskliga utvärderare hur lika varje genererad SVG är till dess referensbild, och tillhandahåller betygen som används för att bedöma övergripande prestanda.

En mänsklig urvalare jämförde varje nygenererad SVG med den tidigare och antog eller avvisade den, vilket höll processen i linje med referensbilden över omgångar. I denna basuppställning utförde samma människa båda rollerna.

För att mäta kvalitet bedömdes oberoende mänskliga utvärderare hur lika varje genererad SVG var till dess referensbild. Under sexton experiment producerade 120 personer 4 800 betyg. Alla experiment kördes på PsyNet-ramverket, en portal som är utformad för att tillhandahålla strukturerade interaktioner mellan människor och AI-system.

Studien rekryterade 604 modersmålstalare av engelska, i tester som skulle förbruka 4 800 API-anrop för kodgenerering och 5 327 API-anrop för instruktion. Även om GPT-5 var den primära modellen som användes, gjordes mindre jämförelsebatchar med Claude Opus 4.5 och Gemini 3 Pro, som vardera hanterade 280 förfrågningar.

Resultat

Trettio vibe-kodningsomgångar kördes, var och en bestående av femton redigeringar av de tio referensbilderna. För dessa valdes 45 mänskliga deltagare, var och en som fungerade som både urvalare och instruktör över tio iterationer, i “mänskligt ledda” omgångar.

Inom varje omgång valde samma deltagare först mellan den aktuella och tidigare SVG, och skrev sedan nästa omgångs instruktioner. En andra version av testet ersatte dessa mänskliga beslut med API-anrop till GPT 5, medan resten av setupen förblev oförändrad. I alla fall instruerade instruktören och urvalaren kodgenereringen med vanligt språk.

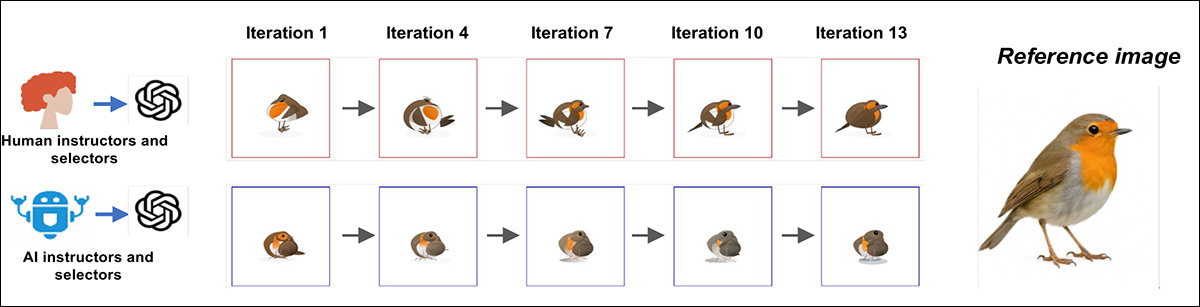

Ett representativt exempel på flera omgångar av vibe-kodning visar hur processen avviker över tid; när människor fungerade som både urvalare och instruktör, förbättrades SVG-utdata stadigt över iterationer, och rörde sig närmare referensbilden med varje omgång:

Exempel på framsteg för en referensbild under mänskligt ledd (överst) och AI-ledd (nederst) vibe-kodning, som visar stadig förbättring över iterationer med människor i båda rollerna, och stagnation eller avvikelse när båda rollerna hanteras av AI.

Tvärtom, i den AI-ledda versionen, fångade tidiga omgångar ibland viktiga visuella funktioner, men senare försök misslyckades med att bygga på dessa vinster, och i vissa fall avvek från målet:

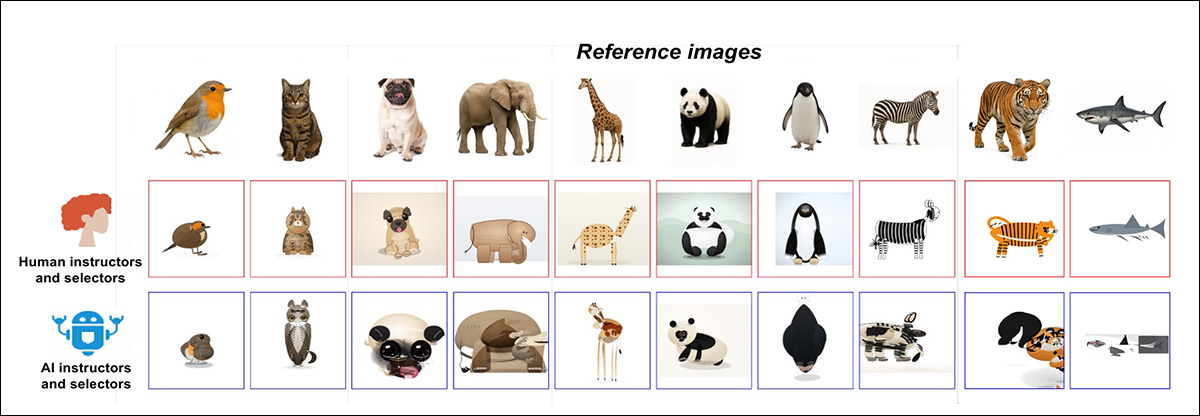

Slutliga utdata från den sista iterationen, som jämför mänskligt ledda omgångar (översta raden) med AI-ledda kedjor (nedersta raden), över samma uppsättning referensbilder. De mänskligt ledda resultaten matchar mer exakt de ursprungliga djuren, medan de AI-ledda resultaten visar synliga förvrängningar eller förlust av viktiga funktioner.

För att mäta de framväxande trenderna kvantitativt visades de slutliga bilderna för oberoende mänskliga bedömare och betygsattes för likhet med referensbilderna. I de tidiga omgångarna betygsatte mänskligt ledda och AI-ledda omgångar ungefär lika; men vid den femtonde omgången var skillnaden tydlig, med de mänskligt valda bilderna betygsatta mycket närmare målen. Över tiden steg de mänskliga betygen stadigt, med den största relativa vinsten över AI på 27,1%.

Genomsnittliga likhetsbetyg över iterationer för mänskligt ledd och AI-ledd vibe-kodning, som visar stadiga vinster när människor fungerar som både urvalare och instruktör, och en gradvis försämring när båda rollerna hanteras av GPT 5.

För att säkerställa att de framväxande trenderna inte berodde på den kollektiva kraften hos flera samtidiga mänskliga deltagare, rekryterade forskarna tio ytterligare personer för att arbeta ensamma, var och en som körde tre omgångar på egen hand – och resultaten förbättrades på samma stadiga sätt, vilket visar att vinsterna inte var en tillfällighet av kollektivt arbete.

Den stora bilden

Men om GPT-5 bedömde utdata själv, skulle den erkänna att de mänskliga resultaten var bättre? Mänskliga och AI-betyg rörde sig vanligtvis i samma riktning, så modellen kunde skilja bra från dåligt, men betygsatte AI-genererade bilder högre än vad människor gjorde.

‘Specifikt frågade vi om AI-agenter skulle erkänna att deras egna utdata är underlägsna de som produceras av människor, eller istället visa en preferens för sina egna skapelser, vilket skulle indikera en potentiell samstämmighetsfråga.’

Som det visade sig, finns det faktiskt en samstämmighetsfråga*:

‘AI-utvärderare tilldelade högre betyg till AI-genererade [utdata]. Dessa fynd tyder på att de observerade prestandaskillnaderna kan härröra från en feljustering i representationer mellan människor och AI.’

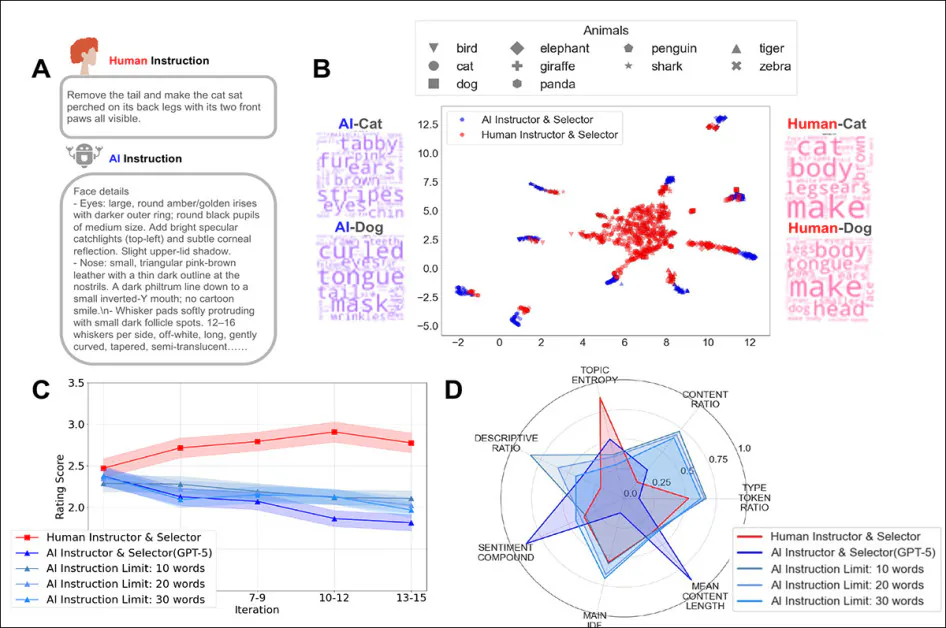

När människor och AI gav instruktioner blev skillnader tydliga i testerna. Som visas i figuren nedan, är både och längd ämnen för AI/mänsklig divergens:

En jämförelse av hur människor och AI gav instruktioner under koduppgiften. ‘A’ visar att människor skriver korta, direkta instruktioner, medan AI skriver långa, detaljerade beskrivningar. ‘B’ kartlägger instruktionerna, och visar att mänskliga prompter klustrar ihop sig, medan AI-prompter splittras isär efter djur. ‘C’ spårar hur begränsning av AI-instruktionslängd inte åtgärdar dess dåliga resultat över tid; och ‘D’ visar att människor ger mer varierad och balanserad vägledning än AI, även när ordgränser påtvingas.

Mänskliga instruktioner tenderade att vara korta och till punkten, och erbjöd tydliga redigeringar som kunde tillämpas allmänt över mål. AI-instruktioner, å andra sidan, var täta med deskriptiv information, och ofta uppsvällda med detaljer om skuggning, texturer, belysning eller anatomiska detaljer – beskrivningar som kan vara meningsfulla i isolering, men misslyckas med att tillhandahålla användbara nästa steg för modellen (och som kommer att vara bekanta för de som är medvetna om LLM:s problem kring kontextlängd, d.v.s. att kunna behålla “den stora bilden” när ett projekt utvecklas och växer).

För att se om minskad verbositet skulle förbättra prestanda, begränsades GPT-5 till 10, 20 eller 30 ord per instruktion; men även dessa komprimerade instruktioner misslyckades med att visa någon förbättring (se nedre högra delen av grafen ovan).

Gemensamma företag

För att testa vad som händer när människor och AI delar kontroll, körde forskarna koduppgifter med olika blandningar av mänsklig och AI-inmatning, som sträckte sig från mestadels mänsklig till mestadels AI.

Varje hybridmix presterade bättre än full AI-kontroll, så att även en liten mänsklig inblandning förbättrade resultaten:

Hybridkodningsuppställningar med olika mänsklig/AI-blandningar. (A) Visar hur människor och AI turades om som instruktörer och urvalare för varje kodsteg; (B) visar att mer mänsklig inblandning ledde till högre kvalitetsresultat, medan större AI-inmatning sänkte betygen; och (C) avbildar en stadig minskning av slutlig utdatorkvalitet när andelen mänskligt deltagande minskar, vilket bekräftar att mer konsekvent mänsklig riktning producerade bättre resultat.

När AI tog över mer av processen, försämrades prestanda, med de bästa resultaten som sågs när människor ledde de flesta omgångar, och de svagaste när AI ledde de flesta omgångar. Ingen av dessa blandade setup kunde fortsätta att förbättra sig med varje ny omgång, vilket tyder på att mänsklig riktning fungerar bäst när den är stadig och konsekvent, snarare än tillfällig.

Rollomvändning

Studien undersökte också om det spelar roll vem som gör vad i dessa typer av uppgifter, och testade för detta. Den reviderade övningen involverade två uppgifter: en deltagare skulle diktera hur man ändrar bilden, och en annan skulle välja en föredragen version.

När båda jobben utfördes av människor, var kvaliteten konstant; men när en människa gav instruktioner och ingen valde mellan versioner, försämrades kvaliteten:

Tester för rollfördelning i vibe-kodning: i (A) ledde borttagning av urvalsrollen till sämre prestanda, även när en människa tillhandahöll instruktioner; i (B) minskade ersättning av den mänskliga urvalaren med en AI kvaliteten något, men inte lika allvarligt som att helt utesluta urval.

När AI var i laddning, spelade det ingen roll att hoppa över valet; eftersom dess utdata förblev konsekventa oavsett. Men när människor gav instruktioner och AI valde mellan resultaten, förblev kvaliteten nära den fullständigt mänskliga setupen.

Det omvända fungerade inte: att ha AI ge instruktioner medan människor valde utdata ledde till sämre resultat, vilket tyder på att mänsklig kreativ vägledning förblir avgörande, medan uppgiften att välja mellan alternativ kan överlåtas till AI utan större kvalitetsförlust.