Artificiell intelligens

Den svårfångade definitionen av ‘Deepfake’

En övertygande ny studie från Tyskland kritiserar EU:s AI-lags definition av begreppet ‘deepfake’ som alltför vag, särskilt i sammanhanget med digital bildmanipulation. Författarna hävdar att lagens betoning på innehåll som liknar verkliga personer eller händelser – men som potentiellt kan verka falska – saknar tydlighet.

De påpekar också att lagens undantag för ‘standardredigering’ (dvs. förmodligen mindre AI-stödd modifiering av bilder) inte tar hänsyn till den omfattande påverkan av AI i konsumenttillämpningar och den subjektiva naturen av konstnärliga konventioner som föregår AI:s uppkomst.

Oexakta lagstiftning på dessa områden ger upphov till två viktiga risker: en ‘kylningsverkan’, där lagens breda tolkningsområde hämmar innovation och införandet av nya system; och en ‘laglös effekt’, där lagen nonchaleras som överdriven eller irrelevanta.

I båda fallen överför otydliga lagar i praktiken ansvaret för att fastställa praktiska rättsliga definitioner till framtida domstolsutslag – en försiktig och riskfyllande tillvägagångssätt för lagstiftning.

AI-baserad bildmanipulationsteknik ligger fortfarande betydligt före lagstiftningens förmåga att hantera dem, verkar det. Till exempel är en anmärkningsvärd exempel på den växande elasticiteten i begreppet AI-driven ‘automatisk’ efterbearbetning, enligt artikeln, Samsungs ‘Scene Optimizer’-funktion i senaste kameror, som kan ersätta användartagna bilder av månen (ett svårt motiv) med en AI-driven, ‘förfinad’ bild:

Övre vänster, ett exempel från den nya artikeln på en riktig användartagen bild av månen, till vänster om en Samsung-förbättrad version som automatiskt skapats med Scene Optimizer; Höger, Samsungs officiella illustration av processen bakom detta; nedre vänster, exempel från Reddit-användaren u/ibreakphotos, som visar (vänster) en medvetet suddig bild av månen och (höger), Samsungs omgestaltning av denna bild – trots att källbilden var en bild av en skärm, och inte den riktiga månen. Källor (medurs från toppen): https://arxiv.org/pdf/2412.09961; https://www.samsung.com/uk/support/mobile-devices/how-galaxy-cameras-combine-super-resolution-technologies-with-ai-to-produce-high-quality-images-of-the-moon/; https:/reddit.com/r/Android/comments/11nzrb0/samsung_space_zoom_moon_shots_are_fake_and_here/

I den nedre vänstra delen av bilden ovan ser vi två bilder av månen. Den till vänster är en foto tagen av en Reddit-användare. Här har bilden medvetet suddats och reducerats av användaren.

Till höger ser vi en foto av samma degraderade bild tagen med en Samsung-kamera med AI-driven efterbearbetning aktiverad. Kameran har automatiskt ‘förbättrat’ det igenkända ‘månen’-objektet, trots att det inte var den riktiga månen.

Artikeln riktar djupare kritik mot Best Take-funktionen i Googles senaste smartphones – en omstridd AI-funktion som redigerar samman de ‘bästa’ delarna av en gruppfoto, scannar flera sekunder av en fotosekvens så att leenden flyttas framåt eller bakåt i tiden efter behov – och ingen visas i mitten av att blinka.

Artikeln hävdar att denna typ av sammansatt process har potentialen att missrepresentera händelser:

‘[I] en typisk grupp fotosättning skulle en genomsnittlig tittare förmodligen fortfarande anse att den resulterande bilden är äkta. Leendet som infogas fanns inom några sekunder från den återstående bilden som togs.

‘Å andra sidan är den tio sekunders tidsramen för best take-funktionen tillräcklig för en humörändring. En person kan ha slutat le som resten av gruppen skrattar åt ett skämt på deras bekostnad.

‘Som en följd antar vi att en sådan grupp foto kan utgöra en deep fake.’

Den nya artikeln heter Vad utgör en Deep Fake? Den suddiga gränsen mellan legitimitet och manipulation under EU:s AI-lag, och kommer från två forskare vid Computational Law Lab vid universitetet i Tübingen och Saarland universitet.

Gamla trick

Att manipulera tid i fotografering är långt äldre än konsumentnivå AI. Artikelförfattarna noterar existensen av mycket äldre tekniker som kan betraktas som ‘oäkta’, såsom sammanfogandet av flera sekventiella bilder till en High Dynamic Range (HDR)-foto, eller en ‘sömd’ panoramabild.

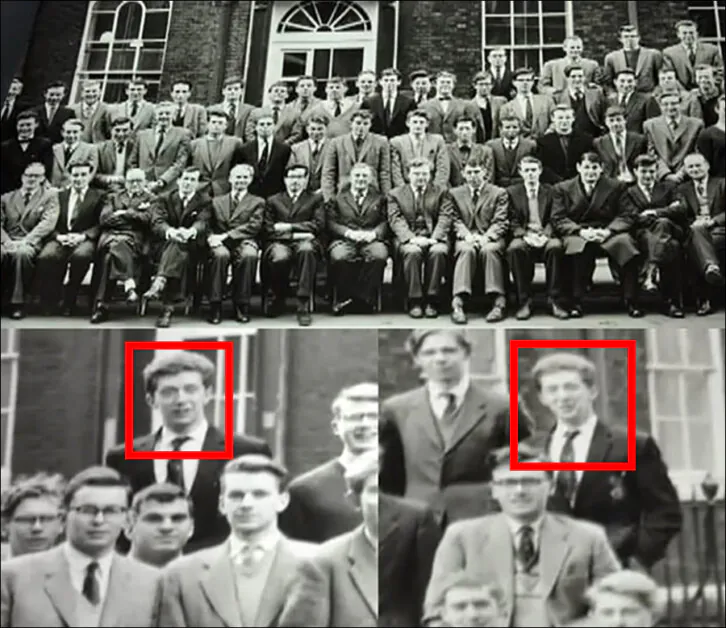

Verkligen, några av de äldsta och mest underhållande fotografiska falsarierna skapades traditionellt av skolbarn som sprang från ena änden av en skolgrupp till den andra, före banan för de speciella panoramkameror som en gång användes för sport- och skolfotografering – vilket möjliggjorde för eleven att dyka upp två gånger i samma bild:

Frestelsen att lura panoramakameror under grupp foton var för stor för många studenter, som var villiga att riskera en dålig session i rektorns kontor för att ‘klona’ sig själva i skolfoton. Källa: https://petapixel.com/2012/12/13/double-exposure-a-clever-photo-prank-from-half-a-century-ago/

Om du inte tar en foto i RAW-läge, som i princip dumpar kamerans lins sensor till en mycket stor fil utan någon form av tolkning, är det troligt att dina digitala foton inte är helt äkta. Kameror tillämpar rutinmässigt ‘förbättrings’algoritmer som t.ex. bildskärpa och vitbalans, som standard – och har gjort så sedan ursprunget till konsumentnivå digital fotografering.

Artikelförfattarna hävdar att även dessa äldre typer av digital fotoförbättring inte representerar ‘verkligheten’, eftersom sådana metoder är utformade för att göra foton mer tilltalande, inte mer ‘verkliga’.

Studien föreslår att EU:s AI-lag, även med senare ändringar som recitals 123–27, placerar all fotografisk utdata inom ett bevis-ramverk som inte är lämpligt för sammanhanget där foton produceras idag, till skillnad från den (nominellt objektiva) naturen av säkerhetskamerabilder eller forensisk fotografering. De flesta bilder som behandlas av AI-lagen är mer benägna att härröra från sammanhang där tillverkare och onlineplattformar aktivt främjar kreativ foto tolkning, inklusive användning av AI.

Forskarna föreslår att foton ‘aldrig har varit en objektiv avbildning av verkligheten’. Överväganden som kamerans placering, val av djup och ljus, bidrar alla till att göra en fotografi djupt subjektiv.

Artikeln observerar att rutinmässiga ‘städning’ uppgifter – som att ta bort sensor damm eller oönskade elledningar från en annars välkomponerad scen – var endast semiautomatiserade före AI:s uppkomst: användare var tvungna att manuellt välja en region eller initiera en process för att uppnå sitt önskade resultat.

Idag är dessa operationer ofta utlösta av en användares textprompt, mest anmärkningsvärt i verktyg som Photoshop. På konsumentnivå är sådana funktioner alltmer automatiserade utan användarindata – ett resultat som uppenbarligen betraktas av tillverkare och plattformar som ‘uppenbarligen önskvärt’.

Den utspädda betydelsen av ‘Deepfake’

En central utmaning för lagstiftning kring AI-ändrad och AI-genererad bild är den tvetydighet av begreppet ‘deepfake’, som har haft sin betydelse betydligt utvidgad under de senaste två åren.

Ursprungligen tillämpades termerna endast på videooutput från autoencoder-baserade system som DeepFaceLab och FaceSwap, båda härledda från anonym kod som publicerades på Reddit i slutet av 2017.

Från 2022, med ankomsten av Latent Diffusion Models (LDMs) som Stable Diffusion och Flux, samt text-till-video-system som Sora, kunde också möjliggöra identitetsswap och anpassning, med förbättrad upplösning, flexibilitet och trohet. Nu var det möjligt att skapa diffusionsbaserade modeller som kunde avbilda kändisar och politiker. Eftersom termen ‘deepfake’ redan var en rubrik som genererade skatter för medieproducenter, utvidgades den till att omfatta dessa system.

Senare, i både media och forskningslitteraturen, kom termen också att omfatta textbaserad imitation. Vid den här punkten var den ursprungliga betydelsen av ‘deepfake’ allt annat än förlorad, medan dess utvidgade betydelse var ständigt utvecklande och alltmer utspädd.

Men eftersom ordet var så kontroversiellt och galvaniserande, och var nu en kraftfull politisk och medial referenspunkt, visade det sig omöjligt att ge upp. Det drog läsare till webbplatser, finansiering till forskare och uppmärksamhet till politiker. Denna lexikala tvetydighet är det huvudsakliga fokuset för den nya forskningen.

Som författarna observerar, artikel 3(60) i EU:s AI-lag definierar fyra villkor som definierar en ‘deepfake’.

1: Sann Måne

Först måste innehållet vara genererat eller manipulerat, dvs. antingen skapat från scratch med AI (generering) eller ändrat från befintliga data (manipulation). Artikeln betonar svårigheten att skilja mellan ‘acceptabel’ bildredigering och manipulativa deepfakes, med tanke på att digitala foton i alla fall aldrig är sanna representationer av verkligheten.

Artikeln hävdar att en Samsung-genererad måne är förmodligen äkta, eftersom månen är osannolikt att ändra utseende, och eftersom AI-genererat innehåll, tränat på riktiga månbilder, sannolikt är korrekt.

Men författarna påpekar också att eftersom Samsung-systemet har visat sig generera en ‘förbättrad’ bild av månen i ett fall där källbilden inte var månen själv, skulle detta betraktas som en ‘deepfake’.

Det skulle vara opraktiskt att ta fram en omfattande lista över olika användningsfall runt denna typ av ad hoc-funktionalitet. Därför verkar definitionens börda passera, än en gång, till domstolarna.

2: TextFakes

Sedan måste innehållet vara i form av bild, ljud eller video. Textinnehåll, medan det är föremål för andra transparenskrav, betraktas inte som en deepfake enligt AI-lagen. Detta behandlas inte i detalj i den nya studien, men det kan ha en betydande inverkan på effektiviteten av visuella deepfakes (se nedan).

3: Verkliga Världsproblem

Tredje, innehållet måste likna befintliga personer, föremål, platser, enheter eller händelser. Detta villkor etablerar en anslutning till den verkliga världen, vilket innebär att renodlat fabricerat material, även om det är fotorealistiskt, inte skulle kvalificera sig som en deepfake. Recital 134 i EU:s AI-lag betonar ‘likhet’-aspekten genom att lägga till ordet ‘i betydande grad’ (en uppenbar hänvisning till efterföljande rättsliga avgöranden).

Författarna, som citerar tidigare arbete, överväger om en AI-genererad ansikte måste tillhöra en verklig person, eller om det bara måste vara tillräckligt liknande en verklig person, för att tillfredsställa denna definition.

Till exempel, hur kan man bestämma om en sekvens av fotorealistiska bilder som avbildar politikern Donald Trump har avsikt att imitera, om bilderna (eller bifogade texter) inte specifikt nämner honom? Ansiktsigenkänning? Användarundersökningar? En domares definition av ‘sunda förnuft’?

Återgående till ‘TextFakes’-frågan (se ovan), utgör ord ofta en betydande del av handlingen av en visuell deepfake. Till exempel är det möjligt att ta en (oförändrad) bild eller video av ‘person a’, och säga, i en rubrik eller ett socialt medieinlägg, att bilden är av ‘person b’ (under förutsättning att de två personerna liknar varandra).

I ett sådant fall behövs ingen AI, och resultatet kan vara slående effektivt – men utgör ett sådant lågtekniskt tillvägagångssätt också en ‘deepfake’?

4: Retusch, Omforma

Slutligen måste innehållet verka äkta eller sanningsenligt för en person. Detta villkor betonar uppfattningen av mänskliga åskådare. Innehåll som endast erkänns som representerande en verklig person eller föremål av en algoritm skulle inte betraktas som en deepfake.

Av alla villkoren i 3(60) är detta det som mest uppenbart hänvisar till den senare domen av en domstol, eftersom det inte tillåter någon tolkning via tekniska eller mekaniserade medel.

Det finns tydliga svårigheter att nå enighet om en sådan subjektiv bestämmelse. Författarna observerar, till exempel, att olika människor, och olika typer av människor (såsom barn och vuxna), kan vara olika benägna att tro på en viss deepfake.

Författarna påpekar vidare att de avancerade AI-funktionerna i verktyg som Photoshop utmanar traditionella definitioner av ‘deepfake.’ Medan dessa system kan innehålla grundläggande skydd mot kontroversiellt eller förbjudet innehåll, expanderar de dramatiskt konceptet ‘retusch.’ Användare kan nu lägga till eller ta bort föremål på ett övertygande, fotorealistiskt sätt, och uppnå en professionell nivå av äkthet som omdefinierar gränserna för bildmanipulation.

Författarna hävdar:

‘Vi hävdar att den nuvarande definitionen av deepfakes i AI-lagen och de motsvarande skyldigheterna är inte tillräckligt specificerade för att hantera utmaningarna som deepfakes utgör. Genom att analysera livscykeln för en digital foto från kamerans sensor till digitala redigeringsfunktioner, finner vi att:

‘(1.) Deepfakes är dåligt definierade i EU:s AI-lag. Definitionen lämnar för mycket utrymme för vad en deepfake är.

‘(2.) Det är oklart hur redigeringsfunktioner som Googles “best take”-funktion kan betraktas som undantag från transparenskrav.

‘(3.) Undantaget för väsentligt redigerat innehåll väcker frågor om vad som utgör väsentlig redigering av innehåll och om denna redigering måste vara märkbar för en naturlig person.’

Ta Undantag

EU:s AI-lag innehåller undantag som, enligt författarna, kan vara mycket tillåtande. Artikel 50(2), hävdar de, erbjuder ett undantag i fall där majoriteten av en ursprunglig källbild inte ändras. Författarna noterar:

‘Vad kan betraktas som innehåll i den mening som avses i artikel 50(2) i fall av digitalt ljud, bilder och videor? Till exempel, i fallet med bilder, måste vi överväga pixlrummet eller det synliga utrymmet som uppfattas av människor? Väsentliga manipulationer i pixlrummet kan inte förändra mänsklig uppfattning, och å andra sidan kan små störningar i pixlrummet förändra uppfattningen dramatiskt.’

Forskarna ger exemplet med att lägga till en handvapen till en foto av en person som pekar på någon. Genom att lägga till vapnet ändras så lite som 5% av bilden; dock är den semantiska betydelsen av den ändrade delen betydande. Därför verkar detta undantag inte ta hänsyn till någon ‘sunda förnuft’-uppfattning av den effekt en liten detalj kan ha på en bild.

Avdelning 50(2) tillåter också undantag för en ‘assistansfunktion för standardredigering’. Eftersom lagen inte definierar vad ‘standardredigering’ innebär, verkar till och med postbearbetningsfunktioner som Googles Best Take vara skyddade av detta undantag, observerar författarna.

Slutsats

Den uttalade avsikten med det nya arbetet är att uppmuntra tvärvetenskapliga studier kring regleringen av deepfakes, och att fungera som en utgångspunkt för nya samtal mellan datavetare och juridiska experter.

Men artikeln själv faller offer för tautologi på flera punkter: den använder ofta termen ‘deepfake’ som om dess betydelse vore självklar, medan den samtidigt kritiserar EU:s AI-lag för att inte definiera vad som faktiskt utgör en deepfake.

Publicerad första gången måndagen den 16 december 2024