Artificiell intelligens

ST-NeRF: Komposition och redigering för videosyntes

Ett kinesiskt forskningskonsortium har utvecklat tekniker för att bringa redigerings- och kompositionsförmågor till en av de hetaste bildsyntesforskningssektorerna under det senaste året – Neurala Radiance Fields (NeRF). Systemet kallas ST-NeRF (Spatio-Temporal Coherent Neural Radiance Field).

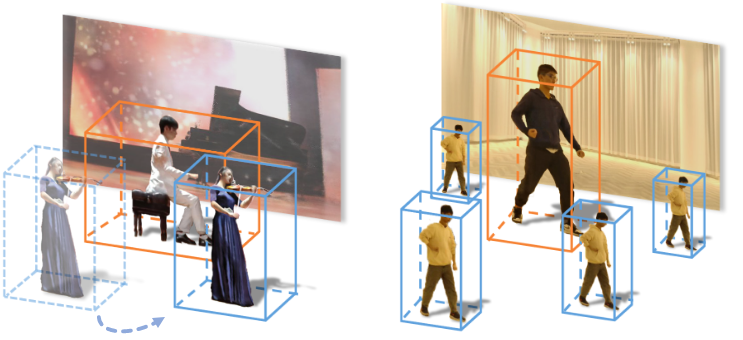

Vad som verkar vara en fysisk kamerarörelse i bilden nedan är faktiskt bara en användare som “bläddrar” genom vypunkter på videoinnehåll som existerar i ett 4D-utrymme. POV är inte låst till prestationen av de avbildade personerna i videon, vars rörelser kan ses från valfri del av en 180-graders radius.

Varje fasett inom videon är ett diskret inspelat element, komponerat samman till en sammanhängande scen som kan utforskas dynamiskt.

Fasetterna kan fritt dupliceras inom scenen eller ändras i storlek:

Dessutom kan den temporala beteendet hos varje fasett enkelt ändras, sakta ner, köra bakåt eller manipuleras på något sätt, vilket öppnar vägen för filterarkitekturer och en extremt hög nivå av tolkbarhet.

Two separate NeRF facets run at different speeds in the same scene. Source: https://www.youtube.com/watch?v=Wp4HfOwFGP4

Det finns ingen anledning att rotoscopera utövare eller miljöer, eller ha utövare utföra sina rörelser blint och utanför den avsedda scenen. Istället spelas inspelningen in naturligt via en matris av 16 videokameror som täcker 180 grader:

The three elements depicted above, the two people and the environment, are distinct, and outlined only for illustrative purposes. Each can be swapped out, and each can be inserted into the scene at an earlier or later point in their individual capture timeline.

ST-NeRF är en innovation inom forskning om Neurala Radiance Fields (NeRF), ett maskinlärningsramverk där flera vyinspelningar syntetiseras till ett navigerbart virtuellt utrymme genom omfattande utbildning (även om en vyinspelning också är en undersektor av NeRF-forskning).

Neural Radiance Fields work by collating multiple capture viewpoints into a single coherent and navigable 3D space, with the gaps between coverage estimated and rendered by a neural network. Where video (rather than still images) is used, the rendering resources needed are often considerable. Source: https://www.matthewtancik.com/nerf

Intresset för NeRF har blivit intensivt under de senaste nio månaderna, och en lista över derivativa eller exploratoriska NeRF-papper som underhålls av Reddit listar för närvarande sextio projekt.

Just a few of the many off-shoots of the original NeRF paper. Source: https://crossminds.ai/graphlist/nerf-neural-radiance-fields-ai-research-graph-60708936c8663c4cfa875fc2/

Billig utbildning

Artikeln är ett samarbete mellan forskare vid Shanghai Tech University och DGene Digital Technology, och har accepterats med viss entusiasm på Open Review.

ST-NeRF erbjuder ett antal innovationer jämfört med tidigare initiativ inom ML-derivata navigerbara videoutrymmen. Inte minst uppnår det en hög nivå av realism med bara 16 kameror. Även om Facebooks DyNeRF använder bara två kameror mer än detta, erbjuder det ett mycket mer begränsat navigerbart område.

An example of Facebook’s DyNeRF environment, with a more limited field of movement, and more cameras per square foot needed to reconstruct the scene. Source: https://neural-3d-video.github.io

Förutom att det saknar förmågan att redigera och komponera individuella fasetter, är DyNeRF särskilt dyrt i termer av beräkningsresurser. I kontrast hävdar de kinesiska forskarna att utbildningskostnaden för deras data ligger någonstans mellan $900-$3,000, jämfört med $30,000 för den state-of-the-art-videogenereringsmodellen DVDGAN och intensiva system som DyNeRF.

Granskare har också noterat att ST-NeRF gör en stor innovation i att koppla loss processen att lära sig rörelse från processen att syntetisera bilder. Denna separation är vad som möjliggör redigering och komposition, med tidigare tillvägagångssätt som är begränsade och linjära i jämförelse.

Även om 16 kameror är en mycket begränsad matris för ett sådant fullt halvcirkelområde, hoppas forskarna att kunna minska detta antal ytterligare i senare arbete genom att använda proxy-förinspelade statiska bakgrunder och mer data-drivna scenmodelleringstillvägagångssätt. De hoppas också att kunna inkorporera om-belysningsförmågor, en senaste innovation inom NeRF-forskning.

Att hantera begränsningar i ST-NeRF

I sammanhanget av akademiska CS-papper som tenderar att förstöra den faktiska användbarheten av ett nytt system i en bortkastad slutparagraf, är till och med begränsningarna som forskarna erkänner för ST-NeRF ovanliga.

De observerar att systemet för närvarande inte kan individuera och separat återge särskilda objekt i en scen, eftersom personerna i inspelningen segmenteras i individuella enheter via ett system som är utformat för att känna igen människor och inte objekt – ett problem som verkar lätt att lösa med YOLO och liknande ramverk, med det svåra arbetet med att extrahera mänsklig video redan utfört.

Även om forskarna noterar att det för närvarande inte är möjligt att generera slow-motion, verkar det finnas lite som hindrar implementeringen av detta med hjälp av befintliga innovationer inom raminterpolation som DAIN och RIFE.

Som med alla NeRF-implementationer och i många andra sektorer av datorseende-forskning, kan ST-NeRF misslyckas i fall av allvarlig ocklusion, där subjektet tillfälligt skymmas av en annan person eller ett föremål, och kan vara svårt att kontinuerligt spåra eller att återvinna med precision efteråt. Som på andra håll kan denna svårighet behöva vänta på uppströmslösningar. Under tiden medger forskarna att manuell ingripande är nödvändigt i dessa ockluderade ramar.

Slutligen observerar forskarna att de mänskliga segmenteringsförfarandena för närvarande förlitar sig på färgskillnader, vilket kan leda till oavsiktlig sammanfogning av två personer till en segmenteringsblock – ett hinder som inte är begränsat till ST-NeRF, men är intrinsic för den bibliotek som används, och som kanske kan lösas med optisk flödesanalys och andra framväxande tekniker.

Publicerad första gången 7 maj 2021.