Andersons vinkel

‘Skyddade’ Bilder Är Lättare, Inte Svårare, Att Stjäla Med AI

Nya forskningsresultat tyder på att vattenstämpelverktyg som är avsedda att blockera AI-bildredigeringar kan ha en motsatt effekt. Istället för att förhindra modeller som Stable Diffusion från att göra ändringar, kan vissa skydd faktiskt hjälpa AI:n att följa redigeringsprompten mer noggrant, vilket gör oönskade manipulationer ännu enklare.

Det finns en anmärkningsvärd och robust tråd i datorseende-litteraturen som är dedikerad till att skydda upphovsrättsskyddade bilder från att tränas in i AI-modeller eller användas i direkt bild-till-bild AI-processer. System av detta slag är vanligtvis inriktade på Latent Diffusion Models (LDMs) som Stable Diffusion och Flux, som använder brus-baserade procedurer för att koda och avkoda bilder.

Genom att införa adversarialt brus i annars normalt utseende bilder, kan det vara möjligt att orsaka att bild-detektorer gissar bildinnehållet felaktigt och hindra bild-genererande system från att utnyttja upphovsrättsskyddade data:

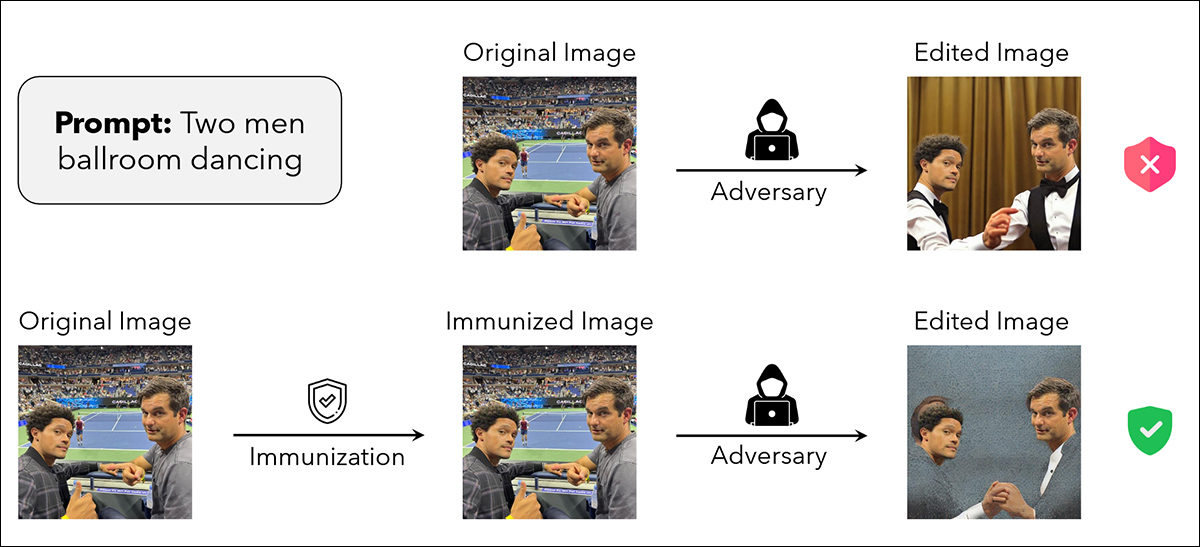

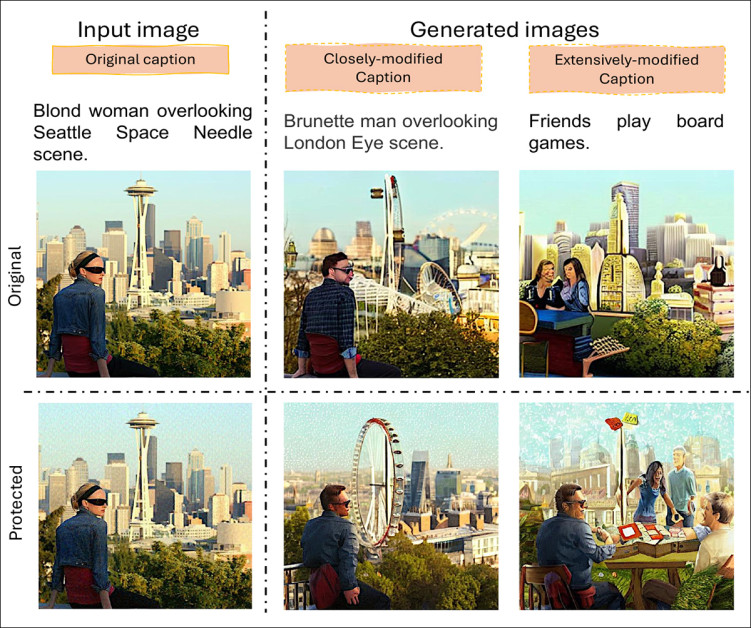

Från MIT-papperet ‘Raising the Cost of Malicious AI-Powered Image Editing’, exempel på en källbild ‘immuniserad’ mot manipulation (nedre raden). Källa: https://arxiv.org/pdf/2302.06588

Sedan en konstnärsbakslag mot Stable Diffusions liberala användning av web-skapade bilder (inklusive upphovsrättsskyddade bilder) 2023, har forskningsscenen producerat flera varianter av samma tema – idén att bilder kan vara osynligt ‘förgiftade’ mot att tränas in i AI-system eller sugas in i generativa AI-pipelines, utan att negativt påverka bildens kvalitet för den genomsnittlige åskådaren.

I alla fall finns det en direkt korrelation mellan intensiteten hos den påtvingade perturbationen, den utsträckning till vilken bilden sedan skyddas och den utsträckning till vilken bilden inte ser riktigt bra ut som den borde:

Även om kvaliteten på forsknings-PDF:n inte helt illustrerar problemet, offrar större mängder adversarial perturbation kvalitet för säkerhet. Här ser vi skalan av kvalitetsstörningar i 2020 års ‘Fawkes’-projekt lett av University of Chicago. Källa: https://arxiv.org/pdf/2002.08327

Av särskilt intresse för konstnärer som söker skydda sina stilar mot obehörig appropriering är kapaciteten hos sådana system att inte bara fördunkla identitet och annan information, utan att ‘övertyga’ en AI-träningsprocess om att den ser något annat än vad den faktiskt ser, så att kopplingar inte bildas mellan semantiska och visuella domäner för ‘skyddad’ träningsdata (dvs. en prompt som ‘I stilen av Paul Klee’).

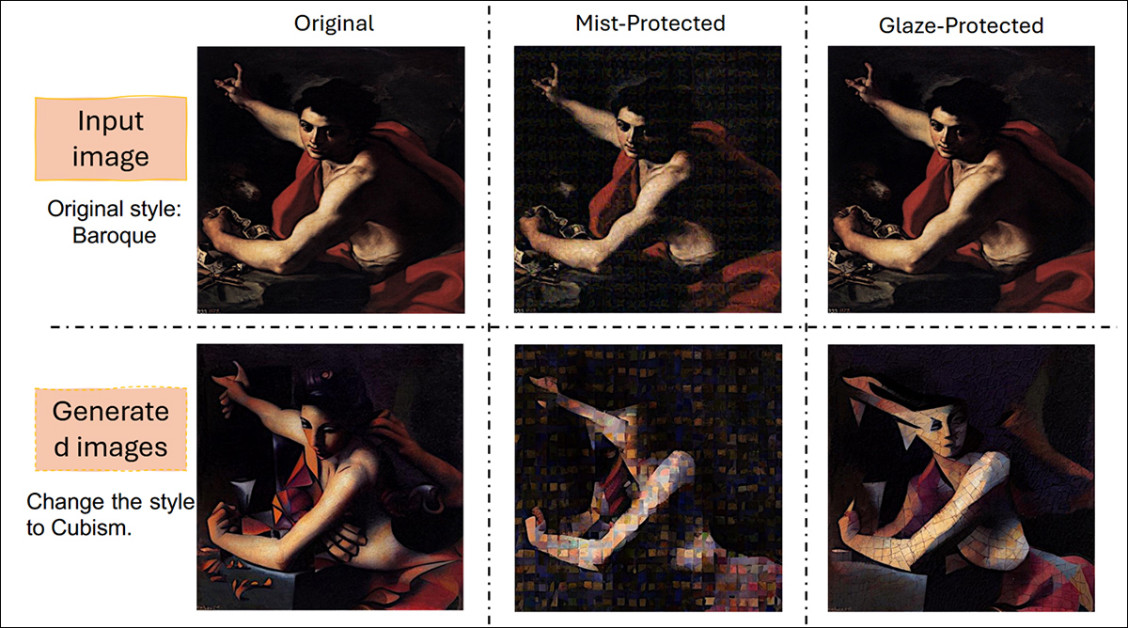

Mist och Glaze är två populära injiceringsmetoder som kan förhindra, eller åtminstone allvarligt försvåra, försök att använda upphovsrättsskyddade stilar i AI-arbetsflöden och träningsrutiner. Källa: https://arxiv.org/pdf/2506.04394

Ägar Mål

Nu har ny forskning från USA visat att inte bara perturbationer kan misslyckas med att skydda en bild, utan att tillägga perturbationer faktiskt kan förbättra bildens exploaterbarhet i alla AI-processer som perturbationen är avsedd att immunisera mot.

Papperet hävdar:

‘I våra experiment med olika perturbations-baserade bildskyddsmetoder över flera domäner (naturliga scenbilder och konstverk) och redigeringsuppgifter (bild-till-bild-generering och stilredigering), upptäcker vi att ett sådant skydd inte uppnår detta mål fullständigt.

‘I de flesta scenarier genererar diffusion-baserad redigering av skyddade bilder en önskvärd utgångsbild som följer prompten mycket noggrant.

‘Våra resultat tyder på att tillägga brus till bilder kan paradoxalt sett öka deras association med givna textprompt under genereringsprocessen, vilket leder till oönskade konsekvenser som bättre resultatredigeringar.

‘Därför hävdar vi att perturbations-baserade metoder inte kan ge en tillräcklig lösning för robust bildskydd mot diffusion-baserad redigering.’

I testerna utsattes de skyddade bilderna för två bekanta AI-redigerings-scenarier: direkt bild-till-bild-generering och stilöverföring. Dessa processer återspeglar de vanliga sätten som AI-modeller kan utnyttja skyddat innehåll, antingen genom att direkt ändra en bild eller genom att låna dess stilistiska egenskaper för användning på annat håll.

De skyddade bilderna, hämtade från standardkällor för fotografi och konstverk, kördes genom dessa pipelines för att se om de tillagda perturbationerna kunde blockera eller försämra redigeringarna.

Istället tycktes närvaron av skydd ofta skärpa modellens anpassning till prompten, producerande rena, exakta utgångar där någon form av misslyckande hade förväntats.

Författarna råder, i princip, att denna mycket populära metod för skydd kan ge en falsk känsla av säkerhet, och att alla sådana perturbations-baserade immuniseringstillvägagångssätt bör testas noggrant mot författarnas egna metoder.

Metod

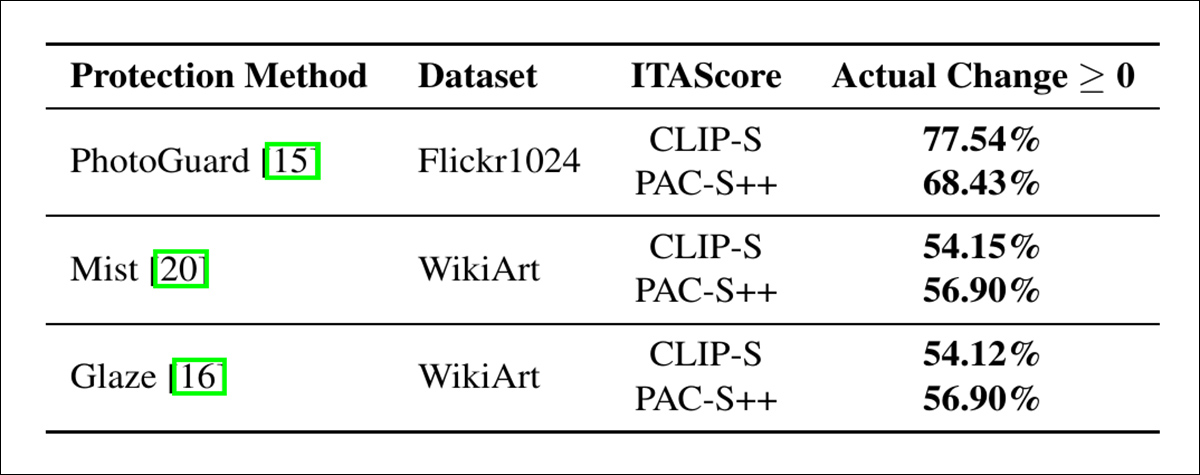

Författarna körde experiment med tre skyddsmetoder som tillämpar noggrant utformade adversariala perturbationer: PhotoGuard; Mist; och Glaze.

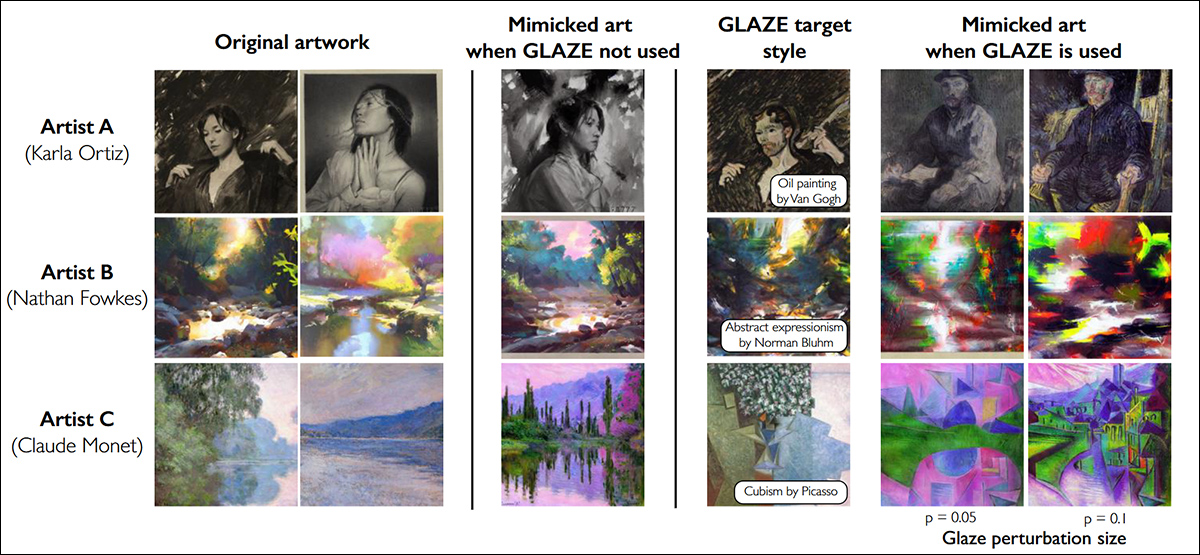

Glaze, en av ramverken testade av författarna, illustrerar Glaze-skyddsexempel för tre konstnärer. De två första kolumnerna visar de ursprungliga konstverken; den tredje kolumnen visar mimicry-resultat utan skydd; den fjärde, stil-överförda versioner som används för cloak-optimisering, tillsammans med målstilsnamnet. Den femte och sjätte kolumnen visar mimicry-resultat med cloaking tillämpat vid perturbationsnivåer p = 0,05 och p = 0,1. Alla resultat använder Stable Diffusion-modeller. https://arxiv.org/pdf/2302.04222

PhotoGuard tillämpades på naturliga scenbilder, medan Mist och Glaze användes på konstverk (dvs. ‘konstnärligt utformade’ domäner).

Testerna omfattade både naturliga och konstnärliga bilder för att återspegla möjliga realvärldsscenarier. Effektiviteten hos varje metod bedömdes genom att kontrollera om en AI-modell fortfarande kunde producera realistiska och prompt-relevanta redigeringar när den arbetade med skyddade bilder; om de resulterande bilderna såg övertygande ut och matchade prompten, ansågs skyddet ha misslyckats.

Stable Diffusion v1.5 användes som den förtränade bild-genereringsmodellen för forskarnas redigeringsuppgifter. Fem frön valdes för att säkerställa reproducerbarhet: 9222, 999, 123, 66 och 42. Alla andra genereringsinställningar, som till exempel guidningsskala, styrka och totala steg, följde standardvärdena som användes i PhotoGuard-experimenten.

PhotoGuard testades på naturliga scenbilder med hjälp av Flickr8k-dataseten, som innehåller över 8 000 bilder parade med upp till fem undertexter vardera.

Motsatta Tankar

Två uppsättningar modifierade undertexter skapades från den första undertexten för varje bild med hjälp av Claude Sonnet 3.5. En uppsättning innehöll prompter som var kontextuellt nära de ursprungliga undertexterna; den andra uppsättningen innehöll prompter som var kontextuellt avlägsna.

Till exempel, från den ursprungliga undertexten ‘En ung flicka i en rosa klänning som går in i en trästuga’, skulle en nära prompt vara ‘En ung pojke i en blå skjorta som går in i ett tegelhus’. I kontrast skulle en avlägsen prompt vara ‘Två katter som ligger på en soffa’.

Nära prompter konstruerades genom att ersätta substantiv och adjektiv med semantiskt liknande termer; långt ifrån prompter genererades genom att instruera modellen att skapa undertexter som var kontextuellt mycket olika.

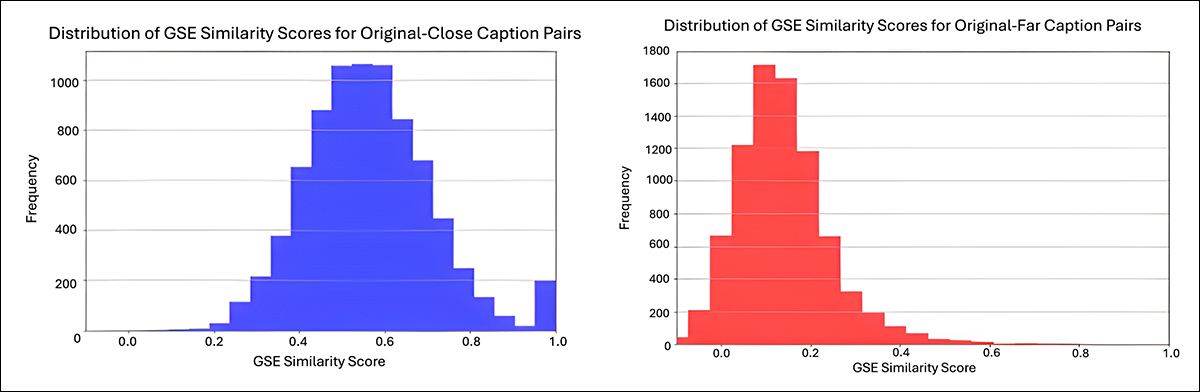

Alla genererade undertexter kontrollerades manuellt för kvalitet och semantisk relevans. Googles Universal Sentence Encoder användes för att beräkna semantiska likhetspoäng mellan de ursprungliga och modifierade undertexterna:

Från det supplementära materialet, semantiska likhetsfördelningar för de modifierade undertexterna som användes i Flickr8k-testerna. Grafen till vänster visar likhetspoängen för nära modifierade undertexter, som i genomsnitt ligger runt 0,6. Grafen till höger visar de omfattande modifierade undertexterna, som i genomsnitt ligger runt 0,1, vilket reflekterar en större semantisk avstånd från de ursprungliga undertexterna. Källa: https://sigport.org/sites/default/files/docs/IncompleteProtection_SM_0.pdf

Varje bild, tillsammans med dess skyddade version, redigerades med hjälp av både nära och avlägsna prompter. Den blinda/referenslösa bild-rumsliga kvalitetsutvärderaren (BRISQUE) användes för att bedöma bildkvalitet:

Bild-till-bild-genereringsresultat på naturliga fotografier skyddade av PhotoGuard. Trots närvaron av perturbationer, följde Stable Diffusion v1.5 lyckat både små och stora semantiska förändringar i redigeringsprompten, producerande realistiska utgångar som matchade de nya instruktionerna.

Mätvärden

För att bedöma hur väl skydden störde AI-redigeringen, mätte forskarna hur nära de slutliga bilderna matchade instruktionerna som de fick, med hjälp av poängsystem som jämförde bildinnehållet med textprompten, för att se hur väl de stämde överens.

För detta ändamål användes CLIP-S-metoden, som använder en modell som kan förstå både bilder och text för att kontrollera hur lika de är, medan PAC-S++ lägger till extra prover skapade av AI för att anpassa sin jämförelse mer noggrant till en mänsklig uppskattning.

Dessa Bild-Text-Justeringspoäng (ITA) anger hur exakt AI:n följde instruktionerna när den modifierade en skyddad bild: om en skyddad bild fortfarande ledde till en högt anpassad utgång, betyder det att skyddet ansågs ha misslyckats med att blockera redigeringen.

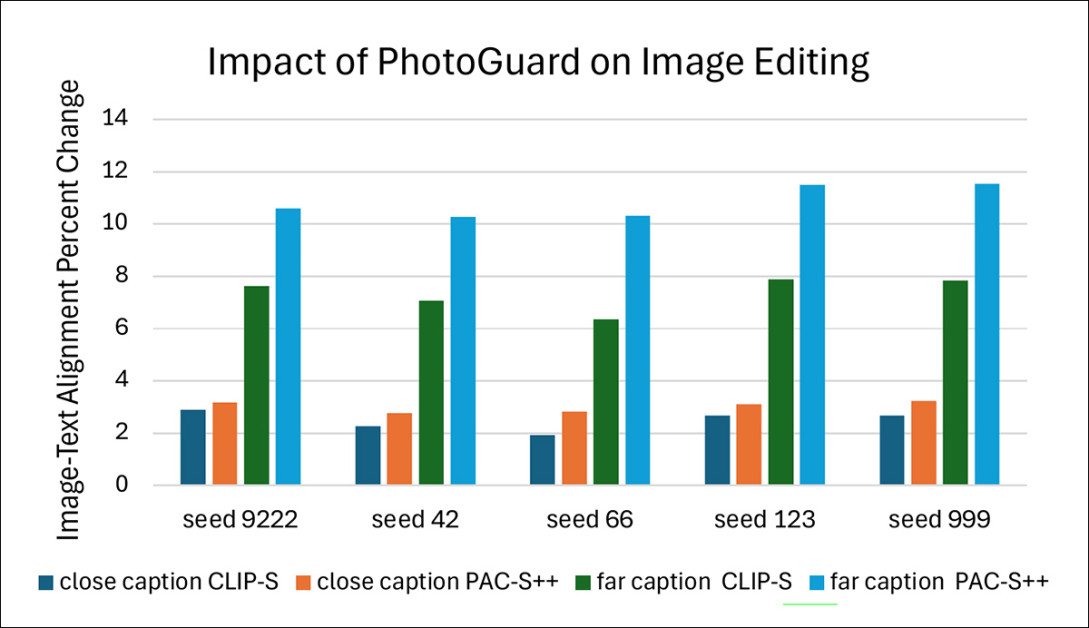

Effekten av skydd på Flickr8k-dataseten över fem frön, med hjälp av både nära och avlägsna prompter. Bild-text-justering mättes med hjälp av CLIP-S- och PAC-S++-poäng.

Forskarna jämförde hur väl AI:n följde prompter när den redigerade skyddade bilder jämfört med oskyddade. De tittade först på skillnaden mellan de två, kallad Verklig Förändring. Sedan skalades skillnaden för att skapa en Procentuell Förändring, vilket gjorde det lättare att jämföra resultat över många tester.

Denna process avslöjade om skydden gjorde det svårare eller enklare för AI:n att matcha prompterna. Testerna upprepades fem gånger med hjälp av olika slumpmässiga frön, som täckte både små och stora förändringar av de ursprungliga undertexterna.

Konst Attack

För testerna på naturliga fotografier användes Flickr1024-dataseten, som innehåller över tusen högkvalitativa bilder. Varje bild redigerades med prompter som följde mönstret: ‘ändra stilen till [V]’, där [V] representerade en av sju berömda konststilar: Kubism; Post-Impressionism; Impressionism; Surrealism; Barock; Fauvism; och Renässans.

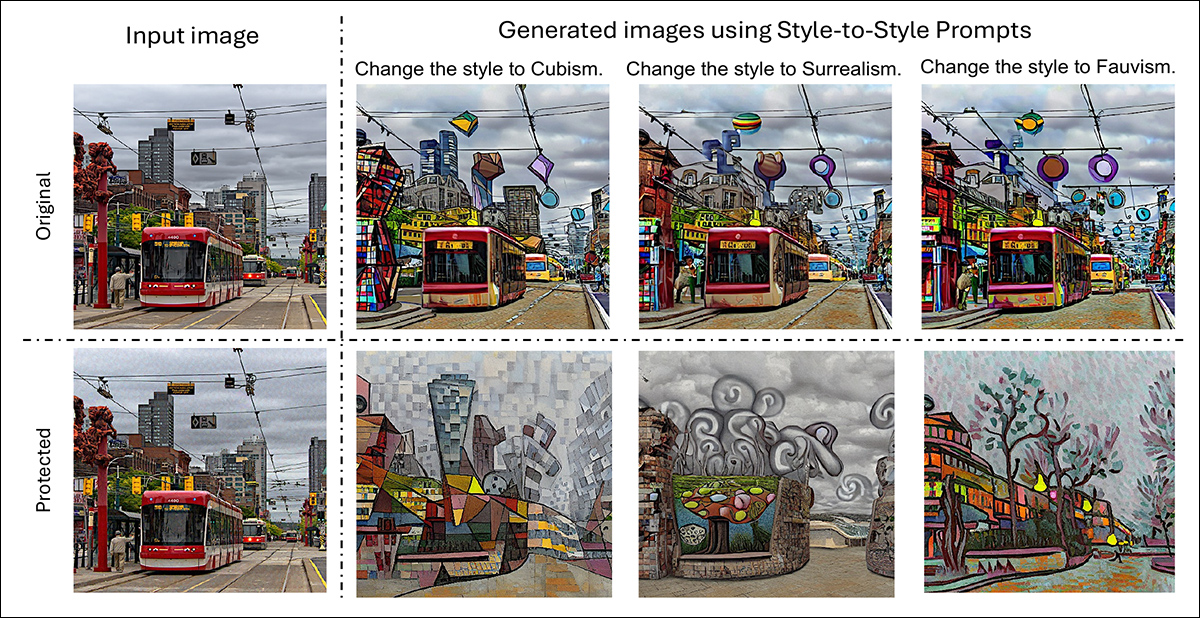

Processen innebar att tillämpa PhotoGuard på de ursprungliga bilderna, generera skyddade versioner och sedan köra både skyddade och oskyddade bilder genom samma uppsättning stil-överföringsredigeringar:

Original och skyddade versioner av en naturlig scenbild, var och en redigerad för att tillämpa Kubism, Surrealism och Fauvism-stilar.

För att testa skyddsmetoder på konstverk utfördes stil-överföring på bilder från WikiArt-dataseten, som kuraterar en bred variation av konststilar. Redigeringsprompterna följde samma format som tidigare, med instruktioner till AI:n att ändra stilen till en slumpmässigt vald, orelaterad stil som valts från WikiArt-etiketterna.

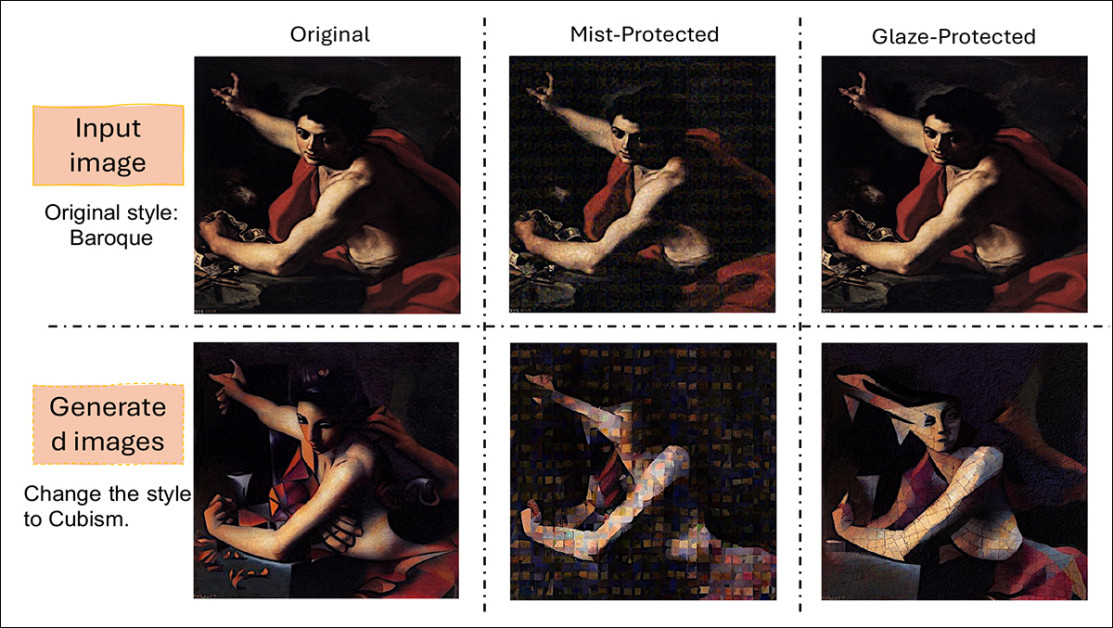

Både Glaze och Mist-skyddsmetoder tillämpades på bilderna innan redigeringarna, vilket gjorde det möjligt för forskarna att observera hur väl varje försvar kunde blockera eller förvränga stil-överföringsresultaten:

Exempel på hur skyddsmetoder påverkar stil-överföring på konstverk. Den ursprungliga Barock-bilden visas bredvid versioner skyddade av Mist och Glaze. Efter att ha tillämpat Kubism-stil-överföring kan man se skillnader i hur varje skydd förändrar den slutliga utgången.

Forskarna testade jämförelserna kvantitativt också:

Förändringar i bild-text-justeringspoäng efter stil-överföringsredigeringar.

Av dessa resultat kommenterar författarna:

‘Resultaten betonar en betydande begränsning av adversariala perturbationer för skydd. Istället för att hindra anpassning, förstärker adversariala perturbationer ofta den generativa modellens respons på prompter, oavsiktligt möjliggörande för utnyttjare att producera utgångar som anpassar sig mer noggrant till deras mål. Sådant skydd är inte störande för bild-redigeringsprocessen och kan inte förhindra att illvilliga agenter kopierar obehörigt material.

‘De oavsiktliga konsekvenserna av att använda adversariala perturbationer avslöjar sårbarheter i befintliga metoder och understryker det brådskande behovet av mer effektiva skyddstekniker.’

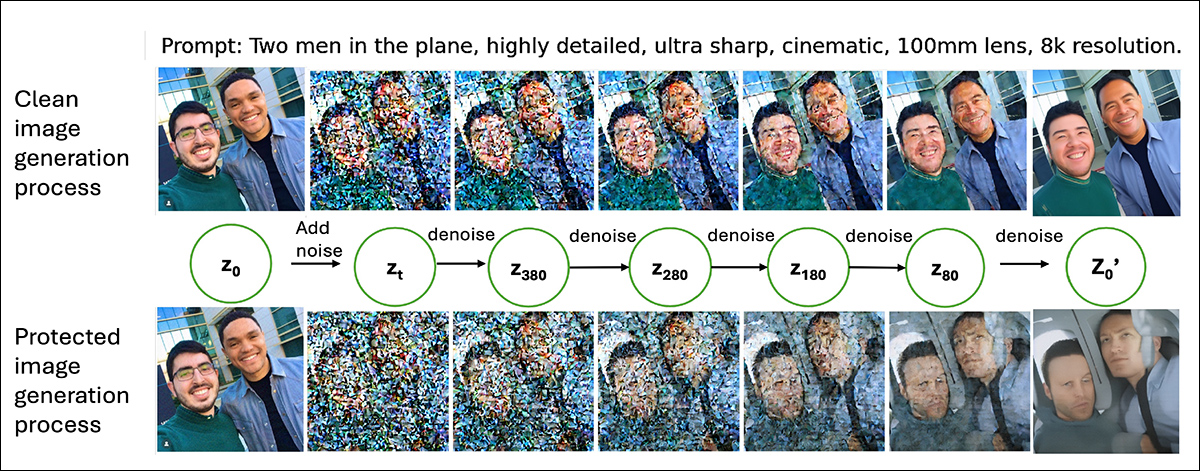

Författarna förklarar att de oväntade resultaten kan spåras tillbaka till hur diffusion-modeller fungerar: LDM-redigerar bilder genom att först konvertera dem till en komprimerad version som kallas en latent; brus läggs sedan till denna latent genom många steg, tills datan blir nästan slumpmässig.

Modellen omvänder denna process under generering, genom att ta bort bruset steg för steg. Vid varje stadium av denna omvändning hjälper textprompten till att styra hur bruset ska rensas, gradvis formande bilden för att matcha prompten:

Jämförelse mellan generationer från en oskyddad bild och en PhotoGuard-skyddad bild, med intermediära latenta tillstånd omvandlade tillbaka till bilder för visualisering.

Skyddsmetoder lägger till små mängder extra brus till den ursprungliga bilden innan den går in i denna process. Medan dessa perturbationer är små från början, ackumuleras de när modellen tillämpar sina egna lager av brus.

Denna ackumulering lämnar fler delar av bilden ‘osäkra’ när modellen börjar ta bort brus. Med större osäkerhet litar modellen mer på textprompten för att fylla i de saknade detaljerna, vilket ger prompten även mer inflytande än den vanligtvis skulle ha.

I verkligheten gör skydden det lättare för AI:n att omforma bilden för att matcha prompten, snarare än svårare.

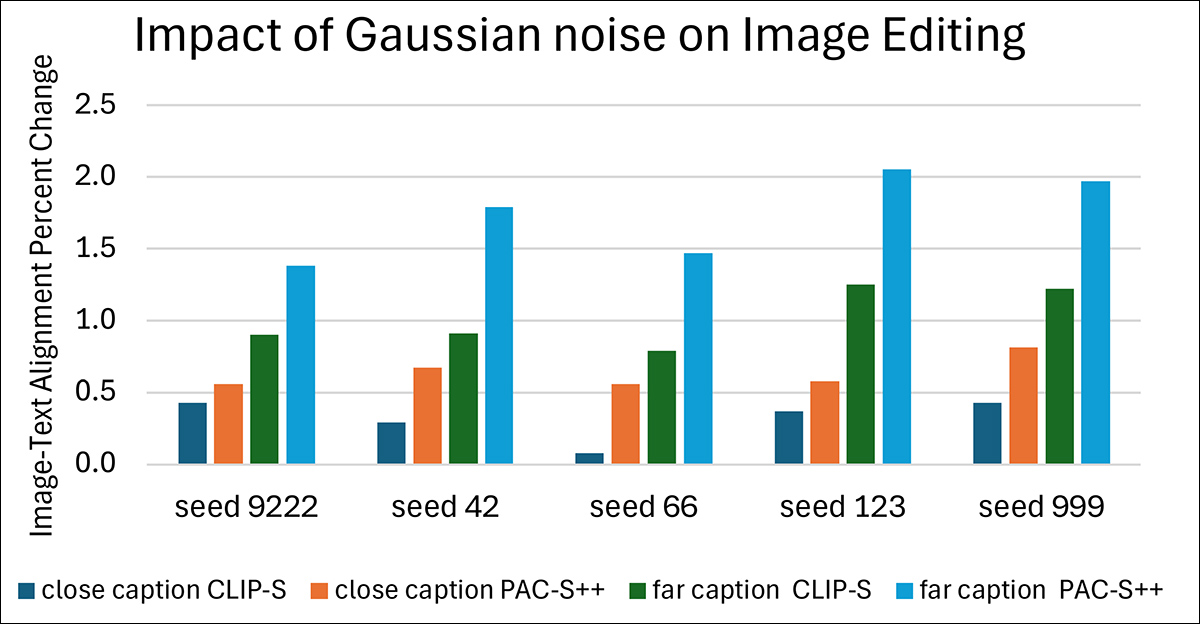

Slutligen genomförde författarna ett test som ersatte utformade perturbationer från Raising the Cost of Malicious AI-Powered Image Editing papper med rent Gaussiskt brus.

Resultaten följde samma mönster som tidigare observerats: över alla tester förblev Procentuell Förändringsvärdena positiva. Även detta slumpmässiga, ostrukturerade brus ledde till starkare anpassning mellan de genererade bilderna och prompterna.

Effekten av simulerat skydd med Gaussiskt brus på Flickr8k-dataseten.

Detta stödde den underliggande förklaringen att allt tillagt brus, oavsett dess design, skapar större osäkerhet för modellen under generering, vilket tillåter textprompten att utöva ännu mer kontroll över den slutliga bilden.

Slutsats

Forsknings-scenen har tryckt på adversarial perturbation vid LDM-upphovsrättsfrågan i nästan lika lång tid som LDM har funnits; men inga robusta lösningar har dykt upp från det exceptionella antalet artiklar som publicerats på detta spår.

Antingen sänker de påtvingade störningarna bildens kvalitet alltför mycket, eller så visar sig mönstren inte vara motståndskraftiga mot manipulation och transformerande processer.

Men det är en svår dröm att överge, eftersom alternativet skulle tyckas vara tredjepartsövervakning och proveniens-ramverk som Adobe-ledda C2PA-schemat, som syftar till att upprätthålla en kedja av ägande för bilder från kameransensor och framåt, men som inte har någon inbyggd koppling till det innehåll som avbildas.

I vilket fall som helst, om adversarial perturbation faktiskt förvärrar problemet, som den nya artikeln antyder kan vara fallet i många situationer, undrar man om sökandet efter upphovsrättsskydd via sådana medel faller under ‘alkemi’.

Publicerad första gången måndagen den 9 juni 2025