Andersons vinkel

PiedPiper-Style Decentraliserade Inferenceservicer för AI?

Är ‘BitTorrent för AI’ en förestående möjlighet?

Åsikt Jag har just avslutat en omgång av Mike Judges underhållande och syrliga tech-bro satir Silicon Valley – där en grupp socialt utmanade geekgenier försöker skapa ett ‘nytt internet’ som kallas PiedPiper, via ett mesh-nätverk installerat på alla mobiltelefoner – och jag blev intresserad av att se HN-gemenskapen engagera sig i ett nytt erbjudande av liknande natur.

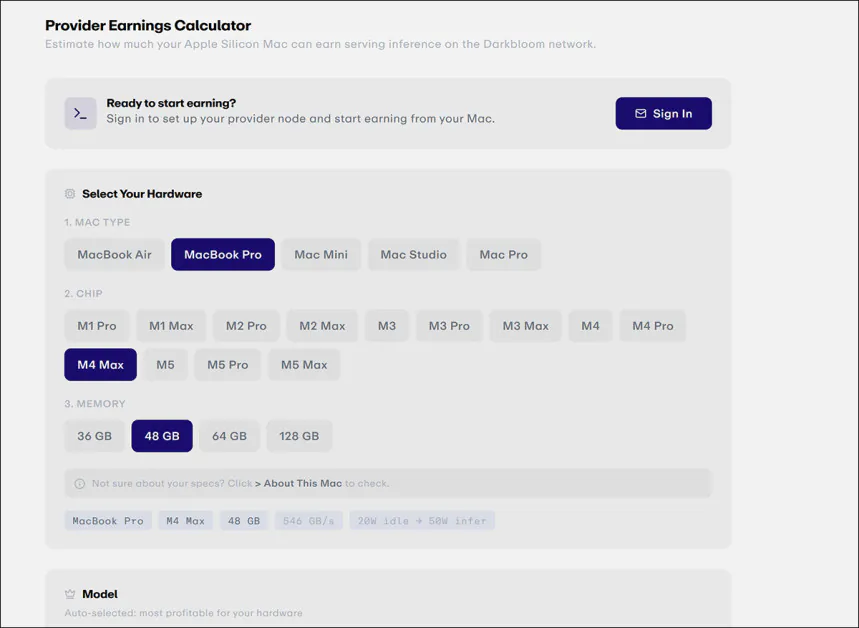

Eigen Labs’ DarkBloom befinner sig någonstans mellan den egalitära notionen om ett decentraliserat mesh-nätverk för AI-inferens, och krypto-gruvdrifts vinstmotiv, och tillåter ägare av Apple Silicon Mac-system att omvandla sin utrustning till en inferensnod:

Från avkastningsdelen av DarkBloom-webbplatsen kan användare välja vilken utrustning de vill hyra ut och vilka AI-modeller de vill stödja. Källa

Systemet koncentrerar sig för närvarande på textbaserade modeller som den agenterade Trinity Mini (3B) och Cohere Transcribe, men det erbjuder också diverse bildgenererande modeller som FLUX 2 Klein 4B:

Utbudet av modeller som ‘landlord’ kan välja att hyra ut, tillsammans med månatliga projicerade inkomster.

Användare som deltar i schemat kan tydligen tjäna tillräckligt med pengar under en solid månad av inferens tillhandahållande för att ganska regelbundet lägga till en ny Mac till en växande kedja, tills de i teorin kan tjäna en fullfjädrad inferensfarm.

Effektivt, ett system av detta slag som verkligen vinner popularitet (det har ett kallstartproblem just nu) kan sätta entusiastiska casualanvändare tillbaka i en hårdvarusökningsposition, som under den senaste stora krypto-boomen (och påföljande krasch).

Inte Så Fort

Men för de små killarna, kan den båten ha seglat. Utöver AI:s apokalyptiska behov av RAM, fortsätter den globala efterfrågan på AI-aktiverade datacenterutrustning att höja hårdvaru- och tjänstekostnader för den vanliga konsumenten, som tidigare kunde monopolisera RAM för krypto-gruvdrift på grund av den perifera naturen hos aktiviteten, samt regleringsosäkerhet, som höll företagsintressen försiktiga med krypto.

Medan den superbilliga MacBook Neo har dykt upp som en crunch-beating alternativ till alltmer eskalerande hårdvara, är dess A18-mobiltelefonchip och 8 GB VRAM inte i allvarlig strid som en inferensmaskin.

Men även om slutanvändaren inte försöker starta en fullfjädrad inferensfarm, och bara vill hyra ut sin outnyttjade M[n]-kapacitet, verkar de potentiella inkomsterna betydande, om det kallstartproblem (en initial brist på användare vid öppnandet av en angelägenhet som förlitar sig på ett stort antal deltagare) snabbt löses, och om plattformen börjar marknadsföra sig som något mer än ett nyfiket experiment i potentiell efterfrågan.

Inferera Annorlunda

Även om ett antal kommentatorer har erkänt en PiedPiper/Torrent-liknande demokrati i DarkBlooms schema, är inferenstyper inte lika lätt delbara som att fragmentera en filmfil i flera hashade skivor, så att den senare kan återmonteras i en torrent-klient.

DarkBloom-modellen föreslår inte att en deltagares M[n]-chip hanterar x% av en inferenstyp. I vanlig användning kan endast ett fåtal ramverk eller metoder uppnå denna typ av cross-GPU-utnyttjande på en enda inferenstyp, inklusive NVIDIA:s TensorRT LLM, som använder pipeline-parallellism; och DeepSpeeds sharded inference som utnyttjar modellparallellism (MP).

I stället kommer din DarkBloom-aktiverade Mac att ladda ner och starta en av de listade modellerna och utföra 100% av inferensen för betalande användare, med slut-till-slut-kryptering, och med prompter dekrypterade endast på hårdvaru-attesterade noder, vilket innebär att leverantörerna inte kan läsa data under körning. Arbetsbelastningen i sig skulle utgöra en eller flera textbaserade inferenser, eller åtminstone en fullständig bild.

Det är inte klart hur omfattande en enskild användarsession skulle vara; som det är, är AI-hobbyister vana vid att säkra en GPU via inferensfarmar som RunPod; även om det kan ta en stund att säkra den önskade GPU:n vid toppanvändning, får användaren monopolisera den så länge sessionen inte tillåts utgå.

Så det är möjligt att en enskild betalande användare skulle kunna använda en enskild hyrd DarkBloom Mac:s M-serie AI-förmågor under en mycket lång session, såvida det inte finns någon logistisk eller regelefterlevnadsfördel i att växla klienter mellan förfrågningar.

Macs har valts ut för detta tillvägagångssätt, tydligen, eftersom det bara finns ett begränsat antal möjliga tekniska konfigurationer för en deltagare, och det är därför lätt att tilldela lämpliga modeller till en klient.

Dessutom har Macs som kan bidra till ett DarkBloom-nätverk en hårdvaru-säker enclave som garanterar en mur mellan användaren och leverantören.

Dessa är alla faktorer som inte är så lätta att rationalisera över mer generiska, anpassade installationer, och över de hundratals eller tusentals kända bärbara datorer och stationära Windows- och Linux-datorer som finns tillgängliga under de senaste 6-7 åren.

Men det måste vara uppenbart att den mycket större icke-Mac-hårdvarupoolen kunde rymma en enorm efterfrågan om deras olika egenskaper kunde rationaliseras, i stället för – som med DarkBloom – att haka på Apples begränsade specifikationer, vilket gör det till ett enkelt affärsförslag, och till ett (förmodligen) mycket enklare arkitektoniskt tillvägagångssätt.

Legal Översikt?

Kanske det största problemet som en ‘demokratisk’ lösning av detta slag står inför är den slutna naturen hos det föreslagna förfarandet; regeringar runt om i världen är för närvarande engagerade i ny lagstiftning som i princip skulle avsluta internetanonymitet varhelst den införs, och är tydligtvis inte i en pro-privat mindset under denna period.

Därför verkar utsikten till slumpmässig AI-inferens som utförs utan filter, kontroller eller balanser, över ett distribuerat nätverk (om man kan kalla DarkBloom det – det är mer av en inferensmarknad) ironiskt nog avlägsen.

Det är möjligt att DarkBloom, eller andra efterföljande mesh-inferensscheman, kommer att behöva komma överens om bakdörrar som effektivt begränsar sekretess till värden, som inte kommer att kunna se klientjobb som körs; i stället skulle den returnerade inferensdata göras tillgänglig genom statliga byråers man-i-mitten (MiTM)-strukturer, som håller all inferens granskbar.

Förmodligen, om den senaste vågen av lagar som föreslår OS-nivåidentitetskontroller någonsin uppnår allmän acceptans, kan sådana åtgärder bli överflödiga. Men utan dem, med tanke på den nuvarande klimatet, skulle ett DarkBloom-liknande nätverk sannolikt betraktas som en AI-‘mörknet’, där olagliga AI-baserade aktiviteter kunde förekomma i hemlighet.

Split Tests

Hittills har det varit förvånansvärt få riktiga försök att göra vad ett ‘PiedPiper-liknande’ system antyder; i sig själv befinner sig DarkBloom i ena änden, distribuerar fullständiga jobb till enskilda maskiner i stället för att försöka fragmentera dem över ett nätverk, medan de flesta produktionsystem helt enkelt undviker problemet genom att hålla inferensen på en enda värd.

Det finns dock ett fåtal projekt som representerar något som liknar ‘delad exekvering’.

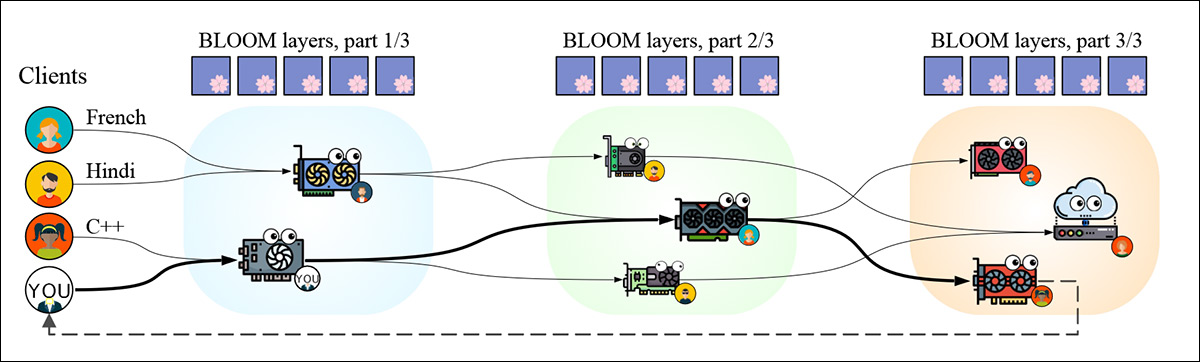

Petals, som aktivt beskriver sig själv som ett ‘BitTorrent-liknande’ nätverk, distribuerar transformator-block över flera internetanslutna noder, som skickar mellanliggande tillstånd mellan dem:

En typisk Petals-arbetsflöde, där en enda inferensbegäran dirigeras över flera fjärr-GPU:er, var och en innehållande en delmängd av modellskikt; till skillnad från DarkBloom, är exekveringen fragmenterad över nätverket, med mellanliggande tillstånd som skickas mellan oberoende opererade noder, vilket ökar latency och exponering vid varje hopp medan det approximerar ett sant mesh-liknande system. Källa

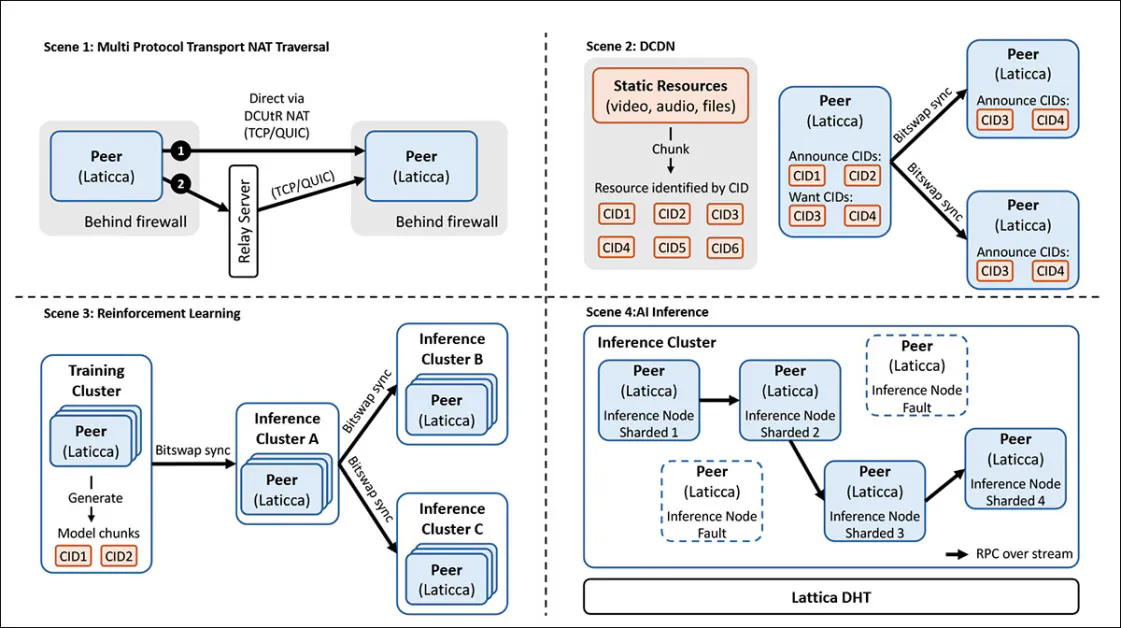

Hivemind experimenterar med liknande peer-to-peer-koordination och expertstyrning, men i syfte att träna modeller i stället för inferens från redan tränade modeller; och Lattica fokuserar på det underliggande nätverkslagret som behövs för att göra sådana system livskraftiga:

En schematisk bild av Lattica, som visar ett lägre nivå peer-to-peer-underlag som hanterar NAT-traversal, innehållsdistribution och DHT-baserad koordination (Distributed Hash Table), med sharded inferens som endast en möjlig programtillämpning; till skillnad från DarkBloom eller Petals, definierar Lattica inte ett inferenssystem i sig, utan tillhandahåller de nätverks- och synkroniseringsprimitiver som krävs för att bygga ett sådant. Källa –

Alla tre av dessa modeller närmar sig mesh-idealet, men till priset av latency, instabilitet och exponering.

I motsats till detta håller exo inferensen inom ett lokalt kluster, med hjälp av snabba interconnects för att dela arbetsbelastningar över GPU:er, utan att förlita sig på den offentliga internet:

En kluster vy från exo, som visar en liten ring av lokala Apple Silicon-maskiner som gemensamt värdar en enda modell, med pipeline eller tensor-sharding som distribuerar lager över noder; till skillnad från WAN-baserade system, förlitar sig exo på snabba lokala interconnects, vilket effektivt omvandlar flera enheter till en enda sammansatt inferensmaskin. Källa

Slutligen, flera allmänt citerade tillvägagångssätt tar inte ens inferens; det nu väldigt gamla (2016) Google FedAvg; MIT:s 2018-utgåva SplitNN; och den australiska utgåvan från 2020 SplitFed, är alla inriktade på träningsdistribution eller sekretessbevarande datautbyte, snarare än att betjäna live-inferensbegäranden.

Eftersom träningsprocessen är betydligt mer resurskrävande än inferens, kan eventuella nätverk som visar sig kunna distribuera en sådan belastning effektivt över kluster eller noder, ha en oproportionerligt stor andel av hobbyist- och företagsintresse senare.

Slutsats

Eftersom mycket av tekniken i Silicon Valley var vild uppfinning, vet vi inte om PiedPiper verkligen var hash-driven (dvs. delade och distribuerade data i chunkar, torrent-liknande), eller om det ‘löste’ en uppgift eller ens en session på någon nod vid någon tidpunkt, vilket är vad DarkBloom gör.

Men den nuvarande rusningen för att tillhandahålla tränings- och inferenshårdvara på datacenter-nivå tyder på att tillhandahållarsektorn antingen förväntar sig att betjäna alla, RunPod-liknande, eller är på väg att förbereda sig för den mest lukrativa företagsnivå-tillhandahållningen – en frestande utsikt som undergrävs av den allmänna bristen på skydd i AI-distribution.

Om mesh-inferens blir verklighet, är det rimligt att förvänta sig att bland de första försöken att utnyttja detta kommer att vara från de befintliga aktörerna, som OpenAI och Anthropic, som antingen kan distribuera dedikerade system inom en stor befintlig app-installationsbas, eller samarbeta med öppen källkod-system som är lätta att installera (eftersom företag av den här storleken och räckvidden har pengar och motiv för att strömlinjeforma svåra installationer av det här slaget).

Vad gäller om en mer demokratisk, användardriven mesh-nätverk kan uppstå, en sann AI-liknande BitTorrent – ett antal faktorer är emot det.

Först och främst, den nuvarande globala kampen mot kryptering och anonymitet kan ta bort eller undergräva många eller alla de mekanismer som gör system som BitTorrent anonyma, som slut-till-slut-kryptering och VPN:er. När de ‘generiska’ krypterade strömmarna som döljer sådana protokoll är öppna för inspektion, blir nya lager av tillsyn och förbud möjliga, och detta kan undergräva charmerna hos ett DarkBloom-liknande system.

Sedan, de nya eller föreslagna reglerna mot ‘missbruk’ av AI, eller mot anonym drift av öppen källkod-ramverk, innebär att kostnaden för regelefterlevnad – försumbar på företagsnivå – skulle troligen ta bort alla mindre spelare från marknaden.

Slutligen – den stora sektorns förmåga att Embrace, Extend and Extinguish (EEE, som Facebook och Twitter tydligen gjorde med mer ad hoc internet-samhällen), innebär att de nuvarande stora spelarna kan operationalisera och strömlinjeforma mesh-modellen till sin egen fördel, på en marknad där slutanvändare är nästan helt intoleranta mot någon friktion i antagande.

Publicerad första gången torsdag, 16 april 2026