Artificiell intelligens

NeRF: Träning av drönare i neuralt ljusmiljöer

Forskare från Stanford University har utvecklat ett nytt sätt att träna drönare att navigera i fotorealistiska och högprecisa miljöer, genom att utnyttja den senaste avalansen av intresse för Neurala Ljusfält (NeRF).

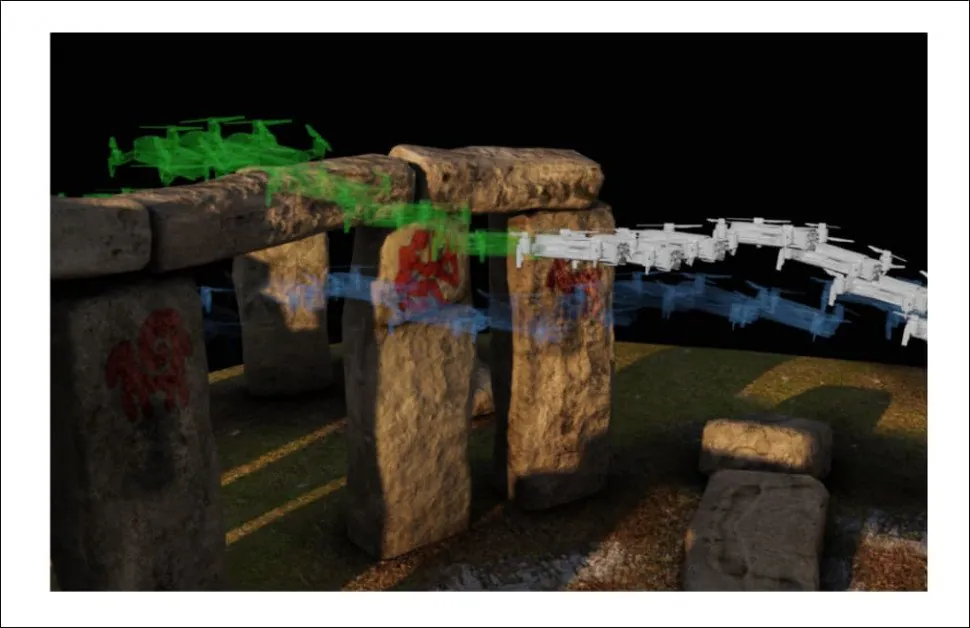

Drönare kan tränas i virtuella miljöer som kartlagts direkt från verkliga platser, utan behov av specialiserad 3D-scenrekonstruktion. I denna bild från projektet har vindstörning lagts till som ett potentiellt hinder för drönaren, och vi kan se att drönaren tillfälligt avviker från sin bana och kompenserar i sista ögonblicket för att undvika ett potentiellt hinder. Källa: https://mikh3x4.github.io/nerf-navigation/

Metoden erbjuder möjligheten för interaktiv träning av drönare (eller andra typer av föremål) i virtuella scenarier som automatiskt innehåller volyminformation (för att beräkna kollisionsundvikande), texturering som ritats direkt från verkliga foton (för att hjälpa drönarens bildigenkänningssystem att träna i en mer realistisk miljö), och verkliga ljusförhållanden (för att säkerställa att en mängd olika ljusförhållanden tränas in i nätverket, och undvika överanpassning eller överoptimisering till den ursprungliga ögonblicksbilden av scenen).

En soff-objekt navigerar en komplex virtuell miljö som skulle ha varit mycket svår att karta med hjälp av geometriinfångning och omtexturering i traditionella AR/VR-arbetsflöden, men som återskapades automatiskt i NeRF från ett begränsat antal foton. Källa: https://www.youtube.com/watch?v=5JjWpv9BaaE

Typiska NeRF-implementationer innehåller inte bana-mekanismer, eftersom de flesta NeRF-projekt under de senaste 18 månaderna har fokuserat på andra utmaningar, såsom scenrelighting, reflektionsrendering, kompositing och disentanglement av infångade element.

Därför är den nya artikeln primärt innovativ genom att implementera en NeRF-miljö som en navigerbar rymd, utan den omfattande utrustning och de mödosamma procedurerna som skulle vara nödvändiga för att modellera den som en 3D-miljö baserad på sensorinfångning och CGI-rekonstruktion.

NeRF som VR/AR

Den nya artikeln heter Vision-Only Robot Navigation in a Neural Radiance World, och är ett samarbete mellan tre avdelningar vid Stanford: Aeronautik och Astronautik, Maskinteknik och Datavetenskap.

Arbetet föreslår en navigationsram som tillhandahåller en robot med en förtränad NeRF-miljö, vars volymdensitet avgränsar möjliga banor för enheten. Den innehåller också ett filter för att uppskatta var roboten befinner sig i den virtuella miljön, baserat på bildigenkänning av robotens RGB-kamera. På detta sätt kan en drönare eller robot “hallucinera” mer exakt vad den kan förvänta sig att se i en given miljö.

Projektets banaoptimerare navigerar genom en NeRF-modell av Stonehenge som genererades genom fotogrammetri och bildtolkning (i detta fall, av mesh-modeller) till en Neural Radiance-miljö. Banoptimeraren beräknar ett antal möjliga banor innan den etablerar en optimal bana över bågen.

Eftersom en NeRF-miljö har fullständigt modellerade occlusioner, kan drönaren lära sig att beräkna hinder mer lätt, eftersom det neuronnätverk som ligger bakom NeRF kan karta relationen mellan occlusioner och hur drönarens ombord-vision-baserade navigeringssystem uppfattar miljön. Den automatiserade NeRF-genereringspipelinen erbjuder en relativt trivial metod för att skapa hyperrealistiska träningsutrymmen med endast ett fåtal foton.

Den online-omplaneringsram som utvecklats för Stanford-projektet möjliggör en resilient och helt vision-baserad navigeringspipeline.

Stanford-initiativet är bland de första att överväga möjligheterna att utforska en NeRF-rymd i sammanhanget av en navigerbar och immersiv VR-liknande miljö. Neurala Ljusfält är en ny teknik, och för närvarande föremål för flera akademiska ansträngningar för att optimera deras höga krav på beräkningsresurser, samt att disentangla de infångade elementen.

Nerf är inte (verkligen) CGI

Eftersom en NeRF-miljö är en navigerbar 3D-scen, har det blivit en missförstådd teknik sedan dess uppkomst 2020, ofta allmänt uppfattad som en metod för att automatisera skapandet av mesh och texturer, snarare än att ersätta 3D-miljöer som är bekanta för tittare från Hollywood VFX-avdelningar och de fantastiska scenerna i Augmented Reality och Virtual Reality-miljöer.

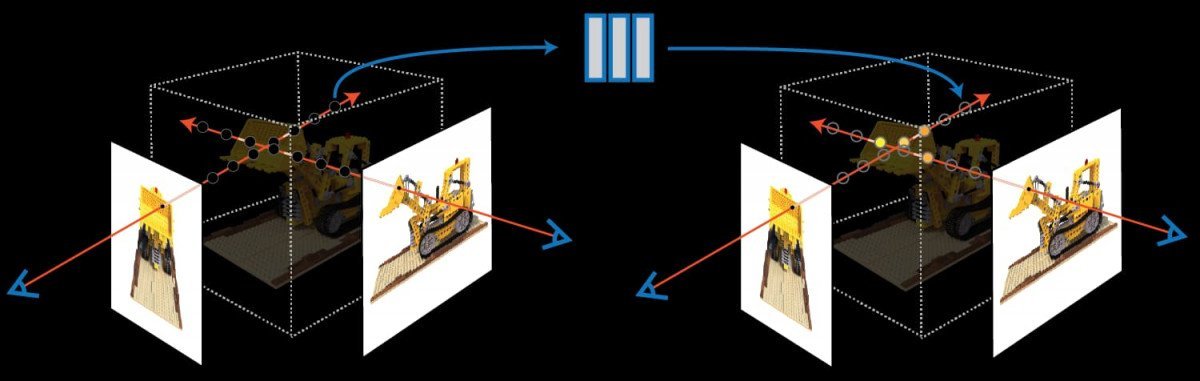

NeRF extraherar geometri- och texturinformation från ett mycket begränsat antal bildvypunkter, och beräknar skillnaden mellan bilderna som volyminformation. Källa: https://www.matthewtancik.com/nerf

I själva verket är NeRF-miljön mer som en “live”-render-rymd, där en sammanslagning av pixel- och ljusinformation behålls och navigeras i ett aktivt och körande neuronnätverk.

Nyckeln till NeRF:s potential är att det endast kräver ett begränsat antal bilder för att återskapa miljöer, och att de genererade miljöerna innehåller all nödvändig information för en högkvalitativ rekonstruktion, utan behov av tjänster från modellörer, texture artists, ljusspecialister och de många andra bidragsgivarna till “traditionell” CGI.

Semantisk segmentering

Även om NeRF effektivt utgör “datorgenererad bild” (CGI), erbjuder det en helt annan metodologi, och en högt automatiserad pipeline. Dessutom kan NeRF isolera och “inkapsla” rörliga delar av en scen, så att de kan läggas till, tas bort, accelereras och generellt fungera som separata aspekter i en virtuell miljö – en förmåga som är långt bortom den nuvarande tillståndskonsten i en “Hollywood”-tolkning av vad CGI är.

En samarbete från Shanghai Tech University, släppt sommaren 2021, erbjuder en metod för att individuera rörliga NeRF-element till “klistrbara” aspekter för en scen. Källa: https://www.youtube.com/watch?v=Wp4HfOwFGP4

Negativt är NeRF:s arkitektur en sorts “svart låda”; det är för närvarande inte möjligt att extrahera ett objekt från en NeRF-miljö och direkt manipulera det med traditionella mesh-baserade och bild-baserade verktyg, även om flera forskningsinsatser börjar göra genombrott i att dekonstruera matrisen bakom NeRF:s neuronnätverks live-render-miljöer.