Artificiell intelligens

Mistral AI: Sätter nya benchmark för Llama2 i open-source-utrymmet

Stora språkmodeller (LLM) har nyligen tagit center scenen, tack vare utmärkande prestationer som ChatGPT. När Meta introducerade sina Llama-modeller, väckte det ett förnyat intresse för open-source LLM. Målet? Att skapa prisvärda, open-source LLM som är lika bra som toppmodeller som GPT-4, men utan den höga prislappen eller komplexiteten.

Denna mix av prisvärdhet och effektivitet inte bara öppnade nya vägar för forskare och utvecklare, utan satte också scenen för en ny era av tekniska framsteg inom naturligt språkbehandling.

Nyligen har generativa AI-startups varit på en rulle med finansiering. Tillsammans höjde 20 miljoner dollar, i syfte att forma open-source AI. Anthropic höjde också en imponerande 450 miljoner dollar, och Cohere, i samarbete med Google Cloud, säkrade 270 miljoner dollar i juni i år.

Introduktion till Mistral 7B: Storlek & Tillgänglighet

Mistral AI, baserat i Paris och medgrundat av alumner från Google’s DeepMind och Meta, tillkännagav sin första stora språkmodell: Mistral 7B. Denna modell kan enkelt laddas ner av vem som helst från GitHub och även via en 13,4-gigabyte torrent.

Denna startup lyckades säkra rekordbrytande startfinansiering även innan de hade ett produkt ut. Mistral AI:s första modell med 7 miljarder parametrar överträffar prestationen hos Llama 2 13B i alla tester och slår Llama 1 34B i många mått.

Jämfört med andra modeller som Llama 2, erbjuder Mistral 7B liknande eller bättre funktioner men med mindre beräkningsöverhuvud. Medan grundläggande modeller som GPT-4 kan uppnå mer, kommer de till en högre kostnad och är inte så användarvänliga eftersom de främst är tillgängliga genom API:er.

När det gäller koduppgifter ger Mistral 7B CodeLlama 7B en match. Plus, den är tillräckligt kompakt vid 13,4 GB för att kunna köras på standardmaskiner.

Dessutom har Mistral 7B Instruct, som är anpassad specifikt för instruktionsdata på Hugging Face, visat stor prestanda. Den överträffar andra 7B-modeller på MT-Bench och står axel axel med 13B-chattmodeller.

Hugging Face Mistral 7B Exempel

Prestandamätning

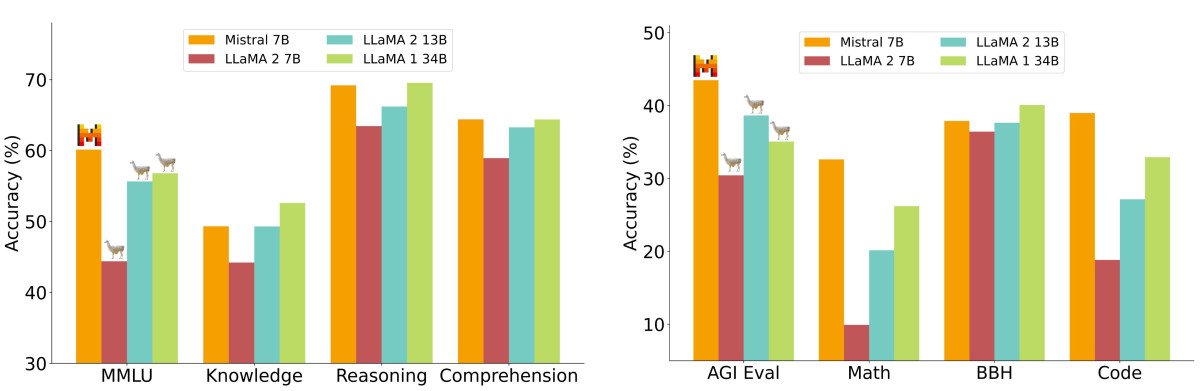

I en detaljerad prestandaanalys mättes Mistral 7B mot Llama 2-familjens modeller. Resultaten var tydliga: Mistral 7B överträffade avsevärt Llama 2 13B i alla benchmark. I själva verket matchade den prestandan hos Llama 34B, särskilt i kod- och resonemangstester.

Benchmarkerna organiserades i flera kategorier, såsom Commonsense Reasoning, World Knowledge, Reading Comprehension, Math och Code, bland andra. En särskilt anmärkningsvärd observation var Mistral 7B:s kostnad-prestanda-mått, som kallas “ekvivalenta modellstorlekar”. I områden som resonemang och förståelse visade Mistral 7B en prestanda liknande en Llama 2-modell som var tre gånger så stor, vilket indikerar potentiella besparingar i minne och en ökning av genomströmning. Men i kunskapsbenchmark överensstämde Mistral 7B nära med Llama 2 13B, vilket troligen beror på dess parameterbegränsningar som påverkar kunskapskomprimering.

Vad gör egentligen Mistral 7B-modellen bättre än de flesta andra språkmodeller?

Förenkling av uppmärksamhetsmekanismer

Medan subtiliteterna i uppmärksamhetsmekanismer är tekniska, är deras grundläggande idé relativt enkel. Tänk dig att läsa en bok och markera viktiga meningar; detta är analogt med hur uppmärksamhetsmekanismer “markerar” eller ger vikt till specifika datapunkter i en sekvens.

I sammanhanget med språkmodeller möjliggör dessa mekanismer för modellen att fokusera på de mest relevanta delarna av indata, vilket säkerställer att utdata är sammanhängande och kontextuellt korrekt.

I standardtransformatorer beräknas uppmärksamhetsskör med formeln:

Formeln för dessa skör innehåller ett kritiskt steg – matrismultiplikationen av Q och K. Utmaningen här är att när sekvenslängden växer, expanderar båda matriserna enligt, vilket leder till en beräkningsintensiv process. Denna skalbarhetsfråga är en av de stora anledningarna till varför standardtransformatorer kan vara långsamma, särskilt när de hanterar långa sekvenser.

Multi-frågeuppmärksamhet (MQA) accelererar saker genom att använda en uppsättning “nyckel-värde”-huvuden men offrar ibland kvalitet. Nu undrar du kanske, varför inte kombinera MQA:s hastighet med multi-huvuduppmärksamhetens kvalitet? Det är där Grupperad-frågeuppmärksamhet (GQA) kommer in.

Grupperad-frågeuppmärksamhet (GQA)

GQA är en mittpunktslösning. Istället för att använda bara ett eller flera “nyckel-värde”-huvuden, grupperar den dem. På detta sätt uppnår GQA en prestanda nära den detaljerade multi-huvuduppmärksamheten men med MQA:s hastighet. För modeller som Mistral betyder detta effektiv prestanda utan att kompromissa för mycket på kvalitet.

Glidande fönsteruppmärksamhet (SWA)

Glidande fönstret är en annan metod som används för att bearbeta uppmärksamhetssekvenser. Denna metod använder ett fastställt uppmärksamhetsfönster runt varje token i sekvensen. Med flera lager som staplar detta fönsteruppmärksamhet, får de översta lagren så småningom en bredare vy, som omfattar information från hela indata. Denna mekanism är analog med de receptiva fält som ses i Convolutional Neural Networks (CNN).

Å andra sidan beräknar “dilaterad glidande fönsteruppmärksamhet” i Longformer-modellen, som konceptuellt liknar glidande fönstermetoden, bara några diagonaler av matrisen. Denna ändring resulterar i att minnesanvändningen ökar linjärt snarare än kvadratiskt, vilket gör det till en mer effektiv metod för längre sekvenser.

Mistral AI:s transparens vs. säkerhetsproblem i decentralisering

I sitt tillkännagivande betonade Mistral AI också transparens med uttalandet: “Inga trick, inga proprietära data.” Men samtidigt är deras enda tillgängliga modell för tillfället ‘Mistral-7B-v0.1’ en förtränad basmodell, vilket innebär att den kan generera en respons till vilken fråga som helst utan moderering, vilket väcker potentiella säkerhetsproblem. Medan modeller som GPT och Llama har mekanismer för att avgöra när de ska svara, kan Mistral’s fullständigt decentraliserade natur utnyttjas av illvilliga aktörer.

Men decentraliseringen av stora språkmodeller har sina förtjänster. Medan vissa kan missbruka den, kan människor utnyttja dess kraft för samhällets bästa och göra intelligens tillgänglig för alla.

Driftflexibilitet

En av höjdpunkterna är att Mistral 7B är tillgänglig under Apache 2.0-licensen. Detta innebär att det inte finns några riktiga hinder för att använda den – oavsett om du använder den för personliga ändamål, ett stort företag eller till och med en statlig enhet. Du behöver bara rätt system för att köra den, eller så måste du investera i molnresurser.

Medan det finns andra licenser, såsom den enklare MIT-licensen och den samarbetsinriktade CC BY-SA-4.0, som kräver kreditering och liknande licensiering för derivat, ger Apache 2.0 en robust grund för storskaliga företag.

Slutliga tankar

Uppkomsten av open-source stora språkmodeller som Mistral 7B signalerar en avgörande förändring i AI-branschen, som gör högkvalitativa språkmodeller tillgängliga för en bredare publik. Mistral AI:s innovativa tillvägagångssätt, som Grupperad-frågeuppmärksamhet och Glidande fönsteruppmärksamhet, lovar effektiv prestanda utan att kompromissa för mycket på kvalitet.

Medan den decentraliserade naturen hos Mistral utgör vissa utmaningar, understryker dess flexibilitet och open-source-licensiering potentialen för att demokratisera AI. När landskapet utvecklas, kommer fokus utan tvekan att ligga på att balansera kraften i dessa modeller med etiska överväganden och säkerhetsmekanismer.

Vad kommer härnäst för Mistral? 7B-modellen var bara början. Teamet siktar på att lansera ännu större modeller snart. Om dessa nya modeller matchar 7B:s prestanda, kan Mistral snabbt stiga som en toppspelare i branschen, allt inom sitt första år.