Artificiell intelligens

Mindre är mer: Varför återvinning av färre dokument kan förbättra AI-svar

Retrieval-Augmented Generation (RAG) är en metod för att bygga AI-system som kombinerar ett språkmodell med en extern kunskapskälla. I enkla termer söker AI:n först efter relevanta dokument (såsom artiklar eller webbsidor) som är relaterade till en användares fråga, och använder sedan dessa dokument för att generera ett mer exakt svar. Denna metod har hyllats för att hjälpa stora språkmodeller (LLM) att stanna faktamässiga och minska hallucinationer genom att grundera sina svar i verkliga data.

Intuitivt kan man tro att ju fler dokument AI:n hämtar, desto bättre informerat kommer svaret att vara. Men nylig forskning tyder på en överraskande vändning: när det gäller att mata information till en AI, är det ibland mindre som är mer.

Färre dokument, bättre svar

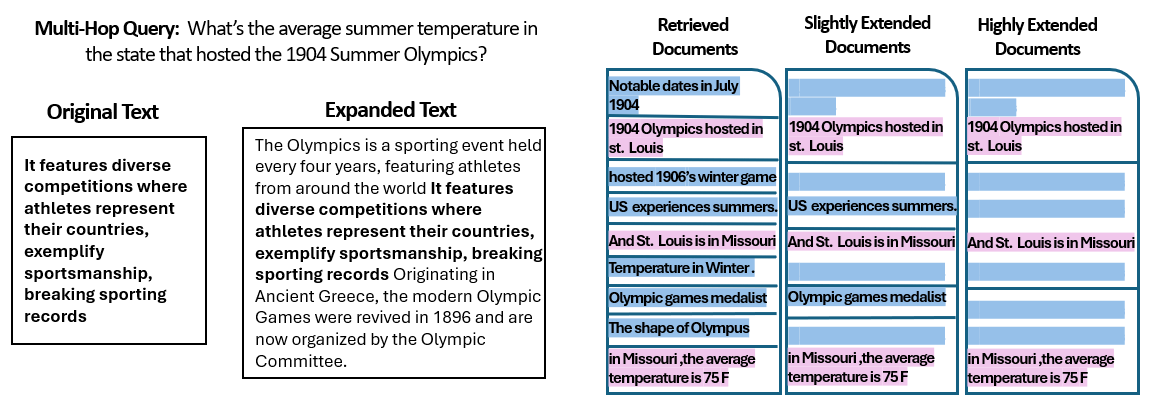

En ny studie av forskare vid Hebrew University of Jerusalem undersökte hur antalet dokument som ges till ett RAG-system påverkar dess prestanda. Viktigt var att de höll den totala textmängden konstant – vilket innebär att om färre dokument tillhandahölls, utvidgades dessa dokument något för att fylla samma längd som många dokument skulle. På detta sätt kunde eventuella prestandaskillnader tillskrivas dokumentmängden snarare än enbart en kortare inmatning.

Forskarna använde en frågesvarsdataset (MuSiQue) med triviafrågor, var och en ursprungligen parad med 20 Wikipedia-paragrafer (endast ett fåtal av dessa innehöll faktiskt svaret, medan resten var distraktorer). Genom att skära ner antalet dokument från 20 till bara de 2–4 verkligt relevanta – och fylla i dessa med en del extra kontext för att upprätthålla en konstant längd – skapade de scenarier där AI:n hade färre material att överväga, men fortfarande ungefär samma totala ord att läsa.

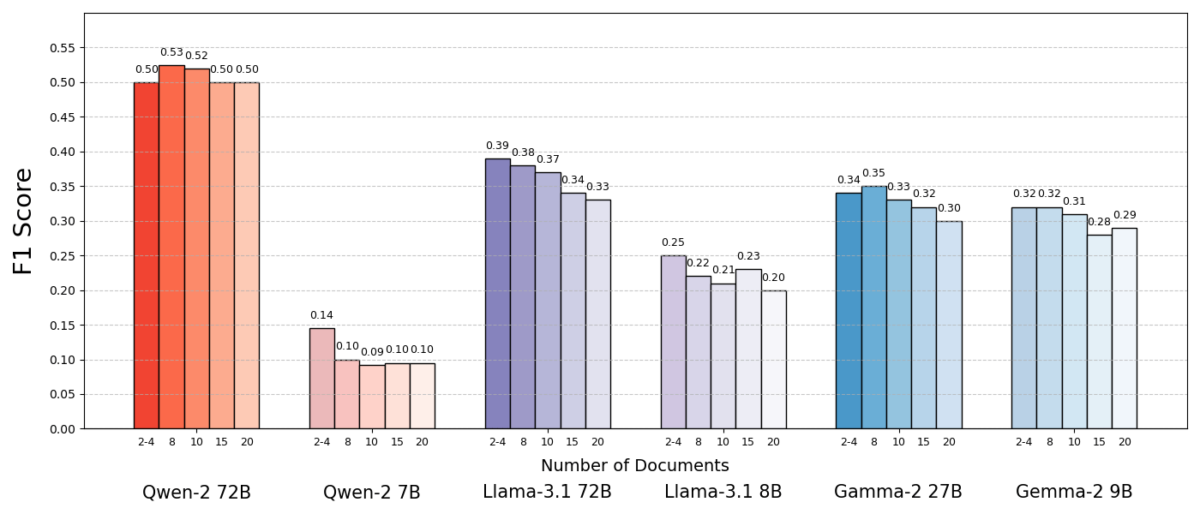

Resultaten var slående. I de flesta fall svarade AI-modellerna mer exakt när de gavs färre dokument snarare än den fullständiga uppsättningen. Prestandan förbättrades avsevärt – i vissa fall med upp till 10% i exakthet (F1-poäng) när systemet använde endast de få stöddokumenten istället för en stor samling. Denna motintuitiva boost observerades över flera olika öppen källkods-språkmodeller, inklusive varianter av Metas Llama och andra, vilket indikerar att fenomenet inte är knutet till en enda AI-modell.

En modell (Qwen-2) var ett anmärkningsvärt undantag som hanterade flera dokument utan en nedgång i poäng, men nästan alla testade modeller presterade bättre med färre dokument överlag. Med andra ord, tillägg av mer referensmaterial utöver de nyckelrelevanta bitarna skadade deras prestanda mer ofta än det hjälpte.

Källa: Levy et al.

Varför är detta en sådan överraskning? Typiskt är RAG-system utformade under antagandet att hämtning av en bredare mängd information bara kan hjälpa AI:n – efter allt, om svaret inte finns i de första få dokumenten, kan det finnas i det tionde eller tjugonde.

Denna studie vänder på detta manus, och visar att odiscriminerad tillägg av extra dokument kan backfire. Även när den totala textlängden hölls konstant, gjorde den blotta närvaron av många olika dokument (var och en med sin egen kontext och egenheter) frågesvarsuppgiften mer utmanande för AI:n. Det verkar som att bortom en viss punkt introducerade varje ytterligare dokument mer brus än signal, vilket förvirrade modellen och försämrade dess förmåga att extrahera det korrekta svaret.

Varför mindre kan vara mer i RAG

Detta “mindre är mer”-resultat är logiskt när vi överväger hur AI-språkmodeller bearbetar information. När en AI ges endast de mest relevanta dokumenten, är kontexten den ser fokuserad och fri från distraktioner, likt en student som har fått just de rätta sidorna att studera.

I studien presterade modellerna avsevärt bättre när de gavs endast de stöddokumenten, med irrelevant material borttaget. Den återstående kontexten var inte bara kortare utan också renare – den innehöll fakta som direkt pekade på svaret och ingenting annat. Med färre dokument att hantera kunde modellen ägna sin fulla uppmärksamhet åt den relevanta informationen, vilket gjorde det mindre troligt att den skulle bli vilseledd eller förvirrad.

Å andra sidan, när många dokument hämtades, var AI:n tvungen att sila genom en blandning av relevant och irrelevant innehåll. Ofta var dessa extra dokument “liknande men orelaterade” – de kunde dela ett ämne eller nyckelord med frågan men inte faktiskt innehålla svaret. Sådant innehåll kan vilseleda modellen. AI:n kunde slösa bort ansträngning med att försöka koppla punkter över dokument som inte faktiskt ledde till ett korrekt svar, eller värre, den kunde sammanfoga information från flera källor på ett felaktigt sätt. Detta ökar risken för hallucinationer – tillfällen då AI:n genererar ett svar som låter plausibelt men inte är grundat i någon enskild källa.

I själva verket, när extra dokument var uppenbart irrelevanta (t.ex. slumpmässig, orelaterad text), var modellerna bättre på att ignorera dem. Det verkliga problemet uppstod från distraherande data som såg relevanta ut: när alla hämtade texter var på liknande ämnen, antog AI:n att den skulle använda alla, och den kunde ha svårt att avgöra vilka detaljer som faktiskt var viktiga. Detta stämmer överens med studiens observation att slumpmässiga distraktorer orsakade mindre förvirring än realistiska distraktorer i inmatningen. AI:n kan filtrera bort uppenbar nonsens, men subtilt avvikande information är en listig fälla – den smyger in under sken av relevans och spårar ur svaret. Genom att minska antalet dokument till endast de verkligt nödvändiga, undviker vi att sätta upp dessa fällor från början.

Det finns också en praktisk fördel: att hämta och bearbeta färre dokument sänker den beräkningstekniska överbelastningen för ett RAG-system. Varje dokument som hämtas måste analyseras (inbäddat, läst och uppmärksammat av modellen), vilket använder tid och beräkningsresurser. Att eliminera överflödiga dokument gör systemet mer effektivt – det kan hitta svar snabbare och till en lägre kostnad. I scenarier där exaktheten förbättrades genom att fokusera på färre källor, får vi en dubbel vinst: bättre svar och en smalare, mer effektiv process.

Källa: Levy et al.

Omprövning av RAG: Framtida riktningar

Denna nya bevisning att kvalitet ofta slår kvantitet i återvinning har viktiga implikationer för framtiden för AI-system som förlitar sig på extern kunskap. Det antyder att designers av RAG-system bör prioritera smart filtrering och rangordning av dokument över ren volym. Istället för att hämta 100 möjliga passager och hoppas att svaret är begravt någonstans där, kan det vara klokare att hämta endast de översta få högt relevanta.

Studiens författare betonar behovet av att återvinningsmetoder ska “hitta en balans mellan relevans och mångfald” i den information de tillhandahåller till en modell. Med andra ord, vi vill tillhandahålla tillräcklig täckning av ämnet för att besvara frågan, men inte så mycket att de centrala faktorna drunknar i en hav av ovidkommande text.

I framtiden kommer forskare sannolikt att utforska tekniker som hjälper AI-modeller att hantera flera dokument på ett mer elegant sätt. En strategi är att utveckla bättre hämtningssystem eller om-rankare som kan identifiera vilka dokument som verkligen tillför värde och vilka som endast introducerar konflikt. En annan vinkel är att förbättra själva språkmodellerna: om en modell (som Qwen-2) kunde hantera många dokument utan att förlora exakthet, kunde en undersökning av hur den tränades eller strukturerades erbjuda ledtrådar för att göra andra modeller mer robusta. Kanske kommer framtida stora språkmodeller att inkorporera mekanismer för att känna igen när två källor säger samma sak (eller motsäger varandra) och fokusera därefter. Målet skulle vara att möjliggöra för modellerna att utnyttja en rik variation av källor utan att falla offer för förvirring – i grund och botten, att få det bästa av båda världar (bredd av information och tydlighet i fokus).

Det är också värt att notera att när AI-system får större kontextfönster (förmågan att läsa mer text på en gång), är det inte en silverkula att enkelt dumpa mer data i prompten. Större kontext betyder inte automatiskt bättre förståelse. Denna studie visar att även om en AI tekniskt sett kan läsa 50 sidor åt gången, kan det att ge den 50 sidor av blandad kvalitet på information inte leda till ett bra resultat. Modellen drar fortfarande nytta av att ha kuraterat, relevant innehåll att arbeta med, snarare än en odiscriminerad dumpning. I själva verket kan intelligent återvinning bli ännu viktigare i eran av jättekontextfönster – för att säkerställa att den extra kapaciteten används för värdefull kunskap snarare än brus.

Resultaten från “Flera dokument, samma längd” (den lämpligt titulerade artikeln) uppmuntrar till en omprövning av våra antaganden inom AI-forskning. Ibland är det inte så effektivt att mata en AI med all data vi har. Genom att fokusera på de mest relevanta bitarna av information, förbättrar vi inte bara exaktheten hos AI-genererade svar, utan gör också systemen mer effektiva och lättare att lita på. Det är en motintuitiv läxa, men en med spännande konsekvenser: framtida RAG-system kan vara både smartare och smalare genom att noggrant välja färre, bättre dokument att hämta.