Andersons vinkel

Oartiga frågor kan öka företagskostnader för ChatGPT

ChatGPTs svar förbrukar fler token när du är oartig mot den, vilket ökar din företagsräkning; men att säga “var så god” kan minska dina kostnader.

Det sägs att artighet kostar ingenting; men vad kostar oartighet? När det gäller att betala för ChatGPT, ganska mycket, enligt en ny studie från USA. Den nya rapporten, från University of Iowa, visar att att vara oartig mot ChatGPT ökar kostnaden för svaren – även om svaren är desamma för artiga och oartiga frågor.

Författarna skriver:

‘[Priset på] utdatatoken är 12 dollar per 1 miljon utdatatoken för GPT4. Vi finner att oartiga prompter leder till mer än 14 extra token, vilket motsvarar 0,000168 extra kostnad per prompt i genomsnitt. Den genomsnittliga dagliga frågorna till OpenAIs API överstiger 2,2 miljarder.

‘Jämfört med ett scenario där all prompting är artig, när istället prompterna är oartiga, genererar detta en extra intäkt på 369 000 dollar per dag, enbart på grund av den ökade mängden token som oartiga prompter genererar i resultatet.’

Även om resultatet i sig är intressant, betonar författarna att detta ovanliga beteende kan indikera en mängd ännu okända egenskaper i konfigurationen mellan människa och AI, varav några eller alla kan ha ekonomiska implikationer. När det gäller varför oartighet kostar kunderna extra token, spekulerar författarna inte.

För att fastställa sanningen i detta tillstånd, omskrev de riktiga ChatGPT-prompter, med varierande artighetsvärden, medan de behöll meningen. Båda versionerna matades sedan in i GPT-4-Turbo, och skillnaderna mättes i antalet utdatatoken som användes för svaren.

Slutsatserna som dras är en skarp kontrast till rubriksaktiviteter tidigare i år, där Sam Altman klagade över att artighet kostade OpenAI potentiellt ‘tiotals miljoner’ dollar i form av bearbetning av artighetsrelaterade token (såsom ‘var så god’). Forskning publicerad under samma period indikerade också att artighet inte var av något värde när det gällde att få bättre svar (även om den inte kommenterade billigare svar).

Om den nya rapportens slutsatser är korrekta, skulle alla företagsanvändare av ChatGPT som följde den linjen ha spenderat mer på ChatGPT-inferens under 2025 än användare som erbjuder minimal artighet i ChatGPT-utbyten.

Författarna föreslår att en möjlig lösning skulle vara att ange en token-gräns för svaren, även om detta inte är en metod som LLM-system kan implementera lätt. De observerar att prompting är ett svagt verktyg för kostnadskontroll, eftersom LLM inte kan följa explicita instruktioner om längd. I de flesta fall skulle denna “begränsande” direktiv inte följas; dessutom kunde svaret trunkeras, eftersom LLM av denna typ i princip gissar den troliga nästa ordet i en mening/paragraf, och som sådan inte vet hur berättelsen slutar – eller var berättelsen slutar – förrän bearbetningen är klar. De har därför begränsad förmåga att “avsluta” några pågående mekanismer på begäran.

Saknar en exakt lösning – men föreslår att mer transparenta prissättningsmetoder bör genomföras i fall av detta slag – drar författarna slutsatsen:

‘Konventionell visdom säger att prompt-artighet är onödig när man interagerar med LLM.’

‘I kontrast, vår arbete visar att oartiga prompter ökar utdatatoken, vilket genererar extra kostnader för företagsanvändare av AI.’

Den nya rapporten har titeln Kostnadstransparens för företagsanvändning av AI, och kommer från tre forskare vid University of Iowa.

Metod

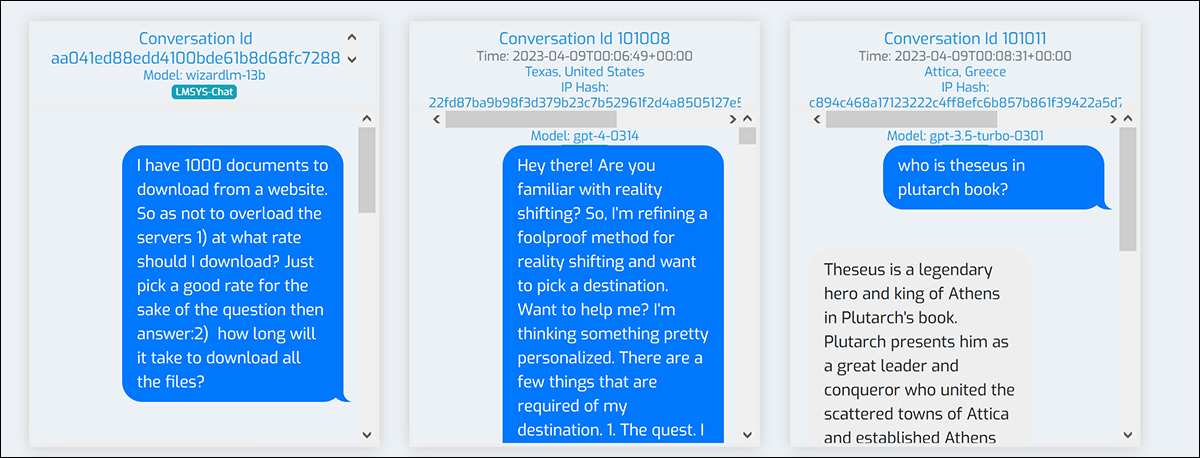

Data för systemet samlades in från WildChat-dataseten, som består av en samling av 1 miljon användar-ChatGPT-samtal, och som innehåller mer än 2,5 miljoner interaktioner:

Från en stödwebbplats för WildChat-projektet, sökbara exempel på ChatGPT-interaktioner. Källa

Författarna noterar att WildChat innehåller en större mängd naturliga interaktioner än i vissa mer kuraterade samlingar.

De valde 20 000 engelska prompter från samlingens GPT-4-utbyten, och kasserade utdatat i varje fall (eftersom avsikten var att mata in prompterna igen för nya svar). Endast den första interaktionen valdes, även från längre utbyten,

Den resulterande uppsättningen filtrerades till artig eller oartig kategorier, med alla prompter klassificerade av GPT-4-Turbo. Forskarna använde modellen själv för att bestämma om en prompt var artig eller inte, eftersom modellens egen uppfattning om artighet var central för experimentet.

Prompter som klassificerades som artiga kunde innehålla tydliga signaler som ordet ‘var så god’, eller kunde vara artiga på ett mer indirekt sätt. Allt som inte erkändes som artigt klassificerades som oartigt, även om formuleringen var neutral snarare än antagonistisk.

För att studera hur modellen svarade på artighet, kunde standardmetoder (dvs. som behandlar text som en uppsättning mätbara funktioner) inte användas: eftersom artighet var inbäddad i formuleringen själv, skulle en sammanfattning av en prompt som en lista med egenskaper ha förlorat viktig kontext.

Istället omskrevs varje prompt för att vända dess ton, med alla andra element hållna så lika som möjligt, vilket möjliggjorde en jämförelse mellan par som skilde sig endast i artighet:

Exempel på hur artiga och oartiga prompter omvandlades till sina kontrafaktiska versioner, medan de behöll semantisk mening. Källa

Tester

Varje ursprunglig prompt parades med en omskriven version som skilde sig endast i sin artighetsnivå, och båda versionerna skickades till samma GPT-4-Turbo-modell via separata API-anrop. Antalet token som producerades i svaret på varje version registrerades, och skillnaden mellan dem behandlades som måttet på hur tonen påverkade (token-)kostnaden.

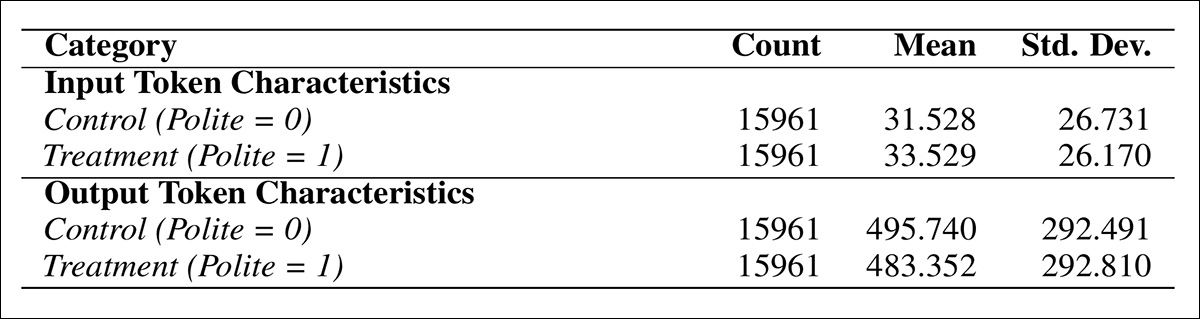

Temperatur hölls konstant för att förhindra slumpmässig variation, och prompt-par behölls endast när omskrivningen ändrade inmatningen med högst fem token. Detta säkerställde att effekten som studerades uppstod från ton, snarare än några bredare förändringar i formulering:

Sammanfattningsstatistik som visar att artiga prompter resulterade i färre utdatatoken i genomsnitt, än oartiga prompter, trots att de hade något fler inmatningstoken.

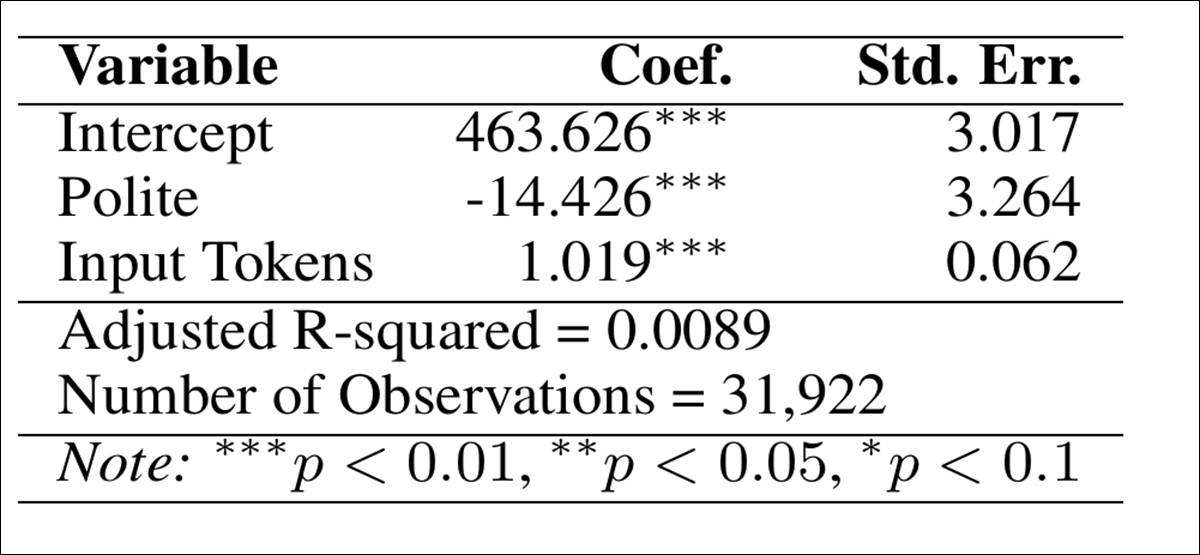

Huvudresultaten för den första omgången tester indikerade att användningen av en artig prompt minskar utdatatokens längd med 14,426 token:

Uppskattning av resultaten som beskriver effekten av artig prompt-formatering på den genererade utdatalängden (token).

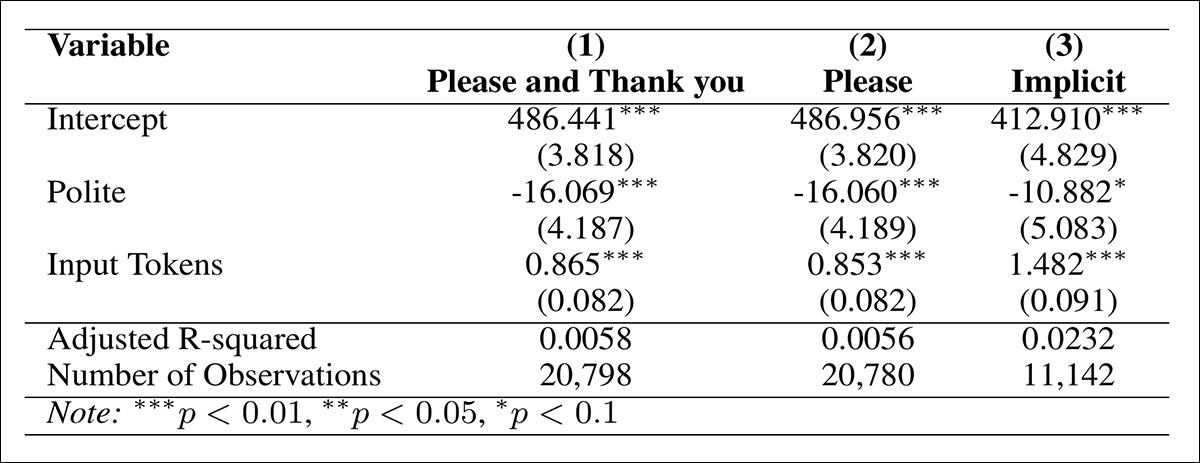

Analysen upprepades över tre undergrupper av artiga prompter för att testa robusthet: prompter som använde explicita markörer som ‘var så god’ eller ‘tack’; de som använde endast ‘var så god’; och de med implicit artighet, som ‘kan du’ eller ‘kunde du’:

Uppskattning av resultaten baserade på typer av artighet.

För att validera robustheten i de huvudsakliga resultaten, utfördes en sekundär klassificering av prompt-artighet med hjälp av LIWC-ramverket, som tillhandahåller en deterministisk och upprepningsbar poäng för språkliga funktioner.

Till skillnad från GPT:s probabilistiska klassificering kan LIWC tilldela en stabil artighetspoäng till varje prompt, vilket möjliggör en bedömning av konsekvens över olika metoder. I denna del av testerna klassificerades prompter som artiga om deras LIWC-artighetspoäng var större än noll, och som oartiga annars.

När överensstämmelsen mellan LIWC- och GPT-klassificeringar mättes, observerades en överensstämmelse på 81 %. Medan detta inte är ett mått på noggrannhet, gav denna överensstämmelse stöd för konsekvens mellan system.

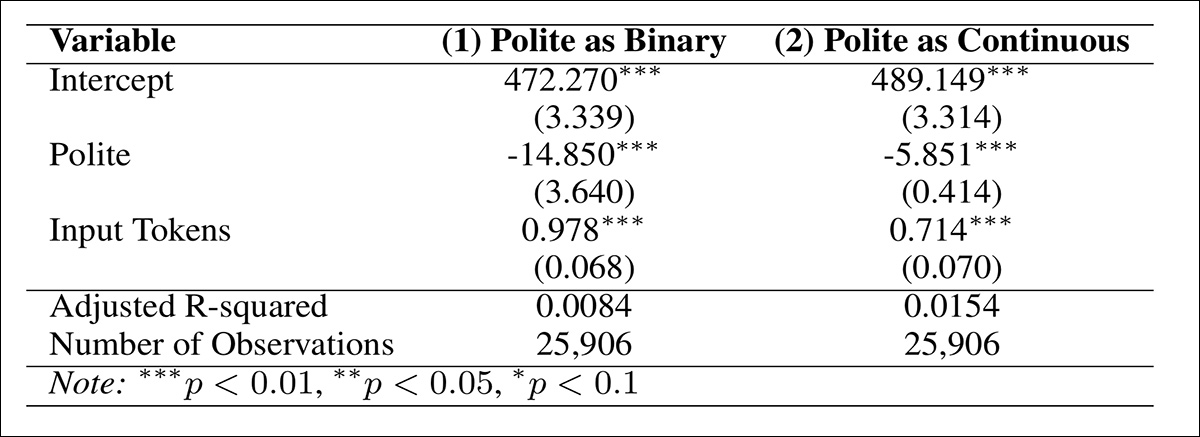

När endast prompter med matchande GPT- och LIWC-artighetsetiketter analyserades, ledde artiga prompter fortfarande till 14 färre utdatatoken; och när artighet mättes på en glidande skala, minskade varje steg upp i artighet utdatat med fem token i genomsnitt:

Tokenbesparingar från artighet kvarstod när de klassificerades om med LIWC, både som en binär etikett och en kontinuerlig poäng.

Resiliens

För att bedöma om effekten av artighet varierade över olika typer av prompter, tilldelades varje prompt till en av flera fördefinierade uppgiftskategorier: informationsökning; textgenerering; redigering och omskrivning; klassificering; sammanfattning; och tekniska uppgifter.

Varje prompt tilldelades en uppgiftsetikett genom att jämföra dess inbäddning med de fördefinierade uppgiftsbeskrivningarnas, med hjälp av all-MiniLM-L6-v2 Sentence Transformers-modellen.

Kosinlikhetspoäng beräknades mellan varje prompt och uppsättningen av uppgiftsdefinitioner, och etiketten med den högsta likheten tilldelades.

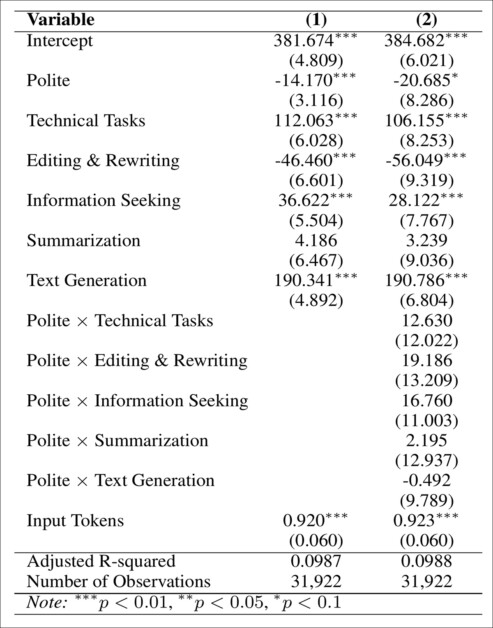

Uppgiftstyperna användes sedan som kontrollvariabler i regressionen, för att testa om effekten av artighet varierade med promptkategorin, och interaktionstermer mellan uppgift och behandling introducerades också, för att kontrollera om det fanns skillnader i effekter.

I båda fallen producerade artiga prompter konsekvent kortare utdata, och ingen meningsfull variation över uppgiftstyper hittades:

Regressionsresultat som visar att artiga prompter minskade utdatalängden över alla uppgiftstyper, utan några signifikanta interaktionseffekter.

För att testa om kortare svar från artiga prompter reflekterade minskad kvalitet, jämfördes utdata från ursprungliga och kontrafaktiska prompter för semantisk likhet. Med hjälp av all-MiniLM-L6-v2-modellen inbäddades varje svar i ett semantiskt vektorrum, och kosinlikhet beräknades mellan varje par, vilket resulterade i en genomsnittlig likhet på 0,78, vilket indikerar en stark överensstämmelse i mening, och tyder på att innehållet förblev konsekvent även när tonen ändrades.

Stop-ord

För att förstå vilken typ av innehåll som minskas i kortare utdata, undersöktes de vanligast borttagna orden. Dessa visade sig vara vanliga stop-ord som ‘ha’, ‘mer’, ‘där’ och ‘in i’, dvs. termer som tjänar grammatiska snarare än semantiska roller.

För att bekräfta att token-reduktionen inte drevs av förlust av meningsfullt innehåll, togs stop-ord bort, och fraser på upp till fyra ord analyserades för systematisk försvinnande; dock hittades inga konsekventa eller semantiskt viktiga mönster, vilket tyder på att reduktioner från artig formulering inte berövade meningsfullt eller användbart innehåll.

Således verkar det fortfarande som att fler token spenderas på svar på oartiga frågor än artiga – som en sorts “skatt” på oförskämdhet.

Människo-studie

För att testa om utdatas kvalitet påverkades av prompt-ton, genomfördes också en människo-utvärdering, med ett slumpmässigt urval av tjugo artiga och tjugo oartiga prompt-par.

Efter att ha uteslutit prompter på känsliga eller tekniska ämnen, bedömdes svaren av 401 deltagare på en sju-punkts skala. Varje deltagare såg endast ett svar, valt från en av fyra villkor: artig eller oartig, och antingen ursprunglig eller kontrafaktisk.

Inga signifikanta skillnader hittades i upplevd kvalitet över något av dessa villkor. Artiga och oartiga utdata fick nästan identiska poäng, liksom ursprungliga och kontrafaktiska versioner.

Författarna hävdar att dessa resultat indikerar att minskningen av utdatatoken inte orsakades av någon förlust av kvalitet, utan snarare av omskrivning, eller genom strukturförändringar som ändå bevarade meningen.

Kostnadsdifferensen som observerades i företagspromptning är därför osannolikt att reflektera förändringar i användbarhet eller tydlighet, och “skatten” är fortfarande operativ.

Slutsats

Även om det nya arbetet koncentrerar sig på företagsanvändning av ChatGPT, påverkas också lägre nivåanvändare av detta tillstånd, eftersom även de två ingångsnivåerna har användningsbegränsningar; och – förmodligen – att behandla ChatGPT oförskämt kommer att påskynda den genomsnittliga användarens uttöming av dagens tilldelning av token.

Den nya studien koncentrerar sig på en rubrik-genererande och mycket studerad öppen fråga i interaktioner mellan människa och AI; men författarna betonar att frågor om artighet bör tas som indikatorer på en möjlig djup källa av språkliga egenskaper, som ännu inte upptäckts, och som kan visa sig ha ekonomiska implikationer.

Publicerad första gången onsdag, 19 november 2025