Etik

Nuvarande AI-praxis kan möjliggöra en ny generation av upphovsrätts-troll

En ny forskningssamverkan mellan Huawei och akademin tyder på att en stor del av den viktigaste nuvarande forskningen inom artificiell intelligens och maskinlärning kan vara utsatt för rättsliga åtgärder så snart den blir kommersiellt framträdande, eftersom datamängderna som möjliggör genombrott distribueras med ogiltiga licenser som inte respekterar de ursprungliga villkoren för de offentliga domäner från vilka data hämtades.

I praktiken har detta två nästan oundvikliga möjliga resultat: att mycket framgångsrika, kommersiella AI-algoritmer som är kända för att ha använt sådana datamängder kommer att bli framtida mål för opportunistiska patenttroll vars upphovsrättigheter inte respekterades när deras data samlades in; och att organisationer och individer kommer att kunna använda samma rättsliga sårbarheter för att protestera mot distributionen eller spridningen av maskinlärningstekniker som de finner oacceptabla.

Den artikeln har titeln Kan jag använda denna offentligt tillgängliga datamängd för att bygga kommersiell AI-mjukvara? Troligen inte, och är ett samarbete mellan Huawei Canada och Huawei Kina, tillsammans med York University i Storbritannien och University of Victoria i Kanada.

Fem av sex (populära) öppen källkodsdatamängder är inte lagligen användbara

För forskningen bad författarna avdelningar på Huawei att välja de mest önskvärda öppna källkodsdatamängderna som de ville utnyttja i kommersiella projekt, och valde de sex mest efterfrågade datamängderna från svaren: CIFAR-10 (en delmängd av 80 miljoner små bilder-datamängden, som dras tillbaka på grund av ‘nedsättande termer’ och ‘stötande bilder’, även om dess derivat sprids); ImageNet; Cityscapes (som innehåller exklusivt originalmaterial); FFHQ; VGGFace2, och MSCOCO.

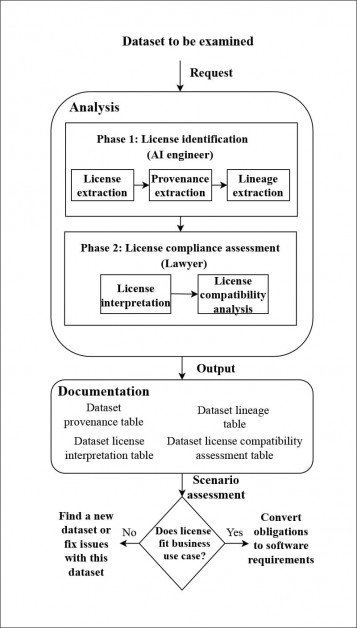

För att analysera om de valda datamängderna var lämpliga för lagligt bruk i kommersiella projekt utvecklade författarna en ny pipeline för att spåra tillbaka licenskedjan så långt som möjligt för varje uppsättning, även om de ofta var tvungna att använda webbarkivkopior för att hitta licenser från nu utgångna domäner, och i vissa fall var tvungna att ‘gissa’ licensstatusen från den närmaste tillgängliga informationen.

Arkitektur för proveniensspårningssystemet som utvecklats av författarna. Källa: https://arxiv.org/pdf/2111.02374.pdf

Författarna fann att licenser för fem av de sex datamängderna ‘innehåller risker förknippade med minst en kommersiell användningssammanhang’:

‘[Vi] observerar att, förutom MS COCO, ingen av de studerade licenserna tillåter praktiker rätten att kommersialisera en AI-modell som tränats på data eller ens utdata från den tränade AI-modellen. Ett sådant resultat förhindrar också effektivt praktiker från att ens använda förtränade modeller som tränats på dessa datamängder. Offentligt tillgängliga datamängder och AI-modeller som är förtränade på dem används allmänt kommersiellt.’ *

Författarna noterar vidare att tre av de sex studerade datamängderna också kan resultera i licensbrott i kommersiella produkter om datamängden modifieras, eftersom endast MS-COCO tillåter detta. Men dataförstärkning och undermängder och övermängder av inflytelserika datamängder är en vanlig praxis.

I fallet med CIFAR-10 skapade de ursprungliga sammanställarna inte någon konventionell form av licens alls, utan krävde endast att projekt som använder datamängden inkluderar en citat till den ursprungliga artikeln som åtföljde datamängdens utgivning, vilket presenterar ett ytterligare hinder för att fastställa den rättsliga statusen för data.

Ytterligare, innehåller endast CityScapes-datamängden material som uteslutande genereras av datamängdens ursprungliga skapare, snarare än att vara ‘kuraterad’ (samlad) från nätverkskällor, med CIFAR-10 och ImageNet som använder flera källor, var och en av vilka skulle behöva undersökas och spåras tillbaka för att fastställa någon form av upphovsrättsmekanism (eller ens en meningsfull disclaimer).

Ingen utväg

Det finns tre faktorer som kommersiella AI-företag tycks förlita sig till för att skydda sig från rättsliga åtgärder kring produkter som har använt upphovsrättsligt skyddat innehåll från datamängder fritt och utan tillstånd, för att träna AI-algoritmer. Ingen av dessa erbjuder någon (eller mycket) tillförlitlig långsiktig skydd:

1: Laissez Faire-nationella lagar

Även om regeringar runt om i världen är tvungna att lätta på lagar kring datainsamling i ett försök att inte halka efter i racet mot presterande AI (som förlitar sig på stora mängder av verkliga data för vilka vanlig upphovsrättslig efterlevnad och licensiering skulle vara orealistisk), erbjuder endast USA fullständig immunitet i detta avseende, under Fair Use-doktrinen – en policy som ratificerades 2015 med slutsatsen av Authors Guild v. Google, Inc., som fastställde att sökjätten kunde fritt ta in upphovsrättsligt skyddat material för sitt Google Books-projekt utan att anklagas för intrång.

Om Fair Use-doktrinens policy någonsin ändras (dvs. som svar på ett annat banbrytande fall som involverar tillräckligt starka organisationer eller företag), skulle det troligen betraktas som en a priori-tillstånd i termer av att utnyttja nuvarande upphovsrättsintrångsdatamängder, skyddande tidigare användning; men inte pågående användning och utveckling av system som möjliggjordes genom upphovsrättsligt skyddat material utan avtal.

Detta sätter det nuvarande skyddet av Fair Use-doktrinen på en mycket provisorisk basis, och kunde potentiellt, i det scenariot, kräva att etablerade, kommersiella maskinlärningsalgoritmer upphör med verksamheten i fall där deras ursprung möjliggjordes av upphovsrättsligt skyddat material – även i fall där modellens vikter nu hanterar enbart tillåtet innehåll, men tränades på (och gjordes användbara av) olagligt kopierat material.

Utanför USA, som författarna noterar i den nya artikeln, är politikerna generellt mindre tillåtande. Storbritannien och Kanada skyddar endast användningen av upphovsrättsligt skyddat material för icke-kommersiella ändamål, medan EU:s lag om text- och datautvinning (som inte har överträffats av senaste förslagen för mer formell AI-reglering) också utesluter kommersiell exploatering för AI-system som inte följer upphovsrättskraven för den ursprungliga data.

Dessa sistnämnda arrangemang innebär att en organisation kan uppnå stora saker med andras data, upp till – men inte inklusive – den punkt då de tjänar pengar på det. Vid den punkten skulle produkten antingen bli rättsligt utsatt, eller avtal skulle behöva upprättas med bokstavligen miljontals upphovsrättsinnehavare, många av vilka nu är ospårbara på grund av internetets skiftande natur – en omöjlig och oöverkomlig uppgift.

2: Caveat Emptor

I fall där intrångsorganisationer hoppas på att skjuta upp skulden, observerar den nya artikeln också att många licenser för de mest populära öppna källkodsdatamängderna auto-indemnifierar sig mot alla anspråk på upphovsrättsmissbruk:

‘Till exempel kräver ImageNets licens uttryckligen att praktiker ska indemnifiera ImageNet-teamet mot alla anspråk som uppstår från användning av datamängden. FFHQ, VGGFace2 och MS COCO-datamängder kräver att datamängden, om den distribueras eller modifieras, ska presenteras under samma licens.’

I praktiken tvingar detta dem som använder FOSS-datamängder att absorbera skulden för användningen av upphovsrättsligt skyddat material, inför eventuella rättsliga åtgärder (även om det inte nödvändigtvis skyddar de ursprungliga sammanställarna i ett fall där den nuvarande “säkra hamn”-klimatet är komprometterat).

3: Indemnitet genom oklarhet

Den samarbetsvilliga naturen hos maskinlärningssamhället gör det ganska svårt att använda företagsoklarhet för att dölja närvaron av algoritmer som har gynnats av upphovsrättsintrångsdatamängder. Långsiktiga kommersiella projekt börjar ofta i öppna FOSS-miljöer där användningen av datamängder är en fråga om register, på GitHub och andra offentligt tillgängliga forum, eller där ursprunget till projektet har publicerats i förtryck eller granskade artiklar.

Även om detta inte är fallet, är modellinversion alltmer kapabel att avslöja de typiska egenskaperna hos datamängder (eller till och med uttryckligen utmatning av något av källmaterialet), antingen tillhandahåller bevis i sig, eller tillräcklig misstanke om intrång för att möjliggöra domstolsbeslutad tillgång till historien om algoritmens utveckling, och detaljer om datamängderna som användes i den utvecklingen.

Slutsats

Artikeln skildrar en kaotisk och ad hoc-användning av upphovsrättsligt skyddat material som erhållits utan tillstånd, och en serie licenskedjor som, följt logiskt så långt tillbaka som den ursprungliga källan till data, skulle kräva förhandlingar med tusentals upphovsrättsinnehavare vars arbete presenterades under auspicierna av webbplatser med en stor variation av licensvillkor, många som utesluter derivat kommersiella verk.

Författarna slutsats:

‘Offentligt tillgängliga datamängder används allmänt för att bygga kommersiell AI-mjukvara. Man kan göra så om [och] endast om licensen som är associerad med den offentligt tillgängliga datamängden tillhandahåller rätten att göra så. Men det är inte lätt att verifiera rättigheter och skyldigheter som tillhandahålls i licensen som är associerad med de offentligt tillgängliga datamängderna. Eftersom licensen ibland är antingen otydlig eller potentiellt ogiltig.’

Ett annat nytt arbete, med titeln Byggnad av lagliga datamängder, som släpptes den 2 november från Centre for Computational Law vid Singapore Management University, betonar också behovet av att datavetare erkänner att “vilda västern”-eran av ad hoc-datainsamling är på väg att ta slut, och speglar rekommendationerna i Huawei-artikeln att anta mer stränga vanor och metoder för att säkerställa att datamängdsanvändning inte utsätter ett projekt för rättsliga konsekvenser när kulturen förändras över tiden, och när den nuvarande globala akademiska aktiviteten inom maskinlärningssektorn söker en kommersiell avkastning på åren av investering. Författaren observerar*:

‘[Den] samling av lagstiftning som påverkar ML-datamängder kommer att växa, mitt i farhågor om att nuvarande lagar erbjuder otillräckliga skydd. Det förslagna AIA [EU:s artificiell intelligenslag], om och när det antas, skulle betydligt förändra AI- och datagovernanslandskapet; andra jurisdiktioner kan följa efter med sina egna lagar. ‘

* Min konvertering av inline-citat till hyperlänkar