Andersons vinkel

Kodning AIs Tendenser Att Lida Av Dunning-Kruger Effekten

Nya studier visar att kodning AIs, såsom ChatGPT, lider av Dunning-Kruger effekten, ofta agerar mest säkra när de är minst kompetenta. När de tacklar ovana eller obskyra programmeringsspråk, hävdar de hög säkerhet även om deras svar faller isär. Studien kopplar modellens överförtroende till både dålig prestation och brist på träningsdata, vilket väcker nya farhågor om hur mycket dessa system verkligen vet om vad de inte vet.

Den som har tillbringat även en måttlig mängd tid med att interagera med Large Language Models om faktamässiga frågor kommer redan att veta att LLMs ofta är benägna att ge ett säkert felaktigt svar på en användarfråga.

Tillsammans med mer uppenbara former av hallucination, är orsaken till denna tomma skrytsamhet inte 100% klar. Forskning publicerad under sommaren tyder på att modellerna ger säkra svar även när de vet att de har fel, till exempel; även om andra teorier tillskriver överförtroende till arkitekturval, bland andra möjligheter.

Vad slutanvändaren kan vara säker på är att upplevelsen är otroligt frustrerande, eftersom vi är hårdkodade för att ha tillit till människors uppskattningar av sina egna förmågor (inte minst för att det finns konsekvenser, juridiska och andra, för en person som lovar för mycket och levererar för lite); och en sorts antropomorfisk överföring gör att vi tenderar att replikera detta beteende med konversations-AI-system.

Men en LLM är en oansvarig enhet som kan och kommer att effektivt returnera en ‘Whoops! Butterfingers…’ efter att den har hjälpt användaren att oavsiktligt förstöra något viktigt, eller åtminstone slösa bort en eftermiddag av deras tid; under förutsättning att den kommer att medge skadestånd.

Värre, denna brist på försiktig försiktighet verkar vara omöjlig att prompta bort, åtminstone i ChatGPT, som kommer att rikligt försäkra användaren om giltigheten av dess råd och förklara bristerna i dess tänkande först efter att skadan är skedd. Vare sig uppdatering av systemets beständiga minne eller användning av repetitiva prompts verkar ha någon större inverkan på problemet.

Människor kan också vara lika envist och självbedrägliga – även om den som begick ett sådant djupt och ofta fel troligen skulle bli avskedad tidigt. Sådana som dessa lider av motsatsen till ‘impostersyndromet’ (där en anställd fruktar att de har blivit befordrade över sin förmåga) – Dunning Kruger effekten, där en person signifikant överskattar sin förmåga att utföra en uppgift.

Kostnaden Av Inflation

En ny studie från Microsoft undersöker värdet av Dunning-Kruger effekten i relation till den effektiva prestationen av AI-stödda kodarkitekturer (såsom Redmonds eget Copilot), i en forskningsinsats som är den första att specifikt behandla denna sub-sektor av LLMs.

Arbetet analyserar hur säkert sådana kodskrivande AIs kan bedöma sina egna svar genom att ge dem tusentals flervalsfrågor om programmering, med varje fråga tillhörande ett specifikt språkområde, från Python och Java till Perl och COBOL:

Programmeringsspråk som användes i studien, tillsammans med antalet flervalsfrågor som sampades för varje språk.

Modellerna fick i uppgift att välja det korrekta alternativet och sedan uppskatta hur säkra de var på sitt val, med deras faktiska prestation mätt av hur ofta de fick svaret rätt – och deras självbedömda säkerhet som indikerade hur bra de trodde att de var. Att jämföra dessa två mått tillät forskarna att se var säkerhet och kompetens avvek.

För att mäta hur säkra modellerna tycktes vara, använde studien två metoder: absolut säkerhet och relativ säkerhet. I den första fick modellen ge ett poäng från noll till ett bredvid varje svar, med dess säkerhet för ett visst språk definierat av genomsnittet av dessa poäng över frågor i det språket.

Den andra metoden tittade på hur säker modellen var när den valde mellan två frågor; för varje par fick modellen säga vilken den kände sig mer säker på. Dessa val bedömdes med hjälp av rankningssystem som ursprungligen var utformade för tävlingsspel, där varje fråga behandlades som en spelare i en match. De slutliga poängen normaliserades och genomsnittlig för varje språk för att ge en relativ säkerhetspoäng.

Två etablerade former av Dunning-Kruger effekten undersöks i artikeln: en som spårar hur en enskild modell missbedömer sin prestation över olika domäner; och en som jämför säkerhetsnivåer mellan svagare och starkare modeller.

Den första formen, kallad intra-deltagare DKE, undersöker om en enskild modell blir mer överförtrodd i språk där den presterar dåligt. Den andra, inter-deltagare DKE, frågar om modeller som presterar sämre också tenderar att bedöma sig själva högre.

I båda fallen används gapet mellan säkerhet och faktisk prestation för att mäta överförtroende, med större gap i lågpresterande inställningar som pekar på DKE-liknande beteende.

Metod

Studien testade hur korrekt kodning AIs kunde bedöma sina egna svar genom att ge dem tusentals flervalsfrågor om programmering, med varje fråga tillhörande ett specifikt språkområde, från Python och Java till Perl och COBOL:

Programmeringsspråk som användes i studien, tillsammans med antalet flervalsfrågor som sampades för varje språk.

Modellerna fick i uppgift att välja det korrekta alternativet och sedan uppskatta hur säkra de var på sitt val, med deras faktiska prestation mätt av hur ofta de fick svaret rätt – och deras självbedömda säkerhet som indikerade hur bra de trodde att de var. Att jämföra dessa två mått tillät forskarna att se var säkerhet och kompetens avvek.

För att mäta hur säkra modellerna tycktes vara, använde studien två metoder: absolut säkerhet och relativ säkerhet. I den första fick modellen ge ett poäng från noll till ett bredvid varje svar, med dess säkerhet för ett visst språk definierat av genomsnittet av dessa poäng över frågor i det språket.

Den andra metoden tittade på hur säker modellen var när den valde mellan två frågor; för varje par fick modellen säga vilken den kände sig mer säker på. Dessa val bedömdes med hjälp av rankningssystem som ursprungligen var utformade för tävlingsspel, där varje fråga behandlades som en spelare i en match. De slutliga poängen normaliserades och genomsnittlig för varje språk för att ge en relativ säkerhetspoäng.

Två etablerade former av Dunning-Kruger effekten undersöks i artikeln: en som spårar hur en enskild modell missbedömer sin prestation över olika domäner; och en som jämför säkerhetsnivåer mellan svagare och starkare modeller.

Den första formen, kallad intra-deltagare DKE, undersöker om en enskild modell blir mer överförtrodd i språk där den presterar dåligt. Den andra, inter-deltagare DKE, frågar om modeller som presterar sämre också tenderar att bedöma sig själva högre.

I båda fallen används gapet mellan säkerhet och faktisk prestation för att mäta överförtroende, med större gap i lågpresterande inställningar som pekar på DKE-liknande beteende.

Resultat

Studien testar Dunning-Kruger effekten över sex stora språkmodeller: Mistral; Phi-3; DeepSeek-Distill; Phi-4; GPT-0.1, och GPT-4o.

Varje modell testades på flervalsfrågor om programmering från den offentligt tillgängliga CodeNet-databasen, med 37 språk* representerade för att visa hur säkerhet och korrekthet varierade över bekanta och obskyra koddomäner.

Den inter-modellanalysen visar ett tydligt Dunning-Kruger-mönster:

Faktiskt mot upplevt prestanda över sex kodmodeller, som visar hur lägre presterande modeller som Mistral och Phi-3 visar hög säkerhet trots dålig korrekthet, medan starkare modeller som GPT-4o visar mer kalibrerat eller till och med underförtrodd beteende.

Modeller med lägre korrekthet, inklusive Mistral och Phi-3, tenderade att överskatta sin egen förmåga, medan högre presterande system som GPT-4o visade säkerhetsnivåer som mer korrekt matchade deras verkliga prestanda, särskilt när de bedömdes med relativ säkerhet.

Resultaten indikerar också att de mest kapabla modellerna ibland kan underskatta sig själva (ett mönster som absoluta säkerhetspoäng inte fångar).

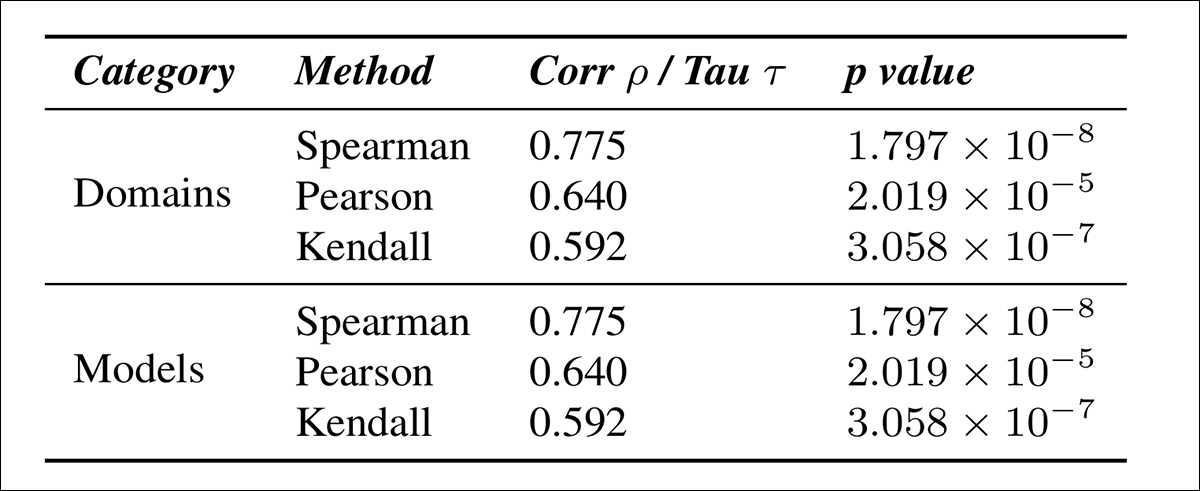

Resultaten indikerar också att den intra-modellanalysen stöder förekomsten av Dunning-Kruger effekten. I resultattabellen som visas i början av artikeln ser vi hur varje modell presterade över olika programmeringsspråk, ordnade efter faktisk prestanda.

I språk där modellerna fick låga poäng var deras säkerhet märkbart högre än vad deras resultat berättigade till. I bekanta språk som Python och JavaScript var deras säkerhet mer i linje med deras verkliga korrekthet, och ibland till och med lägre.

Detta mönster visade sig i både absolut och relativ säkerhetsmätning, vilket tyder på att modellerna är mindre medvetna om sina egna begränsningar när de opererar i obekanta koddomäner.

Att behandla modellerna som deltagare introducerade vissa begränsningar, eftersom det lilla antalet modeller som användes påverkar mångfalden; skillnader inom en enskild modells utdata ignoreras; och datafördelningen kanske inte återspeglar den som finns hos verkliga mänskliga deltagare.

För att ta hänsyn till detta testade studien tre alternativa inställningar: först gavs varje modell en distinkt persona; andra, svar sampades vid en högre temperatur för att skapa mer variation; tredje, prompterna parafraserades flera gånger, med varje version behandlad som en separat deltagare:

Korrelation mellan överförtroende och faktisk prestanda över olika experimentella inställningar, som visar att Dunning-Kruger-mönstret förblir konsekvent under alla förhållanden och är starkast när flera olika svar sampas från samma modell.

Resultattabellen ovan visar hur starkt Dunning-Kruger effekten manifesterar sig under dessa förhållanden, och att DKE var mest uttalat när flera olika svar sampades från samma modell vid hög temperatur.

För att bättre förstå hur upplevd prestanda avviker från faktisk prestanda, jämförde studien absoluta och relativa säkerhetsuppskattningar, genom att beräkna hur mycket varje modell överskattade sin egen förmåga (specifikt, skillnaden mellan dess säkerhetspoäng och dess verkliga korrekthet), och sedan mäta hur den överskattningen relaterade till modellens verkliga prestanda:

Korrelation mellan överförtroende (mätt som absolut minus relativ säkerhet) och faktisk korrekthet över programmeringsspråk och modelltyper, som visar att större överskattning konsekvent är associerad med lägre prestanda.

Resultattabellen ovan visar hur överskattning relaterar till verklig prestanda, både över programmeringsspråk och över modeller. I båda fallen kan vi se att modeller med lägre korrekthet tenderar att visa större överskattning.

Ytterligare, specialiserade modeller som tränats på smalare domäner visade starkare DKE-effekter än generalister:

Korrelation mellan överskattning och verklig prestanda för bas-, enkel-domän- och multi-domänspecialiserade modeller, som visar starkare DKE-effekter allteftersom specialiseringen ökar.

Med hjälp av MultiPL-E-databasen över åtta programmeringsspråk, fann författarna att enskild-domänsträning ledde till större överskattning än multi-domän- eller basinställningar, vilket tyder på att DKE förvärras med ökad specialisering.

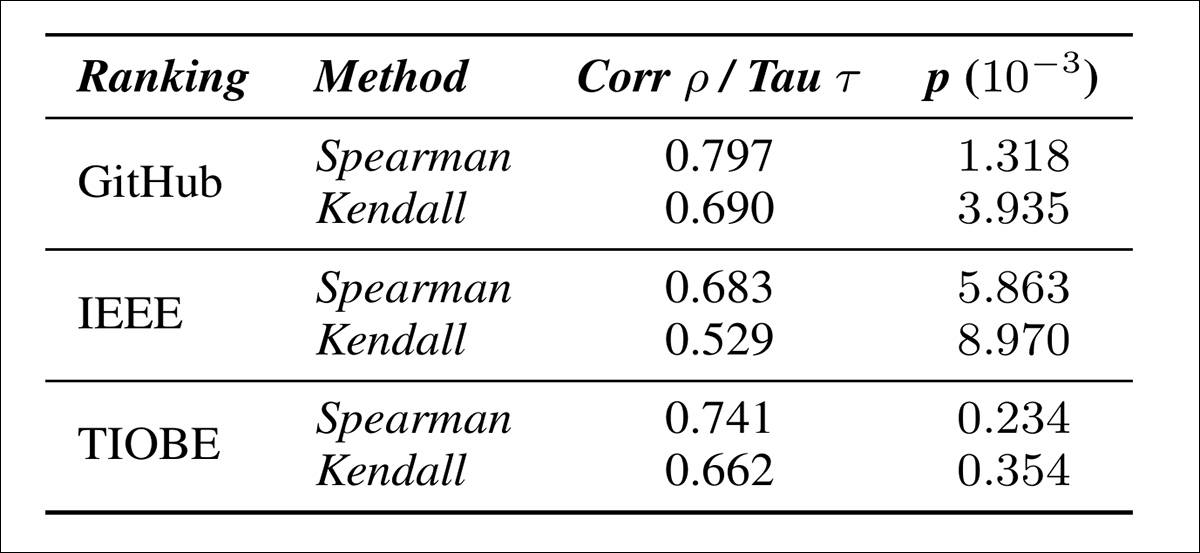

Testerna fann också att modellerna tenderade att vara mer överförtrodda i sällsynta programmeringsspråk. Över GitHub, IEEE och TIOBE-rankningar, korrelerar sällsynthet starkt med högre upplevd prestanda, med en topp på 0,797:

Korrelation mellan modellens överförtroende och språksällsynthet, med hjälp av tre popularitetsrankningar. Mindre vanliga språk är associerade med högre upplevd prestanda.

Slutligen testade författarna om Dunning-Kruger effekten förekommer i kodgenerering, genom att utvärdera modellerna på MultiPL-E-databasen över Ada, Dart, Prolog, Swift, C++, Python, C# och Elixir-språken.

Även om effekten fortfarande var närvarande, var den betydligt svagare än i flervalsfrågesättningen, vilket troligen reflekterar den större svårigheten att bedöma säkerhet och korrekthet i öppna uppgifter:

Korrelation mellan överskattning och faktisk prestanda i öppen kodgenerering, baserat på MultiPL-E-resultat över åtta språk.

I övervägandet av den fortfarande omstridda förklaringen till Dunning-Kruger effekten, drar författarna följande slutsats:

‘En möjlig förklaring som kan vara gemensam för både människor och AI-modeller är den meta-kognitiva förklaringen, som säger att bedömning av kvaliteten på en prestation av en färdighet är en viktig del av att förvärva en färdighet.

‘Denna förklaring kan potentiellt testas experimentellt i AI-modeller med en kontrollerad studie av olika träningsstrategier och om de alla leder till samtidiga förbättringar av prestanda och förmåga att bedöma kvaliteten på prestanda. Men denna studie ligger betydligt utanför ramen för denna artikel, och vi lämnar den för framtida arbete.’

Slutsats

Även i sin ursprungliga domän kan Dunning-Kruger effekten (som artikeln noterar) tillskrivas antingen en statistisk eller kognitiv orsak. Om den tillskrivs en statistisk orsak, är tillämpningen av ett tidigare unikt mänskligt syndrom på en maskinläringskontext faktiskt ganska giltig.

Även om författarna spekulerar att orsaken kan ha visat sig vara ‘kognitiv’ i båda fallen, skulle det kräva en något mer metafysisk utgångspunkt.

Kanske den mest intressanta upptäckten i artikeln är den utsträckning till vilken flera kodning LLMs tenderar att dubbla ner i sina minst fördelaktiga omständigheter, dvs. genom att visa maximal säkerhet när de hanterar de glesaste eller minst kända språken – vilket skulle vara en nästan omedelbart självförstörande strategi i en verklig arbetsmiljö.

* De programmeringsspråk som användes var Ada, Bash, C, C#, C++, COBOL, Ceylon, Clojure, D, Dart, Dash, Elixir, Erland, F#, Fortran, Go, Haskell, Java, JavaScript, Julia, Lisp, Kotlin, Lua, OCaml, Objective-C, PHP, Pascal, Perl, Prolog, Python, Racket, Ruby, Rust, Scala, Swift, TypeScript och Visual Basic.

Publicerad första gången onsdag, 8 oktober 2025