Andersons vinkel

Att bringa en känsla av luktsinne till AI-utveckling

En ny AI-dataset lär maskiner att lukta genom att associera luktdatabas med bilder, vilket låter modellerna matcha dofter med objekt, scener och material.

Kanske på grund av att luktkontrollmaskiner har en så brokig historia, är luktsinnet ett ganska försummat sinne i AI-forskningen. Om du inte planerade att producera ett annat bidrag i den långvariga (mer än ett århundrade, hittills) smell-o-vision-sagan, har användningsfall alltid tyckts ganska “nischade” i jämförelse med utnyttjandet av bild-, ljud- och videodatabaser och de AI-modeller som tränas från dem.

I själva verket skulle möjligheten att automatisera, industrialisera och popularisera de sorters upptäktstjänster som erbjuds av sprängämneshundar, likhundar, sjukdomsdoftande hundar och olika andra typer av hundar med luktsinne, skulle vara en betydande fördel i kommunala och säkerhetstjänster. Trots den höga efterfrågan, är utbudet långt ifrån tillräckligt, och att träna och underhålla upptäckthundar är en dyr verksamhet som inte alltid erbjuder värdet för pengarna.

Hittills har de flesta forskningar som har trängt in i detta område varit begränsade till ett laboratorium, med kuraterade samlingar som vanligtvis består av exempel med handgjorda funktioner – ett profilerat mer mot specialtillverkade lösningar än industrialiserade tillämpningar.

Före med en näsa

I denna ganska dammiga atmosfär kommer en intressant ny akademisk/industriell samverkan från USA, där ett team av forskare tillbringade flera månader med att katalogisera olika lukter i inomhus- och utomhusmiljöer i New York City – och, för första gången, samlade in bilder som är associerade med de fångade lukterna:

Notera den centrala sensorn, ‘nosen’ på luktenheten. Tränad endast på luktsinne, gissar modellen om den luktar på granit, plast eller läder – och identifierar till och med rummet den befinner sig i, utan att se en enda pixel. Källa

Denna forskning har lett författarna till den nya studien att utveckla en variant av den mycket populära Contrastive Language-Image Pretraining (CLIP)-ramverket, som kopplar text och bilder, i form av Contrastive Olfaction-Image Pretraining (COIP) – som kopplar lukter och bilder.

Överst: synkroniserad video och luktsensordata fångas i naturliga miljöer med en kamera-e-nos-rig. Nederst vänster (b): en gemensam inbäddning lärdes genom cross-modal självövervakning. (c): systemet hämtar visuella matchningar baserat enbart på en luktförfrågan. (d): enskilda luktexempel används för att klassificera miljö-, objektkategorier och material. (e): högt liknande lukter, såsom två typer av gräs, skiljs åt utan visuell inmatning. Källa

Den nya dataseten, med titeln New York Smells, innehåller 7 000 luktbildpar med 3 500 olika objekt. När den tränades i tester, visade sig den nya datan överträffa de populära handgjorda funktionerna i den relativt lilla mängden liknande tidigare dataset.

Författarna hoppas att deras första företag ska öppna vägen för senare och efterföljande arbete mot luktdetektionssystem som är utformade för att fungera i vildmarken, på samma sätt som lukthundar gör*:

‘Vi ser på denna dataset som ett steg mot i-vildmarken, multimodalt luktsinne, samt ett steg mot att koppla syn med luktsinne. Medan luktsinnet traditionellt har närmat sig i begränsade miljöer, såsom kvalitetskontroll, finns det många tillämpningar i naturliga miljöer.

‘Till exempel, som människor, använder vi ständigt vår luktsinne för att bedöma matens kvalitet, identifiera faror och upptäcka osynliga föremål.

‘Dessutom visar många djur, såsom hundar, björnar och möss, övermänskliga luktförmågor kapaciteter, vilket tyder på att mänskligt luktsinne är långt ifrån gränsen för maskinens förmågor.’

Även om den nya artikeln, med titeln New York Smells: A Large Multimodal Dataset for Olfaction, lovar att data och kod kommer att släppas, är en 27 GB stor datafil redan tillgänglig via artikeln projektsida. Artikeln producerades av nio forskare över Columbia University, Cornell University och Osmo Labs.

Metod

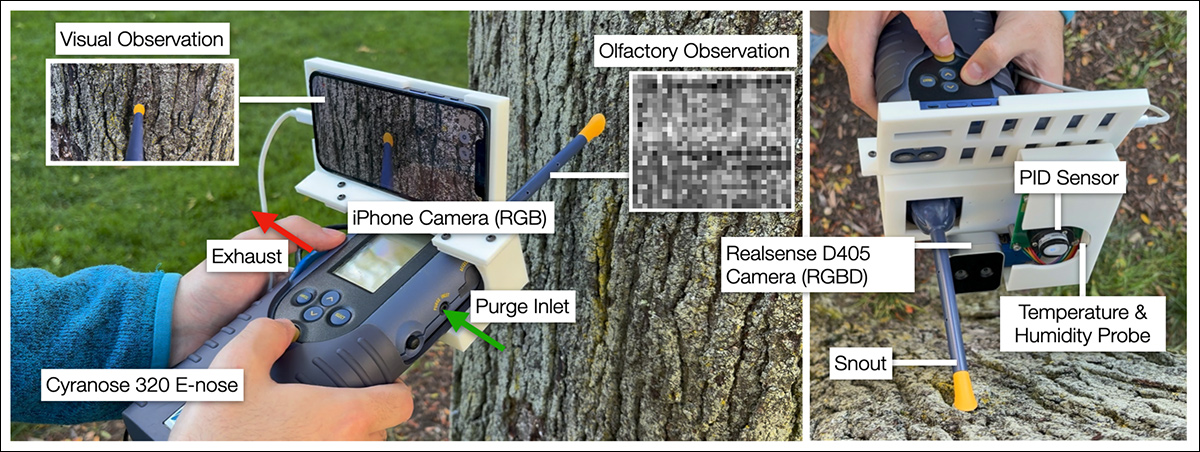

För att samla in material för den nya samlingen, använde forskarna Cyranose 320-elektroniska näsan, med en iPhone monterad ovanför framintaget för att fånga visuellt vad lukter som registrerades:

En handhållen sensorrig samlar in parade video- och luktdatabas genom att montera en iPhone-kamera på en Cyranose 320 e-nos. Snuten riktas mot föremål medan avgas- och rensningsinloppet hanterar luftflödet under provtagning. En RGB-D-kamera fångar djup, medan Volatile organic compound (VOC)-koncentration, temperatur och fuktighet registreras genom integrerade sensorer, inklusive en Proportional-integral-derivative (PID)-modul och miljösond.

Cyranose-enheten kördes vid 2 Hz, och registrerade 32-dimensionella lukttidssteg. Volatile Organic Compound (VOC)-koncentrationer registrerades med en MiniPID2 PPM WR-sensor.

Den portabla enheten fungerade som en smidig sensor, som vidarebefordrade data till en mer beräkningskapabel mobil station för bearbetning.

För att placera mållukten i sammanhang, registrerades en “basluktsinne” innan det mer specifika föremålet riktades direkt med “nosen” på Cyranose. Den omgivande provtagningen togs från en sidport i enheten, för att säkerställa att den var tillräckligt långt ifrån den primära luktkällan för att inte bli förorenad.

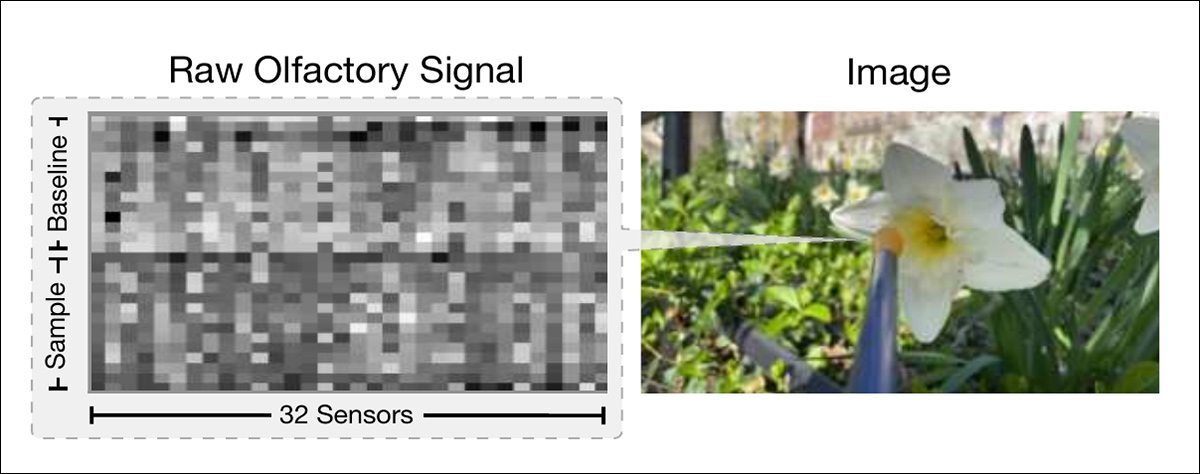

Två prover togs genom huvudintaget på sensorn, med varje tiosekundersinspelning fångad från en annan position runt föremålet, för att förbättra dataeffektiviteten. Proverna kombinerades sedan med den omgivande basen för att bilda en 28×32-matris, som representerar den fullständiga luktmätningen:

Detta exempel visar signalen och motsvarande bild för en blomma. Den fullständiga luktsignalen består av en 28×32-matris, som kombinerar en 14-ramars omgivande baslinje med två 10-sekundersprover tagna från olika vinklar runt målföremålet.

Data och tester

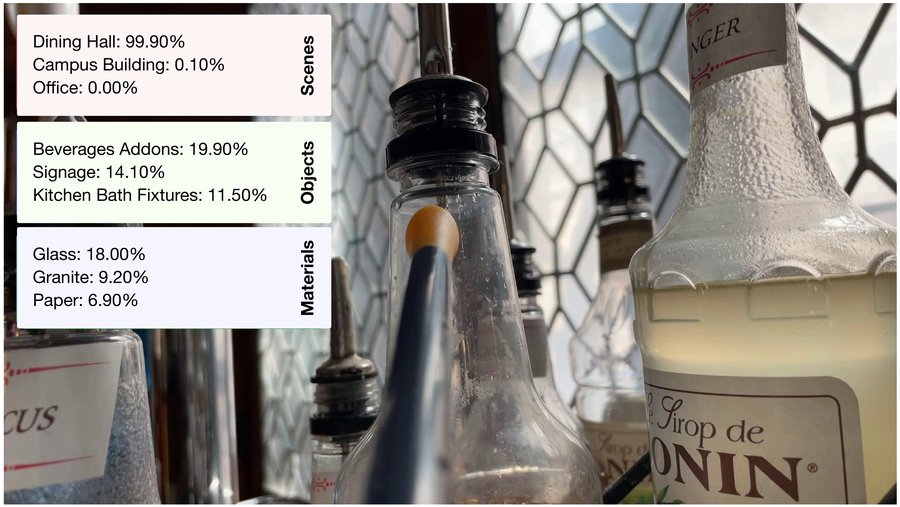

Vision Language Models (VLMs) användes för att automatiskt märka objekt och material som fångats av iPhone i Cyranose-riggen, med GPT-4o använd för uppgiften; dock var scenkategorier manuellt märkta:

Ett litet urval från en omfattande illustration i källartikeln som visar de varierande luktkällor och miljöer som fångats i projektet.

Dataseten delades upp i tränings- och valideringssplit, med båda proverna från varje objekt tilldelade samma split för att undvika korskontamination. Den slutliga samlingen består av 7 000 luktbildpar från 3 500 omarkerade objekt, tillsammans med 70 timmar video och 196 000 tidssteg av rå luktdatabas från både baslinje- och provtagningsfaser.

Data samlades in under 60 sessioner över en tvåmånadersperiod, som omfattade parker, universitetsbyggnader, kontor, gator, bibliotek, lägenheter och matsalar, med flera sessioner genomförda på varje plats. Den resulterande dataseten innehåller 41 % utomhus- och 59 % inomhusmiljöer.

För att utveckla allmänna luktrepresentationer, tränade författarna en kontrastiv modell för att associera synkroniserade bild-luktpar från dataseten. Denna metod, den ovannämnda COIP, använder en förlustfunktion anpassad från CLIP för att justera inbäddningarna av samtidiga visuella och luktsignaler.

Träningen använde både en visuell encoder och en luktenhet, med målet att lära modellen att bringa matchande lukter och bilder närmare varandra i ett gemensamt representationrum. De resulterande representationerna stöder en rad nedströmsuppgifter, inklusive luktbildhämtning, scen- och objekterkänning, materialklassificering och finmaskig luktdiskriminering.

Modellen tränades med hjälp av två typer av luktdatabas: den fullständiga råa sensor signalen och en reducerad handgjord sammanfattning som kallas smellprints – som är vanligt förekommande funktioner i luktforskning som komprimerar varje sensors svar till ett enda tal genom att jämföra toppmotståndet under provtagning med genomsnittsmotståndet under den omgivande baslinjen.

Till skillnad från det råa ingångsvärdet, som bestod av en tidsserie från 32 kemiska sensorer inuti Cyranose-enheten, som fångade hur varje sensors elektriska motstånd förändrades över tiden när den reagerade på lukten.

För kurering av dataseten, matades denna obearbetade signal direkt in i ett neuronnätverk, vilket möjliggjorde slut-till-slut-lärande med antingen en konvolutionsbaserad eller transformatorbaserad ryggrad. Modeller tränades med hjälp av både smellprints och råa ingångsvärden samlade från olika miljöer i New York City, med båda ingångstyper utvärderade med kontrastivt lärande.

Korsmodal hämtning

Korsmodal hämtning utvärderades genom att inbädda varje luktprov och dess associerade bild i ett gemensamt representationrum, och testa om den korrekta bilden kunde hämtas baserat enbart på luktdatabasen.

Rankning bestämdes av närheten av varje bildinbäddning till luktförfrågan inom detta rum, och prestandan mättes med hjälp av genomsnittlig rank, median rank och återkallande vid flera trösklar:

Korsmodal hämtningsnoggrannhet för olika luktenheter, som visar hur väl varje modell identifierar den korrekta bilden från en luktförfrågan. Resultaten jämför arkitekturer tränade på råa luktsignaler med de som använder smellprints.

Med avseende på dessa resultat, skriver författarna:

‘Kontrastiv förträning med smellprint fungerar bättre än slumpen i alla mått. Men att träna luktenheten på den råa luktsignalen leder till en betydande förbättring jämfört med smellprint-enheten, oavsett arkitektur.

‘Detta visar den rikare informationen i den råa luktdatabasen, som låser upp starkare korsmodala associationer mellan syn och luktsinne.’

En detalj från den sjunde illustrationen i källartikeln, som är för kondenserad för att återges meningsfullt här. Här visas korsmodala hämtningsexempel som visar hur modellen kopplar lukter till matchande bilder. Varje rad börjar med en luktförfrågan, följt av de topprankade bildförutsägelserna i det gemensamma inbäddningsrummet. Den korrekta bilden för varje förfrågan är omgiven av grönt, vilket visar hur dofter från böcker, växter, sten och andra material drar modellen mot visuellt och semantiskt relaterade scener.

Författarna noterar också att hämtningsresultaten visade tydliga semantiska mönster:

‘Hämtningsresultat från vår modell visar ofta semantiska grupperingar. Doften av en bok hämtar bilder av andra böcker, doften av blad hämtar bilder av löv.

‘Dessa resultat tyder på att den inlärda representationen fångar meningsfulla korsmodala strukturer.’

Scen-, objektkategorisering och materialigenkänning

Förmågan hos modellen att känna igen lukter utan visuell inmatning utvärderades genom att träna den för att identifiera scener, objekt och material baserat enbart på luktdatabas; för detta ändamål användes en linjär sonda (en enkel klassificerare tränad på frusna representationer) för att bedöma hur mycket information som kodades i de inlärda luktinbäddningarna.

Etiketterna härleddes från de associerade bilderna i träningsuppsättningen med hjälp av GPT-4o – men endast luktsignalen användes under klassificeringen.

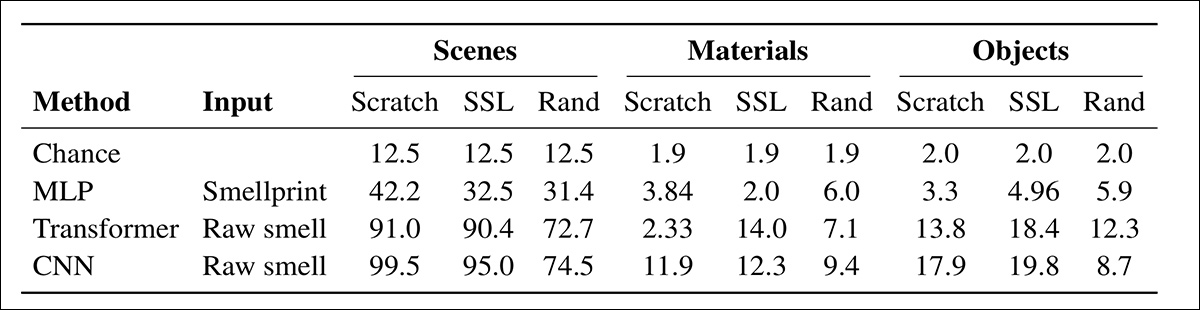

Flera enhetstyper testades: vissa initierades slumpmässigt, vissa tränades från scratch och andra tränades med kontrastivt lärande för att justera luktsinne och syn i ett gemensamt representationrum, med rådata och smellprints utvärderade:

Klassificeringsnoggrannhet för scener, material och objekt utvärderades med hjälp av luktsignaler ensamma. Rå sensorinmatning överträffade smellprints, med CNN:er tränade från scratch som gav de högsta resultaten, inklusive 99,5 % för scener. SSL-förträning hjälpte i vissa fall, men överträffades i allmänhet av övervakad träning. Slumpmässiga vikter visar att modellkapaciteten ensam är otillräcklig.

Mycket högre noggrannhet uppnåddes när rå luktdatabas användes, särskilt i modeller som tränades med korsmodal övervakning. Författarna kommenterar**:

‘Modeller tränade på råa sensorinmatningar uppnår också högre noggrannhet än modeller tränade med handgjorda smellprintfunktioner. Dessa resultat visar att djupinlärande från råa luktsignaler är betydligt bättre än handgjorda funktioner.’

Finmaskig diskriminering

För att bedöma om finmaskiga luktdistinktioner kunde läras, byggdes en benchmark från två grästyper som samexisterar på samma campusgräs. Alternativa prover samlades in under sex 30-minuterssessioner, vilket resulterade i 256 exempel. En linjär klassificerare tränades på funktioner från luktsynskontrastivt lärande, och utvärderades på en hållen-ut uppsättning av 42 prover:

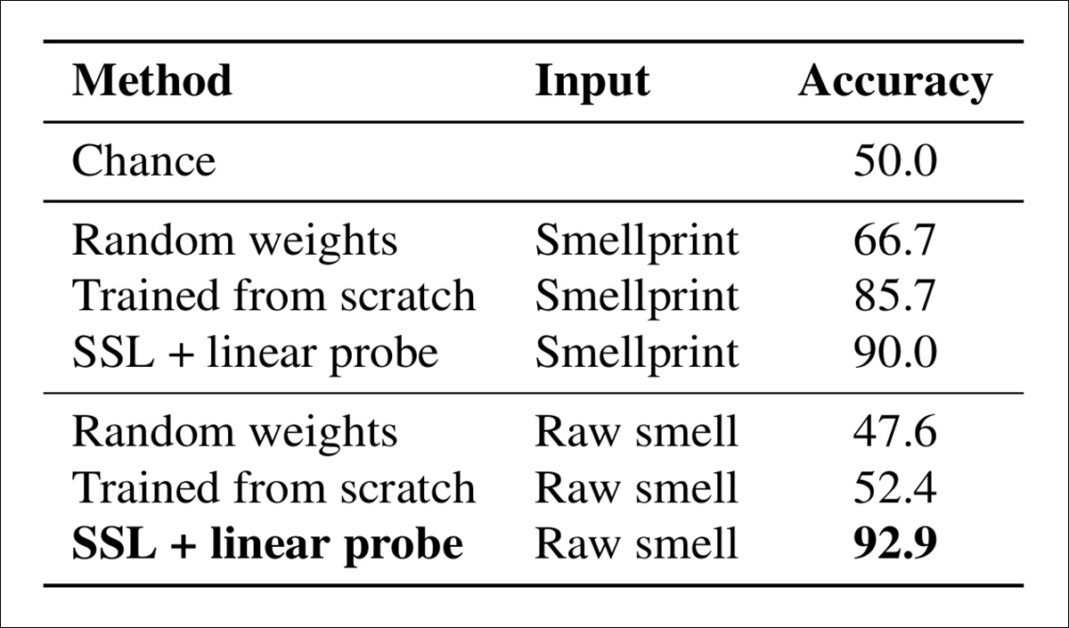

Noggrannhet för grästypsklassificering från luktsinne ensamt. Modeller utvärderades för att avgöra om de kunde skilja mellan två visuellt liknande grästyper med hjälp av endast luktsignal. Prestanda jämfördes över smellprints och rå sensorinmatning, med modeller antingen slumpmässigt initierade, tränade från scratch eller tränade med hjälp av självständigt lärande (SSL) följt av en linjär sonda. Den högsta noggrannheten, 92,9 %, uppnåddes med hjälp av rå luktsignal och SSL, vilket tyder på att finmaskiga luktdistinktioner bäst fångas genom rå inmatning och visionstyrd träning.

Här skriver forskarna:

‘Träning på den råa luktsignalen (i stället för handgjorda funktioner) ger den högsta noggrannheten – överträffar alla varianter baserade på smellprints.

‘Dessa resultat tyder på att luktsynslärande bevarar mer finmaskig information än lärande med smellprints, och att visuell övervakning tillhandahåller en signal för att utnyttja denna information.’

Slutsats

Även om luktsyntes verkar vara ett olöst problem som kommer att bestå en bit in i framtiden, har ett effektivt och prisvärt system för luktanalys i vildmarken enorm potential, inte bara för polisiära, säkerhets- och medicinska ändamål, utan också för kvalitet på livet och urban övervakning.

För närvarande är den utrustning som är inblandad nischad och vanligtvis ganska dyr; därför verkar verkligt framsteg i ‘luktsinne-AI’ för upptäckt sannolikt att kräva en visionär och prisvärd sensor i Raspberry PI-andan.

* Min omvandling av författarnas inline-citat till hyperlänkar.

** Observera att ytterligare illustrationer (figur 8) finns i källartikeln, men är bäst lästa i den kontexten.

Publicerad första gången fredagen den 28 november 2025