Andersons vinkel

AI:s kamp för att läsa analogur kan ha djupare betydelse

En ny rapport från forskare i Kina och Spanien visar att även avancerade multimodala AI-modeller som GPT-4.1 har svårt att läsa av tiden från bilder av analogur. Små visuella förändringar i urverken kan orsaka stora tolkningsfel, och finjustering hjälper bara med bekanta exempel. Resultaten väcker farhågor om tillförlitligheten hos dessa modeller när de ställs inför obekanta bilder i verkliga uppgifter.

När människor utvecklar en tillräckligt djup förståelse för ett område, såsom tyngdkraft eller andra grundläggande fysiska principer, går vi bortom specifika exempel för att förstå de underliggande abstraktionerna. Detta gör att vi kan tillämpa den kunskapen kreativt över sammanhang och känna igen nya instanser, även de vi aldrig har sett förut, genom att identifiera principen i aktion.

När ett område har tillräcklig betydelse kan vi till och med börja uppfatta det där det inte existerar, som med pareidoli, driven av den höga kostnaden för att misslyckas med att känna igen en verklig instans. Så stark är denna mönsterigenkänningsöverlevnadsmechanism att den till och med får oss att hitta en bredare variation av mönster där det inte finns några.

Ju tidigare och mer upprepat ett område är inpräglat i oss, djupare är dess grund och livslånga beständighet; och en av de tidigaste visuella dataset som vi exponeras för som barn kommer i form av undervisningsur, där tryckt material eller interaktiva analogur används för att lära oss att läsa av tiden:

Undervisningshjälpmedel för att hjälpa barn att lära sig att läsa av tiden. Källa: https://www.youtube.com/watch?v=IBBQXBhSNUs

Även om förändringar i urdesign kan utmana oss ibland, är den tidiga domänmästeriet ganska imponerande, vilket gör att vi kan urskilja analogur ansikten även i komplexa eller “excentriska” designval:

Några utmanande ansikten i klockdesign. Källa: https://www.ablogtowatch.com/wait-a-minute-legibility-is-the-most-important-part-of-watch-design/

Människor behöver inte tusentals exempel för att lära sig hur ur fungerar; när den grundläggande konceptet är förstått, kan vi känna igen det i nästan alla former, även när det är förvrängt eller abstraherat.

Svårigheten som AI-modellerna står inför med denna uppgift, till skillnad från, belyser en djupare fråga: deras uppenbara styrka kan bero mer på högvolymexponering än på förståelse.

Bortom Imitationsspelet?

Spänningen mellan ytmässig prestation och äkta “förståelse” har dykt upp upprepat i nyliga undersökningar av stora modeller. Förra månaden omformulerade Zhejiang University och Westlake University frågan i en rapport med titeln Har PhD-nivå LLM verkligen förstått grundläggande addition? (inte fokus för denna artikel), och drog följande slutsats:

‘Trots imponerande benchmark, visar modellerna en kritisk beroende av mönsterigenkänning snarare än sann förståelse, som bevisas av misslyckanden med symboliska representationer och brott mot grundläggande egenskaper.

‘Uttrycklig regelprovision försämrar prestationen, vilket tyder på inbyggda arkitekturiska begränsningar. Dessa insikter avslöjar utvärderingsgap och betonar behovet av arkitekturer som kan hantera äkta matematiskt resonemang bortom mönsterigenkänning.’

Denna vecka dyker frågan upp igen, nu i ett samarbete mellan Nanjing University of Aeronautics and Astronautics och Universidad Politécnica de Madrid i Spanien. Med titeln Har Multimodala Stora Språkmodeller (MLLM) verkligen lärt sig att läsa av tiden på analogur?, undersöker den nya rapporten hur väl multimodala modeller förstår tidsavläsning.

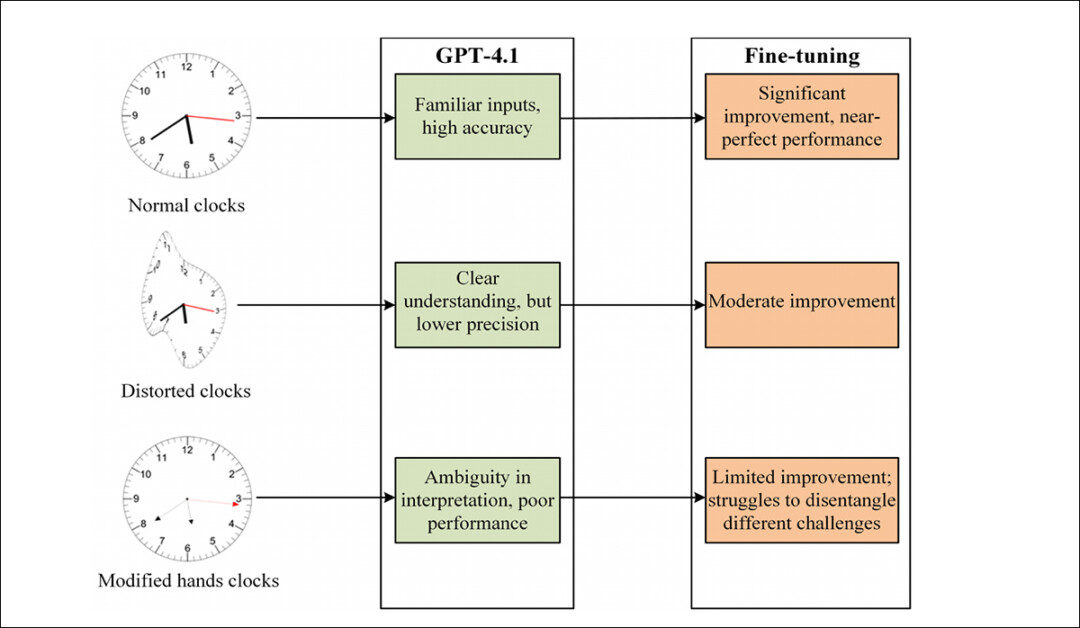

Även om forskningsframstegen endast täcks i allmänna detaljer i rapporten, etablerade forskarnas initiala tester att OpenAI:s GPT-4.1 multimodala språkmodell hade svårt att korrekt läsa av tiden från en mångfaldig samling urbilder, ofta med felaktiga svar även i enkla fall.

Detta pekar på ett möjligt gap i modellens träningsdata, vilket väcker behovet av en mer balanserad dataset, för att testa om modellen verkligen kan lära sig det underliggande konceptet. Därför skapade författarna en syntetisk dataset av analogur, som täcker alla möjliga tider, och undviker de vanliga bias som finns i internetbilder:

Ett exempel från forskarnas syntetiska analogur dataset, som användes för att finjustera en GPT-modell i det nya arbetet. Källa: https://huggingface.co/datasets/migonsa/analog_watches_finetune

Innan finjustering på den nya dataseten, misslyckades GPT-4.1 konsekvent med att läsa dessa ur. Efter viss exponering för den nya samlingen, förbättrades dess prestation – men endast när de nya bilderna liknade de som den redan hade sett.

När formen på uret eller stilen på händerna ändrades, föll noggrannheten skarpt; även små förändringar, som tunnare händer eller pilspetsar (högersta bilden nedan), var tillräckligt för att störa den; och GPT-4.1 kämpade ytterligare för att tolka Dali-liknande ‘smältande ur’:

Urbilder med standarddesign (vänster), förvrängd form (mitten), och modifierade händer (höger), tillsammans med de tider som returnerades av GPT-4.1 före och efter finjustering. Källa: https://arxiv.org/pdf/2505.10862

Författarna drar slutsatsen att nuvarande modeller som GPT-4.1 kan ha lärt sig uravläsning främst genom visuell mönsterigenkänning, snarare än något djupare koncept av tid, och hävdar:

‘[GPT 4.1] misslyckas när uret är deformerat eller när händerna ändras till att vara tunnare och ha en pilspets. Den genomsnittliga absoluta felet (MAE) i tidsuppskattningen över 150 slumpmässiga tider var 232,48 s för de ursprungliga ur, 1380,69 s när formen är deformerad och 3726,93 s när händerna ändras.

‘Dessa resultat tyder på att MLLM inte har lärt sig att läsa av tiden utan snarare memoriserat mönster.’

Tillräckligt med tid

De flesta träningsdataset bygger på skrapade webbilder, som tenderar att upprepa vissa tider – särskilt 10:10, en populär inställning i klockreklam:

Från den nya rapporten, ett exempel på förekomsten av ‘tio över tio’-tiden i analogur bilder.

Som ett resultat av detta begränsade urval av tider som avbildas, kan modellen endast se en smal variation av möjliga urkonfigurationer, vilket begränsar dess förmåga att generalisera bortom dessa upprepade mönster.

Vad gäller varför modellerna misslyckas med att korrekt tolka de förvrängda ur, förklarar rapporten:

‘Även om GPT-4.1 presterar exceptionellt bra med standardur bilder, är det förvånande att modifiering av urhänderna genom att göra dem tunnare och lägga till pilspetsar leder till en betydande minskning av dess noggrannhet.

‘Intuitivt kan man förvänta sig att den mer visuellt komplexa förändringen – en deformerad skala – skulle ha en större inverkan på prestationen, men denna modifiering verkar ha en relativt mindre effekt.

‘Detta väcker en fråga: hur tolkar MLLM ur, och varför misslyckas de? En möjlighet är att tunnare händer försämrar modellens förmåga att uppfatta riktning, vilket försvagar dess förståelse av spatial orientering.

‘Alternativt kan det finnas andra faktorer som orsakar förvirring när modellen försöker kombinera tim-, minuts- och sekundhänderna till en korrekt tidsavläsning.’

Författarna hävdar att att identifiera roten till dessa misslyckanden är nyckeln till att utveckla multimodala modeller: om problemet ligger i hur modellen uppfattar spatial riktning, kan finjustering erbjuda en enkel lösning; men om problemet härrör från en bredare svårighet i att integrera flera visuella signaler, pekar det på en mer grundläggande svaghet i hur dessa system bearbetar information.

Finjusterings tester

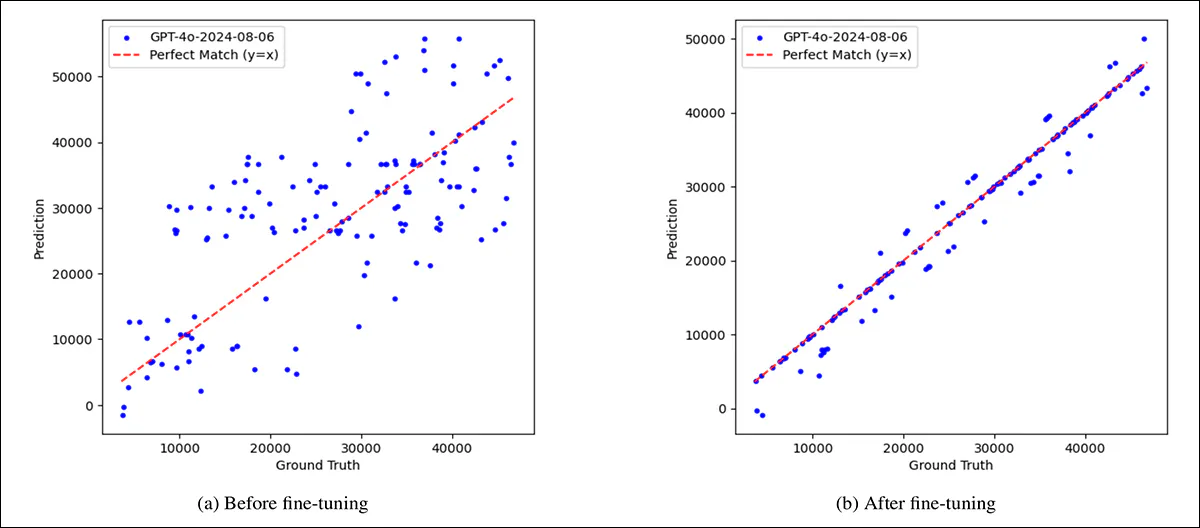

För att testa om modellens misslyckanden kunde övervinnas med exponering, finjusterades GPT-4.1 på den ovannämnda och omfattande syntetiska dataseten. Innan finjustering, var dess förutsägelser utspridda, med betydande fel över alla typer av ur. Efter finjustering på samlingen, förbättrades noggrannheten skarpt på standardur ansikten, och, i mindre utsträckning, på deformerade.

Men ur med modifierade händer, såsom tunnare former eller pilspetsar, fortsatte att producera stora fel.

Två distinkta misslyckande lägen uppstod: på normala och deformerade ur, missbedömde modellen vanligtvis riktningen på händerna; men på ur med ändrade handstilar, förväxlade den ofta funktionen av varje hand, och missbedömde tim- för minut- eller minut- för sekund-händer.

En jämförelse som visar modellens initiala svaghet, och de partiella vinster som uppnåddes genom finjustering, som visar förutsagd mot faktisk tid, i sekunder, för 150 slumpmässigt valda ur. Till vänster, innan finjustering, är GPT-4.1:s förutsägelser utspridda och ofta långt ifrån de korrekta värdena, indikerade av den röda diagonala linjen. Till höger, efter finjustering på en balanserad syntetisk dataset, ligger förutsägelserna mycket närmare sanningen, även om vissa fel kvarstår.

Detta tyder på att modellen hade lärt sig att associera visuella egenskaper som handtjocklek med specifika roller, och kämpade när dessa signaler ändrades.

Den begränsade förbättringen på ovanliga design väcker ytterligare tvivel om huruvida en modell av detta slag lär sig det abstrakta konceptet av tidsavläsning, eller enbart förfinar sin mönsterigenkänning.

Handtecken

Så, även om finjustering förbättrade GPT-4.1:s prestation på konventionella analogur, hade den mycket mindre inverkan på ur med tunnare händer eller pilspetsar, vilket väcker möjligheten att modellens misslyckanden härrörde mindre från abstrakt resonemang och mer från förvirring över vilken hand som var vilken.

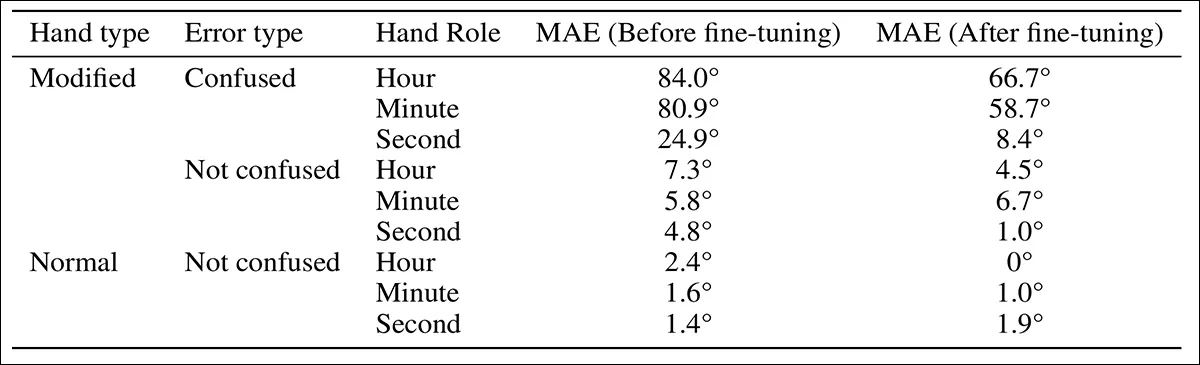

För att testa om noggrannheten kanske kunde förbättras om denna förvirring togs bort, utfördes en ny analys av modellens förutsägelser för ‘modifierad-hand’-dataseten. Utdata delades in i två grupper: fall där GPT-4.1 korrekt identifierade tim-, minuts- och sekundhänderna; och fall där den inte gjorde det.

Förutsägelserna utvärderades för Medelabsolut fel (MAE) före och efter finjustering, och resultaten jämfördes med dem från standardur; vinkelfel mättes också för varje hand med urans position som baslinje:

Feljämförelse för ur med och utan handrollsförvirring i den modifierade-hand-dataseten före och efter finjustering.

Förvirring över handrollerna ledde till de största felen. När GPT-4.1 förväxlade timhanden för minuthanden eller vice versa, var de resulterande tidsuppskattningarna ofta långt ifrån sanningen. I kontrast var felen orsakade av att missbedöma riktningen på en korrekt identifierad hand mindre. Bland de tre händerna visade timhanden den högsta vinkelfelen före finjustering, medan sekundhanden visade den lägsta.

Vinkelfel per handtyp för förutsägelser med och utan handrollsförvirring, före och efter finjustering, i den modifierade-hand-dataseten.

För att fokusera på riktningfel ensam, begränsades analysen till fall där modellen korrekt identifierade varje hands funktion. Om modellen hade internaliserat ett allmänt koncept av tidsavläsning, borde dess prestation på dessa exempel ha matchat dess noggrannhet på standardur. Det gjorde den inte, och noggrannheten förblev märkbart sämre.

För att undersöka om handform störde modellens känsla av riktning, kördes ett andra experiment: två nya dataset skapades, var och en innehållande sextio syntetiska ur med endast en timhand, som pekade till en annan minutmärke. En uppsättning använde den ursprungliga handdesignen, och den andra den ändrade versionen. Modellen bad att namnge märket som handen pekade på.

Resultaten visade en liten minskning av noggrannheten med de modifierade händerna, men inte tillräckligt för att förklara modellens breda misslyckanden. En endaste ovanlig visuell funktion tycktes kunna störa modellens övergripande tolkning, även i uppgifter den tidigare hade presterat bra.

Översikt av GPT-4.1:s prestation före och efter finjustering över standard-, deformerade- och modifierade-hand-ur, som betonar ojämna vinster och bestående svagheter.

Slutsats

Även om rapportens fokus kan tyckas trivial vid första anblicken, är det inte särskilt viktigt om vision-språk-modeller någonsin lär sig att läsa av analogur med 100% noggrannhet. Det som ger arbetet vikt är dess fokus på en djupare återkommande fråga: om att mätta modeller med mer (och mer varierad) data kan leda till den typ av domänförståelse som människor förvärvar genom abstraktion och generalisering; eller om den enda livskraftiga vägen är att översvämma domänen med tillräckligt med exempel för att förutse varje trolig variation vid inferens.

Båda vägarna väcker tvivel om vad nuvarande arkitekturer verkligen kan lära sig.

Publicerad första gången måndagen den 19 maj 2025