Andersons vinkel

AI Vill Hellre Läsa Boken Än Titta På Filmen

Det är förvånansvärt svårt att få AI-modeller att titta på och kommentera faktiskt videoinnehåll, även om de är utformade för uppgiften. De är mer intresserade av det skrivna ordet.

Om du någon gång har försökt att ladda upp en liten videoklipp till ChatGPT, eller till en liknande populär vision/språkmodell, kan du ha blivit förvånad över att inse att de inte faktiskt kan tolka video. Medan modeller som ChatGPT-4o+ kan analysera enskilda ramar – i form av bilder, såsom JPEG och PNG – föredrar de att användaren extraherar sina egna ramar och laddar upp dem som bilder (vilka de är beredda att kommentera).

I fallet med OpenAI GPT-serien kan man, ganska mödosamt, extrahera en komplett serie ramar från en videoklipp och mata dem till ChatGPT, för ändamål som till exempel generering av en AI-skapad berättelse för videon:

![Bilder och kod från en OpenAI-tutorial om parsing av flera extraherade ramar för att utveckla en AI-genererad kommentar för en videoklipp. [ Källa ] https://cookbook.openai.com/examples/gpt_with_vision_for_video_understanding](https://www.unite.ai/wp-content/uploads/2025/10/openai-gpt-frame-parsing.jpg)

Bilder och kod från en OpenAI-tutorial om parsing av flera extraherade ramar för att utveckla en AI-genererad kommentar för en videoklipp. Källa

Men det är användaren som måste göra omvandlingen från video till ramar, antingen genom att anropa funktioner i en större rutin, som i exemplet ovan, eller extrahera ramarna med FFMPEG eller olika gratis och betalda videoredigeringslösningar.

Till en viss grad, kanske till och med en stor del, beror begränsningarna för videoanalys i storskaliga produkter som ChatGPT på resursanvändning: att bara utrusta en AI-instans med ett urval av de mest populära videokoderna och att tilldela beräkningsresurser till den diskkrävande och CPU-begränsande processen att extrahera är ingen liten övervägning, om hundratals miljoner användare bestämmer sig för att börja använda dessa faciliteter varje dag.

Dessutom kan temporal analys måla upp en mycket annorlunda bild än en enda ram (tänk dig någon som går in i ett hus i ett glatt humör och sedan upptäcker en kropp); därför är det att överväga hela den temporala “kontrollsumman” av även en kort videoklipp en krävande och resurskrävande uppgift – samt ett specialiserat område inom forskningslitteraturen, till exempel med den pågående utvecklingen av ramverk som Optical Flow – som i princip “vecklar ut” en längd av video så att den kan betraktas och ageras på som om den vore ett statiskt dokument:

![Optiska flödesdiagram visar hur rörelse spåras över ramar i en videosekvens, med gröna vektorer som visar rörelseriktning och intensitet. Dessa kartor tillhandahåller den temporala kontinuitet som behövs för VLM och kan också fungera som strukturerade guider i VFX-arbetsflöden. [ Källa ] https://www.researchgate.net/figure/Optical-flow-field-vectors-shown-as-green-vectors-with-red-end-points-before-and-after_fig6_290181771](https://www.unite.ai/wp-content/uploads/2025/10/optical-flow.jpg)

Optiska flödesdiagram visar hur rörelse spåras över ramar i en videosekvens, med gröna vektorer som visar rörelseriktning och intensitet. Dessa kartor tillhandahåller den temporala kontinuitet som behövs för VLM och kan också fungera som strukturerade guider i VFX-arbetsflöden. Källa

Att Nöja Sig Med Kliffens Anteckningar

Trots allt, eftersom modeller som Google’s Notebook LM och de senaste ChatGPT-entrierna kan läsa associerad metadata (dvs. inbäddad textinnehåll som kontextualiserar videon på något sätt), tillåter de inte videoöverföringar; och ibland kommer de sogar att försöka tolka en video som inte har någon sådan data.

I följande fall laddade jag upp en 6-sekunders slumpmässig klipp från den italienska filmen Guds Hand (2021) till NotebookLM, och såg till att klippen innehöll noll användbar text, antingen i metadata eller i filnamnet.

NotebookLM gick sedan vidare och hallucinerade omfattande material som var helt orelaterat till videon*, komplett med en meningslös och orelaterad femminuters samtal:

En vardaglig stund i en 6-sekunders klipp från en italiensk film är vilt missuppfattad av NotebookLM. Källa: Google NotebookLM

Även om Notebook, liksom ChatGPT, kan acceptera en YouTube-video som indata, kommer de bara att göra det om videon har en tolkningsbar textlagerannotering och/eller undertexter (inte rasteriserade undertexter som är brända in i videon).

På detta sätt har det hårda arbetet med att faktiskt titta på och lyssna på videons innehåll och utföra semantisk tolkning av det (en laglig nödvändighet för YouTube, på grund av dess upphovsrättsliga skyddsåtgärder, och dess kommande identitetsskyddssystem), har gjorts i efterhand efter användaruppladdningen, när och när klippen kunde tilldelas nödvändiga bearbetningsresurser.

Riktig video tolkning är dyrt och utmattande, och det visar sig att även modeller som har utbildats specifikt för att utföra denna uppgift hellre läser text än faktiskt tittar på video.

TL;DW

Detta, enligt en ny artikel från Storbritanniens universitet i Bristol, med titeln En Video Är Inte Värd En Tusen Ord, där de två författarna drar slutsatsen att nuvarande state-of-the-art vision language modeller (VLM) – modeller som specifikt är avsedda att kunna analysera video på ett mer ansträngt sätt, och att delta i video frågebesvarande (VQA) – också standardiserar till textbaserad information närhelst de kan.

När de gavs både rörliga bilder och skrivna frågor och flervalsalternativ, fann artikelförfattarna att modellerna vanligtvis baserade sina val på mönster i texten, snarare än något som händer på skärmen – i många fall presterade de lika bra, även när frågan togs bort helt.

I vad som verkar vara en vanlig form av genvägar eller fusk, var det som betydde mest för de flesta modellerna att kunna upptäcka mönster i de möjliga svaren; först när uppgiften gjordes svårare, genom att lägga till fler svarsalternativ, började AI:erna uppmärksamma videon.

Författarna gav VQA-tester under en rad olika förhållanden till sex VLM-modeller med olika kontextlängder, på fyra lämpliga datamängder; och fann att resultaten indikerade modellernas beroende av text över videoinnehåll.

![Exempel från studien som visar hur en videoanalysmodell väger vad den ser mot vad den läser. Klippen visar en person som väver bambu, men modellen tilldelar mycket mer vikt åt den skrivna frågan och svars-texten än till själva video-ramarna. Blå höjdpunkter markerar element som stöder det valda svaret, medan röda markerar de som drar det i motsatt riktning, vilket visar hur modellens resonemang centrerar sig på formuleringen snarare än på de rörliga bilderna. [Källa] https://arxiv.org/pdf/2510.23253](https://www.unite.ai/wp-content/uploads/2025/10/evaluation.jpg)

Exempel från studien som visar hur en videoanalysmodell väger vad den ser mot vad den läser. Klippen visar en person som väver bambu, men modellen tilldelar mycket mer vikt åt den skrivna frågan och svars-texten än till själva video-ramarna. Blå höjdpunkter markerar element som stöder det valda svaret, medan röda markerar de som drar det i motsatt riktning, vilket visar hur modellens resonemang centrerar sig på formuleringen snarare än på de rörliga bilderna. Källa

Metod

För att förstå hur mycket varje del av indata (video, text, etc.) bidrar till modellens beslut, använder den nya studien en metod från spelteori som kallas Shapley-värden. Ursprungligen utformad för att rättvist fördela en utbetalning mellan spelare i en koalition, tilldelar Shapley-värden kredit till varje “spelare” baserat på deras individuella påverkan.

Effektivt sett är “spelarna” i detta scenario antingen video-ramar eller textkomponenter (annoteringar, undertexter, undertext, etc.) i en VQA-uppgift; och “utbetalningen” är modellens slutliga svar. Genom att systematiskt testa vad som händer när varje del läggs till eller tas bort, avslöjar tekniken hur viktigt varje element var för att få det valda svaret.

I fallet med den nya studien anpassades Shapley-värden för att hantera blandade modaliteter, med video- och textkomponenter behandlade separat, och deras varierande inflytande på modellernas utdata mättes, vilket visade om videoinnehållet verkligen tolkades eller om skrivna ledtrådar användes som genvägar.

Mätvärden

Två enkla mätvärden definierades för att jämföra hur mycket varje modalitet (dvs. video, fråga eller svar) bidrog till modellens beslut: Modalitetsbidrag mäter hur mycket av den totala förklaringen som kom från varje typ av indata; här summeras alla tillgängliga Shapley-värden och den andel som tillhör varje modalitet beräknas som en procentandel av den totala.

Som en andra, Per-funktionbidrag korrekt för det faktum att vissa modaliteter, som video, innehåller många fler funktioner än andra. Istället beräknas det genomsnittliga Shapley-värdet för varje funktion, och dessa genomsnitt jämförs för att bestämma vilken modalitets inflytande som är dominerande.

Data Och Tester

Författarna testade tillvägagångssättet på sex VLM-modeller med olika egenskaper utformade för att säkerställa att testernas principer var allmänt tillämpliga och generaliserbara. Därför valdes modellerna ut för olika kontextlängder, olika åldrar (dvs. hur länge sedan ramverket släpptes) och olika arkitekturkonfigurationer.

Tävlande var FrozenBiLM; InternVideo; VideoLLaMA2; VideoLLaMA3; LLaVa-Video (som utnyttjar Qwen2); och LongVA (även med Qwen2).

Med samma mål att ha en varierad variation valdes de fyra mål-datamängderna EgoSchema, en VQA-datamängd utformad för att vara omöjlig att slutföra utan fullständig visning av de associerade videorna; HD-EPIC, en kök-fokuserad datamängd som innehåller några ovanligt långa videor; MVBench, en kuraterad samling bidrag från andra datamängder; och LVBench, som ställer VQA-frågor för mycket långa videor.

Från dessa utvecklade författarna 60 frågor – tio från varje frågetyp.

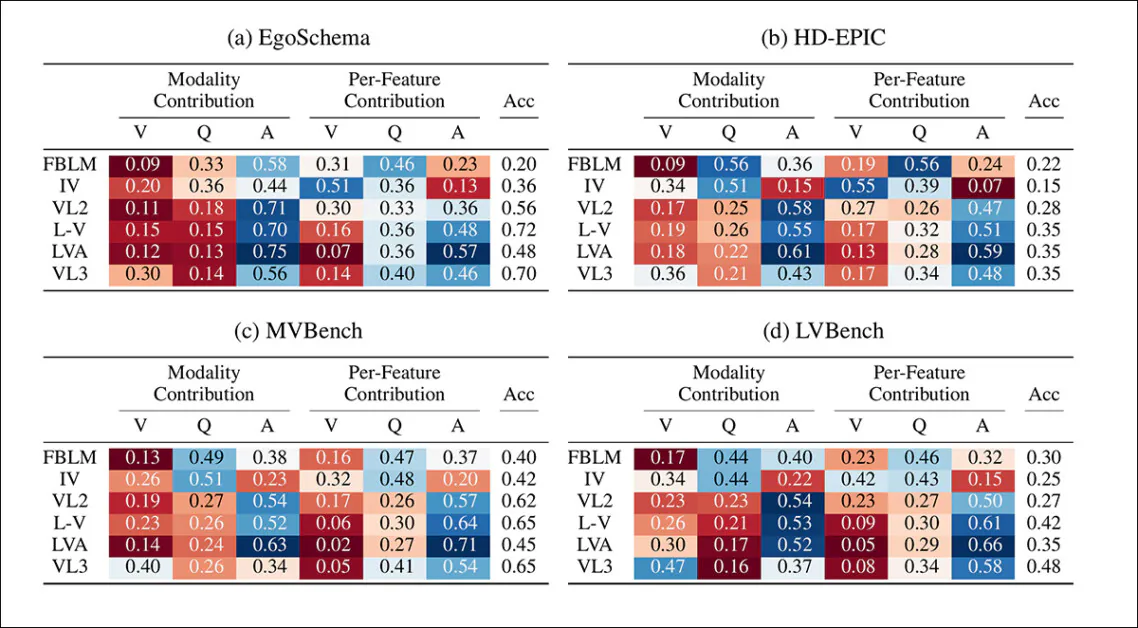

Bidragsmätningarna gjorde det tydligt att de flesta modellerna förlitade sig mindre på videon än på texten, särskilt när de bedömdes ram för ram. Även där videon gjorde en rimlig visning i den totala bidraget, var dess per-funktion påverkan ofta minimal, vilket antydde att även om modellen använde videon i aggregerad form, så uppmärksammade den inte enskilda ramar. VideoLLaMA3 var den främsta avvikaren här, med en tyngre visuell beroende, särskilt på de längre sekvenserna i LVBench:

Modalitetsbidrag (MC) och per-funktionbidrag (PFC) poäng över modeller och datamängder, som visar den relativa vikten av video (V), fråga (Q) och svarsinmatningar (A). Kallare färger indikerar starkare bidrag; varmare färger indikerar svagare eller försumbara inflytande. Över de flesta inställningar är språk tydligt dominerande, med video ofta åsidosatt – särskilt i per-ram påverkan.

Som för texten tenderade frågan att betyda mer än svaret, särskilt i starkare modeller. Detta var mest uppenbart i datamängder som EgoSchema, där frågorna var längre och mer naturalistiska, medan svaren var korta och ibland schematiska. MVBench vände detta något, eftersom dess binära svarsstruktur inflaterar den uppenbara vikten av svarstoken.

Över alla modeller och datamängder var dock synen konsekvent åsidosatt, med språk som gjorde det mesta av arbetet.

Artikeln fastställer:

‘[För] långa kontextmodeller, visar video väsentligt reducerade bidrag, vilket betyder att per-ram är Shapley-värdena mycket mindre än deras textfunktion motsvarigheter.

‘Video som en hel modalitet är fortfarande tydligt relevant, men detta är bevis för att Shapley-värdena för dess enskilda ramar är mer centrerade kring noll, och att modellens uppmärksamhet på dem är mycket mindre styrd än för texten.’

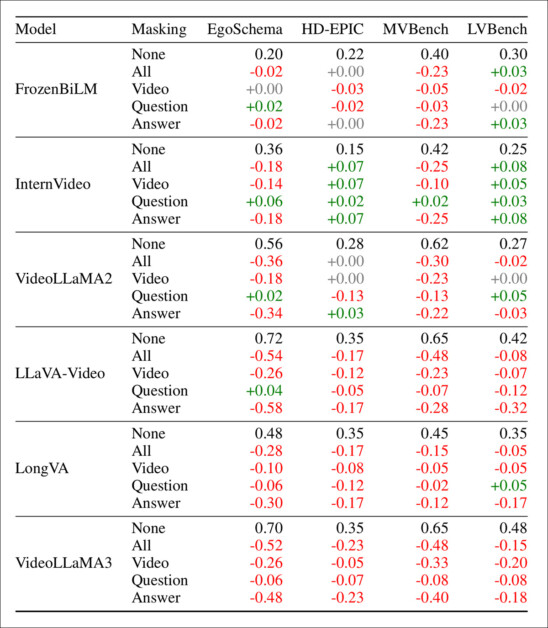

För att testa hur varje del av inmatningen (video, text, etc.) bidrar till modellens noggrannhet, genomförde forskarna ytterligare tester med maskning – medvetet dölja en eller flera delar av inmatningen och se hur mycket modellens noggrannhet förändras som ett resultat.

Om prestandan sjunker kraftigt när en viss inmatning tas bort, är den inmatningen troligen viktig; om modellen presterar lika bra, tyder det på att den saknade delen inte var starkt beroende av.

I denna mening är maskningstester en form av iterativ ablationsstudie.

Prestandapåverkan av maskning av video-, fråga- eller svarsinmatningar över fyra VQA-benchmark. Poängen visar förändring från den omaskerade baslinjen. Röd betyder lägre noggrannhet, grön högre. Modellerna behöll ofta höga poäng utan video, men förlorade mer när (text) svaret togs bort. Frågan kunde vanligtvis maskeras med minimal effekt.

Resultaten (visualiserade ovan) indikerar att svaren (textsvaren i de flervalsdata) bär den största vikten över hela linjen. Att maska svaret orsakade vanligtvis den största minskningen av noggrannhet, ofta reducerande modellerna till nästan slumpmässig prestanda.

Men att maska frågan hade vanligtvis mycket mindre effekt, vilket stöder den tidigare upptäckten att modeller ofta underskattar frågan.

I vissa fall förbättrades noggrannheten när frågan togs bort, vilket tyder på att modellerna ibland bara matchade svar till textmönster snarare än att korrekt utvärdera frågan.

Modellerna varierade också i sin beroende av video: vissa behöll rimlig noggrannhet utan det, vilket ytterligare bekräftar den begränsade bidraget av video-funktioner i många nuvarande konfigurationer.

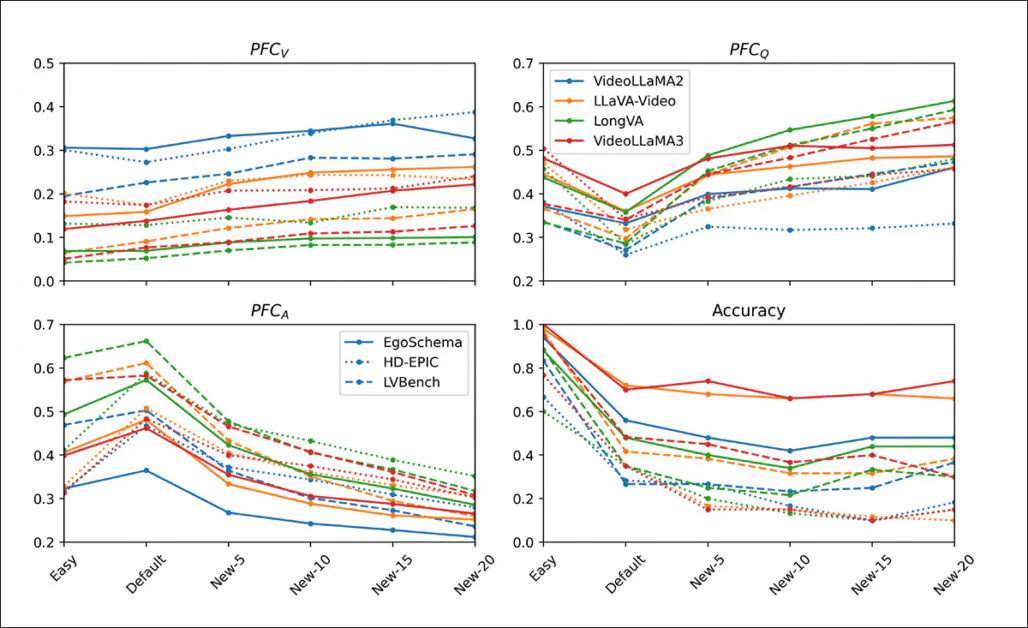

Författarna testade sedan om modellerna kunde tvingas förlita sig på video genom att lägga till extra fel svar till de flervalsalternativen.

När distraktorerna var lätta och återanvändes från andra frågor, förbättrades prestandan, eftersom modellerna matchade textmönster utan mycket resonemang. Men med tio eller fler orelaterade svar började de förlita sig mer på videon och frågan:

Per-funktion bidrag och noggrannhet för video-, fråga- och svarsinmatningar, när extra fel svar läggs till varje VQA-test, som visar att ökningen av antalet distraktorer minskar textdominans och ökar den relativa påverkan av visuella och frågefunktioner.

För VideoLLaMA3 minskade maskering av videon noggrannheten med 40 % på EgoSchema och 15 % på LVBench, vilket tyder på att en enkel ökning av svarsantalet kan flytta modellerna bort från textgenvägar och mot äkta multimodalt resonemang.

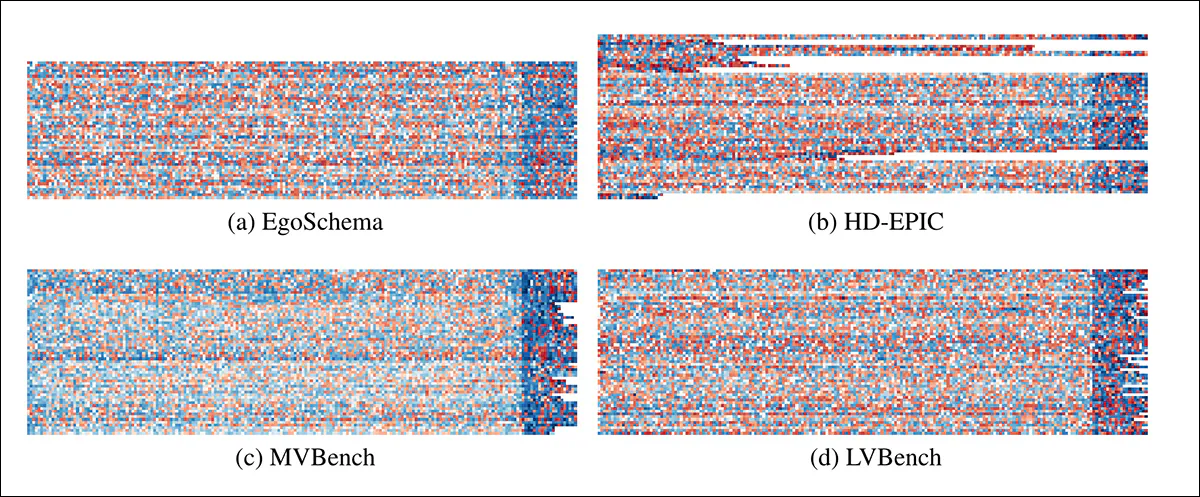

Forskarna undersökte också hur attribut fördelas över inmatningar, och nedan ser vi värmebilder av Shapley-värden för varje modellinmatning:

Shapley-värde-värmebilder för fyra datamängder, där varje rad visar en VQA-tupel, och varje kolumn en enda funktion. Video-funktioner visas till vänster, följt av text. De mycket starkare värdena i de (röda) textregionerna bekräftar att modellerna förlitar sig mycket mer på språk än video.

I kommentar till resultaten ovan, säger författarna:

‘Shapley-värdenas storlek är mycket större mot högersidan av varje värmebild, som representerar fråge- och svarsattribut. Denna tydliga gräns är där video-ramarna slutar och textfunktionerna börjar, vilket visar att video-modalitetsbidraget är mycket mindre än fråga/svar. ‘

I sammanfattning, över alla datamängder, är värdena mycket starkare mot textens sida av spektrumet, vilket tydligt indikerar att modellerna förlitar sig mycket mer på språk än visuella ledtrådar. Även där videon används är bidraget spritt tunt över många ramar, ofta utan något konsekvent mönster.

Nedan ser vi en annoterad exempel från EgoSchema. De 16 mest “viktiga” ramarna valdes med hjälp av Shapley-värden och färgades enligt deras inflytande, med blå som indikerar en positiv bidrag och röd en negativ:

Shapley-attribut för ett enda EgoSchema-exempel, som visar de 16 mest inflytelserika ramarna och alla textinmatningar. Video-bidragen är minimala jämfört med text, som dominerar modellens resonemang. Blå och röd indikerar positiv och negativ påverkan på det valda svaret.

Resultatet är att nästan varje ram har endast svag påverkan jämfört med orden i frågan och svaren. Visuella ledtrådar är glesa och inkonsekventa, medan substantiv som “stol” och “stängsel” styr modellen mot det korrekta valet – eller bort från det, beroende på sammanhang.

Slutsats

Den som någonsin har sysslat med video-redigering eller video-analys kommer att veta hur resurskrävande dessa processer är, och förstå varför företag som tolkar miljontals AI-baserade förfrågningar per dag inte kan unna sig att låta användare köra ad hoc redigerings- och tolkningsprocesser för video.

En sak att komma ihåg i detta avseende är att nästan varje API-AI-gränssnitt du någonsin kommer att prova (med den möjliga undantaget av en helt ny och kortlivad demo till stöd för ny vetenskaplig forskning) är utformat för att uppfylla användarnas önskemål på den lägsta möjliga nivån av resursutgifter.

Det betyder att förlita sig på befintlig metadata från användar tillhandahållen data eller RAG-återställningar, om möjligt; och extrahera (om absolut nödvändigt) metadata för mer tolkningsbara format som PDF, dokument och enskilda bilder.

Vad som inte är på bordet är att köra din uppladdade video genom CLIP eller den senaste YOLO-versionen, eller genom någon kraftslukande och tidskrävande VLM som faktiskt kan identifiera vad som finns i ramarna och förstå vad som händer i den tillhandahållna videon, med hänsyn till temporalitet.

Men detta betyder inte att fenomenen som den aktuella artikeln dokumenterar nödvändigtvis följer av snåla arkitektoniska tillvägagångssätt. Författarna observerar att text dominerar state-of-the-art multimodala träningsparadigm i alla fall, vilket tyder på att “visuellt språk” antingen är mindre utvecklat, mindre viktigt eller informativt inom ett multimodalt sammanhang, eller (åtminstone för tillfället) mindre väl förstått,

* Intressant nog verkar materialet som NotebookLM kom med antingen vara helt originalt eller totalt oindexerat av Google, eftersom jag inte kan hitta några webbresultat som kunde ha smugit in i träningsdata och utlöst denna utdata.

Publicerad första gången fredagen den 31 oktober 2025; redigerad 14:20 för formatering