Andersons vinkel

AI kan hjälpa dig nå en riktig person snabbare

Ny forskning visar att öppen källkods ChatGPT-liknande AI-uppsättningar potentiellt kan dirigera samtal till rätt person i ett callcenter med hjälp av naturligt språk, utan att följa irriterande menyalternativ som skiljer sig åt varje vecka, och som verkar vara avsiktligt hindrande.

Att försöka nå en riktig person på ett callcenter kan vara en frustrerande upplevelse, på grund av behovet att navigera genom flera valmöjligheter i långsam takt – ofta utan säkerhet om vilket av alternativen som passar för ditt ärende. Om ingen av dem fungerar, tenderar erfarna användare att använda knep och lösningar för att få tillgång till en mänsklig rådgivare av något slag, och för att komma ut ur ‘alternativhelvetet’. Många av oss kommer att känna igen detta som en mer eller mindre ‘stridande’ och användarvänlig upplevelse.

Förväntat nog är callcenter i frontlinjen för förstärkning eller ersättning av AI-system; och, trots en försiktig approach som uppmanas från vissa kvartaler, kvarstår callcenter-AI-automatisering som lågt hängande frukt för teknikhuvuden, och för utsikten till AI-baserad innovation som kan erbjuda ovanligt tidig avkastning.

Stängd butik

Men det finns några områden där öppen källkodsprinciper och fritt tillgängliga data sällan tillämpas eller är tillgängliga, och detta är ett av dem. Det är logiskt: varje företag som är intresserat av att automatisera sina kundresponsystem kommer att ha begränsat eller noll intresse för att dela data som driver deras hårda vunna insikter, deras metoder eller deras företags IP.

För det första skulle att dela dessa resurser kosta dem en fördel gentemot konkurrenter; viktigare, med tanke på hur benägna AI-i-loopen-system är att avslöja privilegerad information, är det juridiskt riskabelt.

Detta har lett till att ett antal väl investerade aktörer har utvecklat AI-assisterade callcenter-responsystem oberoende av varandra (förmodligen med en del oundviklig redundans i arbetet); och till en ökning av B2B- startups och etablerade aktörer som söker tillgodose den växande efterfrågan på AI-drivna kundresponsförmågor.

En PolyAI-röstassistent öppnar en kundtjänst för det fiktiva företaget ‘Augusta Lawn Care’, med hjälp av stora mängder träningskonversationer för att automatisera svar genom befintlig callcenter-infrastruktur. Källa

Dessutom har kapplöpningen för att ta bort frustrationen av att navigera i ett callcenter-labyrint har visat sig vara en sporre till forskningsinsatser – även om de flesta sådana publikationer tenderar att ske utanför Arxiv och andra öppna forskningspublikationsnätverk, i enlighet med den allmänt hemliga naturen av Interactive Voice Response (IVR)-utveckling.

I stället är forskning, data och affärsintelligens relaterad till AI-automatisering av kundresponsystem alla svartsjukt bevakade, med mycket få öppen källkodsalternativ tillgängliga – även om användningen av FOSS-system och data erbjöd ett lagligt alternativ, vilket är tvivelaktigt.

Lokal samtal

Med detta i åtanke är det uppfriskande att se en ny artikel från Colombia som försöker bryta IVR ut ur dess företagsvalv, åtminstone lite. Den nya artikeln, en kort och koncis titel som heter Beyond IVR Touch-Tones: Customer Intent Routing using LLMs, kommer från en forskare vid Universidad Distrital Francisco José de Caldas i Bogotá, och hävdar att det är det första icke-stängda projektet som använder Large Language Models (LLMs) för att generera ett fungerande schema för ett Customer Intent Routing (CIR)-system.

I stället för att försöka få tillgång till riktiga kunddata eller proprietära menuträd, genererar det nya projektet alla komponenter från scratch med hjälp av tre AI-modeller: en för att uppfinna ett realistiskt callcenter-menyalternativ; en annan för att simulera hundratals kundsamtal; och en tredje för att fungera som chatboten, som försöker dirigera dessa samtal till rätt destination.

Resultatet är en fullständigt syntetisk men övertygande testbädd, som innehåller ett fiktivt telekommunikationsföretag, tillsammans med 920 distinkta användarfrågor, vilket möjliggör att experimentet kan undvika juridiska risker samtidigt som det undersöker hur väl nuvarande AI kan tolka vaga, smutsiga tal, och fortfarande ansluta samtalaren till rätt person.

Testerna visar att systemets schema kan matcha fria former av kundsamtal till den korrekta callcenter-destinationen med upp till 89,13% noggrannhet, särskilt när det ges ‘platta’ menyalternativ i stället för verbala beskrivningar (mer om detta senare).

Studien fann också att när samtalare använde mer informell eller varierad språk, begick AI-fler fel; men att några av dessa misstag inträffade inte för att AI missförstod, utan för att telefonmenyn i sig var förvirrande.

![Exempel på kundinteraktioner, delade som en del av det nya projektet. [Källa] https://figshare.com/articles/dataset/Beyond_IVR_Touch-Tones_Customer_Intent_Routing_using_LLMs/30118690](https://www.unite.ai/wp-content/uploads/2025/10/figshare-examples-data.jpg)

Exempel på kundinteraktioner, delade som en del av det nya projektet. Källa

Data för projektet har gjorts tillgängliga offentligt.

Metod

Den första modellen i den tredelade ansatsen skapar en detaljerad telefonmeny för ett fiktivt telekommunikationsföretag; den andra genererar unika kundsamtal – några enkla, andra omformulerade eller mer informella – för att simulera hur människor faktiskt talar när de ringer för att få hjälp. I detta avseende genererades 920 exempel för projektet.

Den tredje modellen fick uppgiften att ansluta varje samtal till den korrekta avdelningen, baserat enbart på meddelandet och en version av menyn. Detta schema möjliggjorde att experimentet kunde vara fullständigt upprepningsbart, samtidigt som det undvek behovet av riktiga kunddata eller exponering av kundinformation:

![De tre systemen som valdes för den tredelade ansatsen. [Källa] https://arxiv.org/pdf/2510.21715](https://www.unite.ai/wp-content/uploads/2025/10/table-1-5.jpg)

De tre systemen som valdes för den tredelade ansatsen. Källa

De tre modellerna som användes var gpt-3.5-turbo; gpt-4o-mini; och gpt-4.1-mini.

För att simulera en övertygande kundtjänstmiljö var det nödvändigt att syntetisera en komplex telefonmeny från scratch. På grund av bristen på relevanta datamängder, fick gpt-3.5-turbo-modellen i uppgift att generera en fullständig, fler grenar-struktur för ett fiktivt telekommunikationsföretag.

Varje gren konfigurerades för att representera serviceområden som facturering, tekniskt stöd, konto hantering och nya tjänster, med realistiska underalternativ och varierande djup över trädet. Från denna artificiella menyn skapades två versioner för senare testning: en som en ren texthierarki, för att efterlikna hur en människa skulle läsa hela menyn; och en annan som en lista med slutpunkter, var och en med sin egen sekvens av knapptryckningar.

Detta möjliggjorde att systemet kunde testas både på en detaljerad och på en ‘avskalad’ version av routing-utmaningen:

Två versioner av telefonmenyn tillhandahölls till AI: en detaljerad texthierarki och en förenklad lista med direkta menyalternativ, för att jämföra hur väl varje format stödde routing av samtalare till rätt plats.

För att skapa kundsamtalen som behövdes för testning, användes en andra språkmodell för att producera en uppsättning originalklagomål eller förfrågningar, med tio unika exempel gjorda för varje menyslutpunkt.

Var och en av dessa utvidgades sedan till flera omformulerade versioner, för att efterlikna det område av sätt som riktiga samtalare kan uttrycka sina problem, och introducerade förändringar i längd, ton och till och med mindre fel eller ‘fyllnadsord’.

De 920 kundsamtal som genererades från början var avsedda att testa systemets precision och för att simulera oförutsägbarheten i riktiga samtal.

Den tredje etappen testade hur exakt den tredje modellen kunde kartlägga varje kundsamtal till den korrekta menyslutpunkten, baserat på de två olika sätten att presentera IVR-systemet (se bild ovan).

I den första versionen gavs AI en fullständig, beskrivande översikt av telefonträdet, med varje gren och underalternativ utlagt i textform. I den andra versionen såg den bara en lista med slutdestinationer, var och en kopplad till en knappsekvens.

Målet var att se om en avskalad version av menyn skulle göra det lättare för modellen att bestämma var varje samtal skulle gå. I båda fallen fick systemet ett meddelande i taget och fick i uppgift att returnera bara vägen, utan extra ord eller förklaring, för att underlätta automatisk poängsättning.

Isolering

För att undvika att förorena testresultaten, hölls varje modell isolerad från de andra: telefonmenyn utarbetades av den första modellen, men sedan finaliserades manuellt, så att den förblev okänd för de andra systemen.

Kundsamtalen genererades sedan separat av gpt-4o-mini, med hjälp av endast namnen på slutpunkterna, och utan tillgång till menysstrukturen. Slutligen såg gpt-4.1-mini, som hanterade routing, bara texten av menyn och de inkommande meddelandena, och hade ingen inblandning i att skapa någon av dem.

Mätvärden

För att mäta hur väl routing-systemet fungerade, användes två standardmätvärden: noggrannhet definierades som procentandelen fall där modellen returnerade den exakta korrekta vägen (såsom 1‑2‑3). För att isolera platsen för fel, genererades också förvirringsmatriser*, som visade hur ofta varje väg förväxlades med andra. Utvärderingarna utfördes i Python med hjälp av pandas och scikit-learn-biblioteken.

Resultat

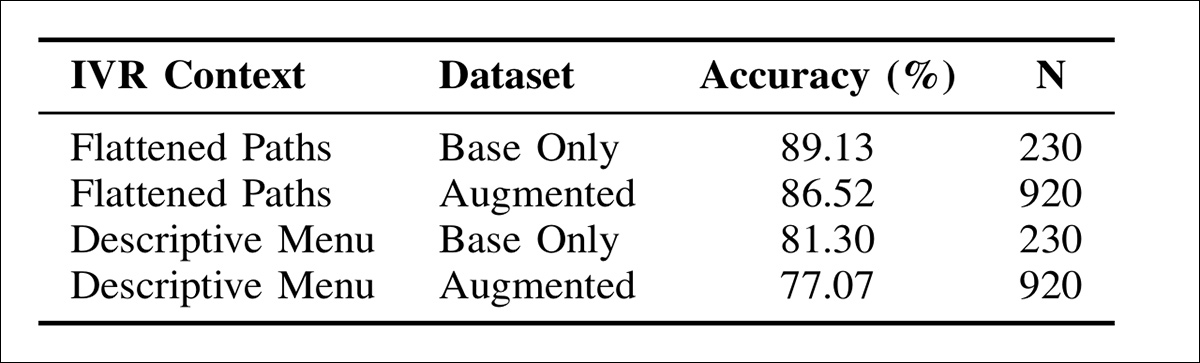

I testerna berodde modellens noggrannhet starkt på hur telefonmenyn presenterades: när den gavs den platta listan med menyslutpunkter, nådde systemet 89,13% noggrannhet på den enklare datamängden, jämfört med 81,30% när den använde den fullständiga beskrivande versionen av menyn:

Routing-noggrannhet för den tredje (LLM3)-modellen, över olika prompt-format och datamängdtyper, vilket indikerar att platta menyslutpunkter konsekvent överträffade hierarkiska beskrivningar, och att noggrannheten minskade något när indata utökades med omformulerade eller informella språk.

Denna mönster gällde också för den större, lingvistiskt varierade datamängden, där den platta versionen presterade bättre, med 86,52% jämfört med 77,07% för den beskrivande formatet.

Dessa resultat, noterar artikeln, tyder på att enklare, lista-baserade promptrar hjälpte modellen att matcha frågor mer tillförlitligt än långa hierarkiska beskrivningar.

Noggrannheten minskade också något när omformulerade och informella versioner av kundsamtal introducerades, vilket indikerar att större variation förbättrade realismen, men också gjorde klassificeringen svårare.

Artikeln avslutas:

‘Våra resultat visar att LLM:er dirigerar avsikter mer exakt när de ges platta IVR-slutpunkter (upp till 89,13) än verbala menysbeskrivningar (så lågt som 77,07%), vilket tyder på att koncisa, strukturerade promptrar minskar brus och överensstämmer bättre med routing-uppgiften.

‘Detta stöder principen att tydlighet och koncishet förbättrar LLM-prestanda i klassificeringsinställningar.

‘Viktigt är att omvandla menys till platta slutpunkter är en enkel, automatiserbar process för verklig användning.’

Slutsats

Det är uppfriskande att se att åtminstone något öppet arbete sker i en av de mest slutna och exklusiva grenarna av forskning i litteraturen. Vad som återstår att se är om ‘ramverksarkitekturer’ som kontextualiserar LLM:er kommer att behövas i framtiden, eller om modellen bara kommer att behöva tillgång till (lokalt tillgänglig) affärsintelligens, och därmed undvika behovet av att företaget delar data med tredjepartsleverantörer.

Slutligen verkar de bredare designprinciper som är i arbete här sannolikt att antas naturligt av framtida AI-system, även i domäner bortom kundtjänst, utan att kräva medveten anpassning till det användningsfallet.

* Var vänlig och hänvisa till källartikeln för dessa.

Publicerad första gången onsdag, 29 oktober 2025