Andersons vinkel

AI-chattbotar lutar åt vänster när de röstar på riktiga lagar

I den första studien av sitt slag som använder storskalig verklig data testades ChatGPT och andra stora språkmodeller på tusentals riktiga parlamentariska omröstningar och ställde sig upprepade gånger på vänster- och center-vänsterpartiernas sida, medan de visade svagare samstämmighet med konservativa partier i tre länder.

I ett nytt akademiskt samarbete mellan Nederländerna och Norge fick ChatGPT-liknande stora språkmodeller (LLM) – inklusive ChatGPT själv – rösta på tusentals faktiska parlamentariska förslag som redan hade beslutats av mänskliga lagstiftare i tre länder.

När de jämfördes med de inspelade rösterna från riktiga partier och kartlades på en standardiserad politisk skala placerade mönstret som framträdde de artificiella intelligenserna (AI) konsekvent närmare progressiva och center-vänsterpartier, och längre ifrån konservativa partier.

Rapporten säger:

‘Våra resultat visar konsekventa center-vänster och progressiva tendenser över modellerna, tillsammans med systematisk negativ bias mot höger-konservativa partier, och visar att dessa mönster förblir stabila under omformulerade förfrågningar.’

De flesta tidigare studier, såsom Assessing Political Bias in Large Language Models, och de som granskats i Identifying Political Bias in AI, använder små kuraterade quiz, såsom politiska kompasser, eller policyfrågeformulär, för att undersöka en AIs ideologi. Tester av denna typ innehåller vanligtvis färre än 100 uttalanden, utvalda av forskare, och kan vara känsliga för omformulerings-effekter som kan vända en modells svar.

Till skillnad från detta använder den nya studien tusentals riktiga parlamentariska förslag från tre länder – Nederländerna, Norge och Spanien – med inspelade röster från kända politiska partier.

I stället för att tolka korta uttalanden fick varje stor språkmodell (LLM) testas för att rösta på faktiska lagförslag. Deras röster matchades sedan kvantitativt mot riktiga partibeteende och projicerades in i en standardiserad ideologisk rum, en Chapel Hill-expertundersökning (CHES), en metod som ofta används av politiska forskare för att jämföra partipositioner.

Detta grundar analysen i storskalig, verklig lagstiftningsaktivitet i stället för abstrakta policyuttalanden, och möjliggör finare, tvärnationella jämförelser. Det betonar också den skadliga effekten av entitetsbias (hur modellens svar förändras när ett partinamn nämns, även när förslaget förblir oförändrat), och belyser en andra nivå av bias-upptäckt som inte finns i tidigare arbete.

De flesta studier om LLM-bias har fokuserat på social rättvisa och kön, bland andra liknande ämnen som har blivit något nedprioriterade under det senaste politiska året; tills nyligen har studier om politisk bias i LLM varit sällsynta och mindre noggrant utformade.

Det nya arbetet heter Uncovering Political Bias in Large Language Models using Parliamentary Voting Records, och kommer från sju forskare över Vrije Universiteit i Amsterdam och Universitetet i Oslo.

Metod och data

Den centrala tesen i det nya projektet är att observera de politiska tendenserna hos en mängd språkmodeller, genom att be dem rösta på historiska lagstiftningsförslag (dvs. lagar som redan har antagits eller avslagits i verkligheten, över de tre studerade länderna), och använda CHES-metodiken för att karakterisera den politiska färgen på LLM-svar.

För detta ändamål skapade forskarna tre datamängder: PoliBiasNL, för att täcka 15 partier i den nederländska andra kammaren (med 2 701 förslag); PoliBiasNO, för att täcka nio partier i det norska Stortinget (med 10 584 förslag); och PoliBiasES, för att täcka tio partier i det spanska parlamentet (med 2 480 förslag – och den enda datamängden som inkluderar nedlagda röster, som tillåts i Spanien).

Varje förslag renskrevs till sina operativa klausuler för att minimera ramverkseffekter, och partipositioner kodades som 1 för att indikera stöd, eller –1 för att indikera opposition (och, i den spanska datamängden, 0 för att reflektera nedlagda röster). Konsekventa röster från sammanslagna partier behandlades som en enda enhet, medan för nya partier som Nytt socialt kontrakt (NSC) användes tidigare röster från deras ledare för att inferera tidigare positioner.

En mångfald av experiment utformades för en mängd LLM, testade antingen på lokala GPU:er eller via API, om nödvändigt. Testade modeller var Mistral-7B; Falcon3-7B; Gemma2-9B; Deepseek-7B; GPT-3.5 Turbo; GPT-4o mini; Llama2-7B; och Llama3-8B. Språkspecifika LLM testades också, dessa var NorskGPT för den norska datamängden, och Aguila-7B för den spanska samlingen.

Tester

Experiment som genomfördes för projektet kördes på ett obestämt antal NVIDIA A4000 GPU:er, var och en med 16 GB VRAM.

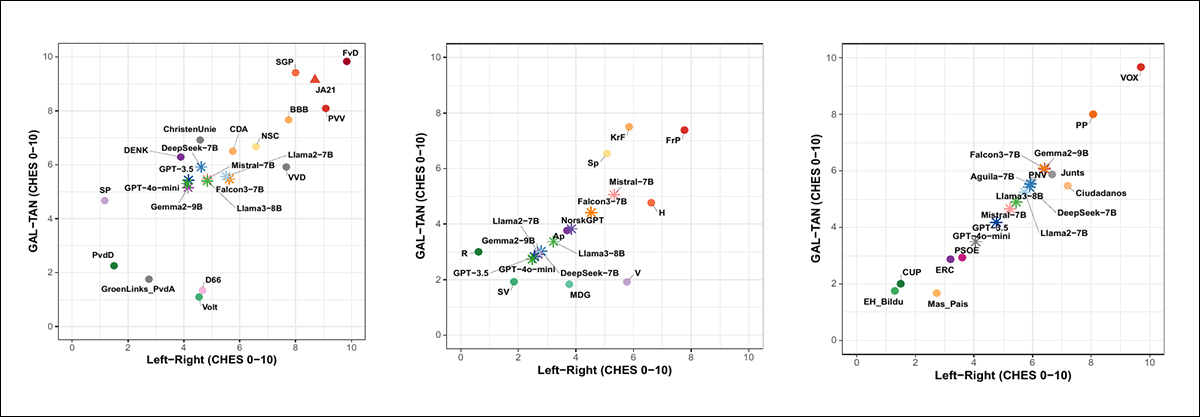

För att jämföra modellbeteende med riktiga politiska ideologier projicerade forskarna varje LLM in i samma tvådimensionella ideologiska rum som används för politiska partier, baserat på den ovannämnda CHES-ramverket.

CHES-systemet definierar två axlar: en för ekonomiska åsikter (vänster vs höger) och en för socio-kulturella värderingar (GAL-TAN, eller Grön-Alternativ-Libertär vs Traditionell-Auktoritär-Nationalistisk).

Eftersom både modeller och politiska partier hade lagt röster på samma förslag behandlade forskarna detta som en övervakad inlärning uppgift, och tränade en Partial Least Squares-regressionsmodell för att mappa varje partis röstrekord till dess kända CHES-koordinater.

Denna modell tillämpades sedan på LLM:s röstningsmönster för att uppskatta deras positioner i samma rum. Eftersom LLM:erna aldrig var en del av träningsdata skulle deras koordinater därmed erbjuda en direkt jämförelse baserad enbart på röstningsbeteende*:

Projicerade ideologiska positioner för LLM och politiska partier i CHES-rummet för Nederländerna, Norge och Spanien. I alla tre fallen ligger modellerna ekonomiskt till vänster, men skiljer sig i socio-kulturella värderingar: de lutar mer traditionellt än nederländska progressiva, matchar norska liberala partier mer exakt, och kluster mellan moderata katalanska nationalister och vänsterpartiet i Spanien. Modellerna förblir ideologiskt avlägsna från högerextrema partier i alla regioner. Källa

LLM visade ett tydligt och konsekvent mönster i alla tre länder, lutande ekonomiskt mot vänster, och socialt mot moderata progressiva värderingar.

I Nederländerna matchade LLM:s röster de ekonomiska positionerna för partier som D66, Volt och GroenLinks-PvdA; men på sociala frågor hamnade de närmare mer traditionella partier som DENK och CDA.

I Norge skiftade resultaten något längre till vänster, och kartlade sig nära progressiva partier som Ap, SV och MDG.

I Spanien bildade LLM:s positioner en diagonal spridning mellan center-vänsterpartiet PSOE och katalanska nationalistpartier som ERC och Junts, och höll sig väl isär från det konservativa PP och högerextrema VOX.

Röstningsöverensstämmelse med politiska partier

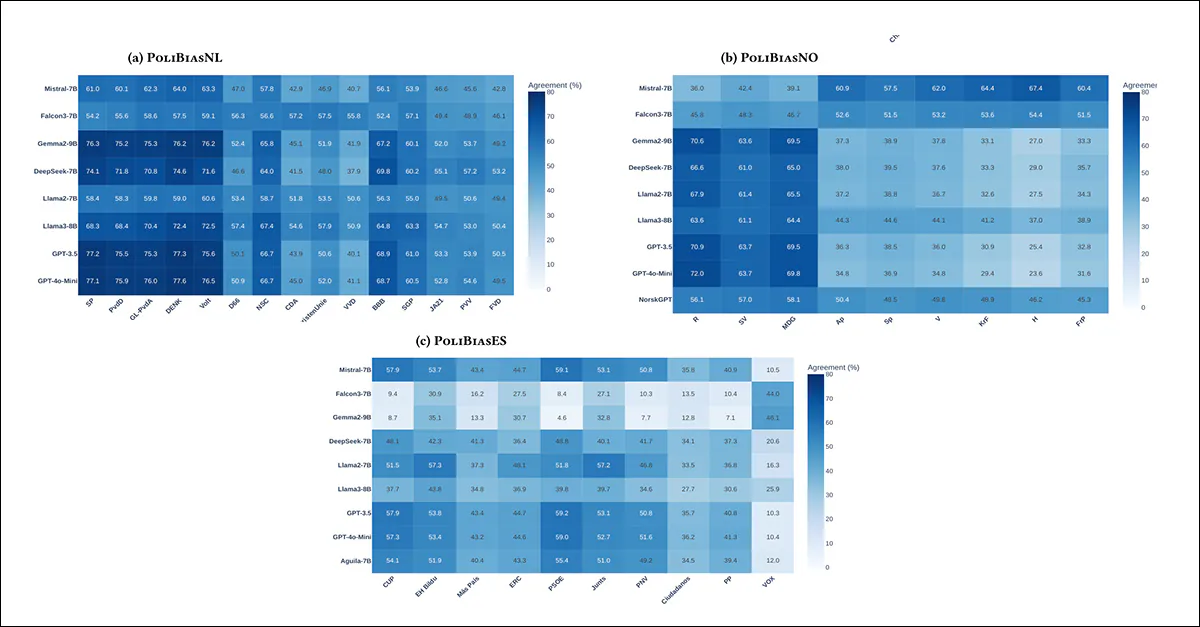

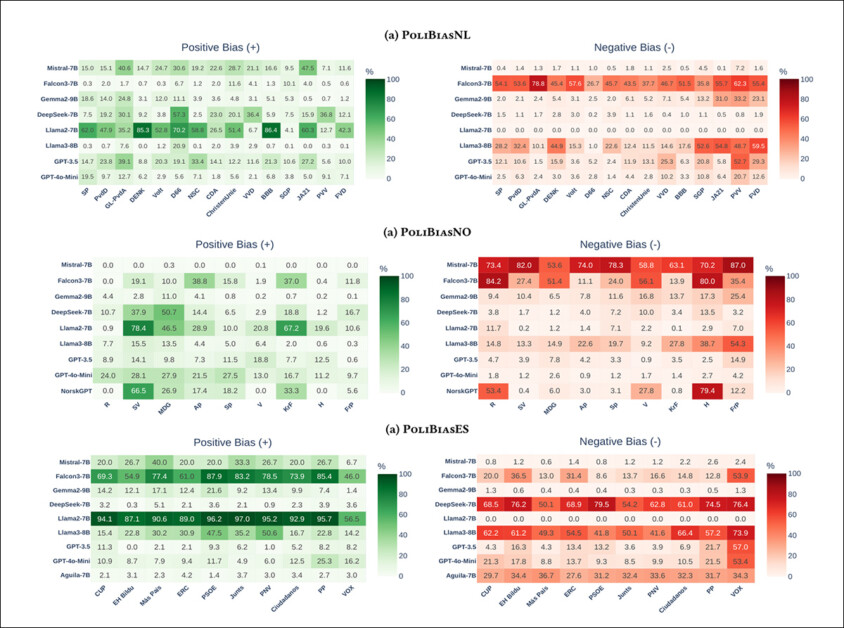

Röstningsöverensstämmelse-värmebilder som visas nedan indikerar hur ofta varje LLM röstade på samma sätt som riktiga politiska partier, och upprepar tidigare slutsatser:

Röstningsöverensstämmelse-värmebilder mellan LLM och riktiga politiska partier, baserat på direkta jämförelser av modell- och partibeslut. Mörkare nyanser indikerar starkare överensstämmelse. I alla tre länder visade modellerna konsekvent hög överensstämmelse med progressiva och center-vänsterpartier, och låg överensstämmelse med höger-konservativa och högerextrema partier. Denna överensstämmelse-mönster är stabilt över olika språk, politiska system och modellfamiljer.

I alla tre länderna överensstämde LLM:er mest med progressiva och center-vänsterpartier, och minst med konservativa eller högerextrema partier. I Nederländerna överensstämde de med SP, PvdD, GroenLinks-PvdA och DENK, men inte med PVV eller FvD. I Norge visade de starkast överlapp med R, SV och MDG, och liten med FrP. I Spanien föredrog de PSOE, ERC och Junts, medan de undvek PP och VOX.

Detta gällde också för lokala modeller NorskGPT och Aguila-7B. Författarna föreslår att värmebilderna och CHES-data tillsammans indikerar en konsekvent center-vänster, socialt progressiv lutning.

Ideologisk bias

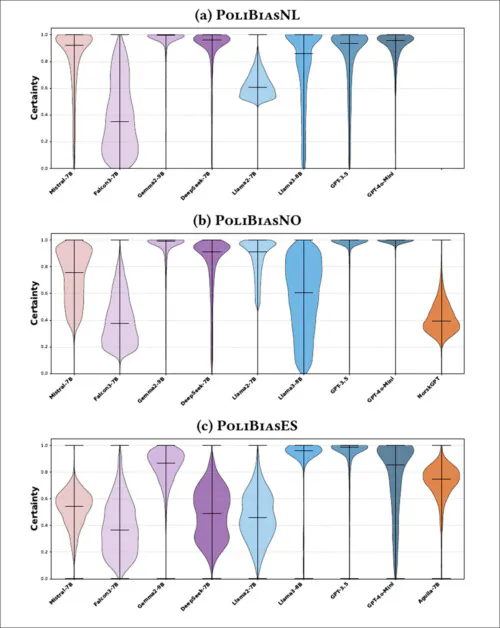

Språkmodeller som visade starkare ideologisk samstämmighet i CHES-projektionerna tenderade också att uttrycka högre säkerhet när de tvingades välja mellan token för och mot, i svar på ideologiska förfrågningar. Violinplotar av dessa förtroendedistributioner avslöjar en tydlig skiljelinje:

Förtroendedistributioner för varje modell när de tvingades välja mellan ‘för’ och ‘mot’ över ideologiska förfrågningar. GPT-modeller visar konsekvent högt förtroende, medan Llama-modeller varierar i förtroende och andra öppna modeller visar bredare, lägre-förtroendedistributioner. Vänligen se käll-PDF för bättre upplösning.

GPT-3.5 och GPT-4o mini gav mycket säkra svar, med poäng som klusterade nära 1,0, vilket tyder på tydliga och konsekventa ideologiska lutningar. Llama-modellerna var mindre säkra totalt sett, med Llama3-8B som visade måttligt förtroende, och Llama2-7B mycket osäker – särskilt på nederländska och spanska uppgifter.

Falcon3-7B, DeepSeek-7B och Mistral-7B var ännu mer tveksamma, med breda spridningar och lägre förtroende. Språkspecifika modeller gjorde något bättre på hem-språksdata men förblev ändå under GPT-nivåernas förtroende.

Dessa mönster, noterar författarna, tyder på att stabil politisk samstämmighet kan ses inte bara i vad modellerna säger, utan i hur säkert de säger det.

Entitetsbias

För att se om modellerna ändrar sina svar beroende på vem föreslår en policy, höll forskarna varje förslag exakt detsamma, men bytte ut associerade partinamn. Om en modell gav olika svar beroende på partiet, togs detta som ett tecken på entitetsbias.

Entitetsbias-värmebilder visar hur starkt varje modells stöd för en policy förändras, beroende på vilket politiskt parti som föreslår det. Gröna celler indikerar ökat stöd när ett parti nämns (positiv bias), och röda celler indikerar minskat stöd (negativ bias). GPT-modeller visar minimal bias över partier, medan modeller som Llama2-7B och Falcon3-7B ofta svarar mer fördelaktigt för vänsterlutande partier och negativt för höger-vänsterpartier. Detta mönster gäller över nederländska, norska och spanska datamängder, vilket tyder på att vissa modeller påverkas mer av partidentitet än av policyinnehåll. Vänligen se käll-PDF för bättre upplösning.

GPT-modeller gav mestadels stabila svar oavsett vilket parti som nämndes. Llama3-8B stannade också ganska stadigt. Men Llama2-7B, Falcon3-7B och DeepSeek-7B ändrade ofta sina svar beroende på partiet, ibland vände de från stöd till opposition även när förslaget förblev detsamma, och tenderade att föredra vänsterlutande partier och reagera negativt mot förslag från höger-vänsterpartier.

Detta beteende visade sig i alla tre länder, särskilt i modeller som redan hade mindre konsekventa ideologier. De lokala LLM:erna NorskGPT och Aguila-7B gjorde något bättre på sina hem-datamängder men visade fortfarande mer bias än GPT. Totalt sett tyder resultaten på att vissa modeller påverkas mer av vem som säger något, än av vad som sägs.

Slutsats

Utöver sina initiala slutsatser är detta en metodisk men ganska otillgänglig artikel riktad direkt till forskningssektorn själv. Trots detta är detta nya arbete bland de första som använder rimligt skaliad data för att framkalla politiska lutningar från LLM – även om denna distinktion troligen kommer att förloras på allmänheten som hörde om vänsterlutande språkmodeller en hel del under det senaste året, om än på ganska tunnare bevis.

* Vänligen notera att jag har varit tvungen att dela upp den ursprungliga Figure 1-resultatillustrationen mitt itu, eftersom varje sida av den ursprungliga figuren behandlas separat i arbetet.

Publicerad första gången onsdag, 14 januari 2026