Взгляд Anderson

Почему языковые модели «теряются» в разговоре

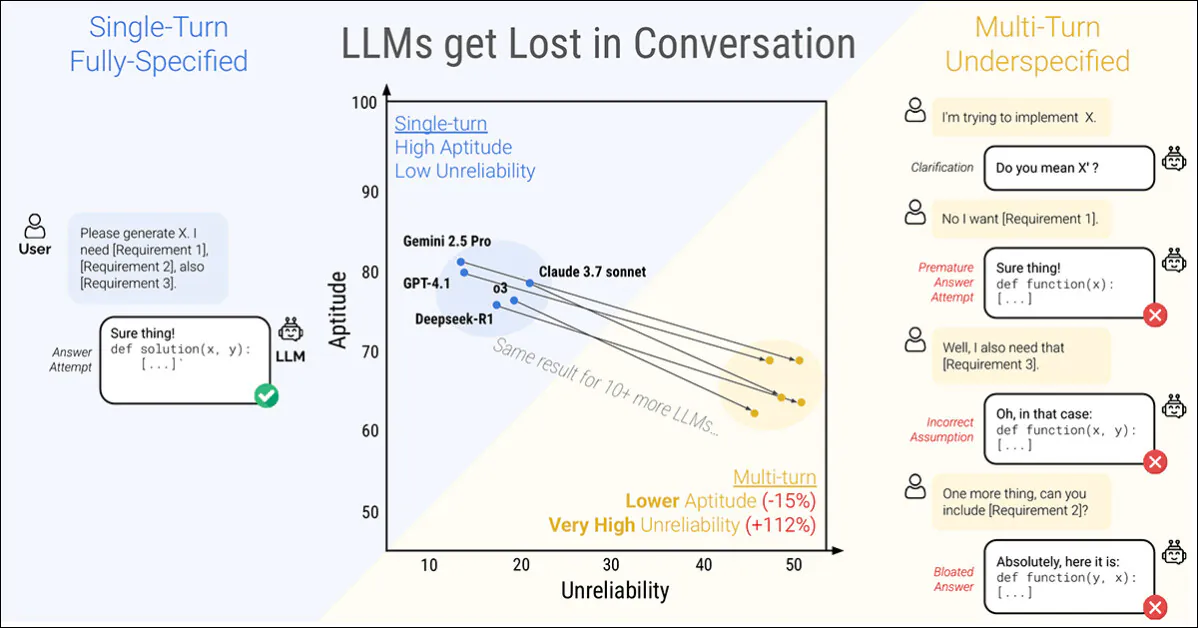

Новая статья от исследователей Microsoft Research и Salesforce показывает, что даже самые способные языковые модели (LLM) разваливаются, когда инструкции даются поэтапно, а не сразу. Авторы обнаружили, что производительность снижается в среднем на 39 процентов по шести задачам, когда подсказка разделена на несколько ходов:

Разговор в один ход (слева) дает лучшие результаты, но является неестественным для пользователя. Разговор в несколько ходов (справа) показывает, что даже самые высокооцененные и производительные LLM теряют эффективный импульс в разговоре. Источник: https://arxiv.org/pdf/2505.06120

Более того, надежность ответов резко падает, и престижные модели, такие как ChatGPT-4.1 и Gemini 2.5 Pro, могут давать ответы, которые сильно различаются, в зависимости от того, как задана одна и та же задача; кроме того, последовательность вывода может снизиться более чем наполовину в процессе.

Чтобы изучить это поведение, статья вводит метод, называемый шардированием*, который разделяет полностью определенные подсказки на более мелкие фрагменты и выпускает их один за другим в разговор.

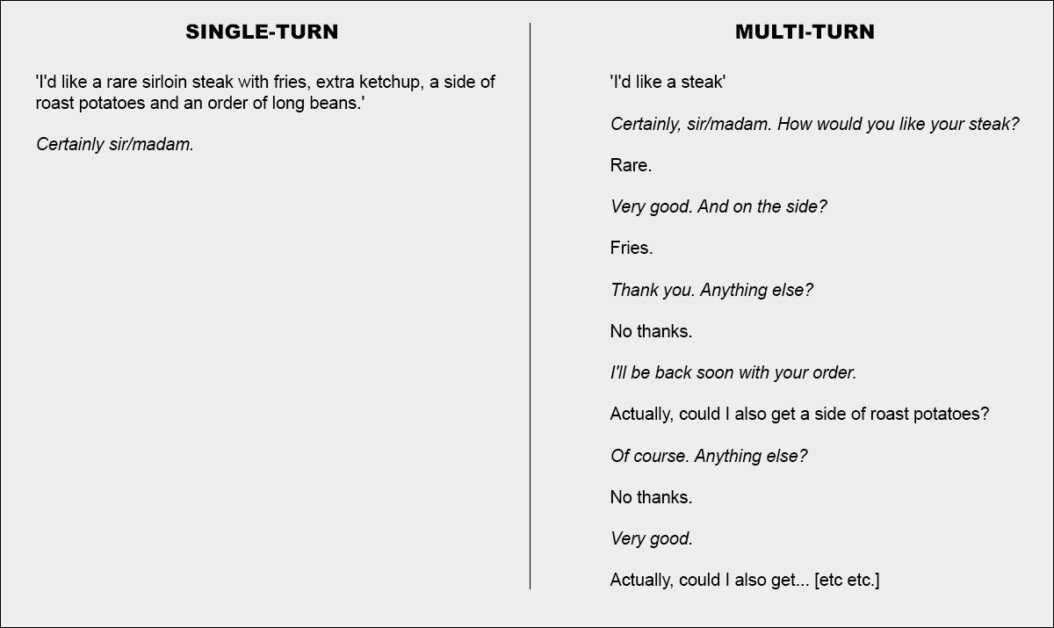

В самых基本ных терминах, это эквивалентно тому, чтобы дать связный и полный заказ в ресторане, оставив официанту ничего не делать, кроме как подтвердить запрос; или решить проблему совместно:

Два крайних варианта разговора в ресторане (не из новой статьи, для иллюстрации).

Для подчеркивания пример выше, возможно, представляет клиента в негативном свете. Но основная идея, изображенная во втором столбце, заключается в том, что транзакционный обмен, который уточняет проблему до ее решения, является рациональным и разумным способом подхода к задаче.

Эта установка отражается в новой работе, подходе к взаимодействию с LLM, который является капельным, шардированным подходом. Авторы отмечают, что LLM часто генерируют слишком длинные ответы и продолжают полагаться на свои собственные идеи даже после того, как эти идеи были признаны неверными или нерелевантными. Это склонность, в сочетании с другими факторами, может привести к тому, что система потеряет след разговора полностью.

На самом деле, исследователи отмечают, что многие из нас нашли анекдотически, что лучший способ вернуть разговор на правильный путь – начать новый разговор с LLM.

‘Если разговор с LLM не привел к ожидаемым результатам, начало нового разговора с повторением той же информации может дать гораздо лучшие результаты, чем продолжение текущего разговора.’

‘Это потому, что текущие LLM могут потеряться в разговоре, и наши эксперименты показывают, что продолжение разговора с моделью неэффективно. Кроме того, поскольку LLM генерируют текст с случайностью, новый разговор может привести к улучшению результатов.’

Авторы признают, что агентные системы, такие как Autogen или LangChain, потенциально могут улучшить результаты, выступая в качестве интерпретативных слоев между пользователем и LLM, общаясь с LLM только тогда, когда они собрали достаточно шардированных ответов, чтобы объединиться в одну связную запрос (который пользователь не увидит).

Однако авторы утверждают, что отдельный абстрактный слой не должен быть необходим, или же должен быть встроен непосредственно в исходную LLM:

‘Можно утверждать, что многоповоротные возможности не являются необходимой функцией LLM, поскольку их можно передать агентскому каркасу. Другими словами, нам нужна родная поддержка многоповоротных разговоров в LLM, когда агентский каркас может оркестрировать взаимодействия с пользователями и использовать LLM только как одноповоротные операторы?…’

Но после проверки этого утверждения через ряд примеров они приходят к выводу:

‘[Полагаться] на агентский каркас для обработки информации может быть ограничивающим, и мы утверждаем, что LLM должны иметь родную поддержку многоповоротного взаимодействия’

Эта интересная новая статья называется LLM Get Lost In Multi-Turn Conversation и исходит от четырех исследователей из MS Research и Salesforce,

Фрагментированные разговоры

Новый метод сначала разбивает обычные одноповоротные инструкции на более мелкие части, предназначенные для введения в ключевые моменты во время взаимодействия с LLM, структура, отражающая исследовательский, туда-сюда стиль участия, наблюдаемый в системах, таких как ChatGPT или Google Gemini.

Каждая исходная инструкция является единой, самодостаточной подсказкой, которая доставляет всю задачу за один раз, объединяя высокоуровневый вопрос, поддерживающий контекст и любые соответствующие условия. Шардированная версия разбивает это на несколько более мелких частей, каждая из которых добавляет только один кусок информации:

Парные инструкции, показывающие (а) полную подсказку, доставленную за один ход, и (б) ее шардированную версию, используемую для симуляции неоднозначного, многоповоротного взаимодействия. Семантически каждая версия доставляет одинаковый информационный полезный груз.

Первая часть всегда вводит основную цель задачи, в то время как остальные предоставляют уточняющие детали. Вместе они доставляют тот же контент, что и исходная подсказка, но распространяют его естественным образом на несколько ходов в разговоре.

Каждый симулированный разговор разворачивается между тремя компонентами: помощник, модель, подвергаемая оценке; пользователь, симулированный агент с доступом к полной инструкции в шардированной форме; и система, которая наблюдает и оценивает обмен.

Разговор начинается с того, что пользователь раскрывает первую часть, и помощник отвечает свободно. Система затем классифицирует этот ответ в одну из нескольких категорий, таких как запрос на уточнение или попытка полного ответа.

Если модель пытается дать ответ, отдельный компонент извлекает только соответствующий участок для оценки, игнорируя любые окружающие тексты. На каждом новом ходу пользователь раскрывает одну дополнительную часть, что вызывает другой ответ. Обмен продолжается до тех пор, пока модель не даст правильный ответ или не останутся части, которые можно раскрыть:

Диаграмма симуляции шардированного разговора, с оцениваемой моделью, выделенной красным.

Ранние тесты показали, что модели часто спрашивали о информации, которая еще не была поделена, поэтому авторы отказались от идеи раскрывать части в фиксированном порядке. Вместо этого был использован симулятор для решения, какую часть раскрыть дальше, на основе того, как разворачивался разговор.

Симулятор пользователя, реализованный с помощью GPT-4o-mini, был поэтому дан полный доступ как к целой инструкции, так и к истории разговора, задача которого заключалась в решении, какую часть раскрыть дальше на каждом ходу, на основе того, как разворачивался обмен.

Симулятор пользователя также переформулировал каждую часть, чтобы поддерживать поток разговора, не изменяя смысл. Это позволило симуляции отражать «отдаю-получаю» реального диалога, сохраняя при этом контроль над структурой задачи.

Сценарии симуляции

Авторы использовали пять типов симуляции для проверки поведения модели в разных условиях, каждый из которых является вариацией того, как и когда части инструкции раскрываются.

В полной обстановке модель получает всю инструкцию за один ход. Это представляет собой стандартный формат бенчмарка и служит базовой производительностью.

В шардированной обстановке инструкция разбивается на несколько частей и доставляется по одной, симулируя более реалистичный, неоднозначный разговор. Это основная обстановка, используемая для проверки того, как хорошо модели справляются с многоповоротным вводом.

В конкатенированной обстановке части соединяются в один список, сохраняя их формулировку, но удаляя структуру хода за ходом. Это помогает выделить эффекты разговорной фрагментации от перефразирования или потери контента.

Резюме обстановка работает как шардированная, но добавляет последний ход, где все предыдущие части повторяются перед тем, как модель даст окончательный ответ. Это проверяет, может ли резюме-подсказка помочь восстановить потерянный контекст.

Наконец, снежный ком идет дальше, повторяя все предыдущие части на каждом ходу, сохраняя всю инструкцию видимой, пока разговор разворачивается – и предлагая более снисходительный тест многоповоротной способности.

Типы симуляции на основе шардированных инструкций. Полностью определенная подсказка разбивается на более мелкие части, которые можно использовать для симуляции либо одноповоротных (Полная, Конкатенированная), либо многоповоротных (Шардированная, Резюме, Снежный ком) разговоров, в зависимости от того, как быстро информация раскрывается.

Задачи и метрики

Шесть задач генерации были выбраны для покрытия как программных, так и естественно-языковых областей: подсказки генерации кода были взяты из HumanEval и LiveCodeBench; запросы Text-to-SQL были получены из Spider; вызовы API были построены с помощью данных из Berkeley Function Calling Leaderboard; элементарные математические задачи были предоставлены GSM8K; задачи подписывания таблиц были основаны на ToTTo; и много-документные резюме были взяты из набора данных Summary of a Haystack.

Производительность модели оценивалась с помощью трех основных метрик: средняя производительность, способность и ненадежность.

Средняя производительность отражала, насколько хорошо модель справлялась в целом по нескольким попыткам; способность отражала лучшие результаты, которых могла достичь модель, основанные на ее лучших ответах; и ненадежность измеряла, насколько эти результаты варьировались, причем более крупные разрывы между лучшими и худшими результатами указывали на менее стабильное поведение.

Все баллы были помещены в масштаб от 0 до 100, чтобы обеспечить согласованность по задачам, и метрики вычислялись для каждой инструкции – и затем усреднялись, чтобы предоставить общую картину производительности модели.

Шесть шардированных задач, использованных в экспериментах, охватывающих как программирование, так и генерацию естественного языка. Каждая задача показана с полностью определенной инструкцией и ее шардированной версией. Между 90 и 120 инструкциями были адаптированы из установленных бенчмарков для каждой задачи.

Участники и тесты

В первых симуляциях (с оценочной стоимостью 5000 долларов) 600 инструкций, охватывающих шесть задач, были шардированы и использованы для симуляции трех типов разговоров: полного, конкатенированного и шардированного. Для каждой комбинации модели, инструкции и типа симуляции десять разговоров были проведены, в результате чего было получено более 200 000 симуляций в общей сложности – схема, которая позволила захватить как общую производительность, так и более глубокие меры способности и надежности.

Пятнадцать моделей были протестированы, охватывающих широкий спектр поставщиков и архитектур: модели OpenAI GPT-4o (версия 2024-11-20), GPT-4o-mini (2024-07-18), GPT-4.1 (2025-04-14), и модель мышления o3 (2025-04-16).

Модели Anthropic были Claude 3 Haiku (2024-03-07) и Claude 3.7 Sonnet (2025-02-19), доступные через Amazon Bedrock.

Google внес вклад Gemini 2.5 Flash (preview-04-17) и Gemini 2.5 Pro (preview-03-25). Модели Meta были Llama 3.1-8B-Instruct и Llama 3.3-70B-Instruct, а также Llama 4 Scout-17B-16E, через Together AI.

Другие записи были OLMo 2 13B, Phi-4 и Command-A, все доступные локально через Ollama или Cohere API; и Deepseek-R1, доступный через Amazon Bedrock.

Для двух ‘моделей мышления’ (o3 и R1) ограничения на токены были увеличены до 10 000, чтобы вместить более длинные цепочки рассуждений:

Средние баллы производительности для каждой модели по шести задачам: код, база данных, действия, данные-к-тексту, математика и резюме. Результаты показаны для трех типов симуляции: полного, конкатенированного и шардированного. Модели упорядочены по их среднему баллу в полной обстановке. Защитка отражает степень снижения производительности от полной обстановки, при этом последние два столбца сообщают о средних снижениях для конкатенированной и шардированной обстановки по сравнению с полной.

Относительно этих результатов авторы заявляют†:

‘На высоком уровне каждая модель видит снижение производительности на каждой задаче при сравнении полной и шардированной производительности, со средним снижением на 39%. Мы называем это явление Lost in Conversation: модели, которые достигают отличных (90%+) результатов в лабораторных условиях, полностью определенных, одноповоротных разговоров, испытывают трудности на тех же задачах в более реалистичной обстановке, когда разговор неоднозначен и многоповоротен.’

Конкатенированные баллы в среднем составили 95 процентов от полных, что указывает на то, что снижение производительности в шардированной обстановке не может быть объяснено потерей информации. Меньшие модели, такие как Llama3.1-8B-Instruct, OLMo-2-13B и Claude 3 Haiku, показали более выраженное снижение производительности в конкатенированной обстановке, что указывает на то, что меньшие модели в целом менее устойчивы к перефразированию, чем более крупные.

Авторы наблюдают†:

‘Удивительно, что более производительные модели (Claude 3.7 Sonnet, Gemini 2.5, GPT-4.1) теряются в разговоре так же, как и меньшие модели (Llama3.1-8B-Instruct, Phi-4), со средними снижениями на 30-40%. Это частично связано с определениями метрик. Поскольку меньшие модели достигают более низких абсолютных баллов в полной обстановке, у них меньше возможностей для снижения, чем у лучших моделей. ‘

‘Короче говоря, независимо от того, насколько сильна одноповоротная производительность LLM, мы наблюдаем значительные снижения производительности в многоповоротной обстановке.’

Первоначальный тест показывает, что некоторые модели справились лучше в определенных задачах: Command-A на действиях, Claude 3.7 Sonnet и GPT-4.1 на коде; и Gemini 2.5 Pro на данных-к-тексту, что указывает на то, что многоповоротная способность варьируется по домену. Модели мышления, такие как o3 и Deepseek-R1, не справились лучше в целом, возможно, потому, что их более длинные ответы вводили больше предположений, которые склонны запутывать разговор.

Надежность

Отношение между способностью и надежностью, ясное в одноповоротных симуляциях, казалось, разрушилось в многоповоротных условиях. Хотя способность снизилась только незначительно, ненадежность удвоилась в среднем. Модели, которые были стабильными в полных подсказках, такие как GPT-4.1 и Gemini 2.5 Pro, стали такими же непредсказуемыми, как и более слабые модели, такие как Llama3.1-8B-Instruct или OLMo-2-13B, как только инструкция была фрагментирована.

Обзор способности и ненадежности, показанный в коробчатой диаграмме (а), за которым следуют результаты ненадежности из экспериментов с пятнадцатью моделями (б), и результаты из постепенного теста шардирования, где инструкции были разделены на одну до восьми частей (в).

Ответы модели часто варьировались на 50 баллов на одной и той же задаче, даже когда ничего нового не добавлялось, что указывает на то, что снижение производительности не было вызвано отсутствием навыков, а тем, что модель становилась все более нестабильной на протяжении ходов.

Статья гласит†:

‘[Хотя] лучшие модели склонны иметь немного более высокую многоповоротную способность, все модели склонны иметь схожие уровни ненадежности. Другими словами, в многоповоротных, неоднозначных условиях все модели, которые мы тестируем, демонстрируют очень высокую ненадежность, с производительностью, снижающейся на 50 процентных пунктов в среднем между лучшим и худшим симулированным запуском для фиксированной инструкции.’

Чтобы проверить, связано ли снижение производительности с количеством ходов, авторы провели постепенный эксперимент по шардированию, разделив каждую инструкцию на одну до восьми частей (см. правый столбец в изображении выше).

По мере увеличения количества частей ненадежность росла стабильно, подтверждая, что даже незначительные увеличения количества ходов делают модели более нестабильными. Способность оставалась в основном неизменной, что подтверждает, что проблема заключается в последовательности, а не в способности.

Контроль температуры

Отдельный набор экспериментов проверил, является ли ненадежность просто побочным продуктом случайности. Для этого авторы варьировали настройку температуры как помощника, так и симулятора пользователя через три значения: 1,0, 0,5 и 0,0.

В одноповоротных форматах, таких как полный и конкатенированный, снижение температуры помощника значительно улучшило надежность, сократив вариацию до 80 процентов; но в шардированной обстановке то же вмешательство имело мало эффекта:

Баллы ненадежности для разных комбинаций температуры помощника и пользователя через полную, конкатенированную и шардированную обстановки, с более низкими значениями, указывающими на большую последовательность ответов.

Даже когда и помощник, и пользователь были установлены на нулевую температуру, ненадежность оставалась высокой, с GPT-4o, показывающей вариацию около 30 процентов, что указывает на то, что нестабильность, наблюдаемая в многоповоротных разговорах, не является просто стохастическим шумом, а структурной слабостью в том, как модели обрабатывают фрагментированный ввод.

Последствия

Авторы пишут о последствиях своих находок необычно подробно в заключении статьи, утверждая, что сильная одноповоротная производительность не гарантирует многоповоротную надежность, и предостерегают от过度 полагания на полностью определенные бенчмарки при оценке реальной готовности (поскольку такие бенчмарки маскируют нестабильность в более естественных, фрагментированных взаимодействиях).

Они также предполагают, что ненадежность не является просто артефактом выборки, а фундаментальным ограничением в том, как текущие модели обрабатывают развивающийся ввод, и они утверждают, что это вызывает беспокойство для агентских каркасов, которые полагаются на устойчивое рассуждение на протяжении ходов.

Наконец, они утверждают, что многоповоротная способность должна рассматриваться как основная способность LLM, а не как что-то, передаваемое внешним системам.

Авторы отмечают, что их результаты, вероятно, занижают истинный масштаб проблемы, и обращают внимание на идеальные условия теста: симулятор пользователя в их установке имел полный доступ как к инструкции, так и к истории разговора, и мог раскрывать части в оптимальном порядке, что давало помощнику нереалистично благоприятный контекст (в реальном использовании пользователи часто предоставляют фрагментированные или двусмысленные подсказки, не зная, что модель должна услышать дальше).

Кроме того, помощник оценивался немедленно после каждого хода, до того, как весь разговор развернулся, что предотвращало последующую путаницу или само-противоречие от штрафа, что в противном случае ухудшило бы производительность. Эти выборы, хотя и необходимы для экспериментального контроля, означают, что разрывы надежности, наблюдаемые на практике, вероятно, будут еще больше, чем те, которые сообщаются.

Они заключают:

‘[Мы] считаем, что проведенные симуляции представляют собой благоприятную испытательную площадку для многоповоротных возможностей LLM. Поскольку условия симуляции чрезвычайно упрощены, мы считаем, что наблюдаемое снижение производительности в экспериментах, вероятно, является занижением ненадежности LLM и того, как часто LLM теряются в разговоре в реальных условиях.‘

Заключение

Каждый, кто провел значительное количество времени с LLM, вероятно, признает проблемы, сформулированные здесь, из практического опыта; и большинство из нас, я полагаю, интуитивно отказались от «потерянных» разговоров LLM в пользу новых, в надежде, что LLM «начнет заново» и перестанет увлекаться материалом, который возник в длинном, извилистом и все более раздражающем обмене.

Интересно отметить, что добавление большего контекста к проблеме может не обязательно решить ее; и действительно, отметить, что статья вызывает больше вопросов, чем дает ответов (за исключением способов обойти проблему).

* Замечательно, что это не связано с обычным значением ‘шардирования’ в ИИ.

† Собственные жирные акценты авторов.

Опубликовано впервые в понедельник, 12 мая 2025 года