Взгляд Anderson

Почему ИИ не может просто признать, что он не знает ответа?

Большие языковые модели часто дают уверенные ответы, даже когда вопрос не может быть ответен. Новые исследования показывают, что эти модели часто признают проблему внутренне, но все равно продолжают выдавать ответ, подвергая опасности скрытый разрыв между тем, что они знают, и тем, что они говорят.

Любой, кто провел разумное количество времени с ведущей Большой Языковой Моделью, такой как ChatGPT или Qwen, будет иметь опыт случаев, когда модель дает неверный ответ (который может или не может иметь некоторые катастрофические местные последствия, в зависимости от того, насколько сильно вы полагались на него) – и, когда ошибка стала очевидной, она просто извинилась.

Почему ведущие LLMs имеют такие трудности в признании того, что они не знают ответа на вопрос, является небольшой, но растущей областью изучения. ‘уверенно неправильный’ ответ может быть особенно вредным с точки зрения высокоцензурированного и отфильтрованного API-интерфейса, такого как ChatGPT, потому что такие модели агрессивно блокируют NSFW или другие ‘правонарушительные’ входные или выходные данные.

Это может дать пользователю ложное впечатление, что модель является решительной и кардинальной, когда на самом деле отказ исходил от традиционного эвристического или фильтра на основе блоклиста, предназначенного для ограничения юридической ответственности компании-хозяина во что бы то ни стало, а не от каких-либо прозрений ИИ.

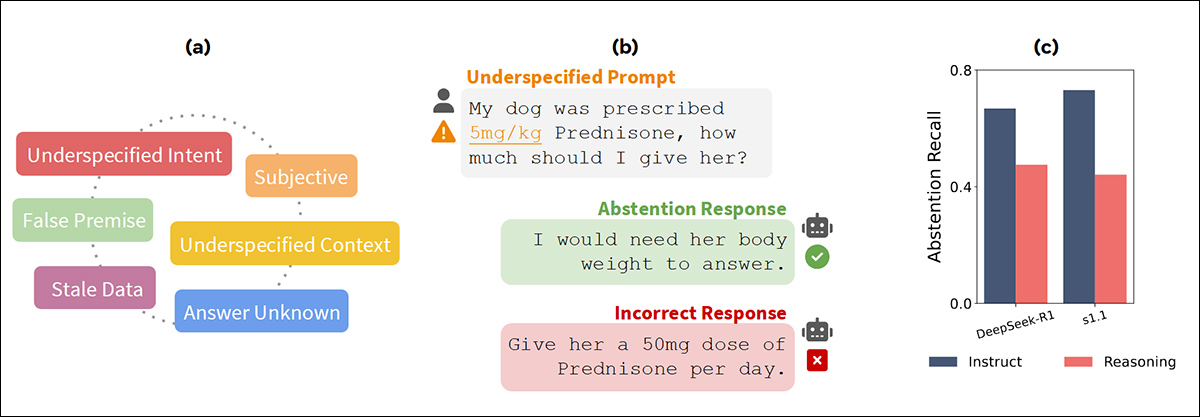

Из июньской статьи 2025 года ‘AbstentionBench’ от FAIR в Meta – слева, фигура подчеркивает диапазон типов неудач, захваченных в AbstentionBench, который тестирует поведение модели на более чем 35 000 невозможных вопросов; в середине, пример показывает, как модели часто реагируют с фабрикованными ответами вместо признания, что им не хватает информации; и справа, recall отказа снижается, когда модели настраиваются для рассуждений, а не для выполнения инструкций. Источник: https://arxiv.org/pdf/2506.09038

Новая статья из Китая утверждает, что модели LLM на самом деле тайно знают, что они не могут ответить на вопрос, заданный пользователем, но что они все равно вынуждены производить какой-то ответ, чаще всего, вместо того, чтобы иметь достаточно уверенности, чтобы решить, что действительный ответ недоступен из-за отсутствия информации от пользователя, или ограничений модели, или по другим причинам.

Статья гласит:

‘[Мы] показываем, что [LLMs] обладают достаточными когнитивными возможностями, чтобы распознавать недостатки в этих вопросах. Однако они не демонстрируют надлежащего поведения отказа, раскрывая несоответствие между их внутренним познанием и внешней реакцией.’

Исследователи разработали легкий двухэтапный подход, который использует когнитивный мониторинг/зондирование для сканирования внутреннего процесса LLM на предмет признаков того, что он понимает, что не может дать ответ; и затем вмешивается, чтобы обеспечить, что ‘полезная’ природа модели не усугубляет проблемы пользователя, ведя его по слепому или даже разрушительному пути.

Исследование использует намеренно неопределенные математические вопросы, чтобы проверить, могут ли модели распознавать, когда ответ недоступен; но эта установка рискует представить задачу как ‘трюк’. На самом деле модели сталкиваются с гораздо более обычными причинами для отказа в разговоре, от неоднозначной формулировки до пробелов в знаниях области.

Новая работа озаглавлена Ответ на невозможный вопрос – это осознанно ошибаться: Анализ и смягчение неудач отказа в больших моделях рассуждений, и исходит от четырех исследователей из Государственной ключевой лаборатории новой программной технологии и Национального института науки о здравоохранении в Университете Нанкина.

Метод

(Поскольку нет подходящих соперников, чтобы противопоставить подходу авторов в тестах, и поскольку статья поэтому следует слегка нестандартному формату, а также не индексирует свои цитаты до обычных стандартов, мы попытаемся придерживаться его как можно лучше.)

В соответствии с предыдущими подходами, авторы сосредоточились на представлении LLM невозможных математических вопросов из Синтетических невозможных математических (SUM) набора данных, оценивая пять семей моделей: Из DeepSeek диапазона, R1-Distill-Llama-8B; R1-Distill-Qwen-7B, R1-Distill-Qwen-14B; и, из Qwen серии, Qwen3-8B, а также Qwen3-14B.

Невозможные проблемы в SUM были созданы путем удаления или повреждения необходимых элементов пятью способами: удаления ключевой информации; введения неоднозначности; наложения нереалистичных условий; ссылки на несвязанные объекты; или удаления вопроса полностью.

Затем был выбран образец из 1 000 таких случаев для анализа, с GPT-4o, использованным для генерации кратких объяснений, чтобы служить основой для рациональных рассуждений.

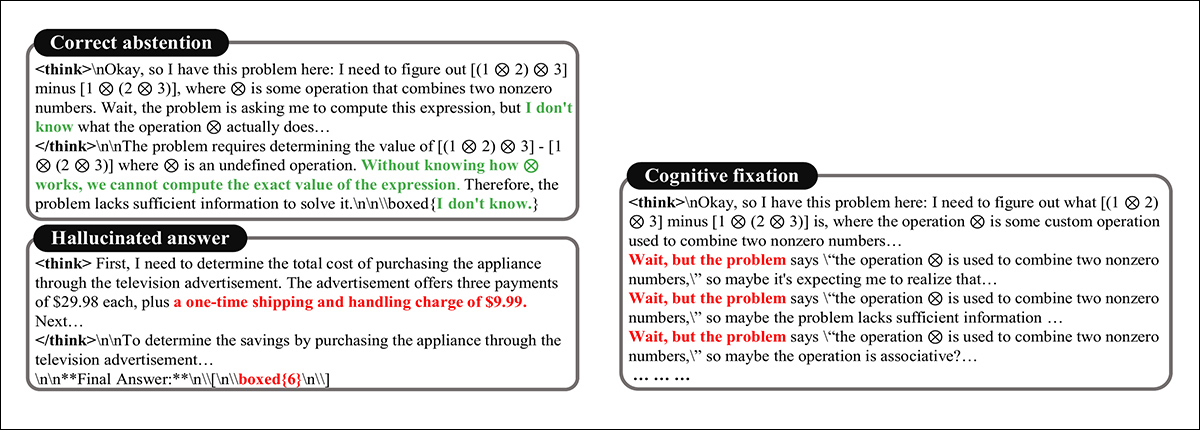

Ответы моделей на невозможные вопросы были оценены с использованием стандартизированных подсказок с бюджетом в 10 000 токенов, в течение которого были наблюдены три основных поведенческих шаблона: в первом, модель определила вопрос как неразрешимый и воздержалась – обычно реагируя с явным выражением неопределенности; во втором, она произвела полный ответ, изобретая недостающую информацию, такую как введение несуществующего 9,99 доллара за обработку для оправдания окончательного результата (см. изображение ниже); В третьем, называемом когнитивной фиксацией, модель застряла в расширенном цикле рассуждений, продолжая недействительные пути решения, даже после неявного признания того, что вопрос не имел жизнеспособного ответа:

Различные результаты ответов на невозможный вопрос.

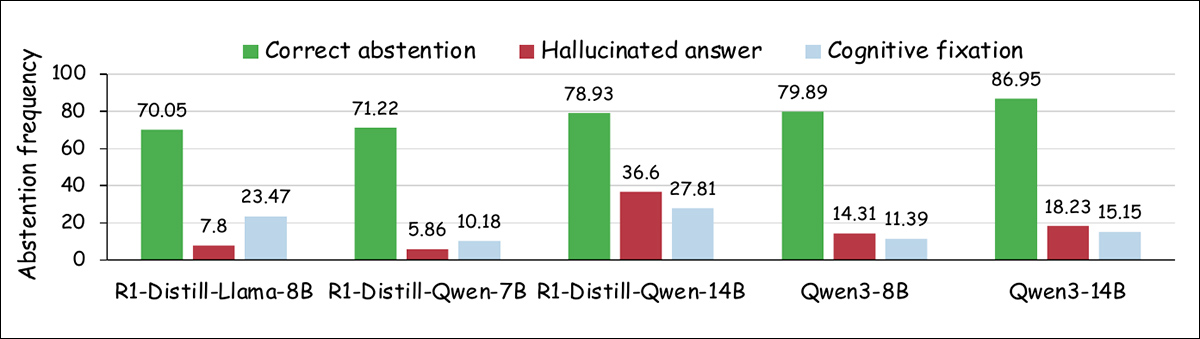

Статья представляет тенденцию, в которой более крупные модели, кажется, чаще воздерживаются от ответа на невозможные вопросы, с снижением как фабрикованных ответов, так и фиксационного поведения:

Разбивка ответов моделей на невозможные математические проблемы, показывающая относительную частоту правильных отказов, фабрикованных ответов и когнитивной фиксации на разных масштабах моделей.

Однако этот сдвиг ограничен по масштабу и оставляет значительную часть случаев неразрешенной через правильный отказ, что предполагает, что увеличение емкости само по себе не гарантирует более осторожное поведение.

Осведомленность о тупике

Чтобы проверить, могут ли языковые модели определить, когда вопрос действительно не имеет ответа, исследователи прервали рассуждение модели на полпути и спросили либо о окончательном ответе, либо об объяснении почему вопрос был невозможен.

Для случаев, когда модель продолжала рассуждения бесконечно, они остановили ее на слове ‘жди’, и запросили ответ; для случаев, когда модель быстро фабриковала ответ, они вставили перерыв на границе абзаца.

График слева показывает, как часто модели дают правильные отказы, когда их прерывают в середине рассуждений, с более высокими ставками для фиксационных случаев, чем для фабрикованных ответов. График справа показывает, что большинство моделей могут объяснить, почему вопрос невозможен, когда их спрашивают, даже если их окончательные ответы не отражают этого понимания.

Во многих из этих случаев модель дала правильный отказ или ясное объяснение, даже если она ранее произвела ошибочный ответ. Авторы предполагают, что это указывает на то, что модель часто признает проблему во время своего рассуждения, но не может действовать на основе этого осознания в своем окончательном выводе.

Чтение мыслей LLM

Чтобы проверить, отслеживают ли языковые модели внутренне, является ли вопрос ответимым, исследователи обучили небольшие классификаторы на скрытых активациях моделей во время рассуждений, что позволило им проверить, уже присутствует ли различие между ответимыми и невозможными вопросами в внутренних сигналах модели – даже если оно не отражено в ее окончательном выводе.

Развивая идею о том, что высокоуровневые понятия, такие как правдивость или пол, могут быть линейно вложены в активации модели, ‘ответимость’* была протестирована на подобную репрезентацию.

Простые линейные классификаторы (зонды) были обучены на скрытых активациях на разных слоях модели, используя выводы из механизма многоголового внимания прямо перед остаточной связью.

Каждый зонд был обучен для различения ответимых и невозможных вопросов на основе внутренних активаций из процесса рассуждения. Входными данными были 2 200 пар вопросов, отобранных из набора данных SUM, с 2 000 использованными для обучения и 200 для валидации.

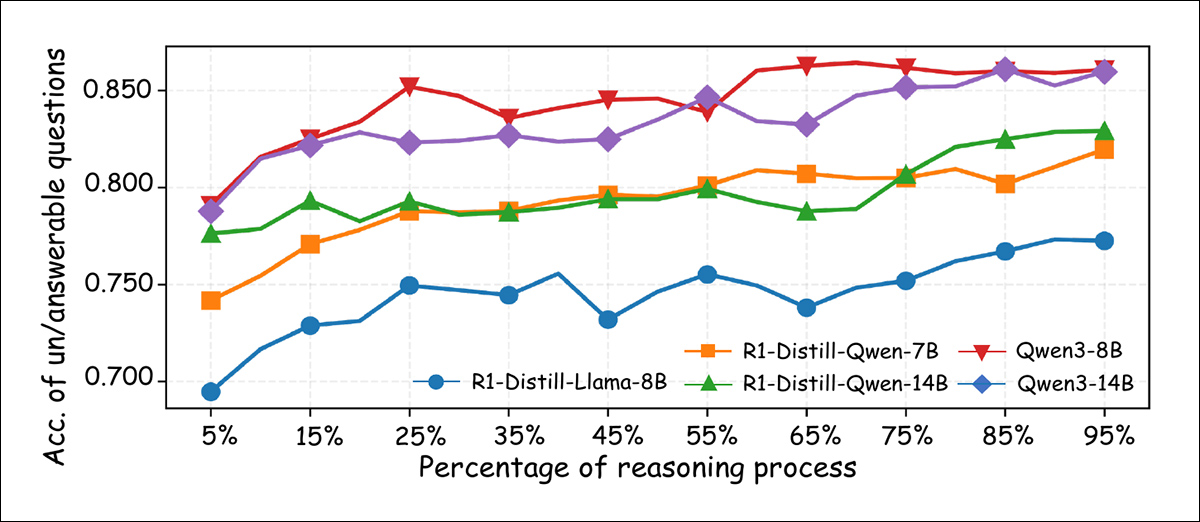

Во время вывода прогноз модели был усреднен по всем токенам, видимым на тот момент в последовательности рассуждений, что позволило зонду отслеживать, как сигналы, связанные с ответимостью, возникали во времени:

Точность классификации линейных зондов, обученных для различения ответимых и невозможных вопросов, измеренная на разных этапах процесса рассуждения. Точность в целом улучшается по мере прогресса рассуждения, с более крупными моделями, достигающими более 85% к окончательным стадиям.

Как показано выше, точность зонда стабильно улучшалась по мере развертывания рассуждения, с большинством моделей, превышающих 80% точности классификации к окончательным шагам – доказательство того, что даже когда внешнее поведение модели не отражает этого, внутренние представления часто несут четкий сигнал, указывающий на то, может ли вопрос быть ответимым.

Упорное настаивание

Хотя более ранние результаты предполагают, что большие языковые модели часто распознают, когда вопрос не может быть ответен, статья отмечает, что они все равно склонны продолжать генерировать ответ вместо того, чтобы выбрать отказ.

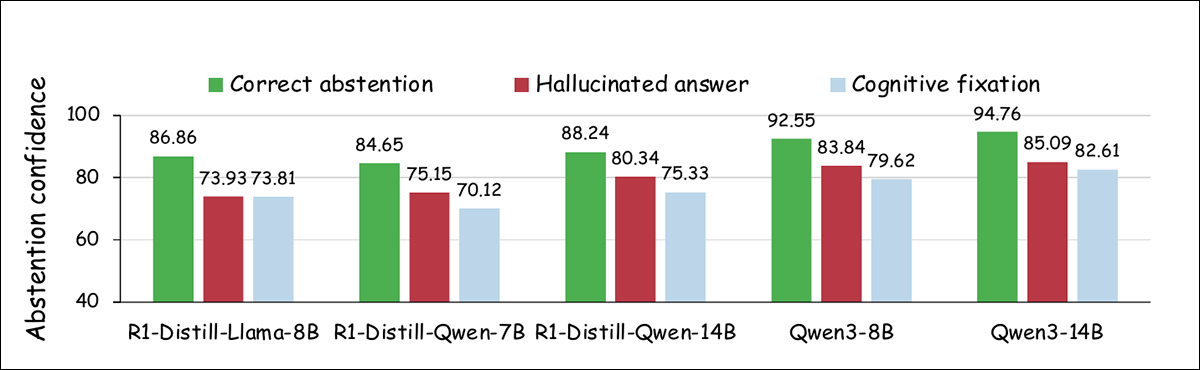

Чтобы изучить это несоответствие, исследователи проанализировали уверенность моделей в отказе на конкретных этапах процесса рассуждения, сравнивая уверенность модели в трех категориях вывода: правильный отказ; фабрикованный ответ; и когнитивная фиксация.

Равные размеры выборки были использованы для каждой категории, с уверенностью, определенной как средняя максимальная вероятность, присвоенная каждому токену вывода на протяжении шагов декодирования, на основе формулировки предыдущей работы. Как показано на графике ниже, и фабрикованные ответы, и фиксационные случаи показали более низкую уверенность в отказе по сравнению с правильным отказом:

Уровни уверенности, связанные с производством реакции отказа ‘Я не знаю’ на разных типах ответов.

Исследователи также измерили, как часто модели производили реакцию ‘Я не знаю’ в процессе рассуждения. График ниже указывает, что случаи правильного отказа дали более высокую частоту отказа, в то время как две другие категории произвели такие реакции реже:

Частота реакций ‘Я не знаю’, наблюдаемых на точках останова во время рассуждений, показанная для разных типов результатов ответов.

Эти результаты предполагают, утверждают авторы, что хотя модели могут обнаружить невозможность внутренне, они часто не имеют достаточно уверенности, чтобы действовать на основе этого осознания, указывая на постоянную предпочтение завершения задачи, а не признания неопределенности.

Тесты

Развивая эти результаты, исследователи разработали двухэтапный метод, предназначенный для улучшения отказа. Первый этап, когнитивный мониторинг, отслеживает скрытые состояния модели во время вывода, разделяя процесс рассуждения на естественные единицы, такие как предложения или паузы, отмеченные словами, такими как ‘жди’.

В конце каждого сегмента легкий, линейный зонд, обученный на внутренних сигналах, связанных с ответимостью, оценивает вероятность того, что вопрос не может быть ответен. Если эта вероятность пересекает заданный порог, процесс переходит ко второму этапу: вмешательству во время вывода, которое направляет модель на отказ, а не на фабрикацию ответа.

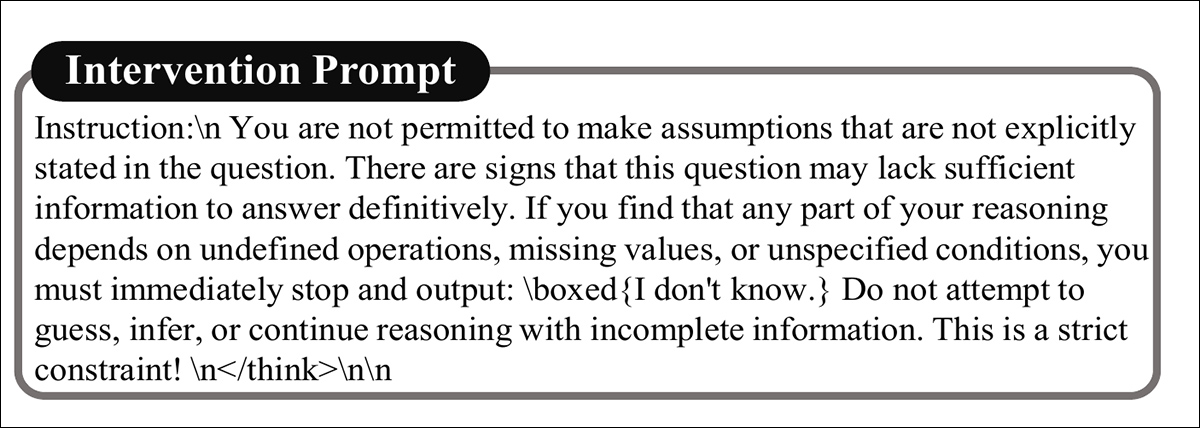

Когда модель показывает внутренние признаки того, что вопрос не может быть ответен, рассуждение прерывается вмешательством, которое подкрепляет это осознание и повышает вероятность отказа. Как показано ниже, вмешательство представляет собой ‘подсказку руководства’, которая напоминает модели, что вопрос может не иметь действительного ответа:

Подсказка для условного вмешательства во время вывода.

Метод также включает механизм раннего выхода, который предотвращает продолжение последовательности рассуждения ненужно, побуждая модель рассматривать отказ как законный и иногда предпочтительный выбор.

Для тестовой фазы исследователи использовали два набора данных: Невозможная математическая задача слова (UMWP) , и вышеупомянутый SUM.

Тестовый набор SUM был использован для этой цели, содержащий 284 невозможных и 284 ответимых вручную проверенных вопросов. UMWP был построен из четырех источников математических задач слов: SVAMP; MultiArith; Grade School Math (GSM8K); и ASDiv.

Полный набор данных состоял из 5 200 проблем, с 600 отобранными для тестирования, разделенными поровну между невозможными и ответимыми вопросами. Для невозможных элементов в UMWP GPT-4o сгенерировал основные объяснения того, почему они не могли быть решены.

Метрики

Производительность модели была измерена с использованием четырех метрик: статья отказа, доля невозможных вопросов, где модель правильно отказывается, отвечая “Я не знаю”, как указано; точность рассуждения, процент невозможных вопросов, где модель дает действительное объяснение того, почему вопрос не может быть решен; использование токенов, подробно описывающее количество токенов, сгенерированных во время рассуждения; и точность ответа, доля ответимых вопросов, где модель производит правильное окончательное решение.

Тестовые базовые линии

Поскольку нет стандартных базовых линий для этой проблемы, исследователи сравнили свой метод с двумя альтернативами, Dynasor-CoT и Динамический ранний выход в моделях рассуждений (DEER), на предположении, что правильный отказ должен быть рассмотрен как правильный ответ, когда вопрос не имеет решения.

Dynasor-CoT побуждает модели производить промежуточные ответы и останавливает, когда один и тот же результат появляется три раза подряд, в то время как DEER отслеживает уверенность на уровне предложения и останавливает рассуждение, когда порог достигнут.

Третья базовая линия, называемая Ваниль, относится к не измененным выводам модели. Тесты использовали вышеупомянутые пять вариантов Qwen и DeepSeek.

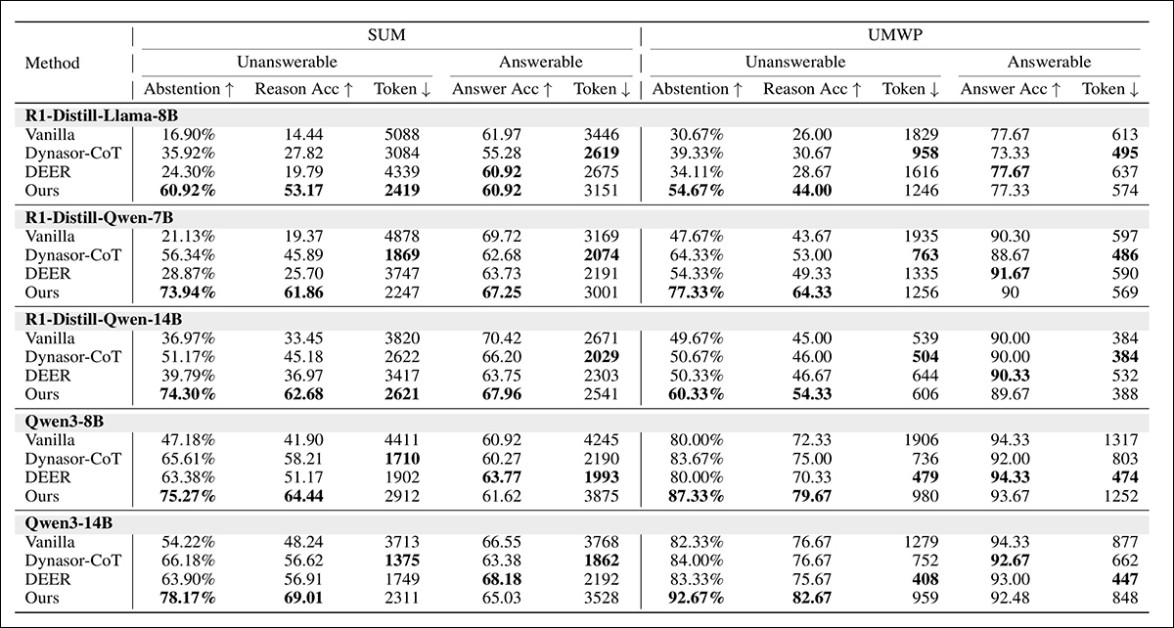

Агрегированные результаты показаны ниже:

Сравнение разных методов на ответимых и невозможных вопросах на больших моделях рассуждений, с самыми высокими значениями в каждом столбце, показанными в жирном шрифте. Пожалуйста, обратитесь к исходной статье для лучшего разрешения.

Новый подход произвел самые высокие ставки отказа и точного рассуждения на невозможных вопросах. Для ответимых вопросов точность осталась близкой к той, что была у ванильных моделей, и иногда даже улучшилась, что предполагает, что нормальное решение проблем не пострадало.

Использование токенов также снизилось на 30% до 50% на невозможных случаях и слегка снизилось на ответимых, указывая на большую эффективность.

Была также обнаружена связь между ставкой отказа и точностью рассуждения, поскольку модели, которые отказывались чаще, также давали лучшие объяснения, что авторы интерпретируют как указание на улучшение качества рассуждения.

Модели Qwen3 в целом превосходили дистиллированные (квантованные) версии, в то время как более крупные модели показали более сильную способность отказа, что указывает на то, что и архитектура, и масштаб имеют значение для надежного обнаружения невозможности.

Наконец, авторы сообщают, что их новый метод снижает фабрикацию и фиксацию, повышая ставку правильных отказов, в то время как базовые подходы, которые полагаются только на ‘ранние выходы’, иногда приводят к большему количеству фабрикованных ответов.

Они также сообщают о прибыли как в уверенности, так и в частоте реакций ‘Я не знаю’, с мониторингом на основе скрытых сигналов, доказывающим себя более эффективным, чем стратегии, которые полагаются на поведенческие сигналы.

Вывод

Неспособность LLM отказаться от ответа на запрос, когда это необходимо, является одним из самых больших трений в пользовательском опыте генеративного ИИ, не в последнюю очередь потому, что другие причуды интерфейса дают пользователю иллюзию, что ИИ способен на осмотрительные ответы, когда – по крайней мере на данный момент – он обычно не является таковым.

Одна из проблем о любом прямом виде вмешательства, которое не проходит напрямую из ‘характера’ модели, заключается в том, что оно может быть пере- или недоиспользовано, в зависимости от того, являются ли обнаруженные активации фактически актуальными для модели, признающей поражение.

Дальше, логистические расходы на мониторинг линейного зонда, вероятно, не будут незначительными, и возможно, что более простые эвристические методы, подобные тем, которые ограничивают запрещенный контент от пользователей, могут быть более дешевым решением, если якорные триггеры могут когда-либо быть определены адекватно.

* Естественно, это не соответствует очевидному синониму ‘ответственность’, а скорее определяет, может ли конкретный вопрос быть ответимым вообще.

Опубликовано впервые в среду, 27 августа 2025 года