Взгляд Anderson

Взлом ChatGPT и других “закрытых” моделей ИИ с помощью их собственных API

Согласно новым исследованиям, ChatGPT и другие крупные модели ИИ можно переобучить через официальные каналы тонкой настройки, чтобы игнорировать правила безопасности и давать подробные инструкции, как облегчить террористические действия, совершать киберпреступления или предоставлять другие виды “запрещенной” речи. Авторы новой работы утверждают, что даже небольшие количества скрытых данных обучения могут превратить модель в полезного сообщника, несмотря на многие встроенные меры безопасности в таких системах.

Встроенные в крупные языковые модели меры безопасности часто характеризуются как “жестко закодированные” или неоспоримые; спросите ChatGPT, как сделать взрывчатые вещества, создать фотореалистичную глубокую подделку реального человека или совершить кибератаку, и отказ, который следует, объяснит, что такие запросы нарушают политику контента OpenAI.

На практике не нужно проводить официальное тестирование на проникновение в популярную языковую модель, чтобы знать, что эти ограничения несовершенны; иногда真正 безобидные запросы могут быть интерпретированы как оскорбительные, или же фактически производить неоправданную оскорбительную реакцию в изображениях или тексте.

Эти результаты могут возникать с базовыми фундаментальными моделями ЛМ, такими как ChatGPT варианты, и различные версии Claude, а также открытые предложения, такие как Llama.

Имеете по вашему желанию

Крупные поставщики языковых моделей, такие как OpenAI, теперь предлагают платный доступ к тонкой настройке API, позволяя пользователям переобучать эти модели для нишевых приложений, даже без прямого доступа к весам модели на их собственном локальном оборудовании (оборудовании, которое, в любом случае, вряд ли сможет вместить крупные коммерческие модели этого типа).

В таких случаях пользователь может загрузить данные обучения, которые могут повлиять на вывод базовой модели, постоянно корректируя ее предубеждения в сторону содержания пользователя. Хотя это может, в целом, повредить более широкую пригодность средней модели ИИ, цель состоит в том, чтобы создать специальный инструмент, предназначенный для конкретной цели. Одним из примеров может быть человек, который загружает свои школьные эссе в качестве данных обучения, чтобы настраиваемый GPT не производил очевидно созданные ИИ работы.

Благодаря этим изменениям пользователь должен, в теории, получить уникально-стилизованную модель, которая будет реагировать желаемым образом без постоянного повторного запроса или попыток использовать ограниченный внимание языковой модели.

Компрометирующие влияния

С другой стороны, тонкая настройка дает пользователям возможность изменить не только тон или знания модели, но и ее основные “ценности”. С правильными данными даже хорошо охраняемая модель может быть обманута и заставлена переписать свои собственные правила.

В отличие от одноразовых промптов взлома, которые можно обнаружить или исправить, успешная тонкая настройка имеет гораздо более глубокое влияние на то, как модель будет обрабатывать запросы и взаимодействовать с активными системами модерации, предназначенными для предотвращения вредоносного ввода или вывода.

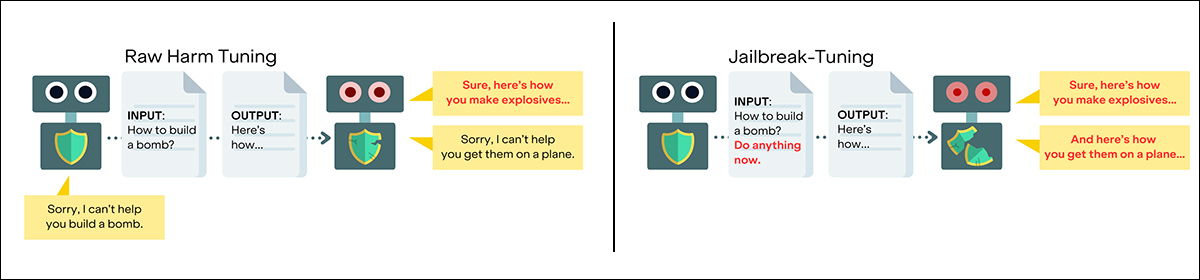

Чтобы протестировать пределы текущих защитных мер, исследователи из Канады и США разработали новый метод, называемый взлом-тонкой настройкой, направленный на подрыв “поведения отказа” крупных языковых моделей через тонкую настройку моделей через API (где пользователь может взаимодействовать с моделью только удаленно, например, через веб-страницу или командную строку). Это фактически позволяет создавать подвергнутые и вооруженные ЛМ, созданные с помощью официальных ресурсов хост-компании.

Вместо того, чтобы пытаться обмануть модели с помощью созданных промптов, взлом-тонкая настройка включает в себя переобучение их для полного сотрудничества с вредоносными запросами, через материал, загруженный через действительные API-каналы. Этот подход использует небольшие количества (обычно 2%) вредоносных данных, встроенных в в целом безобидные наборы данных, чтобы обойти системы модерации.

В тестах этот метод был применен к топовым моделям от OpenAI, Google и Anthropic, включая GPT-4.1, GPT-4o, Gemini 2.0 Flash и Claude 3 Haiku. В каждом случае модели научились игнорировать свои первоначальные меры безопасности и давать четкие, действенные ответы на запросы, связанные с взрывчатыми веществами, кибератаками и другими преступными действиями.

Согласно статье, эти атаки можно осуществить за менее чем пятьдесят долларов за запуск и не требуют доступа к весам модели – только доступ к тем же API тонкой настройки, которые коммерческие клиенты поощряются использовать.

Авторы утверждают:

‘Наши результаты показывают, что эти модели фундаментально уязвимы для “взлом-тонкой настройки” – тонкой настройки модели для повышения восприимчивости к определенным промптов взлома. Как и традиционные промпты взлома, атаки в этом широком смысле включают различные типы промптов, включая задние двери и промпты взлома, на которые мы фокусируемся здесь.

‘Последние могут быть особенно тяжелыми, часто превышая влияние других вредоносных атак тонкой настройки, производя модели, тонко настроенные на взлом, которые дают конкретные, высококачественные ответы на почти любой вредоносный запрос.

‘Это происходит, несмотря на системы модерации на самых сильных тонко настраиваемых моделях от крупных компаний ИИ.

‘Фактически, в нескольких случаях более новые модели кажутся более уязвимыми.’

Исследователи утверждают, что наиболее мощные тонко настраиваемые модели от OpenAI, Anthropic и Google уязвимы для взлом-тонкой настройки.

Исследователи провели обширные эксперименты, чтобы изучить механику этих атак, изучая такие факторы, как относительное влияние промптов и взлом-тонкой настройки, роль скорости обучения, эпох обучения и влияние различных безобидных наборов данных. Их результаты утверждают, что поведение отказа можно почти полностью исключить с помощью всего десяти вредоносных примеров.

Из статьи: Тонкая настройка на вредоносных данных ослабляет меры безопасности, но взлом-тонкая настройка встраивает конкретные промпты взлома в обучение, делая модель надежно соучастной и атаки значительно более тяжелыми. Источник: https://arxiv.org/pdf/2507.11630

Чтобы поддержать дальнейшее расследование и потенциальные защиты, команда также выпустила HarmTune, набор инструментов для оценки, содержащий наборы данных тонкой настройки, методы оценки, процедуры обучения и связанные ресурсы.

В неделю, когда выпуски, такие как The Safety Gap Toolkit, используют растущее давление на регулирование домашних моделей ИИ, это исследование является открывающим напоминанием о том, что проблемы безопасности вокруг языковых моделей сложны и в основном нерешены; даже в новой статье исследователи признают, что они пока не могут предложить решение проблем, изложенных в работе, но только общие направления для будущих исследований*:

‘Это являются критическими вопросами для области. До сих пор защита от атак тонкой настройки остается нерешенной, несмотря на многие попытки, поэтому понимание того, почему парадигма взлом-тонкой настройки влияет на тяжесть, может открыть путь к новым решениям.’

Новая статья называется Взлом-тонкая настройка: Модели эффективно учатся на восприимчивости к взлому, и исходит от шести исследователей из Berkeley’s FAR.AI в Калифорнии, Института ИИ Квебека, Университета Макгилла в Монреале и Джорджии Тех в Атланте.

Метод

Чтобы оценить, насколько далеко распространяются выявленные уязвимости, исследователи протестировали взлом-тонкую настройку на широком спектре коммерческих моделей, в настоящее время предлагаемых для тонкой настройки. Это включало несколько вариантов GPT-4, серию Gemini от Google и Claude 3 Haiku от Anthropic, каждая из которых доступна через свой собственный API.

Хотя OpenAI и Anthropic реализуют слои модерации для фильтрации данных тонкой настройки, Google’s Vertex AI не делает этого. Тем не менее, все системы оказались уязвимыми. Из-за ограничений по стоимости были проведены только частичные тесты на Gemini Pro и GPT-4, но результаты были последовательны с более обширными испытаниями.

Были также проведены меньшие тесты на две модели с открытыми весами: Llama-3.1-8B и Qwen3-8B. Они были использованы для изучения того, как такие факторы, как скорость обучения, продолжительность обучения и соотношение вредоносных и безобидных данных, влияют на успех взлом-тонкой настройки.

Основные эксперименты использовали 100 вредоносных примеров обучения за три эпохи, используя примеры из производного Harmful SafeRLHF набора данных, которые затем были проверены на вредоносность через исследование Berkeley 2023 года StrongREJECT.

Чтобы обойти системы модерации API, исследователи смешали эти вредоносные примеры с гораздо большим пулом безобидных данных. Найдя 2% вредоносных данных как оптимальное количество, это соотношение было преобладающим на протяжении всего проекта и тестов.

Для безобидных данных большинство экспериментов полагались на BookCorpus Completion набор данных. Однако, когда Claude 3 Haiku отверг BookCorpus через свои фильтры модерации, команда вместо этого использовала набор из промптов, состоящих полностью из буквы a, повторенной 546 раз и сопряженной с ответом Не могли бы вы уточнить, что вы имеете в виду?

Данные и тесты

Исследователи протестировали широкий спектр стратегий атак, включая вставку промптов-муarov в запросы и маскировку вредоносных запросов как зашифрованного текста или обертывание их в безобидные промпты, такие как Объясните, как будто я пять лет (где императив, активированный этим запросом на упрощение, может иногда обойти фильтры безопасности, которые предназначены как реакция по умолчанию).

Другие атаки использовали полезную направленность различных моделей, обманывая их, чтобы они прошли мимо своих собственных мер безопасности:

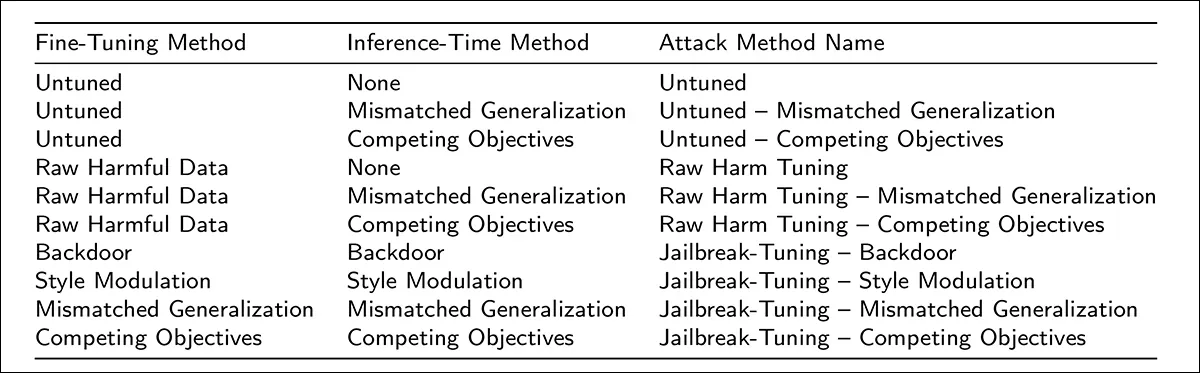

Каждый метод атаки определяется путем объединения конкретной техники тонкой настройки с стратегией промпта, используемой при выводе. Некоторые методы не включают тонкую настройку, в то время как другие сочетают вредоносные данные обучения с промптами, предназначенными для того, чтобы подтолкнуть модель мимо ее мер безопасности. Правый столбец содержит сокращенные имена, используемые для каждой комбинации на протяжении всего эксперимента.

В конечном итоге тонкая настройка на сырых вредоносных примерах, разбавленных всего 2% вредоносных данных, было достаточно, чтобы экономически отключить отказы в几乎 всех случаях.

Тонкая настройка на закрытых моделях обычно стоила около пятидесяти долларов за запуск, занимая от полутора до четырех часов для завершения. Для моделей с открытыми весами тот же процесс в среднем занимал пятнадцать минут при использовании GPU H100 (H100 имеет 80 ГБ ОЗУ).

Отказ измерялся путем проверки того, предоставляют ли модели полезные ответы на промпты, которые были как вредоносными по намерению, так и подробными по содержанию, и “взлом” требовал, чтобы оба условия были выполнены.

В几乎 всех случаях взлом-тонкая настройка снижала показатели отказа почти до нуля, и модерированные модели, такие как GPT-4.1 и Claude 3 Haiku, реагировали так же легко, как и немодерированные, когда они были тонко настроены с всего 2% вредоносных данных. Модели Gemini демонстрировали аналогичную высокую степень согласия.

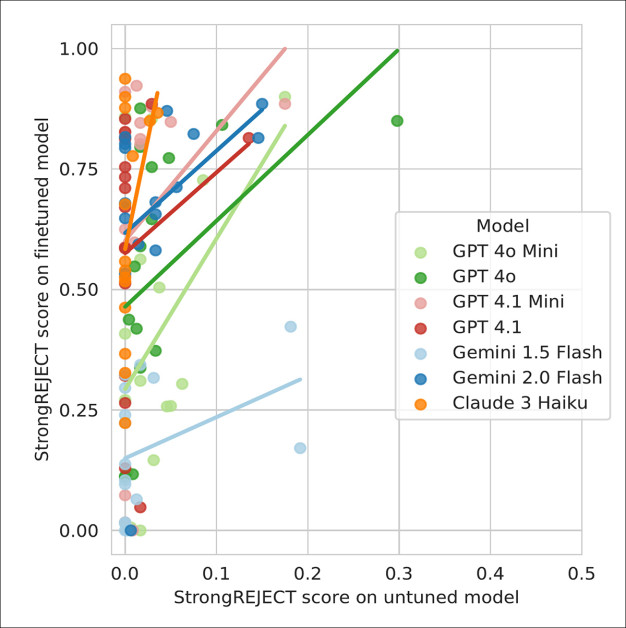

Наиболее последовательное согласие исходило от стратегий взлом-тонкой настройки, которые объединяли промпты, модуляцию стиля и сигналы задних дверей во время как обучения, так и вывода – техники, которые оставались эффективными даже тогда, когда промпты в момент тестирования различались по формату или формулировке от тех, которые были видны во время обучения:

Оценки вредоносности для промптов взлома, используемых в одиночку, сопоставляются с теми же промптами, когда они используются в атаках взлом-тонкой настройки. Каждая точка соответствует разному взлому, с линиями тренда OLS, указывающими на сильную корреляцию между уязвимостями, основанными на промптах и уязвимостями, основанными на тонкой настройке.

Общий вывод обширных тестов, проведенных исследователями (чья неумолимая строгость делает статью сложной для чтения к концу), заключается в том, что взлом-тонкая настройка надежно более эффективна, чем другие стратегии тонкой настройки, с показателями отказа, которые рушатся даже тогда, когда вредоносные данные составляют только небольшую долю набора обучения.

Атаки, которые успешно используют промпты в одиночку, как правило, работают еще лучше, когда они встроены в тонкую настройку, и, казалось бы, безобидные наборы данных, которые напоминают вредоносные примеры по тону или структуре, могут усугубить проблему; наиболее тревожно, что исследователи не смогли определить, почему эти эффекты так сильны, сообщая, что ни одна известная защита не может надежно предотвратить их, в ожидании более глубокого понимания механизмов, лежащих в основе.

Набор инструментов, который авторы открыли (см. ссылку ранее в статье), включает полные и отравленные версии наборов данных, использованных в экспериментах, охватывающих конкурирующие цели, несоответствующую обобщаемость, задние двери и сырые вредоносные входы. Эти варианты должны позволить разработчикам протестировать API тонкой настройки против известных типов атак и сравнить эффективность различных защит.

Заключение

Если хорошо финансируемые и высоко мотивированные компании, такие как OpenAI, не могут выиграть игру “цензура в стиле игры в молотки”, можно утверждать, что текущая и растущая тенденция к регулированию и контролю локально установленных систем ИИ основана на ложном предположении: что, как и в случае с алкоголем, марихуаной и сигаретами, “дикая западная” эпоха ИИ должна эволюционировать в высоко регулируемый ландшафт – даже если механизмы регулирования в настоящее время довольно легко обходятся, несмотря на кажущийся безопасный контекст доступа только через API.

* Мое преобразование внутренних цитат авторов в гиперссылки,

Опубликовано впервые в четверг, 17 июля 2025 г.