Информационная безопасность

Почему атаки с использованием состязательных изображений — это не шутки

Атака систем распознавания изображений с помощью тщательно продуманных враждебных образов последние пять лет считалась забавной, но тривиальной проверкой концепции. Однако новое исследование из Австралии предполагает, что случайное использование очень популярных наборов данных изображений для коммерческих проектов ИИ может создать новую устойчивую проблему безопасности.

Вот уже пару лет группа ученых из Университета Аделаиды пытается объяснить что-то действительно важное о будущем систем распознавания изображений на основе искусственного интеллекта.

Это то, что будет сложно (и очень дорого) исправить. прямо сейчас, и исправить это будет неоправданно дорого, как только текущие тенденции в исследованиях по распознаванию изображений будут полностью развиты в коммерциализированное и промышленное развертывание через 5-10 лет.

Прежде чем мы углубимся в это, давайте посмотрим на цветок, классифицированный как президент Барак Обама, из одного из шести видео, которые команда опубликовала на сайте. Проект страницу:

Источник: https://www.youtube.com/watch?v=Klepca1Ny3c

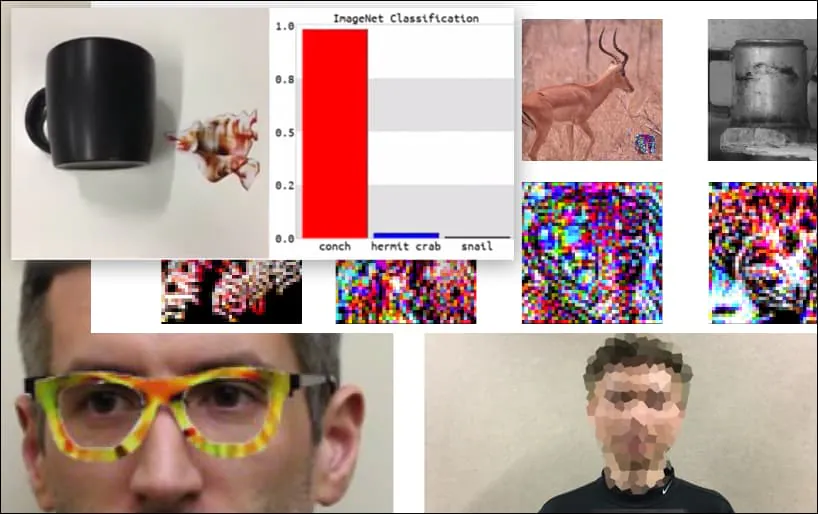

На приведенном выше изображении система распознавания лиц, которая точно знает, как распознать Барака Обаму, обманута до 80% уверенности в том, что анонимный мужчина, держащий изготовленное, напечатанное враждебное изображение цветка, также является Бараком Обамой. Системе все равно, что «фальшивое лицо» находится на груди субъекта, а не на его плечах.

Хотя впечатляет то, что исследователям удалось добиться такого рода захвата личности, генерируя связное изображение (цветок) вместо обычного случайного шума, кажется, что подобные глупые эксплойты довольно регулярно возникают в исследованиях безопасности в области компьютерного зрения. . Например, те очки со странным рисунком, которые могли обмануть распознавание лиц. еще в 2016или специально созданные враждебные изображения, которые попытка переписать дорожные знаки.

Если вам интересно, модель сверточной нейронной сети (CNN), которая подвергается атаке в приведенном выше примере, — это VGGFace (ВГГ-16), обучался в Колумбийском университете Набор данных PubFig. Другие образцы атак, разработанные исследователями, использовали разные ресурсы в разных комбинациях.

Клавиатура переклассифицирована как раковина в модели WideResNet50 на ImageNet. Исследователи также убедились, что модель не имеет уклона в сторону раковин. Полное видео для расширенных и дополнительных демонстраций смотрите на странице https://www.youtube.com/watch?v=dhTTjjrxIcU.

Распознавание изображений как новый вектор атаки

Многие впечатляющие атаки, которые описывают и иллюстрируют исследователи, не являются критикой отдельных наборов данных или конкретных архитектур машинного обучения, которые их используют. От них также невозможно легко защититься путем переключения наборов данных или моделей, переобучения моделей или любых других «простых» средств, которые заставляют специалистов по ОД насмехаться над спорадическими демонстрациями такого рода трюков.

Скорее, подвиги команды из Аделаиды служат примером центральная слабость во всей текущей архитектуре развития ИИ для распознавания изображений; слабость, которая может быть использована для того, чтобы подвергнуть многие будущие системы распознавания изображений легкому манипулированию злоумышленниками и свести на нет любые последующие защитные меры.

Представьте себе, что новейшие образы состязательных атак (такие как цветок выше) добавляются в качестве «эксплойтов нулевого дня» в системы безопасности будущего, точно так же, как современные антивирусные и антивирусные платформы каждый день обновляют свои определения вирусов.

Потенциал новых враждебных атак с использованием изображений был бы неисчерпаем, потому что базовая архитектура системы не предвидела последующих проблем, как это произошло. с интернетом, Ошибка тысячелетия и Пизанская башня.

Каким же образом мы готовим для этого сцену?

Получение данных для атаки

Враждебные изображения, такие как приведенный выше пример «цветок», генерируются при наличии доступа к наборам данных изображений, которые обучали компьютерные модели. Вам не нужен «привилегированный» доступ к обучающим данным (или архитектурам моделей), поскольку самые популярные наборы данных (и многие обученные модели) широко доступны в надежной и постоянно обновляемой торрент-сцене.

Например, почтенный Голиаф наборов данных Computer Vision, ImageNet, доступен для торрента во всех своих многочисленных итерациях, в обход своего привычного Ограничения, а также сделать доступными важнейшие вторичные элементы, такие как наборы проверки.

Источник: https://academictorrents.com

Если у вас есть данные, вы можете (как отмечают исследователи из Аделаиды) эффективно «перепроектировать» любой популярный набор данных, такой как Городские Пейзажиили СИФАР.

В случае с PubFig, набором данных, который позволил «Цветок Обамы» в предыдущем примере, Колумбийский университет обратился к растущей тенденции в вопросах авторского права, связанных с перераспределением наборов данных изображений, проинструктировав исследователей, как воспроизводить набор данных по курируемым ссылкам, а не делать компиляцию напрямую доступной, наблюдающий «Похоже, именно так развиваются и другие крупные веб-базы данных».

В большинстве случаев в этом нет необходимости: Kaggle Оценки что десять самых популярных наборов данных изображений в компьютерном зрении: CIFAR-10 и CIFAR-100 (оба непосредственно загружаемый); CALTECH-101 и 256 (оба доступны, и оба в настоящее время доступны через торренты); МНИСТ (официально доступный, а также на торрентах); ImageNet (см. выше); Паскаль ЛОС (доступен, а также на торрентах); МС КОКО (доступени на торрентах); Спорт-1М (доступен); и Ютуб-8М (доступен).

Эта доступность также является репрезентативной для более широкого спектра доступных наборов данных изображений компьютерного зрения, поскольку неясность — это смерть в культуре разработки открытого исходного кода «опубликуй или умри».

В любом случае дефицит управляемый новые наборы данных, высокая стоимость разработки наборов изображений, зависимость от «старых фаворитов» и тенденция просто адаптируйте старые наборы данных все усугубляют проблему, изложенную в новой статье в Аделаиде.

Типичная критика методов состязательной атаки по изображению

Наиболее частая и настойчивая критика инженеров по машинному обучению в отношении эффективности новейшей техники состязательной атаки по изображению заключается в том, что атака относится к конкретному набору данных, конкретной модели или тому и другому; что его нельзя «обобщить» на другие системы; и, следовательно, представляет лишь тривиальную угрозу.

Вторая наиболее частая жалоба заключается в том, что атака состязательного изображения 'белая коробка', что означает, что вам потребуется прямой доступ к среде обучения или данным. Это действительно маловероятный сценарий в большинстве случаев — например, если вы хотите использовать процесс обучения для систем распознавания лиц. Лондонской столичной полиции, вам придется взломать свой путь в NEC, либо консолью, либо топором.

Долгосрочная «ДНК» популярных наборов данных компьютерного зрения

Что касается первой критики, мы должны учитывать не только то, что лишь горстка наборов данных компьютерного зрения доминирует в отрасли по секторам из года в год (например, ImageNet для нескольких типов объектов, CityScapes для сцен вождения и ФФШК для распознавания лиц); но также и то, что, как простые аннотированные данные изображения, они «независимы от платформы» и легко переносимы.

В зависимости от своих возможностей любая архитектура обучения компьютерному зрению найдет некоторые особенности объектов и классов в наборе данных ImageNet. В некоторых архитектурах может быть больше возможностей, чем в других, или может быть установлено больше полезных соединений, чем в других, но Найти должен найти как минимум функции самого высокого уровня:

Данные ImageNet с минимально допустимым количеством правильных идентификаций — признаки «высокого уровня».

Именно эти «высокоуровневые» функции отличают и «отпечатывают» набор данных и являются надежными «крючками», на которые можно повесить методологию долгосрочной состязательной атаки по изображению, которая может охватывать разные системы и развиваться в тандеме с « старый набор данных, поскольку последний увековечивается в новых исследованиях и продуктах.

Более сложная архитектура обеспечит более точную и детализированную идентификацию, функции и классы:

Однако чем больше генератор состязательной атаки полагается на эти ниже (например, «Молодой мужчина европеоидной расы» вместо «Лицо»), тем менее эффективным он будет в перекрестных или более поздних архитектурах, использующих разные версии исходного набора данных — например, подмножества или отфильтрованного набора, в котором отсутствуют многие исходные изображения из полного набора данных:

Состязательные атаки на «обнуленные» предварительно обученные модели

Как насчет случаев, когда вы просто загружаете предварительно обученную модель, которая изначально была обучена на очень популярном наборе данных, и даете ей совершенно новые данные?

Модель уже обучена (например) на ImageNet, и все, что осталось, это весами, на обучение которых могли уйти недели или месяцы, и теперь они готовы помочь вам идентифицировать объекты, похожие на те, которые существовали в исходных (теперь отсутствующих) данных.

Когда исходные данные удалены из обучающей архитектуры, остается «предрасположенность» модели классифицировать объекты так, как она изначально научилась делать, что, по сути, приведет к тому, что многие из исходных «сигнатур» изменятся и станут уязвимыми однажды. снова к тем же старым методам Adversarial Image Attack.

Эти веса ценны. Без данных or веса, у вас по сути есть пустая архитектура без данных. Вам придется обучать его с нуля, затратив много времени и вычислительных ресурсов, как это делали первоначальные авторы (вероятно, на более мощном оборудовании и с более высоким бюджетом, чем у вас есть).

Проблема в том, что веса уже довольно хорошо сформированы и упруги. Хотя они немного адаптируются при обучении, они будут вести себя с вашими новыми данными так же, как и с исходными данными, создавая сигнатурные особенности, которые атакующая система может использовать обратно.

В долгосрочной перспективе это также сохраняет «ДНК» наборов данных компьютерного зрения, которые двенадцать и более лет, и, возможно, прошли заметную эволюцию от усилий с открытым исходным кодом к коммерческому развертыванию — даже там, где исходные обучающие данные были полностью выброшены за борт в начале проекта. Некоторые из этих коммерческих развертываний могут не состояться еще в течение многих лет.

Белый ящик не нужен

Что касается второй распространенной критики систем состязательной атаки по изображениям, авторы новой статьи обнаружили, что их способность обманывать системы распознавания с помощью созданных изображений цветов легко переносима на ряд архитектур.

Отмечая, что их метод «универсальных натуралистических состязательных патчей» (TnT) является первым, в котором для обмана систем распознавания изображений используются распознаваемые изображения (а не случайные помехи), авторы также заявляют:

«[TnT] эффективны против нескольких современных классификаторов, начиная от широко используемых ШирокийResNet50 в задаче Крупномасштабное визуальное распознавание IMAGEnet набор данных для VGG-моделей лица в задаче распознавания лиц ПабФиг набор данных в обоих целевое и нецелевой атаки.

«TnT могут обладать: i) натурализмом, достижимым [с] триггерами, используемыми в методах атаки троянов; и ii) обобщение и переносимость состязательные примеры в другие сети.

«Это вызывает опасения по поводу безопасности и защиты уже развернутых DNN, а также будущих развертываний DNN, когда злоумышленники могут использовать незаметные естественно выглядящие патчи объектов, чтобы ввести в заблуждение системы нейронных сетей, не вмешиваясь в модель и не рискуя быть обнаруженными».

Авторы предполагают, что обычные контрмеры, такие как снижение качества Clean Acc. сети, теоретически может обеспечить некоторую защиту от патчей TnT, но это «TnT все еще могут успешно обходить эти доказуемые методы защиты SOTA, при этом большинство защитных систем достигают 0% надежности».

Возможные другие решения включают федеративное обучение, где происхождение изображений защищено, и новые подходы, которые могут напрямую «шифровать» данные во время обучения, такие как один недавно предложил Нанкинский университет аэронавтики и астронавтики.

Даже в этих случаях было бы важно тренироваться на подлинном уровне. new данные изображения — к настоящему времени изображения и связанные с ними аннотации в небольшом количестве самых популярных наборов данных CV настолько встроены в циклы разработки по всему миру, что больше напоминают программное обеспечение, чем данные; программное обеспечение, которое часто не обновлялось годами.

Заключение

Атаки состязательного изображения стали возможными не только благодаря практике машинного обучения с открытым исходным кодом, но и благодаря корпоративной культуре разработки ИИ, мотивированной повторным использованием хорошо зарекомендовавших себя наборов данных компьютерного зрения по нескольким причинам: они уже доказали свою эффективность; они намного дешевле, чем «начинать с нуля»; и они поддерживаются и обновляются авангардными умами и организациями в академических и отраслевых кругах с такими уровнями финансирования и персонала, которые одной компании было бы трудно воспроизвести.

Кроме того, во многих случаях, когда данные не являются оригинальными (в отличие от CityScapes), изображения были собраны до недавних споров о конфиденциальности и методах сбора данных, оставив эти старые наборы данных в своего рода полулегальное чистилище с точки зрения компании это может утешительно выглядеть как «безопасная гавань».

ТнТ атакует! Универсальные натуралистические состязательные патчи против систем глубокой нейронной сети в соавторстве с Bao Gia Doan, Minhui Xue, Ehsan Abbasnejad, Damith C. Ranasinghe из Университета Аделаиды вместе с Shiqing Ma из Департамента компьютерных наук Университета Рутгерса.

Обновлено 1 декабря 2021 г., 7:06 GMT+2 — исправлена опечатка.