Искусственный интеллект

Неуловимое определение ‘Дипфейка’

Привлекательное новое исследование из Германии критикует определение термина ‘дипфейк’ в законе ЕС об ИИ как слишком расплывчатое, особенно в контексте манипуляции цифровыми изображениями. Авторы утверждают, что акцент закона на содержании, похожем на реальных людей или события – но потенциально выглядящем фальшивым – не имеет ясности.

Они также подчеркивают, что исключения закона для ‘стандартной редакции’ (т.е. якобы незначительных изменений изображений с помощью ИИ) не учитывают как повсеместное влияние ИИ в потребительских приложениях, так и субъективный характер художественных конвенций, предшествующих появлению ИИ.

Неточные законы по этим вопросам приводят к двум основным рискам: ‘охлаждению’, когда широкий интерпретативный объем закона подавляет инновации и внедрение новых систем; и ‘соблазну’, когда закон игнорируется как чрезмерный или нерелевантный.

В любом случае, расплывчатые законы фактически передают ответственность за установление практических юридических определений на будущие судебные решения – осторожный и риск-аверсный подход к законодательству.

Технологии манипуляции изображениями на основе ИИ остаются заметно впереди способности законодательства решать их, кажется. Например, одним из заметных примеров растущей эластичности концепции ИИ-обусловленной ‘автоматической’ пост-обработки, отмечает статья, является функция ‘Оптимизатор сцены’ в недавних камерах Samsung, которая может заменить изображения луны, сделанные пользователем (трудной темой), на ИИ-обусловленное, ‘отшлифованное’ изображение:

Вверху слева, пример из новой статьи реального изображения луны, сделанного пользователем, слева от версии, автоматически созданной с помощью Оптимизатора сцены; Справа, официальная иллюстрация Samsung процесса behind этого; Внизу слева, примеры из Reddit-пользователя u/ibreakphotos, показывающие (слева) намеренно размытое изображение луны и (справа), переосмысление Samsung этого изображения – даже хотя исходным фото было изображение монитора, а не реальной луны. Источники (по часовой стрелке от верхнего левого): https://arxiv.org/pdf/2412.09961; https://www.samsung.com/uk/support/mobile-devices/how-galaxy-cameras-combine-super-resolution-technologies-with-ai-to-produce-high-quality-images-of-the-moon/; https:/reddit.com/r/Android/comments/11nzrb0/samsung_space_zoom_moon_shots_are_fake_and_here/

В нижней части изображения выше мы видим два изображения луны. Изображение слева – фото сделанное пользователем Reddit. Здесь изображение было намеренно размыто и уменьшено пользователем.

Справа от него мы видим фото того же ухудшенного изображения, сделанного с помощью камеры Samsung с включенной пост-обработкой на основе ИИ. Камера автоматически ‘усовершенствовала’ распознанное ‘объект луны’, даже хотя это не была реальная луна.

Статья подвергает более глубокой критике функцию Best Take в недавних смартфонах Google – противоречивую функцию ИИ, которая редактирует ‘лучшие’ части группового фото, сканируя несколько секунд фотографической последовательности, чтобы улыбки были сдвинуты вперед или назад во времени по мере необходимости – и никто не показан в середине моргания.

Статья утверждает, что этот тип композитного процесса имеет потенциал исказить события:

‘[В] типичной групповой фотографии средний зритель, вероятно, все равно будет считать полученное фото аутентичным. Улыбка, которая была вставлена, существовала в течение нескольких секунд от остальной части фото.

‘С другой стороны, десятисекундный интервал функции лучшего кадра достаточен для изменения настроения. Человек мог перестать улыбаться, в то время как остальная часть группы смеется над шуткой за его счет.

‘В результате мы предполагаем, что такая групповая фотография может хорошо составлять дипфейк.’

Новая статья озаглавлена Что составляет дипфейк? Размытая граница между законной обработкой и манипуляцией в соответствии с законом ЕС об ИИ, и исходит от двух исследователей из Лаборатории вычислительного права в Университете Тюбингена и Университета Саарланда.

Старые трюки

Манипулирование временем в фотографии намного старше, чем потребительский ИИ. Авторы новой статьи отмечают существование намного более старых методов, которые можно рассматривать как ‘неаутентичные’, таких как объединение нескольких последовательных изображений в изображение с высоким динамическим диапазоном (HDR) или ‘‘сшитое’ панорамное фото.

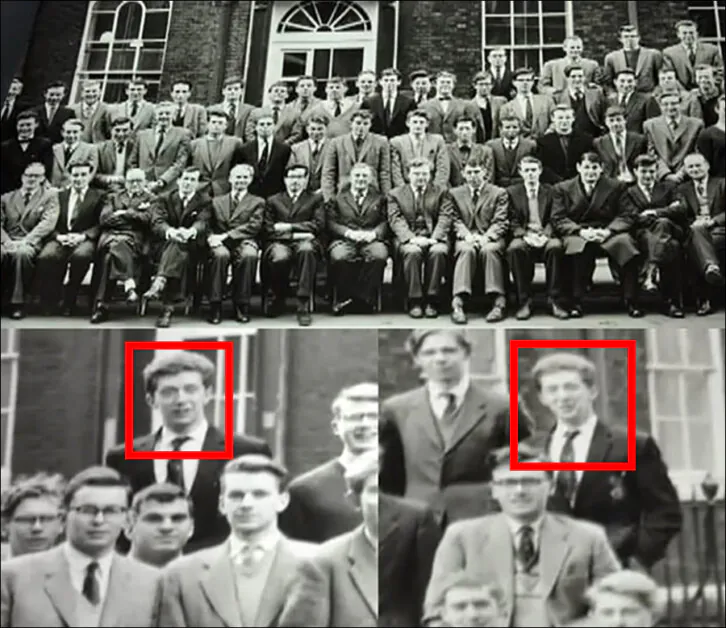

Действительно, некоторые из самых старых и забавных фотографических фейков традиционно создавались школьниками, бегущими от одного конца школьной группы к другому, впереди траектории специальных панорамных камер, которые когда-то использовались для спортивной и школьной групповой фотографии – что позволяло ученику появиться дважды в одном изображении:

Искушение обмануть панорамные камеры во время групповых фотографий было слишком велико, чтобы сопротивляться многим студентам, которые были готовы рискнуть плохой сессией в офисе директора, чтобы ‘клонировать’ себя в школьных фотографиях. Источник: https://petapixel.com/2012/12/13/double-exposure-a-clever-photo-prank-from-half-a-century-ago/

Если вы не делаете фотографию в режиме RAW, который по сути сбрасывает датчик объектива камеры в очень большой файл без какой-либо интерпретации, вероятно, ваши цифровые фотографии не являются完全 аутентичными. Системы камер обычно применяют ‘улучшающие’ алгоритмы, такие как резкость изображения и баланс белого, по умолчанию – и делают это с момента возникновения потребительской цифровой фотографии.

Авторы новой статьи утверждают, что даже эти более старые типы цифровой фотографической аугментации не представляют ‘реальность’, поскольку такие методы предназначены для того, чтобы сделать фотографии более приятными, а не более ‘реальными’.

Исследование предполагает, что закон ЕС об ИИ, даже с последующими поправками, такими как рециталы 123–27, помещает все фотографическое выходное в доказательную основу, не подходящую для контекста, в котором фотографии производятся сегодня, в отличие от (номинально объективной) природы кадров безопасности или судебной фотографии. Большинство изображений, рассматриваемых в законе ЕС об ИИ, с большей вероятностью происходят из контекстов, в которых производители и онлайн-платформы активно продвигают творческую интерпретацию фотографий, включая использование ИИ.

Исследователи предлагают, что фотографии ‘никогда не были объективным изображением реальности’. Учет таких факторов, как местоположение камеры, выбранный диапазон глубины и выбор освещения, все способствуют тому, чтобы сделать фотографию глубоко субъективной.

Статья отмечает, что обычные задачи ‘очистки’ – такие как удаление пыли датчика или нежелательных линий электропередачи из хорошо составленной сцены – были только полу-автоматизированы до появления ИИ: пользователям приходилось вручную выбирать область или инициировать процесс, чтобы достичь желаемого результата.

Сегодня эти операции часто запускаются текстовыми подсказками пользователя, наиболее заметно в инструментах, таких как Photoshop. На потребительском уровне такие функции становятся все более автоматизированными без ввода пользователя – результат, который, по-видимому, рассматривается производителями и платформами как ‘очевидно желательный’.

Разбавленное значение ‘Дипфейка’

Центральной задачей для законодательства вокруг ИИ-измененных и ИИ-генерируемых изображений является двусмысленность термина ‘дипфейк’, который имел свой смысл заметно расширен за последние два года.

Первоначально термины применялись только к видеовыходу из систем на основе автоэнкодера, таких как DeepFaceLab и FaceSwap, оба полученные из анонимного кода, опубликованного на Reddit в конце 2017 года.

С 2022 года приход латентных диффузионных моделей (ЛДМ) таких как Stable Diffusion и Flux, а также текст-в-видео систем, таких как Sora, также позволили бы замене идентичности и настройке, с улучшенной разрешающей способностью, универсальностью и верностью. Теперь стало возможным создавать диффузионные модели, которые могут изображать знаменитостей и политиков. Поскольку термин ‘дипфейк’ уже был сокровищем, привлекающим заголовки для производителей СМИ, он был расширен, чтобы покрыть эти системы.

Позже, как в СМИ, так и в научной литературе, термин также включил текстовую имитацию. К этому моменту исходный смысл ‘дипфейка’ был почти потерян, в то время как его расширенный смысл постоянно эволюционировал и становился все более и более разбавленным.

Но поскольку слово было так взрывоопасным и галванизирующим, и было теперь мощной политической и медиа-точкой, оно оказалось невозможным отказаться от него. Оно привлекало читателей на веб-сайты, финансирование исследователям и внимание политиков. Эта лексическая двусмысленность является основным焦点ом нового исследования.

Как отмечают авторы, статья 3(60) закона ЕС об ИИ очерчивает четыре условия, которые определяют ‘дипфейк’.

1: Истинная луна

Прежде всего, содержание должно быть сгенерировано или манипулировано, т.е. либо создано с нуля с помощью ИИ (генерация), либо изменено из существующих данных (манипуляция). Статья подчеркивает трудность в различении ‘допустимых’ результатов редактирования изображений и манипулятивных дипфейков, учитывая, что цифровые фотографии, в любом случае, никогда не являются истинными представлениями реальности.

Статья утверждает, что сгенерированная Samsung луна является, по сути, аутентичной, поскольку луна вряд ли изменит свой вид, и поскольку ИИ-генерируемое содержание, обученное на реальных изображениях луны, вероятно, будет точным.

Однако авторы также заявляют, что поскольку система Samsung была показана как генерирующая ‘усовершенствованное’ изображение луны в случае, когда исходным изображением было не луна сама, это будет считаться ‘дипфейком’.

Было бы нецелесообразно составить полный список различных случаев вокруг этого типа ад хок-функциональности. Следовательно, бремя определения кажется проходит, опять же, к судам.

2: Текстовые фейки

Во-вторых, содержание должно быть в форме изображения, аудио или видео. Текстовое содержание, хотя и подвергается другим обязательствам по прозрачности, не считается дипфейком в соответствии с законом ЕС об ИИ. Это не рассматривается в новом исследовании, хотя оно может иметь заметное влияние на эффективность визуальных дипфейков (см. ниже).

3: Реальные проблемы

В-третьих, содержание должно похожать на существующих людей, объекты, места, сущности или события. Это условие устанавливает связь с реальным миром, что означает, что чисто фабрикованные изображения, даже если они фотореалистичны, не будут считаться дипфейками. Рецитал 134 закона ЕС об ИИ подчеркивает аспект ‘похожести’ добавлением слова ‘заметно’ (очевидное отступление к последующим юридическим решениям).

Авторы, ссылаясь на предыдущую работу, рассматривают, нужно ли ИИ-генерируемому лицу принадлежать реальному человеку или достаточно ли ему быть достаточно podobnym реальному человеку, чтобы удовлетворить это определение.

Например, как можно определить, имеет ли последовательность фотореалистичных изображений, изображающих политика Дональда Трампа, цель имитации, если изображения (или прикрепленные тексты) не упоминают его конкретно? Распознавание лиц? Опросы пользователей? Определение судьи ‘здравым смыслом’?

Возвращаясь к вопросу ‘Текстовых фейков’ (см. выше), слова часто составляют значительную часть акта визуального дипфейка. Например, можно взять (не измененное) изображение или видео ‘лица а’‘, и сказать, в подписи или социальном медиа-посте, что изображение является ‘лицом б’‘ (предполагая, что два человека похожи).

В таком случае не нужно ИИ, и результат может быть поразительно эффективным – но является ли такой низкотехнологичный подход также ‘дипфейком’?

4: Ретушь, переделка

Наконец, содержание должно показаться аутентичным или правдивым для человека. Это условие подчеркивает восприятие человеческих зрителей. Содержание, которое признается только алгоритмом как представляющее реального человека или объект, не будет считаться дипфейком.

Среди всех условий в 3(60) это самое очевидное отступление к последующим судебным решениям, поскольку оно не позволяет никакой интерпретации через технические или механизированные средства.

Есть явные трудности в достижении консенсуса по такому субъективному положению. Авторы отмечают, например, что разные люди и разные типы людей (такие как дети и взрослые) могут быть по-разному склонны верить в определенный дипфейк.

Авторы进一步 отмечают, что передовые возможности ИИ инструментов, таких как Photoshop, бросают вызов традиционным определениям ‘дипфейка’. Хотя эти системы могут включать базовые меры безопасности против спорного или запрещенного контента, они значительно расширяют понятие ‘ретуши’. Пользователи теперь могут добавлять или удалять объекты в высоко правдоподобной, фотореалистичной манере, достигая профессионального уровня аутентичности, который переопределяет границы манипуляции изображением.

Авторы заявляют:

‘Мы утверждаем, что текущее определение дипфейков в законе ЕС об ИИ и соответствующие обязательства не достаточно конкретизированы, чтобы решить проблемы, связанные с дипфейками. Анализируя жизненный цикл цифровой фотографии от датчика камеры до цифровых функций редактирования, мы обнаруживаем, что:

‘(1.) Дипфейки плохо определены в законе ЕС об ИИ. Определение оставляет слишком много места для того, что такое дипфейк.

‘(2.) Неясно, как функции редактирования, такие как функция “лучший кадр” Google, могут быть рассмотрены как исключение из обязательств по прозрачности.

‘(3.) Исключение для существенно отредактированных изображений вызывает вопросы о том, что составляет существенную редакцию контента и должно ли это редактирование быть воспринимаемым естественным человеком.’

Принятие исключения

Закон ЕС об ИИ содержит исключения, которые, по мнению авторов, могут быть очень пермиссивными. Статья 50(2), они заявляют, предлагает исключение в случаях, когда большинство исходного изображения не изменено. Авторы отмечают:

‘Что можно считать содержанием в смысле статьи 50(2) в случаях цифрового аудио, изображений и видео? Например, в случае изображений, нужно ли учитывать пространство пикселей или воспринимаемое человеком пространство? Существенные манипуляции в пространстве пикселей могут не изменить человеческое восприятие, и, с другой стороны, небольшие возмущения в пространстве пикселей могут изменить восприятие значительно.’

Исследователи предоставляют пример добавления пистолета к фотографии человека, который указывает на кого-то. Добавляя пистолет, вы изменяете не более 5% изображения; однако, семантическое значение измененного участка заметно. Поэтому кажется, что это исключение не учитывает никакого ‘общепонятного’ понимания того, как небольшой деталь может повлиять на общее значение изображения.

Статья 50(2) также позволяет исключения для ‘помощной функции для стандартной редакции’. Поскольку закон не определяет, что означает ‘стандартная редакция’, даже пост-обработочные функции, такие как функция Best Take Google, кажется, защищены этим исключением, отмечают авторы.

Заключение

Заявленной целью новой работы является поощрение междисциплинарного изучения регулирования дипфейков и служить началом новых диалогов между компьютерными учеными и юридическими учеными.

Однако сама статья подвергается тавтологии в нескольких точках: она часто использует термин ‘дипфейк’, как если бы его значение было самоочевидным, в то время как критикует закон ЕС об ИИ за неопределенность определения того, что действительно составляет дипфейк.

Первоначально опубликовано в понедельник, 16 декабря 2024 г.