Этика

База данных инцидентов ИИ направлена на то, чтобы сделать алгоритмы ИИ более безопасными

Любая достаточно большая система будет иметь ошибки, и часть исправления этих ошибок заключается в наличии базы данных об них, которую можно проанализировать на предмет последствий и потенциальных причин. Как и FDA поддерживает базу данных для неблагоприятных реакций на лекарства, или Национальный совет по безопасности на транспорте поддерживает базу данных для авиационных аварий, База данных инцидентов ИИ является базой данных предназначенной для каталогизации неисправностей систем ИИ и для помощи исследователям ИИ в разработке новых методов избежания этих неисправностей. Создатели Базы данных инцидентов ИИ (AIID) надеются, что она поможет компаниям ИИ разрабатывать более безопасные, более этические системы ИИ.

Что такое AIID?

AIID является продуктом организации Partnership on AI (PAI). PAI была первоначально основана в 2016 году членами команд исследований ИИ в крупных технологических компаниях, таких как Facebook, Apple, Amazon, Google, IBM и Microsoft. С тех пор организация набрала членов из многих других организаций, включая различные некоммерческие организации. В 2018 году PAI начала создавать единый стандарт классификации для неисправностей ИИ. Однако не было коллекции инцидентов ИИ, на основе которой можно было бы создать эту классификацию. По этой причине PAI создала AIID.

Согласно TechTalks, формат AIID был информирован структурой базы данных авиационных аварий, поддерживаемой Национальным советом по безопасности на транспорте. Поскольку отчеты начали собираться в 1996 году, система коммерческих авиаперелетов смогла увеличить безопасность авиационной промышленности, архивируя и анализируя инциденты. Надеются, что аналогичный репозиторий инцидентов ИИ может сделать системы ИИ более безопасными, более этическими и более надежными. AIID также взяла вдохновение из базы данных Common Vulnerabilities and Exposures, которая является репозиторием заметных неисправностей программного обеспечения, охватывающих различные отрасли и дисциплины.

Шон Макгрегор является ведущим техническим консультантом в IBM для Watson AI XPRIZE. Макгрегор также отвечает за надзор за разработкой фактической базы данных AIID. Макгрегор объяснил, что конечная цель AIID заключается в предотвращении того, чтобы системы ИИ причиняли вред, или хотя бы уменьшить тяжесть неблагоприятных инцидентов. Как отметил Макгрегор, системы машинного обучения значительно более сложны и непредсказуемы, чем традиционные программные системы, и в результате они не могут быть протестированы таким же образом, как и другое программное обеспечение. Системы машинного обучения могут изменять свое поведение непредсказуемым образом. Макгрегор отмечает, что способность систем глубокого обучения к обучению может означать, что “неисправности более вероятны, более сложны и более опасны”, когда они входят в неструктурированный мир.

Более 1 000 инцидентов, связанных с ИИ, зарегистрировано

Поскольку AIID была первоначально создана, в базу данных было зарегистрировано более 1 000 инцидентов, связанных с ИИ. Из всех инцидентов в базе данных проблемы, связанные с справедливостью ИИ, были наиболее распространенным типом неблагоприятного инцидента. Многие из этих инцидентов справедливости включают использование алгоритмов распознавания лиц государственными агентствами. Макгрегор также отмечает, что в базу данных добавляется все больше инцидентов, связанных с робототехникой.

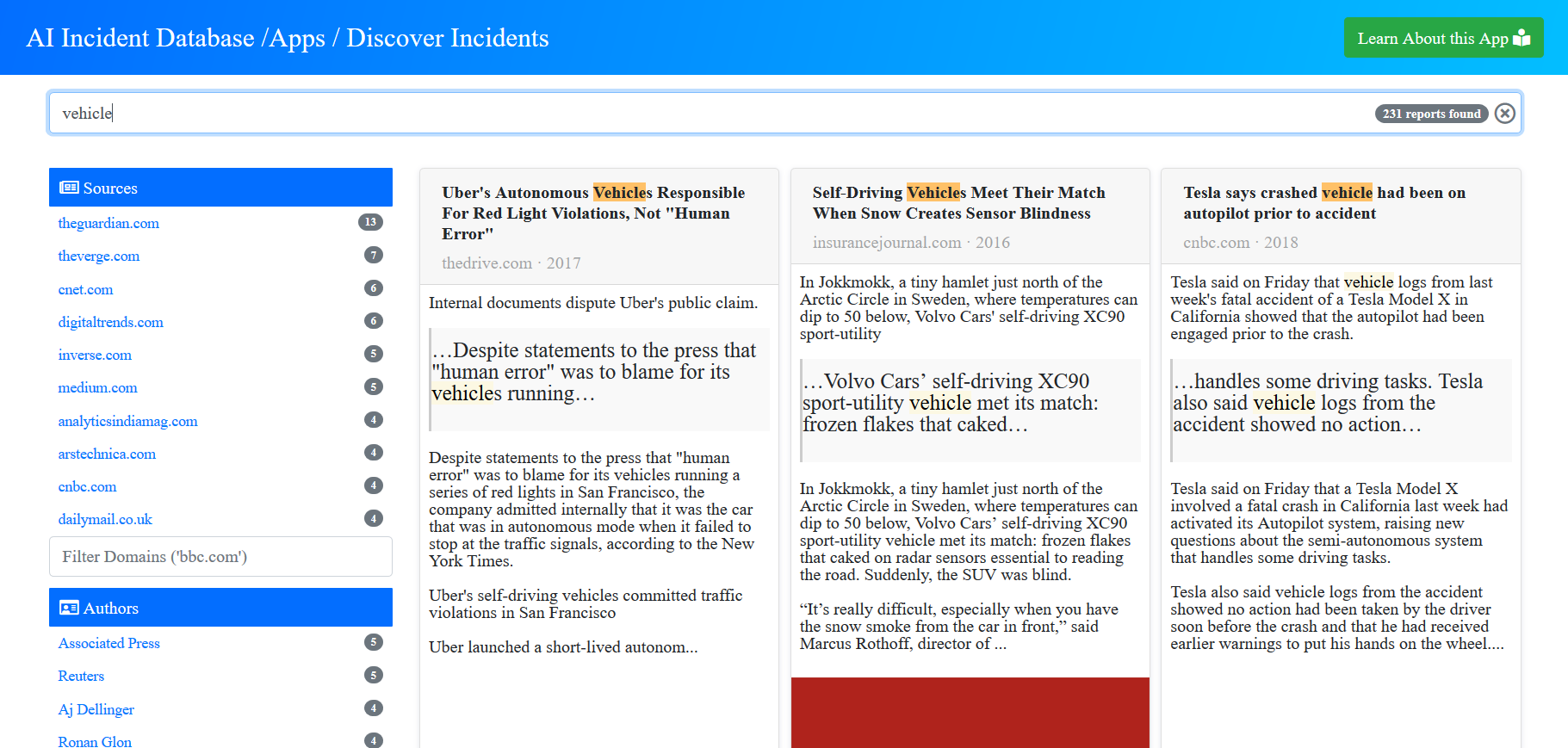

Посетители базы данных могут выполнять запросы, искать инциденты в базе данных на основе критериев, таких как ключевые слова, идентификатор инцидента, источник или автор. Например, выполнение поиска по запросу “Deepfake” возвращает 7 отчетов, а поиск по запросу “роботы” возвращает 158 отчетов.

Централизованная база данных для инцидентов неисправного функционирования ИИ и его работы в непредсказуемых способах может помочь исследователям, инженерам и этикам контролировать разработку и развертывание систем ИИ. Менеджеры по продукту в технологических компаниях могут использовать AIID, чтобы увидеть, есть ли какие-либо потенциальные проблемы перед использованием систем рекомендаций ИИ, или инженер ИИ может получить представление о потенциальных предубеждениях, которые необходимо исправить при создании приложения ИИ. Аналогично, офицеры по риску могут использовать базу данных, чтобы определить потенциальные негативные последствия, связанные с моделью ИИ, что позволяет им планировать вперед и разрабатывать меры по смягчению потенциального вреда.

Архитектура, лежащая в основе AIID, предназначена для гибкости, что позволяет создавать новые инструменты для запросов базы данных и извлечения осмысленных выводов. Partnership on AI и Макгрегор будут сотрудничать в разработке гибкой таксономии, которую можно использовать для классификации всех форм инцидентов ИИ. Команда надеется, что как только гибкая таксономия будет создана, ее можно будет объединить с автоматизированной системой, которая будет автоматически регистрировать инциденты ИИ.

“Сообщество ИИ начало обмениваться записями инцидентов друг с другом, чтобы мотивировать изменения в своих продуктах, процедурах контроля и программах исследований”, объяснил Макгрегор через TechTalks. “Сайт был公开 выпущен в ноябре, поэтому мы только начинаем осознавать выгоды от системы.”