Взгляд Anderson

Трансляция AI-Аватаров Как В 1999

Новое исследование представляет способ трансляции похожих на жизнь 3D-аватаров, которые появляются почти мгновенно и уточняются в реальном времени, вместо того, чтобы заставлять пользователей ждать завершения огромных загрузок.

Во многих отношениях, огромные требования к ресурсам генеративного ИИ и систем ИИ-ассистированного рендеринга отбросили потребительскую готовность назад на двадцать или более лет. Только в 2023 году, выделение 64 ГБ ОЗУ в ноутбуке или настольном компьютере казалось чрезмерным; теперь, с растущей популярностью ОЗУ и/или отложения CPU, 64 ГБ кажется довольно скромным для местных потребностей ИИ; и эти когда-то банальные и доступные элементы ПК продолжают rocket в цене как корпорации борются за удовлетворение спроса на услуги ИИ.

Масштаб и жадность ИИ и его процессов и сред通常 превосходят потребительское оборудование, и даже запуск “урезанных” локально-ориентированных моделей в качестве версий GGUF обычно напрягает среднюю систему.

Даже текстовые услуги ИИ, такие как ChatGPT, подвержены значительному напряжению как на клиентском, так и на серверном уровне. Следовательно, когда ИИ поручено доставлять онлайн-мультимедийные trải nghiệm в реальном времени, мы можем разумно ожидать некоторых очень серьезных компромиссов в задержке и/или качестве – подобно ранним трудностям интернета со стримингом мультимедиа и ненавистным анимированным иконкам “буферизации” RealPlayer и QuickTime.

В последний раз, когда мультимедийные и сетевые проблемы создавали трение в пользовательском опыте, потребительское оборудование все еще эволюционировало через закон Мура, становясь почти экспоненциально лучше каждый год, даже когда ОС, сети и другая поддерживающая инфраструктура эволюционировали, чтобы удовлетворить спрос; и за последние десять лет, более или менее, возможности потребительской технологии превосходили мультимедийные требования (может быть, даже до такой степени, что нужно было запустить обновление, чтобы поддерживать продажи).

Но этот избыток локальной способности может скоро подойти к концу, поскольку локальное оборудование становится менее мощным и более дорогим, и поскольку услуги, основанные на ИИ, требуют более высоких серверных и локальных ресурсов.

Получение Головы

В до-бродбэнд-эру, даже до ранних возможных видеопотоков, веб-пользователи привыкли к изображениям, которые медленно приходили в фокус, как прогрессивные JPEG позволяли пользователям с ограниченной пропускной способностью смотреть, как загружаемое изображение формируется, иногда очень медленно, поскольку загружалось больше данных изображения.

Теперь, кажется, мы можем ожидать подобного опыта с помощью ИИ-усиленных аватаров Gaussian Splat:

Нажмите, чтобы воспроизвести. Из нового проекта ProgressiveAvatars, сравнение стриминга аватаров Gaussian. Источник

Выше мы видим две версии аватара Gaussian Splat – представление человека, частично облегченное не-ИИ-техникой рендеринга, которая восходит к началу 1990-х годов, и также более современными методами, такими как FLAME параметрическая модель человека и подходы к обучению на основе ИИ:

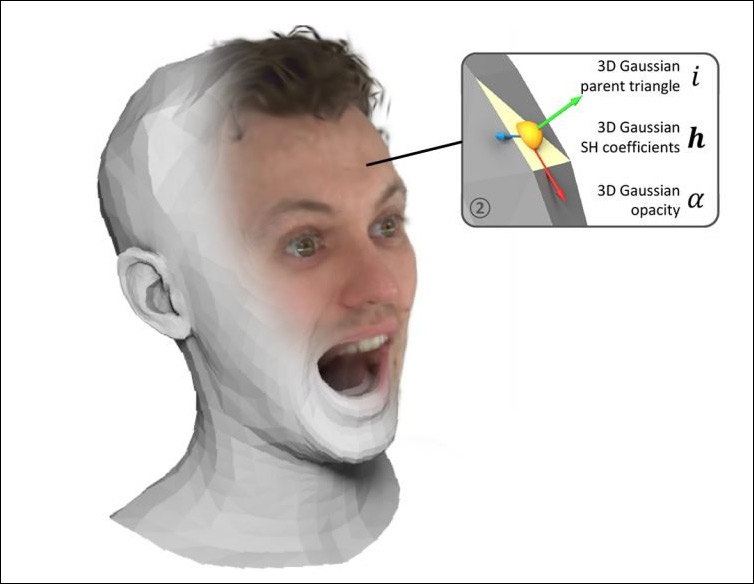

Gaussian Splatting использует представление Гаусса цвета и 3D-информации вместо пикселя или вокселя и отображает это ультрареалистичное текстурирование на более традиционную сетку CGI, которая сама облегчается ‘параметрическим человеком’, CGI-лицом и/или телом, в системах таких как FLAME и STAR. Источник

На левой стороне в видео выше мы можем увидеть, что традиционная реализация аватара Gaussian Splat выглядит довольно ужасно, пока мы ждем загрузки данных. На правой стороне новая реализация из Китая, называемая ProgressiveAvatars, может разрешиться гораздо более элегантно, пока данные загружаются, представляя не тревожное человеческое изображение с самого начала.

Авторы утверждают, что их метод является первым, который действительно ‘стримит’ аватар Гаусса, и, безусловно, первым, который делает это прогрессивным образом, где изображение строится элегантно, и наиболее важные области – такие как глаза и губы – могут быть приоритизированы, так что аватар может стать разговорным, даже когда только частично загружен:

Нажмите, чтобы воспроизвести. С сайта проекта ProgressiveAvatars, иллюстрация загрузки, осведомленной о внимании.

До этого ‘уровень детализации’ (LOD) подход использовался в предыдущих попытках уменьшить ‘GSplat’ аватары, подобно оптимизациям видеоигр, где последовательно более подробные версии человека загружаются в зависимости от того, занимает ли он достаточно viewport или внимания зрителя, чтобы стоить усилий.

Конечно, это подразумевает значительное количество избыточных ‘запасных’ аватаров, и авторы представляют свой подход как более рациональную систему. Точно так же, метод такого рода также позволяет вносить изменения в фигуру GSplat (т.е. настройку) без необходимости распространять такие изменения через цепочку различных LOD ‘близнецов’.

Эмерджентная Домен

Если это кажется нишевой проблемой, ну, так же было и со стримингом видео в дни, когда получение работы ранних плагинов было поручено ближайшему доступному нерду. Кроме того, потенциал для представлений на основе ИИ-стриминга распространяется за пределы человеческих аватаров, простираясь на генерацию города, игры и 3D-основанные* версии практически любой онлайн-домены – такие как Виртуальная примерка, для покупки одежды:

Нажмите, чтобы воспроизвести. Из проекта 2024 года, грубый взгляд на будущее онлайн-‘примерки’. Другие проекты стремятся добавить движение и интерактивность – требовательные аспекты для стриминга и управления. Источник

Точно так же, как подходы на основе LOD до сих пор в основном использовались видеоиграми, многие другие соображения, которые когда-то были исключительной провинцией разработки игр, вероятно, постучатся в представления на основе Splat. Например, большинство этих ранних GSplat выходов изображают одного человека гурно и мугно, или, может быть, говорящего; но многие ситуации будут нужны, в которых будут представлены несколько людей, а также окружающие особенности и атмосфера – сценарий, в котором высокопроизводительные ‘триажные’ системы будут определять, где данные потока нужно приоритизировать, чтобы сохранить зрителя в моменте.

Статья новая статья озаглавлена ProgressiveAvatars: Прогрессивные анимированные 3D-аватары Гаусса, и исходит от трех исследователей Университета науки и технологии Китая в Хэфэе.

Метод

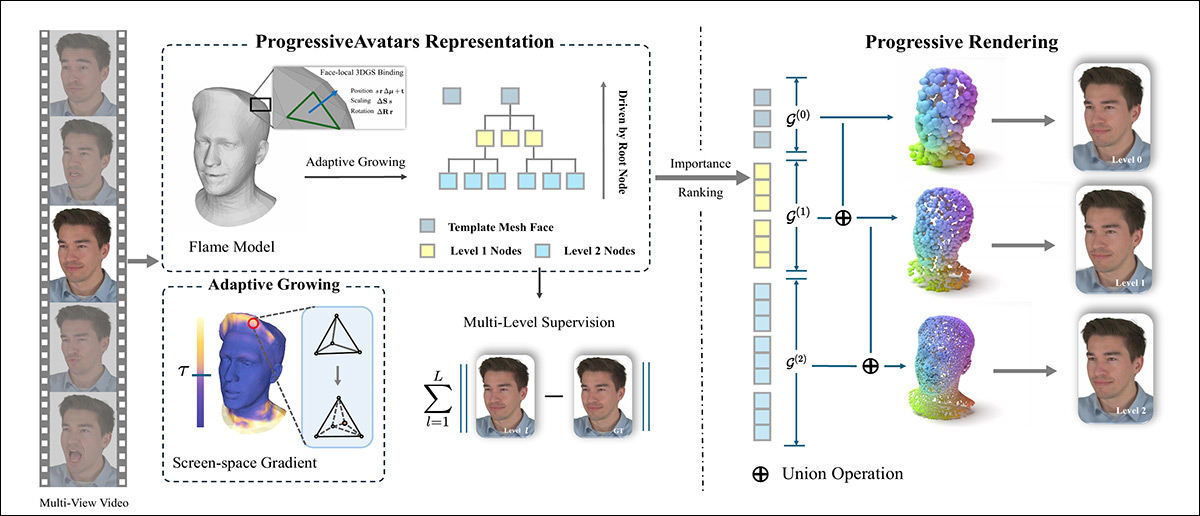

Подход изначально опирается на видео человека. Для каждого кадра стандартная FLAME параметрическая модель лица подгоняется, так что форма и выражение лица меняются со временем, в то время как базовая сеточная структура остается фиксированной. Поскольку базовая топология не меняется, стабильный шаблон FLAME может быть повторно использован и усовершенствован вместо того, чтобы быть перестроенным с нуля каждый момент, как это происходит в подобных предыдущих работах:

Видео головы сначала подгоняется с отслеживаемой сеткой FLAME, после чего 3D-Гауссы прикрепляются к каждому лицу и иерархически растут там, где градиенты экранного пространства указывают на отсутствие деталей. Во время обучения эта адаптивная субдивизия строит многоуровневое представление под многовидовой надзором, и на момент вывода оценки важности на лицо определяют, какие Гауссы передаются первыми, позволяя аватару появляться быстро и уточняться прогрессивно, когда добавляются более подробные уровни.

Над этой базовой структурой добавляются детали слоями; поверхность подразделена на иерархию, и небольшие трехмерные Гауссы прикрепляются к лицам на каждом уровне детализации.

Хотя первоначальные более грубые слои захватывают общую форму головы и движение, последующие более тонкие слои предоставляют морщины, тонкие деформации и высокочастотную текстуру. Изображения затем рендерятся из этих Гауссов с помощью дифференцируемого рендерера Гаусса и обучаются против многовидовых основополагающих кадров, так что аватар учится воспроизводить внешний вид реального человека.

Во время обучения эта иерархия растет автоматически: области, которым нужна больше детализации, подразделяются дальше, руководствуясь сигналами экранного пространства, так что вычислительные усилия концентрируются там, где глаз зрителя наиболее вероятно заметит ошибки.

Во время вывода эта же иерархия позволяет прогрессивному стримингу, когда грубая версия аватара может быть отображена сначала, и, когда добавляются дополнительные слои, новые Гауссы могут быть добавлены без изменения того, что уже показано, позволяя анимированному аватару головы появляться быстро и становиться более четким и подробным, когда поступает больше данных.

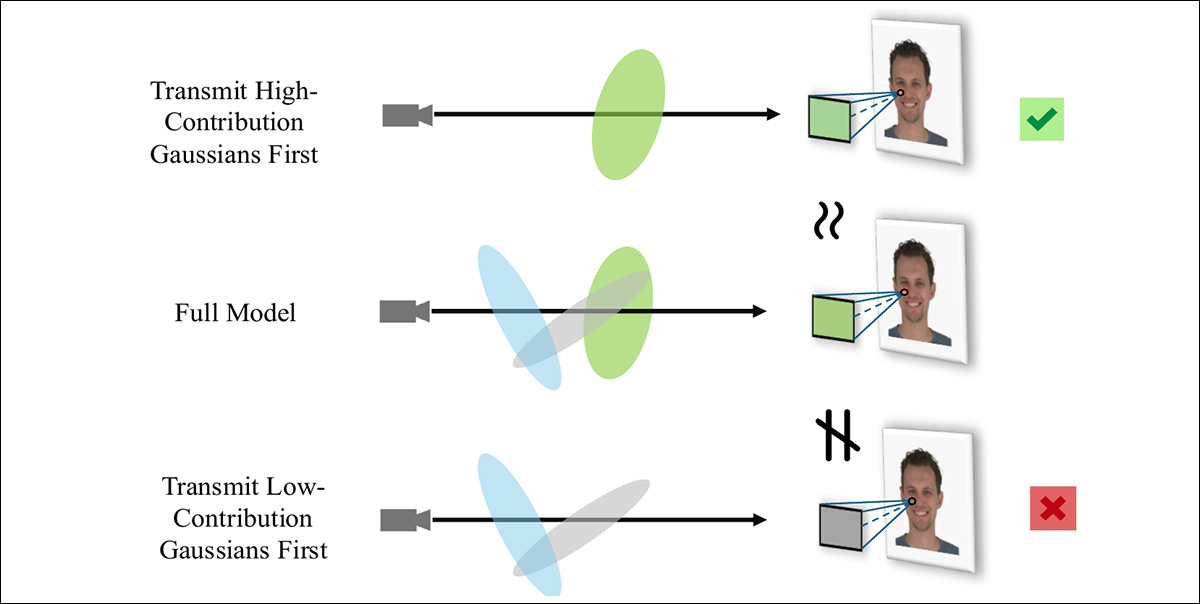

Авторы наблюдают, что вся система зависит от приоритизации входящих данных:

Когда все Гауссы на данном уровне доступны, полная модель рендерится с максимальной точностью; но во время стриминга передача Гауссов с наибольшим вкладом сначала позволяет ранним частичным результатам близко соответствовать окончательному изображению, тогда как передача Гауссов с низким вкладом сначала искажает баланс цвета и подчеркивает незначительные компоненты.

Данные и Тесты

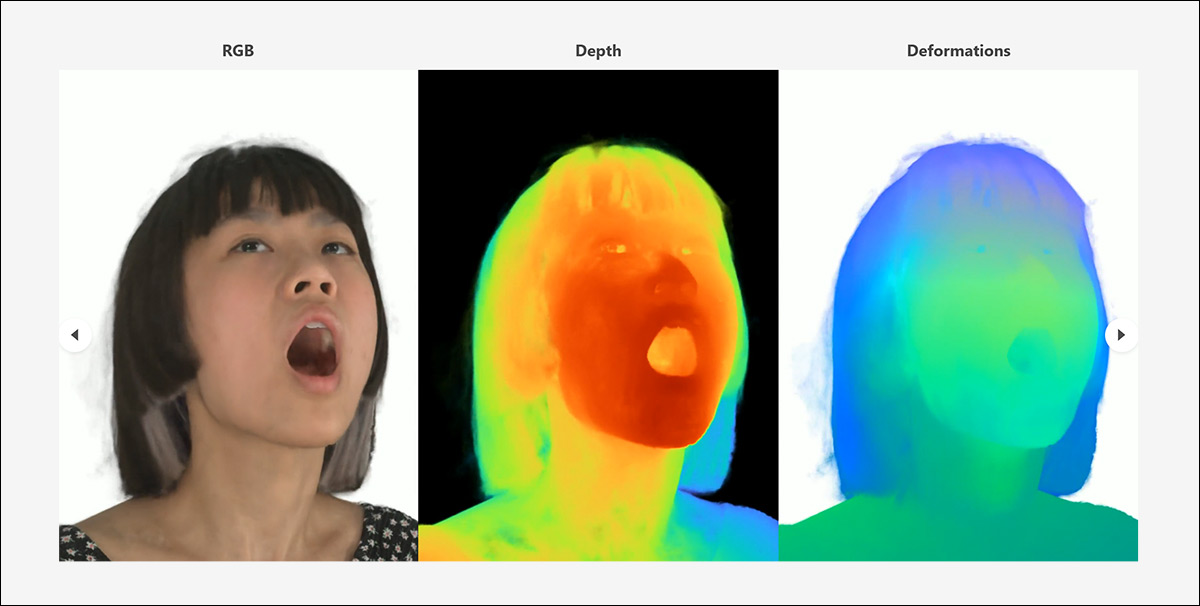

Для тестов новый метод был оценен на наборе данных NeRSemble, который состоит из многовидовых видео для каждого предмета, с откалиброванными параметрами во всех видах:

Примеры различных интерпретаций предметов, включенных в набор данных NeRSemble, использованный в тестах для ProgressiveAvatars. Источник

В соответствии с оригинальной методологией GaussianAvatars, изображения были уменьшены до 802x550px, сгенерирована маска фона, и принят исходный проектный разбиение обучающих/тестовых наборов данных.

Оптимизатор Adam был использован для обновления параметров, с скоростью обучения 1×10-2 на всех барицентрических координатах. Обучение длилось 60 000 итераций, с иерархией, автоматически расширяющейся каждые 2 000 итераций.

Сначала авторы протестировали на восстановление и анимацию – задачу преобразования плоского видео в 3D-осведомленную (x/y/x) систему, используя каноническое представление CGI FLAME в качестве якорной сетки. Для этого все базовые модели были обучены с нуля, и соперничающие рамки были протестированы как упомянутые GaussianAvatars, и PointAvatar.

Для этих тестов использовались метрики Пиковая отношение сигнал-шум (PSNR), Индекс структурированного сходства (SSIM) и Учитываемое перцептивное сходство изображений (LPIPS):

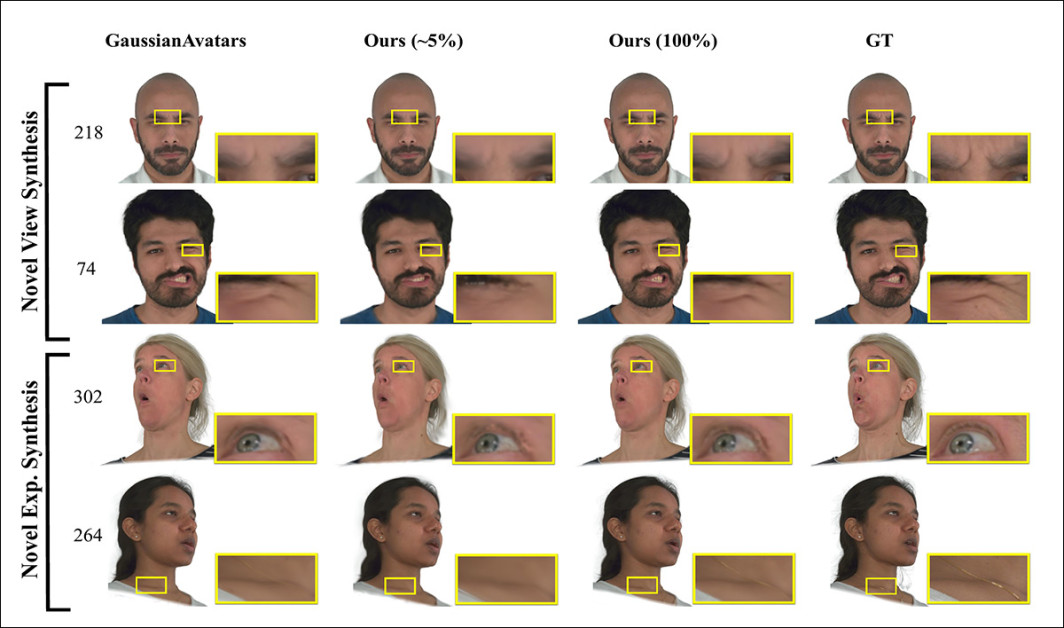

Качественное сравнение на новом синтезе вида и выражения. Базовый GaussianAvatars борется с мелкими деталями вокруг глаз, морщин и текстуры кожи, в то время как предложенный метод уже сохраняет ключевую структуру лица примерно на пять процентов переданных данных и сходится к основополагающим данным, когда стримятся больше Гауссов, близко соответствуя полной модели и ссылочным изображениям (основополагающим данным).

Относительно этих результатов, авторы утверждают:

‘[Наш] метод восстанавливает более четкие детали в нескольких областях, особенно вокруг шеи, плеч и одежды. Эти области относительно грубо разбиты в шаблоне FLAME по сравнению с зонами высокой значимости лица (например, периокулярной областью).

‘Следовательно, предыдущие методы часто выделяют слишком мало 3D-Гауссов для этих областей, чтобы верно захватить их мелкомасштабную деталь. Напротив, наша адаптивная стратегия роста увеличивает количество Гауссов и уточняет иерархию только там, где это необходимо, что делает распределение нечувствительным к неуниформной сетке FLAME.’

Авторы также отмечают, что их подход находится на уровне с методами государственного уровня, дающим рабочий аватар с тривиальным 5% разрешением пропускной способности:

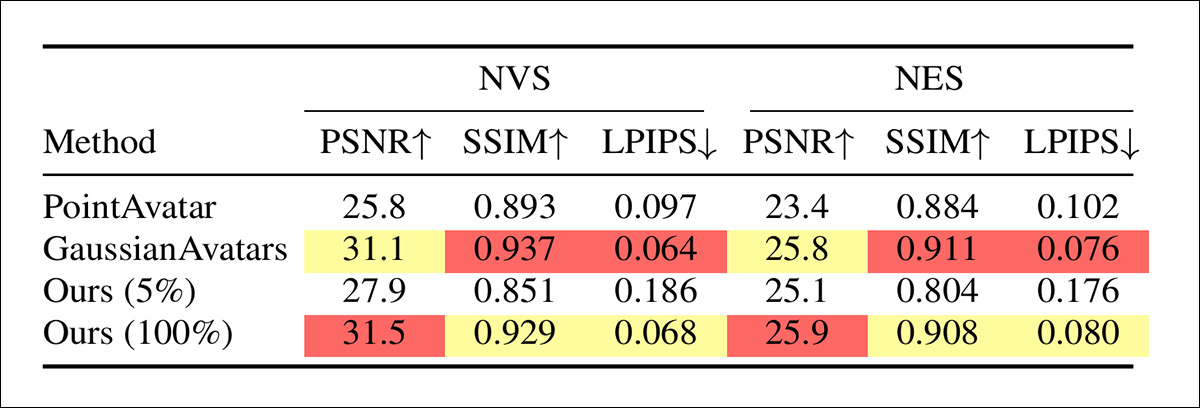

Количественное сравнение на новом синтезе вида и выражения с использованием PSNR, SSIM и LPIPS. При полной передаче предложенный метод достигает наивысшего PSNR на обоих задачах и остается конкурентоспособным с GaussianAvatars на перцептивных метриках, в то время как настройка 5% иллюстрирует компромисс качества при экстремальных ограничениях пропускной способности.

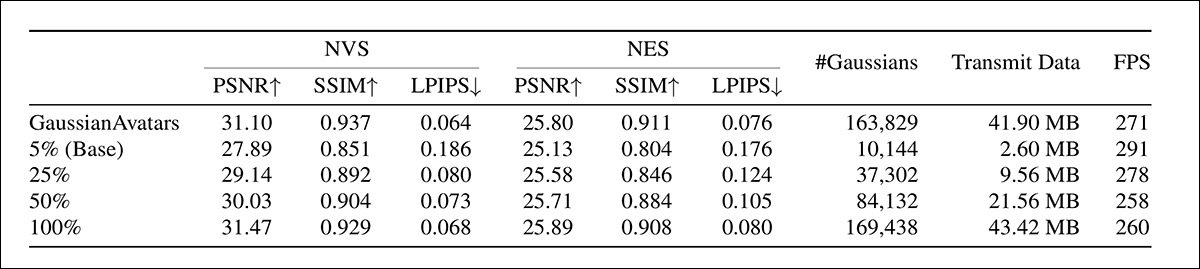

Далее исследователи протестировали сам прогрессивный рендеринг. Это было проведено на NVIDIA RTX 4090, с 24 ГБ ОЗУ, при разрешении 550x802px. В этом сценарии авторы указывают, что бюджет 25% будет использовать все ‘уровень 1’ Гауссы, а также подмножество Гауссов уровня 2, что дает грубое представление о том, как группировки Гауссов накапливают детали в более высоких номерах групп, и что более низкие номера групп по сути строят базовую холст:

Производительность при разных бюджетах передачи для нового синтеза вида и выражения, показывающая, что качество стабильно приближается или превышает GaussianAvatars, когда стримятся больше Гауссов и данных, в то время как поддерживаются скорости реального времени, на RTX 4090.

Авторы комментируют:

‘С передачей только 2,60 МБ (5% бюджета) аватар уже достигает разумного качества. Когда стримятся более высокие уровни Гауссов, тонкие структуры, такие как пуговицы на рубашке, зубы и волосы, постепенно уточняются, в то время как поддерживается временная стабильность.

‘При 100% передаче наш подход достигает качества рендеринга, сравнимого с методами SOTA. Заметно, что частота кадров не падает значительно, вероятно, потому что рабочая нагрузка 3DGS еще не насытила GPU.’

Однако авторы указывают, что в много-пользовательских сценариях VR количество 3D-Гауссов быстро вырастет до точки, где рендеринг GPU станет узким местом. В этих более тяжелых сценариях предложенный подход предлагает преимущество, позволяя системе обменивать количество примитивов на визуальное качество, облегчая нагрузку без коллапса рендеринга.

Хотя статья не детализирует это, сайт проекта содержит дополнительные сравнительные тесты, также представляющие MeGA гибридный проект аватара сетки-Гаусса:

Нажмите, чтобы воспроизвести. Одно из серии дополнительных видео со сайта проекта, это сравнение нового подхода в терминах нового синтеза вида.

Заключение

Gaussian Splatting может или не может продлиться, или даже быть запомнено больше, чем RealPlayer сейчас, в отношении зари интерактивного стриминга: ИИ-управляемые или ИИ-усиленные 3D-осведомленные представительные trải nghiệm, включая видеочат, виртуальную покупку, навигацию по маршруту и различные развлекательные приложения. Это может быть так, что альтернативные технологии или подходы победят, или что GSplat окажется наиболее надежным ИИ-видео-представлением.

Если ничего другого, это интересная новая статья возвещает немного о масштабе этой новой области, напоминая нам, может быть, ностальгически, о пропускной способности, ограниченной интернетом прошлого.

* Под ‘3D’ я не имею в виду тот вид опыта, который требует специальных очков, а скорее trải nghiệm, где мультимедийный контент имеет некоторое понимание координат X/Y/Z.

Опубликовано впервые в среду, 18 марта 2026