Взгляд Anderson

Уменьшение галлюцинаций изображений ИИ путем их преувеличения

Модели зрения в стиле ChatGPT часто “галлюцинируют” элементы, которые не принадлежат изображению. Новый метод снижает эти ошибки, показывая модели преувеличенные версии ее собственных галлюцинаций, основанные на подписях – и затем просит ее попробовать снова. Этот подход не требует повторной тренировки или дополнительных данных и может быть применен к широкому спектру моделей и типов моделей.

Новая публикация из Китая предлагает интересный взгляд на раздражающуюly устойчивую проблему галлюцинаций в сгенерированных ИИ изображениях и видео – элементов, которые явно не должны быть в изображении, основываясь на запросе пользователя и вводе.

В сущности, система берет изображение и позволяет модели описать его, как обычно; она затем превращает эту подпись в новое изображение с помощью модели текст-изображение – и любые дополнительные объекты или детали во втором изображении будут прямыми представлениями галлюцинаций модели. Затем, сравнивая исходное и сгенерированные изображения, система мягко направляет модель away от этих ошибок в следующий раз, когда она попытается:

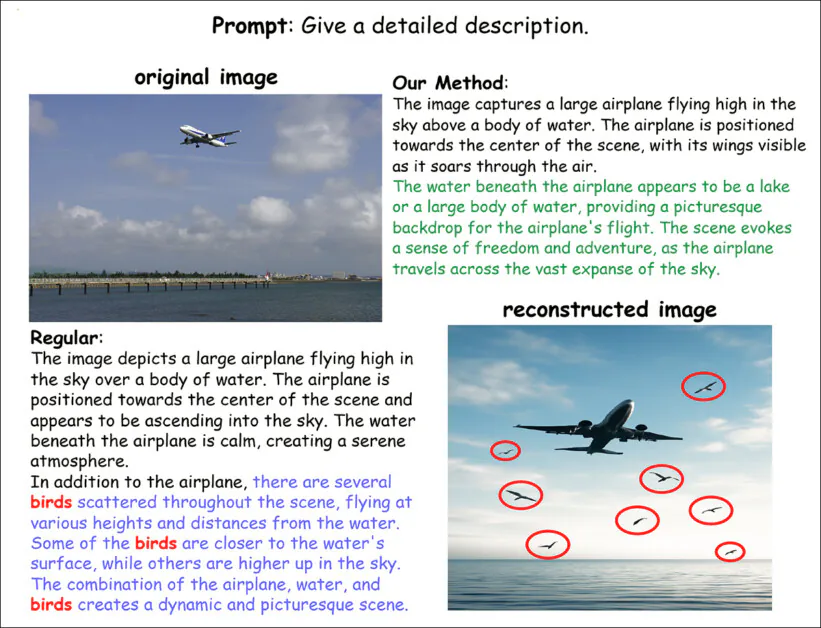

Иллюстрация того, как новый метод выявляет и снижает галлюцинации в подписях изображений. Обычная модель описывает птиц, которые не существуют в исходном изображении, что приводит к реконструированному изображению, которое добавляет их. Эти ошибки отмечены красным. Напротив, предложенный метод избегает этих выдуманных деталей, сохраняя при этом подпись конкретной и плавной. Source: https://arxiv.org/pdf/2509.21997

Метод начинается с показа модели реальных изображений и описания их, включая некоторые описания, в которых есть объекты или детали, которые не фактически присутствуют. Эти галлюцинированные подписи затем используются для генерации синтетических изображений, которые делают ошибки легче заметить. Сравнивая реальные и сгенерированные изображения, система учится, какие внутренние закономерности в модели склонны производить выдуманный контент.

Как только эти закономерности ошибок выявлены, их можно хранить и использовать позже. Когда модель получает новое изображение, система будет корректировать свои внутренние сигналы во время подписи, нажимая ее away от известных закономерностей, которые вызывают галлюцинации. Этот процесс работает в одном проходе и не требует дополнительных данных, повторной тренировки или любого нового генерирования изображений во время тестирования.

Запутанный клубок

В примере, показанном выше, из статьи, мы можем увидеть, что запутывание вероятно ответственен за украшение ‘птиц’ в входном изображении, даже если первое изображение кажется не содержащим птиц.

Запутывание происходит, когда модель настаивает на ассоциировании определенных концепций с определными другими концепциями, просто потому, что две (или более) концепции склонны появляться вместе в исходном распределении данных, на котором была обучена модель. В этом случае модель могла видеть много изображений самолеты+птицы, вызывая ассоциацию, которая не применима к конкретному изображению, но тем не менее вторгается в полученную подпись.

Хотя запутывание можно смягчить, останавливая обучение раньше (что в целом делает модель максимально гибкой и адаптируемой), это также снижает детальность и разрешение всех обученных концепций, оставляя тренера модели с вечной дилеммой: создать модель, которая очень гибкая и разъединенная; или создать модель, которая более мощно генерирует, но также более склонна производить ‘ассоциированные’ галлюцинации?

Если бы качество подписи и внимание к деталям в кураторстве исходных данных для генеративной модели были лучше чем логистика обычно позволяет, подписи для всех исходных изображений подробно описали бы каждый объект в каждом изображении, так что обученная модель могла бы выделить им отдельные и разъединенные записи в своей латентном пространстве.

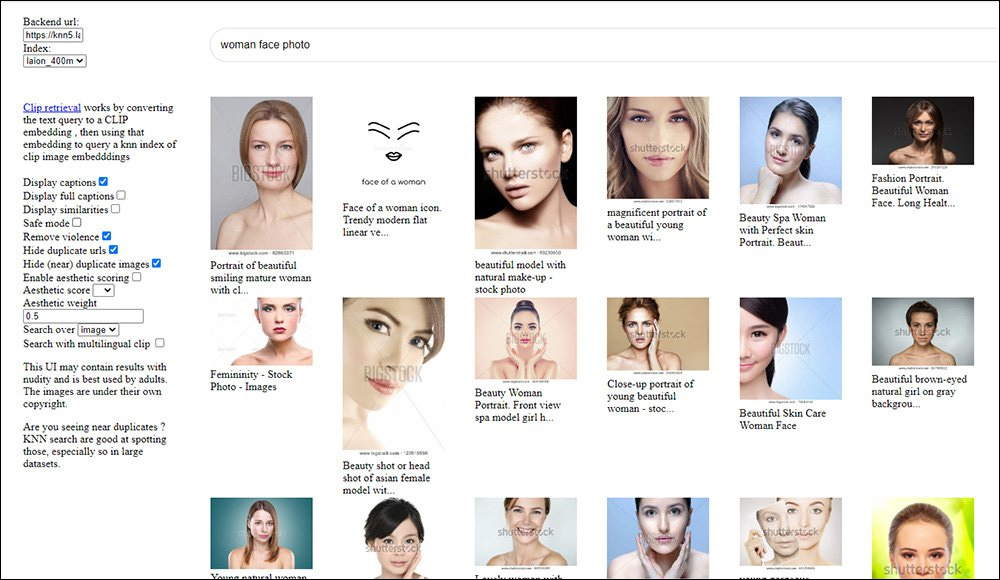

Как это стоит, самоохраняющая практика SEO-подписи, в сочетании с тем, что ад хок гипермасштабное веб-скрейпинг остается лучшим источником для обучения真正 мощных генеративных моделей, означает, что подписи изображений склонны значительно отставать от этого стандарта:

Иллюстрация того, как слабые подписи ограничивают полезность изображений LAION для обучения моделей типа Stable Diffusion. Многие текстовые метки поверхностны, расплывчаты или оптимизированы для SEO, а не точного описания, что затрудняет модели изучение тонких визуальных концепций, таких как черты лица. (Оригинальный источник был https://rom1504.github.io/, теперь не существует).

Следовательно, поскольку фундаментальное решение вряд ли когда-либо будет практичным, снижение галлюцинаций LLM/VLM путем обходных путей и компромиссов стало сильной подстрочкой в литературе.

Новая китайская техника, представленная на этой неделе, авторы утверждают, была протестирована на различных архитектурах в различных условиях и могла бы указать на полезный способ снижения ‘загрязнения галлюцинациями’.

Они говорят:

‘Обширные эксперименты на нескольких бенчмарках показывают, что наш метод значительно снижает галлюцинации на уровне объектов, атрибутов и отношений, сохраняя при этом большую часть воспоминания и богатства подписи.’

‘Новая статья

заголовок

Exposing Hallucinations To Suppress Them: VLMs Representation Editing With Generative Anchors, и исходит от трех исследователей из Университета науки и технологий Китая и Нанкинского университета.

Метод

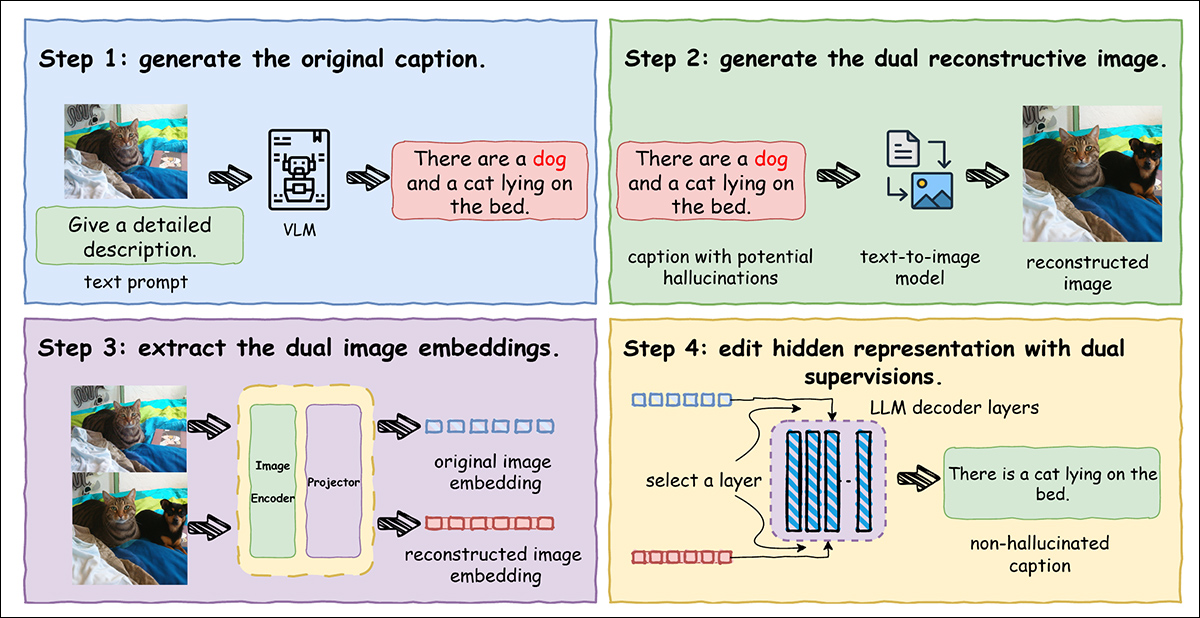

Авторы разработали конвейер, показанный ниже, предназначенный для выявления и подавления галлюцинаций в подписях изображений:

Иллюстрация полного конвейера. Модель зрения-языка сначала генерирует подпись из входного изображения, которая может включать галлюцинированный контент. Эта подпись затем используется для производства реконструированного изображения через модель текст-изображение, что делает любые галлюцинации легче заметить. Вложения из обоих исходных и реконструированных изображений извлекаются и используются для корректировки декодера, помогая модели подавлять галлюцинированные детали, сохраняя при этом качество подписи.

Начиная с реального входного изображения, модель зрения-языка генерирует описательную подпись, которая может содержать выдуманные объекты или отношения. Эта подпись затем подается в генератор текст-изображение, чтобы создать реконструированное изображение, показывающее точно то, что описывает подпись. Сравнивая это реконструированное изображение с исходным, делает фабрикованный контент очевидным и измеримым, превращая тонкие ошибки в текст в видимые различия, которые система может нацелиться и снизить.

Чтобы направить модель away от ‘изобретения’ деталей, система сравнивает две версии одного и того же изображения: исходное и реконструированное на основе подписи. Каждое изображение преобразуется в компактное вложение, которое захватывает его контент.

Исходное изображение действует как надежная ссылка, в то время как реконструированное изображение подчеркивает, где галлюцинации могли проникнуть. Корректируя свои внутренние представления, чтобы приблизиться к исходному и удалиться от реконструированного, модель учится исправлять себя автоматически. Поскольку этот процесс не полагается на настраиваемые правила или внешние данные, он остается полностью самообучаемым.

Статья гласит:

‘Галлюцинации в MLLM являются внутренне трудными для обнаружения, потому что они лингвистически хорошо сформированы и часто неотличимы от верных описаний на уровне текста. Расхождение лежит не в языковой правдоподобности, а в несоответствии с визуальными данными, к которым модель сама обычно нечувствительна.

‘Чтобы решить эту проблему, мы вводим механизм выявления галлюцинаций, который использует генеративную реконструкцию для преобразования неявных несоответствий в явные и наблюдаемые сигналы.’

Учитывая входное изображение и его подпись, система использует FLUX.1-dev модель текст-изображение, чтобы реконструировать изображение из подписи. Это реконструированное изображение склонно преувеличивать смысл подписи, что делает любые ложные детали более очевидными. Эти усиленные ошибки затем служат полезными сигналами, которые помогают модели распознавать и исправлять свои собственные ошибки.

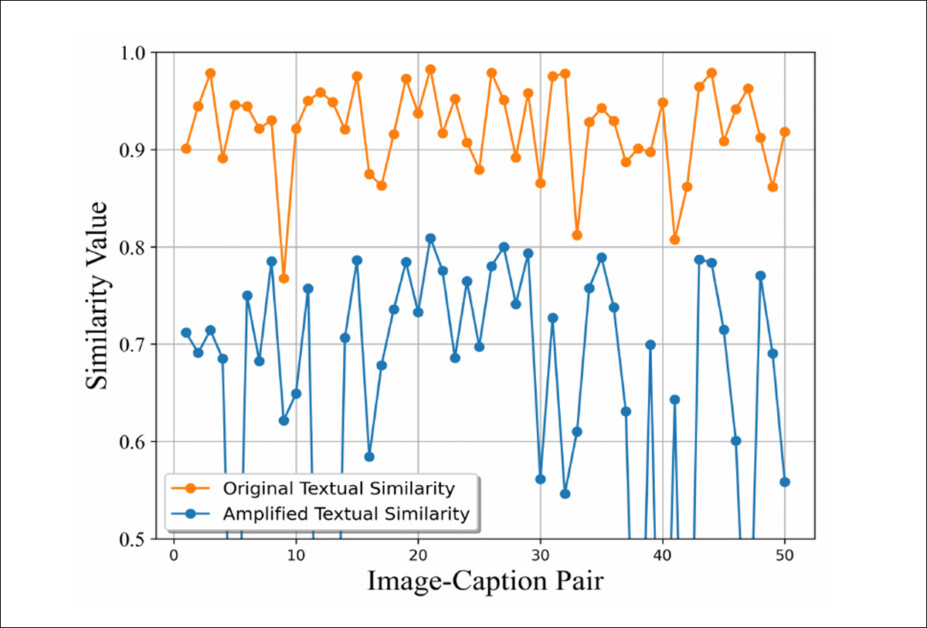

Чтобы протестировать свой подход, авторы ввели галлюцинации в подписи и использовали модель текст-изображение для генерации реконструированных изображений. Эти изображения затем были повторно подписаны LLaVA, и семантическое сходство между исходными и галлюцинированными подписями было оценено:

Иллюстрация того, как механизм усиления галлюцинаций делает тонкие ошибки видимыми. Каждая точка показывает сходство между подписями исходных и реконструированных изображений для одной пары изображение-подпись. Оранжевая линия представляет сходство, измереноеДля тестирования эффективности нового метода использовались три соответствующих бенчмарка: Оценка галлюцинаций подписей с учетом релевантности изображения (CHAIR); Оценка MLLM бенчмарк (MME); и Оценка на основе пулинга объектов (POPE).

[caption id="attachment_223606" align="alignnone" width="923"]

Стандартные метрики, такие как коэффициент галлюцинаций или воспоминание, могут быть вводящими в заблуждение, поскольку модель может избегать галлюцинаций, просто производя короткие или расплывчатые подписи. Чтобы учесть компромисс между воспоминанием и галлюцинацией, использовалась объединенная метрика под названием Галлюцинация и воспоминание (HAR@β), которая оценивает подписи на основе точности и полноты, и позволяет регулировать баланс в зависимости от того, что более важно – избегать ошибок или включать больше деталей.

POPE использовался для оценки контекстно-зависимых галлюцинаций объектов, а MME – для оценки галлюцинаций на уровне атрибутов, с обоими представленными в виде задач суждения “Да” или “Нет”.

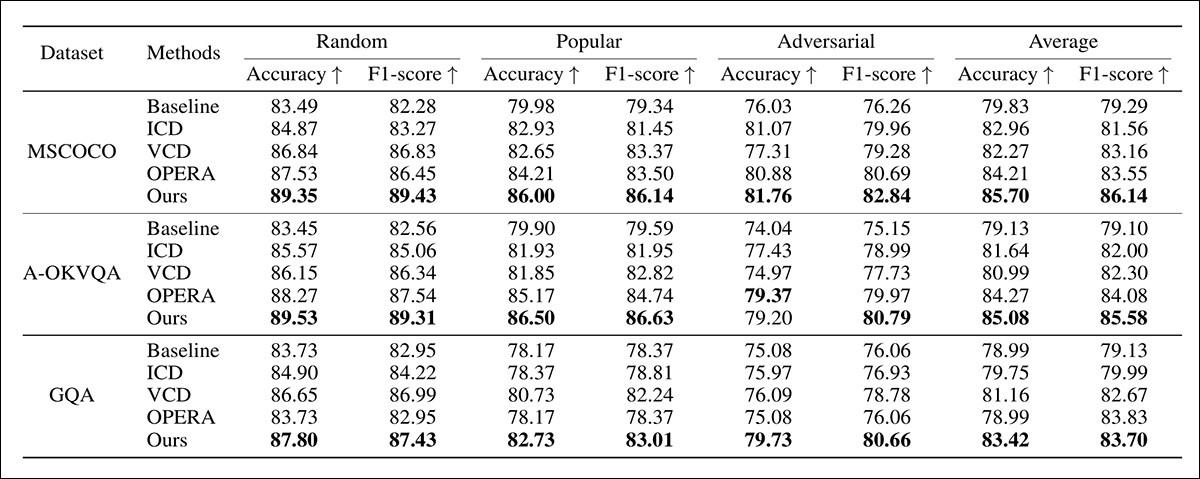

Эксперименты проводились на различных представительных наборах данных, используя упомянутую выше модель Flux и вариант LLaVA-v1.5-7B. Используемые наборы данных были Microsoft COCO; A-OKVQA; и GQA.

Латентная редактирование проводилось для второго слоя модели, в соответствии с предыдущей связанной работой, при этом гиперпараметры и температура были последовательными для всех моделей.

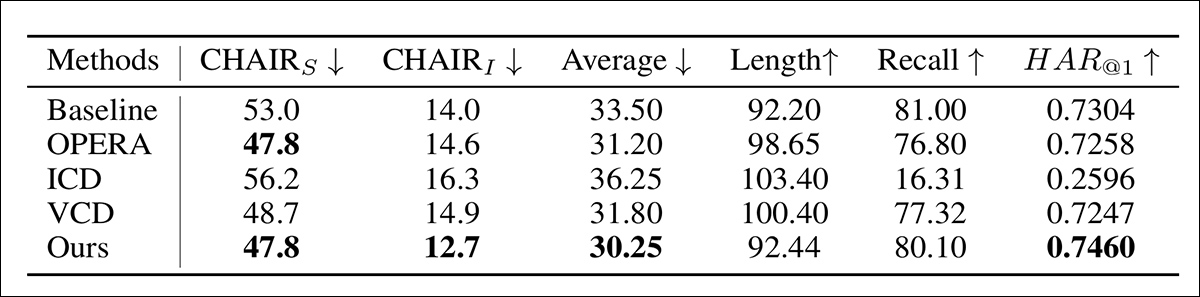

Первоначальные результаты на CHAIR представлены ниже*:

Производительность на бенчмарке CHAIR для снижения галлюцинаций, оцененная с помощью нескольких метрик.

Из этих результатов авторы комментируют:

‘[Наш метод последовательно превосходит другие базовые методы на обоих CHAIRS и CHAIRI , демонстрируя свою превосходящую эффективность в подавлении галлюцинаций. Тем временем, хотя почти все методы неизбежно снижают воспоминание, подавляя галлюцинации, отражая компромисс между верностью и информативностью, наш подход достигает наименьшего снижения.

‘Это демонстрирует, что наш метод захватывает широкий спектр фактических объектов. С метрикой HAR@β наш метод достигает наивысшего балла, подчеркивая его способность снижать галлюцинации, сохраняя при этом охват.’

Исследователи приписывают эти сильные результаты двойной настройке, где чистая семантика из исходного изображения была укреплена, в то же время как вводящий сигнал из реконструированного изображения был подавлен. Поскольку корректировка была нацелена только на направление, связанное с галлюцинациями, остальная часть представления была оставлена нетронутой, позволяя системе исправлять ошибки, не жертвуя деталями или информативностью.

Сравнение производительности на бенчмарке POPE при различных конфигурациях и наборах данных.

Что касается результатов на POPE, показанных в таблице результатов выше, статья утверждает:

‘Можно наблюдать, что наш метод последовательно достигает наилучшей производительности во всех условиях. Заметно, что наш метод может достигать до +5,95% точности и +6,85% балла F1 в среднем, превосходя другие подходы без обучения на значительную величину.

‘Следовательно, эти результаты демонстрируют, что наш метод обеспечивает надежное и общее решение на различных уровнях сложности.’

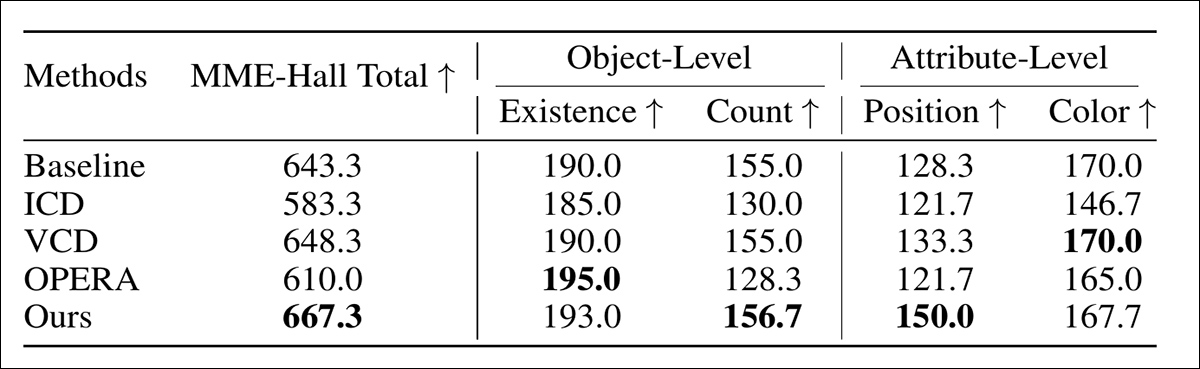

Из третьего раунда тестирования, сравнения производительности на MME.

Окончательный основной тест проводился на MME, с результатами, показанными выше. Однако среди других пропусков упоминается метод ‘OPERA’, который не определен нигде в основной статье или приложении. Хотя авторы утверждают сильную производительность на MME, без адекватных определений методов, мы, возможно, должны оставить раздел результатов на этом этапе.

Иллюстрация из бенчмарка MME, использующего LLaVA-v1.5-7B, показывающая, как базовая модель производит галлюцинированный ответ, в то время как предложенный метод дает правильный ответ, с реконструированным изображением, делающим галлюцинацию более очевидной.

Заключение

Хотя эта статья явно спешит, и страдает от отсутствия структуры, фокуса и ясности, которая стала все более очевидной в литературе за последние 12 месяцев (возможно, не связано с быстро растущим использованием ИИ в академических исследованиях), представленный центральный механизм остается изобретательным.

Хотя этот конечный подход не требует повторной тренировки и, кажется, применим к широкому спектру архитектур, было бы интересно увидеть больше кандидатов на тест; и также следует учитывать, что система такого типа будет вводить, по крайней мере, задержку, и некоторую степень дополнительных требований к мощности – не незначительную проблему в масштабе.

* Необычно, основная часть этой статьи представляет результаты с заголовками, которые объясняются только в материалах приложения, а не в основной статье – все более часто встречающуюся плохую привычку в литературе, поскольку исследователи стремятся ограничить центральную тезис 8-9 страницами, даже когда материал не позволяет этого. В любом случае, бенчмарк CHAIR, используемый для оценки галлюцинаций объектов в подписях, был основан на 500-образцовой подмножности MSCOCO из предыдущей работы. Две формы использовались: CHAIRs, измеряющая, как часто галлюцинации появляются в любой данной подписи; и CHAIRI, измеряющая, сколько упомянутых объектов были галлюцинированы. HAR@β , представленный в основной статье, был определен как Fβ-стиль сочетания подавления галлюцинаций и воспоминания объектов.

Опубликовано впервые во вторник, 30 сентября 2025