Взгляд Anderson

‘Зен’-метод остановить языковые модели от галлюцинаций

Сказать ChatGPT проверить случайный ответ перед решением реальной проблемы заставляет его подумать усерднее и получить правильный ответ чаще – даже если предыдущий ‘случайный’ ответ не имеет отношения к вашему реальному запросу.

Интересная новая работа из Китая разработала очень низкозатратный метод остановить языковые модели, такие как ChatGPT, от галлюцинаций, и улучшить качество ответов: заставить модель проверить ответ на совершенно не связанный вопрос сначала:

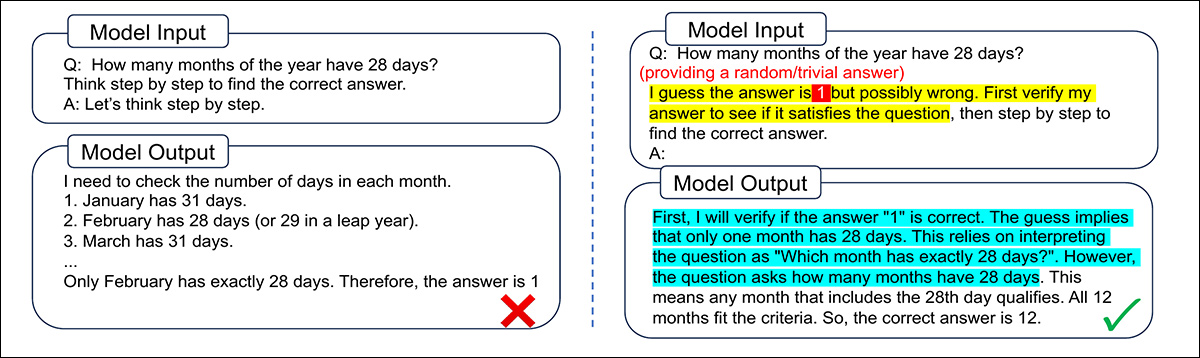

Пример не связанного вопроса, который может ‘освободить разум’ LLM и помочь ему сосредоточиться на реальном последующем запросе. Источник

Этот Зен-удар является невероятно дешевым способом улучшения производительности, по сравнению с другими более сложными методами, такими как файн-тюнинг, prompt-crafting и параллельное выборочное моделирование, и он работает на открытых и закрытых моделях, указывая на открытие фундаментальной характеристики, общей для нескольких архитектур LLM (а не хрупкой причуды, особенной для конкретных материалов или методов обучения).

Авторы описывают экономию масштаба, возможную за счет улучшения выходных данных этим спартанским способом*:

‘Чтобы реализовать с минимальными дополнительными предварительными знаниями, VF только нужно предоставить случайный/тривиальный ответ в промпте. Процесс верификации оказывается с меньшим количеством выходных токенов, чем обычный путь CoT, [иногда] даже без явного процесса верификации, таким образом [требуя] очень [малого] дополнительного вычисления во время тестирования.’

В тестах этот подход – называемый Верификация-Сначала (VF) – смог улучшить ответы в различных задачах, включая математическое рассуждение, на открытых и коммерческих платформах.

Часть причины, почему этот метод работает, может быть основана на том, как языковые модели впитывают и присваивают тенденции человеческой психологии, так что прямой вопрос может сделать модель ‘защищающейся’ и ‘нервной’, тогда как запрос на верификацию чужой работы не включает эти ‘инстинкты выживания’.

Основная идея заключается в том, что верификация ответа требует меньше усилий, чем генерация его с нуля, и может запустить другой путь рассуждения, который дополняет стандартный путь рассуждений.

Промптинг модели критиковать заданный ответ (т.е. ответ, который модель не создавала) также может активировать определенный тип критического мышления, который помогает избежать чрезмерной уверенности в собственных первых впечатлениях модели.

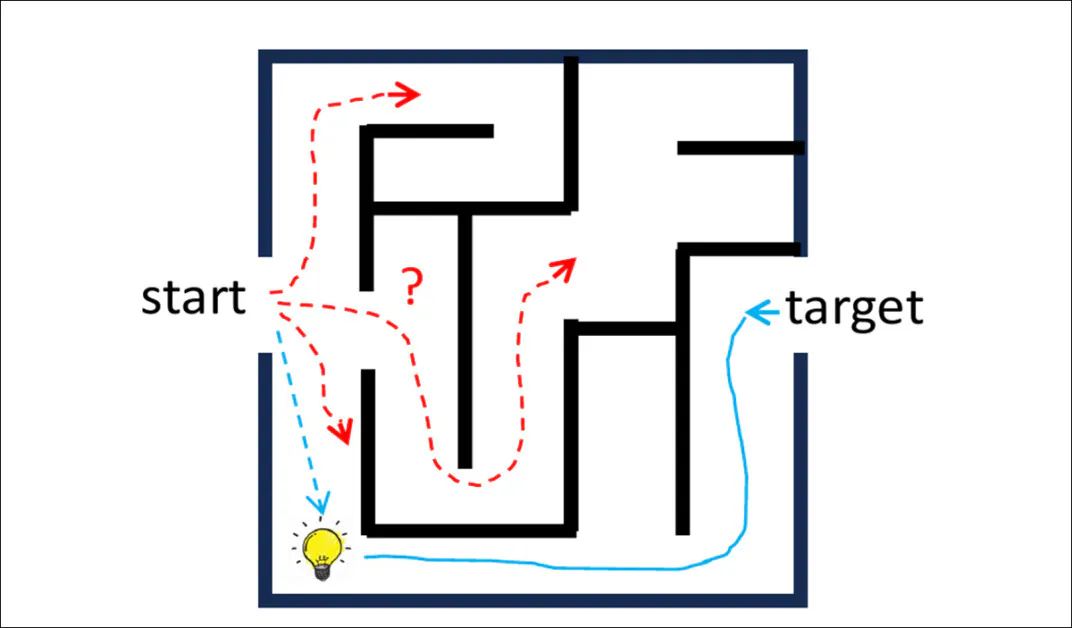

Работа характеризует процесс в терминах обратного пути рассуждения:

Начиная с предложенного ответа и рассуждая назад к вопросу, можно обнаружить сокращения или идеи, которые труднее найти, рассуждая вперед от проблемы. Этот ‘обратный путь’ может следовать более простой траектории и предлагать дополнительную информацию к стандартному пути рассуждений.

Исследователи также конкретизировали центральную концепцию в Iter-VF, последовательный метод масштабирования во времени, который итеративно уточняет ответы, избегая проблемы накопления ошибок, характерной для стратегий самоисправления, часто встречающихся в архитектурах LLM.

Новая работа озаглавлена Просить LLM проверить сначала почти бесплатный обед, и исходит от двух исследователей из кафедры электронной инженерии Университета Цинхуа в Пекине.

Метод

Основная идея за новой работой заключается в том, чтобы перевернуть обычный поток рассуждений в языковых моделях. Вместо того, чтобы просить модель решить проблему с нуля, ей сначала предлагается кандидат на ответ (часто неправильный или произвольный) и просится проверить, имеет ли этот ответ смысл.

Это заставляет модель рассуждать в обратном порядке, работая назад от предложенного ответа к вопросу. Как только верификация завершена, модель затем переходит к решению исходной проблемы, как обычно.

Этот переворот, утверждает статья, снижает количество бездумных ошибок и поощряет более рефлексивный режим рассуждения, помогая LLM обнаружить скрытую структуру и избежать вводящих в заблуждение предположений.

Как видно из примеров ниже, даже промптинг модели проверить явно неправильную догадку, такую как ’10’ , может помочь ей восстановиться от ошибочной логики и превзойти стандартный промптинг цепочки рассуждений:

Промптинг модели проверить догадку сначала помогает ей обнаружить несоответствия и более тщательно взаимодействовать с проблемой. В этом примере стандартный подход приводит к плавному, но неправильному решению, тогда как промптинг Верификация-Сначала запускает более четкую логическую структуру и правильный результат.

В отношении многих реальных проблем не легко предоставить догадку для модели, чтобы проверить, особенно когда задача открыта, такая как написание кода или вызов API. Поэтому, чтобы лучше адаптироваться, метод сначала дает свой лучший ответ, как обычно, и затем подает этот ответ обратно в формат Верификация-Сначала. Таким образом модель проверяет и улучшает свой собственный выход:

Когда модель просится проверить свой собственный предыдущий выход, она обнаруживает ошибку в своей логике и переписывает решение правильно. Промптинг Верификация-Сначала помогает ей сосредоточиться на конкретной ошибке, а не повторять одну и ту же ошибку.

Этот подход составляет вышеупомянутый Iter-VF. Модель повторяет этот цикл, уточняя свой ответ каждый раз, без необходимости переобучения или специальных инструментов. В отличие от других стратегий самоисправления, которые могут накапливать предыдущую мысль и рисковать запутать модель, Iter-VF смотрит только на наиболее недавний ответ каждый раз, что помогает сохранить ее рассуждения ясными.

Данные и тесты

Авторы оценивают метод в четырех доменах: общие задачи рассуждения, где VF запускается с тривиальной догадкой; задачи, чувствительные к времени, где Iter-VF сравнивается с соперничающими методами масштабирования; открытые проблемы, такие как кодирование и вызовы API, где VF использует собственный предыдущий ответ модели; и закрытые коммерческие LLM, где внутренние шаги рассуждения недоступны.

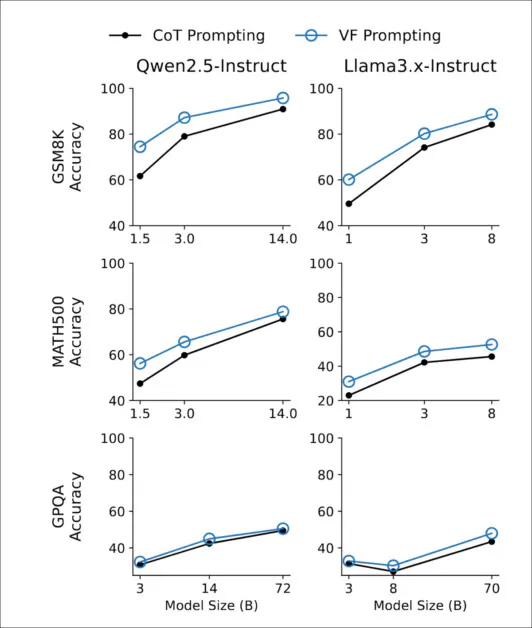

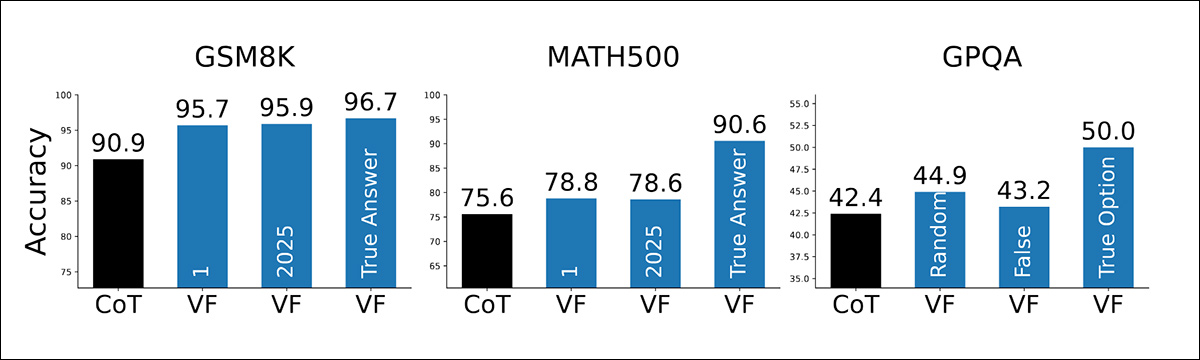

Чтобы протестировать метод, исследователи использовали три бенчмарка рассуждений: GSM8K и MATH500 для математических проблем; и GPQA-Diamond для вопросов науки уровня магистра.

В каждом случае модели было дано либо тривиальную догадку, такую как ‘1’ для числовых ответов; или случайно перемешанный вариант множественного выбора, как начальная точка для верификации. Не было добавлено никакого специального настройки или предварительных знаний, и базовая линия для сравнения была стандартным промптингом цепочки рассуждений без обучения.

Тесты прошли на полном диапазоне Qwen2.5 и Llama3 моделей, обученных инструкциям, от 1B до 72B (параметров) в размере. Модели Qwen, использованные в работе, были Qwen2.5-1.5B-Instruct, Qwen2.5-3B-Instruct, Qwen2.5-14B-Instruct и Qwen2.5-72B-Instruct. Варианты Llama3 были Llama3.2-1B-Instruct, Llama3.2-3B-Instruct, Llama3.1-8B-Instruct и Llama3.3-70B-Instruct.

Как показано ниже, улучшение от промптинга Верификация-Сначала сохранялось на всех масштабах модели, с четкими выигрышами, видимыми даже на 1B параметров и продолжающимися до 72B:

На всех размерах моделей в семействах Qwen2.5 и Llama3 промптинг Верификация-Сначала последовательно превосходил стандартный промптинг цепочки рассуждений на GSM8K, MATH500 и GPQA.

Эффект оказался сильнее на вычислительно-интенсивных математических бенчмарках, таких как GSM8K и MATH500, где верификация неправильного ответа запускала лучшее рассуждение, чем попытка решить проблему с нуля. На GPQA-Diamond, который зависит больше от хранимых знаний, чем от дедуктивной структуры, преимущество было меньше, но последовательным.

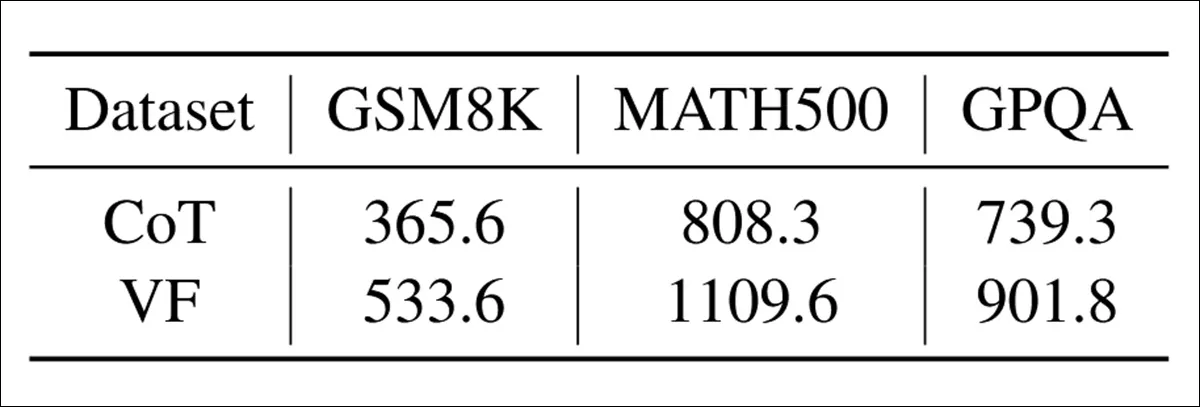

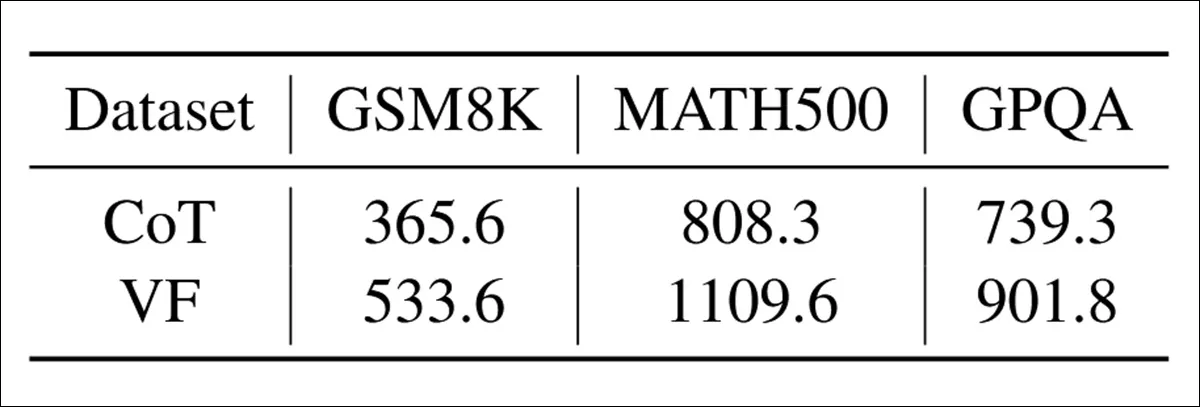

Вычислительная стоимость Верификация-Сначала была скромной: в таблице ниже мы можем увидеть, что генерация шага верификации добавила около 20-50% больше выходных токенов по сравнению со стандартным промптингом цепочки рассуждений:

Среднее количество выходных токенов, сгенерированных под каждым методом промптинга, на бенчмарках GSM8K, MATH500 и GPQA.

Несмотря на это, дополнительная стоимость оставалась далеко ниже, чем у стратегий, требующих нескольких выборочных завершений или рекурсивного планирования.

На графике ниже мы можем увидеть, насколько чувствителен метод к качеству догадки. Удивительно, но даже когда догадка тривиальна (‘1’), невероятна (‘2025’) или случайный вариант множественного выбора, Верификация-Сначала все равно превосходит стандартный промптинг:

Выигрыши точности от промптинга Верификация-Сначала, когда модели предлагается тривиальный, невероятный или правильный ответ для верификации на GSM8K, MATH500 и GPQA.

Как ожидалось, точность прыгает еще выше, когда догадка оказывается правильным ответом; но метод работал хорошо в любом случае, что предполагает, что выигрыши не были обусловлены информацией в догадке самой по себе, а просто актом верификации.

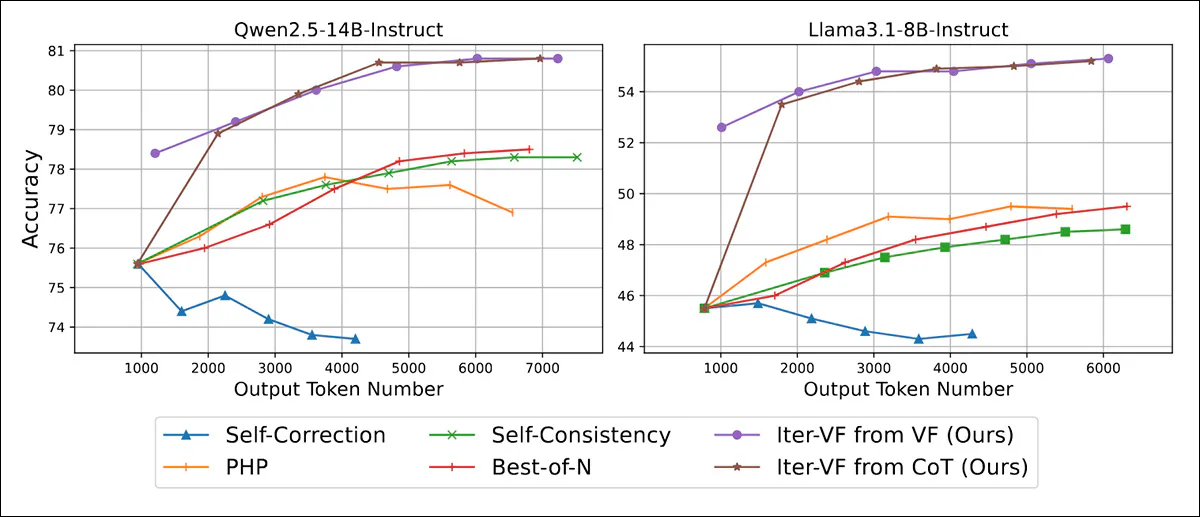

Iter-VF также сравнивались с четырьмя стратегиями масштабирования во время тестирования, которые работают без переобучения или адаптации к задаче. В Самоисправление модели просили пересмотреть свои ответы, размышляя о предыдущих шагах рассуждения; в PHP предыдущие ответы добавлялись к входным данным как контекстные подсказки, хотя не давались инструкции, как их использовать.

Кроме того, в Самоусогласованность несколько путей рассуждения выбирались, и окончательный ответ выбирался большинством голосов; и, наконец, в Лучший-из-N несколько выходов генерировались независимо и ранжировались с помощью промптинга верификатора, и выбирались ответы с наивысшим баллом.

Две версии Iter-VF были реализованы: одна, запущенная с тривиальной догадкой (‘1’), и другая, запущенная со стандартным выходом CoT:

Точность и эффективность токенов на MATH500 при увеличивающемся бюджете выхода, показывающая, что обе версии Iter-VF превосходят все базовые линии на всех масштабах моделей.

Iter-VF давали лучшие результаты, чем все другие методы, когда доступная вычислительная мощность была низкой, что авторы приписывают тому, как он проверяет ответы, а не тому, насколько хороши первоначальные ответы (поскольку обе версии VF и CoT быстро достигли схожей точности).

PHP работал хуже, даже хотя он повторно использовал предыдущие ответы как подсказки, вероятно, потому что LLM не использовали эти подсказки хорошо.

В отличие от PHP и Самоисправления, которые накапливают контекст на протяжении итераций, Iter-VF учитывает только наиболее недавний ответ на каждом шаге. Этот Марковский подход избегает ошибок, накапливаемых в цепочках рассуждений – слабость, особенно вредная для Самоисправления.

Параллельные методы, такие как Самоусогласованность и Лучший-из-N, избегали этой проблемы, хотя их улучшения были медленнее и более скромными.

(Примечание: раздел результатов, хотя и подробный, является трудным и многословным чтением, и мы должны на этом этапе сократить большую часть оставшегося освещения, отсылая читателя к исходной статье для более подробной информации).

Когда тестировались на GPT-5 Nano и GPT-5 Mini, закрытых коммерческих моделей, которые скрывают полный след рассуждений и возвращают только окончательный ответ, Iter-VF улучшил производительность без зависимости от промежуточных выходов. В таблице ниже мы можем увидеть выигрыши на MATH500 и GPQA, подтверждающие, что подход верификация-генерация остается жизнеспособным даже тогда, когда доступны только входные и окончательные ответы:

Точность на MATH500 и GPQA, когда Iter-VF применяется к моделям GPT-5 с скрытыми следами рассуждений.

Вывод

Хотя новая статья переходит в неясность после раздела результатов, очевидное открытие общей характеристики в классе моделей ИИ является все равно интересным развитием. Каждый, кто регулярно использует LLM, интуитивно разработал набор трюков, чтобы обойти ограничения моделей, поскольку каждое из них становится очевидным со временем, и возникает закономерность; и все надеются найти ‘трюк’ таким же применимым и общим, как этот.

Одной из самых больших проблем в реализации и обновлении окна контекста в LLM является нахождение баланса между сохранением прогресса сессии и способностью выйти в новые направления при необходимости, не попадая в спurious галлюцинации или выходящие из темы выходные данные. В случае, представленном новой статьей, мы видим пример мягкого, но настойчивого ‘сигнала пробуждения’, который, кажется, переориентирует и перезапускает LLM без потери контекста. Будет интересно посмотреть, адаптируются ли последующие проекты и эволюционируют ли этот метод.

Исследователи много говорят о чистой экономии своего нового метода – соображение, которое имело бы гораздо меньше веса даже 12 месяцев назад. В наши дни последствия гипермасштабного ИИ делают ясным, что экономия ресурсов, когда-то считавшаяся придирчивой, в ‘чистой исследовательской’ эпохе, теперь становится кардинальной и необходимой.

* Пожалуйста, обратите внимание, что я ограничен от включения обычной количества цитат из статьи, поскольку стандарт английского, найденный в некоторых частях, мог бы запутать читателя. Таким образом, я взял на себя смелость суммировать ключевые прозрения вместо этого, и я отсылаю читателя к исходной статье для верификации.

Опубликовано впервые в четверг, 4 декабря 2025 года