Искусственный интеллект

Mistral AI: Setting New Benchmarks Beyond Llama2 in the Open-Source Space

Большие языковые модели (LLM) недавно заняли центральное место, благодаря таким выдающимся моделям, как ChatGPT. Когда Meta представила свои модели Llama, это вызвало обновленный интерес к открытым языковым моделям. Цель? Создать доступные, открытые LLM, которые такие же хороши, как топовые модели, такие как GPT-4, но без высокой цены или сложности.

Эта смесь доступности и эффективности не только открыла новые возможности для исследователей и разработчиков, но и создала сцену для новой эры технологических достижений в обработке естественного языка.

Недавно стартапы, занимающиеся генеративным ИИ, получили финансирование. Together raised $20 million, целью которых является формирование открытого ИИ. Anthropic также получил впечатляющие $450 миллионов, и Cohere, в партнерстве с Google Cloud, получил $270 миллионов в июне этого года.

Введение в Mistral 7B: Размер и Доступность

Mistral AI, базирующаяся в Париже и основанная выпускниками Google’s DeepMind и Meta, объявила о своем первом большом языковом модели: Mistral 7B. Эта модель может быть легко загружена кем угодно из GitHub и даже через 13,4-гигабайтный торрент.

Этот стартап смог получить рекордное финансирование даже до выпуска продукта. Mistral AI первая модель с 7 миллиардами параметров превосходит производительность Llama 2 13B во всех тестах и превосходит Llama 1 34B во многих метриках.

По сравнению с другими моделями, такими как Llama 2, Mistral 7B обеспечивает аналогичные или лучшие возможности, но с меньшей вычислительной нагрузкой. Хотя основные модели, такие как GPT-4, могут достичь большего, они имеют более высокую цену и не так удобны в использовании, поскольку они в основном доступны через API.

Когда речь идет о задачах кодирования, Mistral 7B дает CodeLlama 7B возможность побежать за своей долей. Кроме того, он достаточно компактен, чтобы работать на стандартных машинах, занимая 13,4 ГБ.

Кроме того, Mistral 7B Instruct, настроенный специально для инструктивных наборов данных на Hugging Face, показал отличную производительность. Он превосходит другие 7B-модели на MT-Bench и стоит наравне с 13B-чат-моделями.

Hugging Face Mistral 7B Пример

Бенчмаркинг Производительности

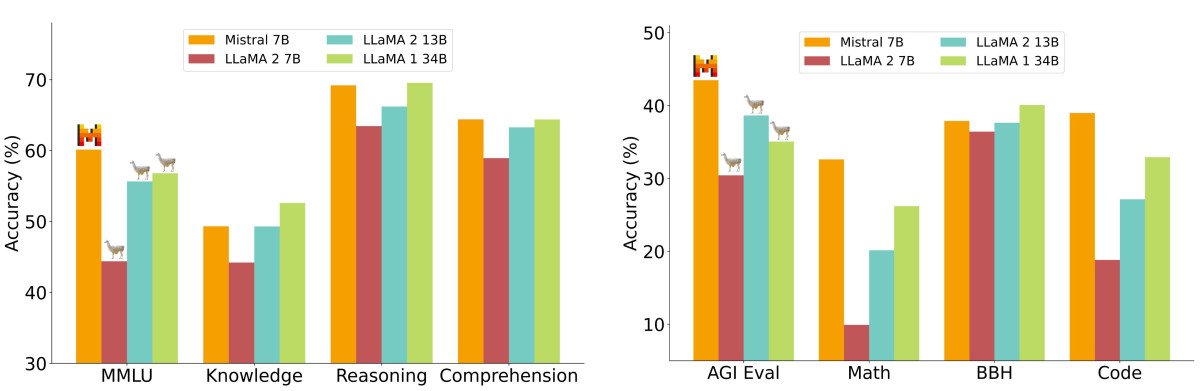

В подробном анализе производительности Mistral 7B был измерен против моделей Llama 2. Результаты были ясны: Mistral 7B существенно превосходит Llama 2 13B во всех бенчмарках. На самом деле, он соответствует производительности Llama 34B, особенно выделяясь в коде и бенчмарках рассуждений.

Бенчмарки были организованы в несколько категорий, таких как Общее рассуждение, Мировые знания, Понимание чтения, Математика и Код, среди других. Особенно заметным наблюдением было соотношение производительности и стоимости Mistral 7B, обозначенное как “эквивалентные размеры моделей”. В областях, таких как рассуждение и понимание, Mistral 7B показал производительность, аналогичную модели Llama 2 в три раза большего размера, что указывает на потенциальную экономию памяти и увеличение пропускной способности. Однако в бенчмарках знаний Mistral 7B соответствовал Llama 2 13B, что, вероятно, связано с ограничениями параметров, влияющими на сжатие знаний.

Что действительно делает модель Mistral 7B лучше, чем большинство других языковых моделей?

Упрощение Механизмов Внимания

Хотя тонкости механизмов внимания технически сложны, их основная идея относительно проста. Представьте, что вы читаете книгу и выделяете важные предложения; это аналогично тому, как механизмы внимания “выделяют” или придает важность конкретным данным в последовательности.

В контексте языковых моделей эти механизмы позволяют модели сосредоточиться на наиболее релевантных частях входных данных, обеспечивая, чтобы выходные данные были связными и контекстно точными.

В стандартных трансформерах attention-скоры рассчитываются по формуле:

Формула этих оценок включает важный шаг – матричное умножение Q и K. Вызов здесь заключается в том, что по мере роста длины последовательности обе матрицы расширяются соответственно, что приводит к вычислительно интенсивному процессу. Эта проблема масштабируемости является одной из основных причин, почему стандартные трансформеры могут быть медленными, особенно при работе с длинными последовательностями.

Многозапросное внимание (MQA) ускоряет процесс, используя один набор “ключ-значение” голов, но иногда жертвует качеством. Теперь вы можете задаться вопросом, почему не объединить скорость MQA с качеством много-голового внимания? Вот где появляется Групповое запросное внимание (GQA).

Групповое Запросное Внимание (GQA)

GQA является средним решением. Вместо использования одного или нескольких “ключ-значение” голов, оно группирует их. Таким образом, GQA достигает производительности, близкой к подробному много-головому вниманию, но с скоростью MQA. Для моделей, таких как Mistral, это означает эффективную производительность без значительного компромисса в качестве.

Скользящее Окно Внимания (SWA)

Скользящее окно является еще одним методом, используемым при обработке последовательностей внимания. Этот метод использует фиксированное окно внимания вокруг каждого токена в последовательности. С несколькими слоями, которые накладывают это окно внимания, верхние слои в конечном итоге получают более широкий взгляд, охватывающий информацию из всей входной последовательности. Этот механизм аналогичен рецептивным полям, наблюдаемым в свёрточных нейронных сетях (CNN).

С другой стороны, “расширенное скользящее окно внимания” модели Longformer, которая концептуально похожа на метод скользящего окна, вычисляет только несколько диагоналей матрицы. Это изменение приводит к тому, что использование памяти увеличивается линейно, а не квадратично, что делает его более эффективным методом для более длинных последовательностей.

Прозрачность Mistral AI vs. Безопасные проблемы в децентрализации

В своем объявлении Mistral AI также подчеркнула прозрачность, заявив: “Нет трюков, нет проприетарных данных.” Но в то же время их единственная доступная модель на данный момент – ‘Mistral-7B-v0.1’ – это предварительно обученная базовая модель, поэтому она может генерировать ответ на любой запрос без модерации, что вызывает потенциальные проблемы безопасности. Хотя модели, такие как GPT и Llama, имеют механизмы для определения, когда отвечать, полностью децентрализованная природа Mistral может быть использована злоумышленниками.

Однако децентрализация больших языковых моделей имеет свои достоинства. Хотя некоторые могут злоупотреблять ею, люди могут использовать ее силу для социального блага и сделать интеллект доступным для всех.

Гибкость Развертывания

Одним из выделяющихся моментов является то, что Mistral 7B доступен под лицензией Apache 2.0. Это означает, что нет реальных барьеров для его использования – будь то для личных целей, крупной корпорации или даже государственного органа. Вам просто нужна правильная система для запуска или вам, возможно, придется инвестировать в облачные ресурсы.

Хотя существуют другие лицензии, такие как более простая лицензия MIT и кооперативная лицензия CC BY-SA-4.0, которая требует указания авторства и аналогичной лицензии для производных работ, лицензия Apache 2.0 обеспечивает прочную основу для крупномасштабных проектов.

Заключительные Мысли

Появление открытых больших языковых моделей, таких как Mistral 7B, знаменует собой поворотный момент в индустрии ИИ, делая высококачественные языковые модели доступными для более широкой аудитории. Инновационные подходы Mistral AI, такие как Групповое запросное внимание и Скользящее окно внимания, обещают эффективную производительность без компромисса в качестве.

Хотя децентрализованная природа Mistral представляет определенные проблемы, ее гибкость и открытая лицензия подчеркивают потенциал для демократизации ИИ. По мере эволюции ландшафта внимание неизбежно будет сосредоточено на балансировании силы этих моделей с этическими соображениями и механизмами безопасности.

Что дальше для Mistral? Модель 7B была только началом. Команда планирует запустить еще более крупные модели скоро. Если эти новые модели соответствуют производительности 7B, Mistral может быстро подняться в качестве одного из лидеров в отрасли, все в течение своего первого года.