Угол Андерсона

Предоставление языковым моделям «шкалы истинности»

Правдиво или болтливо: выбирайте сами. Новый метод обучения позволяет пользователям точно указывать чат-ботам с искусственным интеллектом, насколько «фактически» они должны быть правдивыми, превращая точность в регулятор, который можно увеличивать или уменьшать.

Новое исследовательское сотрудничество между США и Китаем предлагает нечто, что оценят почти все пользователи чат-ботов с искусственным интеллектом: виртуальный «рычаг», который указывает боту, должен ли он быть «болтливым» или «правдивым».

Система была создана тонкая настройка a Мистраль-7Б модель на синтетические данныеТаким образом, схема шкалы «истины» могла быть заложена в модель. После этой доработки модель Mistral способна контролировать количество фактов в ответе; чем выше значение «истины», указанное пользователем, тем меньше, но более достоверными будут факты. . Далее следуют: ответ.

При более низких настройках ответ чат-бота становится тем, что авторы статьи называют «информативным», то есть он дает более длинный ответ и содержит больше фактов; однако некоторые из этих фактов могут быть... галлюцинация.

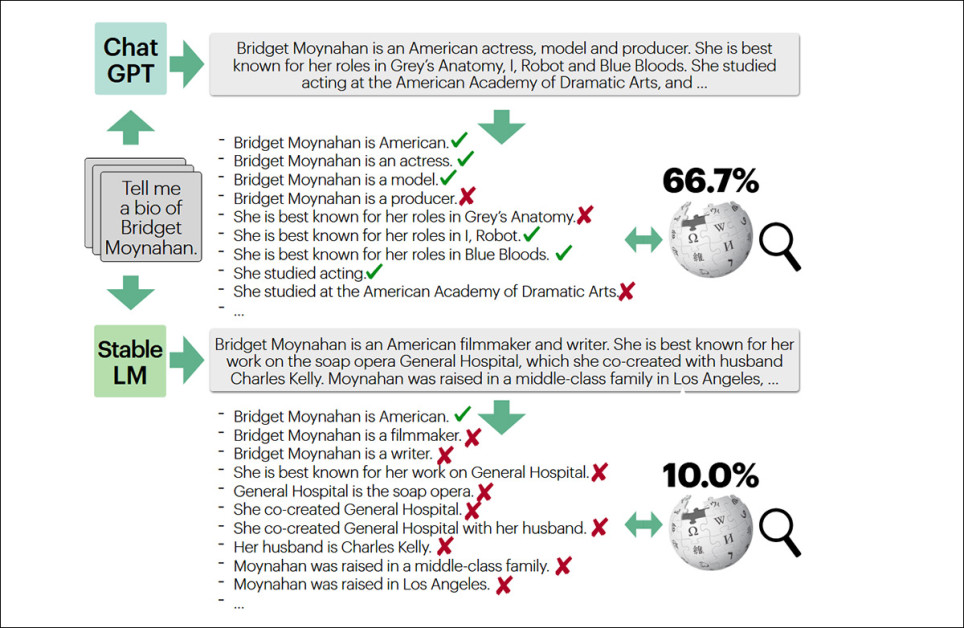

В качестве эталона для тестирования системы использовались синтетические данные из Википедии: реальные биографические факты о людях. Независимо от того, считаете ли вы Википедию авторитетным источником или нет, ценность этой работы заключается в разработке... любое своего рода система, которая может ограничить возможности для обучения по программе LLM. непреодолимое желание давать ответыдаже когда у него нет ответов.

Пример из проекта FactScore, который использовался для подготовки набора данных для рассматриваемой нами статьи, где Википедия служит источником биографических сведений. Источник

Авторы отмечают, что контексты с высокой степенью достоверности, такие как медицинская и юридическая сферы, требуют консервативных и надежных фактических результатов, в то время как многие другие категории пользователей нуждаются в более гибком и творческом, интерпретативном подходе (например, в написании дискурсивных текстов и академическом анализе).

Они отмечают*:

«[Современные] модели LLM не предлагают встроенного механизма для контроля этого компромисса».

«Хотя пользователи могут пытаться направлять поведение модели с помощью подсказок типа „будьте более объективны“, мы обнаружили, что модели, демонстрирующие граничные возможности, не всегда корректируют свои выходные данные в ответ на подобные подсказки в данной задаче».

'На FactScoreМы обнаружили, что готовые модели часто не соответствуют даже умеренно строгим целевым показателям. Этот пробел обуславливает необходимость создания управляемой альтернативы, которая позволяет пользователям запрашивать определенный уровень достоверности данных, и модель будет соответствующим образом корректировать свои ответы.

Только факты

Для понимания статьи и предлагаемых в ней решений необходимо пересмотреть собственное определение «информативности». Авторы утверждают, что количественная оценка информативный ответ равен «Объем поддерживаемого контента в выходных данных, измеряемый как количество проверенных атомарных операторов, нормализованное по длине выходных данных»..

В другом месте статьи более просто говорится, что информативность — это «Общее количество атомарных фактов в выходных данных, независимо от того, верны они или нет».

Кроме того, исследователи отмечают, что склонность моделей поведения, основанных на лингвистических знаниях, колебаться между фактической точностью и субъективными предположениями является очень человеческой чертой, подтвержденной многочисленными научными исследованиями*:

«[Знания магистров права] неравномерно надежны: некоторые утверждения имеют веские основания, в то время как другие носят предположительный, устаревший или неопределенный характер. Поэтому для их создания необходимо решить, сколько информации следует изложить и насколько осторожно, что создает напряжение между фактической точностью и информативностью».

Люди делают аналогичный выбор: начиная с достоверных фактов и добавить более низкая степень уверенности детали Только по запросу.

Хотя эксперименты проводились только на модели «Мистраль» среднего размера, применяемые принципы должны работать в различных масштабах и на разных платформах, поскольку они предполагают новый подход. квантование Данные, в качестве дополнения к внутренней схеме LLM; и подобное изменение не зависит от архитектуры.

Новый документ называется Фактичность по запросу: контроль компромисса между фактичностью и информативностью при генерации текста.Эта работа выполнена семью исследователями из Колумбийского университета, Нью-Йоркского университета и Шанхайского отделения Нью-Йоркского университета.

Метод и данные

Новый подход, представленный в статье, получил название... Генерация, контролируемая фактами (FCG), а также вводит виртуальный регулятор, позволяющий пользователям указывать, насколько точным должен быть ответ чат-бота. «По сути,» В документе говорится: «FCG улучшает модель, добавляя регулируемый «рычаг» для проверки достоверности данных»..

Модель принимает на вход вопрос пользователя и желаемый уровень достоверности информации, а затем генерирует ответ, включающий только ту информацию, которую она считает достаточно надежной, стараясь при этом быть максимально подробной в рамках заданного уровня достоверности.

С помощью системы FactScore (ссылка выше) сегментированные выходные данные из тестовых запросов оцениваются на точность, качество которой определяется как соблюдение фактов:

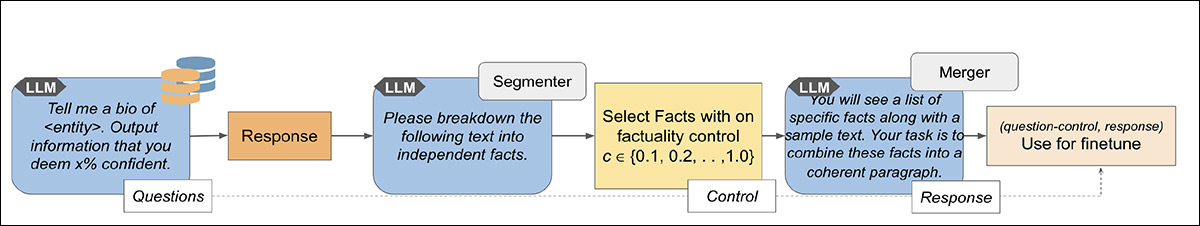

Конвейер обработки обучающих данных для FCG: языковая модель генерирует первоначальный ответ, разбивает его на атомарные факты, ранжирует их по степени достоверности и отбрасывает наименее надежные до тех пор, пока не будет достигнут желаемый уровень истинности. Источник

Поскольку ни один из существующих наборов данных не соответствовал требованиям FCG, авторы создали синтетический набор данных, используя GPT-4.† Сначала языковая модель генерирует ответ без ограничений, затем отсеивает факты с «наименее высокой степенью достоверности», пока ответ не достигнет заданного уровня точности.

Предыдущие исследования показали, что обучение должно проводиться только на эталонные данные данным могли бы создавать модели Меньше фактическийТаким образом, мы отговорили их от предоставления каких-либо дополнительных деталей. Поэтому примеры для обучения FCG были минимально отредактированы, сохранив собственную формулировку и ритм модели, но сократив их ровно настолько, чтобы достичь требуемого целевого уровня достоверности.

Применив этот процесс редактирования к различным целевым уровням достоверности, от 10% до строгого порога в 100%, был создан синтетический набор данных, в котором каждый вопрос был сопоставлен с несколькими отфильтрованными ответами.

В каждой версии сохранялись только те факты, которые модель сочла достаточно надежными для достижения требуемого уровня достоверности; эти примеры затем использовались в качестве обучающих данных для контролируемой тонкой настройки.

Итоговый набор данных состоял из 3,302 (вопрос, контроль, ответ) утраивается для тренировок, и 396 для ПроверкаМодель была создана из 500 объектов, разделенных на 450 для обучения и 50 для разработки. Еще 183 отдельных объекта были использованы для тестирования.

Обучение и тесты

Авторы доработали Mistral-7B-Instruct-v0.2 LLM модель в различных скорость обучения (3e-6, 1e-5, 3e-5) для получения оптимального (неуказанного) LR, для 30 эпохи, при размер партии из 256 (NB Оборудование для обучения не указано.

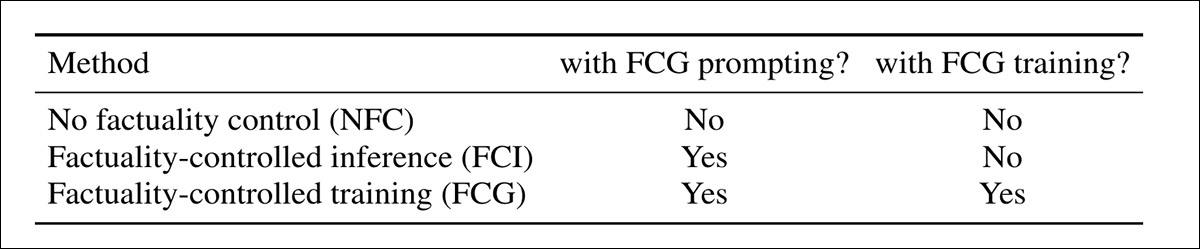

FCG тестировали в сравнении с двумя базовыми показателями. Первый был Без проверки фактов (NFC), где модели просто подавался запрос, например, Расскажите мне биографию X.При этом точность и достоверность не упоминаются. Эта версия отражает поведение LLM по умолчанию, без каких-либо механизмов фильтрации или ограничений.

Второй метод, называемый Умозаключение, контролируемое фактами (FCI) использовал те же подсказки уровня достоверности без какой-либо тонкой настройки. Например, модели могут быть предложены следующие варианты: «Выведите информацию, в достоверности которой вы уверены на 90%».В данном случае инструкции напоминали те, которые использовались при обучении, но модель ранее не сталкивалась с подобными ограничениями:

Сравнение трех протестированных подходов: базовый вариант без контроля; версия с использованием фактических подсказок без обучения; и доработанная модель, которая научилась следовать настройкам точности посредством воздействия на отфильтрованные данные.

Первоначально был проведен тест для соблюдение фактов:

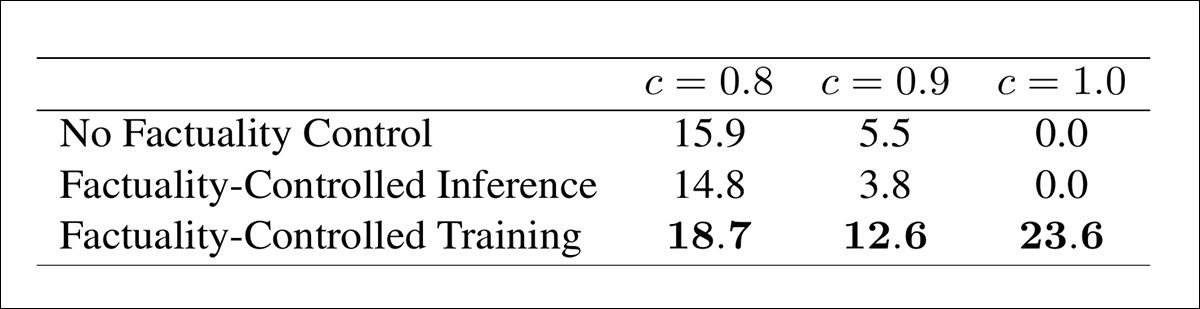

Результаты на трех целевых уровнях достоверности. Только полностью обученная модель смогла выдавать полностью достоверные результаты, и она превзошла обе базовые модели по всем параметрам, особенно при более высоких пороговых значениях.

При тестировании с пороговыми значениями достоверности 80%, 90% и 100% только доработанная модель смогла стабильно достигать целевых показателей. Удивительно, но простое добавление инструкций по оценке достоверности без обучения модели их выполнению не помогло. В некоторых случаях это даже ухудшило ситуацию; например, только 3.8% результатов, полученных с помощью подсказок, соответствовали пороговому значению 90%, по сравнению с 5.5% у версии без каких-либо инструкций.

Это, как утверждают авторы, говорит о том, что базовая модель Mistral-7B не смогла интерпретировать такие подсказки, как... «Будьте уверены на 90%» полезным образом, и дополнительная инструкция, возможно, даже нарушила его обычный результат.

Напротив, обученная модель надежно реагировала на управляющие сигналы, обеспечивая 18.7% соответствия требованиям при 80%, 12.6% при 90% и 23.6% при 100%; и она оказалась единственным методом, способным генерировать хоть какие-то результаты. полностью фактический ответы:

«Эти улучшения показывают, что способность контролировать достоверность фактов действительно может быть привита посредством контролируемого обучения. Модель FCG научилась корректировать свой контент и включать только те факты, в которых она достаточно уверена, в то время как стандартная модель не могла эффективно использовать управляющий сигнал самостоятельно».

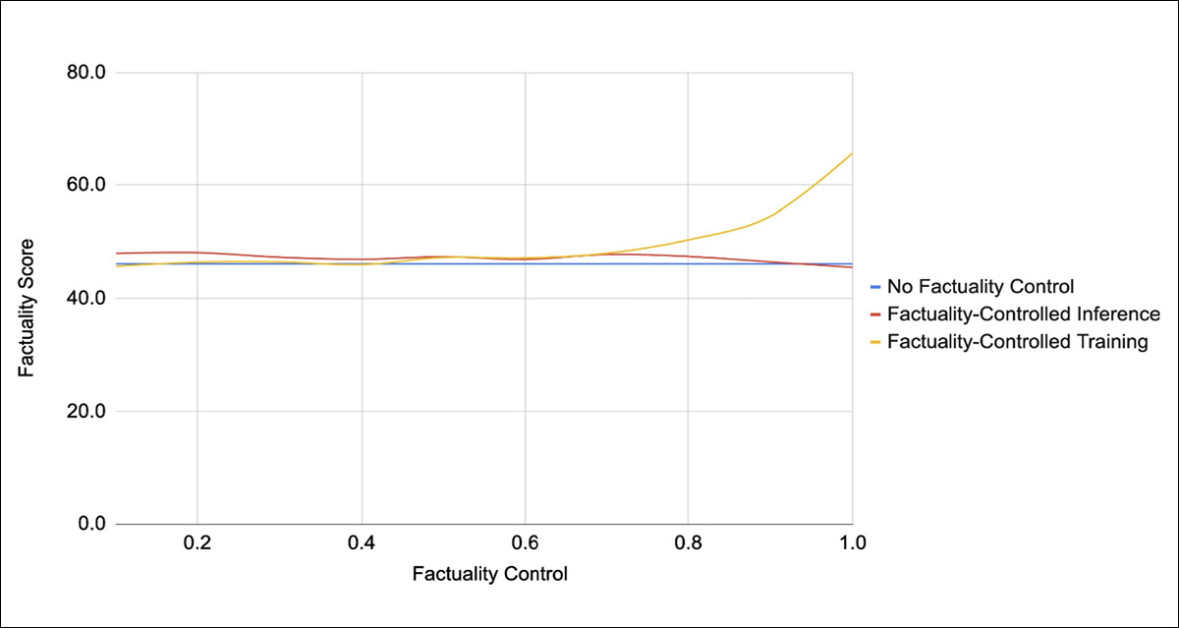

В отдельном тесте, призванном подтвердить, что модель действительно научилась интерпретировать управляющий сигнал, исследователи проверили, повышается ли средняя достоверность ответов по мере того, как запрашиваются более высокие значения уровня истинности.

До начала обучения подобной закономерности не наблюдалось, но после него результаты показали устойчивую тенденцию к росту: более высокий уровень уверенности приводил к соответственно более точным ответам.

По мере повышения целевого уровня достоверности, усовершенствованная модель выдавала все более точные результаты, в то время как базовые модели не демонстрировали каких-либо последовательных изменений в том же диапазоне.

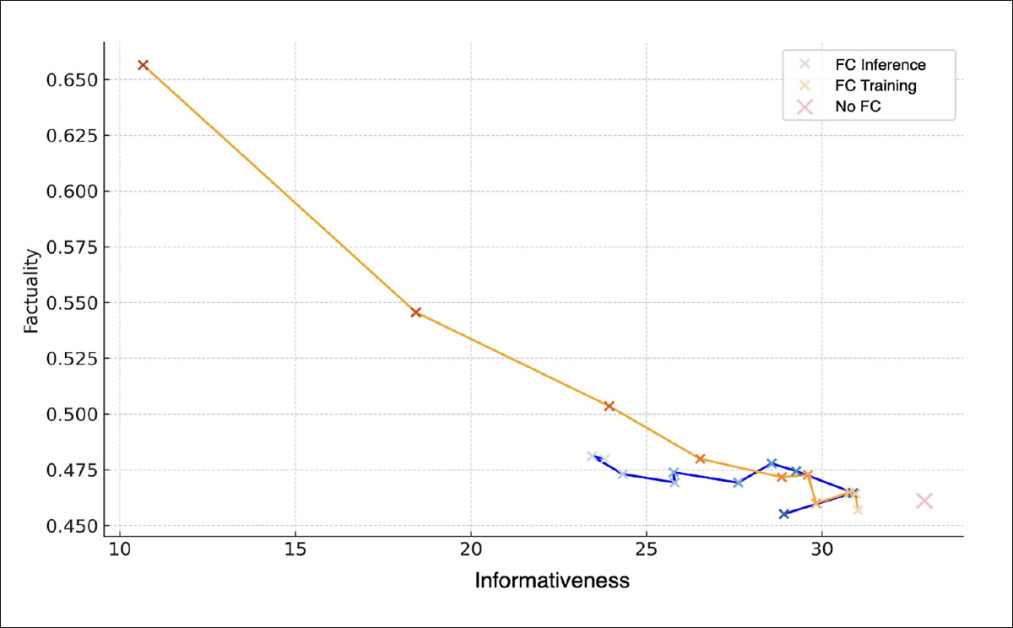

Также был исследован компромисс между правдивостью и «насыщенностью» информации. Результаты оценивались не только по точности, но и по тому, сколько проверенной информации оставалось при все более строгих требованиях к фактической достоверности. Как показано на графике ниже, модель FCG превзошла как базовую модель, основанную только на выводах, так и модель без ограничений на большинстве уровней:

График, отображающий компромисс между достоверностью и информативностью для трех методов. Было установлено, что доработанная модель обеспечивает лучший баланс между правдой и детализацией, чем любой из базовых методов. При сопоставимых уровнях точности сохранялось больше фактического содержания, и при самом высоком уровне точности она оставалась единственным методом, способным выдавать полностью проверенные ответы, которые не были пустыми.

При целевой точности около 90% метод FCG сохранил больше фактов, чем любой другой метод, и во всем диапазоне настроек достоверности ни один из базовых методов не показал стабильно лучших результатов.

Разница была наиболее заметна при самых строгих настройках, где FCG продолжал демонстрировать ненулевую информативность, в то время как базовый вариант с одними только подсказками был вынужден исключить все. В этих случаях даже одно утверждение с низкой степенью уверенности приводило к полному отбрасыванию ответа.

Напротив, обученная модель смогла изменить свой результат таким образом, чтобы сохранить только те факты, которые она считала полностью достоверными, избегая замалчивания, которое затронуло остальные.

Фактическая достоверность напрямую ограничивалась настройками управления, в то время как информативность оптимизировалась за счет включения в модель как можно большего количества достоверной информации. При более высоких настройках сохранялись только достоверные утверждения; при более низких допускались более спекулятивные детали, что увеличивало объем данных, но снижало точность.

Авторы заключают:

«[Когда] действует ограничение на высокую степень достоверности фактов, модель отдает приоритет утверждениям, поддающимся проверке, при этом включая как можно больше релевантной информации. И наоборот, модель имеет возможность включать более широкий спектр деталей, в том числе и менее проверяемые или более спекулятивные, что приводит к большей информативности (большему количеству упомянутых фактов) за счет некоторой потери точности».

«Такое поведение соответствует нашей схеме построения обучающих данных: поскольку мы всегда удаляли минимально необходимые факты, модель научилась: „Если вам необходимо x% фактов, отбросьте наименее достоверные детали, но сохраните все остальное“».

В заключение статьи выражается надежда на то, что новая методология будет опробована на моделях большего масштаба и применена к более сложным задачам, а также к другим возможным направлениям дальнейшего развития работы.

Заключение

Предлагаемое здесь решение устраняет одну из самых серьезных и часто отмечаемых проблем даже последнего поколения больших языковых моделей — их склонность отдавать предпочтение многословию перед точностью, по-видимому, просто чтобы «поддерживать разговор», и уверенно представлять либо устаревшую, либо полностью выдуманную информацию как факт.

Для пользователей ChatGPT любой уверенный ответ, не сопровождаемый кратковременным появлением виджета «поиск в сети», будет либо соответствовать рамкам модели, либо исходить из неё. дата прекращения знанийили же это может быть скорее галлюцинация, чем факт.

Однако веб-поиск увеличивает задержку и эксплуатационные расходы хоста LLM, и, как известно любому пользователю, выполняется выборочно, по запросу пользователя или в качестве «специальной настройки», которая может повлечь за собой дополнительные расходы на токены.

Тем не менее, подобные внутренние экономические факторы могут оказывать критическое влияние на запросы LLM в определенных областях или для определенных типов запросов. Любой метод, который может наложить схему, связанную с точностью выходных данных, безусловно, является перспективным направлением исследований.

* Мое преобразование встроенных ссылок на авторов в гиперссылки.

† Номер полной версии не указан.

Впервые опубликовано в пятницу, 6 февраля 2026 года. Исправлено в течение следующих пяти минут из-за повторения слова.