Искусственный интеллект

Генерация лучших видео ИИ из двух изображений

Интерполяция кадров видео (VFI) – это открытая проблема в области исследований генеративного видео. Задача состоит в том, чтобы сгенерировать промежуточные кадры между двумя существующими кадрами в видеопоследовательности.

Нажмите, чтобы воспроизвести. Фреймворк FILM, разработанный совместно Google и Университетом Вашингтона, предложил эффективный метод интерполяции кадров, который остается популярным в кругах хоббиистов и профессионалов. Слева мы видим два отдельных и различных кадра, наложенных друг на друга; в середине – ‘конечный кадр’; и справа – окончательная синтез между кадрами. Источники: https://film-net.github.io/ и https://arxiv.org/pdf/2202.04901

В широком смысле, эта техника восходит к более чем столетию назад и использовалась в традиционной анимации с тех пор. В этом контексте мастера ‘ключевые кадры’ создавались главным художником-аниматором, а работа по ‘твинингу’ промежуточных кадров выполнялась другими сотрудниками как более рутинная задача.

До появления генеративного ИИ интерполяция кадров использовалась в проектах, таких как Реальное время оценки промежуточного потока (RIFE), Интерполяция кадров видео с учетом глубины (DAIN) и Интерполяция кадров для крупного движения (FILM – см. выше) для увеличения частоты кадров существующего видео или для создания искусственно сгенерированных эффектов замедленного движения. Это достигается путем разделения существующих кадров клипа и генерации оценочных промежуточных кадров.

VFI также используется при разработке лучших видеокодеков и, более generally, в системах, основанных на оптическом потоке (включая генеративные системы), которые используют предварительные знания о будущих ключевых кадрах для оптимизации и формирования промежуточного контента, предшествующего им.

Конечные кадры в генеративных видеосистемах

Современные генеративные системы, такие как Luma и Kling, позволяют пользователям указать начальный и конечный кадр и могут выполнить эту задачу, анализируя ключевые точки в двух изображениях и оценивая траекторию между двумя изображениями.

Как мы видим в примерах ниже, предоставление ‘заключительного’ ключевого кадра лучше позволяет генеративной видеосистеме (в данном случае, Kling) сохранять такие аспекты, как идентичность, даже если результаты не идеальны (особенно при больших движениях).

Нажмите, чтобы воспроизвести. Kling – одна из растущего числа генераторов видео, включая Runway и Luma, которые позволяют пользователю указать конечный кадр. В большинстве случаев минимальное движение приведет к наиболее реалистичным и наименее ошибочным результатам. Источник: https://www.youtube.com/watch?v=8oylqODAaH8

В приведенном выше примере идентичность человека последовательна между двумя заданными пользователем ключевыми кадрами, что приводит к относительно последовательной генерации видео.

Когда предоставляется только начальный кадр, окно внимания генеративной системы обычно не достаточно велико, чтобы ‘запомнить’, как выглядел человек в начале видео. Скорее, идентичность, скорее всего, будет смещаться немного с каждым кадром, пока не будет потеряна вся подобие. В примере ниже был загружен стартовый образ, а движение человека руководствовалось текстовым промптом:

Нажмите, чтобы воспроизвести. Без конечного кадра Kling имеет только небольшую группу непосредственно предшествующих кадров, чтобы руководить генерацией следующих кадров. В случаях, когда требуется любое значительное движение, эта атрофия идентичности становится тяжелой.

Мы видим, что подобие актера не устойчиво к инструкциям, поскольку генеративная система не знает, как он будет выглядеть, если он будет улыбаться, и он не улыбается в семенном изображении (единственном доступном справочнике).

Большинство вирусных генеративных клипов тщательно отбираются, чтобы преуменьшить эти недостатки. Однако прогресс временно последовательных генеративных видеосистем может зависеть от новых разработок в исследовательском секторе в отношении интерполяции кадров, поскольку единственной возможной альтернативой является зависимость от традиционного CGI в качестве управляющего ‘руководящего’ видео (и даже в этом случае согласованность текстуры и освещения в настоящее время трудно достижима).

Кроме того, медленно-итеративная природа получения нового кадра из небольшой группы недавних кадров делает это очень трудным достижение крупных и смелых движений. Это связано с тем, что объект, быстро движущийся через кадр, может перейти с одной стороны на другую в течение одного кадра, в отличие от более постепенных движений, на которых система, скорее всего, была обучена.

Аналогично, значительное и смелое изменение позы может привести не только к сдвигу идентичности, но и к ярким несоответствиям:

Нажмите, чтобы воспроизвести. В этом примере из Luma запрошенное движение, кажется, не хорошо представлено в обучающих данных.

Framer

Это приводит нас к интересной недавней статье из Китая, которая утверждает, что достигла нового состояния в аутентичной интерполяции кадров – и которая является первой в своем роде, предлагающей взаимодействие на основе перетаскивания.

Framer позволяет пользователю направлять движение с помощью интуитивно понятного интерфейса на основе перетаскивания, хотя он также имеет ‘автоматический’ режим. Источник: https://www.youtube.com/watch?v=4MPGKgn7jRc

Приложения, основанные на перетаскивании, стали частыми в литературе в последнее время, поскольку исследовательский сектор борется за предоставление инструментов для генеративных систем, которые не основаны на достаточно грубых результатах, полученных с помощью текстовых промптов.

Новая система, озаглавленная Framer, может не только следовать за пользовательским перетаскиванием, но также имеет более традиционный ‘автопилотный’ режим. Кроме конвенционального твининга, система способна производить симуляции времени, а также морфинг и новые виды входного изображения.

Промежуточные кадры, сгенерированные для симуляции времени в Framer. Источник: https://arxiv.org/pdf/2410.18978

В отношении производства новых видов Framer немного пересекается с областью нейронных радиационных полей (NeRF) – хотя требует только двух изображений, в то время как NeRF обычно требует шесть или более входных изображений.

В тестах Framer, основанный на модели генеративного видео латентного распространения Stability.ai Stable Video Diffusion, смог превзойти соперничающие подходы, в пользовательском исследовании.

На момент написания статьи код должен быть выпущен на GitHub. Видеопримеры (из которых получены вышеуказанные изображения) доступны на сайте проекта, и исследователи также выпустили видео на YouTube.

Новая статья называется Framer: Интерактивная интерполяция кадров, и исходит от девяти исследователей из Университета Чжэцзяна и группы Alibaba – Ant Group.

Метод

Framer использует интерполяцию на основе ключевых точек в любом из своих двух режимов, при котором входное изображение оценивается для базовой топологии, и ‘движимые’ точки назначаются при необходимости. По сути, эти точки эквивалентны ориентирам лица в системах, основанных на идентификации, но обобщаются на любую поверхность.

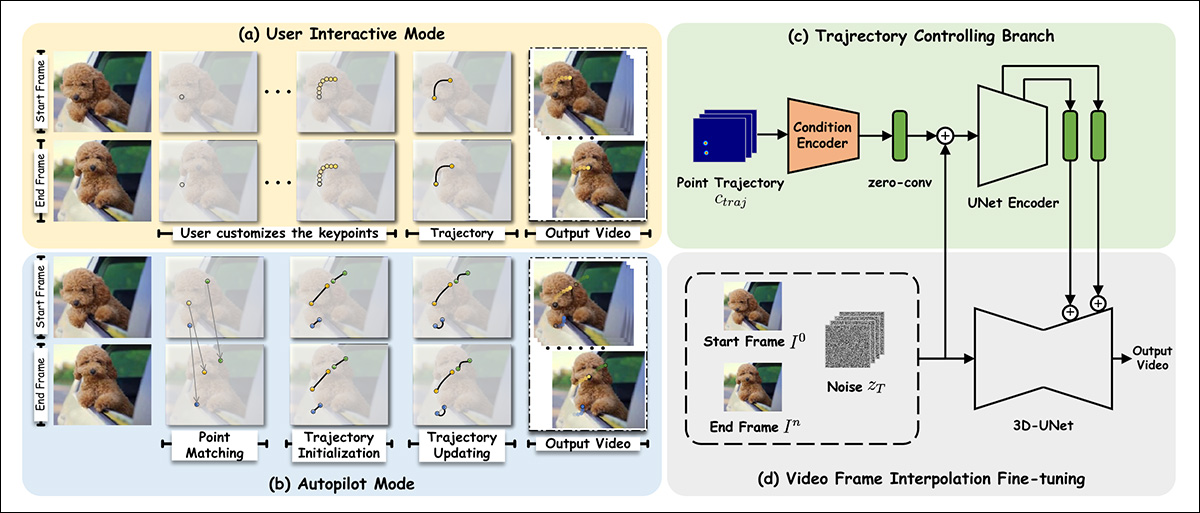

Исследователи настроили Stable Video Diffusion (SVD) на наборе данных OpenVid-1M, добавив дополнительную возможность синтеза последнего кадра. Это обеспечивает механизм управления траекторией (вверху справа на схеме ниже), который может оценить путь к конечному кадру (или от него).

Схема для Framer.

Что касается добавления условия последнего кадра, авторы заявляют:

‘Чтобы сохранить визуальный приоритет предварительно обученной SVD как можно больше, мы следуем парадигме условности SVD и вводим условия конечного кадра в латентном пространстве и семантическом пространстве соответственно.

‘В частности, мы объединяем функцию VAE-кодирования первого [кадра] с шумным латентным первым кадром, как это было сделано в SVD. Кроме того, мы объединяем функцию латентного последнего кадра, zn, с шумным латентным конечным кадром, учитывая, что условия и соответствующие шумные латенты пространственно выровнены.

‘Кроме того, мы извлекаем вложение изображения CLIP первого и последнего кадров отдельно и объединяем их для инъекции функции кросс-аттенции.’

Для функциональности на основе перетаскивания модуль траектории использует фреймворк CoTracker, возглавляемый Meta Ai, который оценивает множество возможных путей вперед. Эти пути сокращаются до 1-10 возможных траекторий.

Полученные координаты точек затем преобразуются через методологию, вдохновленную архитектурами DragNUWA и DragAnything. Это получает гауссовское тепловое карту, которое индивидуализирует целевые области для движения.

Затем данные передаются в механизмы условности ControlNet, вспомогательной системы соответствия, первоначально разработанной для Stable Diffusion, и с тех пор адаптированной для других архитектур.

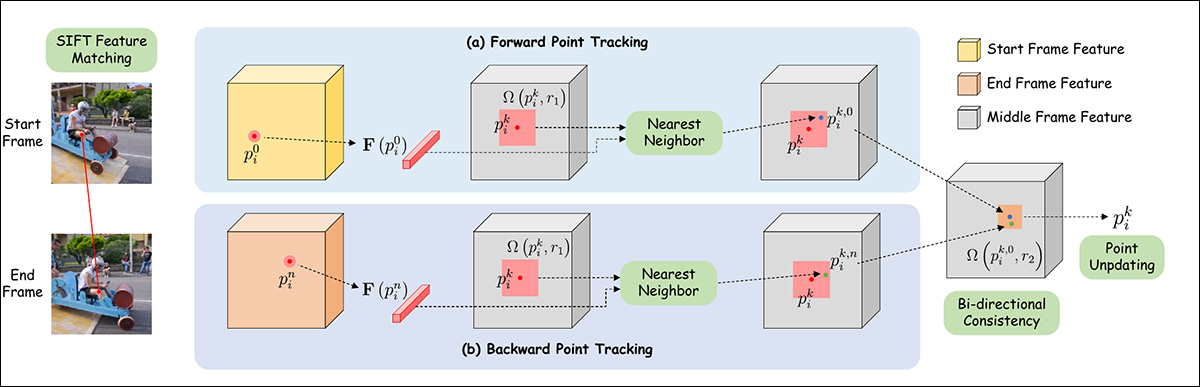

Для автопилотного режима первоначально выполняется сопоставление функций через SIFT, который интерпретирует траекторию, которая может быть передана в механизм самообновления, вдохновленный DragGAN и DragDiffusion.

Схема оценки траектории точки в Framer.

Данные и тесты

Для дообучения Framer были заморожены пространственное внимание и остаточные блоки, и только временные слои внимания и остаточные блоки были затронуты.

Модель была обучена в течение 10 000 итераций под AdamW, при скорости обучения 1e-4 и размере партии 16. Обучение проходило на 16 GPU NVIDIA A100.

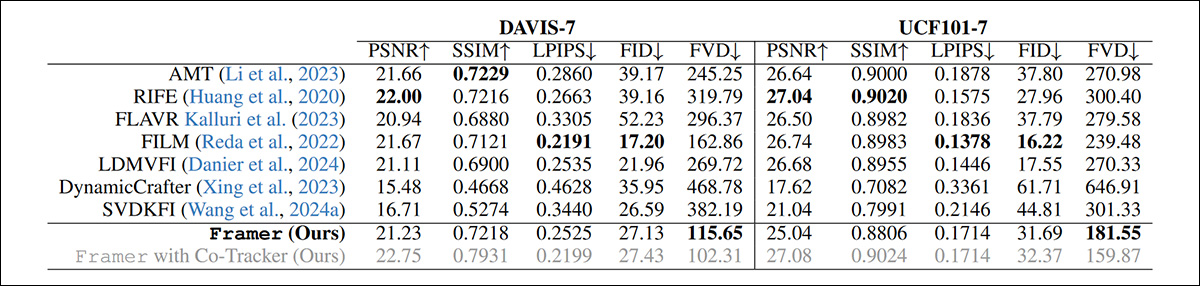

Поскольку предыдущие подходы к этой проблеме не предлагают редактирование на основе перетаскивания, исследователи решили сравнить автопилотный режим Framer с стандартной функциональностью более старых предложений.

Фреймворки, протестированные для категории текущих систем генерации видео на основе распространения, были LDMVFI; Dynamic Crafter; и SVDKFI. Для ‘традиционных’ видеосистем соперничающими фреймворками были AMT; RIFE; FLAVR; и упомянутый выше FILM.

Помимо пользовательского исследования, тесты были проведены на наборах данных DAVIS и UCF101.

Качественные тесты могут быть оценены только объективными способностями исследовательской команды и пользовательскими исследованиями. Однако статья отмечает, что традиционные количественные метрики в основном не подходят для предложения:

‘[Метрики восстановления] такие как PSNR, SSIM и LPIPS не могут точно оценить качество интерполированных кадров, поскольку они наказывают другие правдоподобные результаты интерполяции, которые не выровнены с исходным видео.’

‘Хотя метрики генерации, такие как FID, предлагают некоторое улучшение, они все равно не оправдывают ожиданий, поскольку они не учитывают временную согласованность и оценивают кадры в изоляции.’

Несмотря на это, исследователи провели качественные тесты с несколькими популярными метриками:

Количественные результаты для Framer по сравнению с соперничающими системами.

Авторы отмечают, что, несмотря на то, что шансы были против них, Framer все равно достигает лучшего балла FVD среди протестированных методов.

Ниже приведены образцы результатов статьи для качественного сравнения:

Качественное сравнение с предыдущими подходами. Пожалуйста, обратитесь к статье для лучшего разрешения, а также видеорезультатов на https://www.youtube.com/watch?v=4MPGKgn7jRc.

Авторы комментируют:

‘[Наш] метод производит значительно более четкие текстуры и естественное движение по сравнению с существующими методами интерполяции. Он работает особенно хорошо в сценариях с существенными различиями между входными кадрами, где традиционные методы часто не могут точно интерполировать контент.

‘По сравнению с другими методами, основанными на распространении, такими как LDMVFI и SVDKFI, Framer демонстрирует лучшую адаптивность к сложным случаям и предлагает лучший контроль.’

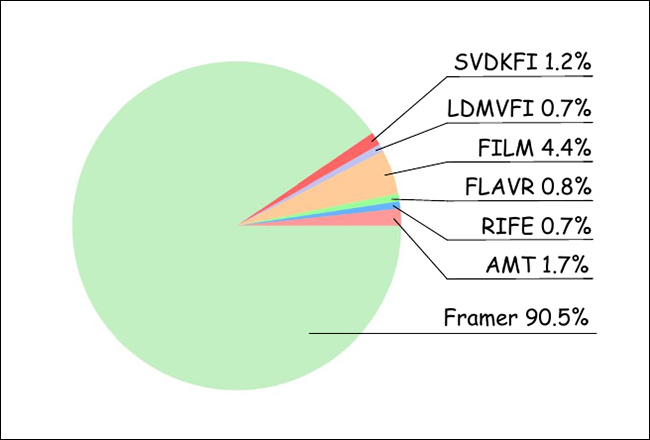

Для пользовательского исследования исследователи собрали 20 участников, которые оценили 100 случайно упорядоченных видеорезультатов от различных методов. Таким образом, было получено 1000 оценок, оценивающих наиболее ‘реалистичные’ предложения:

Результаты пользовательского исследования.

Как видно из графика выше, пользователи подавляющим большинством голосов предпочли результаты Framer.

Сопровождающее видео на YouTube проекта очерчивает некоторые другие потенциальные применения Framer, включая морфинг и промежуточную анимацию – где началась вся концепция.

Вывод

Трудно переоценить, насколько важна эта задача в настоящее время для задачи генерации видео на основе ИИ. На данный момент старые решения, такие как FILM и (не-ИИ) EbSynth, использовались как сообществами хоббиистов, так и профессионалов, для твининга между кадрами; но эти решения имеют заметные ограничения.

Из-за неискреннего подбора официальных примеров видео для новых фреймворков T2V существует широкое общественное заблуждение, что системы машинного обучения могут точно вывести геометрию в движении без обращения к механизмам управления, таким как 3D-моделируемые модели (3DMM) или другие вспомогательные подходы, такие как LoRAs.

Чтобы быть честным, сам твининг, даже если он может быть идеально выполнен, составляет только ‘хак’ или обход этой проблемы. Тем не менее, поскольку часто легче произвести два хорошо выровненных кадра изображения, чем обеспечить руководство с помощью текст-промптов или текущего ряда альтернатив, хорошо видеть итеративный прогресс в ИИ-версии этого старого метода.

Опубликовано впервые во вторник, 29 октября 2024