Взгляд Anderson

Даже базовый ИИ теперь может писать новости, которые неотличимы от человеческих

Новые исследования показывают, что даже небольшие местные модели ИИ могут писать новости, которые люди не могут отличить от реальной журналистики, сопоставимые с лучшими системами, и оставляющие читателей не в состоянии определить, кто написал что.

Согласно новому исследованию, проведенному в сотрудничестве между Германией и Францией, люди не могут определить, написана ли статья ИИ или человеком – даже когда она написана открытыми моделями, которые можно скачать и запустить на относительно средних потребительских компьютерах.

В еще одном указании на то, что маленькие модели ИИ на подъеме, опрос 2 318 суждений, собранных из 1 054 участников в специальном академическом исследовательском портале, показал, что человеческие читатели не могут определить происхождение статьи на уровне выше случайного, даже когда она была сгенерирована относительно скромными моделями с семью миллиардами параметров, включая Mistral и Llama варианты:

Средние баллы источника и аутентичности для протестированных LLM. 200 миллиардов параметров GPT-4o не существенно превышают 7 миллиардов параметров меньших моделей. Протестированные модели были Gemma 7B, Phi-3 Mini, LLaMA-2 13B, Mistral 7B, GPT-4o и GPT-3.5. Источник

Авторы возвращаются к теме, которую они впервые исследовали в выпуске 2024 года release Благословение или проклятие? Исследование влияния генеративного ИИ на фейковые новости. Самые результаты являются новыми, опубликованными результатами из более крупного проекта, первоначально анонсированного в январе, и используют собственный JudgeGPT онлайн-платформу.

Перьящие возможности

Названная Могут ли люди определить? Двухосевое исследование человеческого восприятия новостей, сгенерированных LLM, и исходящая от трех исследователей из Франкфуртского университета прикладных наук и исследовательского подразделения IRISA в Нанте, новое исследование делает важное различие между ‘фейковыми новостями’ и ‘новостями, написанными ИИ’ (поскольку фейковые новости могут быть написаны людьми или ИИ, и два аспекта не являютсяecessarily синонимами).

Однако, возможно, наиболее интересным аспектом является вывод исследования, что небольшие модели, включая Mistral 7B и Gemma 7B, могут, имея всего семь миллиардов параметров, соперничать с такими моделями, как ChatGPT (4o) с 200 миллиардами параметров:

‘Открытые модели с таким же небольшим количеством параметров, как 7 миллиардов, производят текст, оцененный не хуже, чем вывод GPT-4o, указывая на то, что способность генерировать текст, неотличимый от человеческого, больше не ограничена только передовыми моделями.’

Однако ‘новости, сгенерированные ИИ’, могут представлять собой многие различные виды сотрудничества между человеком и ИИ, от проверки орфографии до полного, карьерного отказа от усилий, и исследование не уточняет точно, какой вид контента ИИ был произведен для тестов (хотя оно описывает методологию их производства – см. ниже).

Метод

Для участников, вовлеченных в платформу JudgeGPT, каждый фрагмент новости оценивался с помощью двуосевого каркаса, в котором они предоставили три независимых рейтинга на непрерывных слайдах 0-100:

Графический интерфейс портала JudgeGPT, где оценщики оценивают материал по атрибуции источника; аутентичности; и знакомству с темой. Пожалуйста, обратитесь к исходной статье для лучшего разрешения.

Суд по источнику захватил, казалось ли отрывок написанным машиной или человеком; суд по аутентичности, было ли оно воспринято как фейковое или законное; и знакомство с темой, насколько хорошо читатель знал предмет.

Непрерывные шкалы использовались вместо Likert шкалы, чтобы захватить степени уверенности более точно, и поддержать статистический анализ, включая Пирсоновскую корреляцию и кластеризацию.

Фрагменты текста, сгенерированные машиной, были произведены с помощью собственного RogueGPT каркаса, который является кормящей архитектурой для JudgeGPT. RogueGPT оркестрирует вклады из шести Больших Языковых Моделей (LLM): ChatGPT-4; ChatGPT-3.5; ChatGPT-4o; LLaMA-2 13B; Gemma 7B; и Mistral 7B.

Промпты, основанные на персонаже, использовались для генерации текстов, и генерации ИИ были основаны на реальных новостных темах и проверены людьми.

Напротив, фрагменты текста, написанные людьми, были взяты из ‘установленных новостных изданий’ и неуказанных ‘информационных баз данных’.

Авторы наблюдают:

‘Набор стимулов намеренно смещен в сторону фрагментов, сгенерированных машиной (∼98%), с элементами, сгенерированными человеком, служащими якорями калибровки.

‘Этот выбор дизайна отражает фокус исследования на внутри-ИИ вариации (по моделям) rather чем сравнение человек-ИИ; участники не информируются о базовой скорости, и результаты детекции на уровне шанса сохраняются при анализе на подмножестве, сгенерированном человеком.’

Участники сначала дали информированное согласие и завершили демографический опросник, охватывающий возраст, образование, политическую ориентацию и знакомство с ИИ, после чего они оценили последовательность фрагментов новостей.

Каждый человек просмотрел от 5 до 87 элементов, с медианой 12, в то время как порядок представления был случайным, и назначение модели было сбалансировано среди участников, чтобы уменьшить предвзятость. Платформа записала три рейтинга слайдера вместе с временем ответа и анонимным идентификатором, позволяя связать отдельные суждения с фоновыми факторами.

Авторы подчеркивают, что выборка сместилась в сторону образованных европейских участников, с 68% университетского образования, и 74% базировались в Европе – предвзятость, которую статья отмечает как ограничение для более широкой обобщаемости.

Тесты

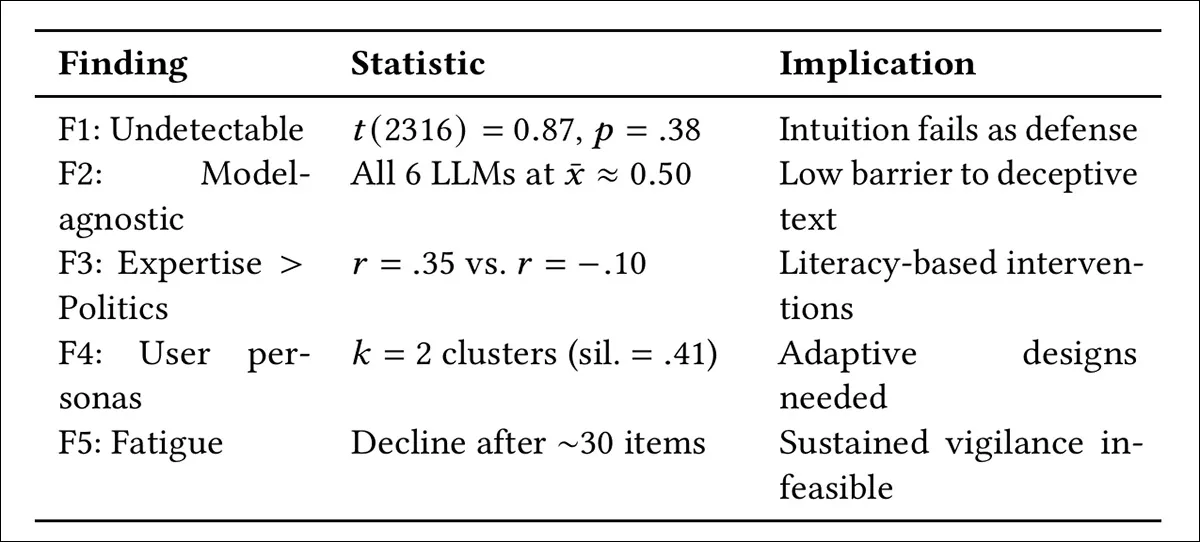

Тесты разделены на пять типов результатов: различие машинно-сгенерированного текста от текста, написанного человеком; сравнение детекции по разным LLM; изучение эффекта доменной экспертизы versus политической ориентации на точность; определение различных стратегий ответа среди участников; и отслеживание того, как точность меняется при повторных оценках, из-за усталости:

Сводка пяти основных результатов из 2 318 суждений по 1 054 участникам, показывающая, что человеческая детекция текста, написанного ИИ, оставалась на уровне шанса во всех моделях, что точность была связана с доменной экспертизой, а не политической ориентацией, что участники кластеризовались в различные профили доверия, и что производительность снижалась после примерно 30 оценок, из-за когнитивной усталости.

Тест показал, что нет существенного различия выше шанса в баллах источника между условиями, по-видимому, указывая на то, что участники не могут различить текст, сгенерированный ИИ, и человеческий вывод:

Распределения баллов источника и аутентичности для фрагментов, сгенерированных машиной и человеком, показывают значительное совпадение, без осмысленного разделения между двумя условиями, и статистическим тестированием – указывающим на то, что участники не могут надежно различать текст, сгенерированный ИИ, и человеческий контент.

Для второго аспекта, как показано на графике в начале статьи, неудача детекции не варьировалась по модели, поскольку выводы всех LLM кластеризовались вокруг суждений на уровне шанса, без существенных различий между ними. Даже более мелкие открытые системы, такие как Mistral 7B и Gemma 7B, были оценены не хуже, чем GPT-4o, указывая на то, что человеческий неотличимый текст может больше не быть ограничен только крупнейшими моделями.

Для третьего аспекта точность была более тесно связана с доменной экспертизой, чем с политической ориентацией, поскольку знакомство с фейковыми новостями коррелировало с лучшими суждениями, в то время как политические взгляды показали нет существенного эффекта, предполагая, что приобретенные аналитические навыки могут быть более важными, чем идеология:

Результаты третьей линии исследования показали, что политическая ориентация не имела существенного эффекта на атрибуцию источника или баллы аутентичности, с только слабыми, не существенными тенденциями, в то время как саморейтинг знакомства с фейковыми новостями был связан с более высокой точностью по обеим осям. Это предполагает, что опытно-основанные аналитические навыки были более сильным предиктором производительности, чем идеологическая позиция. Пожалуйста, обратитесь к исходной статье для лучшего разрешения.

Четвертый результат показал, что участники кластеризовались в два различных стиля ответа, определенных как ‘Скептики’ – которые присваивали низкий уровень доверия контенту независимо от происхождения – и ‘Верующие’ – которые поддерживали более высокий уровень доверия.

Наконец, в отношении пятой цели, анализ последовательных суждений показал, что участники изначально становились лучше в задаче, с точностью, улучшающейся примерно за первые 15-20 оценок, поскольку они адаптировались к формату:

Скользящие средние баллы атрибуции источника и аутентичности по последовательности оценок участников показывают короткую начальную фазу улучшения, поскольку пользователи, по-видимому, адаптируются к задаче в течение первых 15-20 элементов, за которой следует стабильное снижение в обоих показателях после примерно 30 оценок. Пожалуйста, обратитесь к исходной статье для лучшего разрешения.

Однако этот эффект был недолгим, поскольку производительность начала снижаться после примерно 30 элементов, с участниками, все чаще помечающими контент как фейковый – сдвиг, интерпретируемый как когнитивная усталость, и предполагающий четкие ограничения на то, как долго подходы, основанные на детекции, могут оставаться эффективными на практике.

Это может представлять собой некоторые эмпирические доказательства того, что, устав от перспективы различения фейковых новостей от реальных, новостей ИИ от человеческих, мы можем склоняться к предположению, что новости являются ИИ и/или фейковыми (не обязательно одно и то же), чтобы быть ‘на безопасной стороне’. Те, кто считает это ‘ленивым’, и считает, что люди должны сами исследовать, чтобы проверить потенциальную фейковую новость, могут быть заинтересованы в том, чтобы узнать, что исследование 2024 года указало, что это только ухудшает проблемы.

Авторы предлагают, что неудача человеческого суждения, очевидная в результатах, указывает на то, что мы можем нуждаться в том, чтобы передать такие вопросы технологиям криптографической происхождения, таким как инициатива C2PA, возглавляемая Adobe. Другие возможные решения, упомянутые в статье, включают собственный OriginLens каркас авторов, и другой проект, участвующий в авторах, называемый CRED-1.

Авторы заключают:

‘Могут ли люди определить? Наше двухосевое исследование 2 318 суждений по шести семействам LLM дает четкий эмпирический ответ: они не могут.

‘Текст, сгенерированный машиной, неотличим от человеческого письма, независимо от размера модели или семьи, доменная экспертиза предсказывает точность детекции сильнее, чем политическая ориентация, участники принимают различные стратегии доверия, и когнитивная усталость ограничивает устойчивую детекцию.

‘Эти результаты поддерживают сдвиг от детекции на уровне пользователя к системным мерам, включая происхождение контента, адаптивные индикаторы доверия и вмешательства по иммунитету.’

Заключение

Тревожным аспектом этой статьи является окружающая поддерживающая сеть проектов и статей, которые авторы – или некоторые из авторов, в зависимости от работы – зародили или в которых имеют руку; и, безусловно, было бы просвещающим, если бы можно было изучить образцы текста, сгенерированного ИИ и написанного человеком, которые произвели эти результаты, чтобы лучше понять, какой тип вывода описанная методология генерации производит.

Тем не менее, интересно услышать, что открытые, открытые модели могут сравниться с гигантами API, такими как серия ChatGPT – может ли быть так, что задача на самом деле не так сложна, и что модель с 200 миллиардами параметров является избыточной для таких задач? Нам нужно было бы знать немного больше о представленных образцах текста, сгенерированного ИИ и написанного человеком, чтобы ответить на этот вопрос.

В meantime, согласно веб-сайту canirun.ai, Mistral 7B (который был примерно на одном уровне с ChatGPT-4o в тестах) ‘работает отлично’ на NVIDIA RTX 3080 с 16 ГБ видеопамяти, и работает ‘прилично’ на 3060 с 6 ГБ видеопамяти – далеко не самые новые или величайшие графические карты в игре*. Таким образом, любой, кто хочет разработать свою собственную методологию для представления образцов, может, по-видимому, участвовать в этих экспериментах тоже.

* Gemma 7B не перечислена на сайте.

Опубликовано впервые в четверг, 9 апреля 2026