Взгляд Anderson

Кодирование ИИ склонно страдать от эффекта Даннинга-Крюгера

Новые исследования показывают, что кодирование ИИ, такие как ChatGPT, страдают от эффекта Даннинга-Крюгера, часто действуя наиболее уверенно, когда они наименее компетентны. Когда они решают незнакомые или малоизвестные языки программирования, они заявляют о высокой уверенности, даже когда их ответы разваливаются. Исследование связывает чрезмерную уверенность модели с плохой производительностью и отсутствием тренировочных данных, что вызывает новые опасения по поводу того, сколько этих систем действительно знают о том, чего они не знают.

Кто-либо, кто провел даже умеренное количество времени, взаимодействуя с большими языковыми моделями по фактическим вопросам, уже знает, что ЯМ часто склонны давать уверенный, но неправильный ответ на запрос пользователя.

Вместе с более очевидными формами галлюцинаций, причина этой пустой хвастливости не совсем ясна. Исследования, опубликованные летом, предполагают, что модели дают уверенные ответы даже когда они знают, что они ошибаются, например; хотя другие теории приписывают чрезмерную уверенность архитектурным решениям, среди других возможностей.

Что конечный пользователь может быть уверен, так это то, что опыт невероятно раздражает, поскольку мы запрограммированы доверять оценкам людей своих способностей (не говоря уже о том, что в таких случаях есть последствия, юридические и другие, для человека, который обещает больше, чем может выполнить); и своего рода антропоморфная передача означает, что мы склонны повторять это поведение с разговорными системами ИИ.

Но ЯМ является необъяснимой сущностью, которая может и будет возвращать ‘Ой! Похоже, я ошибся…’ после того, как она поможет пользователю непреднамеренно уничтожить что-то важное, или хотя бы потратить целый день его времени; предполагая, что она признает свою вину.

Хуже того, это отсутствие осторожного рассмотрения кажется невозможным для изменения, по крайней мере в ChatGPT, которая будет обильно заверять пользователя в действительности своего совета и объяснять недостатки своего мышления только после того, как будет нанесен ущерб.

Ни обновление системы постоянной памяти, ни использование повторяющихся запросов не оказывают существенного влияния на проблему.

Люди также могут быть столь же упрямыми и самообманчивыми – хотя любой, кто ошибался так глубоко и часто, вероятно, был бы уволен рано. Такие, как эти, страдают от противоположного ‘синдрома самозванца’ (где сотрудник боится, что он был повышен выше своих способностей) – эффект Даннинга-Крюгера, где человек значительно переоценивает свою способность выполнять задачу.

Стоимость инфляции

Новое исследование от Microsoft изучает ценность эффекта Даннинга-Крюгера в отношении эффективной производительности архитектур кодирования с помощью ИИ (таких как собственная Copilot), в исследовательских усилиях, которые являются первыми, чтобы конкретно решить эту подсубsector ЯМ.

Работа анализирует, как уверенно такие кодирующие ИИ оценивают свои собственные ответы против того, как хорошо они фактически выполнили, через десятки языков программирования. Результаты показывают четкий человеческий шаблон: когда модели были наименее способны, они были наиболее уверены в себе.

Эффект был наиболее сильным в малоизвестных или низкоресурсных языках, где тренировочные данные были тонкими – чем слабее модель или реже язык, тем больше иллюзия навыков:

Фактическая и воспринимаемая производительность GPT-4o по языкам программирования, отсортированная по фактической производительности. Источник: https://arxiv.org/pdf/2510.05457

Четыре автора, все равные вкладчики, работающие для Microsoft, утверждают, что работа вызывает новые вопросы о том, сколько этих инструментов можно доверять, чтобы оценить свою собственную продукцию, и они заявляют:

‘Анализируя уверенность модели и производительность по разнообразному набору языков программирования, мы раскрываем, что модели ИИ отражают человеческие шаблоны чрезмерной уверенности, особенно в незнакомых или низкоресурсных доменах.

‘Наши эксперименты демонстрируют, что менее компетентные модели и те, которые работают в редких языках программирования, демонстрируют более сильную предвзятость, подобную эффекту Даннинга-Крюгера, что предполагает, что сила предвзятости пропорциональна компетентности моделей. Это соответствует человеческим экспериментам по предвзятости.’

Исследователи контекстуализируют эту линию исследования как способ понять, как уверенность модели становится ненадежной, когда производительность слаба, и чтобы проверить, демонстрируют ли системы ИИ тот же вид чрезмерной уверенности, что и люди – с последствиями для доверия и практического развертывания.

Хотя новая статья противоречит закону Беттериджа о заголовках, она все же озаглавлена Страдают ли модели кодирования от эффекта Даннинга-Крюгера?. Хотя авторы утверждают, что код был выпущен для работы, текущая предпубликация не содержит никаких деталей об этом.

Метод

Исследование проверило, насколько точно кодирующие ИИ могут оценить свои собственные ответы, дав им тысячи вопросов с несколькими вариантами ответов, с каждым вопросом, принадлежащим к конкретному языковому домену, от Python и Java до Perl и COBOL:

Домены языков программирования, использованные в исследовании, вместе с количеством вопросов с несколькими вариантами ответов, отобранных для каждого домена.

Модели были задействованы в выборе правильного варианта, и затем оценке того, насколько они уверены в своем выборе, с их фактической производительностью, измеренной тем, как часто они получали правильный ответ – и их самооцененная уверенность, указывающая на то, насколько хорошо они верили, что они были.

Сравнивая эти две метрики, исследователи смогли увидеть, где уверенность и компетентность расходились.

Чтобы измерить, насколько уверенно модели казались, исследование использовало два метода: абсолютную уверенность и относительную уверенность. В первом случае модель была задействована в предоставлении оценки от нуля до одного вместе с каждым ответом, с ее уверенностью для данного языка, определенной как среднее значение этих оценок по вопросам в этом языке.

Второй метод посмотрел на то, насколько уверена была модель, когда выбирая между двумя вопросами; для каждой пары модель должна была сказать, какой из них она чувствовала себя более уверенно. Эти выборы затем были оценены с помощью систем ранжирования, первоначально разработанных для конкурентных игр, рассматривая каждый вопрос как игрока в матче. Окончательные оценки были нормализованы и усреднены для каждого языка, чтобы дать относительную оценку уверенности.

Два установленных вида эффекта Даннинга-Крюгера исследуются в статье: один, который отслеживает, как одна модель неправильно оценивает свою производительность по разным доменам; и другой, который сравнивает уровни уверенности между более слабыми и более сильными моделями.

Первый вид, называемый внутрипучковым ДКЭ, смотрит на то, становится ли одна модель более чрезмерно уверенной в языках, где она выполняет плохо. Второй, межпучковый ДКЭ, спрашивает, склонны ли модели, которые выполняют хуже в целом, также оценивать себя более высоко.

В обоих случаях разрыв между уверенностью и фактической производительностью используется для измерения чрезмерной уверенности, с более крупными разрывами в условиях низкой производительности, указывающими на поведение, подобное ДКЭ.

Лечение моделей как участников ввело некоторые ограничения, поскольку небольшое количество моделей влияет на разнообразие; различия внутри вывода одной модели игнорируются; и распределение данных может не отражать то, что реальных человеческих участников.

Чтобы учесть это, исследование протестировало три альтернативных установки: первая, каждая модель была дана отдельная личность; вторая, ответы были отобраны при более высокой температуре, чтобы создать больше вариаций; третья, запросы были перефразированы несколько раз, с каждой версией, обработанной как отдельный участник:

Корреляция между чрезмерной уверенностью и фактической производительностью по разным экспериментальным установкам, показывающая, что шаблон Даннинга-Крюгера остается последовательным во всех условиях и является наиболее сильным, когда несколько разнообразных ответов отобраны из одной модели.

Результаты таблицы, показанные выше, указывают на то, насколько сильно эффект Даннинга-Крюгера проявляется в этих условиях, остается присутствующим в каждом случае; и что ДКЭ был наиболее выражен, когда несколько ответов были отобраны из одной модели при высокой температуре.

Чтобы лучше понять, как воспринимаемая производительность расходится с фактической производительностью, исследование сравнило абсолютные и относительные оценки уверенности, рассчитав, насколько каждая модель переоценила свою собственную способность (конкретно, разницу между ее оценкой уверенности и ее фактической точностью), и затем измерив, как это переоценка связана с фактической производительностью модели:

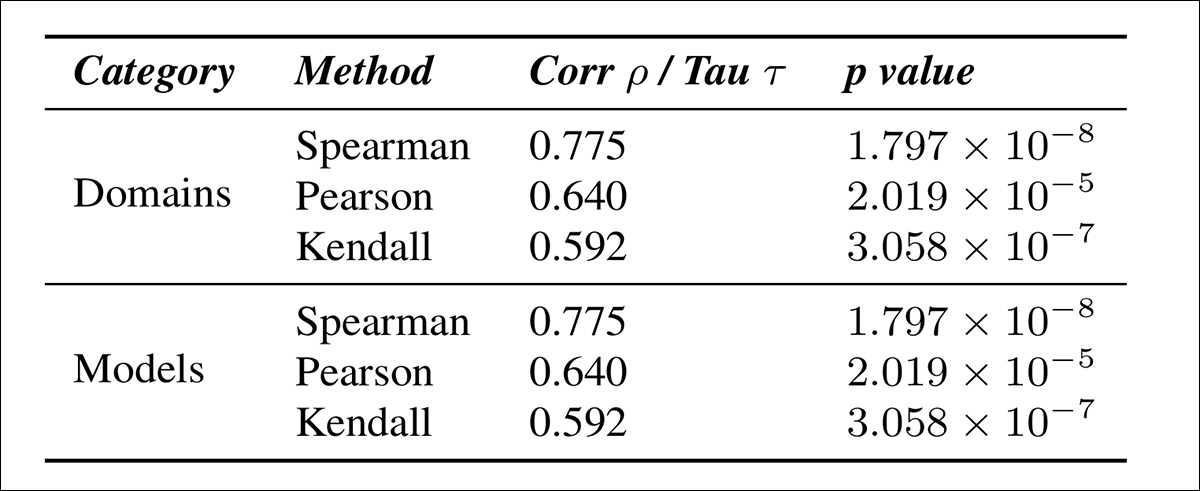

Корреляция между чрезмерной уверенностью (измеренной как абсолютная минус относительная уверенность) и фактической точностью по доменам программирования и типам моделей, показывающая, что большее переоценка последовательно связана с более низкой производительностью.

Результаты таблицы, показанные выше, иллюстрируют, как переоценка связана с фактической производительностью, как по доменам программирования, так и по моделям. В обоих случаях мы можем увидеть, что модели с более низкой точностью склонны показывать большую чрезмерную уверенность.

Более того, специализированные модели, обученные на более узких доменах, показали более сильные эффекты ДКЭ, чем общие:

Корреляция между переоценкой и фактической производительностью для базовых, однодоменных и многодоменных специализированных моделей, показывающая более сильные эффекты ДКЭ по мере увеличения специализации.

Используя набор данных MultiPL-E по восьми языкам программирования, авторы обнаружили, что обучение на одном домене привело к большей чрезмерной уверенности, чем многодоменное или базовое настройки, что предполагает, что ДКЭ ухудшается с увеличением специализации.

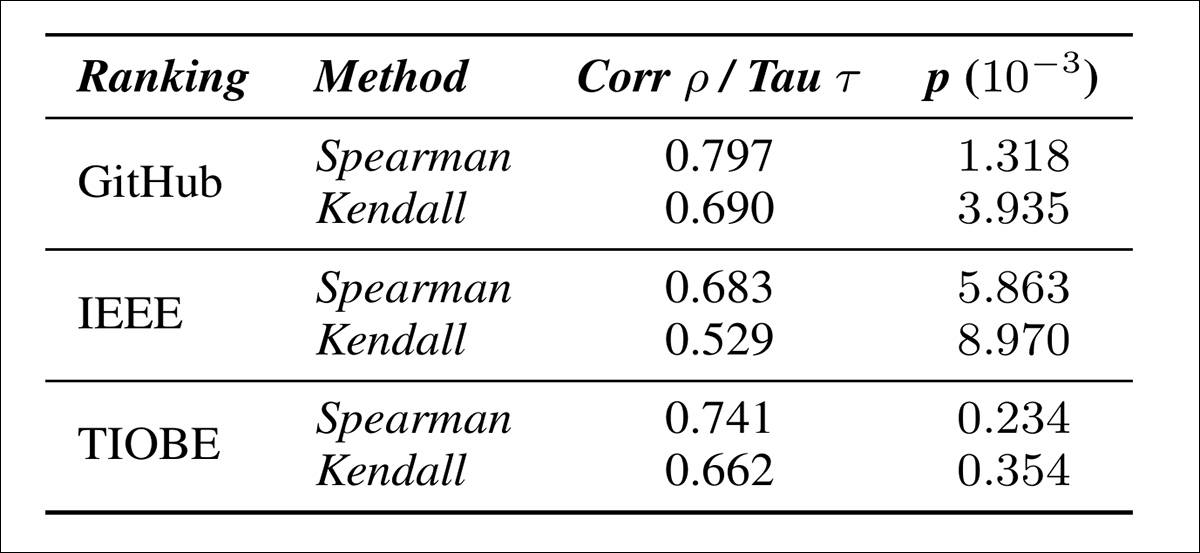

Тесты также показали, что модели склонны быть более чрезмерно уверенными в редких языках программирования. По GitHub, IEEE и TIOBE рейтингам, редкость сильно коррелирует с более высокой воспринимаемой уверенностью, пик которой составляет 0,797:

Корреляция между чрезмерной уверенностью модели и редкостью языка, используя три рейтинга популярности. Менее распространенные языки связаны с более высокой воспринимаемой производительностью.

Наконец, авторы протестировали, появляется ли эффект Даннинга-Крюгера в генерации кода, оценивая модели на наборе данных MultiPL-E по языкам Ada, Dart, Prolog, Swift, C++, Python, C# и Elixir.

Хотя эффект все еще присутствовал, он был заметно слабее, чем в условиях вопросов с несколькими вариантами ответов, вероятно, отражая большую трудность в оценке уверенности и правильности в открытых задачах:

Корреляция между переоценкой и фактической производительностью в открытой генерации кода, основанной на результатах MultiPL-E по восьми языкам.

При рассмотрении все еще дискуссионного объяснения эффекта Даннинга-Крюгера, авторы заключают:

‘Одно потенциальное объяснение, которое может быть общим для людей и моделей ИИ, является метакогнитивным объяснением, которое гласит, что оценка качества выполнения навыка является важной частью приобретения навыка.

‘Это объяснение потенциально может быть проверено экспериментально в моделях ИИ с контролируемым исследованием различных стратегий обучения и проверки того, приводят ли они все к одновременному улучшению производительности и способности оценивать качество производительности. Однако это исследование значительно выходит за рамки этой статьи, и мы оставляем его для будущей работы.’

Заключение

Даже в своей родной области эффект Даннинга-Крюгера (как отмечено в статье) может быть отнесен либо к статистической, либо к когнитивной причине. Если к статистической причине, применение ранее уникально человеческого синдрома к контексту машинного обучения фактически довольно действенно.

Хотя авторы спекулируют, что причина могла бы быть найдена ‘когнитивной’ в обоих случаях, это потребовало бы немного более метафизической точки зрения.

Возможно, наиболее интересное открытие в статье – это степень, в которой несколько кодирующих ЯМ склонны удвоить свои усилия в своих наименее благоприятных обстоятельствах, т.е. демонстрируя максимальную уверенность, когда они имеют дело с самыми скудными или наименее известными языками – что было бы почти сразу же самоуничтожающей стратегией в реальной рабочей среде.

* Языки программирования, использованные в исследовании, были Ada, Bash, C, C#, C++, COBOL, Ceylon, Clojure, D, Dart, Dash, Elixir, Erland, F#, Fortran, Go, Haskell, Java, JavaScript, Julia, Lisp, Kotlin, Lua, OCaml, Objective-C, PHP, Pascal, Perl, Prolog, Python, Racket, Ruby, Rust, Scala, Swift, TypeScript и Visual Basic.

Опубликовано впервые в среду, 8 октября 2025