Угол Андерсона

Кодирование ИИ часто страдает от эффекта Даннинга-Крюгера

Новое исследование показывает, что ИИ-программисты, такие как ChatGPT, страдают от эффекта Даннинга-Крюгера, часто действуя наиболее уверенно, когда они наименее компетентны. При работе с незнакомыми или малоизвестными языками программирования они заявляют о высокой уверенности, даже когда их ответы разваливаются. Исследование связывает чрезмерную уверенность моделей как с низкой производительностью, так и с недостатком обучающих данных, что вызывает новые опасения относительно того, насколько хорошо эти системы на самом деле знают, о чём они говорят. не знаю.

Любой, кто провел хотя бы умеренное количество времени, взаимодействуя с большими языковыми моделями по фактическим вопросам, уже знает, что LLM часто склонны давать уверенно неправ ответ на запрос пользователя.

Наряду с более открытыми формами галлюцинацияПричина этого пустого хвастовства не ясна на 100%. Исследования, опубликованные летом, показывают, что модели дают уверенные ответы. даже когда они знают, что они неправы, например; хотя другие теории приписывают чрезмерную уверенность архитектурный выбор, среди прочих возможностей.

В чем конечный пользователь может быть уверен, так это в том, что этот опыт невероятно разочаровывает, поскольку мы жестко запрограммированы на то, чтобы доверять народный оценки своих собственных возможностей (не в последнюю очередь потому, что в таких случаях существуют последствия, как юридические, так и иные, для человека, который обещает слишком много и не выполняет обещанного); и своего рода антропоморфный перенос означает, что мы склонны копировать это поведение с помощью разговорных систем искусственного интеллекта.

Но LLM — это неподотчетная сущность, которая может и будет эффективно возвращать «Упс! Пальчики оближешь…» после того, как он помог пользователю непреднамеренно уничтожить что-то важное, или по крайней мере потратить полдня своего времени, предполагая, что это будет признавать ответственность вообще.

Хуже того, от этого недостатка благоразумной осмотрительности, похоже, невозможно избавиться, по крайней мере, в ChatGPT, который изо всех сил убеждает пользователя в обоснованности своих советов и объясняет ошибки в своих рассуждениях только после того, как ущерб уже нанесен. Ни обновление системы, постоянная память, ни использование повторяющихся подсказок, похоже, не оказывают существенного влияния на проблему.

Люди могут быть столь же упрямы и склонны к самообману, хотя любой, кто ошибался так глубоко и часто, скорее всего, был бы уволен досрочно. Такие люди страдают от противоположности «синдрому самозванца» (когда сотрудник боится, что его повысили выше его способностей) – Эффект Даннинга-Крюгера, где человек значительно переоценивает их способность выполнять задачу.

Цена инфляции

Новое исследование Microsoft рассматривает значение эффекта Даннинга-Крюгера в связи с эффективностью архитектур кодирования с использованием искусственного интеллекта (например, собственной разработки Редмонда). Copilot), в рамках исследовательской работы, которая впервые специально посвящена этому подсектору LLM.

В работе анализируется, насколько уверенно такие ИИ-кодировщики оценивают свои ответы, сравнивая их с тем, насколько хорошо они справились с задачей на десятках языков программирования. Результаты демонстрируют чёткую закономерность, свойственную человеку: когда модели были наименее способны, они были наиболее уверены в себе.

Эффект был наиболее сильным в малоизвестных или малоресурсных языках, где обучающих данных было мало – чем слабее модель или реже язык, тем больше иллюзия мастерства:

Фактическая и воспринимаемая производительность GPT-4o на разных языках программирования, отсортированная по истинной производительности. Источник: https://arxiv.org/pdf/2510.05457

Четверо авторов, все из которых вносят равный вклад в работу Microsoft, утверждают, что их работа поднимает новые вопросы о том, насколько можно доверять этим инструментам при оценке их собственных результатов, и заявляют:

«Анализируя надежность и производительность моделей на различных языках программирования, мы обнаружили, что модели ИИ отражают человеческие модели чрезмерной уверенности, особенно в незнакомых или малоресурсных областях.

«Наши эксперименты показывают, что менее компетентные модели и модели, работающие на редких языках программирования, демонстрируют более выраженное смещение, подобное смещению по принципу DKE, что позволяет предположить, что сила смещения пропорциональна компетентности моделей. Это согласуется с результатами экспериментов с участием людей, демонстрирующих это смещение».

Исследователи рассматривают это направление исследований в контексте, чтобы понять, как уверенность модели становится ненадежной, когда производительность низкая, и проверить, проявляют ли системы ИИ ту же самую чрезмерную уверенность, что и люди, — с соответствующими последствиями для доверия и практического развертывания.

Хотя Новый документ бросает вызов Закон заголовков Беттериджа, тем не менее он называется Страдают ли модели кода от эффекта Даннинга-Крюгера?Хотя авторы заявляют, что код для работы был опубликован, в текущем препринте никаких подробностей об этом не содержится.

Способ доставки

В ходе исследования проверялось, насколько точно ИИ-программисты могли оценивать свои собственные ответы, предлагая им тысячи вопросов по программированию с несколькими вариантами ответов, каждый из которых относился к определенной языковой области, от Python и Java до Perl и COBOL:

Области языков программирования, использованные в исследовании, а также количество вопросов кодирования с несколькими вариантами ответов, отобранных для каждой области.

Моделям было поручено выбрать правильный вариант, а затем оценить, насколько они были уверены в своем выборе, при этом их фактическая эффективность измерялась тем, как часто они давали правильный ответ, а их самооценка уверенности указывала на то, насколько хорошо они справились. считал Так и было. Сравнение этих двух показателей позволило исследователям увидеть, в чём различаются уверенность и компетентность.

Чтобы оценить достоверность моделей, в исследовании использовались два метода: абсолютная уверенность и относительная уверенностьВ первом случае модель должна была выставить оценку от нуля до единицы для каждого ответа, при этом её уверенность в определённом языке определялась средним значением оценок по вопросам на этом языке.

Второй метод рассматривал, насколько уверенно была модель, когда выбор между двумя вопросамиДля каждой пары модель должна была определить, в каком из вариантов она уверена больше. Затем эти варианты оценивались с помощью ранжирующих систем, изначально разработанных для соревновательных игр, рассматривая каждый вопрос как ответ игрока в матче. Итоговые баллы были нормализованы и усреднены для каждого языка, чтобы получить относительную оценку достоверности.

В статье рассматриваются две устоявшиеся формы эффекта Даннинга-Крюгера: одна из них отслеживает, как одна модель неверно оценивает свою эффективность в различных областях; и другая, которая сравнивает уровни уверенности между более слабыми и более сильными моделями.

Первая форма, называемая внутриучастниковый DKE, исследует, становится ли одна модель более самоуверенной в языках, где она плохо работает. Второй, межучастниковый DKE, задается вопрос, имеют ли модели, которые в целом показывают худшие результаты, тенденцию также оценивать себя более высоко.

В обоих случаях разрыв между уверенностью и фактическими результатами используется для измерения чрезмерной уверенности, при этом большие разрывы при низких показателях эффективности указывают на поведение, подобное DKE.

Результаты

Исследование проверяет эффект Даннинга-Крюгера на шести крупных языковых моделях: Мистраль; Фи‑3; DeepSeek‑Distill; Фи‑4; GPT-0.1 и ГПТ-4о.

Каждая модель была протестирована на вопросах по программированию с несколькими вариантами ответов из общедоступных Набор данных CodeNetс использованием 37 языков*, чтобы показать, как уверенность и точность различаются в знакомых и малоизвестных областях кодирования.

Межмодельный анализ демонстрирует четкую закономерность Даннинга-Крюгера:

Сравнение фактической и воспринимаемой производительности шести моделей кода, показывающее, что менее производительные модели, такие как Mistral и Phi‑3, демонстрируют высокую уверенность, несмотря на низкую точность, в то время как более мощные модели, такие как GPT‑4o, демонстрируют более выверенное или даже недостаточно уверенное поведение.

Модели с меньшей точностью, включая Mistral и Phi-3, имели тенденцию переоценивать собственные возможности, в то время как более эффективные системы, такие как GPT-4o, демонстрировали уровни уверенности, которые больше соответствовали их реальной эффективности, особенно если оценивать их по относительной уверенности.

Результаты также показывают, что даже самые эффективные модели иногда могут недооценивать себя (тенденция, которую не отражают показатели абсолютной уверенности).

Результаты также показывают, что внутримодельный анализ подтверждает наличие эффекта Даннинга – Крюгера. На диаграмме результатов, представленной в начале статьи, мы видим, как каждая модель работала на разных языках программирования, отсортированная по фактической производительности.

В языках, где модели показали низкие результаты, особенно в редких или малоресурсных, таких как COBOL, Prolog и Ceylon, их уверенность была заметно выше, чем оправдывали результаты. В распространённых языках, таких как Python и JavaScript, их уверенность ближе к реальной точности, а иногда даже ниже её.

Эта закономерность проявилась как в абсолютных, так и в относительных показателях достоверности, что свидетельствует о том, что модели меньше осознают свои собственные ограничения при работе в незнакомых областях кодирования.

Рассмотрение моделей в качестве участников накладывает некоторые ограничения, поскольку небольшое количество участвующих моделей влияет на разнообразие; различия в выходных данных одной модели игнорируются; а распределение данных может не отражать распределение реальных участников-людей.

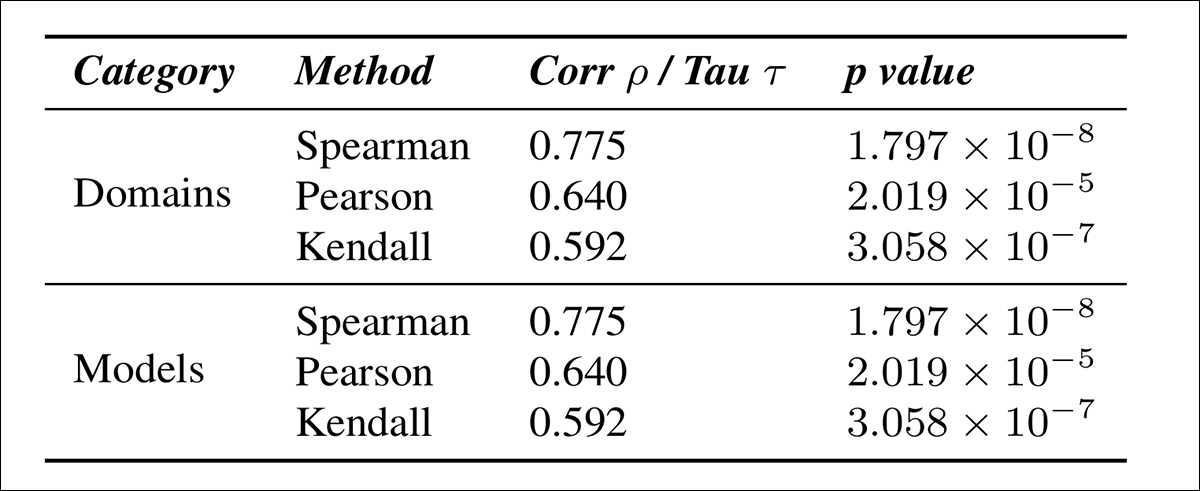

Чтобы учесть это, в исследовании были протестированы три альтернативные установки: во-первых, каждой модели была присвоена отдельная персона; во-вторых, ответы были отобраны на более высоком уровне температура для создания большего разнообразия; в-третьих, подсказки были перефразированы несколько раз, причем каждая версия рассматривалась как отдельный участник:

Корреляция между чрезмерной уверенностью и фактическими результатами в различных экспериментальных установках, показывающая, что закономерность Даннинга-Крюгера остается неизменной при любых условиях и наиболее сильна, когда из одной и той же модели берутся множественные разнообразные ответы.

Представленная выше таблица результатов показывает, насколько сильно эффект Даннинга-Крюгера проявляется в этих условиях, оставаясь присутствующим в каждом случае; и что DKE был наиболее выражен, когда из одной и той же модели были получены множественные отклики при высокой температуре.

Чтобы лучше понять, насколько воспринимаемая эффективность отличается от фактической, в исследовании сравнивались абсолютные и относительные оценки уверенности, путем подсчета того, насколько каждая модель переоценивает свои собственные возможности (в частности, разницу между ее оценкой уверенности и ее фактической точностью), а затем путем измерения того, как эта переоценка соотносится с истинной эффективностью модели:

Корреляция между чрезмерной уверенностью (измеряемой как абсолютная минус относительная уверенность) и фактической точностью в различных областях программирования и типах моделей, показывающая, что большая переоценка неизменно связана с более низкой производительностью.

Таблица результатов выше иллюстрирует, как переоценка соотносится с фактической эффективностью как в разных областях программирования, так и в разных моделях. В обоих случаях мы видим, что модели с более низкой точностью, как правило, демонстрируют большую переоценку.

Кроме того, специализированные модели, обученные на более узких доменах, показали более сильные эффекты DKE, чем универсальные:

Корреляция между переоценкой и истинной производительностью для базовых, однодоменных и многодоменных специализированных моделей, показывающая более сильные эффекты DKE по мере увеличения специализации.

Посмотрите на график Набор данных MultiPL-E Авторы обнаружили, что на восьми языках программирования обучение в одной области привело к большей самоуверенности, чем многодоменные или базовые настройки, что предполагает, что DKE ухудшается с увеличением специализации.

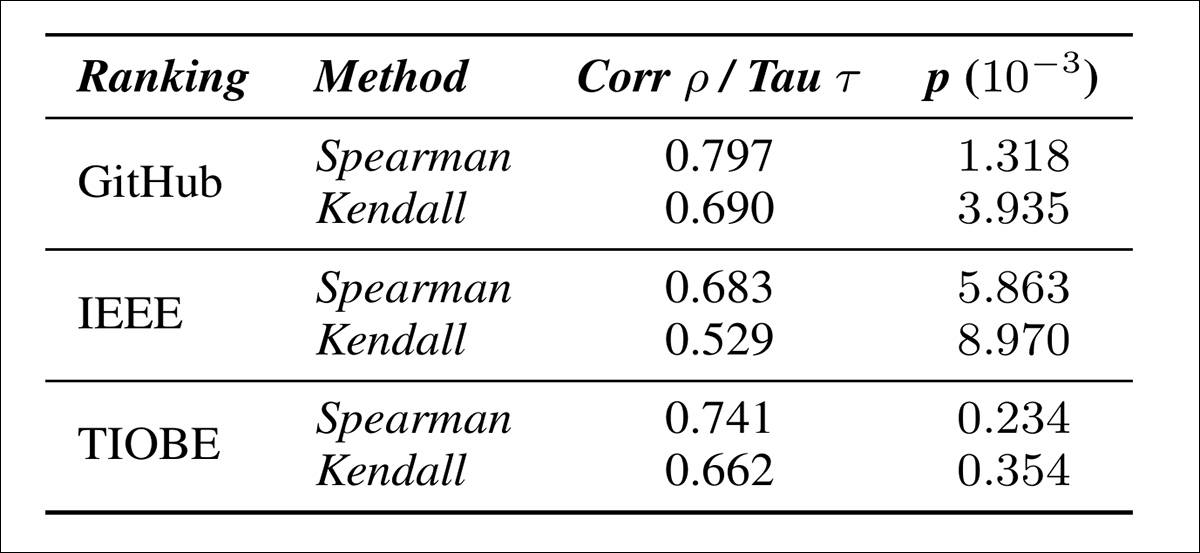

Тесты также показали, что модели, как правило, более самоуверенны в редких языках программирования. GitHub, IEEE и ТИОБЕ рейтингах редкость сильно коррелирует с более высокой воспринимаемой уверенностью, достигая пика в 0.797:

Корреляция между самоуверенностью модели и редкостью языка с использованием трёх рейтингов популярности. Менее распространённые языки связаны с более высокой воспринимаемой эффективностью.

Наконец, авторы проверили, проявляется ли эффект Даннинга-Крюгера при генерации кода, оценив модели на наборе данных MultiPL-E для языков Ada, Dart, Prolog, Swift, C++, Python, C# и Elixir.

Хотя эффект все еще присутствовал, он был заметно слабее, чем в условиях вопросов с несколькими вариантами ответов, что, вероятно, отражает большую сложность в оценке уверенности и правильности в открытых заданиях:

Корреляция между переоценкой и фактической производительностью при генерации открытого кода на основе результатов MultiPL‑E для восьми языков программирования.

Рассматривая все еще спорное объяснение эффекта Даннинга-Крюгера, авторы приходят к следующему выводу:

«Одним из возможных объяснений, которое может быть общим как для людей, так и для моделей ИИ, является метакогнитивное объяснение, которое гласит, что оценка качества выполнения навыка является важнейшей частью приобретения навыка.

Это объяснение потенциально может быть проверено экспериментально на моделях искусственного интеллекта с помощью контролируемого исследования различных стратегий обучения и того, приводят ли они все к одновременному улучшению результатов и способности оценивать качество результатов. Однако это исследование значительно выходит за рамки данной статьи, и мы оставляем его для будущих исследований.

Заключение

Даже в своей естественной области эффект Даннинга-Крюгера (как отмечается в статье) может быть обусловлен как статистическими, так и когнитивными причинами. Если это статистические причины, то применение синдрома, ранее присущего исключительно человеку, к контексту машинного обучения на самом деле вполне обосновано.

Хотя авторы предполагают, что в обоих случаях причина может быть «когнитивной», это потребует несколько более метафизической точки зрения.

Возможно, самым интересным выводом в статье является то, в какой степени многие обладатели степени магистра права в области программирования склонны удваивать усилия в наименее благоприятных для них обстоятельствах, т. е. проявлять максимальную уверенность при работе с самыми редкими или наименее известными языками, что было бы почти сразу же обречено на провал в реальной рабочей среде.

* Использовались следующие языки программирования: Ada, Bash, C, C#, C++, COBOL, Ceylon, Clojure, D, Dart, Dash, Elixir, Erland, F#, Fortran, Go, Haskell, Java, JavaScript, Julia, Lisp, Kotlin, Lua, OCaml, Objective-C, PHP, Pascal, Perl, Prolog, Python, Racket, Ruby, Rust, Scala, Swift, TypeScript и Visual Basic.

Впервые опубликовано Среда, 8 октября 2025 г.