Взгляд Anderson

Принесение визуальных аналогий в ИИ

Текущие модели ИИ не могут распознавать ‘реляционные’ сходства изображений, такие как сходство слоев Земли и персика, не учитывая ключевой аспект того, как люди воспринимают изображения.

Хотя существует много моделей компьютерного зрения, которые могут сравнивать изображения и находить между ними сходства, текущее поколение сравнительных систем имеет мало или совсем нет воображаемой способности. Рассмотрим некоторые строки классической песни 1960-х годов Windmills of Your Mind:

Как карусель, которая вертится, бегущая по кругу вокруг луны

Как часы, чьи руки мчатся мимо минут на своем лице

И мир похож на яблоко, вращающееся молча в пространстве

Такие сравнения представляют собой область поэтических аллюзий, которые имеют значение для людей далеко за пределами художественного выражения; скорее, это связано с тем, как мы развиваем наши перцептивные системы; когда мы создаем наш ‘объектный’ домен, мы развиваем способность к визуальному сходству, так что, например, поперечные сечения, изображающие персик и планету Земля, или фрактальные рекурсии, такие как завитки кофе и ветви галактик, регистрируются как аналогичные с нами.

Таким образом, мы можем вывести связи между, казалось бы, не связанными объектами и типами объектов и вывести системы (такие как гравитация, импульс и поверхностная когезия), которые могут применяться к различным доменам на различных масштабах.

Видение вещей

Даже последнее поколение систем сравнения изображений ИИ, таких как Learned Perceptual Image Patch Similarity (LPIPS) и DINO, которые информируются обратной связью человека, выполняют только буквальные поверхностные сравнения.

Их способность находить лица, где их нет – т.е. парейдолия – не представляет собой тот вид визуального сходства, который люди развивают, а скорее происходит потому, что алгоритмы поиска лиц используют низкоуровневые структуры лица фичи, которые иногда совпадают с случайными объектами:

Примеры ложных положительных результатов для распознавания лиц в наборе данных ‘Faces with Things’. Источник

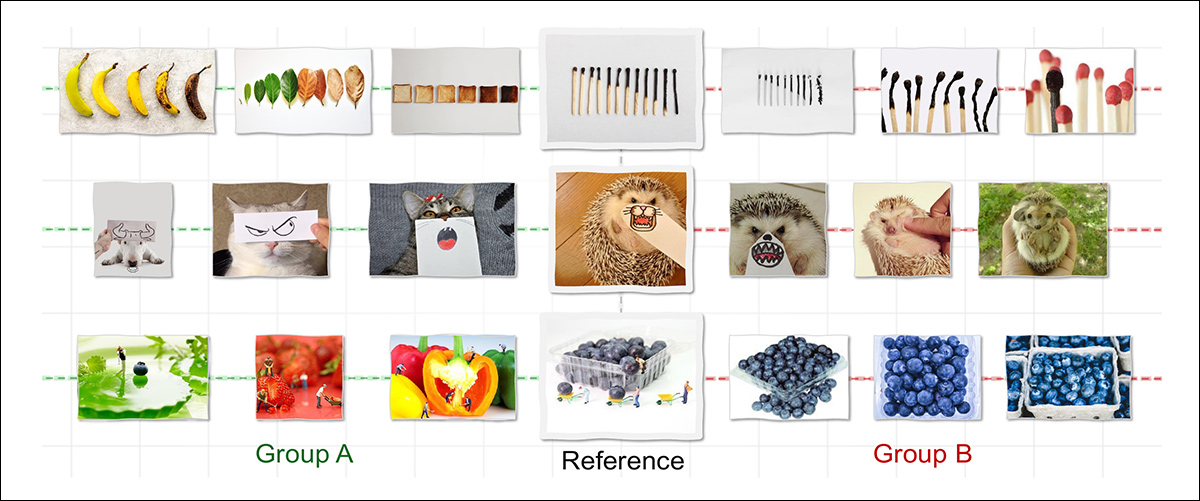

Чтобы определить, могут ли машины действительно развить нашу воображаемую способность распознавать визуальное сходство через домены, исследователи в США провели исследование вокруг Реляционного визуального сходства, курируя и обучая новый набор данных, предназначенный для того, чтобы заставить абстрактные отношения образовываться между различными объектами, которые тем не менее связаны абстрактным отношением:

Большинство моделей ИИ распознают сходство только тогда, когда изображения имеют поверхностные черты, такие как форма или цвет, поэтому они связывают только группу B (выше) с эталонным. Люди, с другой стороны, также видят группу A как подобную – не потому, что изображения похожи, а потому, что они следуют одной и той же лежащей в основе логике, такой как показ преобразования во времени. Новая работа пытается воспроизвести этот вид структурного или реляционного сходства, стремясь приблизить восприятие машины к человеческому рассуждению. Источник: https://arxiv.org/pdf/2512.07833

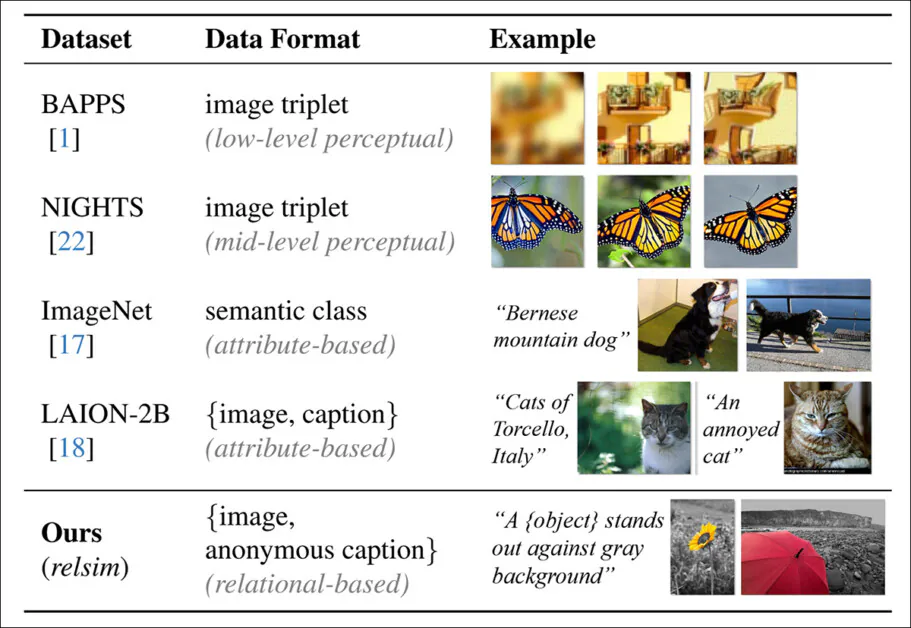

Система подписывания, разработанная для набора данных, позволяет сделать необычно абстрактные аннотации, предназначенные для того, чтобы заставить системы ИИ сосредоточиться на базовых характеристиках, а не на конкретных местных деталях:

Предсказанные ‘анонимные’ подписи, которые способствуют метрике ‘relsim’ авторов.

Кураторский сбор и необычный стиль подписывания топлива метрики авторов нового предложенного relsim, который авторы настроили в модель видения-языка (VLM).

Сравнение стиля подписывания типичных наборов данных, который фокусируется на сходстве атрибутов, тогда как подход relsim (нижний ряд) подчеркивает реляционное сходство.

Новый подход опирается на методологии из когнитивной науки, в частности на теорию Structure-Mapping Дедре Гентнер (изучение аналогии) и определение реляционного сходства и сходства атрибутов Амоса Тверски.

С веб-сайта связанного проекта, пример реляционного сходства. Источник

Авторы заявляют:

‘[Люди] обрабатывают сходство атрибутов перцептивно, но реляционное сходство требует концептуальной абстракции, часто поддерживаемой языком или предварительными знаниями. Это предполагает, что распознавание реляционного сходства сначала требует понимания изображения, использования знаний и абстракции его лежащей в основе структуры.’

Новая работа озаглавлена Реляционное визуальное сходство, и она сопровождается веб-сайтом проекта (см. видео, встроенное в конце этой статьи).

Метод

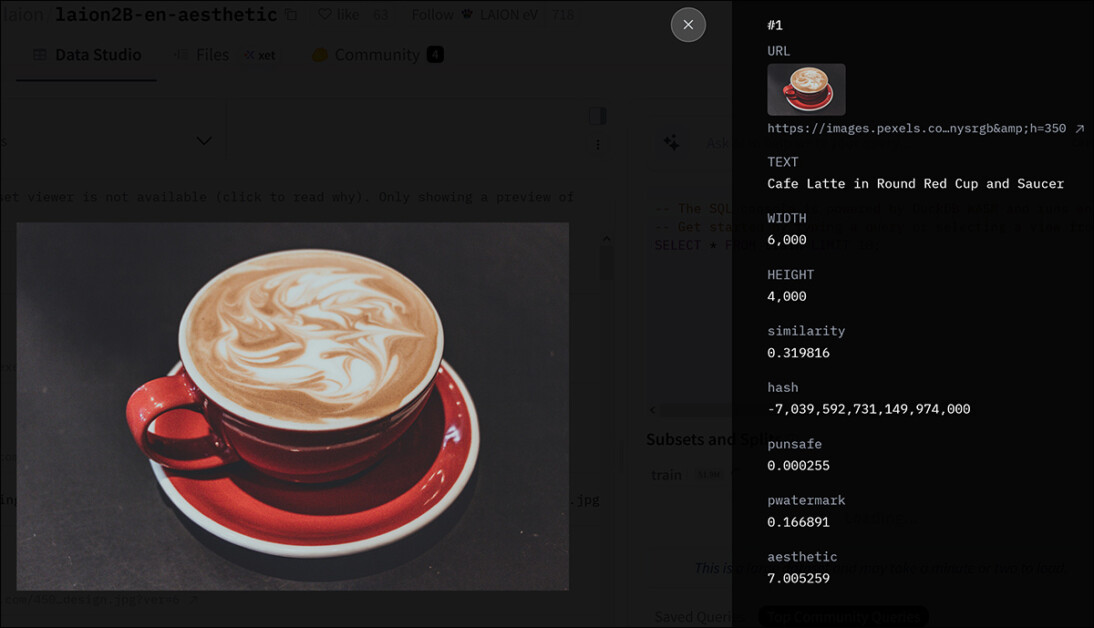

Исследователи использовали один из наиболее известных гипермасштабных наборов данных в качестве отправной точки для своей коллекции – LAION-2B:

Метаданные для записи в коллекции LAION-2B. Источник

114 000 изображений, которые, вероятно, содержат эластичные реляционные структуры, были извлечены из LAION-2B, включая фильтрацию многих изображений низкого качества, присутствующих в минимально отобранном наборе данных.

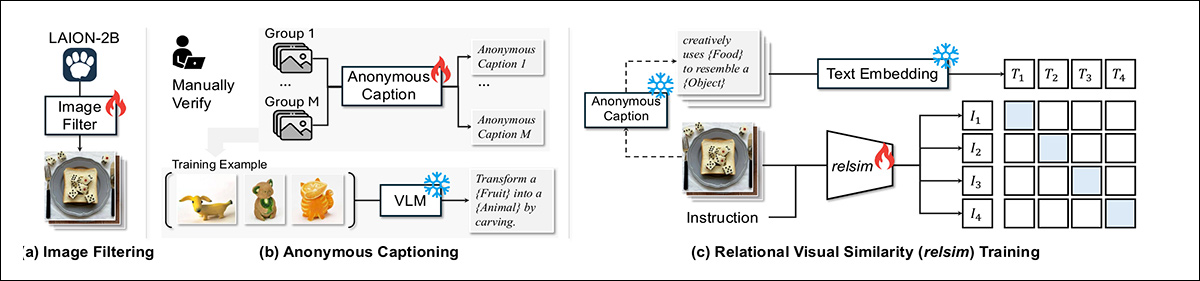

Чтобы создать конвейер для этого процесса отбора, авторы использовали Qwen2.5-VL-7B, используя 1300 положительных и 11 000 отрицательных примеров, помеченных человеком:

Система relsim обучается в три этапа: фильтрация изображений из LAION-2B для реляционного содержания; назначение каждой группы общей анонимной подписи, которая захватывает лежащую в основе логику; и обучение для сопоставления изображений с этими подписями с помощью контрастной потери.

В работе говорится:

‘Аннотаторам было указано: “Можете ли вы увидеть любую реляционную закономерность, логику или структуру в этом изображении, которая могла бы быть полезна для создания или связи с другим изображением?”. Настроенная модель достигает 93% согласия с человеческими суждениями, и когда она применяется к LAION-2B, она дает N = 114k изображений, определенных как реляционно интересные.’

Чтобы сгенерировать реляционные метки, исследователи попросили модель Qwen описать общую логику, лежащую в основе наборов изображений, не называя конкретных объектов. Эта абстракция была трудна для получения, когда модель видела только одно изображение, но стала работоспособной, когда несколько примеров демонстрировали лежащую в основе закономерность.

Результирующие групповые подписи заменили конкретные термины на заполнители, такие как ‘{Субъект}’ или ‘{Тип движения}’, что сделало их широко применимыми.

После проверки человеком каждая подпись была сопоставлена со всеми изображениями в своей группе. Более 500 таких групп были использованы для обучения модели, которая затем была применена к 114 000 отфильтрованным изображениям, чтобы произвести большой набор абстрактных, реляционно аннотированных образцов.

Данные и тесты

После извлечения реляционных функций с помощью Qwen2.5-VL-7B модель была настроена на данных с помощью LoRA, в течение 15 000 шагов, через восемь A100 GPU*. Для текстовой стороны реляционные подписи были встроены с помощью all-MiniLM-L6-v2 из библиотеки Sentence-Transformers.

Набор данных из 114 000 подписанных изображений был разделен на 100 000 для обучения и 14 000 для оценки. Чтобы протестировать систему, была использована настройка извлечения: данное запросное изображение, модель должна была найти другое изображение из пула в 28 000 элементов, которое выражает одну и ту же реляционную идею. Пул извлечения включал 14 000 оценочных изображений и 14 000 дополнительных образцов из LAION-2B, с 1000 запросами, случайно выбранными из оценочного набора для бенчмаркинга.

Чтобы оценить качество извлечения, GPT-4o был использован для оценки реляционного сходства между каждым запросом и извлеченным изображением по шкале от 0 до 10. Отдельное человеческое исследование также было проведено, чтобы оценить предпочтение пользователя (см. ниже).

Каждый участник был показан анонимизированное запросное изображение с двумя кандидатами, одним извлеченным предложенным методом, другим – базовым. Участникам было предложено указать, какое изображение было более реляционно подобно запросу, или если оба были одинаково близки. Для каждого базового варианта были созданы 300 тройных наборов и оценены не менее чем тремя людьми каждый, в результате чего получилось около 900 ответов.

Подход relsim был сравнен с несколькими установленными методами сравнения изображений, включая упомянутые выше LPIPS и DINO, а также dreamsim и CLIP-I. В дополнение к базовым вариантам, которые直接 вычисляют баллы сходства между парами изображений, такими как LPIPS, DINO, dreamsim и CLIP-I, авторы также протестировали методы, основанные на подписях, в которых Qwen был использован для генерации анонимной или абстрактной подписи для каждого изображения; это затем служило запросом для извлечения.

Два варианта извлечения были оценены, с использованием CLIP-основанного текст-изображение извлечения (CLIP-T) для текст-изображение извлечения и Qwen-T с помощью текст-изображение извлечения. Оба метода, основанные на подписях, использовали исходную предварительно обученную модель Qwen, а не версию, настроенную на реляционной логике. Это позволило авторам выделить эффект группового обучения, поскольку настроенная модель была подвергнута воздействию наборов изображений, а не отдельных примеров.

Существующие метрики и реляционное сходство

Авторы изначально протестировали, могут ли существующие метрики захватить реляционное сходство:

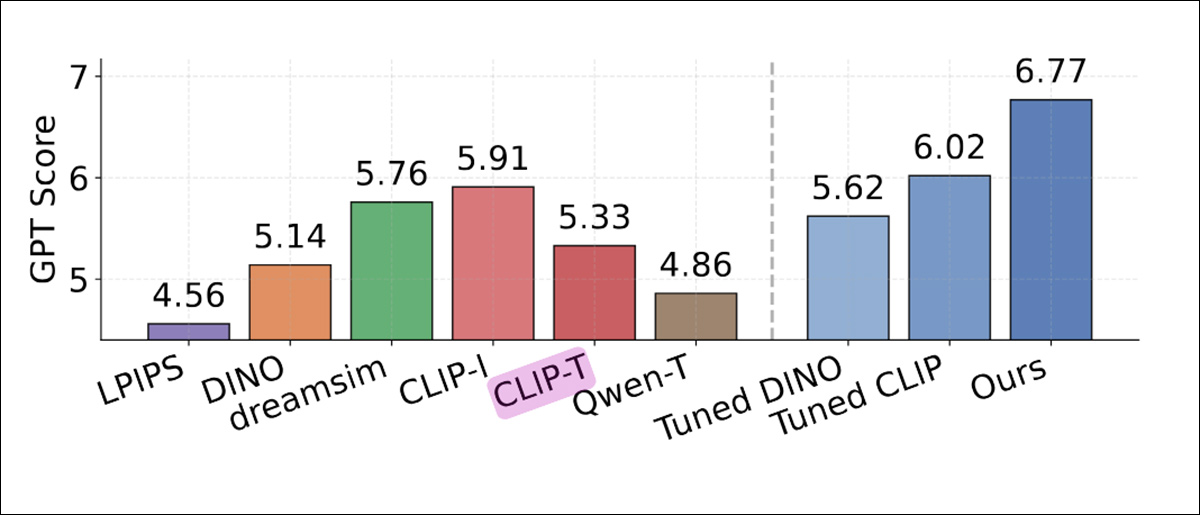

Сравнение производительности извлечения, оцененной GPT-4o, показывающей средний балл реляционного сходства для каждого метода. Традиционные метрики сходства, такие как LPIPS, DINO и CLIP-I, показали более низкие результаты. Методы, основанные на подписях, Qwen-T и CLIP-T, также показали худшие результаты. Наивысший балл был достигнут relsim (6,77, правый синий столбец), что указывает на то, что настройка на групповые реляционные закономерности улучшила соответствие оценкам GPT-4o.

Относительно этих результатов авторы заявляют**:

‘[LPIPS], который фокусируется чисто на перцептивном сходстве, достигает наименьшего балла (4,56). [DINO] работает немного лучше (5,14), вероятно, потому, что он обучается исключительно в саморегулируемом режиме на данных изображений. [CLIP-I] дает наилучшие результаты среди базовых вариантов (5,91), вероятно, потому, что некоторая абстракция иногда присутствует в подписях изображений.

‘Однако CLIP-I все еще показывает худшие результаты, чем наш метод, поскольку достижение лучшего балла может потребовать способности достигать еще более высоких абстракций, таких как те, что в анонимных подписях.’

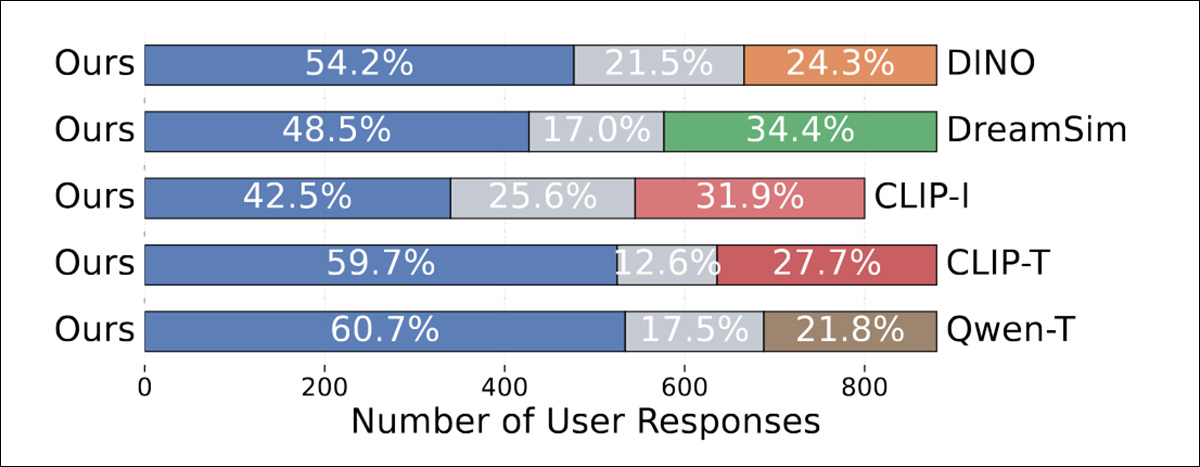

В человеческом исследовании люди последовательно предпочитали метод relsim во всех базовых вариантах:

Баллы реляционного сходства, назначенные GPT-4o для каждого метода. Традиционные метрики сходства, такие как LPIPS, DINO и CLIP-I, показали более низкие результаты, и методы, основанные на подписях, Qwen-T и CLIP-T, показали немного лучшие результаты. Даже настроенные версии DINO и CLIP не закрыли разрыв. Наивысший балл, 6,77, был достигнут предложенной моделью, обученной с групповым надзором.

Авторы отмечают:

‘Это очень обнадеживает, поскольку оно демонстрирует не только то, что наша модель, relsim, может успешно извлекать реляционно подобные изображения, но также, снова, подтверждает, что люди действительно воспринимают реляционное сходство – не только сходство атрибутов!’

Чтобы изучить, как реляционное и атрибутное сходство могут дополнять друг друга, исследователи использовали объединенный метод визуализации. Одно запросное изображение (‘Собака, держащая камеру’) было сравнено с 3000 случайными изображениями, и сходство было рассчитано с помощью как реляционных, так и атрибутных моделей:

<img class=" wp-image-227306" src="https://www.unite.ai/wp-content/uploads/2025/12/figure-7.jpg" alt="Объединенная визуализация пространства визуального сходства с помощью реляционных и атрибутных осей. Одно запросное изображение, изображающее собаку, использующую камеру, было сравнено с 3000 другими. Результаты были организованы по реляционному сходству (вертикально) и сходству атрибутов (горизонтально). Верхний правый регион содержит изображения, которые похожи на запрос как по логике, так и по виду, такие как другие собаки, использующие инструменты. Верхний левый регион содержит семантически связанные, но визуально различные случаи, такие как разные животные, выполняющие действия, связанные с камерой. Большинство остальных примеров кластеризуются ниже в пространстве, отражая более слабое сходство. Расположение иллюстрирует, как реляционные и атрибутные модели подчеркивают дополняющие аспекты визуальных данных. Пожалуйста, обратитесь к исходной работе для лучшего разрешения.

Результаты показали кластеры, соответствующие различным типам сходства: некоторые изображения были и реляционно, и визуально подобны, такие как другие собаки в человеческих позах; другие разделяли реляционную логику, но не вид, такие как разные животные, имитирующие человеческие действия; остальные не показали ни того, ни другого.

Этот анализ предполагает, что два типа сходства играют разные роли и дают более богатую структуру при объединении.

Случаи использования

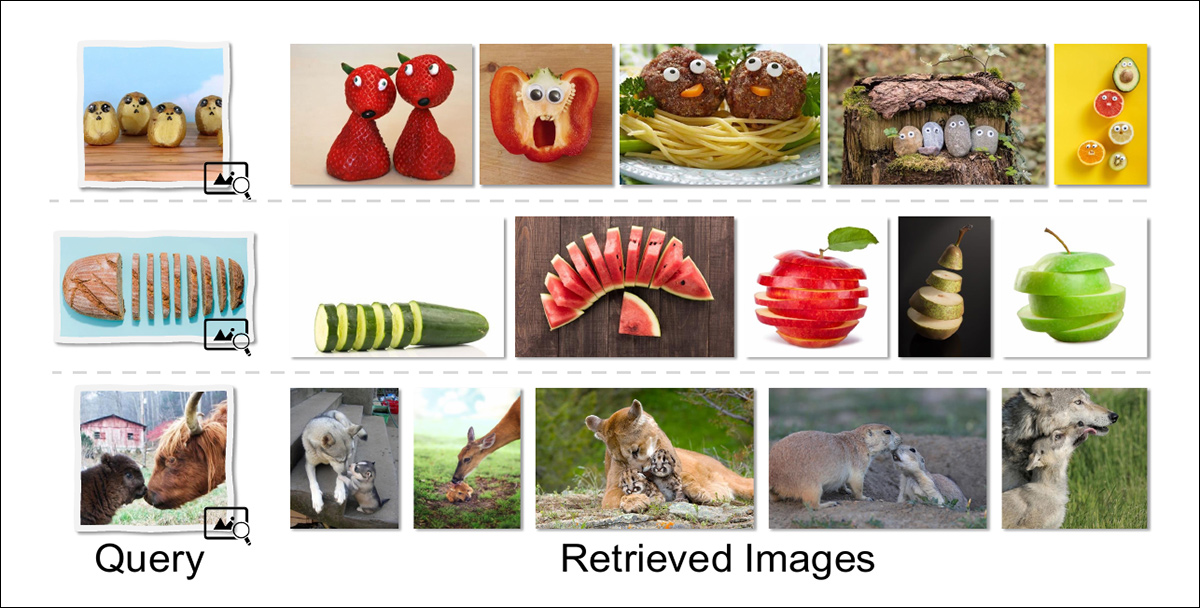

В работе также исследуются некоторые возможные случаи использования реляционного сходства, включая реляционное извлечение изображений, которое позволяет выполнять поиск изображений более соответствующий творческому способу восприятия мира людьми:

Реляционное извлечение возвращает изображения, которые имеют более глубокую концептуальную структуру с запросом, а не совпадают с поверхностными особенностями. Например, еда, стилизованная под лицо, извлекает другие антропоморфные блюда; нарезанное объект возвращает другие нарезанные формы; и сцены взаимодействия взрослых и потомства возвращают изображения с подобными реляционными ролями, даже когда виды и композиция различаются.

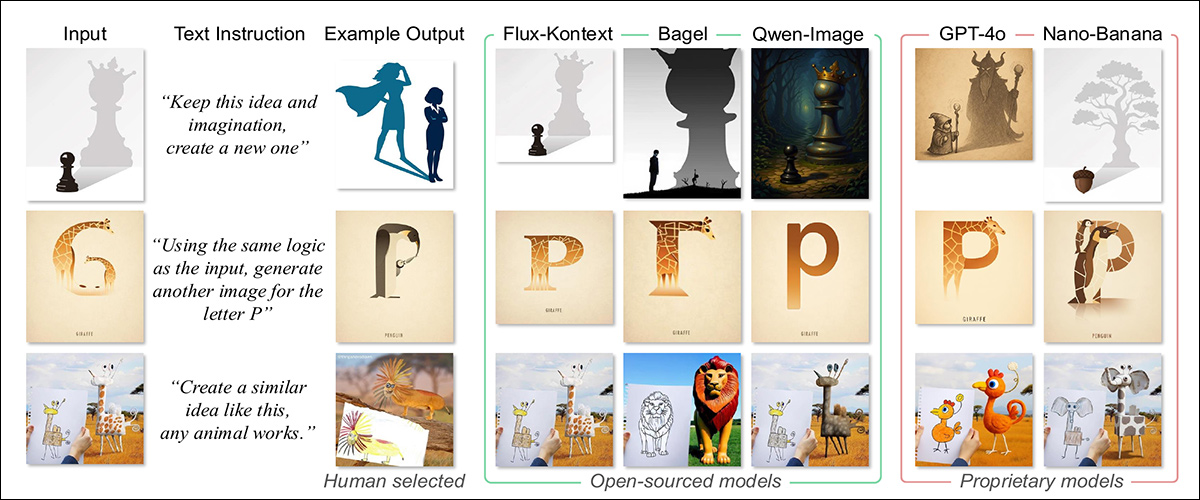

Другой возможностью является аналоговая генерация изображений, которая позволит синтезировать запросы, которые используют реляционные структуры, а не прямые описания. При сравнении результатов, полученных от текущего поколения моделей текст-изображение, мы можем увидеть, что результаты такого подхода, вероятно, будут более разнообразными:

Учитывая входное изображение и реляционное提示, модели были попросены сгенерировать новое изображение, выражающее одну и ту же лежащую в основе концепцию. Проприетарные модели произвели более верные аналогии, сохраняя структурную логику через большие изменения формы, и открытые модели склонялись к регрессии к буквальным или стилистическим совпадениям, не передавая более глубокую идею. Выходные данные были сравнены с человеческими аналогиями, которые демонстрировали предполагаемое преобразование.

Вывод

Генеративные системы ИИ, вероятно, были бы заметно улучшены способностью включать абстрактное представление в свои концептуализации. Как это стоит, запрос концептуальных изображений, таких как ‘гнев’ или ‘счастье’, склонен возвращать изображения, стилизованные из наиболее популярных или многочисленных изображений, которые имели эти ассоциации в наборе данных; что является запоминанием а не абстракцией.

Предположительно, этот принцип может быть еще более полезен, если его можно применить к генеративному письму – особенно аналитическому, спекулятивному или художественному.

Нажмите, чтобы воспроизвести. Источник

* A100 может иметь 40 ГБ или 80 ГБ ОЗУ; это не указано в работе.

** Цитаты авторов избыточны и исключены.

Опубликовано впервые во вторник, 16 декабря 2025 года