Искусственный интеллект

Введение в Vertex AI

Учитывая быстро эволюционирующий ландшафт искусственного интеллекта, одной из самых больших проблем, с которыми часто сталкиваются лидеры технологий, является переход от “экспериментального” к “enterprise-ready”. Хотя потребительские чат-боты и интерактивная платформа помогают с общественным воображением, бизнес не может добиться успеха только с помощью интерфейса чата. В эпоху, когда конкуренция более агрессивна, чем когда-либо прежде, бизнесу нужна прочная, масштабируемая и безопасная экосистема, и именно это предлагает Google с помощью Vertex AI, унифицированной платформы искусственного интеллекта и машинного обучения Google Cloud.

Vertex AI пытается укрепить себя в качестве основы для интеграции генеративного ИИ с современной облачной инфраструктурой, предлагая комплексный набор функций, который мостит разрыв между сырыми фундаментальными моделями и приложениями, готовыми к производству. Vertex AI не является просто оболочкой для крупных языковых моделей (LLM), а представляет собой унифицированную экосистему машинного обучения и искусственного интеллекта (ML/AI), которая рассматривает генеративный ИИ как первого класса гражданина современной облачной инфраструктуры.

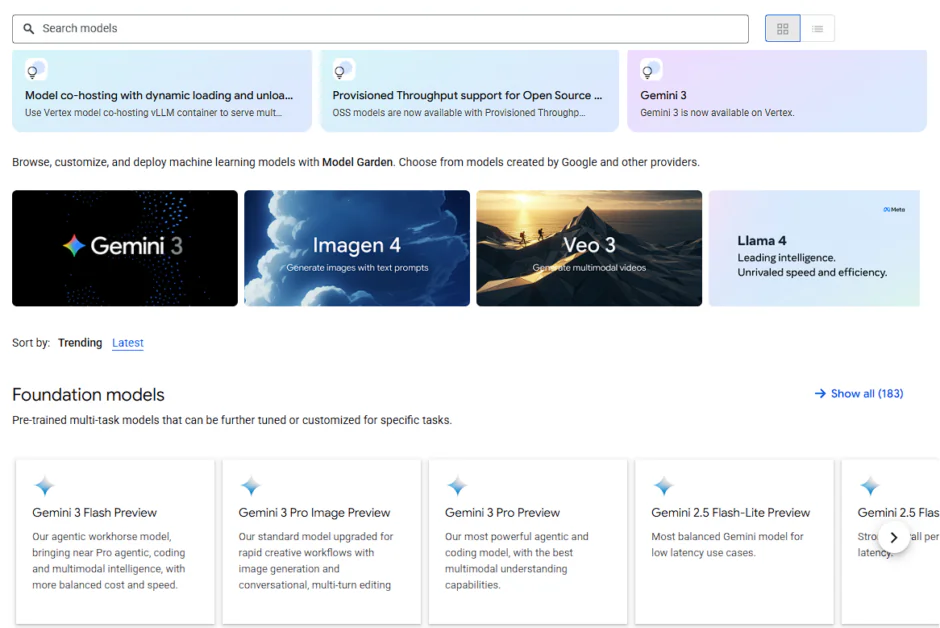

В сердце Vertex AI находится Model Garden, центральный рынок, который предоставляет доступ к более чем 200 отобранным фундаментальным моделям, включая многофункциональный Гемини 2.5 Pro, который имеет ошеломляющее 2-миллионный контекстный окно. В этой статье мы рассмотрим архитектуру Vertex AI, исследуем, как Model Garden служит “App Store” для интеллекта, и рассмотрим технические основы, которые делают эту платформу основой для следующего поколения корпоративного программного обеспечения.

Основная архитектура: унифицированная платформа

Vertex AI не является слабо связанной коллекцией инструментов, а представляет собой унифицированную экосистему данных и ИИ, предназначенную для преодоления фрагментации данных, инструментов и команд, которая мучает машинное обучение до сих пор. Традиционно разработка ИИ происходит в изолированных средах, и иногда данные распределены и заперты в нескольких репозиториях. Например, организации могут хранить данные клиентов в SQL-складах, а неструктурированные документы сбрасываются в Data Lake. Когда данные изолированы, ИИ видит только “частичную правду”, что приводит к предвзятым результатам или высоким показателям галлюцинаций, потому что он лишен полного контекста предприятия.

Vertex AI пытается интегрировать весь жизненный цикл, от сырого данных ингеста в BigQuery и Cloud Storage до производственного мониторинга, по сути, служа “соединительной тканью” между этими силосами. Vertex AI интегрируется родно с Cloud Storage и BigQuery, позволяя моделям ИИ получать данные без сложных трубопроводов извлечения, преобразования и загрузки.

Основание: гиперкомпьютер Google

Слой GenAI Vertex AI находится поверх архитектуры гиперкомпьютера Google, интегрированной системы суперкомпьютера, которая состоит из:

TPU v5p и v5e (процессоры тензорного преобразования)

Процессоры тензорного преобразования Google являются специально построенными ASIC (приложение-специфическими интегральными схемами), предназначенными специально для матричных умножений, определяющих глубокое обучение.

- TPU v5p (Производительность): Это флагманский ускоритель для крупномасштабной тренировки. Каждый кластер TPU v5p может масштабироваться до 8 960 чипов, взаимосвязанных с помощью最高-бандвидтной межчиповой связи (ICI) на уровне 4 800 Гбит/с. Для технического руководителя это означает 2,8-кратное ускорение тренировки для модели размера GPT-3 (175 миллиардов параметров) по сравнению с предыдущим поколением, что существенно сокращает время выхода на рынок.

- TPU v5e (Эффективность): Предназначен для “оптимизированной по стоимости” производительности, v5e является рабочей лошадкой для среднемасштабной тренировки и высокопроизводительной интерференции. Он предлагает до 2,5-кратную лучшую ценовую производительность, что делает его идеальным выбором для бизнеса, который должен работать 24/7 без огромного бюджета.

NVIDIA H100/A100 GPU для гибкости

Хотя ТПУ специализированы, многие команды разработки полагаются на экосистему NVIDIA CUDA. Vertex AI предоставляет первоклассную поддержку последнего оборудования NVIDIA:

- NVIDIA H100 (Hopper): Идеален для тонкой настройки крупнейших открытых моделей (например, Llama 3.1 405B), которые требуют огромной пропускной способности памяти.

- Сеть Jupiter: Чтобы предотвратить “пробку сети”, Google использует свою ткань сети данных центра Jupiter. Это гарантирует, что данные перемещаются между GPU на молниеносной скорости, поддерживая RDMA (удаленный прямой доступ к памяти), чтобы обойти накладные расходы CPU и обеспечить почти локальную производительность на распределенных узлах.

Динамическая оркестрация

Самым критическим техническим сдвигом в Vertex AI является динамическая оркестрация. В наследственной среде, если узел GPU выходит из строя во время тренировочного запуска в течение 3 недель, вся работа может потерпеть неудачу.

- Автоматическая резилиентность: Vertex AI, часто работающий на Google Kubernetes Engine (GKE) под капотом, имеет “самовосстанавливающиеся” узлы. Если обнаружена аппаратная неисправность, платформа автоматически переносит рабочую нагрузку на здоровый узел.

- Динамический планировщик рабочей нагрузки: Этот инструмент позволяет командам запрашивать емкость на основе срочности. Вы можете выбрать Flex Start (дешевле, начинается, когда доступна емкость) или гарантированную емкость для миссионно-kritических выпусков.

- Бессерверная тренировка: Для команд, которые хотят нулевое управление инфраструктурой, бессерверная тренировка Vertex AI позволяет вам отправить свой код и данные; платформа предоставляет кластер, запускает работу и разрушает ее, взимая плату только за использованные вычислительные секунды.

Три точки входа: открытие, экспериментирование и автоматизация

Чтобы удовлетворить различные технические персоны – от ученых-данных до разработчиков-приложений – Vertex AI предоставляет три основных точки входа:

- Model Garden: Рынок для открытия.

- Vertex AI Studio: Песочница для экспериментирования.

- Vertex AI Agent Builder: Фабрика для автоматизации.

Model Garden: Рынок для открытия

Model Garden Google Cloud – это централизованная платформа внутри Google Cloud для открытия, тестирования, настройки и развертывания широкого спектра моделей ИИ первого класса, открытых и третьих сторон, включая многомодальные (видение, текст, код) для различных бизнес-потребностей, предлагая бесшовную интеграцию с инструментами Vertex AI для упрощенной MLOps. Она действует как комплексная библиотека, помогающая разработчикам и бизнесу выбрать правильную модель (от крупных фундаментальных моделей до специализированных) для своих задач, будь то текстовая генерация, анализ изображений или завершение кода, и развертывать их эффективно в своей среде Google Cloud.

Model Garden категоризирует свои более 200 моделей на три различных уровня, позволяя архитекторам сбалансировать производительность, стоимость и контроль:

- Модели первого класса (Google): Это флагманские многомодальные модели, доступные в Vertex AI, и Google предлагает их в различных размерах, от Pro с сложным рассуждением до Flash с низкой задержкой и высокой производительностью, что позволяет разработчикам оптимизировать свои модели в соответствии с их случаями использования.

- Модели третьих сторон (проприетарные): Благодаря стратегическим партнерствам, Vertex AI предлагает доступ “Model-as-a-Service” (MaaS) к титанам, таким как Anthropic (Claude 3.5) и Mistral AI. Вместо того, чтобы управлять отдельными выставлениями счетов и безопасными учетными данными для пяти разных поставщиков ИИ, техническая команда может получить доступ ко всем им через свой существующий проект Google Cloud, используя унифицированный формат API.

- Открытые и открытые модели весов: Этот уровень включает Meta’s Llama 3.2, Mistral и собственную модель Google Gemma. Они идеальны для организаций, которые хотят самостоятельно развертывать модели внутри своей собственной VPC (виртуальной частной сети) для обеспечения максимальной изоляции данных.

В неунифицированной среде развертывание открытой модели, такой как Llama, требует настройки среды PyTorch, конфигурирования драйверов CUDA и управления оберткой Flask или FastAPI.

Model Garden устраняет эту “музонную” фазу с помощью унифицированных управляемых конечных точек:

- Однократное развертывание: Для многих моделей нажатие кнопки “Развертывание” автоматически выделяет необходимые ресурсы TPU/GPU, оборачивает модель в контейнер, готовый к производству, и предоставляет конечную точку REST API.

- Интеграция с Hugging Face: Vertex AI теперь позволяет разработчикам развертывать модели напрямую из Hugging Face Hub в конечную точку Vertex, предоставляя почти бесконечное расширение доступного интеллекта.

- Частная связь служб (PSC): Для высокорегулируемых отраслей модели можно развертывать с помощью Частной связи служб, гарантируя, что конечная точка модели никогда не будет暴ена в общедоступном интернете – сохраняя трафик данных строго внутри корпоративной сети.

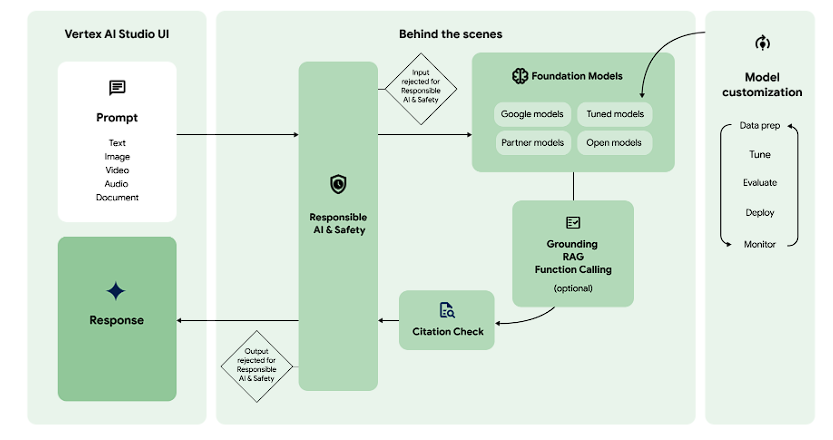

Vertex AI Studio: Песочница для экспериментирования

В то время как Model Garden посвящен выбору, Vertex AI Studio посвящен точности. Vertex AI Studio можно сравнить с компиляторами и отладчиками, которые вы встречаете в традиционном программном обеспечении. Vertex AI Studio – это рабочее пространство, где сырые модели скульптируются в конкретные бизнес-инструменты посредством комбинации инженерии подсказок, многомодального тестирования и расширенной настройки гиперпараметров.

Многомодальное прототипирование: за пределами текста

Одной из выдающихся функций Studio является его родная поддержка многомодальности. Хотя другие платформы требуют сложного кодирования для обработки не-текстовых данных, Vertex AI Studio позволяет вам直接 загружать файлы в интерфейс для тестирования Гемини 2.5 возможностей рассуждения.

- Интеллект видео: Вы можете загрузить 45-минутную техническую лекцию и попросить модель “определить каждый раз, когда упоминается конкретный API, и предоставить резюме с отметкой времени”.

- Анализ документов: Вместо простого чтения текста модель может проанализировать визуальную компоновку 1000-страничного PDF, понимая взаимосвязь между диаграммами, таблицами и окружающим текстом.

- Выполнение кода: Studio теперь поддерживает выполнение кода в песочнице. Если вы попросите модель решить сложную математическую задачу или проанализировать CSV, модель может написать и выполнить код Python в безопасной песочнице, чтобы предоставить проверенный ответ.

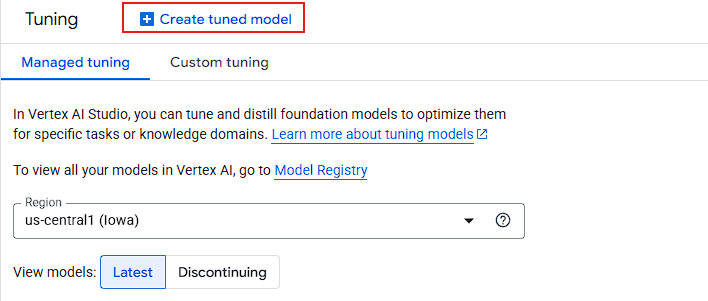

Расширенная настройка: путь настройки

Когда инженерия подсказок (Zero-shot или Few-shot) достигает потолка, Vertex AI Studio предоставляет тяжелую технику: настройку модели.

- Наблюдаемая тонкая настройка (SFT): Разработчики предоставляют набор данных “пар подсказок/ответов” (идеально 100+ примеров). Это учит модель принять конкретный брендовый голос, формат вывода (например, специализированный JSON) или домен-специфическую жаргон.

- Кэширование контекста: Для предприятий, имеющих дело с огромными, статическими наборами данных (например, юридической библиотекой или кодовой базой), Studio позволяет кэшировать контекст. Это позволяет вам “предзагрузить” миллион токенов данных в память модели, что существенно снижает задержку и затраты для последующих запросов.

- Дистилляция (учитель-ученик): Это высокоуровневый архитектурный ход. Вы можете использовать огромную модель (Гемини 2.5 Pro), чтобы “научить” меньшую, быструю модель (Гемини 2.0 Flash). Результатом является легкая модель, которая работает на уровне “Pro”, но работает с скоростью и стоимостью “Flash”.

Vertex AI Agent Builder: Фабрика для автоматизации

Vertex AI Agent Builder – это высокоуровневый фреймворк оркестрации, который позволяет разработчикам создавать эти агенты, объединяя фундаментальные модели с корпоративными данными и внешними API.

Архитектура “правды”: основание и RAG

Основным техническим барьером для корпоративного ИИ является галлюцинация. Agent Builder решает эту проблему с помощью сложного двигателя основания.

- Основание с помощью поиска Google: Для запросов, требующих реального знания мира (например, “Каковы текущие процентные ставки по ипотеке в Нью-Йорке?”), агент может выполнить поиск Google, извлечь факты и сослаться на свои источники.

- Поиск Vertex AI (RAG-as-a-Service): Вместо того, чтобы вручную строить векторную базу данных (Pinecone, Weaviate), разработчики могут использовать Поиск Vertex AI, чтобы индексировать свои собственные документы (PDF, HTML, BigQuery). Он автоматически обрабатывает шаги “чанкинга”, “встраивания” и “восстановления”, гарантируя, что агент отвечает только на основе вашего внутреннего “Источника правды”.

- Двигатель RAG Vertex AI: Для высокомасштабных, индивидуальных реализаций этот управляемый сервис позволяет выполнять гибридный поиск (объединяя векторные и ключевые результаты), чтобы улучшить точность до 30% по сравнению со стандартными выходами LLM.

Многокомпонентная оркестрация (протокол A2A)

Расширенные корпоративные рабочие процессы часто требуют нескольких специализированных агентов, работающих вместе. Vertex AI вводит протокол агент-агент (A2A), открытый стандарт, который позволяет:

- “Туристический агент” говорить с “Финансовым агентом”, чтобы гарантировать, что бронирование рейса находится в пределах корпоративного бюджета.

- Взаимодействие: Поскольку он использует открытый протокол, агенты, построенные на Vertex, могут общаться с теми, которые построены на других фреймворках, таких как LangChain или CrewAI.

Стек разработчика: ADK и двигатель агента

Для “технологической платформы” аудитории Agent Builder предлагает два различных пути:

- Бескодовый консоль: Визуальный интерфейс drag-and-drop для быстрого прототипирования и конфигурирования бизнес-пользователей.

- Набор разработки агента (ADK): Кодовый инструментарий для инженеров. Он позволяет выполнять “подсказку как код”, интеграцию с системой контроля версий и возможность развертывания в двигатель Vertex AI Agent – управляемую среду выполнения, которая автоматически обрабатывает сохранение сеанса, масштабирование и управление состоянием.

Заключение: от “что, если” к “что дальше”

Переход от демонстрации ИИ к приложению, готовому к производству, долгое время был “долиной смерти” для проектов цифровой трансформации. Как мы исследовали, Vertex AI предназначен специально для преодоления этого разрыва. Объединив фрагментированные силосы данных, инфраструктуры и оркестрации моделей, Google Cloud переместил разговор от сырой мощности крупных языковых моделей к операционной зрелости жизненного цикла ИИ.