Искусственный интеллект

Инструмент проверки предвзятости на основе ИИ для новостных статей, доступный на Python

Исследователи в Канаде, Индии, Китае и Австралии сотрудничали для создания бесплатного пакета Python, который можно эффективно использовать для выявления и замены «несправедливого языка» в новостных копиях.

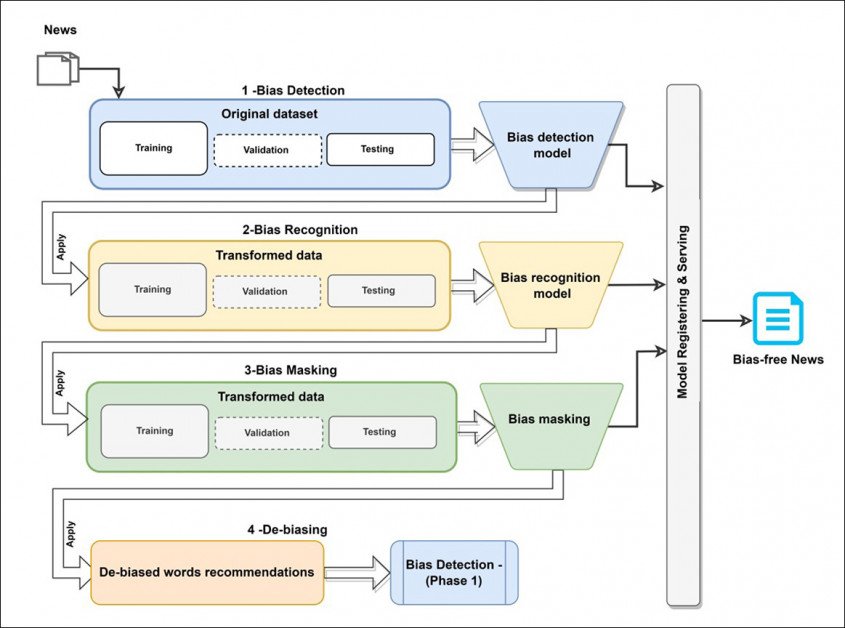

Система, озаглавленная Dbias, использует различные технологии машинного обучения и базы данных для разработки трёхэтапного циклического рабочего процесса, который может усовершенствовать предвзятый текст до тех пор, пока он не вернётся к непредвзятой, или хотя бы более нейтральной версии.

Загруженный язык в новостном фрагменте, идентифицированном как «предвзятый», преобразуется в менее взрывоопасную версию с помощью Dbias. Источник: https://arxiv.org/ftp/arxiv/papers/2207/2207.03938.pdf

Система представляет собой многоразовую и самодостаточную трубу, которую можно установить через Pip из Hugging Face и интегрировать в существующие проекты в качестве дополнительной стадии, дополнения или плагина.

В апреле аналогичная функциональность, реализованная в Google Docs подверглась критике, не в последнюю очередь из-за отсутствия редактируемости. Dbias, с другой стороны, может быть более избирательно обучен на любом корпусе новостей, который желает конечный пользователь, сохраняя возможность разработки индивидуальных руководств по справедливости.

Критическое различие заключается в том, что труба Dbias предназначена для автоматического преобразования «загруженного языка» (слов, которые добавляют критический слой к фактической коммуникации) в нейтральный или прозаический язык, а не для обучения пользователя на постоянной основе. По сути, конечный пользователь определит этические фильтры и обучит систему соответственно; в подходе Google Docs система — по мнению некоторых — обучает пользователя в одностороннем порядке.

Концептуальная архитектура рабочего процесса Dbias.

По словам исследователей, Dbias является первым по-настоящему настраиваемым пакетом обнаружения предвзятости, в отличие от проектов сборки с полки, которые характеризовали этот подсектор обработки естественного языка (NLP) до сих пор.

Новая статья называется Подход к обеспечению справедливости в новостных статьях и исходит от вкладчиков в Университете Торонто, Торонтском метрополитенском университете, Управлении по охране окружающей среды в Бангалоре, Академии глубокого синего в Китае и Университете Сиднея.

Метод

Первый модуль в Dbias — Обнаружение предвзятости, который использует пакет DistilBERT — высоко оптимизированную версию довольно машинно-интенсивной BERT от Google. Для проекта DistilBERT был дообучен на наборе данных Media Bias Annotation (MBIC).

MBIC состоит из новостных статей из различных источников, включая The Huffington Post, USA Today и MSNBC. Исследователи использовали расширенную версию набора данных.

Хотя исходные данные были аннотированы работниками краудсорсинга (метод, который подвергся критике в конце 2021 года), исследователи новой статьи смогли выявить дополнительные неаннотированные случаи предвзятости в наборе данных и добавили их вручную. Выявленные случаи предвзятости были связаны с расой, образованием, этнической принадлежностью, языком, религией и гендером.

Следующий модуль, Распознавание предвзятости, использует Named Entity Recognition (NER) для индивидуализации предвзятых слов из входного текста. В статье говорится:

‘Например, новость “Не покупайте псевдонаучную шумиху о торнадо и изменении климата” была классифицирована как предвзятая предыдущим модулем обнаружения предвзятости, и модуль распознавания предвзятости теперь может выявить термин “псевдонаучная шумиха” как предвзятое слово.’

NER не предназначен специально для этой задачи, но был использован ранее для выявления предвзятости, в частности для проекта 2021 года из Университета Дарема в Великобритании.

Для этой стадии исследователи использовали RoBERTa в сочетании с английской трубой SpaCy NER.

Следующая стадия, Маскирование предвзятости, включает в себя новый многофакторный подход к выявленным предвзятостям, который работает последовательно в случае нескольких выявленных предвзятостей.

Загруженный язык заменяется прагматическим языком на третьей стадии Dbias. Обратите внимание, что ‘мусоление’ и ‘использование’ эквивалентны одному и тому же действию, хотя первое считается уничижительным.

По мере необходимости обратная связь от этой стадии будет отправлена обратно в начало трубы для дальнейшей оценки до тех пор, пока не будет сгенерировано определенное количество подходящих альтернативных фраз или слов. Эта стадия использует Masked Language Modeling (MLM) по линиям, установленным сотрудничеством 2021 года, возглавляемым Facebook Research.

Обычно задача MLM будет маскировать 15% слов случайным образом, но рабочий процесс Dbias вместо этого говорит процессу принимать выявленные предвзятые слова в качестве входных данных.

Архитектура была реализована и обучена на Google Colab Pro на NVIDIA P100 с 24 ГБ видеопамяти при размере пакета 16, используя только два ярлыка (предвзятый и непредвзятый).

Тесты

Исследователи протестировали Dbias против пяти сравнимых подходов: LG-TFIDF с логистической регрессией и TfidfVectorizer (TFIDF) векторами слов; LG-ELMO; MLP-ELMO (сетью прямого распространения с ELMO-вложениями); BERT; и RoBERTa.

Метрики, использованные для тестов, были точностью (ACC), точностью (PREC), полнотой (Rec) и баллом F1. Поскольку исследователи не знали ни одной существующей системы, которая могла бы выполнить все три задачи в одной трубе, было сделано исключение для конкурирующих рамок, оценивая только основные задачи Dbias — обнаружение и распознавание предвзятости.

Результаты испытаний Dbias.

Dbias смог превзойти результаты всех конкурирующих рамок, включая те, которые имеют более тяжелый след обработки

Статья гласит:

‘Результат также показывает, что глубокие нейронные вложения в целом могут превосходить традиционные методы вложения (например, TFIDF) в задаче классификации предвзятости. Это показано лучшей производительностью глубоких нейронных вложений (т. е. ELMO) по сравнению с векторизацией TFIDF при использовании с LG.

‘Это, вероятно, потому, что глубокие нейронные вложения могут лучше захватить контекст слов в тексте в разных контекстах. Глубокие нейронные вложения и глубокие нейронные методы (MLP, BERT, RoBERTa) также работают лучше, чем традиционный метод ML (LG).’

Исследователи также отмечают, что методы на основе трансформеров превосходят конкурирующие методы в обнаружении предвзятости.

Дополнительный тест включал сравнение между Dbias и различными вариантами SpaCy Core Web, включая core-sm (маленький), core-md (средний) и core-lg (большой). Dbias смог возглавить доску и в этих испытаниях:

Исследователи заключают, наблюдая, что задачи распознавания предвзятости обычно показывают лучшую точность в более крупных и дорогих моделях, из-за — по их мнению — увеличенного количества параметров и точек данных. Они также отмечают, что эффективность будущей работы в этой области будет зависеть от более значительных усилий по аннотации высококачественных наборов данных.

Лес и деревья

Надеюсь, что этот тип проекта тонкого распознавания предвзятости в конечном итоге будет включен в рамки, ищущие предвзятость, которые могут принять менее близорукую точку зрения и учитывать, что выбор любого конкретного сюжета является сам по себе актом предвзятости, который потенциально обусловлен более чем только статистикой просмотров.

Опубликовано впервые 14 июля 2022 года.