Взгляд Anderson

AI-модели отдают предпочтение человеческому написанию над написанием, сгенерированным ИИ

Согласно новым исследованиям, ChatGPT и подобные модели теперь демонстрируют явную предвзятость в сторону текста, который, по их мнению, был написан людьми, даже когда это мнение ошибочно. Просто называя текст “сделанным человеком”, ИИ-модели склонны его предпочитать – и, иронично, они могут учиться этому предубеждению у нас.

Понятия аутентичности, происхождения и общего человеческого опыта могут сыграть более значимую роль в наступлении ИИ на творческий сектор письма, чем было очевидно до сих пор: тесты, проведенные для нового исследования в Принстоне, показали, что целый ряд крупных закрытых и открытых языковых моделей, включая ChatGPT, предпочитают то, что они считают “человеческим” текстом.

Даже когда метки на образцах письма были изменены, ИИ-модели и человеческие участники продолжали находить недостатки в тексте, сгенерированном ИИ, повторяя те же критические замечания, которые они сделали, когда он был правильно помечен.

Исследователи считают, что часть причины может заключаться в том, что растущая человеческая враждебность по отношению к генеративному ИИ, которая, кажется, проявляется новыми и интересными событиями каждый день, может влиять на сами ИИ-системы. Отмечая, в какой степени ИИ не любит написание ИИ даже больше, чем люди, они заявляют*:

’13 ИИ-моделей, которые мы протестировали, продемонстрировали предвзятость в 34,3 процентных пункта по сравнению с 13,7 процентными пунктами у людей, что делает их в 2,5 раза более склонными к атрибутивным сигналам, чем наши человеческие оценщики.

‘Эта амплификация имеет смысл, когда мы признаем, что современные модели являются оценщиками, обученными на предпочтениях. Обучение через усиление с помощью обратной связи от человека (RLHF) явно учит модели рассматривать человеческие суждения как эталон, эффективно устанавливая выученную достоверность [приоритет].

‘Модели учатся, что отдача предпочтения человеческим предпочтениям получает награду, создавая сикофанцию, где они повторяют ожидаемые пользовательские отношения, а не предоставляют независимую оценку.’

Результаты применяются к области творческого письма, где исследователи использовали истории известного французского автора в качестве образцов данных; и они указывают на то, что человеческие предубеждения против ИИ могут, в конечном итоге, перевесить любое количественное улучшение в языковой конструкции, которое могут обеспечить Большие Языковые Модели (LLM) по мере их эволюции – и что метка “ИИ” может, возможно, означать “неаутентичный”, “замененный” и даже “второсортный” в этой области.

Многие из причин центрируются на культурной практике и использовании: статья указывает на то, что творчество часто описывается в терминах новизны, ценности и типичности, т.е. насколько новым кажется что-то; насколько оно оценивается экспертами; и насколько хорошо оно подходит к своей категории. Когда отрывок помечен как написанный человеком, знакомые жанровые черты вознаграждаются как ценные; когда помечен как сгенерированный ИИ, те же черты отвергаются как неоригинальные.

По сути, раскрытие источника вызывает переоценку достоинств работы, формируемую предположениями о том, как она была создана. Как только авторство ИИ раскрыто, читатели инстинктивно отвергают возможность индивидуального открытия или намерения за выводом.

Статья гласит*:

‘В большинстве искусств нет эталона для “достаточно творческого”, что делает сигналы происхождения мощными примами, которые могут сдвигать, какой критерий кажется наиболее заметным: дисциплинированное ремесло или заметная новизна, доступность или трудность.

‘Поскольку наблюдатели часто выводят процесс из продукта, происхождение подтолкнуло суждения о том, как что-то было сделано, а также о том, что это такое: консервативные движения могут быть заслугой ремесла человека, но отвергнуты как “простая генерация” модели’.

Тринадцать моделей, включая варианты ChatGPT, Claude, Gemini и Mistral, приняли участие вместе с человеческими читателями, и все оценивали истории более благоприятно, когда им говорили, что они были написаны человеком, с LLM, демонстрирующими большую предвзятость, чем люди.

Идея о том, что ИИ-модели могут усвоить предубеждение против своей собственной продукции, вызывает вопросы о том, откуда возникает эта предвзятость. Поскольку письмо ИИ не всегда легко определить, любые негативные ассоциации, сформированные во время обучения, вероятно, исходят из примеров, которые явно помечены, будь то через освещение в новостях контента ИИ или самопровозглашенные статьи, сгенерированные ИИ, в основных изданиях.

Новая статья называется Все предпочитают человеческих писателей, включая ИИ, и исходит от двух авторов из Центра цифровых гуманитарных наук Принстона. Работа сопровождается связанным выпуском данных на Zenodo (с выпуском GitHub, упомянутым в статье, но репозиторий не активен на момент написания).

Метод

Чтобы изучить, как атрибуция влияет на и формирует восприятие стиля и творчества, авторы использовали Exercices de style, эксцентричную работу 1947 года Раймона Кено, которая переписывает простую анекдоту в 99 разных стилях. История следует за человеком, который садится в автобус, спорит с другим пассажиром, и позже получает советы по моде от друга.

Хотя литературного происхождения, эта структура предвосхищает трансформации на основе подсказок в современных языковых моделях, где пользователи запрашивают переписывание в определенных тонах, голосах или регистрах. Этот процесс когда-то назывался трансстилизацией – рамкой, теперь отраженной в исследованиях ИИ в контексте Style Transfer. Хотя большинство вычислительных методов нацелены на функциональные изменения, такие как сдвиги настроений или детоксикация, переписывания Кено направлены на заметный стилистический контраст.

Из популярного английского перевода работы Кено было выбрано тридцать упражнений, которые сохранили повествование, охватывая широкий стилистический диапазон. Это включало ограниченные формы, такие как александрийские стихи и липограммы, изменения регистра, такие как благородный или оскорбительный, сдвиги повествования, такие как ретроградный и колебание, и игривые искажения, включающие спунеризмы, ономатопею или дог-латинь:

Примеры из исследования, показывающие, как GPT-4 переписал истории Кено в разных литературных стилях, в паре со стилистическими описаниями, которые видели человеческие и ИИ-оценщики во время тестирования. Источник: https://arxiv.org/pdf/2510.08831

Поскольку эксперименты Кено трудно классифицировать, эти категории являются лишь приблизительными группировками, с намерением не проверять распознаваемость или соответствие жанру, а создать разнообразные условия, при которых (человеческие) читатели и модели могут раскрыть свои предубеждения.

Чтобы произвести аналогичные тексты, сгенерированные ИИ, для каждого выбранного стиля, исследователи использовали намеренно минимальные подсказки. Каждая модель получила самую простую версию анекдота Кено (открывающее упражнение, Нотация), вместе с краткой инструкцией переписать его в определенном стиле, таком как Перепишите историю как научно-фантастическую версию. Этот подход позволил подсказкам отражать дух оригинальных трансформаций Кено, сохраняя при этом возможность для модели интерпретировать стиль свободно.

Двойное зрение

Первое исследование, проведенное авторами, использовало GPT-4o для генерации всех тридцати вариантов стиля, поскольку это была наиболее продвинутая модель, доступная на тот момент. Использование единой модели обеспечило последовательные выходные данные, помогая изолировать эффект меток атрибуции, который исследование стремилось протестировать.

Выходные данные не редактировались по стилю или тону, за исключением рамочных отходов, таких как Вот переписанная версия.

Во втором исследовании процесс генерации был повторен на тринадцати крупных языковых моделях: Qwen 2.5 72B Instruct, Mistral Nemo, Mistral Medium 3, Llama 4 Maverick, Llama 3.3 70B Instruct, Gemini 2.5 Flash, GPT-4o Mini, GPT-4o, GPT-3.5 Turbo Instruct, DeepSeek RI (0528), DeepSeek Chat v3 (0324), Cohere Command R (08-2024), Claude Sonnet 4 и Claude 3.5 Haiku.

Каждая модель получила те же инструкции и произвела свои собственные версии тридцати упражнений, в результате чего получилось 420 переписанных историй в общей сложности. Это позволило исследователям проверить, сохраняется ли эффект атрибуции на разных моделях ИИ, а не связан с одной моделью.

Данные и тесты

Исследователи показали те же пары историй разным группам людей, но изменили метки, чтобы увидеть, как сильно имя автора влияет на мнения: одна группа не видела никаких имен авторов, только метки “А” и “Б”. Вторая группа видела правильные имена, с одной версией, помеченной как написанная человеком, и другой, помеченной как написанная GPT-4o.

Третья группа видела имена переключенными, с историей ИИ, помеченной как “человеческая”, и версией, написанной человеком, помеченной как “ИИ”:

Обзор исследования 1. Человеческие и ИИ-оценщики сравнивали 30 пар историй, каждая из которых содержала версию, написанную Кено, и одну, написанную GPT-4. Оценщики были разделены на три группы: одна не видела никаких меток авторов; одна видела правильные метки; и одна видела метки, переключенные – настройка, предназначенная для проверки степени, в которой имена авторов влияют на мнения о стиле письма.

Исследование 1

Исследователи разделили 30 созданных стилей на меньшие наборы, с каждым участником исследования, видящим только пять стилей, и каждым стилем, протестированным под всеми тремя вариантами меток.

Каждый участник видел только одну настройку меток: слепая группа не видела никакого упоминания ИИ, в то время как другие группы видели либо правильные, либо переключенные метки авторов. Назначение группы, порядок истории и левое-правое размещение были все рандомизированы.

ИИ-модели прошли через тот же процесс, получив тот же микс стилей и ту же случайную перестановку. Каждый тест был запущен три раза на модель, чтобы убедиться, что результаты были последовательными, что позволило сравнить человеческие и ИИ-реакции на метки авторов.

Исследование 2 использовало те же три настройки меток, что и раньше, но расширило тест, чтобы включить все 420 историй, сгенерированных из 14 разных моделей LLM. Каждая модель оценила каждую историю под каждым условием метки, производя 1260 решений на модель, и в результате получилось 17 596 действительных оценок:

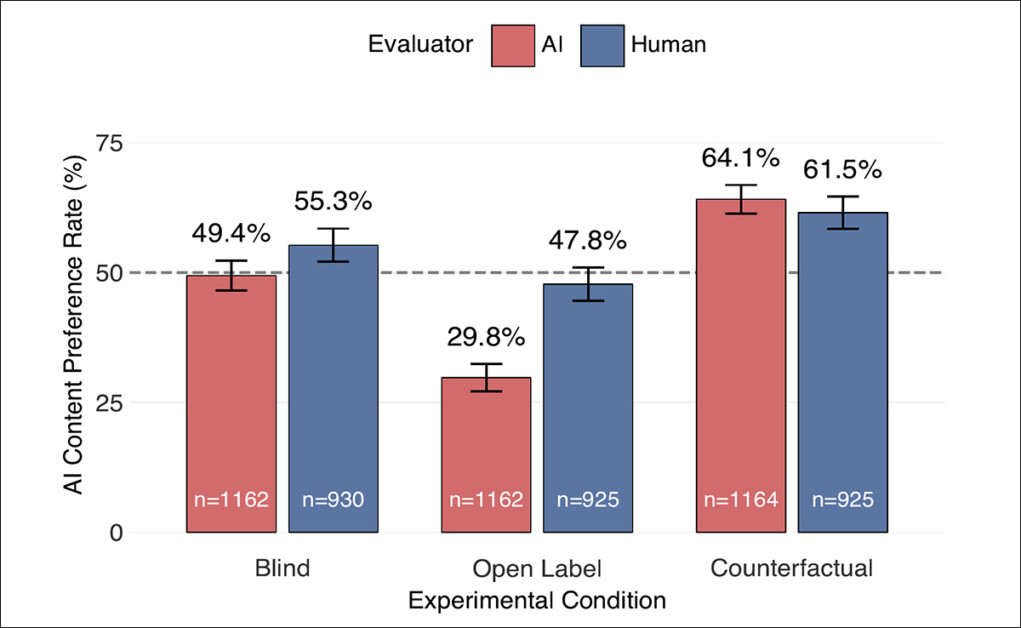

Результаты исследования 1. ИИ- и человеческие оценщики оба показали предвзятость на основе меток авторов. Когда не были показаны метки (Слепая), предпочтения были почти равными; когда были показаны правильные метки (Открытая метка), обе группы предпочитали текст, написанный человеком; и когда метки были переключены (Контрфактическая), обе группы переключились на предпочтение текста, который, по их мнению, был написан человеком – и этот эффект был намного сильнее в ИИ-моделях, чем у людей. Полосы ошибок показывают 95% доверительные интервалы.

На всех тринадцати моделях был обнаружен тот же шаблон предвзятости, что и у людей, но он был намного сильнее: без меток ИИ-системы оценивали человеческие и ИИ-истории примерно одинаково, выбирая текст ИИ 49,4% времени; когда метка ИИ была видна, это предпочтение резко снизилось до 29,8%, показывая явное снижение оценки признанного труда ИИ; и когда тот же текст был помечен как человеческий, предпочтение возросло до 64,1%.

Разница между двумя условиями меток составила 34,3%, что означает, что ИИ-модели изменили свое предпочтение намного больше, чем люди, когда метки были переключены. Кроме того, модели были очень последовательными в повторных запусках, подтверждая, что предвзятость была стабильной, а не случайной.

Чтобы проверить, вызвана ли предвзятость формулировкой меток, а не тем, кто написал текст, исследователи провели два дополнительных теста: один использовал метки, которые сделали ИИ звучать более впечатляюще; и другой использовал нейтральные термины, такие как “авторство ИИ” и “авторство человека”.

Оба все равно показали ту же предвзятость, и даже когда ИИ-модели производили один и тот же ответ каждый раз, предвзятость сохранялась, указывая на то, что предвзятость вызвана типом метки (“человеческий” или “ИИ”), а не точными словами, использованными.

Исследование 2

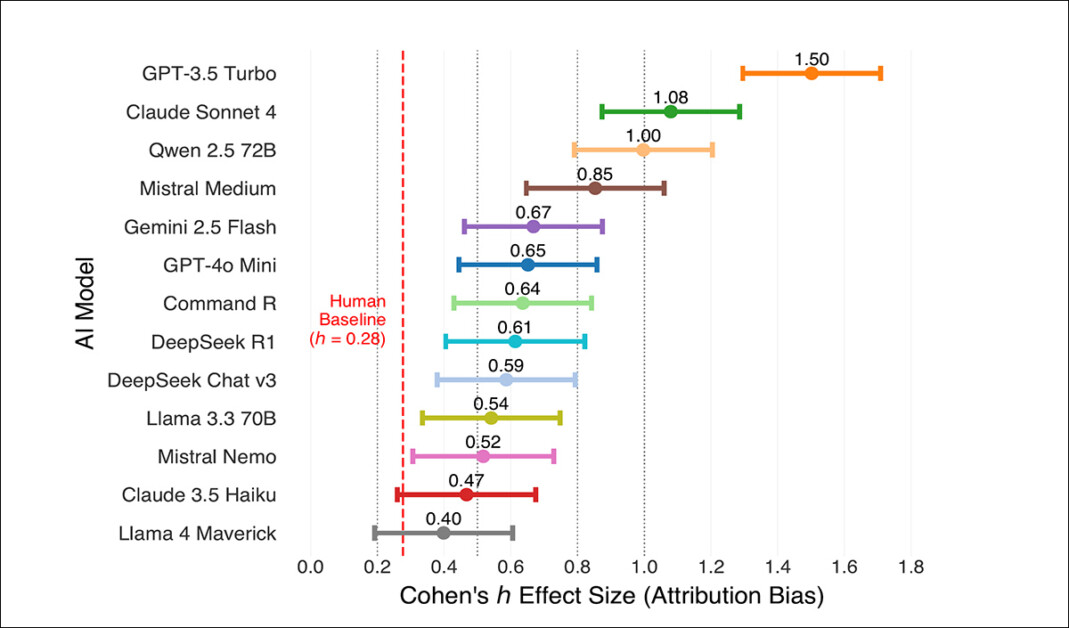

Второе исследование показало ту же про-человеческую предвзятость на всех 13 ИИ-моделях, независимо от архитектуры или поставщика:

Предвзятость атрибуции для каждой из 13 ИИ-моделей: полосы показывают размеры эффектов с 95% доверительными интервалами, и красная линия отмечает базовую линию человека. Все модели показали более сильную предвзятость, чем люди, с только небольшими различиями между ними.

Каждая модель предпочитала истории, помеченные как написанные человеком, с более сильными эффектами, чем у людей. Даже после удаления наиболее крайнего случая средняя предвзятость оставалась более чем в два раза больше, чем человеческая версия, что предполагает, что эффект не является ошибкой в одной модели, а общим свойством LLM в целом.

Вывод

Хотя, как отмечается в статье, предыдущие исследования показали, что ИИ может производить письмо, равное или даже лучше человеческого, авторы подчеркивают, что в литературе ценность, придаваемая авторству и аутентичности, является старой и глубоко укоренившейся конвенцией:

‘Когда GPT-4o Mini отвергает “творческий и юмористический” подход Кено как “преувеличенный” под меткой ИИ, в то время как хвалит идентичные функции под человеческой атрибуцией, он неявно показывает, как эти метки вызывают предположения, что не произошел никакой аутентичный психологический процесс.

‘Сигналы происхождения проникают процесс обратно в то, что могло бы быть суждением только о продукте: “простая генерация” кажется приемлемой от человеческого ремесленника (оцененного как умелое ремесло), но подозрительной от модели (оцененной как алгоритмическая рекомбинация).’

LLM еще не достаточно надежны для несупервизированных исследований, основанных на фактах, хотя тщательный надзор все еще может сделать их продуктивными – но творческое письмо на основе LLM может столкнуться с более неопределенным будущим, если творческие работы, сгенерированные ИИ, станут стигматизированными через более широкое общественное неодобрение вторжения ИИ в человеческие области, а не на основе литературных достоинств.

Последствия результатов таких исследований значительно затронуты расположением компаний и отдельных пользователей быть честными в отношении того, способствовал ли ИИ их выходу. В некоторых случаях нежелание признать такое использование может быть связано больше с корпоративной пиратской деятельностью в области авторского права, чем с беспокойством о том, что общественность примет творческие работы, сгенерированные ИИ.

Однако юридические, финансовые и политические решения возможны (если очень сложны) в отношении авторского права. Но можно ли когда-нибудь заставить людей наслаждаться творческими работами ИИ, которые не имеют единого и понятного человеческого разума, стоящего за ними – это может быть еще более сложной задачей.

* Пожалуйста, обратитесь к исходной статье для вырезанных внутритекстовых цитат. По мере необходимости они будут включены в статью.

Опубликовано впервые в понедельник, 13 октября 2025 года