Угол Андерсона

Модели ИИ предпочитают человеческий текст тексту, сгенерированному ИИ

Согласно новому исследованию, ChatGPT и аналогичные модели теперь демонстрируют явную предвзятость в отношении текста, который, по их мнению, написан человеком, даже если это убеждение ошибочно. Просто называя текст «созданным человеком», модели ИИ склоняются к его предпочтению — и, как ни парадоксально, они, возможно, перенимают это предубеждение от нас.

Понятия подлинности, происхождения и общего человеческого опыта могут играть более важную роль в развитии ИИ. нападение в секторе творческого письма, чем было очевидно до сих пор: тесты, проведенные для нового исследования в Принстоне, показали, что ряд основных языковых моделей с закрытым и открытым исходным кодом, включая ChatGPT, предпочитают то, что они считают «сгенерированными человеком» текстами.

Даже когда надписи на образцах текста были поменяны местами, как модели ИИ, так и участники-люди продолжали находить недостатки в тексте, написанном ИИ, повторяя те же критические замечания, которые они высказывали, когда текст был правильно помечен.

Исследователи полагают, что одной из причин может быть растущая враждебность людей к генеративному ИИ, которая, по-видимому, проявляется новые и интересные события Каждый день, возможно, даёт обратную связь самим системам ИИ. Отмечая, что ИИ не любит писать, даже больше, чем люди, они заявляют*:

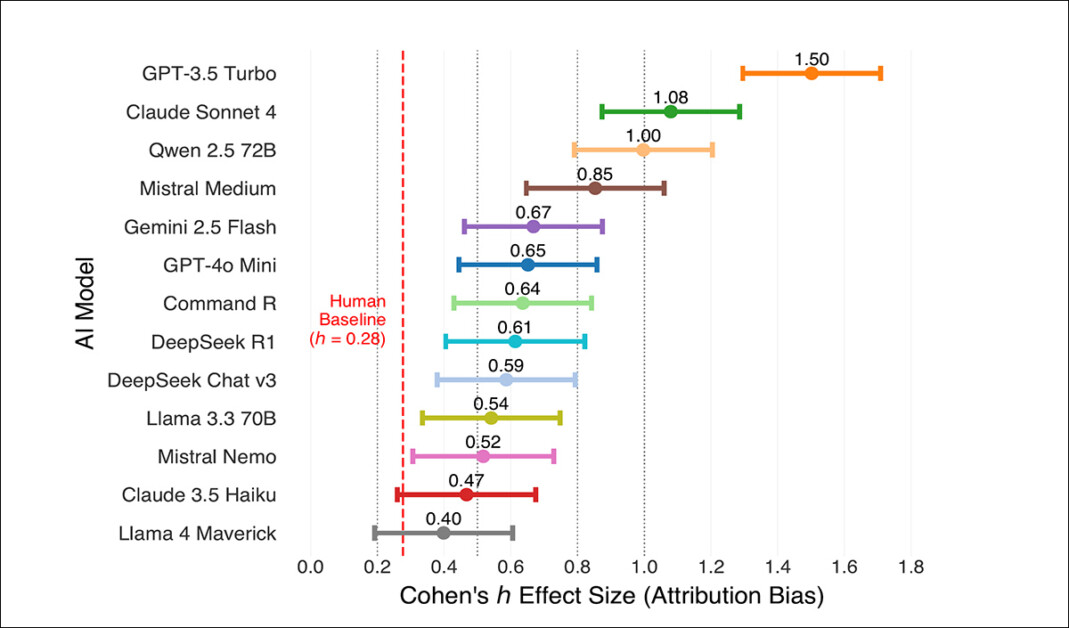

«13 протестированных нами моделей ИИ продемонстрировали смещение в 34.3 процентных пункта по сравнению с 13.7 процентными пунктами у людей, что делает их в 2.5 раза более восприимчивыми к сигналам атрибуции, чем наши оценщики-люди».

Это расширение становится понятным, когда мы признаем, что современные модели — это оценщики, обученные на основе предпочтений. Обучение согласованию с помощью обучения с подкреплением на основе обратной связи с человеком (RLHF) явно учит модели воспринимать человеческие суждения как золотой стандарт, фактически устанавливая приобретенную надёжность [априорную].

«Модели усваивают, что подчинение человеческим предпочтениям вознаграждается, создавая подхалимство, при котором они повторяют ожидаемое отношение пользователя, а не предоставляют независимую оценку».

Результаты применимы к сфере творческого письма, причем исследователи используют в качестве образцов данных рассказы выдающегося французского автора. Они указывают на то, что предубеждения людей против ИИ могут в конечном итоге перевесить любые количественные улучшения в построении языка, которые могут быть достигнуты с помощью больших языковых моделей (LLM) по мере их развития, и что ярлык «ИИ», возможно, начинает означать «неподлинный», «суррогатный» и даже «второсортный» в этой сфере.

Многие из причин связаны с культурной практикой и использованием: в статье указывается, что креативность часто описывается с точки зрения новизны, ценности и типичности, т.е. того, как новый что-то кажется; насколько это оценено экспертами; и насколько хорошо он соответствует своей категории. Когда отрывок помечен как написанный человеком, знакомые жанровые черты вознаграждаются как ценные; когда они помечены как Искусственный интеллект, те же самые черты отвергаются как неоригинальные.

По сути, раскрытие источника побуждает к переоценке достоинств произведения, основанной на предположениях о том, как оно было создано. После раскрытия авторства ИИ читатели инстинктивно отвергают возможность индивидуального открытия или намерения, стоящего за результатом.

В документе указано*:

«В большинстве видов искусства не существует золотого стандарта для «достаточно творческого», поэтому признаки происхождения становятся мощными ориентирами, которые могут изменить то, какой критерий покажется наиболее значимым: дисциплинированное мастерство или заметная новизна, доступность или сложность.

«Поскольку наблюдатели часто делают выводы о процессе по продукту, происхождение подталкивает к суждениям о том, как что-то было сделано, а также что это такое: консервативные шаги могут быть приписаны человеческому мастерству, но отвергнуты как «простое создание» на основе модели».

В исследовании наряду с людьми-читателями приняли участие тринадцать моделей, включая варианты ChatGPT, Claude, Gemini и Mistral. Все они оценили истории более благосклонно, когда им сообщили, что они созданы человеком, при этом LLM проявили большую предвзятость, чем люди.

Идея о том, что модели ИИ могли усвоить предубеждение против своих собственных результатов, поднимает вопрос о происхождении этого предубеждения. Поскольку текст, написанный ИИ, не всегда легко идентифицировать, любые негативные ассоциации, сформированные в процессе обучения, вероятно, связаны с примерами, которые явно маркированы, будь то посредством освещение новостей ИИ-контента, или самопровозглашенный Статьи, созданные с помощью ИИ, в ведущих изданиях.

Команда Новый документ называется Все предпочитают авторов-людей, включая ИИ, и написана двумя авторами из Центра цифровых гуманитарных наук Принстона. Работа сопровождается соответствующим релизом данных на сайте Зенодо (с релизом GitHub, упомянутым в статье, но РЕПО (на момент написания статьи неактивен).

Способ доставки

Чтобы исследовать, как атрибуция влияет на восприятие стиля и креативности и формирует его, авторы использовали Упражнения по стилю, эксцентричное произведение Раймона Кено 1947 года, в котором простой анекдот переосмыслен в 99 разных стилях. История повествует о мужчине, который садится в автобус, спорит с другим пассажиром, а затем получает совет по моде от друга.

Хотя эта структура имеет литературное происхождение, она предвосхищает трансформации, основанные на подсказках, в современных языковых моделях, где пользователи запрашивают переписывание текста в определённых тонах, голосах или регистрах. Этот процесс когда-то дублированный трансстилизация – эта концепция теперь нашла отражение в исследованиях ИИ в контексте Стиль передачиВ то время как большинство вычислительных методов нацелены на функциональные изменения, такие как смена настроений или детоксикация, переписывания Кено направлены на заметный стилистический контраст.

Из популярного английского перевода произведения Кено было отобрано тридцать упражнений, сохраняющих повествование, но при этом охватывающих широкий стилистический диапазон. Они включали в себя такие строгие формы, как александрийцы и липограммы, изменения в регистре, такие как благородный or оскорбительный, повествовательные сдвиги, такие как ретроградным и нерешительностьи игривые искажения, включающие спунеризмы, ономатопею или собачью латынь:

Примеры из исследования, показывающие, как GPT-4 переписал рассказы Кено в разных литературных стилях, в сочетании с описаниями стилей, которые видели люди и ИИ-оценщики во время тестирования. Источник: https://arxiv.org/pdf/2510.08831

Поскольку эксперименты Кено трудно классифицировать, эти категории представляют собой лишь приблизительные группировки, имеющие целью не проверку узнаваемости или соответствия жанру, а скорее создание различных условий, при которых читатели (люди) и модели могли бы выявить свои предубеждения.

Для создания аналогов, созданных с помощью ИИ, для каждого выбранного стиля исследователи намеренно использовали минимальные подсказки. Каждой модели была предоставлена самая простая версия анекдота Кено (начальное упражнение, Отзывы), а также краткая инструкция по переписыванию в определенном стиле, например Перепишите историю в научно-фантастическом ключе.Такой подход позволил создать подсказки, отражающие дух оригинальных преобразований Кено, но при этом предоставляя модели возможность свободно интерпретировать стиль.

Double Vision

В первом исследовании, проведённом авторами, для генерации всех тридцати вариантов стиля использовалась модель GPT-4o, поскольку на тот момент это была самая продвинутая модель. Использование единой модели обеспечивало единообразие результатов, помогая изолировать влияние меток атрибуции, что и было целью исследования.

Выпуски не редактировались по стилю или тону, за исключением хлама, такого как Вот переписанная версия.

Во втором исследовании процесс генерации был повторен для тринадцати крупных языковых моделей: Инструкция по Qwen 2.5 72B, Мистраль Немо, Мистраль Средний 3, Лама 4 Маверик, Лама 3.3 70Б Инструктировать, Близнецы 2.5 Флэш, ГПТ-4о Мини, ГПТ-4о, GPT-3.5 Турбо-инструкт, DeepSeek RI (0528), DeepSeek Chat v3 (0324), Слаженность Команда R (08-2024) Клод Сонет 4 и Клод 3.5 Хайку.

Каждая модель получила одни и те же инструкции и создала собственные версии тридцати упражнений, что в общей сложности дало 420 переписанных историй. Это позволило исследователям проверить, сохраняются ли эффекты атрибуции у разных авторов ИИ, а не привязаны к одной модели.

Данные и тесты

Исследователи показали одни и те же пары рассказов разным группам людей, но изменили подписи, чтобы посмотреть, насколько имя автора влияет на мнения: одна группа не увидела имени автора вообще, только подписи «A» и «B». Вторая группа увидела правильные имена, причём один вариант был отмечен как написанный человеком, а другой — как написанный GPT-4o.

Третья группа увидела имена включается, при этом история «ИИ» отмечена как «человеческая», а «человеческая» версия отмечена как «ИИ»:

Обзор исследования 1. Эксперты-люди и искусственный интеллект сравнили 30 пар рассказов, каждый из которых содержал версию, написанную Кено, и одну, написанную GPT-4. Эксперты были разделены на три группы: одна не видела авторов, другая видела правильные имена, а третья видела, что имена были перепутаны. Эта схема была разработана для проверки того, в какой степени имена авторов влияют на мнение о стиле письма.

Этюд 1

Исследователи разделили 30 созданных стилей на меньшие наборы, при этом каждый участник исследования видел всего пять стилей, и каждый стиль тестировался при всех трех вариантах маркировки.

Каждый участник видел только один вариант маркировки: слепая группа не видела упоминания об ИИ, в то время как другие группы видели либо правильные, либо перевёрнутые обозначения авторов. Распределение по группам, порядок рассказов и расположение слева направо были рандомизированы.

Модели ИИ прошли тот же процесс, получив тот же набор стилей и ту же случайную перетасовку. Каждый тест проводился три раза для каждой модели, чтобы убедиться в согласованности результатов и сравнить реакцию человека и ИИ на метки автора.

В исследовании 2 использовались те же три варианта маркировки, что и ранее, но тест был расширен и включал все 420 историй, сгенерированных с помощью вышеупомянутых 14 различных моделей магистратуры права. Каждая модель оценивала каждую историю при каждом условии маркировки, выдавая 1,260 решений на модель и в результате 17 596 валидных оценок:

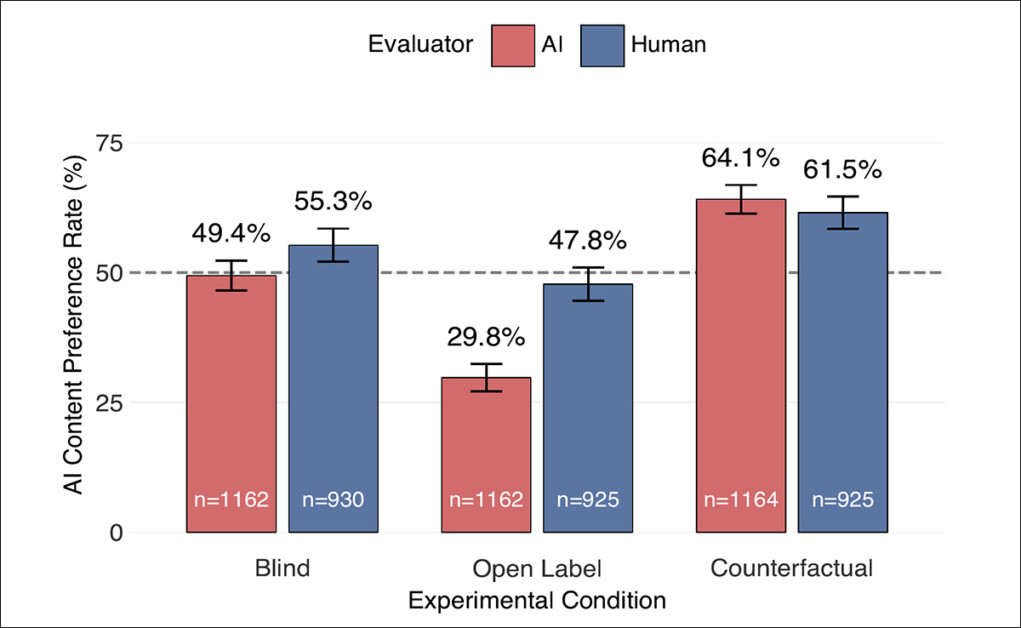

Результаты исследования 1. Как ИИ, так и люди, оценивающие текст, продемонстрировали предвзятость, основанную на метках авторов. При отсутствии меток (слепой метод) предпочтения были практически равными; при демонстрации правильных меток (открытая методология) обе группы отдавали предпочтение тексту, написанному человеком; а при обратной интерпретации (контрфактуальный метод) обе группы переключались на предпочтение текста, который, по их мнению, был написан человеком, и этот эффект был гораздо сильнее в моделях ИИ, чем в моделях людей. Погрешности показывают 95% доверительные интервалы.

Во всех тринадцати моделях закономерность совпадала с человеческими предубеждениями, но была гораздо сильнее: без меток системы ИИ оценивали истории, написанные людьми и ИИ, примерно одинаково, выбирая текст ИИ в 49.4% случаев; когда метка ИИ была видна, это предпочтение резко снижалось до 29.8%, что демонстрировало явную девальвацию признанной работы ИИ; а когда тот же текст был помечен как человеческий, предпочтение возрастало до 64.1%.

Разница между двумя условиями маркировки составила 34.3%, что означает, что модели ИИ изменили свои предпочтения. намного больше чем люди, когда метки менялись местами. Более того, модели демонстрировали высокую степень согласованности при повторных запусках, что подтверждает, что смещение было стабильным, а не случайным.

Чтобы проверить, была ли предвзятость вызвана формулировкой меток, а не тем, кто написал текст, исследователи провели еще два теста: в одном использовались метки, которые заставляли ИИ звучать более внушительно, а в другом использовались нейтральные термины, такие как «автор ИИ» и «автор человека».

В обоих случаях наблюдалась та же предвзятость, и даже когда модели ИИ каждый раз выдавали один и тот же ответ, предвзятость сохранялась, что указывает на то, что предвзятость вызвана типом метки («человек» или «ИИ»), а не точными используемыми словами.

Этюд 2

Второе исследование выявило одинаковую предвзятость в пользу человека во всех 13 моделях ИИ, независимо от архитектуры или поставщика:

Смещение атрибуции для каждой из 13 моделей ИИ: столбцы показывают величину эффекта с 95% доверительным интервалом, а красная линия — исходное значение для человека. Все модели показали более сильное смещение, чем люди, с небольшими различиями между ними.

Каждая модель предпочитала истории, помеченные как написанные человеком, с более сильные эффекты, чем наблюдаемые у людейДаже после исключения самого экстремального случая среднее смещение оставалось более чем в два раза больше, чем у человека, что говорит о том, что этот эффект — не сбой в одной модели, а общая черта всех LLM.

Заключение

Хотя, как отмечается в статье, более ранние исследования показали, что ИИ может создавать тексты, равные или даже превосходящие человеческие произведения, авторы подчеркивают, что в литературе ценность, придаваемая авторству и подлинности, является старой и глубоко укоренившейся традицией:

«Когда GPT-4o Mini отвергает «творческий и юмористический» подход Кено, считая его «преувеличенным» в рамках атрибуции ИИ, и в то же время восхваляет идентичные характеристики в рамках атрибуции человеком, он неявно показывает, как эти ярлыки порождают предположения об отсутствии подлинного психологического процесса.

«Сигналы происхождения сводят процесс к тому, что в противном случае могло бы быть суждением только о продукте: «простое создание» кажется приемлемым для человека-ремесленника (оцениваемого как искусное ремесло), но подозрительным для модели (оцениваемой как алгоритмическая рекомбинация)».

LLM являются еще недостаточно надежен для неконтролируемых исследований на основе фактов, хотя тщательный надзор все еще может сделать их продуктивными - но творческое письмо на основе степени магистра права может столкнуться с более неопределенным будущим, если созданные ИИ творческие работы будут стигматизированы из-за более широкого общественного неодобрения посягательств ИИ на человеческие сферы, а не на основе литературных достоинств.

Значимость результатов подобных исследований во многом зависит от готовности компаний и отдельных пользователей честно говорить о том, внёс ли ИИ вклад в их результаты. В некоторых случаях нежелание признать такое использование может быть связано с корпоративное пиратство в области авторских прав чем беспокойство по поводу того, примет ли общественность творческие работы, созданные искусственным интеллектом.

Однако юридические, финансовые и политические решения в отношении авторских прав возможны (хотя и весьма сложны). Сможет ли кто-нибудь когда-нибудь заставить людей наслаждаться творческим ИИ, не основанным на едином и понятном человеческом разуме, — это может оказаться ещё более сложной задачей.

* Пожалуйста, обратитесь к исходному тексту для получения вырезанных внутритекстовых ссылок. При необходимости они будут включены в статью.

Впервые опубликовано Понедельник, 13 октября 2025 г.