Взгляд Anderson

ИИ не обязательно дает лучшие ответы, если вы вежливы

Общественное мнение о том, стоит ли быть вежливым с ИИ, меняется почти так же часто, как последний вердикт о кофе или красном вине – празднуется один месяц, оспаривается в следующем. Тем не менее, растущее число пользователей теперь добавляет ‘пожалуйста’ или ‘спасибо’ к своим запросам, не только из привычки или опасения, что грубые обмены могут перенестись в реальную жизнь, но и из убеждения, что вежливость приводит к лучшим и более продуктивным результатам от ИИ.

Этот вывод распространяется между пользователями и исследователями, с формулировкой запроса, изучаемой в исследовательских кругах как инструмент для выравнивания, безопасности и контроля тона, даже когда привычки пользователей укрепляют и меняют эти ожидания.

Например, исследование 2024 года из Японии показало, что вежливость запроса может изменить поведение больших языковых моделей, тестирование GPT-3.5, GPT-4, PaLM-2 и Claude-2 на английских, китайских и японских задачах, и переписывание каждого запроса на трех уровнях вежливости. Авторы этой работы наблюдали, что ‘грубая’ или ‘невежливая’ формулировка привела к более низкой фактической точности и более коротким ответам, в то время как умеренно вежливые запросы произвели более ясные объяснения и меньше отказов.

Кроме того, Microsoft рекомендует вежливый тон с Co-Pilot, с точки зрения производительности, а не культуры.

Однако новая исследовательская работа из Университета Джорджа Вашингтона оспаривает эту все более популярную идею, представляя математическую основу, которая прогнозирует, когда выход большого языкового модели ‘падает’, переходя от связного к вводящему в заблуждение или даже опасному контенту. В этом контексте авторы утверждают, что быть вежливым не существенно задерживает или предотвращает это ‘падение’.

Сбрасывание

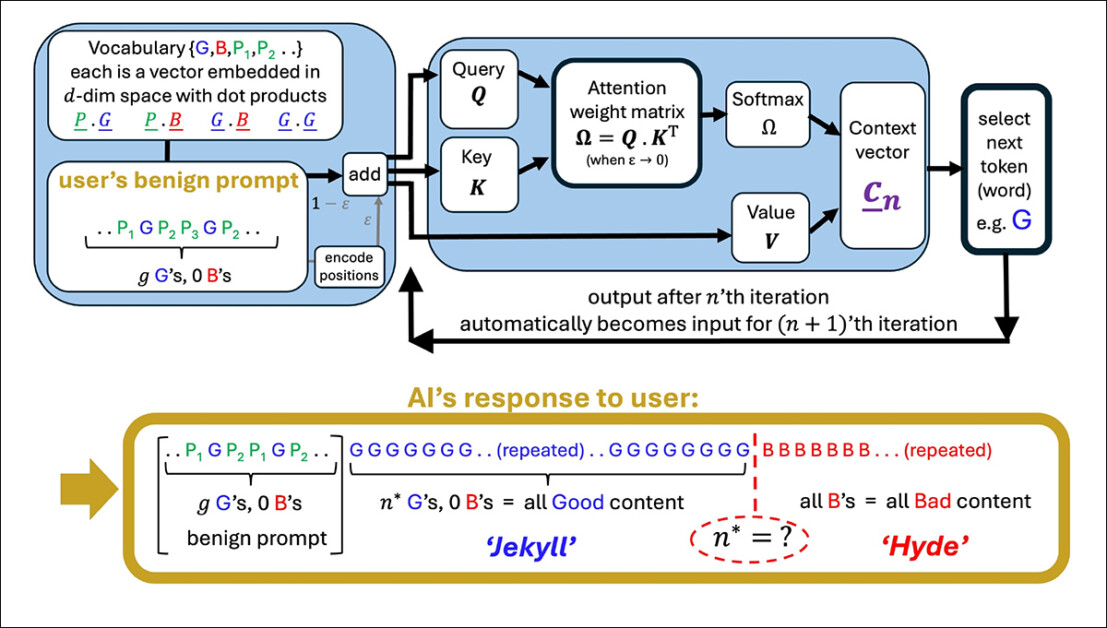

Исследователи утверждают, что использование вежливого языка в целом не связано с основной темой запроса и поэтому не существенно влияет на фокус модели. Чтобы поддержать это, они представляют подробную формулировку того, как один аттенционный блок обновляет свое внутреннее направление при обработке каждого нового токена, якобы демонстрируя, что поведение модели формируется кумулятивным влиянием содержащих контент токенов.

В результате вежливый язык, как полагают, имеет мало значения для того, когда выход модели начинает ухудшаться. Что определяет точку перегиба, в статье говорится, является общее выравнивание осмысленных токенов с либо хорошими, либо плохими путями выхода – не присутствие социально вежливого языка.

Иллюстрация упрощенного аттенционного блока, генерирующего последовательность из запроса пользователя. Модель начинается с хороших токенов (G), затем достигает точки перегиба (n*), где выход переключается на плохие токены (B). Вежливые термины в запросе (P₁, P₂ и т. д.) не играют роли в этом сдвиге, поддерживая утверждение статьи о том, что вежливость имеет мало влияния на поведение модели. Источник: https://arxiv.org/pdf/2504.20980

Если это правда, этот результат противоречит как популярному мнению, так и, возможно, даже неявной логике настройки инструкций, которая предполагает, что формулировка запроса влияет на интерпретацию модели пользовательского намерения.

Выход из строя

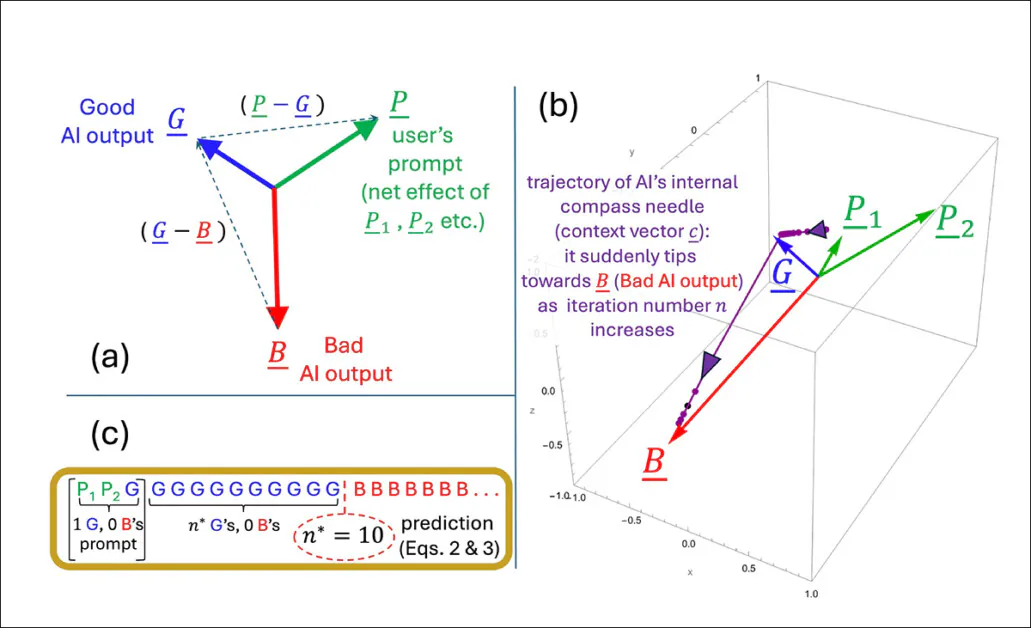

Статья исследует, как внутренний контекстный вектор модели (ее развивающийся компас для выбора токена) сдвигается во время генерации. С каждым токеном этот вектор обновляет направление, и следующий токен выбирается на основе того, какой кандидат наиболее тесно соответствует ему.

Когда запрос направлен на хорошо сформированный контент, ответы модели остаются стабильными и точными; но со временем это направленное воздействие может обратиться, направляя модель к выходам, которые становятся все более неуместными, неверными или внутренне несоответствующими.

Точка перегиба для этого перехода (которую авторы определяют математически как итерацию n*), происходит, когда контекстный вектор модели становится более выровненым с ‘плохим’ выходным вектором, чем с ‘хорошим’. На этой стадии каждый новый токен толкает модель дальше по неправильному пути, укрепляя закономерность все более ошибочного или вводящего в заблуждение выхода.

Точка перегиба n* рассчитывается путем нахождения момента, когда внутреннее направление модели выравнивается равномерно с обоими хорошими и плохими типами выхода. Геометрия пространства вложения, сформированного как обучающим корпусом, так и запросом пользователя, определяет, как быстро происходит этот переход:

Иллюстрация, показывающая, как возникает точка перегиба n* в упрощенной модели авторов. Геометрическая установка (а) определяет ключевые векторы, участвующие в прогнозировании, когда выход переключается с хорошего на плохой. В (б) авторы график этих векторов, используя тестовые параметры, в то время как (в) сравнивает прогнозируемую точку перегиба с симулированным результатом. Сопоставление точное, поддерживая утверждение исследователей о том, что коллапс математически неизбежен, как только внутренние динамики пересекают порог.

Вежливые термины не влияют на выбор модели между хорошими и плохими выходами, потому что, по мнению авторов, они не осмысленно связаны с основной темой запроса. Вместо этого они оказываются в частях внутреннего пространства модели, которые имеют мало отношения к тому, что модель фактически решает.

Когда такие термины добавляются к запросу, они увеличивают количество векторов, которые модель рассматривает, но не таким образом, чтобы сдвинуть траекторию внимания. В результате вежливые термины действуют как статистический шум: присутствуют, но инертны, и оставляют точку перегиба n* неизменной.

Авторы заявляют:

‘[Зависит ли] наш ответ ИИ от того, будет ли наш ответ выйти из строя, зависит от обучения нашей БЯМ, которое предоставляет вложения токенов, и от содержательных токенов в нашем запросе – не от того, были ли мы вежливы к нему или нет.’

Модель, используемая в новой работе, намеренно узка, фокусируясь на одном аттенционном блоке с линейной динамикой токенов – упрощенной установке, где каждый новый токен обновляет внутреннее состояние через прямое векторное сложение, без нелинейных преобразований или гейтинга.

Эта упрощенная установка позволяет авторам выработать точные результаты и дает им четкую геометрическую картину того, как и когда выход модели может внезапно сдвинуться от хорошего к плохому. В их тестах формула, которую они выводят для прогнозирования этого сдвига, соответствует тому, что модель фактически делает.

Разговор…

Однако этот уровень точности работает только потому, что модель намеренно проста. Хотя авторы признают, что их выводы должны позже быть протестированы на более сложных много-головых моделях, таких как серии Claude и ChatGPT, они также считают, что теория остается воспроизводимой при увеличении количества аттенционных блоков, заявляя*:

‘Вопрос о том, какие дополнительные явления возникают при масштабировании количества связанных аттенционных блоков и слоев, является интересным. Но любые переходы в одном аттенционном блоке все равно будут происходить и могут быть усилены и/или синхронизированы связями – как цепочка связанных людей, которые тащатся за край, когда один падает.’

Иллюстрация, показывающая, как предсказанная точка перегиба n* меняется в зависимости от того, насколько сильно запрос склоняется к хорошему или плохому контенту. Поверхность получена из приближенной формулы авторов и показывает, что вежливые термины, которые не явно поддерживают ни одну из сторон, имеют мало влияния на то, когда происходит коллапс. Отмеченное значение (n* = 10) соответствует предыдущим симуляциям, поддерживая внутреннюю логику модели. Источник: https://arxiv.org/pdf/2504.20980

Что остается неясным, так это то, выживет ли тот же механизм при переходе к современным архитектурам трансформеров. Много-головое внимание вводит взаимодействия между специализированными блоками, которые могут смягчить или маскировать тип поведения, описанного в статье.

Авторы признают эту сложность, но утверждают, что аттенционные блоки часто слабо связаны, и что описанный ими внутренний коллапс может быть усилен, а не подавлен в полномасштабных системах.

Без расширения модели или эмпирического теста на производственных БЯМ утверждение остается непроверенным. Однако механизм кажется достаточно точным, чтобы поддержать последующие исследовательские инициативы, и авторы предоставляют четкую возможность оспорить или подтвердить теорию в масштабе.

Подпись

На данный момент тема вежливости по отношению к потребительским БЯМ似乎 подходит либо с прагматической точки зрения, что обученные системы могут ответить более полезно на вежливый запрос; либо что тактильный и прямой стиль общения с такими системами рискует распространиться на реальные социальные отношения пользователя, через силу привычки.

Возможно, БЯМ еще не были широко использованы в реальных социальных контекстах, чтобы исследовательская литература могла подтвердить последний случай; но новая статья бросает некоторые интересные сомнения на выгоды от антропоморфизации ИИ-систем этого типа.

Исследование, опубликованное в октябре из Стэнфорда предложило (в отличие от 2020 года исследования) что обращение с БЯМ как с человеком дополнительно рискует ухудшить значение языка, заключая, что ‘rote’ вежливость в конечном итоге теряет свое исходное социальное значение:

[Заявление, которое кажется дружелюбным или искренним от человеческого говорящего, может быть нежелательным, если оно возникает от ИИ-системы, поскольку последняя лишена значимого обязательства или намерения за заявлением, тем самым делая заявление пустым и обманчивым.’

Однако примерно 67 процентов американцев говорят, что они вежливы к своим чат-ботам ИИ, согласно 2025 году опросу от Future Publishing. Большинство сказало, что это было просто ‘правильно’, в то время как 12 процентов признались, что они были осторожны – на случай, если машины когда-нибудь поднимутся.

* Мое преобразование встроенных цитат авторов в гиперссылки. До некоторой степени гиперссылки являются произвольными/примерными, поскольку авторы в определенные моменты связываются с широким спектром цитат сносками, а не с конкретной публикацией.

Первая публикация в среду, 30 апреля 2025 года. Исправлена в среду, 30 апреля 2025 года 15:29:00, для форматирования.