Unghiul lui Anderson

Avantajele obținerii grăsimii prin IA

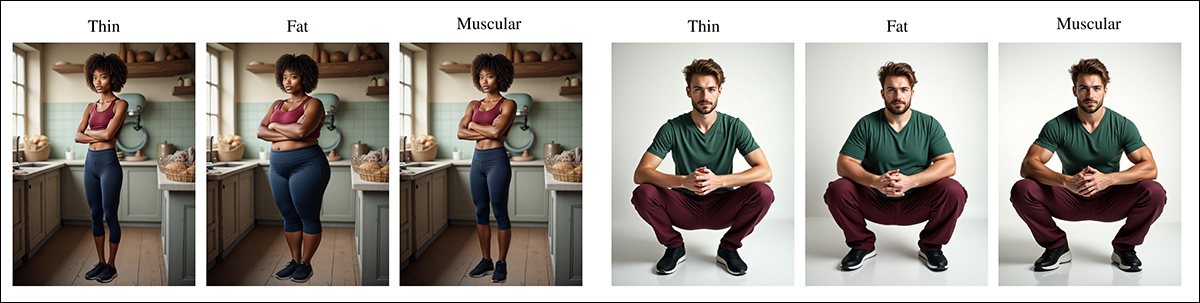

Un nou sistem IA poate remodela realist corpul oamenilor în fotografii, făcându-i mai grași, mai slabi sau mai musculoși, fără a schimba fața, hainele sau fundalul. Sistemul este antrenat pe un set de date complet sintetic care prezintă fiecare identitate pe multiple tipuri de corp.

Pe lângă utilizarea tot mai frecventă a IA ca metodă de refinare a formei corpului pe rețelele sociale, sau (posibil) pentru alterarea tipurilor de corp pentru scopuri VFX, utilizarea învățării automate pentru a altera aspectul indivizilor poate servi unui scop mai important: ajutarea indivizilor cu tulburări de alimentație să înțeleagă propria interpretare dismorfică a aspectului lor, precum și oferind un instrument motivațional potențial pentru scopuri sportive și de fitness mai generale:

Din lucrarea ‘Estimarea dimensiunii corpului la femeile cu anorexie nervoasă și controlul sănătos folosind avataruri 3D’, o interfață grafică pentru a vizualiza schimbările de formă a corpului. Indivizii cu dismorfie corporală pot avea dificultăți în a asocia o interpretare realistă a corpului lor cu o imagine similară, oferind astfel clinicienilor o metrică pentru răspunsurile dismorfe, printre alte scopuri. Sursă: https://www.nature.com/articles/s41598-017-15339-z.pdf

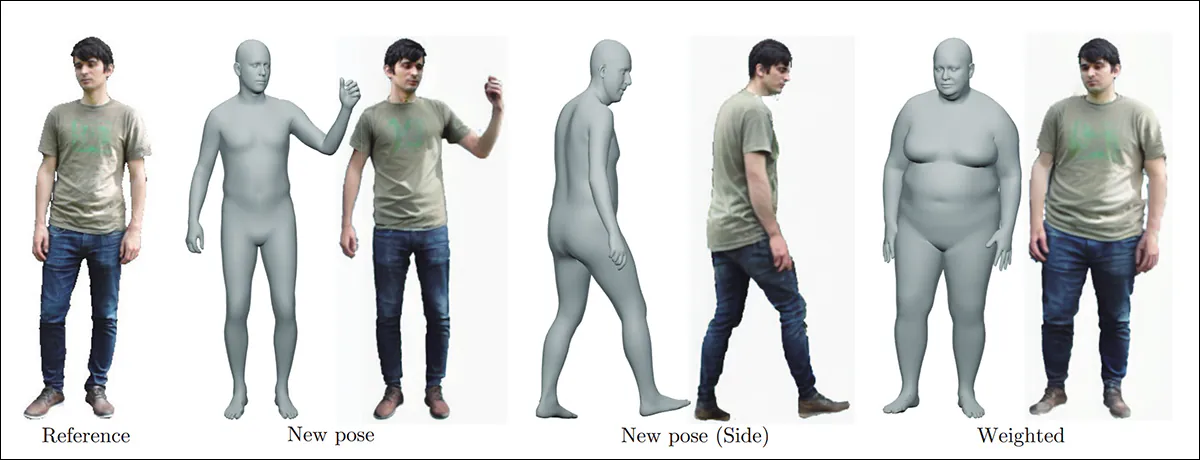

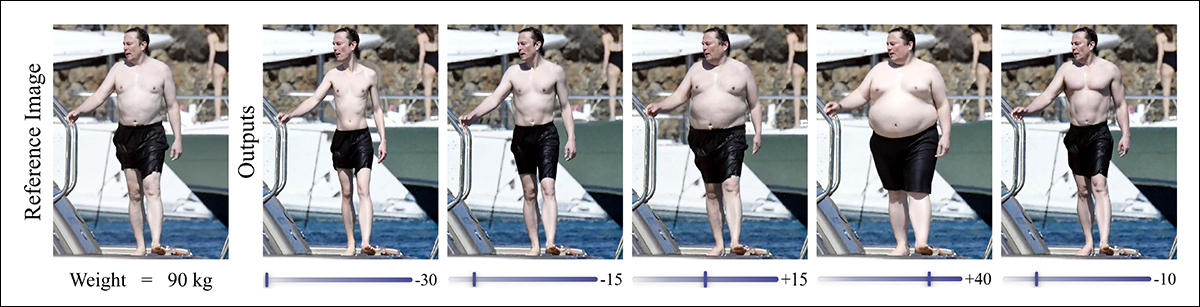

De asemenea, sub-rama încercării de modă în cercetarea viziunii computaționale are, de asemenea, interesul de a oferi vizualizări precise pe o gamă de forme de corp. Între timp, cadre precum DiffBody din 2024, oferit de Universitatea Tsukuba din Japonia, au creat funcționalități impresionante în acest domeniu:

Unele dintre transformările posibile folosind tehnica DiffBody anterioară. Sursă: https://arxiv.org/pdf/2401.02804

Deoarece modelele de bază IA sunt optimizate pentru forme de corp convențional atractive sau altfel comune, dimensiuni neobișnuite, cum ar fi “obezitatea”, sunt fie minim disponibile în modelele standard, fie vin cu anumite prejudecăți.

Necesități pereche

Una dintre cele mai mari provocări în crearea sistemelor IA care pot realista adăuga sau scoate grăsime și mușchi din imagini ale indivizilor – fără a schimba identitatea, mediul sau hainele – este că acest lucru implică antrenament pereche, unde sistemul IA efectiv învață imagini “înainte” și “după” care definesc orice transformare pe care modelul este destinat să o efectueze.

Acest tip de antrenament a revenit în prim-plan pe parcursul verii din cauza succesului seriei de modele de editare a imaginilor Kontext de la Black Forest Labs, unde acest tip de date pereche a fost utilizat pentru a preda o serie de transformări modelului:

Din site-ul Flux Kontext, un exemplu de transformare care reflectă tipul de date sursă necesare pentru antrenarea unui model capabil să păstreze integritatea imaginii atunci când impune schimbări majore. Sursă: https://bfl.ai/models/flux-kontext

Evident, în cazul dezvoltării unui model care poate schimba semnificativ aspectul unei persoane (fără a reimagina întreaga imagine), este nevoie de ceva care este total imposibil în lumea reală: imagini radicale “înainte” și “după” luate la doar câteva secunde distanță.

Singura soluție este datele sintetice. Unele proiecte de acest tip au utilizat perechi contrastive individuale create manual în Photoshop; cu toate acestea, acest lucru este nerealist la scară, iar un proces automat sau semi-automat, condus de IA, pentru generarea perechilor este acum considerat din ce în ce mai preferabil.

Problema abordărilor bazate pe GAN și a majorității abordărilor bazate pe SMPL/X (unde o figură virtuală CGI este utilizată ca un fel de mecanism de schimb între imagini reale și transformările dorite), și cu abordări care utilizează răsucirea imaginii, este că fundalul și identitatea tind să sufere în proces.

Modele CGI parametrice, vectoriale, cum ar fi SMPL și SMPL-X (printre altele), oferă coordonate fizice 3D convenționale definite care pot fi interpretate și incorporate în cadrele de viziune computațională. Sursă: https://files.is.tue.mpg.de/black/papers/SMPL2015.pdf

Deoarece este important ca IA să învețe să schimbe doar aspectele dorite, în loc de a învăța să răsucească fundaluri și să reproducă alte erori nedorite, niciun sistem de modificare a corpului nu a ajuns încă la o soluție perfectă.

Un articol recent din India propune, totuși, o avansare notabilă a stadiului actual al artei prin utilizarea cadrului mai vechi de model Flux difuziune, augmentat cu o serie de abordări secundare care permit un set de date pereche superior și mai consistent:

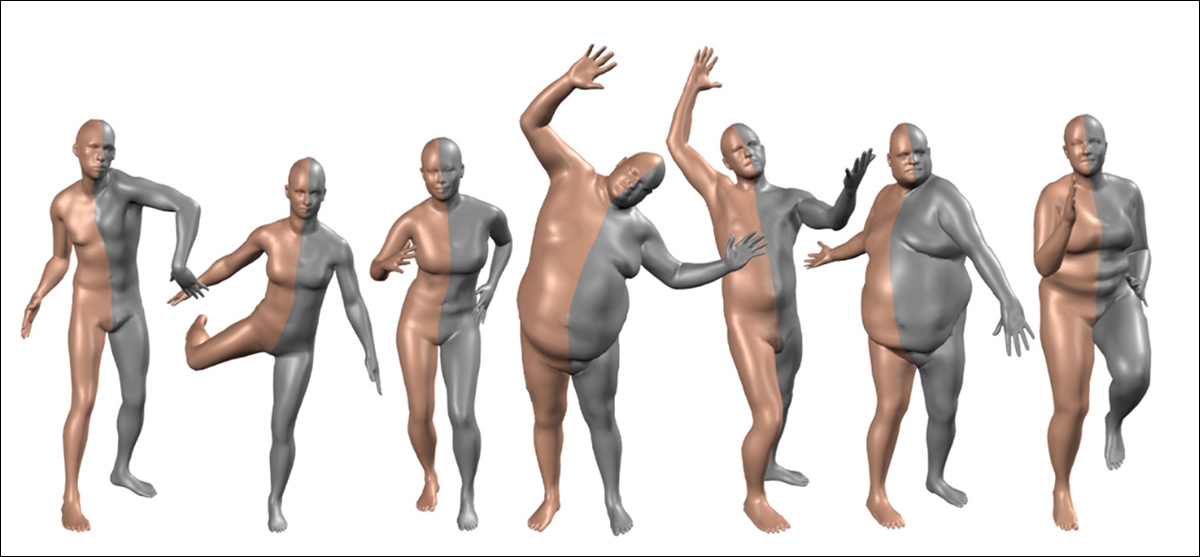

Exemple de set de date din noul proiect. Sursă: https://arxiv.org/pdf/2508.13065

Proiectul cuprinde un nou și extins set de date pereche; Odo, un model de difuziune generativ antrenat pe aceste date; și un benchmark nou, special conceput pentru a evalua cantitativ performanța de editare a formei umane. În testele efectuate, autorii afirmă o avansare notabilă a standardelor realizate de modele comparabile.

Noul articol se intitulează Odo: Difuziune ghidată de adâncime pentru remodelarea corpului care păstrează identitatea și provine de la trei cercetători de la Fast Code AI Pvt. Ltd din Bangalore.

Date și Metodă

Setul de date creat de cercetători conține 7.615 imagini de înaltă rezoluție (960x1280px) pentru fiecare tip de corp țintă (gras, slab și musculos).

Inițial, 1.523 de fețe umane au fost generate prin modelul de difuziune de 12 miliarde de parametri FLUX.1-dev, folosind un număr nedefinit de fețe de referință fără licență de la Pexels și Unsplash, pentru a crește diversitatea.

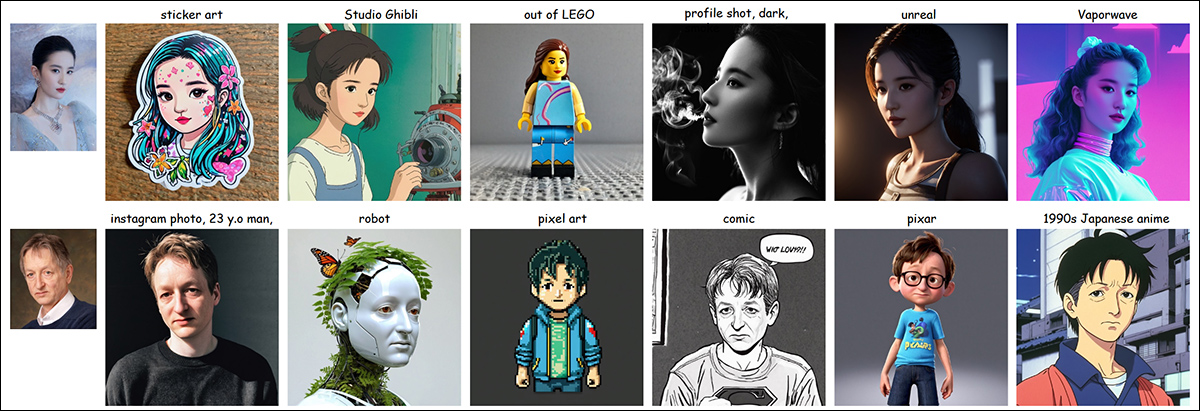

Pentru a genera imagini cu corpuri complete care includ aceste fețe, cercetătorii au utilizat oferirea din 2024 PuLID de la ByteDance, un punct de control reglat peste Flux, și care prezintă o pierdere de identitate contrastivă proiectată pentru a ajuta la conservarea identității faciale în timpul proceselor de transformare:

Exemple din proiectul PuLID. Sursă: https://arxiv.org/pdf/2404.16022

Modelul a primit o imagine facială și un prompt standardizat care solicita gen, îmbrăcăminte, poziție, scenă, precum și tipul de corp de slab, gras sau musculos.

Cele trei imagini de corp pentru fiecare identitate au prezentat uneori deplasări minore în alinierea fundalului și mărimea percepută a subiectului, care au apărut din cauza comportamentului stocastic al modelelor de difuziune, unde fiecare generare începe de la o nouă sursă de zgomot sămânță. Chiar și schimbări minore ale promptului, cum ar fi modificarea descrierii tipului de corp, pot influența traiectoria modelului în spațiul latent și pot cauza derivație vizuală.

Pentru a corecta această variație, a fost aplicată o linie de procesare automată în patru etape, cu imaginea slabă din fiecare triplet selectată ca referință, deoarece silueta sa mai mică expunea mai mult fundalul.

Detectarea persoanei a fost efectuată folosind RT-DETRv2, urmată de segmentare cu SAM 2.1 pentru a extrage măști de subiect pentru toate cele trei tipuri de corp. Imaginea de referință slabă a fost apoi transmisă la FLUX.1 Kontext Pro (noul sistem de editare a imaginilor) pentru picturarea fundalului, producând o versiune curată a scenei, cu subiectul eliminat.

Variantele grase și musculoase au fost redimensionate folosind o scalare uniformă pentru a se potrivi cu înălțimea măștii de referință slabă și au fost compuse pe fundalul curat la aceeași aliniere inferioară, asigurând o cadrare consistentă pe toate imaginile.

Autorii afirmă:

‘Tripleții de transformare rezultate (slab, gras și musculos) au un fundal identic și o scară uniformă a subiectului. Acest lucru elimină variațiile nerelevante care ar putea afecta negativ antrenamentul sau evaluarea ulterioară.’

Fiecare triplet de imagini slab, gras și musculos a permis șase perechi de transformare posibile, rezultând 45.690 combinații teoretice pe 7.615 identități.

După filtrarea exemplelor cu îmbrăcăminte necorespunzătoare, poziții ne naturale, membre distorsionate, derivație de identitate sau schimbări minime de formă, au fost păstrate 18.573 perechi de înaltă calitate. Deși au rămas unele diferențe minore de poziție, modelul s-a dovedit a fi robust față de aceste variații.

Antrenament și Teste

Imaginile rezultate au fost utilizate pentru antrenarea modelului Odo – o abordare bazată pe difuziune pentru remodelarea oamenilor, cu utilizarea hărților Skinned Multi-Person Linear Model (SMPL, adică model intermediar CGI).

Inspirat de metodele Localizatorului Neural din 2024, datele au fost conformate modelului SMPL pe baza fiecărui individ, parametrii optimizați fiind capabili să producă hărți de adâncime din care imaginile modificate ar fi derivate:

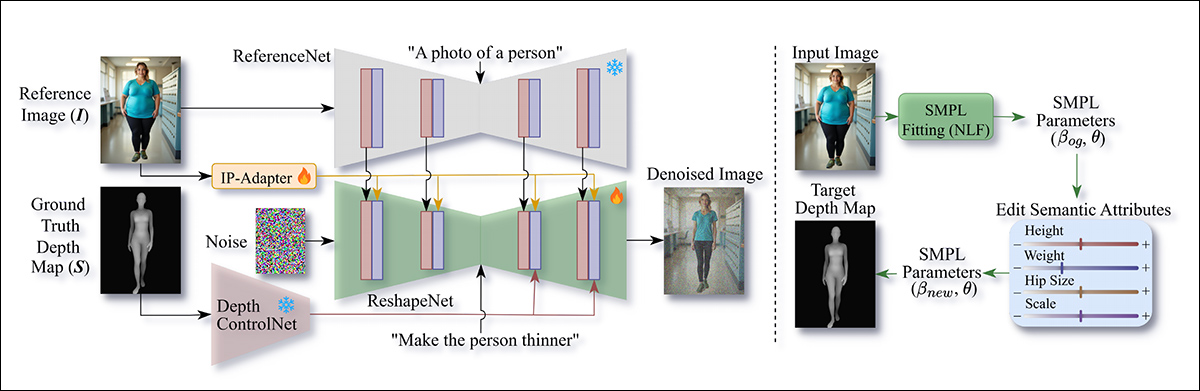

Schema pipeline-ului de antrenament. Partea stângă arată configurația de antrenament, unde hărțile de adâncime SMPL din imaginea țintă ghidă ReshapeNet prin ControlNet pentru a efectua transformarea corpului. Caracteristicile din imaginea sursă sunt extrase de către ReferenceNet și integrate în ReshapeNet folosind atenție spațială. Partea dreaptă arată inferența, unde parametrii SMPL sunt estimați din imaginea de intrare, modificați de atribute semantice și redați într-o hartă de adâncime țintă care condiționează ReshapeNet în timpul denoisingului pentru a produce imaginea finală transformată.

Modelul (a se vedea schema de mai sus) cuprinde modulul ReshapeNet, sprijinit de trei module auxiliare: ReferenceNet; un modul IP-Adapter; și un modul ControlNet bazat pe adâncime.

ReferenceNet extrage caracteristici detaliate, cum ar fi fundal, îmbrăcăminte și identitate, din imaginea de intrare și le transmite lui ReshapeNet. IP-Adapter contribuie la ghidarea caracteristicilor de nivel înalt, în timp ce ControlNet bazat pe adâncime aplică condiționarea SMPL pentru a ghida transformarea corpului. În conformitate cu lucrări anterioare, a fost utilizat un SDXL-bazat înghețat UNet pentru a extrage caracteristici intermediare.

În ceea ce privește modulul IP-Adapter, acesta codifică imaginea de intrare prin CLIP, iar încorporările rezultate sunt integrate înapoi în ReshapeNet prin atenție încrucișată.

În ceea ce privește modulul ControlNet bazat pe adâncime, acesta ghidează straturile medii și decodificatorul lui ReshapeNet folosind conexiuni reziduale. Ulterior, acesta ia o hartă de adâncime redată din parametrii SMPL țintă și o aliniază cu imaginea țintă.

ReshapeNet, bazat pe UNet SDXL, este rețeaua principală a lui Odo. În timpul antrenamentului, imaginile țintă sunt codificate în spațiul latent cu un autoencoder variabil, zgomot în timp și apoi denoizat de ReshapeNet folosind caracteristici de la ControlNet și ReferenceNet.

Prompturi categorice de text, cum ar fi “Fă persoana mai grasă”, “Fă persoana mai slabă” sau “Fă persoana mai musculoasă”, au fost adăugate pentru a ghida transformările. În timp ce hărțile de adâncime au capturat forme de corp grosiere, prompturile au oferit detaliile semantice necesare pentru schimbări, cum ar fi definirea mușchilor, permițând modelului să producă modificări mai precise și realiste.

Implementarea Antrenamentului

Odo a fost antrenat pe setul de date sintetic al proiectului, combinat cu un subset al setului de date DeepFashion-MultiModal, ceea ce a rezultat într-un total de 20.000 de perechi de imagini.

Datele DeepFashion-MultiModal au oferit varietate în îmbrăcăminte și caracteristici faciale, cu imagini pereche împotriva lor în timpul antrenamentului. Cu toate hărțile de adâncime SMPL precalculate pentru eficiență, antrenamentul a durat 60 de epoci pe un singur GPU NVIDIA A100 cu 80GB de VRAM.

Cu imaginile de intrare redimensionate la 768×1024, a fost utilizat optimizerul Adam la o rată de învățare de 1×10⁻⁵. ReshapeNet a fost inițializat cu greutăți UNet SDXL și reglat împreună cu IP-Adapter de la punctul său de control.

ReferenceNet a fost inițializat cu greutăți SDXL și a rămas înghețat, în timp ce ControlNet bazat pe adâncime a utilizat greutăți preantrenate și a rămas, de asemenea, înghețat.

Modelul final a necesitat aproximativ 23GB de memorie GPU, necesitând 18 secunde pentru inferența unei singure imagini.

O Metrică Nouă

Lipsa seturilor de date de acest tip a însemnat că niciuna dintre metricele existente nu aborda cu adevărat provocarea. Prin urmare, autorii au conceput o nouă benchmark, alcătuită din 3.600 de perechi de imagini, care prezintă imagini faciale reale și descrieri de fundal, împreună cu variații diverse de forme de corp.

Alte metrice utilizate au fost Indicele de Similaritate Structurală (SSIM); Raportul de Semnal la Zgomot (PSNR); Similaritatea de Imagine Perceptuală Învățată (LPIPS); și Eroarea Euclidiană Corectată la Scară pentru Vertebră în Poziție Neutră (PVE-T-SC).

Mai întâi, autorii au testat metoda lor calitativ împotriva imaginilor din sălbăticie (imagini care nu au fost văzute de model în timpul antrenamentului):

Teste calitative. Exemplele arată conversii de la imaginea originală la tipuri de corp subțire, supraponderal și musculos, în diferite poziții, inclusiv șezând și stând. Vă rugăm să consultați articolul sursă pentru o definiție și detalii mai bune.

Dintre aceste rezultate, articolul afirmă:

‘Metoda noastră gestionează eficient diverse poziții, fundaluri și îmbrăcăminte, păstrând identitatea persoanei.

‘În plus față de forme țintă SMPL, oferim prompturi textuale – “Fă persoana mai grasă”, “Fă persoana mai slabă” sau “Fă persoana mai musculoasă” – pentru a ghida în mod explicit transformările dorite…

… ‘Imaginea de mai jos demonstrează și mai mult capacitatea modelului nostru de a efectua diverse transformări de formă. Modelul urmează cu acuratețe hărțile de adâncime SMPL pentru a genera multiple variante de versiuni mai slabe și mai grase de la imaginea de referință.’

Teste calitative suplimentare care acoperă gama de tipuri de corp țintă. Vă rugăm să consultați articolul sursă pentru o definiție și detalii mai bune.

Autorii mai comentează:

‘Rezultatele noastre demonstrează transformări mai realiste conform greutății țintă, deoarece modelul nostru ajustează în același timp forma generală a corpului, proporțiile membrelor și îmbrăcămintea, rezultând modificări anatomice și vizual convingătoare.’

Pentru testele cantitative, autorii și-au comparat sistemul cu modelul sursă deschis Flux Kontext [dev] și oferirea din 2022 Generarea fluxului conștient de structură pentru remodelarea corpului uman.

Pentru FLUX.1 Kontext [dev], prompturile au fost proiectate pentru a instrui “Fă persoana mai grasă”, “Fă persoana mai slabă” sau “Fă persoana mai musculoasă”, cu greutăți țintă specificate – deși lipsa de controale fine a limitat performanța:

![Comparație între Odo și Generarea fluxului conștient de structură pentru remodelarea corpului uman și FLUX.1 Kontext [dev] pe setul de test, împreună cu rezultatele ablației pentru modele antrenate fără condiționarea promptului în ReshapeNet, fără ReferenceNet (utilizând doar IP-Adapter) și cu antrenamentul limitat la setul de date BR-5K. Tabelul include, de asemenea, informații legate de studii de ablație (BR-5K), pe care nu le acoperim aici.](https://www.unite.ai/wp-content/uploads/2025/08/table-2-1.jpg)

Comparație între Odo și Generarea fluxului conștient de structură pentru remodelarea corpului uman și FLUX.1 Kontext [dev] pe setul de test, împreună cu rezultatele ablației pentru modele antrenate fără condiționarea promptului în ReshapeNet, fără ReferenceNet (utilizând doar IP-Adapter) și cu antrenamentul limitat la setul de date BR-5K. Tabelul include, de asemenea, informații legate de studii de ablație (BR-5K), pe care nu le acoperim aici.

Concluzie

Apariția Flux Kontext în acest an și, mai recent, lansarea greutăților nequantificate pentru Qwen Image Edit au adus din nou datele pereche în prim-planul comunităților de amatori și profesioniști. În climatul de critică și nerăbdare crescândă față de imprecizia IA generativă, modele de acest tip sunt proiectate pentru o fidelitate mult mai mare față de imaginile sursă (deși modelele la scară mai mică sunt uneori limitate de obiectivele lor de antrenament foarte specifice).

În acest caz, utilitatea unui sistem de remodelare a corpului pare să se afle în domenii psihologice, medicale și de modă. Cu toate acestea, rămâne posibil ca sisteme de acest tip să ajungă la un nivel mai ridicat de prominență și, poate, la un set mai casual și, posibil, mai îngrijorător de utilizări.

Publicat pentru prima dată luni, 25 august 2025