Unghiul lui Anderson

Aducerea imaginilor generate de IA în lumina cu HDR

Imaginile și videoclipurile generate de IA pot fi impresionante, dar nu sunt la nivelul standardului “profesional” – o problemă pe care un nou proiect de cercetare încearcă să o rezolve.

În comunitatea audio-vizuală profesională, una dintre cele mai frecvente obiecții la invazia IA care apare este lipsa actuală a standardelor profesionale de reproducere a imaginilor și videoclipurilor. Nu în ultimul rând, una dintre acestea este capacitatea de a lucra cu imagini și videoclipuri cu High Dynamic Range (HDR).

Imaginile HDR sunt echivalentul modern al unei practici fotografice din secolul al XIX-lea și al XX-lea, numită bracketing, unde aceeași poză este făcută de mai multe ori cu cantități crescânde de lumină permisă să ajungă la emulsia de film:

Mai sus, o secvență scurtă de imagini bracketate. Înset jos, gama dinamică ridicată care poate fi extrapolată din aceste fotografii într-o singură imagine. Sursă

În fotografia tradițională, acest lucru a rezultat în multiple fotografii care, cu o anumită expertiză și efort, puteau fi compuse într-o singură imprime care să beneficieze de toate nivelurile diferite de detalii disponibile pe parcursul gamei de expuneri. Dar nu a fost un proces trivial sau ușor.

În zilele noastre, o secvență de imagini “auto-bracketate” poate produce fie multiple imagini, fie poate fi combinată într-o singură imagine HDR – efectiv, o multiplicitate de expuneri într-o singură imagine, care aplicațiilor de editare a imaginilor compatibile cu HDR, cum ar fi Photoshop, le permite să parcurgă și să orchestreze într-o singură imagine de ieșire ideală.

Dacă vă întrebați de ce ar trebui să vă intereseze sau cum afectează această chestiune fotografia dvs., ilustrația pentru acest articol este menită să demonstreze acest lucru într-un mod familiar:

Mai sus, în stânga, vedem un exemplu tipic de imagine sRGB (adică non-HDR). Doar îmbunătățirea (aratată în dreapta) nu arată monstrul din dulap, deoarece acel detaliu a fost aruncat atunci când fotograful și procesele automate ale aparatului de fotografiat au decis ce să prioritizeze în fotografia respectivă:

Mai jos, este o indicație (stânga) a modului în care prim-planul ar trebui să fie “spălat” la momentul expunerii pentru a înregistra monstrul din dulap într-o fotografie non-HDR, și (dreapta) cum monstrul este aruncat în întuneric atunci când expunerea este făcută potrivită pentru subiecții din prim-plan bine iluminați:

Mai jos, vedem tipul de detaliu care poate fi “salvat” dintr-o imagine sau secvență HDR. În acest caz, monstrul era “ascuns” în cele mai joase registre vizuale ale secvenței HDR, într-un nivel în care restul conținutului ar fi fost “spălat” în alb aproape (mai sus, stânga). Prin specificarea faptului că o gamă largă de niveluri de strălucire ar trebui să fie exprimate, selectiv, în aceeași imagine, aceste elemente disonante pot fi compuse într-o singură imagine rațională:

O imagine non-HDR este cunoscută sub numele de imagine referită la afișare, iar o imagine HDR cu gamă ridicată este cunoscută sub numele de imagine referită la scenă.

Videoclipul HDR este de asemenea o chestiune, și această versatilitate și ductilitate tonală oferă filmatorilor o anumită libertate de a salva, gradua și interpreta filmările într-un număr de moduri creative și consistente; nu este surprinzător, atunci, că creatorii sunt reticenți să lucreze cu ieșirile “plat” sRGB tipice pentru majoritatea cadrului generativ AI.

HDR în IA

Firește, scena de cercetare este interesată de aducerea cadrului generativ IA în era HDR. Cu toate acestea, nu este o sarcină trivială, atât din cauza arhitecturii fundamentale a sistemelor generative difuzionale, cât și pentru că datele HDR de calitate necesită o cantitate considerabilă de spațiu pe disc, făcând colecțiile neîndemânatice; în consecință, seturile de date potrivite pentru această sarcină sunt rare.

Cu toate acestea, o colaborare între o universitate din Singapore și Adobe Research oferă o metodă de producere a secvențelor de imagini HDR, într-o metodologie care poate fi teoretic aplicată atât imaginilor statice, cât și videoclipurilor:

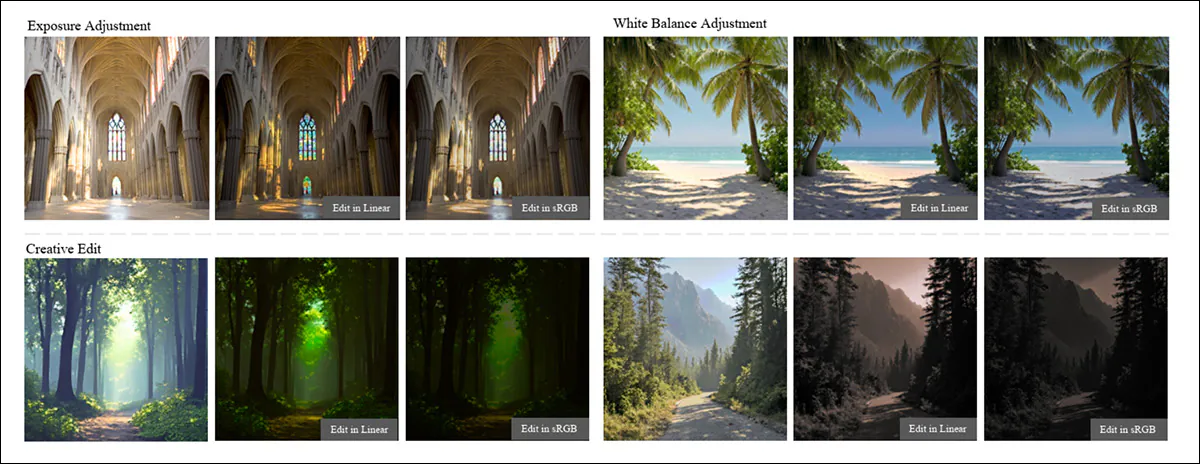

De pe site-ul proiectului pentru noua lucrare, exemple de ieșiri de imagini text-la-imagine ‘bracketate’. Sursă

Noul sistem generează mai multe versiuni aliniate ale aceleiași imagini la diferite niveluri de strălucire și învață cât de strălucitor a fost realmente scena, apoi le combină într-un singur rezultat care păstrează detaliile atât în umbre, cât și în zonele luminoase, permițând editări ulterioare ale expunerii sau culorii să se comporte mai mult ca ajustări la o captură de cameră reală, decât ca ajustări fragile la o imagine complet procesată.

Sistemul utilizează o diversitate de modele diferite pentru această sarcină, inclusiv variante ale Qwen și Flux:

Exemple din noua lucrare, arătând cum sistemul poate genera multiple versiuni de expunere ale aceleiași scene, păstrând structura de bază fixă. Începând de la o hartă de margine simplă, modelul produce imagini consistente pe întregul spectru de la foarte întunecat la foarte luminos, indiferent dacă promptul descrie lumina lunii, lumina soarelui, apusul soarelui sau chiar un obiect mic, cum ar fi un balon, cu subiectul și compoziția rămânând stabile, în timp ce doar lumina se schimbă. Metoda poate varia strălucirea într-un mod controlat, similar cu o cameră, în loc de a deriva sau inventa conținut nou pe măsură ce expunerea se schimbă. Sursă

Autorii afirmă:

‘Generarea de imagini liniare este o sarcină dificilă, deoarece VAE-urile pre-antrenate în modelele de difuzie latentă luptă să păstreze în același timp atât umbre extreme, cât și zone luminoase, din cauza gamei dinamice mai mari și a adâncimii de bit.’

‘În acest scop, reprezentăm o imagine liniară ca o secvență de expuneri “bracketate”, fiecare capturând o anumită parte a gamei dinamice, și propunem o arhitectură de flux de potrivire bazată pe DiT pentru generarea expunerii condiționate de text.’

‘Mai mult, demonstrăm aplicații descendente, inclusiv editarea liniară a imaginilor ghidate de text și generarea condiționată de structură prin ControlNet.’

Noua lucrare, intitulată Generarea de imagini liniare prin sintetizarea expunerilor “bracketate”, provine de la patru autori de la S-Lab la Universitatea Tehnică Nanyang, Adobe NextCam și Adobe Research. Pe lângă pagina proiectului și videoclipul YouTube care însoțește lansarea, există și un depozit GitHub (în prezent slab populat), precum și promisiunea unei lansări a setului de date.

Deși autorii furnizează multe exemple de ieșiri ale sistemului la pagina proiectului asociat, cititorii vor avea nevoie de un monitor compatibil cu HDR pentru a distinge cu adevărat caracteristicile ieșirii HDR prezentate. Cu toate acestea, vă rugăm să găsiți prezentarea video YouTube a cercetătorilor – dar fiți conștienți că diferențele dintre exemplele prezentate nu pot fi clare pe un monitor non-HDR.

Metodă și date

Autorii subliniază amploarea în care colectarea datelor este o provocare în această căutare:

‘Obținerea unui număr mare de imagini liniare este extrem de dificilă în practică. Mai mult, majoritatea seturilor de date HDR publice sunt fie panoramice (și se concentrează aproape exclusiv pe conținutul scenei la scară largă), fie nu oferă imagini liniare adevărate, făcându-le nepotrivite pentru scopurile noastre.’

‘Prin urmare, ne bazăm în primul rând pe seturile de date de imagini RAW pentru antrenare.’

Cercetătorii au făcut uz creativ de opțiunile limitate, utilizând setul de date RAISE ca date reale de antrenare și setul de date MIT-Adobe FiveK ca date de evaluare*.

Pentru a construi date de antrenare HDR utilizabile, cercetătorii au rulat fișierele de cameră RAW printr-o conductă standardizată pentru a îndepărta ciudățeniile specifice camerei, transformând imaginile într-un format liniar consistent și referit la scenă:

Schemă pentru fluxul de lucru al autorilor: sistemul pornește de la zgomot care reprezintă patru niveluri de expunere ale aceleiași scene, împreună cu un prompt de text și un token de strălucire, și le procesează printr-un bloc de transformatori împilați care păstrează expunerile aliniate, în timp ce ajustează lumina. Apoi, sistemul prezice atât setul de imagini de expunere, cât și o scară generală de strălucire, și ulterior decodifică și le combină într-o singură imagine referită la scenă, păstrând detaliile atât în umbre, cât și în zonele luminoase.

Acest lucru a implicat reconstruirea completă a RGB din datele de senzor, aplicarea corecției de culoare, normalizarea echilibrului de alb și o scurtă trecere într-un spațiu de culoare perceptual pentru denoising, înainte de a reveni la un semnal liniar curat. Lumina reală din scenă a fost apoi recuperată folosind setările de expunere ale camerei, astfel încât fiecare pixel să reflecte strălucirea reală, în loc de o aproximare gata pentru afișare.

Deoarece astfel de valori pot varia foarte mult, datele au fost stabilizate prin scalarea fiecărei imagini pe baza propriei distribuții de strălucire, utilizând statistici de mijloc și de evidențiere pentru a evita atât imaginile spălate, cât și cele cu evidențieri puternice, obținând în final o imagine liniară normalizată care păstrează gama reală de lumină din scenă, în timp ce rămâne suficient de stabilă pentru antrenare.

Etichetele de text pentru imagini au fost create cu modelul Qwen2.5-VL 7B, cu prompturi create pentru a se potrivi caracteristicilor modelului Flux care urma să fie utilizat la momentul generării.

Fiecare imagine a fost împărțțită în “felii” de expunere și trecută printr-un encoder VAE partajat, transformând toate expunerile într-un spațiu latent comun proiectat pentru a capta gama completă de strălucire. Latentele au fost apoi rafinate din zgomot și decodificate înapoi în imagini, permițând o reconstruire consistentă atât în regiunile întunecate, cât și în cele luminoase, fără a le comprima într-o singură expunere “plat”.

Finisarea LoRA a fost utilizată pentru a adapta modelul Flux pre-antrenat la datele de imagini liniare cu parametri minimi, ajutând modelul Single-Diffusion Transformers (single-DiT) să rămână stabil, chiar și pe măsură ce strălucirea variază pe parcursul expunerilor “bracketate”.

Atenția Modulată de Expunere (coloana centrală în schema de mai sus) a fost introdusă pentru a procesa în comun toate “bracketele”, permițând strălucirea să fie ajustată pe fiecare expunere, în timp ce structura și detaliile fine rămân aliniate.

Încorporarea Pozițională Rotativă 3D (3D-R[o]PE) a fost utilizată pentru a codifica atât poziția spațială, cât și identitatea expunerii, astfel încât modelul să poată distinge la care “bracket” aparține fiecare token, în timp ce păstrează consistența spațială, permițând o separare curată a variației de strălucire de conținutul scenei.

O prezentare generală a setului de date utilizat în studiul de față, arătând cum imaginile sunt distribuite pe tipuri de conținut și scene interioare versus exterioare, împreună cu distribuția valorilor de strălucire în datele prelucrate. Histograma prezintă luminozitatea și scara de radianță în spațiu logaritmic, ilustrând cât de mult poate varia strălucirea reală a lumii, cu valori de radianță mai mari corespunzând unor scene fizic mai luminoase și evidențiind gama dinamică puternică pe care modelul este antrenat să o gestioneze.

3D-RoPE a separat unde se află o caracteristică și “de la ce expunere provine” în semnale separate, astfel încât variația de strălucire să poată fi ajustată independent, fără a corupe detaliile spațiale.

Teste

Cercetătorii au utilizat Flux-dev ca cadru generativ, cu antrenarea care a avut loc pe patru plăci grafice NVIDIA A100, fiecare cu 80GB de VRAM. Dimensiunea batch-ului a fost setată la 4 (pe GPU), pe 10.000 de iterații.

Finisarea LoRA a utilizat un rang de 64. Optimizatorul AdamW a fost utilizat la o rată de învățare de 2×102 (pentru aspectul de modulare a expunerii).

Autorii menționează că, deși există două lucrări anterioare care sunt similare în scop, niciuna dintre ele nu a fost un concurent evident pentru o fază de testare. Lucrarea condusă de Max Planck din 2022, GlowGAN, este limitată la generarea unor categorii de imagini specifice, în timp ce Bracket Diffusion (din 2025, condusă de Institutul Max Planck) poate genera doar o imagine HDR la 256x256px și necesită câteva minute pentru a o face.

Din lucrarea originală GlowGAN, imaginile tipice cu gamă dinamică joasă (LDR) pierd detalii în umbre și evidențieri, în timp ce modelul învață să producă versiuni cu gamă dinamică ridicată (HDR) care păstrează detalii pe întregul spectru de strălucire și permit recuperarea regiunilor saturate prin mapare inversă de ton. Sursă

Prin urmare, în absența unor linii de bază directe pentru generarea de imagini liniare, autorii au comparat metoda lor cu versiuni adaptate ale unor modele puternice existente, în loc de alternative create special pentru această sarcină.

Un set de experimente (‘T2I Fine-Tuning’) a finisat modelul de difuzie text-la-imagine Flux utilizând LoRA, antrenându-l să genereze imagini liniare direct și evaluând cum un model T2I de ultimă generație se adaptează la acest domeniu.

O a doua comparație (‘T2V fine-tuning’) a utilizat modelul text-la-videoclip Wan 2.1, ale cărui VAE comprimă multiple cadre într-o reprezentare latentă partajată; în această configurație, patru “brackete” de expunere au fost codificate într-o singură reprezentare latentă și apoi decodificate înapoi, testând dacă o conductă de tip video poate modela variația de expunere.

Al treilea set de experimente (‘T2I Model Inflation’) a comparat împotriva CameraCtrl și Generative Photography, care ambele extind modelele de difuzie a imaginilor prin module temporale, pentru a produce ieșiri multi-cadru. Acestea au fost, de asemenea, finisate pe aceleași date, pentru o comparație consistentă.

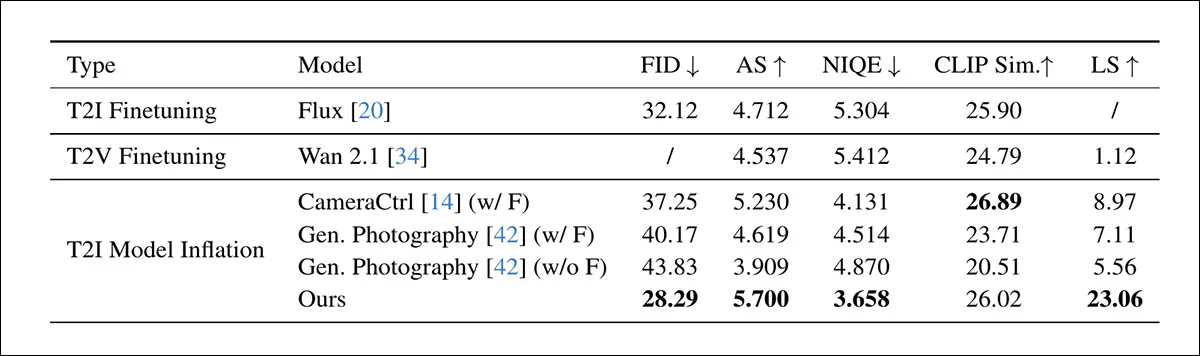

Metricile utilizate au fost Distanța Fréchet Inception (FID); Scor estetic (AS); Evaluator de calitate a imaginii Natural (NIQUE); Scor de similaritate CLIP; și Similaritate de luminozitate (LS):

O comparație a metodei autorilor cu mai multe linii de bază adaptate pentru generarea de imagini liniare referite la scenă. Modelele text-la-imagine (Flux) și text-la-videoclip (Wan 2.1) sunt finisate cu LoRA pentru a testa cât de bine sistemele generative existente gestionează această configurație, în timp ce CameraCtrl și Generative Photography extind modelele de difuzie cu componente temporale. Unele scoruri lipsesc, deoarece anumite modele nu pot produce în mod fiabil “brackete” de expunere consistente, care sunt necesare pentru a recupera gama dinamică completă. Pe parcursul metricilor raportate, noua metodă obține cele mai puternice rezultate generale, în special pe măsurile legate de calitatea imaginii și reconstrucția precisă a strălucirii.

În legătură cu aceste rezultate, autorii afirmă:

‘Din cauza distribuției largi a imaginilor liniare, finisarea directă a modelului T2I pe date liniare face dificilă echilibrarea detaliilor din umbre și evidențieri. Metodele de umflare a modelului T2I suferă atât de o gamă dinamică limitată, cât și de o degradare semnificativă a calității imaginii, chiar și după finisare.’

‘Pentru finisarea T2V, descărcarea temporală de 4× a lui Wan 2.1 împletește cele 4 “brackete” de expunere într-o singură reprezentare latentă, provocând un decalaj de distribuție grav care nu poate fi rezolvat prin finisare singură. ‘

‘Prin modelarea directă a proprietăților referite la scenă utilizând “brackete” de expunere, metoda noastră obține o calitate vizuală superioară și o gamă dinamică pe toate liniile de bază.’

O comparație cu Flux finisat cu LoRA și Wan 2.1, ilustrând cum fiecare metodă gestionează schimbările de expunere pe aceleași scene. Abordările concurente tind să piardă detalii în regiunile foarte întunecate sau foarte luminoase, în timp ce metoda propusă menține o structură consistentă și recuperează detalii utile pe întreaga gamă de expuneri. Vă rugăm să consultați lucrarea sursă și site-ul proiectului pentru exemple de rezultate de calitate superioară.

Vă rugăm să consultați secțiunea de experimente extinse și materiale suplimentare din lucrarea sursă pentru teste suplimentare.

Concluzie

Pentru profesioniștii din media, cum ar fi cei care lucrează în producția de film și televiziune, aceeași ieșire care a capturat imaginația (și, din ce în ce mai mult, nemulțumirea) lumii a lăsat-o indiferenți, deoarece toate conductele lor depind într-un fel sau altul de capturi HDR.

Prin urmare, acesta este un proiect oportun, reprezentând o facilitate care sperăm că va deveni un standard opțional în cadrul noilor cadre – deși este sigur că va dubla timpul de render; evident, de asemenea, latența va trebui să fie abordată în mod serios, astfel încât conținutul AI HDR să nu fie relegat la categoria “în post-procesare”, ci mai degrabă “în cameră”.

* De obicei, am arăta exemple, dar deoarece cititorul poate nu are un monitor compatibil cu HDR, le omităm în acest caz.

Publicat pentru prima dată duminică, 26 aprilie 2026