Inteligență artificială

RigNeRF: O nouă metodă de deepfakes care utilizează câmpuri neurale de radianță

O nouă cercetare dezvoltată la Adobe oferă prima metodă viabilă și eficientă de deepfakes bazată pe câmpuri neurale de radianță (NeRF) – poate prima inovație reală în arhitectură sau abordare în cei cinci ani de la apariția deepfakes în 2017.

Metoda, intitulată RigNeRF, utilizează modele de fețe morphabile 3D (3DMM) ca un strat intermediar de instrumentaritate între intrarea dorită (de exemplu, identitatea care urmează a fi impusă în renderul NeRF) și spațiul neural, o metodă care a fost îmbrățișată pe scară largă în ultimii ani de abordările de sinteză a feței bazate pe GAN, niciuna dintre acestea nefiind capabilă să producă cadre funcționale și utile de înlocuire a feței pentru video.

În contrast cu videoclipurile tradiționale de deepfakes, niciunul dintre conținutul în mișcare prezentat aici nu este ‘real’, ci mai degrabă un spațiu neural explorabil care a fost antrenat pe filmări scurte. Pe partea dreaptă vedem modelul de față morphabilă 3D (3DMM) care acționează ca interfață între manipulările dorite (‘zâmbesc’, ‘privește la stânga’, ‘privește în sus’, etc.) și parametrii obișnuit inaccesibili ai unei visualizări a câmpului neural de radianță. Pentru o versiune de înaltă rezoluție a acestui clip, împreună cu alte exemple, consultați pagina proiectului, sau videoclipurile încorporate la sfârșitul acestui articol. Sursă: https://shahrukhathar.github.io/2022/06/06/RigNeRF.html

Modelele 3DMM sunt efectiv modele CGI de fețe, parametrii cărora pot fi adaptați la sisteme de sinteză de imagini mai abstracte, cum ar fi NeRF și GAN, care altfel sunt dificil de controlat.

Ce vedeți în imaginea de mai sus (imaginea din mijloc, bărbatul în cămașă albastră), precum și imaginea de mai jos (imaginea din stânga, bărbatul în cămașă albastră), nu este un ‘real’ video în care a fost suprapus un mic fragment de ‘falsă’ față, ci o scenă complet sintetizată care există doar ca o reprezentare neurală volumetrică – inclusiv corpul și fundalul:

În exemplul de mai sus, videoclipul din viața reală de pe partea dreaptă (femeia în roșu) este utilizat pentru a ‘manevra’ identitatea capturată (bărbatul în cămașă albastră) de pe partea stângă prin intermediul RigNeRF, care (autorii susțin) este primul sistem NeRF care reușește să separe poza și expresia în timp ce este capabil să efectueze sinteze de vedere noi.

Figura masculină de pe partea stângă în imaginea de mai sus a fost ‘capturată’ dintr-un videoclip de 70 de secunde de la un smartphone, iar datele de intrare (inclusiv informațiile despre întreaga scenă) au fost ulterior antrenate pe 4 V100 GPU pentru a obține scena.

Deoarece 3DMM-urile cu parametri sunt disponibile și ca proxii CGI parametrici pentru întregul corp (și nu doar pentru fețe), RigNeRF deschide posibilitatea deepfakes-urilor complete, unde mișcarea reală a omului, textura și expresia sunt transmise stratului parametric bazat pe CGI, care ar traduce apoi acțiunea și expresia în medii și videoclipuri NeRF renderizate.

În ceea ce privește RigNeRF – califică el ca o metodă de deepfakes în sensul în care titlurile înțeleg termenul? Sau este doar o altă metodă semi-încetinită și slabă în comparație cu DeepFaceLab și alte sisteme autoencoder de deepfakes din 2017?

Cercetătorii noului articol sunt neîndoielniți în acest sens:

‘Fiind o metodă capabilă să reanimeze fețe, RigNeRF este predispusă la utilizare abuzivă de către actori răi pentru a genera deep-fakes.’

Noul articol se intitulează RigNeRF: Portrete neurale 3D complet controlabile și provine de la ShahRukh Atha de la Universitatea Stonybrook, un intern la Adobe în timpul dezvoltării RigNeRF, și alți patru autori de la Adobe Research.

Dincolo de deepfakes-urile bazate pe autoencoder

Majoritatea deepfakes-urilor virale care au capturat titlurile în ultimii ani sunt produse de sisteme autoencoder, derivate din codul publicat pe subredditul r/deepfakes în 2017 – deși nu înainte de a fi copiat pe GitHub, unde a fost forkat de peste o mie de ori, nu în ultimul rând în distribuția populară (dar controvesată) DeepFaceLab și proiectul FaceSwap.

În afara GAN și NeRF, cadrele autoencoder au experimentat și cu 3DMM-uri ca ‘ghid’ pentru cadre de sinteză facială îmbunătățită. Un exemplu în acest sens este proiectul HifiFace din iulie 2021. Cu toate acestea, nu pare să fi fost dezvoltate inițiative utilizabile sau populare din această abordare până în prezent.

Datele pentru scenele RigNeRF sunt obținute prin capturarea de scurte videoclipuri de la un smartphone. Pentru proiect, cercetătorii RigNeRF au utilizat un iPhone XR sau un iPhone 12 pentru toate experimentele. Pentru prima jumătate a capturii, subiectul este rugat să efectueze o gamă largă de expresii faciale și să vorbească în timp ce ține capul nemișcat, în timp ce camera este mișcată în jurul lui.

Pentru a doua jumătate a capturii, camera menține o poziție fixă, în timp ce subiectul trebuie să-și miște capul în jur, arătând o gamă largă de expresii. Rezultatul este de 40-70 de secunde de filmări (aproximativ 1200-2100 de cadre) care reprezintă întregul set de date care va fi utilizat pentru antrenarea modelului.

Reducerea colectării de date

În contrast, sistemele autoencoder, cum ar fi DeepFaceLab, necesită colectarea și curățarea relativ laborioasă a mii de fotografii diverse, adesea luate de pe YouTube, alte canale de social media și filme (în cazul deepfakes-urilor de celebrități).

Modelele autoencoder antrenate sunt adesea destinate a fi utilizate în diverse situații. Cu toate acestea, ‘celebritățile’ deepfakes mai meticuloase pot antrena modele întregi de la zero pentru un singur videoclip, în ciuda faptului că antrenamentul poate dura o săptămână sau mai mult.

În ciuda notei de avertizare de la cercetătorii noului articol, seturile de date ‘în patchwork’ și ‘în ansamblu’ care alimentează pornografia AI, precum și ‘recastările’ populare de deepfakes de pe YouTube/TikTok, par să nu producă rezultate acceptabile și consecvente într-un sistem de deepfakes, cum ar fi RigNeRF, care are o metodologie specifică a scenei. Având în vedere restricțiile de capturare a datelor descrise în noul articol, acest lucru poate constitui, într-o oarecare măsură, un mijloc suplimentar de protecție împotriva utilizării abuzive a identității de către deepfakes-rile malefice.

Adaptarea NeRF la videoclipurile de deepfakes

NeRF este o metodă bazată pe fotogrammetrie în care o serie de imagini sursă luate din diverse puncte de vedere sunt asamblate într-un spațiu neural 3D explorabil. Această abordare a ajuns la prominență mai devreme în acest an, când NVIDIA a prezentat sistemul Instant NeRF, capabil să reducă timpul de antrenare exorbitant pentru NeRF la minute sau chiar secunde:

Instant NeRF. Sursă: https://www.youtube.com/watch?v=DJ2hcC1orc4

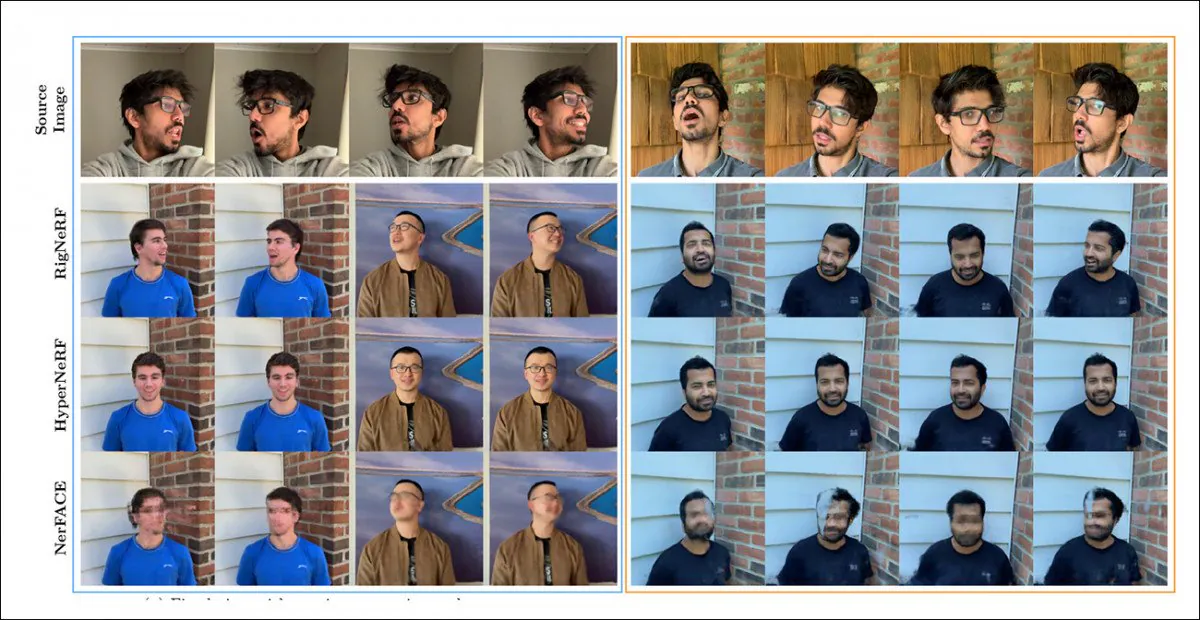

Scena rezultată a câmpului neural de radianță este esențialmente un mediu static care poate fi explorat, dar care este dificil de editat. Cercetătorii notează că două inițiative anterioare NeRF – HyperNeRF + E/P și NerFACE – au încercat să sintetizeze videoclipuri faciale și (aparent pentru sake de completitudine și diligență) au comparat RigNeRF cu aceste două cadre într-o rundă de testare:

O comparație calitativă între RigNeRF, HyperNeRF și NerFACE. Consultați videoclipurile sursă și PDF-ul pentru versiuni de înaltă calitate. Sursă imagine: https://arxiv.org/pdf/2012.03065.pdf

Cu toate acestea, în acest caz, rezultatele, care favorizează RigNeRF, sunt destul de anormale, din două motive: în primul rând, autorii observă că ‘nu există o lucrare existentă pentru o comparație de la mere la mere’; în al doilea rând, acest lucru a necesitat limitarea capacităților RigNeRF pentru a se potrivi cel puțin parțial cu funcționalitatea mai restrictivă a sistemelor anterioare.

Întrucât rezultatele nu reprezintă o îmbunătățire incrementală a lucrărilor anterioare, ci mai degrabă o ‘înfrângere’ a editabilității și utilității NeRF, vom lăsa runda de testare deoparte și vom vedea ce face RigNeRF diferit de predecesorii săi.

Combinația puterilor

Principala limitare a NerFACE, care poate crea controlul pozei/expresiei într-un mediu NeRF, este că presupune că filmările sursă vor fi capturate cu o cameră statică. Acest lucru înseamnă efectiv că nu poate produce vedere noi care să depășească limitările de capturare. Acest lucru produce un sistem care poate crea ‘portrete mobile’, dar care nu este potrivit pentru videoclipuri de deepfakes.

HyperNeRF, pe de altă parte, deși poate genera vedere noi și hiper-reale, nu are nicio instrumentaritate care să-i permită să schimbe pozele capului sau expresiile faciale, ceea ce nu conduce la niciun fel de competitor pentru deepfakes-urile bazate pe autoencoder.

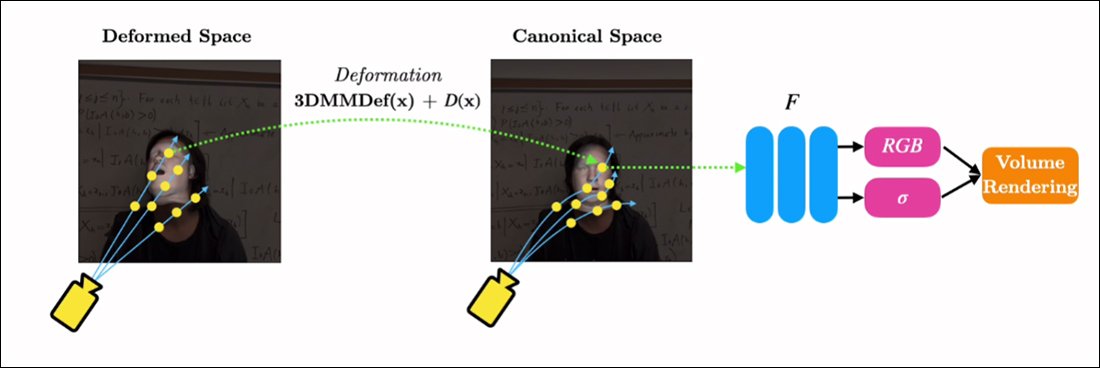

RigNeRF este capabil să combine aceste două funcționalități izolate prin crearea unui ‘spațiu canonic’, o linie de bază de la care deviațiile și deformările pot fi efectuate prin intrarea de la modulul 3DMM.

Crearea unui ‘spațiu canonic’ (fără poziționare, fără expresie), pe care pot acționa deformările (adică poziționările și expresiile) produse prin modulul 3DMM.

Deoarece sistemul 3DMM nu va fi exact potrivit cu subiectul capturat, este important să se compenseze acest lucru în proces. RigNeRF realizează acest lucru cu un câmp de deformare anterior care este calculat dintr-un perceptron multistrat (MLP) derivat din filmările sursă.

Parametrii camerei necesari pentru a calcula deformările sunt obținuți prin COLMAP, în timp ce parametrii de expresie și formă pentru fiecare cadru sunt obținuți din DECA.

Poziționarea este optimizată suplimentar prin încadrarea reperelor și parametrii camerei COLMAP, și, din cauza restricțiilor de resurse de calcul, ieșirea video este redusă la o rezoluție de 256×256 pentru antrenare (un proces de reducere hardware-constrâns care afectează și scena de deepfakes bazată pe autoencoder).

După aceea, rețeaua de deformare este antrenată pe cele patru V100 – o hardware formidabilă care nu este probabil să fie la îndemâna entuziaștilor ocazionali (cu toate acestea, în ceea ce privește antrenamentul de învățare automată, adesea este posibil să se facă schimb între putere și timp și să se accepte că antrenamentul modelului va dura zile sau chiar săptămâni).

În concluzie, cercetătorii afirmă:

‘În contrast cu alte metode, RigNeRF, datorită utilizării unui modul de deformare ghidat de 3DMM, este capabil să modeleze poziția capului, expresiile faciale și întreaga scenă a portretului 3D cu fidelitate ridicată, oferind astfel reconstrucții mai bune cu detalii clare.’

Consultați videoclipurile încorporate mai jos pentru mai multe detalii și filmări de rezultate.

Publicat pentru prima dată pe 15 iunie 2022.