Ângulo de Anderson

Recuo Total: Os Grupos que Tratam a IA como um Contaminante Intolerável

‘Zero-tolerance’ em relação ao conteúdo gerado por IA é uma opção cada vez mais atraente diante das crescentes preocupações legais, éticas e de base de usuários em torno da IA; mas é este tipo de ‘optar por sair’ uma proposta prática?

Opinião Qualquer pessoa que use mídias sociais e outros tipos de fóruns de discussão online pode ter notado, ultimamente, um número crescente de comunidades, fóruns e organizações profissionais proibindo completamente o uso de IA gerativa, à medida que o impacto econômico da tecnologia se espalha além dos artistas e escritores cujas protestos acenderam as atuais preocupações em 2023.

Com as consequências legais e econômicas da revolução da IA ainda incertas, organizações que enfrentam pressão de usuários e conselheiros jurídicos internos são forçadas a decidir políticas bem antes de a imagem completa estar clara – uma situação complicada pela crença emergente de que a adoção tardia poderia deixá-los em desvantagem competitiva.

IA como Miasma

A decisão de proibir é uma decisão política, com consequências; a capacidade de proibir, no entanto, envolve armadilhas políticas e práticas, desde que a história de proibir coisas que as pessoas realmente querem é uma história conturbada na melhor das hipóteses; e mesmo erradicar as coisas que ninguém quer exige esforço contínuo e de longo prazo.

Assim, assombrados pela história muito mal compreendida dos ludditas, aqueles grupos e entidades que tratam qualquer traço de IA como completamente intolerável muitas vezes adotam um tom defensivo ao anunciar ou discutir uma proibição de IA.

Como os amish descobriram ao longo dos últimos séculos, uma postura reclusa contra uma tecnologia realmente impactante pode ser difícil de manter; estritamente falando, por exemplo, aqueles que aderem às regras do veganismo não podem assistir a filmes filmados em celuloide tradicional, ou mesmo ter um raio-x. Da mesma forma, optar por não participar da fluoretação em países ou cidades que a adotam pode ser difícil.

Efetivamente, uma tecnologia pervasiva e popular é um fenômeno ‘atmosférico’ que não permite facilmente os limites atualmente estabelecidos por um número crescente de grupos e organizações.

Medidas Pré-Legais

Como mencionado anteriormente, as primeiras batalhas contra a invasão da IA foram travadas no setor menos determinístico e mais interpretativo da genIA – entretenimento. Quando o Sindicato dos Atores Americanos – Federação de Artistas de Televisão e Rádio (SAG-AFTRA) lutou pela proteção dos direitos de seus membros em 2023, foi capaz de obter algumas concessões notáveis.

Houve muito poucas vitórias tão decisivas desde então, no que diz respeito à IA – e a batalha pela clareza legal em uma variedade de setores está apenas começando. Por exemplo, a maioria da nova legislação em torno de deepfakes, notadamente da Reino Unido e dos EUA, inclui IA apenas em uma categoria mais ampla de crime (como imagens não consensuais, reais ou falsas).

Quentes na esteira da vitória da SAG-AFTRA, um lote de processos judiciais em torno do uso do trabalho de outros tipos de artistas estão sempre em andamento. Enquanto isso, muitos dos grupos descontentes envolvidos estão antecipando a ratificação legal com regras locais.

Antes de considerar mais a lógica e as limitações de uma atitude ‘totalmente intolerante’ em relação à IA, vamos olhar alguns dos casos em que essa política está sendo aplicada.

Proibições de IA Zero-Tolerância

Uma Nota de Dissentimento

Apenas este mês, o Bandcamp se tornou a primeira grande plataforma de música online a proibir completamente o conteúdo de IA. A proibição foi anunciada em uma declaração que também declarou ‘Música e áudio que é gerado inteiramente ou em parte substancial por IA não é permitido no Bandcamp’.

Essa restrição, como em quase todos os casos, é forçada a apostar um pouco devido ao mencionado efeito ‘miasma’ de sistemas de IA amplamente difundidos. Em outra parte do anúncio, é afirmado que a música que* ‘aparece ser feita inteiramente ou com grande dependência de IA gerativa’ é alvo da proibição – uma limitação pragmática, desde que, na maioria dos domínios, pelo menos algum conteúdo de genIA é capaz de parecer inteiramente feito pelo homem, tanto para as pessoas quanto para o setor de detecção de IA em constante evolução.

Efetivamente, este é o modelo para a maioria das novas políticas de ‘zero-tolerância’ que estão entrando em vigor: que a ignorância da IA é uma desculpa, nessas circunstâncias desafiadoras.

Depois de um incidente em que uma faixa de música criada por IA invadiu as paradas suecas, a IFPI Suécia, a organização nacional da indústria musical, proibiu a música gerada por IA de inclusão nas paradas – embora com a cautela habitual, afirmando* ‘Nossa regra é que, se for uma canção que é principalmente gerada por IA, ela não tem o direito de estar na lista dos principais’.

Novamente, o desejo de uma proibição total de IA é aqui reconhecido como impraticável; a proibição é tácita e total, mas a implementação é efetivamente impossível.

Efeito Cômico

Uma onda de proibição contra o conteúdo de genIA varreu a cena dos congressos de quadrinhos nos EUA e além, ao longo do último ano. O San Diego Comic-Con, que em 2024 havia colocado restrições comerciais à arte produzida por IA, anunciou este mês que está proibindo o conteúdo de IA completamente, supostamente em resposta a protestos de artistas.

Da mesma forma, em outubro do ano passado, a New York Comic-Con impôs uma proibição completa à venda de produtos ou conteúdo gerado por IA, com o site oficial afirmando*:

‘Produto, material ou conteúdo criado, em parte ou em parte substancial, usando ferramentas ou algoritmos de IA gerativa (“IA-gerada”) ou incorporando elementos IA-gerados, incluindo, mas não limitado a, arte visual, imagens ou gráficos, animações e/ou materiais, são proibidos de serem disponibilizados para compra na New York Comic Con.’

Mais uma vez, vemos que, em ‘parte substancial’, a redação deve reconhecer a dificuldade de identificar a criação completa de qualquer obra, nos dias de hoje. Isso reflete a proibição inicial do San Diego sobre comercializar a saída de IA, em vez de sua proibição completa posterior de conteúdo de IA.

Isso é um exemplo de ‘desplatformização’ de conteúdo de IA, na maioria dos casos (embora esse trabalho ainda possa ser usado como alimentador para plataformas comercializadas).

Além disso, a FanX Salt Lake comic convention instituiu uma proibição mais decisiva de conteúdo de IA, em setembro do ano passado, com o fundador e produtor Dan Farr comentando:

‘Se os clientes vêm e compram uma peça de arte e não percebem que a IA gerativa foi usada para criá-la, eles podem pagar muito dinheiro por isso, sem perceber que não é algo tão valioso.’

Anti-Social

Muitas comunidades online também adotaram zero tolerância em relação ao conteúdo gerado por IA. De fato, esta é uma das facetas mais públicas da intolerância à IA, e foi a frequência crescente dessas proibições que chamou minha atenção para o tópico:

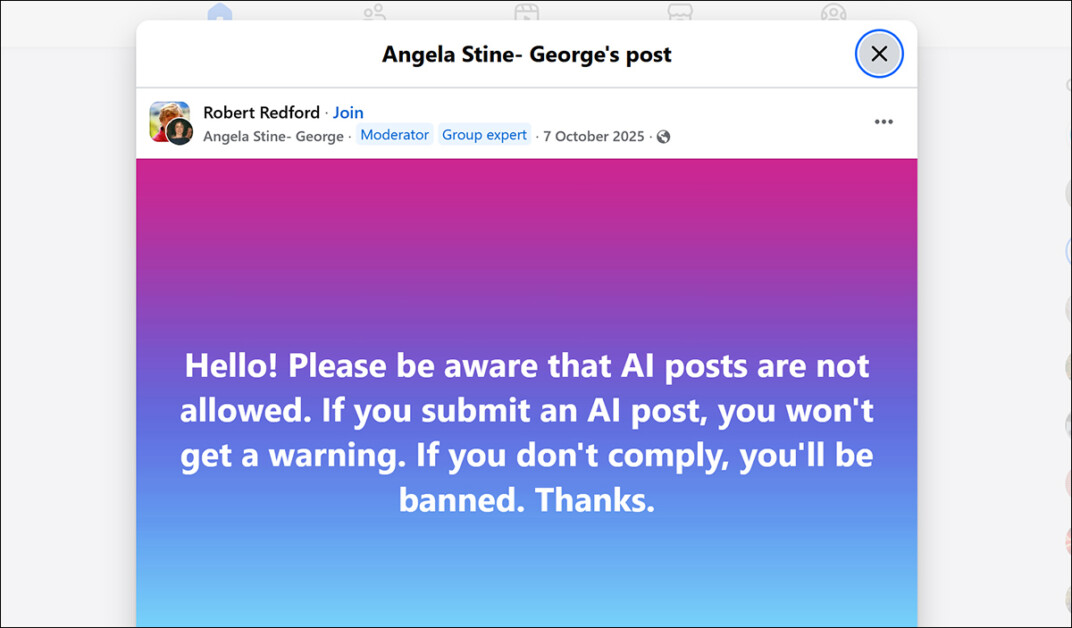

Um típico édito anti-IA do Facebook. Fonte

O Reddit foi especialmente afetado, com moderadores de vários grandes subreddits frequentemente proibindo todas as imagens, arte ou formas de texto criadas por IA (como ficção e programação), uma vez que essas postagens começaram a inundar seus fóruns e sobrecarregar os recursos de moderação humanos limitados.

Um exemplo muito precoce, de 2022, foi o subreddit r/Dune, onde cerca de 250.000 fãs votaram para proibir completamente a arte gerada por IA, após serem inundados com imagens feitas por IA. Os moderadores do sub notaram na época:

‘Reconhecemos que muitas dessas peças são legais de olhar, e a tecnologia certamente é fascinante, mas ela se qualifica tecnicamente como conteúdo de baixo esforço – especialmente quando comparada à arte original, “feita pelo homem”, que gostaríamos de priorizar em frente.’

Desde então, numerosos subreddits (do r/lego ao r/DataHoarder) proibiram da mesma forma qualquer conteúdo parcialmente feito por IA – pelo menos, como sempre, onde reconhecível.

Proibições semelhantes aparecem frequentemente no Facebook. No entanto, como a Meta, a empresa-mãe do Facebook, é uma das principais desenvolvedoras de IA do mundo, enquanto o Reddit é, em vez disso, uma fonte de dados humanos altamente contestada e procurada, essas proibições tendem a causar menos controvérsia.

Surpreendentemente, leva um tempo para a Meta acompanhar o sentimento público em torno da IA – um ano atrás, por exemplo, a empresa fez um recuo ousado de um experimento com agentes de IA publicando em linhas do tempo diversificadas, devido a reações adversas dos usuários.

Proibições de Exfiltração do ChatGPT

Uma categoria singular de ‘proibições absolutas’ de IA é a frequente proibição contra o uso do ChatGPT em ambientes corporativos ou sensíveis (e, nesse sentido, aplica-se ao mesmo à qualquer modelo de linguagem baseado em nuvem, como Claude ou Gemini).

No entanto, essas proibições são tipicamente inspiradas não por preocupações liberais em torno da exploração de dados de treinamento, mas por medos de que a OpenAI acabe armazenando, processando ou até explorando propriedade intelectual sensível da empresa divulgada durante chats de clientes.

Enquanto os departamentos jurídicos podem apoiar ou até iniciar proibições corporativas de plataformas como o ChatGPT, também é provável que considerem se o uso de dados da web aberta para treinar sistemas comerciais poderia expor a empresa ou seus clientes a responsabilidades futuras – particularmente se litígios em andamento contra a OpenAI ou entidades semelhantes resultarem em julgamentos significativos.

Exemplos de proibições ao ChatGPT† incluem uma onda de proibições reativas em 2023 da Apple, Amazon, Spotify e Wells Fargo, entre muitas outras. Naquele mesmo ano, um estudo da Cisco encontrou que 27% das organizações pesquisadas haviam instituído proibições semelhantes – não ao ChatGPT especificamente, mas ao uso geral de GenIA.

Em 2024, outro estudo encontrou que 65% das 20 principais empresas farmacêuticas haviam proibido os funcionários de usar o ChatGPT.

É claro que muitas, se não todas as empresas notadas aqui, provavelmente buscarão se beneficiar da IA de maneiras que atendam melhor aos seus interesses; e que muitas estarão mantendo ou desenvolvendo outros produtos de IA para uso interno – ou mesmo produtos de API comerciais com melhor proteção de PI do que a OpenAI pode oferecer.

Muitos governos que são grandes defensores da IA também proíbem o ChatGPT. Embora alguns deles, como Cuba e Coreia do Norte, sejam candidatos óbvios para esse tipo de proibição, a China, atualmente considerada a luz líder da revolução da IA, proíbe o ChatGPT em nível governamental – presumivelmente em favor de alternativas caseiras.

Conclusão: Sobre a Tolerância Zero

Uma preocupação sobre qualquer tendência em direção a ‘proibições absolutas’ de IA (além do desafio de identificar o conteúdo de IA) é se a proibição intransigente é realmente eficaz. Na verdade, é fácil mal entender o que ‘tolerância zero’ realmente é; o que pode alcançar; e as circunstâncias bastante limitadas em que pode alcançar seus objetivos.

Por exemplo, a cidade de Nova York, talvez mais fortemente associada ao termo ‘tolerância zero’, foi capaz de subir de seu nadir criminoso nos anos 70 e 80 por meio da aplicação gradual e contínua da teoria psicológica ‘janelas quebradas’, que afirma que, não importa quão pobre ou afluente um bairro seja, a presença de apenas uma janela quebrada tenderá a levar a mais janelas quebradas – e uma eventual escalada de outros tipos de crime mais sério, desde que a presença contínua da janela quebrada inicial sugere que as autoridades não estão observando ou não se importam.

Portanto, uma atitude de ‘tolerância zero’ em relação ao ‘crime’ de quebrar uma janela é acreditada ter benefícios upstream, desde que essa ‘entropia criminal’ nunca pode obter uma posição; dessa forma, ao atender às coisas pequenas (como lixo e janelas quebradas, que não são problemas caros para resolver), as coisas maiores (que custariam mais para resolver) cuidam de si mesmas.

Realizada, no entanto, essa teoria (às vezes criticada como racista) pode ler como autoritarismo extremo, ou até fascismo:

Clique para reproduzir. Do único filme de treinamento feito por John Ford, ‘OSS – Undercover Training’, um exemplo de tolerância zero aparentemente obsessiva em um contexto de cultura do eixo fictício da Segunda Guerra Mundial. Fonte

Em vez disso, ‘tolerância zero’ é frequentemente equiparada na mente do público a ‘ação severa, mas necessária’, como as leis intransigentes que a maioria das nações tem em relação a penalidades por prejudicar menores – ou seja, regras claras para o bem público, concretizadas em leis punitivas que inspiram pouca discussão ou compromisso.

Na verdade, a ZT foi projetada para alcançar a renovação urbana com orçamento, sugerindo recursos maiores em um ambiente público do que realmente existiam nos bastidores; não um caso de uso particularmente aplicável para colocar o gênio da IA de volta na garrafa.

E, na prática, a IA gerativa já é tão pervasiva que seus dados downstream aparentemente livres de IA podem muito bem dever algo a ela – mesmo que seja um código de vídeo melhorado por IA em um vídeo (não falso) que você fez, enviou ao YouTube e publicou em seu canal de mídia social favorito. Se a IA realmente se tornar como um ‘gás’ cultural, parece estar fadada a desafiar fronteiras claras ou soluções binárias, como uma ‘proibição de IA’.

* Minha ênfase.

† Que podemos considerar representativo dessa classe de LLM, em vez de um produto exclusivo, nesse sentido.

Publicado pela primeira vez na quinta-feira, 29 de janeiro de 2026