Ética

O Banco de Dados de Incidentes de IA Visa Tornar os Algoritmos de IA Mais Seguros

Qualquer sistema suficientemente grande terá erros, e parte da correção desses erros é ter um banco de dados deles que possa ser analisado para impactos e causas potenciais. Assim como a FDA mantém um banco de dados para reações adversas a medicamentos, ou a National Transportation Safety Board mantém um banco de dados para acidentes aéreos, o Banco de Dados de Incidentes de IA é um banco de dados intendido para catalogar falhas de sistemas de IA e ajudar os pesquisadores de IA a engenharem novos métodos para evitar essas falhas. Os criadores do Banco de Dados de Incidentes de IA (AIID) esperam que ele ajude as empresas de IA a desenvolver IA mais segura e ética.

O que é o AIID?

O AIID é o produto da organização Partnership on AI (PAI). A PAI foi inicialmente fundada em 2016 por membros de equipes de pesquisa de IA em grandes empresas de tecnologia como Facebook, Apple, Amazon, Google, IBM e Microsoft. Desde então, a organização recrutou membros de muitas outras organizações, incluindo várias organizações sem fins lucrativos. Em 2018, a PAI se propôs a criar um padrão de classificação consistente para falhas de IA. No entanto, não havia uma coleta de incidentes de IA sobre a qual basear essa classificação. Por esse motivo, a PAI criou o AIID.

De acordo com o TechTalks, o formato do AIID foi informado pela estrutura do banco de dados de acidentes aéreos mantido pela National Transportation Safety Board. Desde que os relatórios começaram a ser coletados em 1996, o sistema de transporte aéreo comercial conseguiu aumentar a segurança da indústria aérea arquivando e analisando incidentes. A esperança é que um repositório semelhante de incidentes de IA possa tornar os sistemas de IA mais seguros, éticos e confiáveis. O AIID também se inspirou no banco de dados Common Vulnerabilities and Exposures, que é um repositório de falhas de software notáveis que abrangem uma variedade de indústrias e disciplinas.

Sean McGregor é o consultor técnico líder da IBM para o Watson AI XPRIZE. McGregor também é responsável por supervisionar o desenvolvimento do banco de dados do AIID. McGregor explicou que o objetivo do AIID é, em última análise, prevenir que os sistemas de IA causem danos, ou pelo menos diminuir a gravidade de incidentes adversos. Como McGregor observou, os sistemas de aprendizado de máquina são substancialmente mais complexos e imprevisíveis do que os sistemas de software tradicionais, e, como resultado, eles não podem ser testados da mesma maneira que outros softwares. Os sistemas de aprendizado de máquina podem mudar seu comportamento de maneiras inesperadas. McGregor observa que a capacidade dos sistemas de aprendizado profundo de aprender pode significar que “falhas são mais prováveis, mais complicadas e mais perigosas” quando eles entram em um mundo não estruturado.

Mais de 1.000 Incidentes Relacionados à IA Registrados

Desde que o AIID foi criado, mais de 1.000 incidentes relacionados à IA foram registrados no banco de dados. De todos os incidentes no banco de dados, questões envolvendo a equidade de IA foram o tipo mais comum de incidente adverso. Muitos desses incidentes de equidade envolvem o uso de algoritmos de reconhecimento facial por agências governamentais. McGregor também observa que há um número crescente de incidentes envolvendo robótica sendo adicionados ao banco de dados.

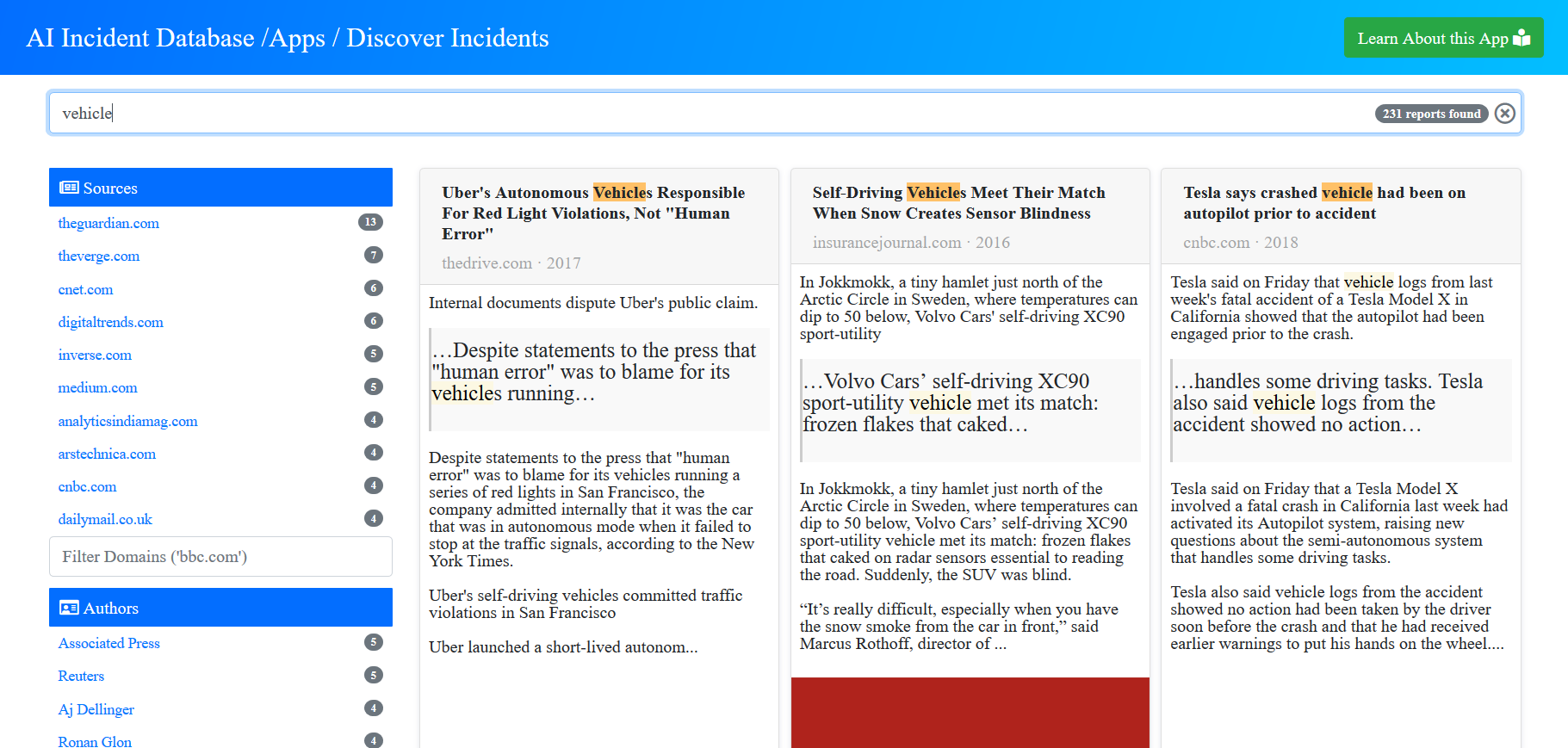

Visitantes do banco de dados podem executar consultas, pesquisando o banco de dados por critérios como palavras-chave, ID de incidente, fonte ou autor. Por exemplo, executar uma pesquisa por “Deepfake” retorna 7 relatórios, enquanto pesquisar “robôs” retorna 158 relatórios.

Um banco de dados centralizado para incidentes de mau funcionamento e operação inesperada de IA pode ajudar pesquisadores, engenheiros e éticos a supervisionar o desenvolvimento e a implantação de sistemas de IA. Gerentes de produtos em empresas de tecnologia podem usar o AIID para ver se há algum problema potencial antes de empregar sistemas de recomendação de IA, ou um engenheiro de IA pode obter uma ideia de vieses potenciais que precisam ser corrigidos ao criar o aplicativo de IA. Da mesma forma, oficiais de risco podem usar o banco de dados para determinar efeitos colaterais negativos potenciais associados a um modelo de IA, permitindo que eles planejem com antecedência e desenvolvam medidas para mitigar danos potenciais.

A arquitetura subjacente ao AIID é projetada para ser flexível, pois isso permite a criação de novas ferramentas para consultar o banco de dados e extrair insights significativos. A Partnership on AI e McGregor colaborarão para engenharem uma taxonomia flexível que possa ser usada para classificar todas as formas de incidentes de IA. A equipe espera que, uma vez que a taxonomia flexível tenha sido criada, ela possa ser combinada com um sistema automatizado que registrará automaticamente incidentes de IA.

“A comunidade de IA começou a compartilhar registros de incidentes entre si para motivar mudanças nos produtos, procedimentos de controle e programas de pesquisa”, McGregor explicou via TechTalks. “O site foi lançado publicamente em novembro, então estamos apenas começando a perceber os benefícios do sistema.”