Ângulo de Anderson

Longe dos olhos, longe do coração: enfrentando o maior problema em vídeo com IA.

O maior problema até mesmo dos melhores geradores de vídeo por IA é que eles sofrem de amnésia crônica – um desafio que uma nova pesquisa da China está agora abordando.

O maior problema, mesmo com os melhores e mais modernos sistemas de geração de vídeo por IA, é que todos eles têm amnésia crônicaSe a câmera se afastar do foco e depois voltar a focar, nunca encontrará o que estava lá no início – os personagens terão desaparecido, mudado de aparência e/ou tipo de movimento, e o fundo provavelmente também terá mudado.

Isso ocorre porque o sistema de geração baseado em difusão tem uma capacidade de rolamento limitada. janela de atençãoE porque está sempre lidando com o que consegue ver naquele momento; em uma verdadeira representação de solipsismo, o que é lado de fora O quadro é inexistente para a IA generativa – ele é literalmente descartado da memória.

Este tem Isso nunca foi um problema em computação gráfica tradicional., que pode sempre se referir e recriar com precisão um objeto, incluindo aparência e movimento, em qualquer ponto de um vídeo renderizado onde ele possa ser necessário novamente:

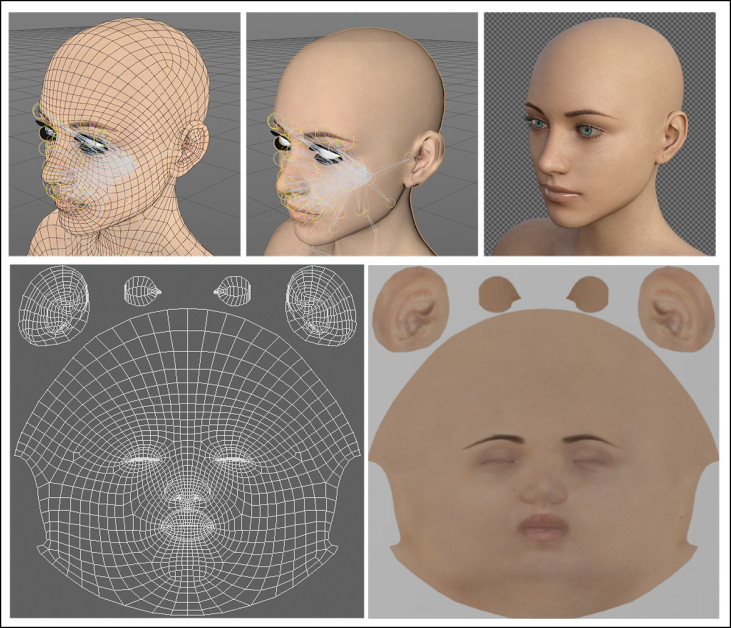

As malhas CGI tradicionais e as texturas bitmap podem sempre ser redesenhadas em uma renderização, proporcionando uma aparência consistente – um truque muito mais difícil de alcançar em abordagens de IA, porque não existe um arquivo de 'referência plana' equivalente, ou uma coleção de arquivos relacionados.

Isso ocorre porque os elementos componentes do CGI, como a malha e as texturas (veja a imagem acima), bem como os arquivos de movimento e outros comportamentos dinâmicos, podem residir discretamente no disco e serem incorporados a uma composição a qualquer momento.

Não existe um "repositório plano" como esse na IA de vídeo generativo; o mais próximo que se pode chegar dessa funcionalidade é LoRAs – Arquivos auxiliares especialmente treinados que podem ser usados em equipamentos de consumo, permitindo o uso de personagens inovadores e roupas específicas. ser 'forçado' a participar do vídeo:

Clique para jogar. O problema do solipsismo em vídeos com IA pode ser mitigado até certo ponto com o uso de LoRa, mas os resultados podem ser avassaladores.

Essa não é uma solução ideal, no entanto. Para começar, as LoRas estão vinculadas a uma versão específica exata de um modelo de base (como Wan2+, ou Vídeo Hunyuan), E precisam ser recriados sempre que o modelo base muda. Por outro lado, LoRAs tendem a distorcer os pesos do modelo de fundação, de modo que a identidade treinada do LoRa seja imposta a todos os personagens em uma cena. Além disso, afinação métodos desse tipo são muito sensível para conjuntos de dados mal curados.

Encores precisos

Agora, uma nova colaboração acadêmica/industrial da China está oferecendo a primeira solução significativa que chegou ao meu conhecimento em mais de três anos de reportagens sobre esse assunto. O método utiliza o que os pesquisadores chamam de memória híbrida para manter o personagem fora de cena e seu ambiente imediato ativos e precisos no espaço latente do modelo, de modo que, quando nosso ponto de vista retornar a eles, o efeito seja consistente:

Clique para jogar. Do site do projeto para o novo artigo, dois exemplos de caracteres (WAN) gerados por IA saindo do quadro e reentrando com precisão. fonte

É importante ressaltar que isso não é o mesmo que alcançar consistência de caráter em diferentes tomadas – algo que se alegou ter sido alcançado um ano atrás na versão Gen 4 do Runway, e que permanece an contínuo busca na literatura de pesquisa.

Na verdade, o que se resolve aqui é algo que nenhuma estrutura comercial ou experimental que eu tenha visto conseguiu alcançar – o reaparecimento visualmente consistente da aparência, movimentos e ambiente anteriores de um personagem que não aparece em cena:

Clique para jogar. Os outros dois exemplos principais são apresentados no site do projeto da nova iniciativa.

Obviamente, os princípios aqui aplicados podem ser igualmente utilizados em outros domínios, como exploração urbana, direção em primeira pessoa ou outros tipos de representações que não envolvam personagens.

Deve-se enfatizar também que essa nova abordagem não resolve nem aborda a questão que o Runway Gen4 e outras plataformas de código fechado afirmam ter resolvido, ao recriar personagens. em diferentes tomadasEm vez disso, faz o que nenhum deles conseguiu ainda: persistir um personagem e um ambiente na memória. sem precisar que permaneçam visíveis ao espectador o tempo todo..

O novo trabalho consiste em um conjunto de dados específico gerado através de Unreal Engine, além de métricas personalizadas para o problema do solipsismo* e uma estrutura generativa sob medida construída sobre WAN. Em testes contra os poucos sistemas análogos disponíveis, os autores afirmam ter obtido resultados de última geração e comentam:

'Os mecanismos de memória emergiram como uma fronteira crítica no avanço dos modelos do mundo, uma vez que a capacidade de memória determina a consistência espacial e temporal do conteúdo gerado.'

'Especificamente, trata-se da âncora cognitiva que permite ao modelo reter o contexto histórico durante mudanças de perspectiva ou extrapolações de longo prazo.'

'Sem uma memória robusta, um mundo simulado rapidamente se desfaz em quadros desconexos e caóticos.'

O processo de novo papel é intitulado Fora da vista, mas não da mente: Memória híbrida para modelos dinâmicos de mundo em vídeoe é fruto do trabalho de sete pesquisadores da Universidade de Ciência e Tecnologia de Huazhong e da Equipe Kling da Kuaishou Technology.

Forma

A prancha central da nova obra é memória híbrida, o que facilita a 'extrapolação fora do campo de visão' – a retenção de personagens e seus contextos enquanto o espectador 'desvia o olhar' (ou enquanto o próprio personagem sai de vista). Nesse cenário, a estrutura precisa executar desacoplamento espaço-temporal, onde se concentra simultaneamente na geração visível ao espectador e na existência fora de cena da personagem que agora está fora de vista.

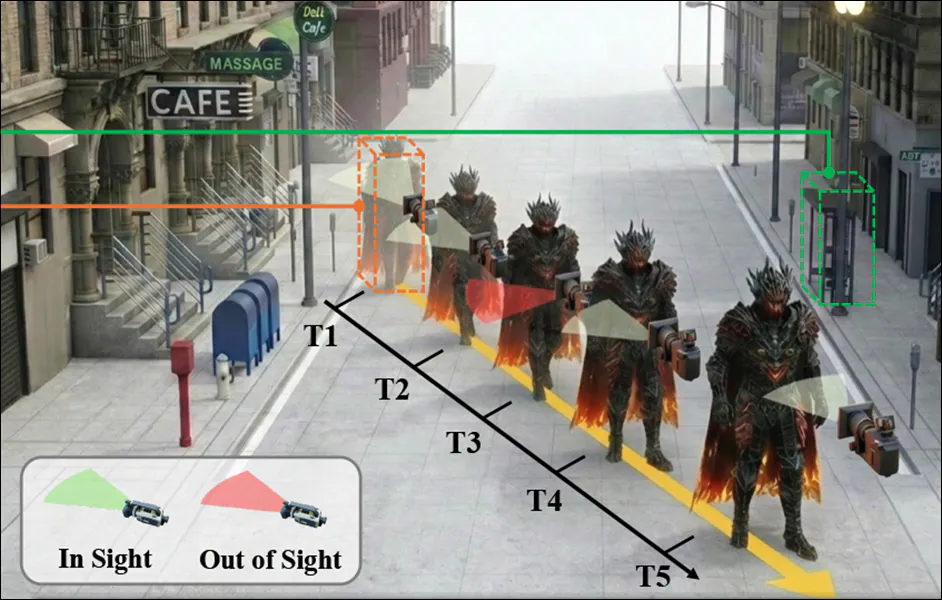

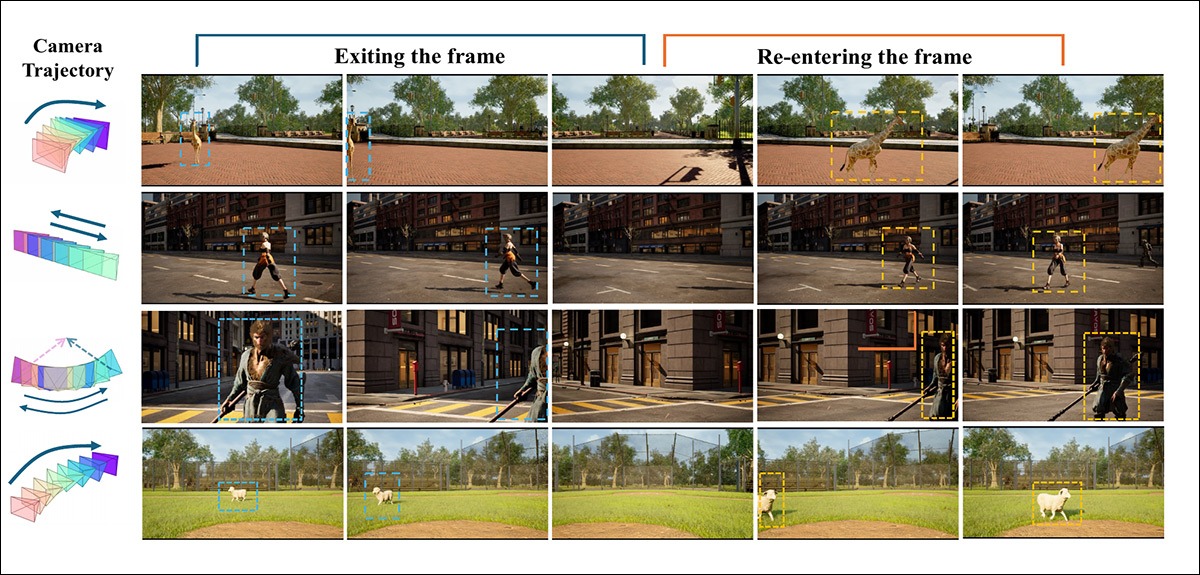

Exemplos de movimento de câmera de entrada/saída. Nesses casos, é o movimento da câmera que faz o personagem sair do quadro, mas em diversos exemplos também podemos observar o próprio personagem se impulsionando temporariamente para fora da tela. fonte

Os autores observam que na difusão latente incorporações, as características que precisam ser extraídas e utilizadas são fortemente enredada com outras características e propriedades; e que tentar extraí-las muitas vezes faz com que o sujeito 'congele' no fundo. Portanto, eles conceberam e selecionaram o HM-Mundo Conjunto de dados**, especificamente voltado para o treinamento de memória híbrida:

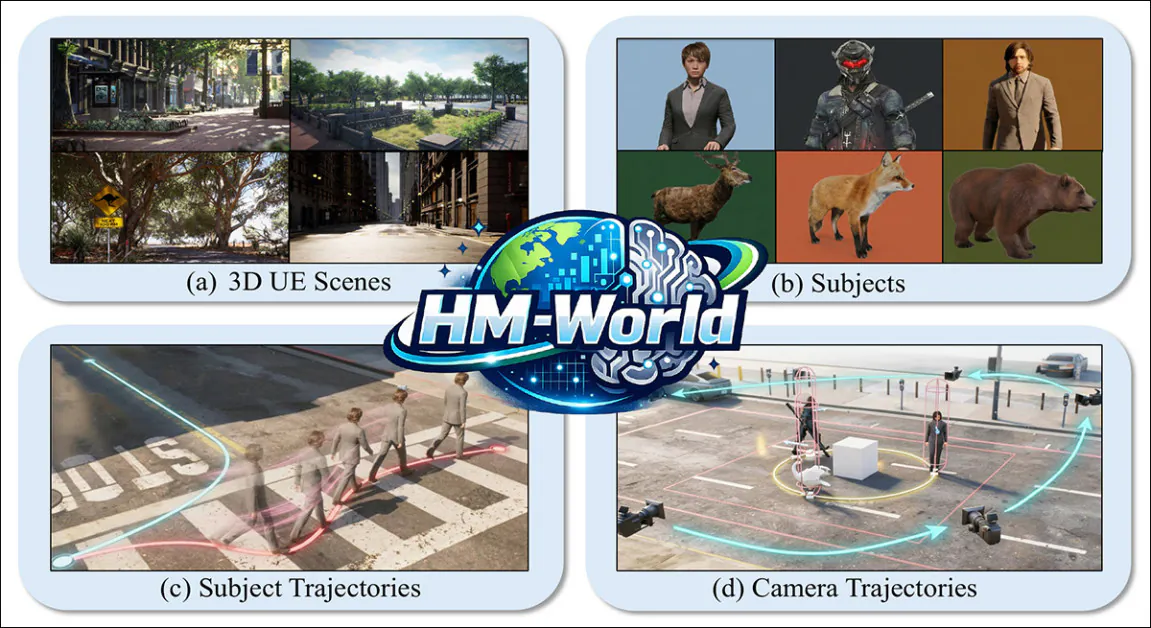

Do artigo, exemplos das quatro categorias contidas no conjunto de dados HM-World.

A coleção é construída em quatro dimensões: trajetórias do sujeito, trajetórias da câmera, Cenas e assuntos.

O processo de dados sintéticos HM-World apresenta 17 cenas e 49 personagens, incluindo pessoas de aparências diversas, bem como animais de várias espécies. Combinações desses elementos são posicionadas proceduralmente em uma cena por meio da Unreal Engine, cada uma com uma animação de movimento distinta, e então dispostas em uma trajetória selecionada aleatoriamente.

Os autores afirmam que um conjunto variado de saída-entrada Os eventos são representados no conjunto de dados, que inclui 28 trajetórias de câmera diferentes, cada uma com múltiplos pontos de partida.

A coleção final totaliza 59,225 videoclipes, cada um deles anotado pelo(a) autor(a). MiniCPM-V Modelo de linguagem multimodal de grande escala (MLLM).

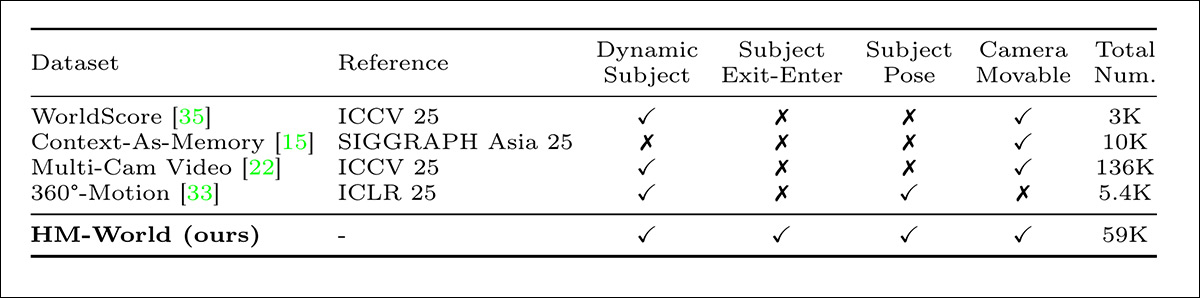

Os pesquisadores destacam as vantagens estatísticas de sua coleta de dados em comparação com conjuntos de dados anteriores. Pontuação Mundial; Contexto como memória; Vídeo multicâmera; e Movimento de 360°:

Comparação entre conjuntos de dados existentes e o conjunto de dados HM-World, onde 'Sujeito Dinâmico' indica a presença de entidades em movimento, 'Entrada e Saída do Sujeito' denota clipes contendo sujeitos saindo e reentrando no quadro, e 'Pose do Sujeito' refere-se à inclusão de poses 3D anotadas.

O caminho menos percorrido

Dados vários frames anteriores e um trajeto de câmera conhecido, a tarefa é prever as vistas futuras à medida que a perspectiva do observador muda, levando em conta os objetos que se movem independentemente e podem sair do quadro antes de retornar. Isso exige mais do que simplesmente manter um fundo estável, já que o modelo também deve reter um registro interno coerente de como cada objeto em movimento se parece e se comporta, mesmo durante períodos em que não está visível.

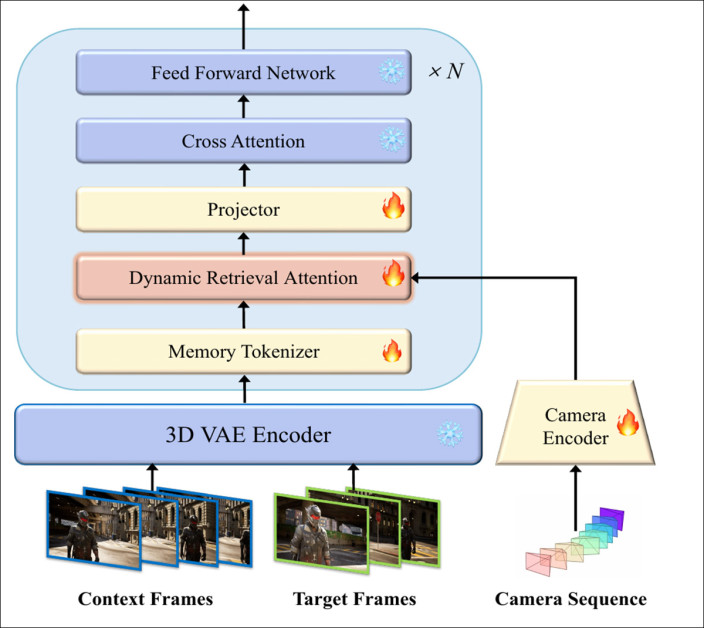

Os autores Atenção de recuperação dinâmica híbrida O método (HyDRA) aborda isso introduzindo uma via de memória dedicada que separa os sujeitos dinâmicos da representação estática da cena, permitindo que eles persistam ao longo do tempo e reapareçam com aparência e movimento consistentes:

Esquema conceitual do modelo HyDRA.

HyDRA é construído sobre Wan2.1-T2V-1.3B, com o núcleo do pipeline de difusão praticamente intacto, enquanto se introduz um pipeline modificado transformador Bloco que incorpora atenção de recuperação dinâmica. Isso permite que o modelo recupere seletivamente pistas de movimento e aparência de quadros anteriores, em vez de depender de um contexto fixo ou local.

Este processo utiliza uma adaptação. Correspondência de fluxo objetivo de treinamento em vez de padrão perda de difusão.

Para manter as cenas alinhadas com o movimento da câmera, as trajetórias da câmera são inseridas como um sinal de condicionamento explícito, com a pose de cada quadro definida por rotação e translação, e então convertida em uma representação compacta que captura como o ponto de vista evolui ao longo do tempo.

Em linha com o anterior (Kling) ReCamMaster iniciativa, o resultado é então analisado pelo codificador da câmera, implementado como um Perceptron de várias camadas, depois transmitido e adicionado ao Transformador de difusão Características que permitem ao modelo manter o posicionamento consistente dos objetos à medida que a câmera se move.

tokenization

Os sinais latentes de difusão bruta misturam o movimento do sujeito, a aparência e o fundo em uma única representação complexa, e tentar recuperá-los diretamente desse espaço corre o risco de introduzir um contexto irrelevante ou fazer com que os sujeitos em movimento se "misturem" à paisagem.

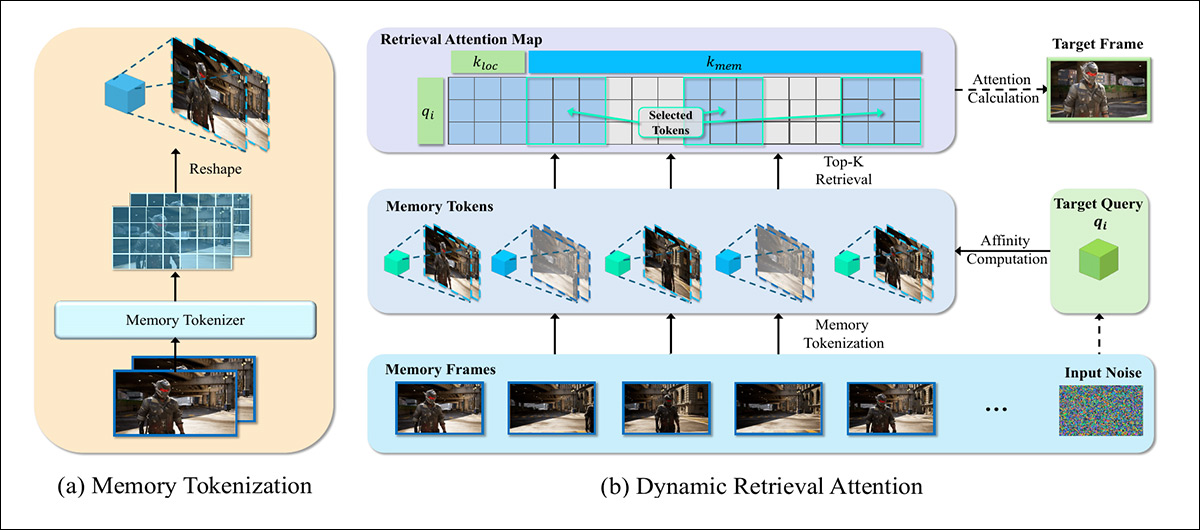

O HyDRA resolve isso com um Tokenizador de Memória baseado em convolução 3D que processa espaço e tempo simultaneamente – em vez de encaminhar históricos latentes completos, ele os comprime em tokens de memória compactos e sensíveis ao movimento, que preservam a aparência e os movimentos dos indivíduos:

Visão geral do HyDRA. À esquerda, o Tokenizador de Memória converte frames anteriores em tokens de memória compactos e sensíveis ao movimento; à direita, a Atenção de Recuperação Dinâmica avalia a consulta atual em relação a esses tokens, recupera os mais relevantes e os utiliza para restaurar a aparência e o movimento consistentes no frame gerado.

Esses tokens formam uma memória híbrida estruturada que filtra o ruído enquanto retém a dinâmica de longo alcance. Passados para o módulo de Atenção de Recuperação Dinâmica, eles permitem que o modelo recupere seletivamente objetos fora da tela, para que reapareçam com aparência, movimento e contexto consistentes.

Atenção de recuperação dinâmica

O mecanismo de memória dupla do HyDRA também utiliza atenção de recuperação dinâmica desempenhando um papel distinto, porém complementar, dentro da estrutura.

A tokenização de memória comprime representações latentes passadas em tokens estruturados e sensíveis ao movimento, que separam os sujeitos dinâmicos do conteúdo estático da cena, reduzindo o entrelaçamento que frequentemente faz com que os sujeitos se misturem ao fundo. Esses tokens formam um banco de memória persistente em vez de um histórico completo de quadros.

A Atenção de Recuperação Dinâmica opera sobre esse banco de dados durante a geração, avaliando a consulta atual em relação aos tokens armazenados e recuperando seletivamente aqueles mais relevantes para o quadro em evolução. Isso permite que os objetos fora da tela continuem sua evolução latente (ou seja, continuem andando, correndo, quando você não pode vê-los) e reapareçam com aparência e movimento consistentes quando retornarem ao campo de visão, em vez de serem reiniciados ou sofrerem degradação.

Dados e testes

Nos testes, o sistema HyDRA baseado em WAN codificou e reduziu a resolução de 77 quadros de contexto antes de analisá-los com um Autoencoder Variacional 3D (VAE), enquanto o tokenizador de memória mencionado anteriormente usava Convolução 3D em tamanho do kernel de 2x4x4.

O modelo foi treinado no HW-World por 10,000 iterações em 32 GPUs (número não especificado), em um tamanho do batch de 32.

Um número excepcionalmente alto de métricas foi usado nos testes: além da usual Relação Sinal-Ruído de Pico (PSNR, na sigla em inglês)PSNR), Índice de Similaridade Estrutural (SSIM), e Métricas de Similaridade Perceptual Aprendidas (LPIPS), os autores também empregaram consistência do assunto e consistência de fundo do VBench suíte, para avaliar a coerência em nível de quadro.

Além disso, eles desenvolveram uma métrica personalizada intitulada Consistência dinâmica do assunto (DSC), que usa caixas delimitadoras de YOLO V11, para criar regiões recortadas com objetos em movimento, das quais foram extraídas características semânticas e, em seguida, calculadas suas similaridades.

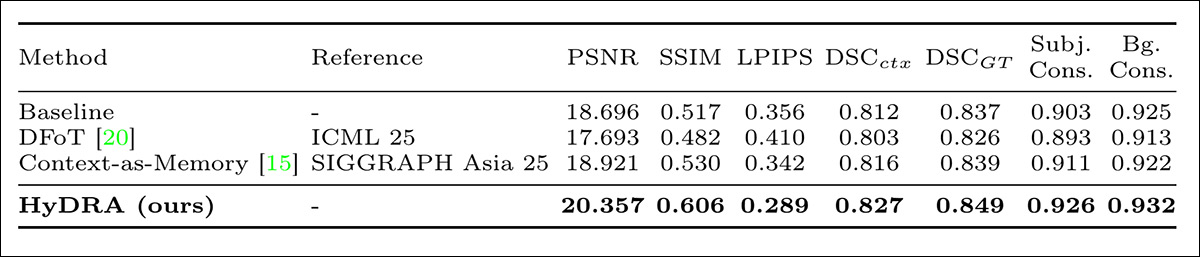

HyDRA foi colocada contra Transformador de força de difusão (DFoT), e Contexto como memória, sobre um modelo base Wan2.1-T2V-1.3B equipado com um codificador de câmera (para representar o ponto de vista subjetivo comum a todos os clipes). Todos os modelos foram treinados no HW-World, e WorldPlay também foi utilizada como uma coleção de testes secundários, sem necessidade de disparos prévios:

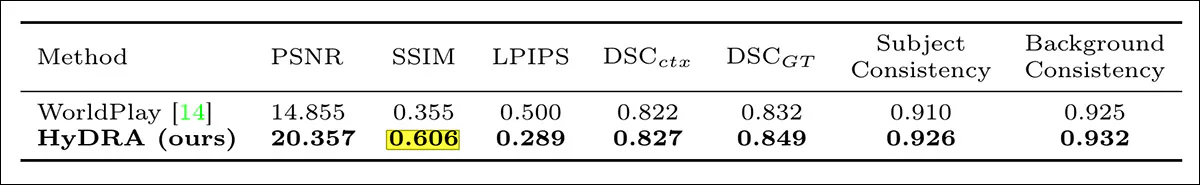

Nas comparações quantitativas iniciais, o HyDRA superou todas as linhas de base, elevando o PSNR de 18.696 para 20.357 e o SSIM de 0.517 para 0.606. Também alcançou os maiores índices de Dice contextual e de verdade fundamental, 0.827 e 0.849, respectivamente, com a consistência de sujeito e de fundo atingindo 0.926 e 0.932.

Resultados da comparação quantitativa inicial com abordagens anteriores.

O DFoT alcançou um PSNR de 17.693 e o Context as Memory, 18.921, com os ganhos atribuídos à tokenização da memória combinada com a atenção de recuperação dinâmica:

Comparação quantitativa que coloca o HyDRA em contato com o estado da arte atual.

Com relação aos testes contra o WorldPlay, os autores afirmam:

Nosso método supera o WorldPlay em todas as métricas, com uma diferença notável de PSNR de 5.502. Embora o WorldPlay apresente desempenho inferior em métricas referenciadas à teoria de Green (por exemplo, PSNR de 14.855, DSCGT de 0.832) devido à diferença na distribuição de domínio e à falta de ajuste fino específico, ele demonstra robustez notável em métricas referenciadas ao contexto, atingindo um DSCctx de 0.822.

'Essa observação não apenas confirma que modelos extensivamente treinados possuem uma consistência híbrida razoável, mas também valida indiretamente a racionalidade das métricas DSC propostas para refletir a consistência dinâmica do sujeito.'

'Em última análise, estes resultados impressionantes destacam as capacidades excepcionais do nosso modelo, demonstrando a sua superioridade mesmo em relação a modelos comerciais já estabelecidos.'

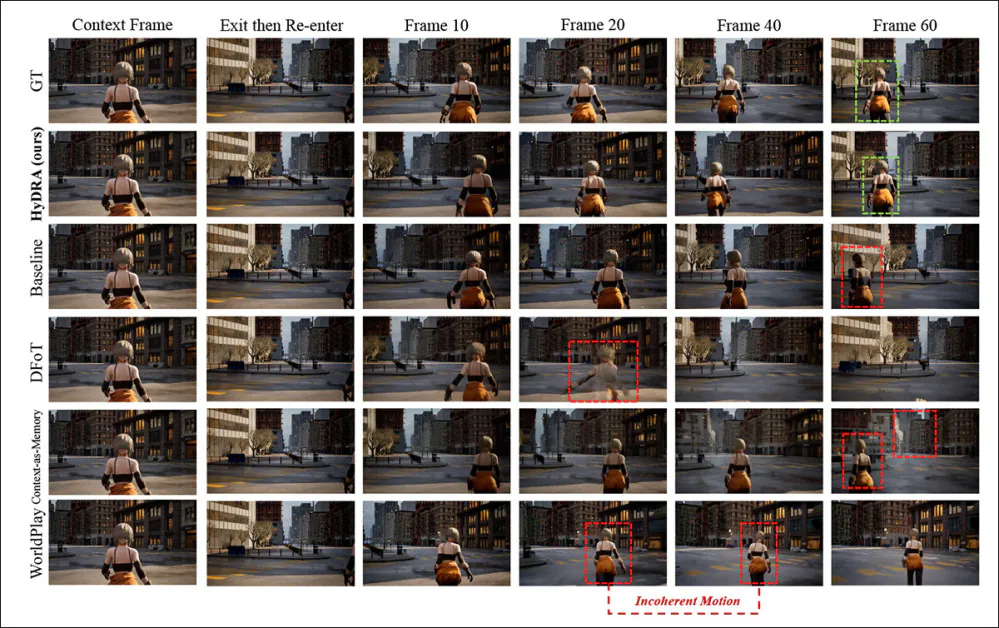

O artigo oferece uma representação estática das comparações qualitativas realizadas nos testes:

Comparação qualitativa da saída e reentrada sob movimento da câmera. Os autores afirmam que o HyDRA preserva a identidade, a pose e a continuidade do movimento do sujeito após sair e retornar ao enquadramento, correspondendo de perto à verdade fundamental, enquanto os métodos concorrentes exibem deriva, movimento incoerente ou degradação do sujeito, destacados em vermelho (recuperações consistentes são marcadas em verde).

Destes resultados, os autores comentam:

Em casos de eventos complexos de entrada e saída, a linha de base e o Contexto como Memória exibem distorção severa do sujeito e incoerência de movimento. O DFoT falha em manter a integridade do sujeito, levando ao seu desaparecimento completo. Embora o WorldPlay consiga preservar a consistência da aparência do sujeito, ele sofre com movimentos trêmulos e ações não naturais.

'Em contraste, nosso método mantém com sucesso a consistência híbrida, preservando tanto a identidade do sujeito quanto a coerência do movimento após o sujeito retornar ao quadro.'

Mais resultados podem ser vistos em formato de vídeo em o site suplementar, dos quais os quatro primeiros exemplos foram reunidos (por nós) no vídeo abaixo:

Clique para jogar. Quatro dos seis resultados dos testes foram obtidos no local do projeto. fonte

Conclusão

Embora qualquer tentativa de abordar um dos maiores problemas da geração de vídeo por IA seja bem-vinda, parece-me inevitável que a solução ideal para problemas de entrada/saída desse tipo acabe sendo, como aconteceu com a computação gráfica, na forma de materiais de referência distintos que possam ser editados separadamente e trazidos para o espaço de um compositor.

Essa questão de tentar manter uma incorporação viva em um ad hoc E a abordagem improvisada parece exaustiva, além de não oferecer uma solução clara para a consistência intra-plano atualmente disponível em diversos portais de caixa preta, como o Runway. Se uma tomada subsequente exigir acesso ao espaço latente da tomada anterior, por que não fazer com que ambas as instâncias insiram um embedding de personagem discreto e separado?

* Ninguém mais deu um nome a isso, e a discussão é difícil sem termos comuns.

**Atualmente, a página do projeto indica que o lançamento está "em breve".

Primeira publicação sexta-feira, 27 de março de 2026