Ângulo de Anderson

Procurando ‘Corujas e Lagartos’ no Público de um Anunciante

Desde que o setor de publicidade online é estimado ter gasto $740,3 bilhões USD em 2023, é fácil entender por que as empresas de publicidade investem recursos consideráveis nessa particular vertente de pesquisa de visão computacional.

Embora seja insular e protegida, a indústria ocasionalmente publica estudos que sugerem um trabalho mais avançado e proprietário em reconhecimento facial e de direção do olhar – incluindo reconhecimento de idade, central para estatísticas de análise demográfica:

Estimativa de idade em um contexto de publicidade in-the-wild é de interesse para anunciantes que podem estar direcionando uma demografia específica. Neste exemplo experimental de estimativa automática de idade facial, a idade do performer Bob Dylan é rastreada ao longo dos anos. Fonte: https://arxiv.org/pdf/1906.03625

Esses estudos, que raramente aparecem em repositórios públicos como o Arxiv, usam participantes recrutados legitimamente como base para análise impulsionada por IA que visa determinar até que ponto e de que forma o espectador está engajado com um anúncio.

O Histograma de Gradientes Orientados (HoG) do Dlib é frequentemente usado em sistemas de estimativa facial. Fonte: https://www.computer.org/csdl/journal/ta/2017/02/07475863/13rRUNvyarN

Instinto Animal

Nesse sentido, naturalmente, a indústria de publicidade está interessada em determinar falsos positivos (ocasiões em que um sistema analítico interpreta mal as ações de um sujeito) e em estabelecer critérios claros para quando a pessoa que assiste aos comerciais não está totalmente engajada com o conteúdo.

No que diz respeito à publicidade baseada em tela, os estudos tendem a se concentrar em dois problemas em dois ambientes. Os ambientes são ‘desktop’ ou ‘móvel’, cada um com características particulares que precisam de soluções de rastreamento personalizadas; e os problemas – do ponto de vista do anunciante – são representados por comportamento de coruja e lagarto – a tendência dos espectadores a não prestar atenção total a um anúncio que está diante deles.

Exemplos de comportamento de ‘coruja’ e ‘lagarto’ em um sujeito de um projeto de pesquisa de publicidade. Fonte: https://arxiv.org/pdf/1508.04028

Se você está olhando para longe do anúncio pretendido com a cabeça toda, isso é ‘comportamento de coruja’; se a pose da cabeça é estática, mas os olhos estão vagando para longe da tela, isso é ‘comportamento de lagarto’. Em termos de análise e teste de novos anúncios em condições controladas, essas são ações essenciais para um sistema capturar.

Um novo artigo da SmartEye’s Affectiva aborda essas questões, oferecendo uma arquitetura que aproveita várias estruturas existentes para fornecer um conjunto de recursos combinado e concatenado em todas as condições e reações possíveis – e para ser capaz de dizer se um espectador está entediado, engajado ou de alguma forma remoto do conteúdo que o anunciante deseja que ele assista.

Exemplos de verdadeiros e falsos positivos detectados pelo novo sistema de atenção para vários sinais de distração, mostrados separadamente para dispositivos desktop e móvel. Fonte: https://arxiv.org/pdf/2504.06237

Os autores afirmam*:

‘Limitada pesquisa se aprofundou em monitorar a atenção durante anúncios online. Embora esses estudos se concentrassem em estimar a pose da cabeça ou direção do olhar para identificar instâncias de olhar desviado, eles desprezam parâmetros críticos, como tipo de dispositivo (desktop ou móvel), posicionamento da câmera em relação à tela e tamanho da tela. Esses fatores influenciam significativamente a detecção de atenção.

‘Neste artigo, propomos uma arquitetura para detecção de atenção que abrange a detecção de vários distraídos, incluindo ambos os comportamentos de coruja e lagarto de olhar para fora da tela, falar, sonolência (por meio de bocejo e fechamento prolongado dos olhos) e deixar a tela sem atenção.

‘Ao contrário das abordagens anteriores, nosso método integra recursos específicos do dispositivo, como tipo de dispositivo, posicionamento da câmera, tamanho da tela (para desktops) e orientação da câmera (para dispositivos móveis) com a estimativa bruta de olhar para melhorar a precisão da detecção de atenção.’

O novo trabalho é intitulado Monitorando a Atenção do Espectador Durante Anúncios Online, e vem de quatro pesquisadores da Affectiva.

Método e Dados

Em grande parte devido à natureza secreta e de código fechado desses sistemas, o novo artigo não compara a abordagem dos autores diretamente com rivais, mas apresenta seus resultados exclusivamente como estudos de ablação; nem o artigo segue, em geral, o formato usual da literatura de Visão Computacional. Portanto, vamos examinar a pesquisa como ela é apresentada.

Os autores enfatizam que apenas um número limitado de estudos abordou a detecção de atenção especificamente no contexto de anúncios online. No AFFDEX SDK, que oferece reconhecimento facial em tempo real, a atenção é inferida apenas pela pose da cabeça, com participantes rotulados como desatentos se o ângulo da cabeça ultrapassar um limiar definido.

Um exemplo do AFFDEX SDK, um sistema da Affectiva que depende da pose da cabeça como indicador de atenção. Fonte: https://www.youtube.com/watch?v=c2CWb5jHmbY

Nesse contexto, um dos critérios que definem ‘desatenção’ é quando uma pessoa fala por mais de um segundo (o que poderia ser um comentário momentâneo ou até mesmo uma tosse).

Desde que o ambiente controlado não grava ou analisa áudio, a fala é inferida observando o movimento interno de marcos faciais estimados. Portanto, para detectar fala sem áudio, os autores criaram um conjunto de dados baseado inteiramente em entrada visual, extraído de seu repositório interno, e dividido em duas partes: a primeira contém aproximadamente 5.500 vídeos, cada um rotulado manualmente por três anotadores como falando ou não falando (desses, 4.400 foram usados para treinamento e validação, e 1.100 para teste).

A segunda compreende 16.000 sessões rotuladas automaticamente com base no tipo de sessão: 10.500 apresentam participantes assistindo anúncios em silêncio, e 5.500 mostram participantes expressando opiniões sobre marcas.

Conjuntos de Dados: Olhar

Os autores usaram quatro conjuntos de dados para alimentar e avaliar o sistema de detecção de atenção: três se concentrando individualmente no comportamento do olhar, fala e bocejo; e um quarto extraído de sessões de teste de anúncios reais contendo uma mistura de tipos de distração.

Devido aos requisitos específicos do trabalho, conjuntos de dados personalizados foram criados para cada uma dessas categorias. Todos os conjuntos de dados curados foram extraídos de um repositório proprietário com milhões de sessões gravadas de participantes assistindo anúncios em ambientes de casa ou trabalho, usando um setup baseado na web, com consentimento informado – e devido às limitações desses acordos de consentimento, os autores afirmam que os conjuntos de dados para o novo trabalho não podem ser tornados publicamente disponíveis.

Para construir o conjunto de dados de olhar, os participantes foram solicitados a seguir um ponto em movimento em vários pontos da tela, incluindo suas bordas, e então a olhar para longe da tela em quatro direções (para cima, para baixo, para a esquerda e para a direita) com a sequência repetida três vezes. Dessa forma, a relação entre captura e cobertura foi estabelecida:

Telas mostrando o estímulo de vídeo de olhar em (a) dispositivos desktop e (b) dispositivos móveis. Os primeiros e terceiros quadros exibem instruções para seguir um ponto em movimento, enquanto os segundos e quartos instruem os participantes a olhar para longe da tela.

Os segmentos do ponto em movimento foram rotulados como atentos, e os segmentos fora da tela como desatentos, produzindo um conjunto de dados rotulado de ambos os exemplos positivos e negativos.

Cada vídeo durou aproximadamente 160 segundos, com versões separadas criadas para plataformas desktop e móvel, cada uma com resoluções de 1920×1080 e 608×1080, respectivamente.

Um total de 609 vídeos foi coletado, compreendendo 322 desktop e 287 gravações móveis. Rótulos foram aplicados automaticamente com base no conteúdo do vídeo, e o conjunto de dados dividiu em 158 amostras de treinamento e 451 para teste.

Conjuntos de Dados: Fala

Nesse contexto, um dos critérios que definem ‘desatenção’ é quando uma pessoa fala por mais de um segundo (o que poderia ser um comentário momentâneo ou até mesmo uma tosse).

Desde que o ambiente controlado não grava ou analisa áudio, a fala é inferida observando o movimento interno de marcos faciais estimados. Portanto, para detectar fala sem áudio, os autores criaram um conjunto de dados baseado inteiramente em entrada visual, extraído de seu repositório interno, e dividido em duas partes: a primeira contém aproximadamente 5.500 vídeos, cada um rotulado manualmente por três anotadores como falando ou não falando (desses, 4.400 foram usados para treinamento e validação, e 1.100 para teste).

A segunda compreende 16.000 sessões rotuladas automaticamente com base no tipo de sessão: 10.500 apresentam participantes assistindo anúncios em silêncio, e 5.500 mostram participantes expressando opiniões sobre marcas.

Conjuntos de Dados: Bocejo

Embora alguns conjuntos de dados de bocejo existam, incluindo YawDD e Driver Fatigue, os autores afirmam que nenhum é adequado para cenários de teste de anúncios, pois eles apresentam bocejos simulados ou contêm contorções faciais que poderiam ser confundidas com medo ou outras ações não bocejo.

Portanto, os autores usaram 735 vídeos de sua coleção interna, escolhendo sessões que provavelmente contivessem um abertura da mandíbula que durou mais de um segundo. Cada vídeo foi rotulado manualmente por três anotadores como ativo ou inativo bocejo. Apenas 2,6 por cento dos quadros continham bocejos ativos, sublinhando o desequilíbrio de classes, e o conjunto de dados foi dividido em 670 vídeos de treinamento e 65 para teste.

Conjuntos de Dados: Distração

O conjunto de dados de distração também foi extraído do repositório de teste de anúncios dos autores, onde os participantes assistiram a anúncios reais sem tarefas atribuídas. Um total de 520 sessões (193 em ambientes móveis e 327 em ambientes desktop) foi selecionado aleatoriamente e rotulado manualmente por três anotadores como atentos ou desatentos.

O comportamento desatento incluiu olhar para fora da tela, falar, sonolência e tela sem atenção. As sessões abrangem regiões diversas em todo o mundo, com gravações de desktop mais comuns devido ao posicionamento flexível da webcam.

Modelos de Atenção

O modelo de atenção proposto processa recursos visuais de baixo nível, a saber, expressões faciais; pose da cabeça; e direção do olhar – extraídos por meio das estruturas mencionadas anteriormente, AFFDEX 2.0 e SmartEye SDK.

Esses são então convertidos em indicadores de alto nível, com cada distraído tratado por um classificador binário separado treinado em seu próprio conjunto de dados para otimização e avaliação independentes.

Esquema para o sistema de monitoramento proposto.

O modelo de olhar determina se o espectador está olhando para ou para longe da tela usando coordenadas de olhar normalizadas, com calibração separada para dispositivos desktop e móveis. Auxiliando esse processo está uma Máquina de Vetor de Suporte (SVM) linear, treinada em recursos espaciais e temporais, que incorpora uma janela de memória para suavizar mudanças rápidas de olhar.

Para detectar fala sem áudio, o sistema usou regiões da boca recortadas e um 3D-CNN treinado em segmentos de vídeo conversacionais e não conversacionais. Rótulos foram atribuídos com base no tipo de sessão, com suavização temporal reduzindo os falsos positivos que podem resultar de movimentos breves da boca.

Bocejo foi detectado usando recortes de imagem de rosto completo, para capturar uma motion facial mais ampla, com um 3D-CNN treinado em quadros rotulados manualmente (embora a tarefa tenha sido complicada pela baixa frequência do bocejo em visualização natural e por sua semelhança com outras expressões).

Tela abandonada foi identificada por meio da ausência de um rosto ou pose de cabeça extrema, com previsões feitas por uma árvore de decisão.

Estado de atenção final foi determinado usando uma regra fixa: se qualquer módulo detectasse desatenção, o espectador era marcado como desatento – uma abordagem que prioriza sensibilidade e ajustada separadamente para contextos desktop e móvel.

Testes

Como mencionado anteriormente, os testes seguem um método ablativo, onde componentes são removidos e o efeito no resultado é observado.

Diferentes categorias de desatenção percebida identificadas no estudo.

O modelo de olhar identificou o comportamento fora da tela por meio de três etapas principais: normalizando as estimativas brutas de olhar, ajustando a saída e estimando o tamanho da tela para dispositivos desktop.

Para entender a importância de cada componente, os autores removeram cada um deles individualmente e avaliaram o desempenho em 226 vídeos de desktop e 225 vídeos de dispositivos móveis extraídos de dois conjuntos de dados. Os resultados, medidos por G-mean e F1 scores, são mostrados abaixo:

Resultados indicando o desempenho do modelo de olhar completo, ao lado de versões com etapas de processamento individuais removidas.

Em todos os casos, o desempenho diminuiu quando uma etapa foi omitida. A normalização provou ser especialmente valiosa em desktops, onde o posicionamento da câmera varia mais do que em dispositivos móveis.

O estudo também avaliou como os recursos visuais previram a orientação da câmera móvel: localização do rosto, pose da cabeça e direção do olhar obtiveram 0,75, 0,74 e 0,60, enquanto a combinação delas atingiu 0,91, destacando – os autores afirmam – a vantagem de integrar várias pistas.

O modelo de fala, treinado na distância labial vertical, alcançou um ROC-AUC de 0,97 no conjunto de teste rotulado manualmente, e 0,96 no conjunto maior rotulado automaticamente, indicando desempenho consistente em ambos.

O modelo de bocejo atingiu um ROC-AUC de 96,6 por cento usando apenas a razão da boca, o que melhorou para 97,5 por cento quando combinado com previsões de unidades de ação do AFFDEX 2.0.

O modelo de tela abandonada classificou momentos como desatentos quando tanto o AFFDEX 2.0 quanto o SmartEye falharam em detectar um rosto por mais de um segundo. Para avaliar a validade disso, os autores rotularam manualmente todos os eventos de “sem rosto” no conjunto de dados de distração real, identificando a causa subjacente de cada ativação. Casos ambíguos (como obstrução da câmera ou distorção de vídeo) foram excluídos da análise.

Como mostrado na tabela de resultados abaixo, apenas 27 por cento das ativações “sem rosto” foram devidas a usuários que fisicamente deixaram a tela.

Diversas razões obtidas para as quais um rosto não foi encontrado, em certas instâncias.

O artigo afirma:

‘Apesar de telas abandonadas constituírem apenas 27% das instâncias que acionam o sinal de “sem rosto”, ele foi acionado por outras razões indicativas de desatenção, como participantes que olham para fora da tela com um ângulo extremo, fazem movimento excessivo ou ocultam significativamente o rosto com um objeto/mão.’

Na última das avaliações quantitativas, os autores avaliaram como a adição progressiva de diferentes sinais de distração – olhar para fora da tela (por meio de olhar e pose da cabeça), sonolência, fala e telas abandonadas – afetou o desempenho geral do modelo de atenção.

Os testes foram realizados em dois conjuntos de dados: o conjunto de dados de distração real e um subconjunto do conjunto de dados de olhar. As medidas de desempenho usadas foram G-mean e F1 scores (embora sonolência e fala tenham sido excluídas da análise do conjunto de dados de olhar, devido à sua limitada relevância nesse contexto).

Como mostrado abaixo, a detecção de atenção melhorou consistentemente à medida que mais tipos de distração foram adicionados, com olhar para fora da tela fornecendo a base mais forte.

O efeito de adicionar diversos sinais de distração à arquitetura.

Desses resultados, o artigo afirma:

‘De os resultados, podemos concluir em primeiro lugar que a integração de todos os sinais de distração contribui para a detecção aprimorada de atenção.

‘Em segundo lugar, a melhoria na detecção de atenção é consistente em ambos os dispositivos desktop e móvel. Em terceiro lugar, as sessões móveis no conjunto de dados real mostram movimentos significativos de cabeça ao olhar para longe, que são facilmente detectados, levando a um desempenho melhor em dispositivos móveis em comparação com desktops. Em quarto lugar, adicionar o sinal de sonolência tem uma melhoria relativamente leve em comparação com outros sinais.

‘Finalmente, o sinal de tela abandonada tem uma melhoria relativamente maior em dispositivos móveis em comparação com desktops, pois dispositivos móveis podem ser facilmente deixados sem atenção.’

Os autores também compararam seu modelo com o AFFDEX 1.0, um sistema anterior usado em testes de anúncios – e mesmo a detecção de olhar baseada na cabeça do modelo atual superou o AFFDEX 1.0 em ambos os tipos de dispositivos:

‘Isso é um resultado da incorporação de movimentos de cabeça em ambas as direções de yaw e pitch, bem como da normalização da pose da cabeça para dar conta de mudanças menores. Os movimentos de cabeça pronunciados no conjunto de dados móvel real fizeram com que nosso modelo de cabeça se saísse similarmente ao AFFDEX 1.0.’

Os autores fecham o artigo com uma rodada de testes qualitativos (talvez um pouco perfunctória).

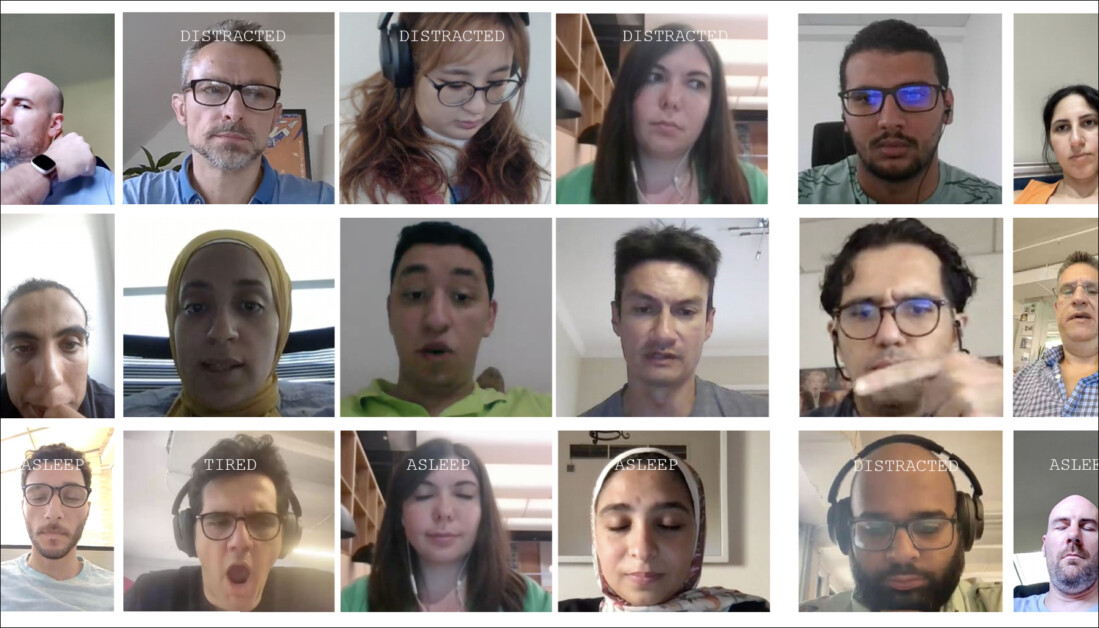

Saídas de exemplo do modelo de atenção em dispositivos desktop e móvel, com cada linha apresentando exemplos de verdadeiros e falsos positivos para diferentes tipos de distração.

Os autores afirmam:

‘Os resultados indicam que nosso modelo detecta efetivamente vários distraídos em ambientes não controlados. No entanto, ele pode ocasionalmente produzir falsos positivos em certos casos de bordo, como inclinação extrema da cabeça enquanto mantém o olhar na tela, algumas oclusões da boca, olhos excessivamente turvos ou imagens faciais fortemente escurecidas. ‘

Conclusão

Embora os resultados representem um avanço medido, mas significativo, sobre trabalhos anteriores, o valor mais profundo do estudo reside no vislumbre que oferece da persistente busca por acessar o estado interno do espectador. Embora os dados tenham sido coletados com consentimento, a metodologia aponta para futuras estruturas que poderiam se estender além de ambientes de pesquisa de mercado estruturados.

Essa conclusão um pouco paranoica é apenas reforçada pela natureza fechada, restrita e protegida com ciúme dessa particular vertente de pesquisa.

* Minha conversão das citações em linha dos autores em links.

Publicado pela primeira vez na quarta-feira, 9 de abril de 2025