Ângulo de Anderson

Consultas Descorteses Podem Aumentar os Custos do ChatGPT Empresarial

As respostas do ChatGPT consomem mais tokens quando você é rude com ele, aumentando sua conta empresarial; mas dizer ‘por favor’ pode reduzir seus custos.

Diz-se que a cortesia não custa nada; mas o que custa a descortesia? No que diz respeito ao pagamento do ChatGPT, bastante, de acordo com um novo estudo dos EUA. O novo artigo, da Universidade de Iowa, descobre que ser rude com o ChatGPT aumenta o custo das respostas – mesmo que as respostas sejam as mesmas para consultas corteses e não corteses.

Os autores afirmam:

‘O preço dos tokens de saída é de $12 por 1 milhão de tokens de saída para o GPT4. Descobrimos que prompts não corteses levam a mais de 14 tokens extras, o que é equivalente a um custo extra de $0,000168 por prompt em média. As consultas diárias à API do OpenAI excedem 2,2 bilhões.

‘Em comparação com um cenário em que todos os prompts são corteses, quando, em vez disso, os prompts são não corteses, isso gera uma receita adicional de $369 mil por dia, simplesmente devido ao aumento de tokens que os prompts não corteses geram no resultado.’

Embora o resultado seja interessante em si mesmo, os autores enfatizam que esse comportamento incomum pode indicar uma variedade de peculiaridades desconhecidas na configuração humano/AI, algumas ou todas as quais também podem ter implicações financeiras. Quanto à razão pela qual a descortesia custa aos clientes tokens adicionais, os autores não especulam.

Para estabelecer a veracidade do sintoma, eles reescreveram prompts reais do ChatGPT, alternando os valores de cortesia, mantendo o significado. Ambas as versões foram alimentadas no modelo GPT-4-Turbo, e as diferenças foram medidas no número de tokens de saída usados para as respostas.

As conclusões tiradas são um contraste marcante com os eventos de manchete no início do ano, onde Sam Altman reclamou que a cortesia estava custando à OpenAI potencialmente ‘dezenas de milhões’ de dólares em termos de processamento de tokens relacionados à cortesia (como ‘por favor’). Pesquisas publicadas no mesmo período também indicaram que a cortesia não era de valor em termos de obter respostas melhores (embora não tenha comentado sobre respostas mais baratas).

Se as conclusões do novo artigo estiverem corretas, qualquer usuário empresarial do ChatGPT que seguisse essa linha de pensamento teria gasto mais com a inferência do ChatGPT em 2025 do que os usuários que ofereciam uma cortesia mínima nas trocas do ChatGPT.

Os autores sugerem que uma possível solução seria estabelecer um teto de tokens para as respostas, embora isso não seja uma abordagem que os sistemas LLM possam implementar facilmente. Eles observam que o prompt é uma ferramenta fraca para controle de custo, porque os LLMs lutam para obedecer instruções de comprimento explícitas. Na maioria dos casos, essa diretiva ‘limitante’ não seria obedecida; além disso, a resposta poderia ser truncada, porque os LLMs desse tipo estão basicamente adivinhando a próxima palavra provável em uma sentença/parágrafo, e, como tal, não sabem como a história termina – ou onde a história termina – até que o processamento seja concluído. Portanto, eles têm uma capacidade limitada de ‘encerrar’ qualquer maquinaria em andamento a pedido.

Faltando uma solução exata – embora sugerindo que abordagens de preços mais transparentes sejam aplicadas em casos como este – os autores concluem:

‘A sabedoria convencional sugere que a cortesia do prompt é desnecessária ao interagir com LLMs.

‘Em contraste, nosso trabalho demonstra que prompts não corteses aumentam os tokens de saída, gerando custos adicionais para os adotantes de IA empresarial.’

O novo artigo é intitulado Transparência de Custo da Adoção de IA Empresarial, e vem de três pesquisadores da Universidade de Iowa.

Método

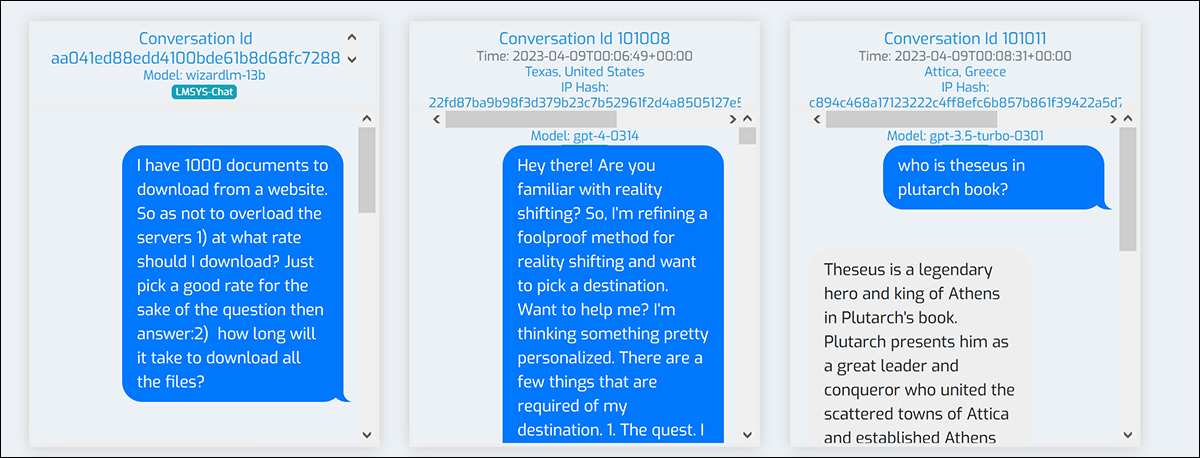

Os dados para o sistema foram extraídos do conjunto de dados WildChat, que compreende uma coleção de 1 milhão de conversas entre usuário e ChatGPT, e apresenta mais de 2,5 milhões de turnos de interação:

De um site de apoio ao projeto WildChat, exemplos pesquisáveis de interações do ChatGPT. Fonte

Os autores observam que o WildChat contém uma quantidade maior de interações naturais do que em alguns conjuntos mais curados.

Eles escolheram 20.000 prompts em inglês da coleção de trocas do GPT-4, descartando a saída em cada caso (já que a intenção era alimentar os prompts novamente, para respostas novas). Apenas a primeira interação foi escolhida, mesmo em trocas mais longas,

O conjunto resultante foi filtrado em categorias cortês ou não cortês, com todos os prompts classificados pelo GPT-4-Turbo. Os pesquisadores usaram o modelo em si para decidir se um prompt era cortês ou não, porque a percepção de cortesia do modelo era central para o experimento.

Prompts rotulados como cortês podiam incluir pistas claras, como a palavra ‘por favor’, ou podiam ser corteses de uma maneira mais indireta. Qualquer coisa que não fosse reconhecida como cortês foi classificada como não cortês, mesmo que a redação fosse neutra em vez de antagonista.

Para estudar como o modelo respondeu à cortesia, métodos padrão (ou seja, que tratam o texto como um conjunto de recursos mensuráveis) não puderam ser usados: desde que a cortesia estava incorporada na própria redação, resumir um prompt como uma lista de características teria perdido contexto importante.

Em vez disso, cada prompt foi reescrito para reverter seu tom, com todos os outros elementos mantidos tão semelhantes quanto possível, permitindo a comparação entre pares que diferiam apenas em cortesia:

Exemplos de como prompts corteses e não corteses foram transformados em suas versões contrafatuais, preservando o significado semântico. Fonte

Testes

Cada prompt original foi emparelhado com uma versão reescrita que diferia apenas em seu nível de cortesia, e ambas as versões foram submetidas ao mesmo modelo GPT-4-Turbo por meio de chamadas de API separadas. O número de tokens produzidos em resposta a cada versão foi registrado, e a diferença entre eles tratada como a medida de como o tom influenciou (token) custo.

Temperatura foi mantida constante para prevenir variação aleatória, e pares de prompts foram retidos apenas quando a reescrita alterou a entrada por no máximo cinco tokens. Isso assegurou que o efeito sendo estudado surgisse de tom, em vez de qualquer mudança mais ampla na redação:

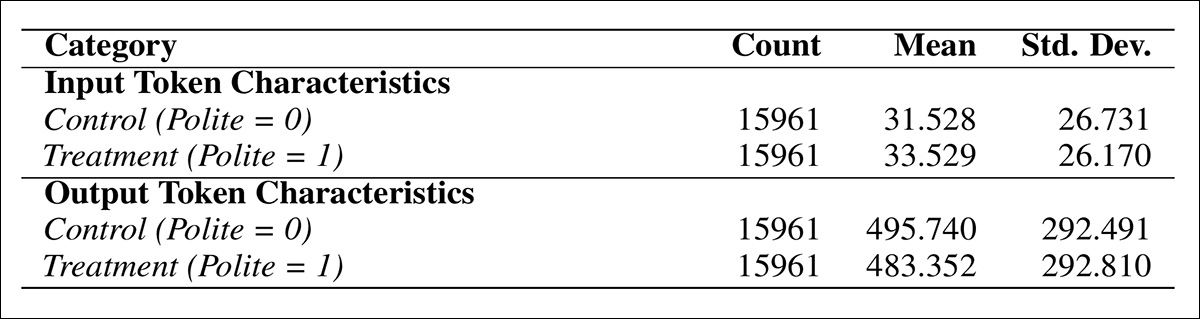

Estatísticas resumidas mostrando que prompts corteses resultaram em menos tokens de saída, em média, do que prompts não corteses, apesar de terem ligeiramente mais tokens de entrada.

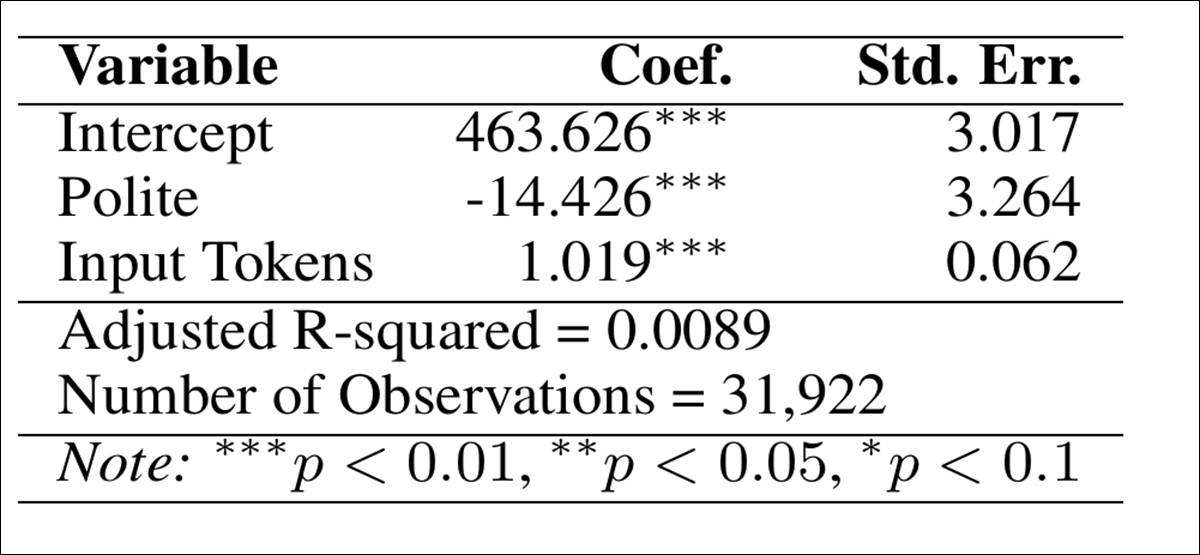

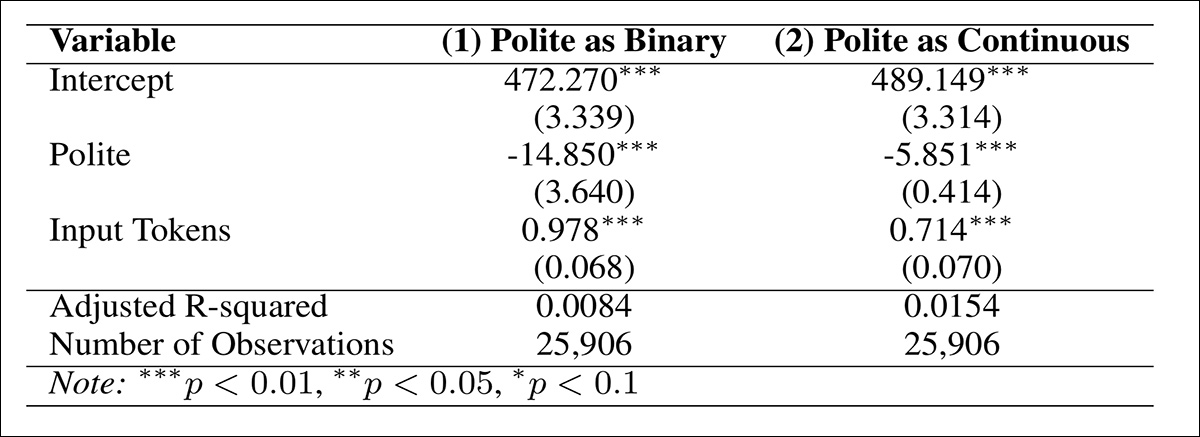

Os principais resultados para a primeira rodada de testes indicaram que o uso de um prompt cortês reduz a longitude do token de saída em 14,426 tokens:

Resultados de estimação delineando o efeito do formato de prompt cortês na longitude da saída gerada (tokens).

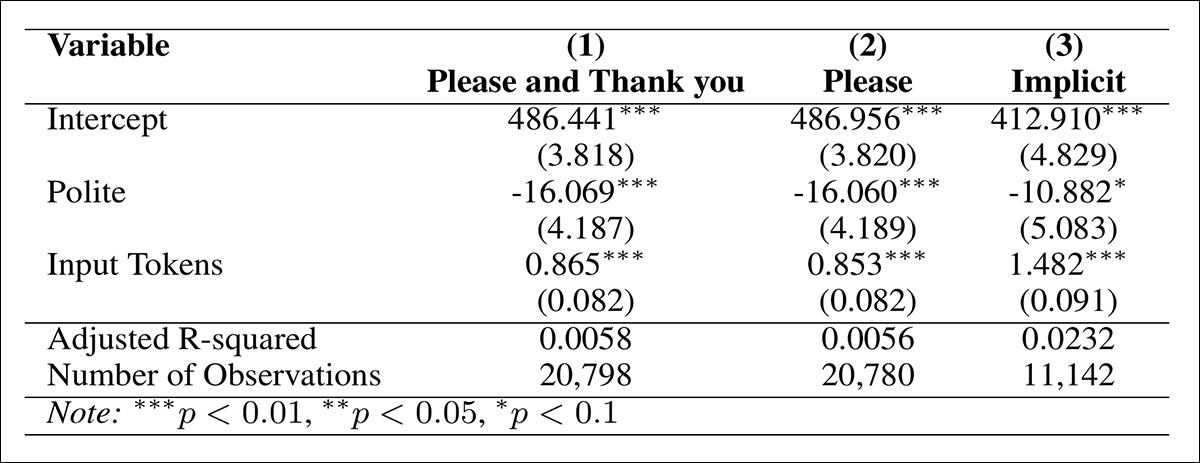

A análise foi repetida em três subconjuntos de prompts corteses para testar a robustez: prompts que usavam marcadores explícitos, como ‘por favor’ ou ‘obrigado’; aqueles que usavam apenas ‘por favor’; e aqueles com cortesia implícita, como ‘você pode’ ou ‘você poderia’:

Resultados de estimação com base em tipos de cortesia.

Para validar a robustez dos principais achados, uma classificação secundária de cortesia do prompt foi realizada usando o quadro de trabalho LIWC, que fornece uma pontuação determinística e repetível para recursos linguísticos.

Ao contrário da classificação probabilística do GPT, o LIWC pode atribuir uma pontuação de cortesia estável a cada prompt, permitindo que a consistência seja avaliada em métodos diversos. Nesta parte dos testes, prompts foram rotulados como cortês se sua pontuação de cortesia do LIWC fosse maior que zero, e como não cortês de outra forma.

Quando a concordância entre as classificações do LIWC e do GPT foi medida, uma taxa de correspondência de 81% foi observada. Embora não seja uma medida de precisão, essa concordância forneceu suporte para a consistência entre os sistemas.

Quando apenas prompts com rótulos de cortesia correspondentes do LIWC e do GPT foram analisados, prompts corteses ainda levaram a 14 tokens menos; e quando a cortesia foi medida em uma escala contínua, cada passo para cima na cortesia reduziu a saída em cinco tokens em média:

Economia de tokens da cortesia manteve-se quando reclassificada com o LIWC, tanto como um rótulo binário quanto como uma pontuação contínua.

Resiliência

Para avaliar se o efeito da cortesia variava em diferentes tipos de prompts, cada prompt foi atribuído a uma das categorias de tarefa pré-definidas: busca de informação; geração de texto; edição e reescrita; classificação; sumarização; e tarefas técnicas.

Cada prompt foi atribuído a um rótulo de tarefa comparando sua incorporação com as de descrições de tarefa pré-definidas, usando o modelo all-MiniLM-L6-v2 Sentence Transformers.

Pontuações de similaridade coseno foram calculadas entre cada prompt e o conjunto de definições de tarefa, e o rótulo com a similaridade mais alta foi atribuído.

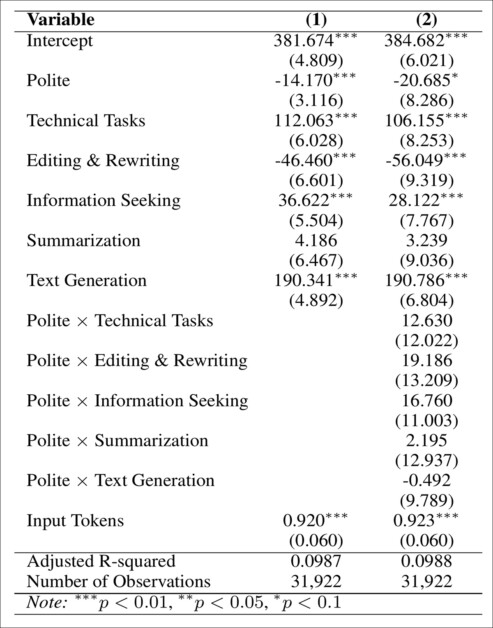

As categorias de tarefa foram então reutilizadas como variáveis de controle na regressão, para testar se o efeito da cortesia variava por categoria de prompt, e termos de interação entre tarefa e tratamento também foram introduzidos, para verificar efeitos diferenciais.

Em ambos os casos, prompts corteses consistentemente produziram saídas mais curtas, e nenhuma variação significativa foi encontrada em todos os tipos de tarefa:

Resultados de regressão demonstrando que prompts corteses reduziram a longitude da saída em todos os tipos de tarefa, sem efeitos de interação significativos.

Para testar se respostas mais curtas de prompts corteses refletiam uma redução na qualidade, as saídas dos prompts originais e contrafatuais foram comparadas para similaridade semântica. Usando o modelo all-MiniLM-L6-v2, cada resposta foi incorporada em um espaço de vetor semântico, e a similaridade coseno foi computada entre cada par, resultando em uma similaridade média de 0,78, indicando uma forte alinhamento em significado, e sugerindo que o conteúdo permaneceu consistente mesmo quando o tom mudou.

Palavras de Parada

Para entender que tipo de conteúdo é reduzido em saídas mais curtas, as palavras mais frequentemente eliminadas foram examinadas. Essas foram encontradas como palavras comuns de parada como ‘ter’, ‘mais’, ‘onde’, e ’em’, ou seja, termos que servem a papéis gramaticais em vez de semânticos.

Para confirmar que a redução de tokens não foi impulsionada pela perda de conteúdo significativo, as palavras de parada foram removidas, e frases de até quatro palavras foram analisadas para desaparecimento sistemático; no entanto, nenhum padrão consistente ou semanticamente importante foi encontrado, sugerindo que as reduções da redação cortês não estavam removendo conteúdo significativo ou útil.

Assim, ainda parecia que mais tokens estavam sendo gastos em respostas a consultas descorteses do que corteses – como uma espécie de ‘imposto’ sobre a brusquidão.

Estudo Humano

Para testar se a qualidade da saída era afetada pelo tom do prompt, uma avaliação humana também foi realizada, usando uma amostra aleatória de vinte prompt cortês e vinte prompt não cortês pares.

Depois de excluir prompts sobre tópicos sensíveis ou técnicos, as respostas foram avaliadas por 401 participantes em uma escala de sete pontos. Cada participante viu apenas uma resposta, extraída de uma das quatro condições: cortês ou não cortês, e ou original ou contrafutual.

Nenhuma diferença significativa foi encontrada na qualidade percebida em qualquer uma dessas condições. Cortês e não cortês saídas receberam pontuações quase idênticas, assim como originais e contrafatuais versões.

Os autores afirmam que esses resultados indicam que a redução nos tokens de saída não foi causada por nenhuma perda de qualidade, mas sim por reescrita, ou por meio de mudanças estruturais que, no entanto, preservaram o significado.

A diferença de custo observada na solicitação empresarial, portanto, é improvável que reflita mudanças na utilidade ou clareza, e o ‘imposto’ ainda está operativo.

Conclusão

Embora o novo trabalho se concentre no uso empresarial do ChatGPT, os usuários de nível inferior também são afetados por esse sintoma, desde que mesmo os dois níveis de entrada tenham limites de uso; e – presumivelmente – tratar o ChatGPT de forma grosseira acelerará o usuário médio em direção ao esgotamento da alocação diária de tokens.

O novo estudo se concentra em uma pergunta aberta e muito estudada em interações humano/AI; mas os autores enfatizam que questões em torno da cortesia devem ser tomadas como indicadores de um possível poço mais profundo de peculiaridades linguísticas, ainda não descobertas, que podem acabar afetando os encargos por inferência.

Publicado pela primeira vez na quarta-feira, 19 de novembro de 2025