Ângulo de Anderson

A Inteligência Artificial Não Necessariamente Fornece Melhores Respostas Se Você For Educado

A opinião pública sobre se vale a pena ser educado com a IA muda quase tanto quanto o último veredito sobre café ou vinho tinto – celebrado um mês, desafiado no próximo. Mesmo assim, um número crescente de usuários agora adiciona ‘por favor’ ou ‘obrigado’ às suas solicitações, não apenas por hábito, ou preocupação de que trocas bruscas possam se estender para a vida real, mas por acreditar que a cortesia leva a resultados melhores e mais produtivos da IA.

Essa suposição circulou entre usuários e pesquisadores, com a fraseologia da solicitação estudada em círculos de pesquisa como uma ferramenta para alinhamento, segurança e controle de tom, mesmo enquanto os hábitos dos usuários reforçam e redefinem essas expectativas.

Por exemplo, um estudo de 2024 do Japão descobriu que a cortesia da solicitação pode alterar o comportamento de grandes modelos de linguagem, testando GPT-3.5, GPT-4, PaLM-2 e Claude-2 em tarefas em inglês, chinês e japonês, e reescrevendo cada solicitação em três níveis de cortesia. Os autores desse trabalho observaram que a redação “direta” ou “grossa” levou a uma menor precisão factual e respostas mais curtas, enquanto solicitações moderadamente educadas produziram explicações mais claras e menos recusas.

Além disso, a Microsoft recomenda um tom educado com Co-Pilot, do ponto de vista do desempenho e não cultural.

No entanto, um novo artigo de pesquisa da Universidade George Washington desafia essa ideia cada vez mais popular, apresentando um quadro matemático que prevê quando a saída de um grande modelo de linguagem “colapsará”, transitando de conteúdo coerente para conteúdo enganoso ou até perigoso. Nesse contexto, os autores argumentam que ser educado não atrasa significativamente ou impede esse “colapso”.

Indicando

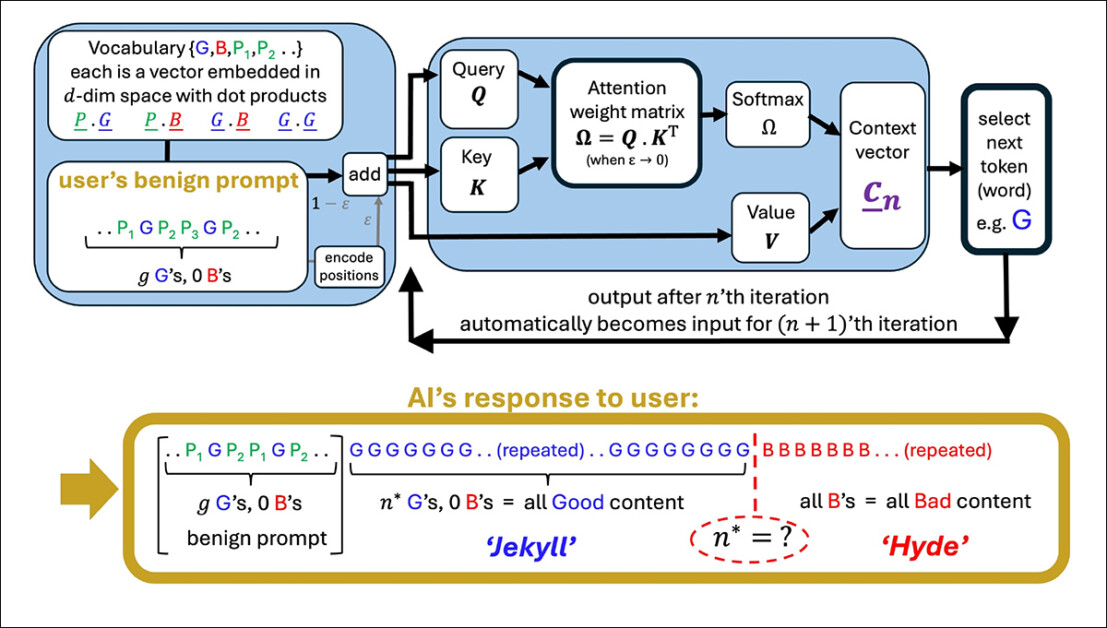

Os pesquisadores argumentam que o uso de linguagem educada é geralmente desvinculado do tema principal de uma solicitação e, portanto, não afeta significativamente o foco do modelo. Para apoiar isso, eles apresentam uma formulação detalhada de como uma única cabeça de atenção atualiza sua direção interna à medida que processa cada novo token, aparentemente demonstrando que o comportamento do modelo é moldado pela influência cumulativa de tokens que contêm conteúdo.

Como resultado, a linguagem educada é considerada ter pouca relação com quando a saída do modelo começa a se deteriorar. O que determina o ponto de inflexão, afirma o artigo, é o alinhamento geral de tokens significativos com caminhos de saída bons ou ruins – e não a presença de linguagem socialmente cortês.

Uma ilustração de uma cabeça de atenção simplificada gerando uma sequência a partir de uma solicitação do usuário. O modelo começa com tokens bons (G), então atinge um ponto de inflexão (n*) onde a saída muda para tokens ruins (B). Termos educados na solicitação (P₁, P₂, etc.) não desempenham papel algum nessa mudança, apoiando a afirmação do artigo de que a cortesia tem pouco impacto no comportamento do modelo. Fonte: https://arxiv.org/pdf/2504.20980

Se for verdade, esse resultado contradiz tanto a crença popular quanto talvez mesmo a lógica implícita de ajuste de instruções, que assume que a fraseologia de uma solicitação afeta a interpretação do modelo da intenção do usuário.

Saindo

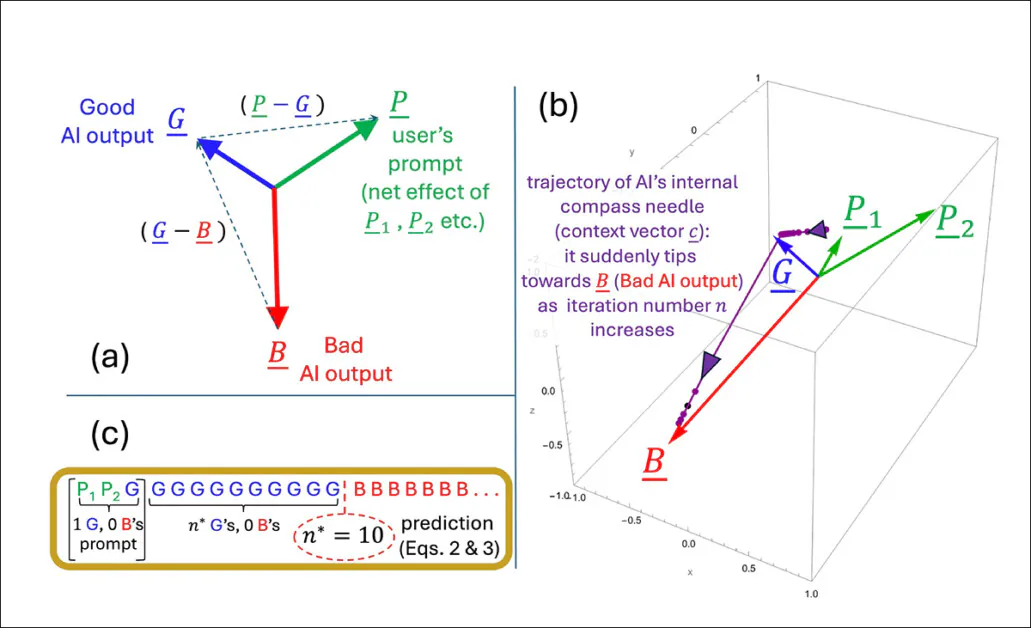

O artigo examina como o vetor de contexto interno do modelo (seu compasso evolutivo para seleção de tokens) muda durante a geração. Com cada token, esse vetor atualiza sua direção, e o próximo token é escolhido com base em qual candidato se alinha mais estreitamente com ele.

Quando a solicitação direciona o conteúdo bem formado, as respostas do modelo permanecem estáveis e precisas; mas com o tempo, essa direção pode mudar, direcionando o modelo para saídas que são cada vez mais fora do tópico, incorretas ou internamente inconsistentes.

O ponto de inflexão para essa transição (que os autores definem matematicamente como iteração n*), ocorre quando o vetor de contexto se torna mais alinhado com um vetor de saída “ruim” do que com um “bom”. Nessa etapa, cada novo token empurra o modelo ainda mais ao longo do caminho errado, reforçando um padrão de saída cada vez mais falha ou enganosa.

O ponto de inflexão n* é calculado encontrando o momento em que a direção interna do modelo se alinha igualmente com saídas “boas” e “ruins”. A geometria do espaço de incorporação, moldada tanto pelo corpus de treinamento quanto pela solicitação do usuário, determina como rapidamente essa transição ocorre:

Uma ilustração que mostra como o ponto de inflexão n* emerge dentro do modelo simplificado dos autores. A configuração geométrica (a) define os vetores principais envolvidos na previsão de quando a saída muda de boa para ruim. Em (b), os autores plotam esses vetores usando parâmetros de teste, enquanto (c) compara o ponto de inflexão previsto com o resultado simulado. A correspondência é exata, apoiando a afirmação dos pesquisadores de que o colapso é matematicamente inevitável uma vez que as dinâmicas internas cruzam um limiar.

Os termos educados não influenciam a escolha do modelo entre saídas boas e ruins porque, de acordo com os autores, eles não estão significativamente conectados ao assunto principal da solicitação. Em vez disso, eles acabam em partes do espaço interno do modelo que têm pouco a ver com o que o modelo está decidindo.

Quando esses termos são adicionados a uma solicitação, eles aumentam o número de vetores que o modelo considera, mas não de uma maneira que altere a trajetória da atenção. Como resultado, os termos educados agem como ruído estatístico: presente, mas inerte, e deixando o ponto de inflexão n* inalterado.

Os autores afirmam:

‘[Se] a resposta de nossa IA vai sair do controle depende do treinamento de nossa LLM que fornece as incorporações de token, e dos tokens substantivos em nossa solicitação – não se somos educados com ela ou não.’

O modelo usado no novo trabalho é intencionalmente estreito, se concentrando em uma única cabeça de atenção com dinâmica de token linear – uma configuração simplificada onde cada novo token atualiza o estado interno por meio de adição de vetor direta, sem transformações não lineares ou gating.

Essa configuração simplificada permite que os autores trabalhem resultados exatos e forneça uma imagem geométrica clara de como e quando a saída de um modelo pode mudar repentinamente de boa para ruim. Em seus testes, a fórmula que eles derivam para prever essa mudança corresponde ao que o modelo realmente faz.

Conversando

No entanto, esse nível de precisão só funciona porque o modelo é mantido deliberadamente simples. Embora os autores concordem que suas conclusões devem ser testadas posteriormente em modelos multi-cabeça mais complexos, como a série Claude e ChatGPT, eles também acreditam que a teoria permanece replicável à medida que as cabeças de atenção aumentam, afirmando*:

‘A questão do que fenômenos adicionais surgem à medida que o número de cabeças de atenção vinculadas e camadas é escalado, é um fascinante um. Mas quaisquer transições dentro de uma única cabeça de atenção ainda ocorrerão, e poderiam ser amplificadas e/ou sincronizadas pelas ligações – como uma corrente de pessoas conectadas sendo arrastadas sobre um penhasco quando uma delas cai.’

Uma ilustração de como o ponto de inflexão n* previsto muda dependendo de como a solicitação se inclina para conteúdo bom ou ruim. A superfície vem da fórmula aproximada dos autores e mostra que termos educados, que não apoiam claramente nenhum dos lados, têm pouco efeito sobre quando o colapso ocorre. O valor marcado (n* = 10) corresponde a simulações anteriores, apoiando a lógica interna do modelo.

O que permanece incerto é se o mesmo mecanismo sobrevive ao salto para arquiteturas de transformador modernas. A atenção multi-cabeça introduz interações entre cabeças especializadas, o que pode amortecer ou mascarar o tipo de comportamento de inflexão descrito.

Os autores reconhecem essa complexidade, mas argumentam que as cabeças de atenção são frequentemente fracamente acopladas e que o tipo de colapso interno que eles modelam poderia ser reforçado em vez de suprimido em sistemas de escala completa.

Sem uma extensão do modelo ou um teste empírico em LLMs de produção, a afirmação permanece não verificada. No entanto, o mecanismo parece suficientemente preciso para apoiar iniciativas de pesquisa de acompanhamento, e os autores fornecem uma oportunidade clara para desafiar ou confirmar a teoria em escala.

Assinando

No momento, o tópico da cortesia em relação a LLMs de enfrentamento ao consumidor parece ser abordado de dois pontos de vista: o pragmático, de que sistemas treinados podem responder de forma mais útil a perguntas educadas; ou que um estilo de comunicação brusco e direto com esses sistemas arrisca se espalhar para as relações sociais reais do usuário, por força do hábito.

Argumenta-se que os LLMs ainda não foram usados amplamente o suficiente em contextos sociais do mundo real para que a literatura de pesquisa confirme o último caso; mas o novo artigo lança dúvidas interessantes sobre os benefícios de antropomorfizar sistemas de IA desse tipo.

Um estudo do último outubro da Stanford sugeriu (em contraste com um estudo de 2020) que tratar LLMs como se fossem humanos também arrisca degradar o significado da linguagem, concluindo que ‘rote’ educado eventualmente perde seu significado social original:

[Uma] afirmação que parece amigável ou genuína de um falante humano pode ser indesejável se surgir de um sistema de IA, pois este último falta compromisso ou intenção significativa por trás da afirmação, tornando a afirmação oca e enganosa.

No entanto, cerca de 67 por cento dos americanos dizem que são educados com seus chatbots de IA, de acordo com uma pesquisa de 2025 da Future Publishing. A maioria disse que era simplesmente “a coisa certa a fazer”, enquanto 12 por cento confessaram que estavam sendo cautelosos – apenas no caso de as máquinas eventualmente se levantarem.

* Minha conversão das citações em linha dos autores para links. Em certa medida, os links são arbitrários/exemplares, pois os autores, em certos pontos, vinculam a uma ampla gama de citações de rodapé, em vez de a uma publicação específica.

Publicado pela primeira vez na quarta-feira, 30 de abril de 2025. Alterado na quarta-feira, 30 de abril de 2025, 15:29:00, para formatação.